一、深度與模塊化

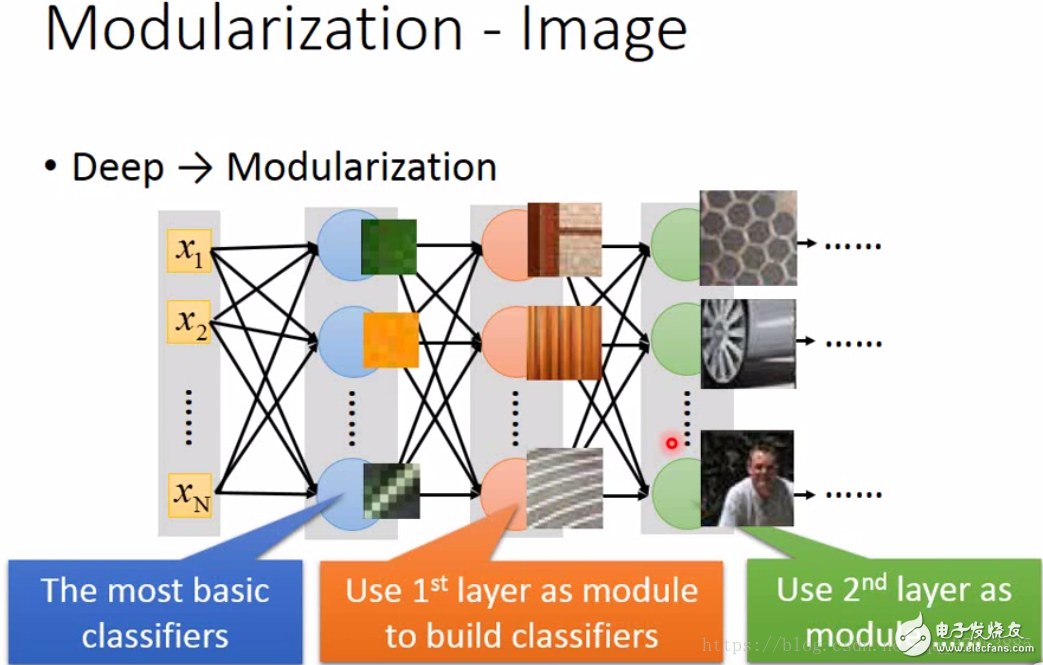

對于一個分類的問題的簡化,我們可以先訓練一個Basic classfier,然后將其共享給following classfier,通過多層的分類器進行特征的提取,用較少的數據就可以訓練好網絡。而在deep的模型當中,Basic classfier是由神經網絡自己學到的,然后通過更多層的網絡可以使得classfier逐漸學到更加深層次的特征。這就是deep network能夠work的原因。

二、模塊化與語音識別

語音識別的大致步驟:

②將狀態轉化成音素

③將音素轉化成為文字

④考慮同音異字的問題

傳統方法:

HMM-GMM,每一個音素都有自己獨立的分布,找出所有音素的分布,然后根據條件概率求出所給的數據屬于哪一個音素。

DNN:

所有的狀態都共用一個DNN。訓練時DNN會根據訓練數據來學習人所發出的聲音時的舌頭位置,然后根據不同的舌頭位置將發出聲音映射到不同的特征空間從而達到分類的目的。

相比于傳統的語音識別方法,DNN可以利用同一組的檢測器來識別不同的語音,做到了模塊化,使得參數的使用更加有效率。

Universality Theorem指出:對于所有的函數 f : RN→RM 都可以用只有一個隱藏層的神經網絡來實現,只要隱藏單元的個數足夠。雖然淺層的神經網絡可以擬合任何的函數,但是采用深層的結構可以提高模型的效率,因為深度的網絡可以表征更加復雜的特征空間(保證淺層與深層的網絡具有同樣數量的參數),即可以通過相對較少的參數便可以實現淺層神經網絡的功能。可以類比電路中的多層門電路可以利用較少的門來實現一層門電路的功能。也可以類比剪窗花的過程,通過對折我們可以把特征空間進行對折,通過較少的幾剪(數據)便可以剪出復雜的形狀。

三、端到端的學習

通過一個較為復雜的function將多個simple function組合在一起,端到端的網絡可以自動地學習到每一個simple function應該完成的任務。

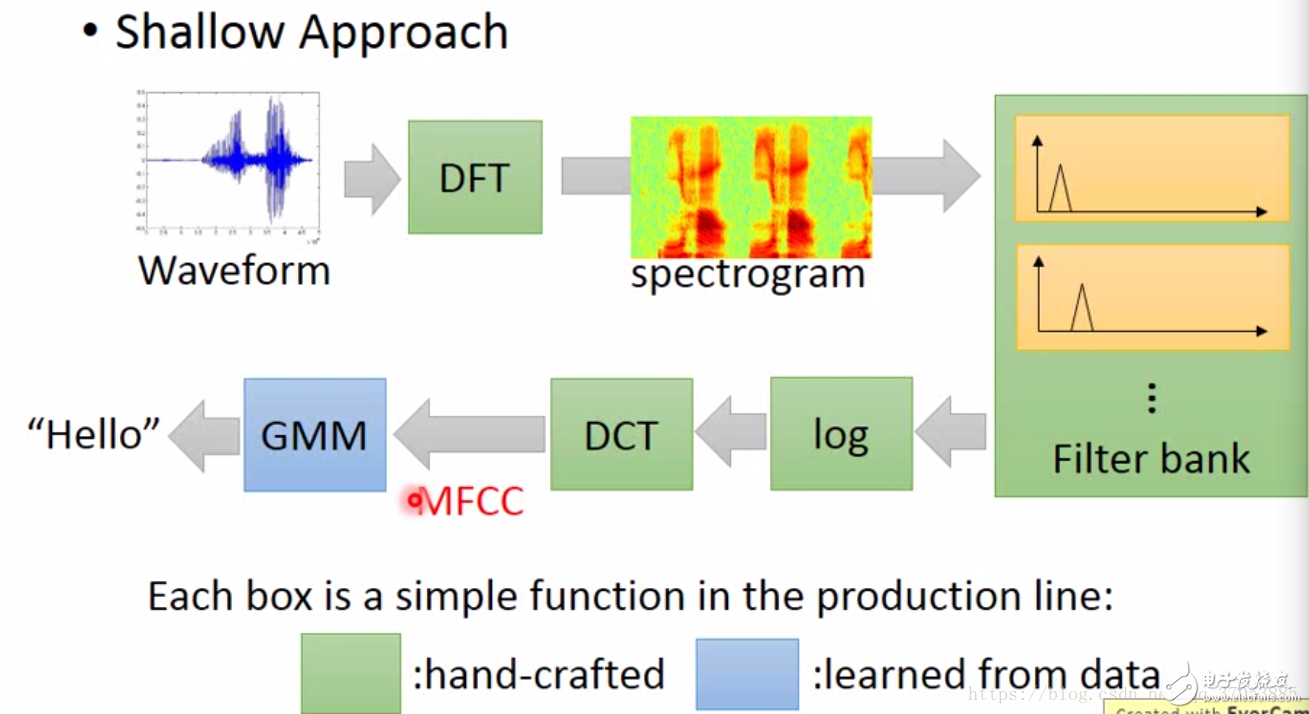

在傳統的語音識別的過程中需要大量的手工提取工作,流程如下圖所示:

圖片中只有GMM是需要通過訓練數據進行訓練的,其余均為根據先驗的經驗來進行設計。

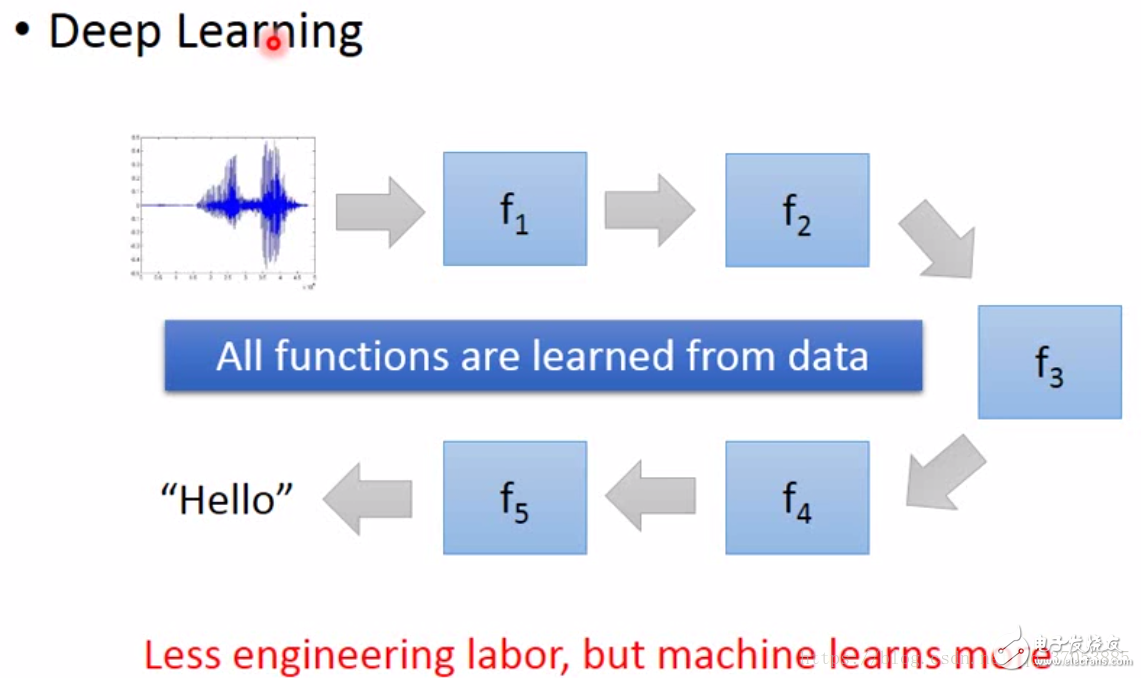

而在深度學習中的語音識別的架構如下圖所示:

每個函數都可以通過數據來進行訓練,學習到函數中的參數。在圖像識別中,端到端相對于傳統方法的優勢與語音識別類似。

四、深度可以完成復雜的任務

①處理相似的輸入,但不同的輸出問題

②處理不同的輸入,但相似的輸出問題

深度學習可以通過多個layer的轉換學習更高維度的特征來解決更加復雜的任務。

-

語音識別

+關注

關注

39文章

1778瀏覽量

114076 -

深度學習

+關注

關注

73文章

5557瀏覽量

122658

發布評論請先 登錄

深度學習能解決什么任務

深度學習能解決什么任務

評論