1. STM32 嵌入式機器學習(TinyML)實戰教程-01 | 邊緣智能實驗室

第1部分:總體介紹 在STM32H747I Discovery開發板上,使用機器學習技術,開發機器視覺應用,本教程由ST(意法半導體)官方發布。 邊緣智能實驗室原創中文字幕,感謝支持。視頻中涉及的文檔(也可到ST官網下載):

鏈接:https://pan.baidu.com/s/1K1Dr2vMUZ8UmtVbZHkKAVA

提取碼:w41p

2. 為AI而生,打破存儲墻,佐治亞理工等提出新型嵌入式無電容DRAM | 機器之心

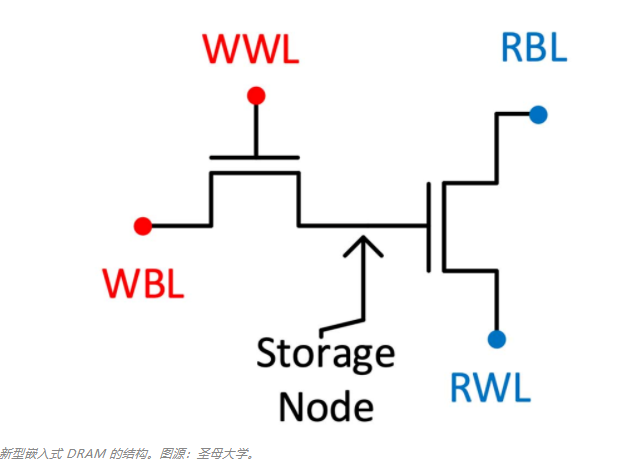

當今計算中最大的問題之一是「存儲墻」,即處理時間與將數據從單獨的 DRAM 存儲器芯片傳送到處理器所花費時間之間的差距。AI 應用的日益普及只會加劇該問題,因為涉及面部識別、語音理解、消費商品推薦的巨大網絡很少能容納在處理器的板載內存上。 在 2020 年 12 月舉行的 IEEE 國際電子設備會議(IEDM)上,一些研究小組認為:一種新型的 DRAM 可能成為「存儲墻」問題的解決方案。他們表示:「這種新型的 DRAM 由氧化物半導體制成,并內置在處理器上方的各層中,其位長是商用 DRAM 的數百或數千倍,并且在運行大型神經網絡時可以提供較大的區域,節省大量能源。」 新型嵌入式 DRAM 僅由兩個晶體管制成,沒有電容器,簡稱為 2T0C。之所以可以這樣做,是因為晶體管的柵極是天然的電容器(盡管有些小)。因此代表該位的電荷可以存儲在此處。該設計具有一些關鍵優勢,特別是對于 AI 來說。

原文鏈接:https://spectrum.ieee.org/tech-talk/semiconductors/memory/new-type-of-dram-could-accelerate-ai

3. 明年,我要用 AI 給全村寫對聯 | HyperAI超神經

春節接近尾聲,你是否還沉浸在年味里? 年前的臘月二十九、三十,家家戶戶都要開始貼春聯了。今年,各種 AI 寫春聯應用都紛紛上線,幫大家寫春聯,要不來試試? 對聯對聯,講究的就是「成對」,要對仗工整,平仄協調。不過現代人的對對聯技能,已經遠不如古代的文人墨客,甚至有時候可能連上下聯都傻傻分不清楚。而聰明的 AI 已經學會自己寫對聯了。

測試地址:

https://ai.binwang.me/couplet/

Github:

https://github.com/wb14123/couplet-dataset

數據集地址:

https://hyper.ai/datasets/14547

4. DeepMind最新研究NFNet:拋棄歸一化,深度學習模型準確率卻達到了前所未有的水平 | 機器之心

Paper:

https://arxiv.org/abs/2102.06171

DeepMind 還放出了模型的實現:

https://github.com/deepmind/deepmind-research/tree/master/nfnets

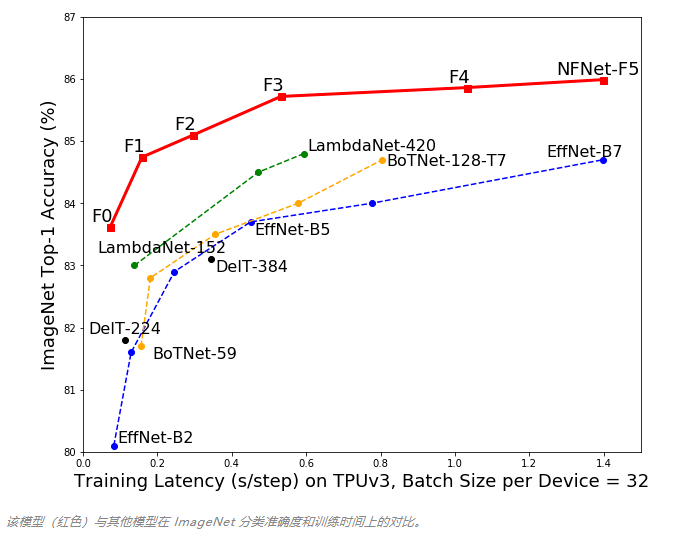

我們知道,在傳遞給機器學習模型的數據中,我們需要對數據進行歸一化(normalization)處理。 在數據歸一化之后,數據被「拍扁」到統一的區間內,輸出范圍被縮小至 0 到 1 之間。人們通常認為經過如此的操作,最優解的尋找過程明顯會變得平緩,模型更容易正確的收斂到最佳水平。 然而這樣的「刻板印象」最近受到了挑戰,DeepMind 的研究人員提出了一種不需要歸一化的深度學習模型 NFNet,其在大型圖像分類任務上卻又實現了業內最佳水平(SOTA)。 該論文的第一作者,DeepMind 研究科學家 Andrew Brock 表示:「我們專注于開發可快速訓練的高性能體系架構,已經展示了一種簡單的技術(自適應梯度裁剪,AGC),讓我們可以訓練大批量和大規模數據增強后的訓練,同時達到 SOTA 水平。」

5. 在游戲里還原自己的臉,給AI一張照片就行,網易&密歇根大學出品 | AAAI 2021 開源 | 量子位

論文地址:

https://arxiv.org/abs/2102.02371

GitHub地址:

https://github.com/FuxiCV/MeInGame

給AI一張毛不易的照片,它自動就能生成一個古風毛大俠。

現在,想在游戲里定制化自己的臉,你可以不用自己花時間琢磨參數了。 熟悉游戲的小伙伴可能認出來了,這一套AI捏臉術,來自網易伏羲人工智能實驗室和密歇根大學。 現在,最新相關研究登上了AAAI 2021。 據作者介紹,這個名為MeInGame的方法,可以集成到大多數現有的3D游戲中,并且相比于單純基于3DMM(3D Morphable Face Model )的方法,成本更低,泛化性能更好。

6. 谷歌開源計算框架JAX:比Numpy快30倍,還可在TPU上運行! | 新智元

Github:

https://github.com/google/jax

快速入門鏈接:

https://jax.readthedocs.io/en/latest/notebooks/quickstart.html

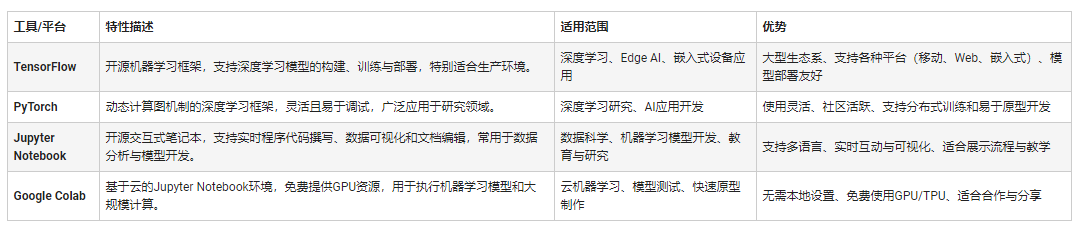

相信大家對numpy, Tensorflow, Pytorch已經極其熟悉,不過,你知道JAX嗎? JAX發布之后,有網友進行了測試,發現,使用JAX,Numpy運算可以快三十多倍!下面是使用Numpy的運行情況:

1importnumpyasnp#使用標準numpy,運算將在CPU上執行。 2x=np.random.random([5000,5000]).astype(np.float32) 3%timeitnp.matmul(x,x)

運行結果:

1 loop, best of 3: 3.9 s per loop

而下面是使用JAX的Numpy的情況:

1importjax.numpyasnp#使用"JAX版"的numpy 2fromjaximportrandom#注意JAX下隨機數API有所不同 3x=random.uniform(random.PRNGKey(0),[5000,5000]) 4%timeitnp.matmul(x,x)

運行情況:

1 loop, best of 3: 109 ms per loop

我們可以發現,使用原始numpy,運行時間大概為3.9s,而使用JAX的numpy,運行時間僅僅只有0.109s,速度上直接提升了三十多倍! 那JAX到底是什么? JAX是谷歌開源的、可以在CPU、GPU和TPU上運行的numpy,是針對機器學習研究的高性能自微分計算框架。簡單來說,就是GPU和TPU加速、支持自動微分(autodiff)的numpy。

7. 大年初四,宜學習:MIT 6.S191視頻、PPT上新!網友:這是最好的深度學習入門課之一 | 機器之心

課程主頁:http://introtodeeplearning.com/

原文標題:【20210219期AI簡報】嵌入式機器學習(TinyML)實戰教程、谷歌開源計算框架JAX...

-

嵌入式

+關注

關注

5144文章

19575瀏覽量

315796 -

STM32

+關注

關注

2291文章

11019瀏覽量

363026 -

AI

+關注

關注

88文章

34589瀏覽量

276226 -

開源

+關注

關注

3文章

3634瀏覽量

43585 -

機器學習

+關注

關注

66文章

8497瀏覽量

134228

原文標題:【20210219期AI簡報】嵌入式機器學習(TinyML)實戰教程、谷歌開源計算框架JAX...

文章出處:【微信號:RTThread,微信公眾號:RTThread物聯網操作系統】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

嵌入式開發入門指南:從零開始學習嵌入式

飛凌嵌入式2025嵌入式及邊緣AI技術論壇圓滿結束

飛凌嵌入式2025嵌入式及邊緣AI技術論壇圓滿結束

飛凌嵌入式「2025嵌入式及邊緣AI技術論壇」議程公布

新生態 智未來「飛凌嵌入式2025嵌入式及邊緣AI技術論壇」開啟報名!

嵌入式學習建議

嵌入式系統的未來趨勢有哪些?

開啟全新AI時代 智能嵌入式系統快速發展——“第六屆國產嵌入式操作系統技術與產業發展論壇”圓滿結束

恩智浦加速嵌入式AI創新應用開發

AI普及給嵌入式設計人員帶來新挑戰

嵌入式機器學習和AI前沿資訊簡報

嵌入式機器學習和AI前沿資訊簡報

評論