推理和訓(xùn)練作為AI/ML關(guān)鍵的一環(huán),無論是通用的GPU,還是專用的推理/訓(xùn)練加速器,都想在各大流行模型和機(jī)器學(xué)習(xí)庫上跑出優(yōu)秀的成績,以展示自己的硬件實(shí)力。業(yè)界需要一個(gè)統(tǒng)一的跑分標(biāo)準(zhǔn),為此,各大廠商在2018年根據(jù)業(yè)內(nèi)指標(biāo)聯(lián)合打造的MLPerf就承擔(dān)了這一重任。

不過隨著時(shí)間的推移,MLPerf幾乎已經(jīng)成了英偉達(dá)一家獨(dú)大的跑分基準(zhǔn),這家GPU廠商憑借自己的產(chǎn)品幾乎統(tǒng)治著整個(gè)AI硬件市場。這不,近日公布的MLPerf Training 2.0,就將這些AI硬件公司和服務(wù)器廠商提交的具體AI訓(xùn)練成績公布了出來,其中既有一些新晉成員,也有一些出人意料的結(jié)果。

谷歌的反超

這次跑分結(jié)果中,最驚艷的還是谷歌的TPU v4系統(tǒng),谷歌憑借這一架構(gòu)的系統(tǒng),在五個(gè)基準(zhǔn)測試中都打破了性能記錄,平均訓(xùn)練速度比第二名的英偉達(dá)A100系統(tǒng)快了1.42倍左右,哪怕是與自己在1.0測試下的成績相比,也提升了1.5倍。

能實(shí)現(xiàn)這樣的成績自然離不開谷歌自己的TPU芯片設(shè)計(jì),谷歌的每個(gè)TPU v4 Pod都由4096個(gè)芯片組成,且?guī)捵龅搅?Tbps。除此之外,谷歌有著豐富的用例經(jīng)驗(yàn),相較其他公司而言,谷歌是唯一一個(gè)在搜索和視頻領(lǐng)域都已經(jīng)大規(guī)模普及AI/ML應(yīng)用的。

TPU v4與A100的對比 / 谷歌

不過谷歌與英偉達(dá)并不是直接競爭關(guān)系,他們對標(biāo)的還是使用英偉達(dá)GPU系統(tǒng)的云服務(wù)公司,比如微軟的Azure,谷歌也為此特地做了成本對比。如上圖所示,在BERT模型的訓(xùn)練中,4096個(gè)TPU v4芯片與Azure 4096個(gè)A100芯片對比,谷歌的方案可以節(jié)省35%,ResNet模型的訓(xùn)練下更是可以節(jié)省近50%。

不過以上的成績在所有8項(xiàng)測試中也只是和英偉達(dá)平分秋色,而且隨著系統(tǒng)規(guī)模的不同,其結(jié)果或許會有更多的變化。再者,谷歌的TPU僅限于其自己的云服務(wù),所以總的來說并不算一個(gè)通用方案,至少微軟和亞馬遜這樣的競爭對手肯定是用不上。

英偉達(dá)地位不保?

除了谷歌之外,還取得了不錯的成績的就是英特爾旗下Habana Labs的Gaudi2訓(xùn)練加速器。這款今年5月推出的處理器,從上一代的16nm換成了臺積電7nm,Tensor處理器內(nèi)核的數(shù)量因此增加了兩倍,使其在ResNet-50的訓(xùn)練吞吐量上實(shí)現(xiàn)了3倍提升,BERT的訓(xùn)練吞吐量提升了4.7倍。

Gaudi 2訓(xùn)練處理器 / 英特爾

在與英偉達(dá)提交的A100-80GB GPU系統(tǒng)成績相比,Gaudi2在ResNet-50上的訓(xùn)練時(shí)間縮短了36%;與戴爾提交的A100-40GB GPU系統(tǒng)成績相比,Gaudi2在BERT上的訓(xùn)練時(shí)間縮短了45%。

從結(jié)果來看,已經(jīng)有不少廠商的AI硬件已經(jīng)可以在訓(xùn)練上對標(biāo)甚至超過英偉達(dá)的GPU生態(tài)了,但這并不代表全部機(jī)器學(xué)習(xí)訓(xùn)練領(lǐng)域。比如在測試中,廠商是不需要將每個(gè)項(xiàng)目的測試結(jié)果都提交上去的。從這個(gè)角度來看,RetinaNet輕量型目標(biāo)檢測、COCO重型目標(biāo)檢測、語音識別數(shù)據(jù)集Librispeech和強(qiáng)化學(xué)習(xí)Minigo這幾個(gè)項(xiàng)目中,只有基于英偉達(dá)GPU的系統(tǒng)提交了成績。

不僅如此,如果你看所有提交成績的服務(wù)器和云服務(wù)公司來看,他們用到的CPU或是AMD的EPYC處理器,或是英特爾的Xeon處理器,但加速器卻是幾乎清一色的英偉達(dá)A100。這也證明了在百度、戴爾、H3C、浪潮和聯(lián)想這些廠商的眼中,英偉達(dá)的GPU依然是最具競爭力的那個(gè)。

不可小覷的軟件

還有一點(diǎn)需要指出,那就是以上都是封閉組的成績,他們所用到的都是標(biāo)準(zhǔn)的機(jī)器學(xué)習(xí)庫,比如TensorFlow 2.8.0和Pytorch 22.04等。而開放組則不受此限制,可以用到他們自己定制的庫或優(yōu)化器,這一組中三星和Graphcore都根據(jù)不同的軟件配置提交了成績,但最亮眼的還是MosaicML。

?

?

Composer在ResNet-50下的訓(xùn)練時(shí)間對比 / MosaicML

這家公司所用的加速器硬件同樣是和諸多提交者一樣的英偉達(dá)A100-SXM-80GB GPU,但他們用到的是自己用Pytorch編寫的庫Composer。這家公司于今年4月推出了Composer,并聲稱可讓模型訓(xùn)練速度提升2到4倍。在MLPerf Training 2.0的跑分中,使用MosaicML Composer的對比組在ResNet訓(xùn)練速度上實(shí)現(xiàn)了近4.6倍的提升。不過Composer雖說支持任何模型,但這個(gè)提速的表現(xiàn)目前還是體現(xiàn)在ResNet上比較明顯,所以本次也并沒有提交其他模型下的成績。

考慮到英特爾等公司為了提升其軟件開發(fā)實(shí)力,已經(jīng)在收購Codeplay這樣的軟件開發(fā)公司,MosaicML作為剛公開不久的初創(chuàng)公司,創(chuàng)始人又是英特爾的前AI實(shí)驗(yàn)室骨干,如果能在未來展現(xiàn)出更優(yōu)秀的成績,說不定也會被英偉達(dá)這樣的公司看中。

結(jié)語

英偉達(dá)常年在MLPerf上霸榜,也有不少人認(rèn)為MLPerf跑分成了英偉達(dá)的宣傳工具,然而事實(shí)是英特爾、谷歌等同樣重視AI的公司也將其視為一個(gè)公平的基準(zhǔn)測試,而且MLPerf還有同行評審環(huán)節(jié),進(jìn)一步驗(yàn)證測試結(jié)果。從以上結(jié)果來看,AI訓(xùn)練硬件上的創(chuàng)新仍未停止,無論是GPU、TPU還是IPU都在推陳出新,但跑分結(jié)果并不代表任何用例都能達(dá)到高性能,還需要廠商自己去調(diào)校模型和軟件才能達(dá)成最好的成績。

不過隨著時(shí)間的推移,MLPerf幾乎已經(jīng)成了英偉達(dá)一家獨(dú)大的跑分基準(zhǔn),這家GPU廠商憑借自己的產(chǎn)品幾乎統(tǒng)治著整個(gè)AI硬件市場。這不,近日公布的MLPerf Training 2.0,就將這些AI硬件公司和服務(wù)器廠商提交的具體AI訓(xùn)練成績公布了出來,其中既有一些新晉成員,也有一些出人意料的結(jié)果。

谷歌的反超

這次跑分結(jié)果中,最驚艷的還是谷歌的TPU v4系統(tǒng),谷歌憑借這一架構(gòu)的系統(tǒng),在五個(gè)基準(zhǔn)測試中都打破了性能記錄,平均訓(xùn)練速度比第二名的英偉達(dá)A100系統(tǒng)快了1.42倍左右,哪怕是與自己在1.0測試下的成績相比,也提升了1.5倍。

能實(shí)現(xiàn)這樣的成績自然離不開谷歌自己的TPU芯片設(shè)計(jì),谷歌的每個(gè)TPU v4 Pod都由4096個(gè)芯片組成,且?guī)捵龅搅?Tbps。除此之外,谷歌有著豐富的用例經(jīng)驗(yàn),相較其他公司而言,谷歌是唯一一個(gè)在搜索和視頻領(lǐng)域都已經(jīng)大規(guī)模普及AI/ML應(yīng)用的。

TPU v4與A100的對比 / 谷歌

不過谷歌與英偉達(dá)并不是直接競爭關(guān)系,他們對標(biāo)的還是使用英偉達(dá)GPU系統(tǒng)的云服務(wù)公司,比如微軟的Azure,谷歌也為此特地做了成本對比。如上圖所示,在BERT模型的訓(xùn)練中,4096個(gè)TPU v4芯片與Azure 4096個(gè)A100芯片對比,谷歌的方案可以節(jié)省35%,ResNet模型的訓(xùn)練下更是可以節(jié)省近50%。

不過以上的成績在所有8項(xiàng)測試中也只是和英偉達(dá)平分秋色,而且隨著系統(tǒng)規(guī)模的不同,其結(jié)果或許會有更多的變化。再者,谷歌的TPU僅限于其自己的云服務(wù),所以總的來說并不算一個(gè)通用方案,至少微軟和亞馬遜這樣的競爭對手肯定是用不上。

英偉達(dá)地位不保?

除了谷歌之外,還取得了不錯的成績的就是英特爾旗下Habana Labs的Gaudi2訓(xùn)練加速器。這款今年5月推出的處理器,從上一代的16nm換成了臺積電7nm,Tensor處理器內(nèi)核的數(shù)量因此增加了兩倍,使其在ResNet-50的訓(xùn)練吞吐量上實(shí)現(xiàn)了3倍提升,BERT的訓(xùn)練吞吐量提升了4.7倍。

Gaudi 2訓(xùn)練處理器 / 英特爾

在與英偉達(dá)提交的A100-80GB GPU系統(tǒng)成績相比,Gaudi2在ResNet-50上的訓(xùn)練時(shí)間縮短了36%;與戴爾提交的A100-40GB GPU系統(tǒng)成績相比,Gaudi2在BERT上的訓(xùn)練時(shí)間縮短了45%。

從結(jié)果來看,已經(jīng)有不少廠商的AI硬件已經(jīng)可以在訓(xùn)練上對標(biāo)甚至超過英偉達(dá)的GPU生態(tài)了,但這并不代表全部機(jī)器學(xué)習(xí)訓(xùn)練領(lǐng)域。比如在測試中,廠商是不需要將每個(gè)項(xiàng)目的測試結(jié)果都提交上去的。從這個(gè)角度來看,RetinaNet輕量型目標(biāo)檢測、COCO重型目標(biāo)檢測、語音識別數(shù)據(jù)集Librispeech和強(qiáng)化學(xué)習(xí)Minigo這幾個(gè)項(xiàng)目中,只有基于英偉達(dá)GPU的系統(tǒng)提交了成績。

不僅如此,如果你看所有提交成績的服務(wù)器和云服務(wù)公司來看,他們用到的CPU或是AMD的EPYC處理器,或是英特爾的Xeon處理器,但加速器卻是幾乎清一色的英偉達(dá)A100。這也證明了在百度、戴爾、H3C、浪潮和聯(lián)想這些廠商的眼中,英偉達(dá)的GPU依然是最具競爭力的那個(gè)。

不可小覷的軟件

還有一點(diǎn)需要指出,那就是以上都是封閉組的成績,他們所用到的都是標(biāo)準(zhǔn)的機(jī)器學(xué)習(xí)庫,比如TensorFlow 2.8.0和Pytorch 22.04等。而開放組則不受此限制,可以用到他們自己定制的庫或優(yōu)化器,這一組中三星和Graphcore都根據(jù)不同的軟件配置提交了成績,但最亮眼的還是MosaicML。

?

?Composer在ResNet-50下的訓(xùn)練時(shí)間對比 / MosaicML

這家公司所用的加速器硬件同樣是和諸多提交者一樣的英偉達(dá)A100-SXM-80GB GPU,但他們用到的是自己用Pytorch編寫的庫Composer。這家公司于今年4月推出了Composer,并聲稱可讓模型訓(xùn)練速度提升2到4倍。在MLPerf Training 2.0的跑分中,使用MosaicML Composer的對比組在ResNet訓(xùn)練速度上實(shí)現(xiàn)了近4.6倍的提升。不過Composer雖說支持任何模型,但這個(gè)提速的表現(xiàn)目前還是體現(xiàn)在ResNet上比較明顯,所以本次也并沒有提交其他模型下的成績。

考慮到英特爾等公司為了提升其軟件開發(fā)實(shí)力,已經(jīng)在收購Codeplay這樣的軟件開發(fā)公司,MosaicML作為剛公開不久的初創(chuàng)公司,創(chuàng)始人又是英特爾的前AI實(shí)驗(yàn)室骨干,如果能在未來展現(xiàn)出更優(yōu)秀的成績,說不定也會被英偉達(dá)這樣的公司看中。

結(jié)語

英偉達(dá)常年在MLPerf上霸榜,也有不少人認(rèn)為MLPerf跑分成了英偉達(dá)的宣傳工具,然而事實(shí)是英特爾、谷歌等同樣重視AI的公司也將其視為一個(gè)公平的基準(zhǔn)測試,而且MLPerf還有同行評審環(huán)節(jié),進(jìn)一步驗(yàn)證測試結(jié)果。從以上結(jié)果來看,AI訓(xùn)練硬件上的創(chuàng)新仍未停止,無論是GPU、TPU還是IPU都在推陳出新,但跑分結(jié)果并不代表任何用例都能達(dá)到高性能,還需要廠商自己去調(diào)校模型和軟件才能達(dá)成最好的成績。

聲明:本文內(nèi)容及配圖由入駐作者撰寫或者入駐合作網(wǎng)站授權(quán)轉(zhuǎn)載。文章觀點(diǎn)僅代表作者本人,不代表電子發(fā)燒友網(wǎng)立場。文章及其配圖僅供工程師學(xué)習(xí)之用,如有內(nèi)容侵權(quán)或者其他違規(guī)問題,請聯(lián)系本站處理。

舉報(bào)投訴

-

AI

+關(guān)注

關(guān)注

88文章

35164瀏覽量

279947 -

英偉達(dá)

+關(guān)注

關(guān)注

22文章

3953瀏覽量

93786

發(fā)布評論請先 登錄

相關(guān)推薦

熱點(diǎn)推薦

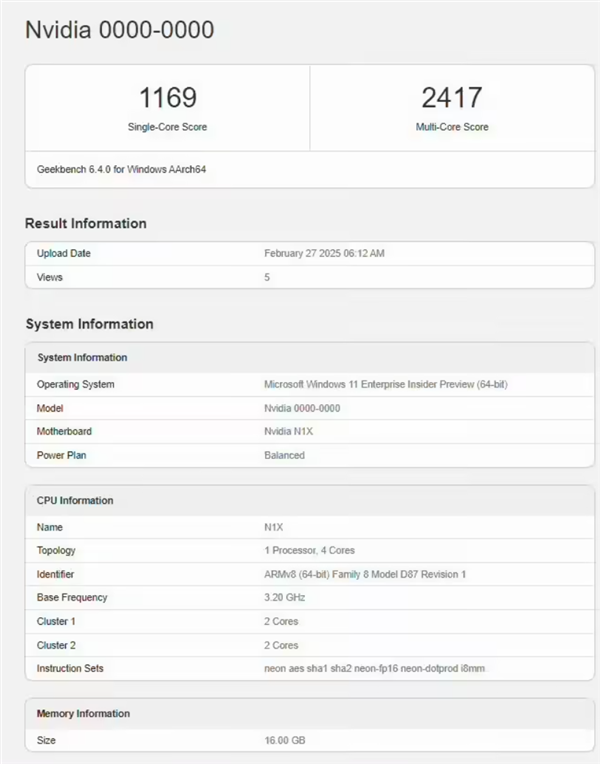

英偉達(dá)重磅殺入Arm AI PC,N1X芯片跑分曝光!結(jié)果比較意外

?電子發(fā)燒友網(wǎng)報(bào)道(文/黃山明)如今我們正處于信息時(shí)代邁入AI時(shí)代的過渡期,而作為AI時(shí)代最大的“賣鏟人”,英偉達(dá)算是吃盡了時(shí)代的紅利。不僅將公司一舉帶上了全球第一的市值,更是讓

IBM攜手英偉達(dá)AI數(shù)據(jù)平臺推動企業(yè)級AI創(chuàng)新

近日,IBM(紐約證券交易所:IBM)宣布與英偉達(dá)(納斯達(dá)克股票代碼:NVDA)開展全新合作,雙方將基于英偉達(dá) AI 數(shù)據(jù)平臺參考架構(gòu)(re

發(fā)表于 03-24 19:20

?240次閱讀

英偉達(dá)市值一夜蒸發(fā)近2萬億 英偉達(dá)股價(jià)下跌超8%

在美東時(shí)間周一,美股三大指數(shù)集體收跌,截至收盤,英偉達(dá)股價(jià)下跌超8%,英偉達(dá)市值一夜蒸發(fā)2650億美元(換算下來約合人民幣19345億元);

英偉達(dá)收購AI初創(chuàng)公司Run:ai

全球領(lǐng)先的芯片制造商英偉達(dá)近日正式完成了對以色列人工智能初創(chuàng)公司Run:ai的收購。這一收購案在經(jīng)過歐盟反壟斷機(jī)構(gòu)的嚴(yán)格審查后,最終獲得了批準(zhǔn),標(biāo)志著英偉

超萬個(gè)英偉達(dá)芯片已交付 13000個(gè)Blackwell芯片樣品已發(fā)送給客戶

第三季度財(cái)報(bào),當(dāng)天盤后英偉達(dá)股價(jià)下跌約2%。 業(yè)界分析人士認(rèn)為,雖然英偉達(dá)的營收超預(yù)期但股價(jià)下跌,原因可能是投資者會擔(dān)心

加速拋棄英偉達(dá),微軟又發(fā)布一顆芯片 #微軟 #英偉達(dá) #半導(dǎo)體 #芯片 #電路知識

英偉達(dá)

jf_15747056

發(fā)布于 :2024年11月21日 17:31:05

軟銀攜手英偉達(dá)打造日本最強(qiáng)AI超算

軟銀集團(tuán)近日宣布,將率先采用英偉達(dá)最新的Blackwell平臺,打造日本最強(qiáng)的AI超級計(jì)算機(jī)。此舉旨在滿足日本在人工智能領(lǐng)域快速發(fā)展的迫切需求,推動國內(nèi)AI技術(shù)的創(chuàng)新與應(yīng)用。

英偉達(dá)與軟銀攜手共建日本AI基礎(chǔ)設(shè)施

近日,英偉達(dá)創(chuàng)始人兼CEO黃仁勛宣布,英偉達(dá)將與軟銀集團(tuán)合作,在日本共同建設(shè)AI基礎(chǔ)設(shè)施,其中包括日本最大的

英偉達(dá)超越蘋果成為市值最高 英偉達(dá)取代英特爾加入道指

在AI浪潮下英偉達(dá)被各路資本競相追逐,2024年英偉達(dá)公司的股價(jià)累計(jì)上漲高達(dá)180%。在11月4日,英偉

英偉達(dá)市值欲超蘋果面臨挑戰(zhàn),美研究機(jī)構(gòu)稱穩(wěn)居榜首不易

。然而,在收盤時(shí),蘋果反超了英偉達(dá),重新奪回市值第一的寶座。這已經(jīng)不是英偉達(dá)第一次嘗試登頂了,今

英偉達(dá)或被罰在美營收30%

司法部的傳票。 據(jù)彭博社報(bào)道,美國監(jiān)管機(jī)構(gòu)一直在調(diào)查2024年4月份英偉達(dá)宣布收購Run AI的交易。而有業(yè)界人士認(rèn)為英偉達(dá)收購Run

英偉達(dá)投資日本AI公司Sakana AI

英偉達(dá)現(xiàn)身日本人工智能研發(fā)初創(chuàng)公司Sakana AI的A輪融資名單中;據(jù)悉;Sakana AI的A輪融資而完成超過1億美元,此次融資由New Enterprise Associates

英偉達(dá)Blackwell架構(gòu)揭秘:下一個(gè)AI計(jì)算里程碑?# 英偉達(dá)# 英偉達(dá)Blackwell

英偉達(dá)行業(yè)資訊

jf_02331860

發(fā)布于 :2024年08月26日 10:58:09

AI芯片巨頭英偉達(dá)漲超4% 英偉達(dá)市值暴增7500億

誰是美股最靚的仔?在人工智能浪潮之下AI芯片巨頭英偉達(dá)肯定有一席之地,特別是現(xiàn)在全球資本市場動蕩之際,業(yè)界分析師多認(rèn)為英偉達(dá)是最佳“反彈股”

英偉達(dá)TITAN AI顯卡曝光,性能狂超RTX 4090達(dá)63%!# 英偉達(dá)# 顯卡

顯卡英偉達(dá)

jf_02331860

發(fā)布于 :2024年07月24日 17:18:28

AI硬件反超英偉達(dá)?跑分來看尚不現(xiàn)實(shí)

AI硬件反超英偉達(dá)?跑分來看尚不現(xiàn)實(shí)

評論