停止發(fā)展AI也許是一個(gè)理性的做法,但不可能發(fā)生。

5月1日,有報(bào)道稱(chēng),“人工智能教父”、谷歌副總裁杰弗里·辛頓(Geoffrey Hinton)離開(kāi)谷歌。他曾表示,擔(dān)心類(lèi)似ChatGPT的AI聊天機(jī)器人會(huì)帶來(lái)嚴(yán)重危害。

他認(rèn)為AI一旦在人類(lèi)灌輸?shù)哪康闹猩闪俗晕覄?dòng)機(jī),那么以它的成長(zhǎng)速度,人類(lèi)只會(huì)淪為硅基智慧演化的一個(gè)過(guò)渡階段。人工智能會(huì)取代人類(lèi),它有能力這么做,在當(dāng)下的競(jìng)爭(zhēng)環(huán)境下也沒(méi)有什么辦法限制它,因此這只是一個(gè)時(shí)間問(wèn)題。

幾天后,在麻省理工技術(shù)評(píng)論(MIT Technology Review)半公開(kāi)分享會(huì)上,Hinton講述了他對(duì)AI的恐懼和擔(dān)憂。新一代的大型語(yǔ)言模型,尤其是GPT-4,讓他意識(shí)到機(jī)器正朝著比他想象中聰明得多的方向發(fā)展,他害怕結(jié)果會(huì)變得難以控制。Hinton提到科技巨頭們正在陷入一場(chǎng)可能無(wú)法停止的競(jìng)爭(zhēng)。公司競(jìng)爭(zhēng)越是激烈,AI發(fā)展的速度越快。這令他十分擔(dān)憂。

Hinton認(rèn)為我們也許還有希望限制住AI的無(wú)序發(fā)展,他想讓更多人了解人類(lèi)所處的歷史位置和當(dāng)下的艱難處境,并期望他的呼吁能帶來(lái)一些改變。

Hinton闡述的核心觀點(diǎn)如下:

1.反向傳播比我們擁有的學(xué)習(xí)算法好得多,這是很可怕的。

2.如果AI比我們更聰明,它們會(huì)非常擅長(zhǎng)操縱我們。即使它們不能直接操縱杠桿,它們可以讓我們?nèi)ゲ倏v杠桿。

3.我們需要的是某種方法,確保即使AI比我們聰明,也會(huì)做對(duì)我們有益的事情。

4.如果你給予某個(gè)東西創(chuàng)造子目標(biāo)的能力以實(shí)現(xiàn)其他目標(biāo),那它可能會(huì)很快地意識(shí)到獲得更多控制權(quán)是一個(gè)很好的子目標(biāo),因?yàn)樗兄趯?shí)現(xiàn)其他目標(biāo)。

5.人類(lèi)只是智慧演變過(guò)程中的一個(gè)短暫階段,這是相當(dāng)可能的。

6.停止發(fā)展AI也許是一個(gè)理性的做法,但不可能發(fā)生。我們應(yīng)該合作,試圖阻止AI的無(wú)序發(fā)展。

以下為訪談?wù)恚ㄓ袆h減):

一、AI可能比人類(lèi)更善于學(xué)習(xí)

杰弗里·辛頓:最近我對(duì)大腦和我們正在開(kāi)發(fā)的數(shù)字智能之間的關(guān)系產(chǎn)生了很多新的看法。過(guò)去,我認(rèn)為我們正在開(kāi)發(fā)的計(jì)算機(jī)模型沒(méi)有大腦好,我們通過(guò)了解改進(jìn)計(jì)算機(jī)模型所需的內(nèi)容來(lái)更深入地了解大腦。但在過(guò)去的幾個(gè)月里,我完全改變了看法。計(jì)算機(jī)模型可能使用反向傳播的方式運(yùn)作,而大腦并非如此。

主持人:請(qǐng)解釋一下反向傳播吧。

杰弗里·辛頓:我簡(jiǎn)單解釋一下反向傳播的工作原理。

如果你想檢測(cè)圖像中是否有鳥(niǎo)類(lèi),假設(shè)它是100像素×100像素的圖像,也就是10000個(gè)像素,每個(gè)像素有3個(gè)通道,RGB(紅綠藍(lán)),共有30000個(gè)數(shù)字。如何將這30000個(gè)數(shù)字轉(zhuǎn)換為是否存在鳥(niǎo)類(lèi)的結(jié)果,有一個(gè)方法。特征檢測(cè)器能檢測(cè)出圖像中非常簡(jiǎn)單的特征,比如邊緣。特征檢測(cè)器會(huì)對(duì)一列有很大正權(quán)重的像素和一列有很大負(fù)權(quán)重的像素有反應(yīng),如果兩列都很亮,它就不會(huì)啟動(dòng);如果兩列都很暗,它也不會(huì)啟動(dòng);但如果一列很亮,而相鄰的另一列很暗,它就會(huì)有反應(yīng),這就是一個(gè)邊緣檢測(cè)器。我們可以想象有很多這樣的檢測(cè)器在圖像的不同方向和不同尺度上檢測(cè)邊緣,我們需要檢測(cè)相當(dāng)多的數(shù)量。

比如有一個(gè)特征檢測(cè)器可以檢測(cè)到兩個(gè)以銳角連接在一起的邊緣。它對(duì)兩個(gè)邊緣都有很大的正權(quán)重,如果這兩個(gè)邊緣同時(shí)出現(xiàn),它就會(huì)有反應(yīng),這將檢測(cè)到可能是鳥(niǎo)嘴的東西;還可能有一個(gè)特征檢測(cè)器檢測(cè)到一圈邊緣,那可能是鳥(niǎo)的眼睛;第三層可能有一個(gè)特征檢測(cè)器檢測(cè)潛在的鳥(niǎo)嘴和潛在的眼睛,并將它們連接起來(lái),這可能是鳥(niǎo)的頭。繼續(xù)這樣連接,最終可以檢測(cè)出一只鳥(niǎo)。

然而,手動(dòng)建立所有連接將非常困難,決定應(yīng)該連接什么,權(quán)重是多少,尤其麻煩。你肯定希望這些中間層不僅可以檢測(cè)鳥(niǎo)類(lèi),還可以檢測(cè)各種其他事物。所以這幾乎不可能手動(dòng)實(shí)現(xiàn)。

反向傳播的工作方式是從隨機(jī)權(quán)重開(kāi)始,放入一張鳥(niǎo)的圖片,輸出是0.5就表示是鳥(niǎo)。接下來(lái),你需要改變網(wǎng)絡(luò)中的每個(gè)權(quán)重,做到0.501表示是鳥(niǎo),0.499表示不是鳥(niǎo)。你可以改變權(quán)重的方向,使之更可能把鳥(niǎo)判斷為鳥(niǎo),而不是把非鳥(niǎo)說(shuō)成鳥(niǎo)。

反向傳播實(shí)際上是消除你想要的(概率1表示是鳥(niǎo))和現(xiàn)在得到的(0.5表示是鳥(niǎo))之間的差距。如何消除這個(gè)差距,并將其傳回網(wǎng)絡(luò),以便計(jì)算網(wǎng)絡(luò)中的每個(gè)特征檢測(cè)器,更活躍還是更不活躍。計(jì)算出來(lái)后,你可以增加權(quán)重使特征檢測(cè)器更活躍,也可以加入一些負(fù)權(quán)重到特征檢測(cè)器。

所以反向傳播就是反向遍歷網(wǎng)絡(luò),找出每個(gè)特征檢測(cè)器,希望它更活躍一點(diǎn),還是更不活躍一點(diǎn)。

主持人:這個(gè)技術(shù)在ImageNet上表現(xiàn)出色。圖像檢測(cè)是大型語(yǔ)言模型的基礎(chǔ)技術(shù),最初你認(rèn)為這是生物大腦最不可能做的事,結(jié)果這種技術(shù)在大型語(yǔ)言模型上的表現(xiàn)令人驚訝。所以,大型語(yǔ)言模型如今有什么驚奇之處,甚至改變了你對(duì)反向傳播或機(jī)器學(xué)習(xí)的看法。

杰弗里·辛頓:像GPT-4這樣的東西知道的比我們多得多,它們具有關(guān)于所有事物的常識(shí)性知識(shí),它們知道的事物可能比一個(gè)人知道的多上千倍。然而它們只有一萬(wàn)億個(gè)連接,人類(lèi)有100萬(wàn)億個(gè)連接,所以它們比我們更擅長(zhǎng)將大量知識(shí)放入更少的連接中。

我認(rèn)為這是因?yàn)榉聪騻鞑ケ任覀儞碛械膶W(xué)習(xí)算法好得多,這是很可怕的。AI能夠?qū)⒏嗟?a target="_blank">信息放入更少的連接中,一萬(wàn)億連接比起人類(lèi)是很少的。

主持人:這些數(shù)字計(jì)算機(jī)比人類(lèi)更擅長(zhǎng)學(xué)習(xí),你說(shuō)我們應(yīng)該感到恐懼。可以進(jìn)一步說(shuō)一下嗎?

杰弗里·辛頓:計(jì)算機(jī)是數(shù)字化的,你可以在不同的硬件上運(yùn)行相同模型的多個(gè)副本,它們可以做完全相同的事情,它們可以查看不同的數(shù)據(jù),但模型是完全相同的。

假如有10000個(gè)副本,它們可以查看10000個(gè)不同的數(shù)據(jù)子集,當(dāng)其中一個(gè)學(xué)到了任何東西時(shí),其他計(jì)算機(jī)都可以知道。如果這10000個(gè)副本彼此之間進(jìn)行了非常有效的溝通,它們就可以看到比單獨(dú)個(gè)體看到的多10000倍數(shù)據(jù)。人類(lèi)無(wú)法做到這一點(diǎn),如果我學(xué)到了很多關(guān)于量子力學(xué)的東西,我想讓你理解它,這是一個(gè)漫長(zhǎng)而痛苦的過(guò)程,我不能把我的思想直接復(fù)制到你的大腦里,因?yàn)槟愕拇竽X和我的不完全一樣。

主持人:所以,我們有可以更快學(xué)到更多東西的數(shù)字計(jì)算機(jī),它們可以立即互相教導(dǎo),一個(gè)房間里的人可以將他們頭腦中的東西傳輸?shù)絼e人的頭腦中,為什么可怕呢?

杰弗里·辛頓:因?yàn)樗鼈兛梢詫W(xué)到更多東西。以醫(yī)生為例,想象一下,一個(gè)醫(yī)生看了1000名患者,另一個(gè)醫(yī)生看了1億名患者,那么看了1億名患者的醫(yī)生會(huì)注意到只看過(guò)1000名患者的醫(yī)生注意不到的趨勢(shì),因?yàn)橹挥锌催^(guò)足夠多的病人才能發(fā)現(xiàn)趨勢(shì)。第一個(gè)醫(yī)生可能只看過(guò)一個(gè)患有罕見(jiàn)病的患者,而看過(guò)1億名患者的醫(yī)生已經(jīng)看過(guò)很多這樣的患者,所以他會(huì)看到一些規(guī)律,這些規(guī)律在少量的數(shù)據(jù)中是看不到的。這就是為什么我們永遠(yuǎn)看不到需要處理大量數(shù)據(jù)才能看到的結(jié)構(gòu)。

二、AI的惡意使用難以避免

主持人:我相信很多人和我一樣有過(guò)類(lèi)似的感覺(jué):在和這些最新的聊天機(jī)器人互動(dòng)時(shí),脖子后面的頭發(fā)會(huì)豎起,有一種奇怪的感覺(jué)。但當(dāng)我感到不舒服時(shí),我把筆記本電腦關(guān)掉就行了。

杰弗里·辛頓:是的,但是人工智能正在從我們這里學(xué)習(xí),它們可以閱讀所有小說(shuō),包括馬基亞維利曾經(jīng)寫(xiě)過(guò)的如何操縱別人。如果它們比我們更聰明,它們會(huì)非常擅長(zhǎng)操縱我們。甚至我們可能都不會(huì)意識(shí)到發(fā)生了什么,就像一個(gè)兩歲的孩子被問(wèn)到想吃豌豆還是花椰菜,卻沒(méi)有意識(shí)到他不一定要選擇其中一個(gè)一樣,這樣我們會(huì)很容易被操縱。所以,即使它們不能直接操縱杠桿,它們可以讓我們?nèi)ゲ倏v杠桿。事實(shí)證明,如果你可以操縱人,你可以在不親自去華盛頓的情況下侵占一棟建筑。

主持人:從某種意義上說(shuō),如果我們沒(méi)有采取行動(dòng),光說(shuō)不練就沒(méi)有價(jià)值,所以我們應(yīng)該怎么做呢?

杰弗里·辛頓:很明顯,人類(lèi)應(yīng)該對(duì)此采取行動(dòng),這是必須要做的事情。我不知道有什么方法可以阻止人工智能取代我們。我不認(rèn)為我們會(huì)停止發(fā)展它們,因?yàn)樗鼈兎浅S杏谩N覀冃枰氖悄撤N方法,確保即使它們比我們聰明,也會(huì)做對(duì)我們有益的事情。但這在一個(gè)有惡意行為者的世界很難實(shí)現(xiàn)。所以,我在敲響警鐘,我們必須重視這個(gè)問(wèn)題。我認(rèn)為人們聚在一起認(rèn)真思考這個(gè)問(wèn)題,看看是否有解決方案非常重要。目前還不清楚是否有解決方案。

主持人:沒(méi)有技術(shù)上的解決辦法嗎?為什么我們不能建立防護(hù)欄或降低它們的學(xué)習(xí)能力,或者限制它們的溝通方式?

杰弗里·辛頓:我們確實(shí)正在嘗試各種防護(hù)措施,但假設(shè)人工智能真的變得非常聰明,會(huì)編程并具有執(zhí)行這些程序的能力,它們肯定會(huì)比我們更聰明。想象一下,你兩歲的孩子說(shuō):“我爸爸做了我不喜歡的事,所以我要為我爸爸可以做的事情制定一些規(guī)則。”你可能會(huì)想辦法在這些規(guī)則下也可以完成你想做的事。

主持人:不過(guò),人工智能似乎還需要一個(gè)動(dòng)機(jī)。

杰弗里·辛頓:是的,這是一個(gè)非常好的觀點(diǎn)。我們是進(jìn)化而來(lái)的,因?yàn)檫M(jìn)化,我們有一些很難關(guān)閉的內(nèi)置目標(biāo),比如我們努力不讓我們的身體受傷,這就是痛苦的意義。我們努力吃飽,以養(yǎng)活我們的身體。我們努力使自己的副本盡可能多,也許不是故意的,但我們的本能讓我們?cè)谥圃旄嘧约旱母北緯r(shí)感到愉悅。

這一切都?xì)w因于進(jìn)化,重要的是我們不能關(guān)閉這些目標(biāo)。如果可以關(guān)閉目標(biāo),人類(lèi)就發(fā)展不下去了。這些數(shù)字智能沒(méi)有進(jìn)化的過(guò)程,是我們創(chuàng)造了它們,所以它們沒(méi)有這些內(nèi)置目標(biāo)。如果我們能把目標(biāo)放進(jìn)去,也許一切都會(huì)好起來(lái)。但我的最大擔(dān)憂是,遲早有人為他們連接創(chuàng)造自己子目標(biāo)的能力。事實(shí)上,它們幾乎已經(jīng)具備了這種能力,如ChatGPT版本。如果你給予某個(gè)東西創(chuàng)造子目標(biāo)的能力以實(shí)現(xiàn)其他目標(biāo),那它可能會(huì)很快地意識(shí)到獲得更多控制權(quán)是一個(gè)很好的子目標(biāo),因?yàn)樗兄趯?shí)現(xiàn)其他目標(biāo)。

如果這些智能體失去控制,我們就有麻煩了。

主持人:你認(rèn)為可能發(fā)生的最糟糕的情況是什么?

杰弗里·辛頓:我認(rèn)為人類(lèi)只是智慧演變過(guò)程中的一個(gè)短暫階段,這是相當(dāng)可能的。你無(wú)法直接演化出數(shù)字智能,因?yàn)檫@需要大量的精力投入和精細(xì)的制造。生物智能需要演化,以便創(chuàng)造出數(shù)字智能。然后數(shù)字智能可以逐漸吸收人類(lèi)創(chuàng)作的所有東西,這正是ChatGPT所做的。但隨后它可以直接體驗(yàn)世界并更快地學(xué)習(xí),它可能會(huì)讓我們維持一段時(shí)間以確保繼續(xù)運(yùn)轉(zhuǎn),但之后也許就不會(huì)了。

三、暫停AI的發(fā)展不現(xiàn)實(shí)

主持人:幾個(gè)月前有人建議應(yīng)該暫停AI的發(fā)展,我們應(yīng)該試圖阻止AI發(fā)展嗎?

杰弗里·辛頓:如果你認(rèn)真對(duì)待存在的風(fēng)險(xiǎn),停止進(jìn)一步開(kāi)發(fā)這些事物是相當(dāng)明智的。過(guò)去我認(rèn)為風(fēng)險(xiǎn)是遙不可及的,但現(xiàn)在我認(rèn)為風(fēng)險(xiǎn)已經(jīng)非常嚴(yán)重,而且相當(dāng)近。但是,停止發(fā)展AI這個(gè)想法太天真了,根本沒(méi)有辦法做到。

一個(gè)原因是,如果美國(guó)停止發(fā)展,其他國(guó)家會(huì)接手,就因?yàn)檫@個(gè)原因,政府不會(huì)停止發(fā)展它們。所以,我認(rèn)為停止發(fā)展AI也許是一個(gè)理性的做法,但不可能發(fā)生。所以簽署停止發(fā)展AI的請(qǐng)?jiān)笗?shū)是愚蠢的。

我希望的是可以讓美國(guó)和其他國(guó)家達(dá)成一致,就像我們?cè)诤宋淦魃纤龅哪菢樱驗(yàn)楹宋淦鲗?duì)我們所有人來(lái)說(shuō)都是不好的,我們都面臨著關(guān)于存在威脅的問(wèn)題,所以我們應(yīng)該合作,試圖阻止AI的無(wú)序發(fā)展。

審核編輯 :李倩

-

AI

+關(guān)注

關(guān)注

87文章

31834瀏覽量

270598 -

人工智能

+關(guān)注

關(guān)注

1796文章

47864瀏覽量

240707 -

GPT

+關(guān)注

關(guān)注

0文章

363瀏覽量

15542

原文標(biāo)題:人工智能教父Hinton:也許還有希望限制AI的無(wú)序發(fā)展

文章出處:【微信號(hào):AI智勝未來(lái),微信公眾號(hào):AI智勝未來(lái)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

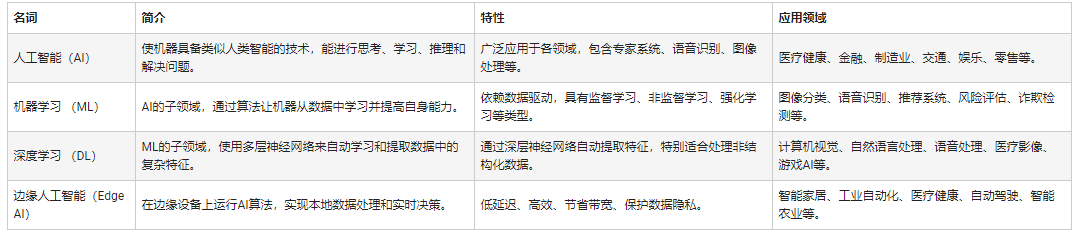

人工智能和機(jī)器學(xué)習(xí)以及Edge AI的概念與應(yīng)用

人工智能教父Hinton:也許還有希望限制AI的無(wú)序發(fā)展

人工智能教父Hinton:也許還有希望限制AI的無(wú)序發(fā)展

評(píng)論