對話文本數據,作為人類交流的生動表現,正成為訓練大型模型的寶貴資源。這些數據不僅蘊含了豐富的語言特點和人類交流方式,更在模型訓練中發揮著重要的意義,從而為其賦予更強大的智能和更自然的交流能力。

大型模型,尤其是基于深度學習的預訓練語言模型,需要通過大量的數據來學習語言的結構、上下文關系和意義。對話文本數據在這方面扮演著關鍵角色。首先,對話文本數據呈現了豐富的情境和語境,模擬了真實世界中的交流場景。模型通過學習這些數據,能夠更好地理解在對話中隱含的信息,從而更準確地進行回復和表達。

對話文本數據還能夠幫助模型培養出更自然的交流風格。人類的對話往往充滿了語氣、情感和語言習慣,模型通過學習對話數據,能夠更好地模仿這些特點,使得其生成的回復更加貼近人類交流。這在智能對話系統、虛擬助手等應用中具有重要價值,使得用戶能夠更舒適、流暢地與機器進行交流。

此外,對話文本數據還能夠為模型提供多樣性和變化性的訓練樣本。現實生活中的對話涵蓋了各種話題、語境和表達方式,模型通過學習這些數據,能夠更好地適應不同的交流情景。這有助于模型在不同領域和任務上表現出更廣泛的適應性和智能性。

然而,對話文本數據也存在一些挑戰。例如,數據的質量和準確性可能影響模型的表現。此外,對話中可能存在偏見、不準確的信息,模型需要學會識別和處理這些問題,以確保其回復是中立、準確的。

總體而言,對話文本數據對于訓練大型模型具有深遠的意義。它們為模型提供了真實世界中的語言交流情景,幫助模型學習語言的語法、語義和情感。通過對話數據的學習,大型模型能夠在智能對話、問答系統、自然語言生成等領域發揮更大的作用。隨著對話數據的不斷積累和模型技術的不斷發展,我們可以期待大型模型在未來在交流和人機互動方面取得更加令人矚目的進展。

數據堂除了提供豐富的成品對話文本數據集之外,還提供對話文本數據的清洗、文本分類、信息抽取、實體關系標注、意圖標注、情感標注等數據定制服務。針對數據定制標注服務,我們自研數據標注平臺具備成熟的標注、審核、質檢等機制,可支持多種類型的文本數據標注。

審核編輯 黃宇

-

人工智能

+關注

關注

1806文章

48987瀏覽量

249049 -

深度學習

+關注

關注

73文章

5560瀏覽量

122762 -

大模型

+關注

關注

2文章

3132瀏覽量

4046

發布評論請先 登錄

labview樹形控件讀取子文本數據(child text)

從一個文本數據的文件夾中,怎樣實現數據的連續提取

LabVIEW操作Excel報表時會丟失所有的非文本數據

文本數據分析:文本挖掘還是自然語言處理?

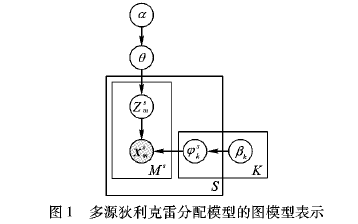

如何使用狄利克雷多項分配模型進行多源文本主題挖掘模型

異構文本數據轉換過程中解析XML文本的方法對比

對話文本數據是培養大模型的智能與交流之源

對話文本數據是培養大模型的智能與交流之源

評論