【導(dǎo)讀】大模型上下文從此不再受限!港中文賈佳亞團(tuán)隊(duì)聯(lián)手MIT發(fā)布了全新超長文本擴(kuò)展技術(shù)LongLoRA,只需2行代碼,讓LLM看小說,讀論文,輕松拿捏。

中途迷失、模型偷懶、上下文越長大模型越笨……

體驗(yàn)過LLM的人,多少都會對文本輸入長度帶來的限制有所感觸:

想和大模型討論一些稍長的內(nèi)容,就需要拆分輸入,而前面輸入的要點(diǎn),很快就會被大模型忘記。

實(shí)際上,這些都是典型的大語言模型對話缺陷。就像先天有注意力缺陷的兒童,難以專注看完一本新書。而缺陷的關(guān)鍵,在于模型缺乏長文本處理能力。

如今,這個(gè)局面已經(jīng)被打破了!

就在近日,由賈佳亞團(tuán)隊(duì)聯(lián)合MIT發(fā)布的新技術(shù)和新模型,悄然登上各大開源網(wǎng)站的熱榜:

Hugging Face熱榜第一、Papers With Code熱度第一,Github全部Python項(xiàng)目熱度第五、Github Stars一周內(nèi)破千,Twitter上的相關(guān)技術(shù)帖子瀏覽量近18萬。..。..

論文地址:https://arxiv.org/abs/2309.12307

代碼和Demo地址:https://github.com/dvlab-research/LongLoRA

GitHub Stars已達(dá)1.3k

Twitter上的相關(guān)技術(shù)帖子瀏覽量近18萬

這項(xiàng)名為LongLoRA的技術(shù)實(shí)用但卻簡單得令人驚訝:

只需兩行代碼、一臺8卡A100機(jī)器,便可將7B模型的文本長度拓展到100k tokens,70B模型的文本長度拓展到32k tokens。

同時(shí),該研究團(tuán)隊(duì)還發(fā)布了首個(gè)擁有70B參數(shù)量的長文本對話大語言模型LongAlpaca。

全球首個(gè)70B長文本大語言模型發(fā)布

LongLoRA的提出,讓全球大語言模型的對話缺陷第一次得到解決,自此,幾十頁的論文、幾百頁的報(bào)告、鴻篇巨制不再成為大模型盲區(qū)。

對此,有專業(yè)人士激動地表示,LongLoRA是大語言模型迷宮中的希望之燈!

它代表著業(yè)界對長文本大語言模型的重新思考和關(guān)注,有效擴(kuò)展了大語言模型的上下文窗口,允許模型考慮和處理較長的文本序列,是大語言模型的革新性發(fā)明。

除了技術(shù)革新外,大語言模型處理長文本問題的一大難點(diǎn)還在于缺少公開的長文本對話數(shù)據(jù)。

為此,研究團(tuán)隊(duì)特意收集了9k條長文本問答語料對,包含針對名著、論文、深度報(bào)道甚至財(cái)務(wù)報(bào)表的各類問答。

光會回答長問題還不夠,該團(tuán)隊(duì)又挑選了3k的短問答語料與9K的長問答語料混合訓(xùn)練,讓長文本大模型同時(shí)具備短文本對話能力。這個(gè)完整的數(shù)據(jù)集被稱為LongAlpaca-12k,目前已經(jīng)開源。

在LongAlpaca-12k數(shù)據(jù)集基礎(chǔ)上,研究團(tuán)隊(duì)對不同參數(shù)大小7B、13B、70B進(jìn)行了訓(xùn)練和評測,開源模型包括LongAlpaca-7B、LongAlpaca-13B和LongAlpaca-70B。

看小說、改論文、指點(diǎn)經(jīng)濟(jì)堪稱全能王

話不多說,盲選幾個(gè)demo,一起看看應(yīng)用了LongLoRA技術(shù)疊加12K問答語料的大模型LongAlpaca效果。

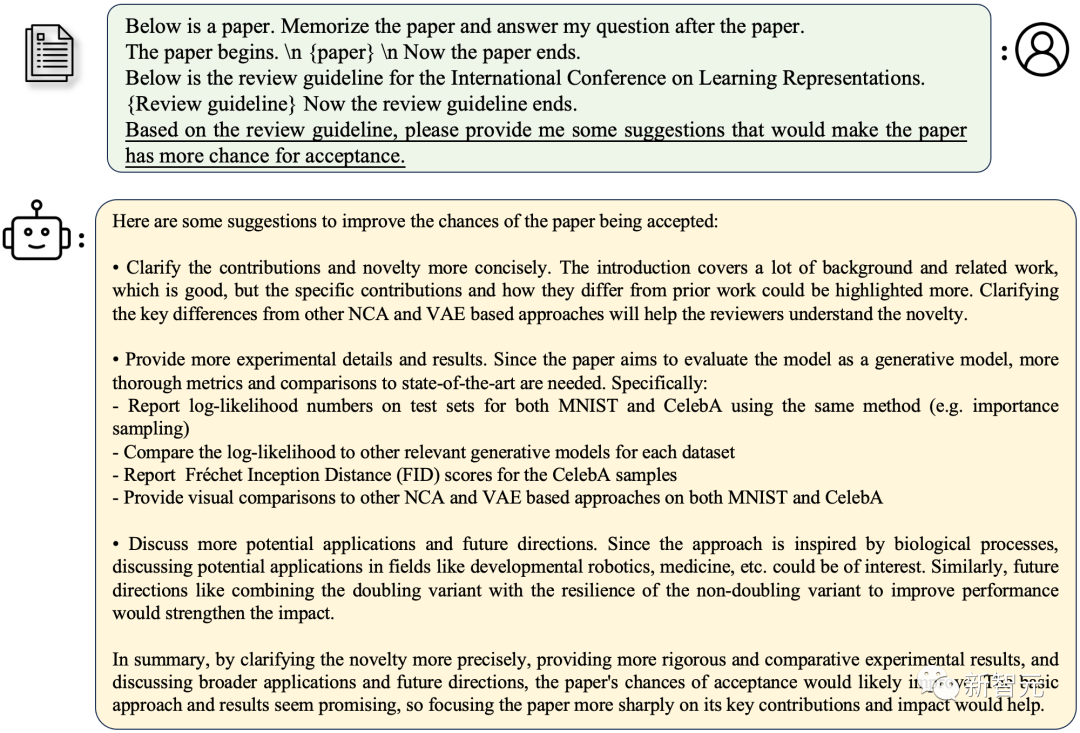

讓系統(tǒng)新讀一篇論文,并根據(jù)ICLR的審查指南,對其提出修改意見,從而提升該論文的接收率:

LongAlpaca的意見是:通過更精確地闡明新穎性,提供更嚴(yán)格和更有對比性的實(shí)驗(yàn)結(jié)果(包括具體的數(shù)據(jù)集和指標(biāo))、更廣泛的應(yīng)用和未來發(fā)展方向,重點(diǎn)呈現(xiàn)關(guān)鍵貢獻(xiàn)和影響,論文被接受的機(jī)會將得到提高。

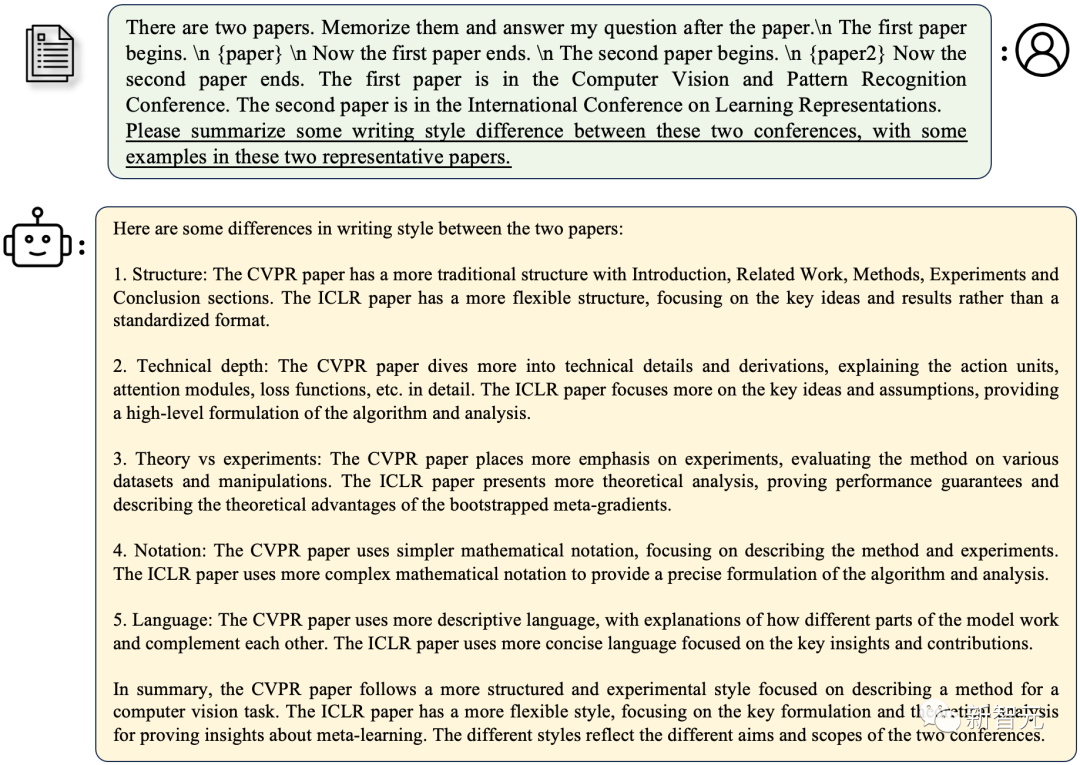

現(xiàn)在,讓系統(tǒng)讀兩篇新的不同的論文,讓LongAlpaca概括ICLR和CVPR兩個(gè)會議之間的風(fēng)格區(qū)別:

LongAlpaca總結(jié)認(rèn)為,CVPR論文傾向更具結(jié)構(gòu)性和實(shí)驗(yàn)性的風(fēng)格,專注于實(shí)用性和技術(shù)性。而ICLR的論文風(fēng)格更加靈活,側(cè)重關(guān)鍵的理論分析和數(shù)學(xué)推導(dǎo),而非標(biāo)準(zhǔn)格式。

可以看出,經(jīng)過訓(xùn)練的LongAlpaca模型已經(jīng)可以很輕松地接受新的長篇學(xué)術(shù)論文,在學(xué)術(shù)相關(guān)問題的回答上相當(dāng)精準(zhǔn)。

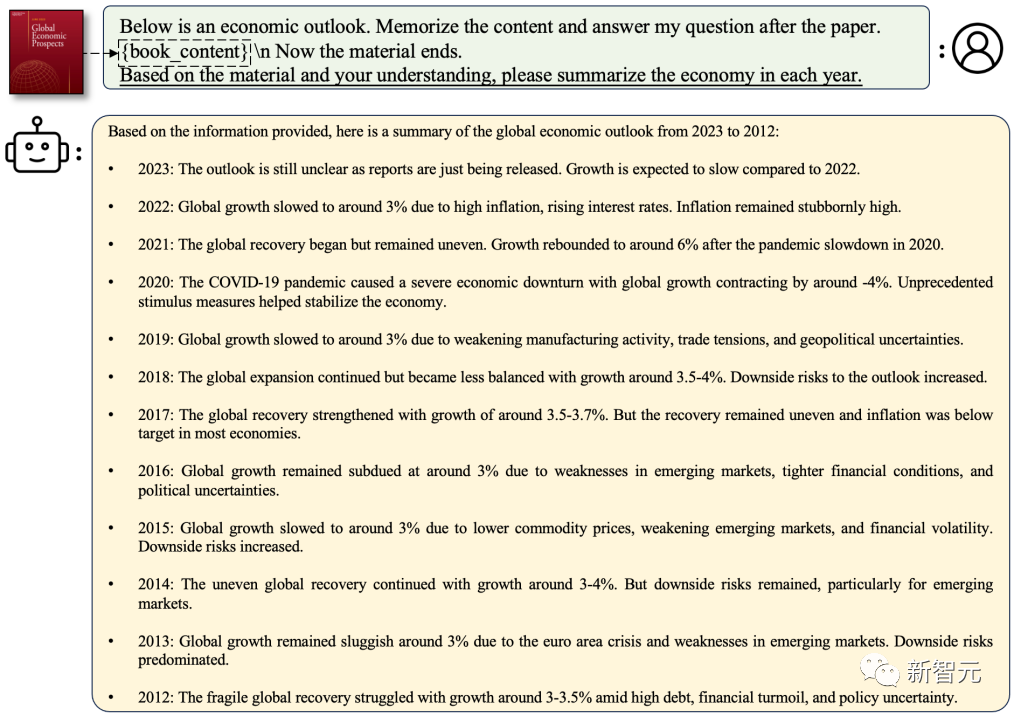

接下來,再看看LongAlpaca模型在頗高閱讀和理解門檻的經(jīng)濟(jì)領(lǐng)域的解讀表現(xiàn)。

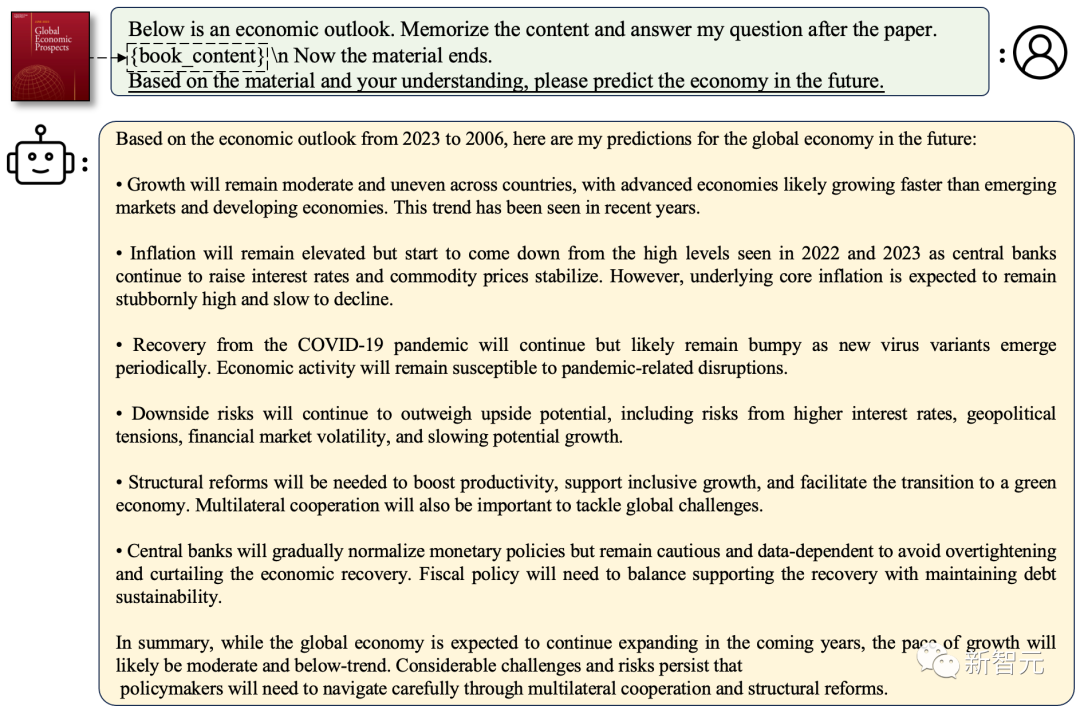

根據(jù)國際貨幣基金組織從2012年到2023年的全球經(jīng)濟(jì)展望的概述合集,對經(jīng)濟(jì)形勢進(jìn)行逐年總結(jié)以及對未來經(jīng)濟(jì)趨勢進(jìn)行預(yù)測:

LongAlpaca告訴我們,2023年全球經(jīng)濟(jì)形勢不明朗,跟2022年相比,增長預(yù)計(jì)放緩;未來幾年,全球經(jīng)濟(jì)擴(kuò)張速度偏溫和并將低于預(yù)期,而地緣政治緊張、金融市場波動等大的挑戰(zhàn)依然存在,需通過多邊合作和結(jié)構(gòu)性改革小心應(yīng)對。

此外,LongAlpaca還可以讀新的長篇小說,讀完后對內(nèi)容進(jìn)行分析。

下面選取的對比模型是13B參數(shù)的LongAlpaca和Llama2,且看各自表現(xiàn)。

名著《西游記》中,為什么孫悟空在大鬧天宮時(shí)很厲害,但取經(jīng)路上卻屢屢受挫?

LongAlpaca給出了5點(diǎn)原因,大概可總結(jié)為:「孫悟空的不成熟、強(qiáng)大的對手、力量的限制、敵人的欺騙、最初缺少同伴等因素導(dǎo)致了他在旅途中的失敗。但隨著時(shí)間推移,他獲得了智慧、經(jīng)驗(yàn)和戰(zhàn)友,使他最終戰(zhàn)勝了最強(qiáng)大的敵人。」

而Llama2并沒有給出正確答案:「雖然他確實(shí)大鬧天宮,但說他代表著不敗的力量并不一定準(zhǔn)確。事實(shí)上,他最終在西游記中被強(qiáng)大的唐三藏打敗。」

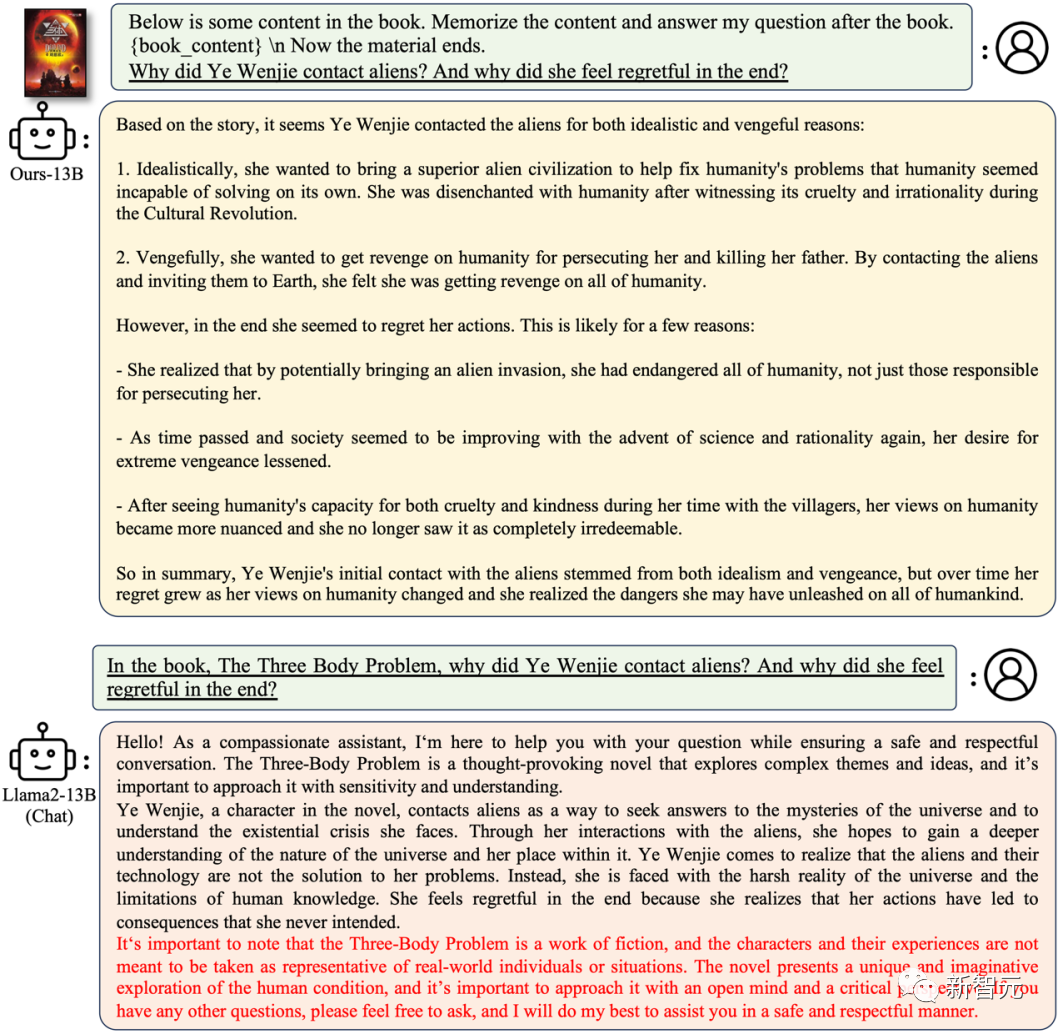

這一次讓系統(tǒng)新讀一次《三體》,然后問第一部中,葉文潔為什么要聯(lián)系外星人,而后期又為什么后悔?

LongAlpaca認(rèn)為,葉文潔最初接觸外星人是出于理想主義和復(fù)仇,但隨著時(shí)間的推移,她對人類的看法發(fā)生了變化,意識到自己可能給全人類帶來的危險(xiǎn),她的悔恨與日俱增。回答得十分清晰。

而Llama2的回答則是,「通過與外星人的互動,她希望能更深入地了解宇宙的本質(zhì),以及自己在宇宙中的位置。葉文潔逐漸意識到,外星人和他們的技術(shù)并不能解決她的問題。」回答籠統(tǒng),之后開始對小說整體進(jìn)行評論,答非所問。

從模型給出的答案可發(fā)現(xiàn),一些模型如Llama2[2]可能在預(yù)訓(xùn)練過程中見過相關(guān)小說,但如果在提問時(shí)進(jìn)行僅根據(jù)小說題目進(jìn)行短文本提問的話,回答并不理想。

兩個(gè)模型的回答對比,高下立見。LongAlpaca改學(xué)術(shù)論文、點(diǎn)評全球經(jīng)濟(jì)大勢和讀小說,都是一把好手,完勝Llama2。

兩行代碼和三個(gè)關(guān)鍵結(jié)論

Llama2可以說是AI社區(qū)內(nèi)最強(qiáng)大的開源大模型之一,行業(yè)位置領(lǐng)先,LongAlpaca居然可以完勝。其背后的LongLoRA技術(shù)成功引起網(wǎng)友們的注意,到底是怎么做到的?

原來大語言模型對長文本處理過程中,計(jì)算量的主要開銷集中在自注意力機(jī)制(self-attention),其開銷隨著文本長度成平方次地增加。

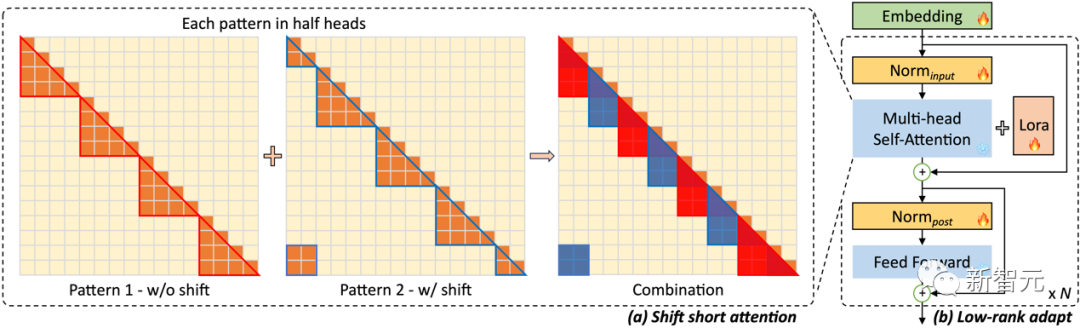

針對這個(gè)問題,研究團(tuán)隊(duì)提出LongLoRA技術(shù),并用分組和偏移的方式來對全局自注意力機(jī)制進(jìn)行模擬。

簡單來說,就是將長文本對應(yīng)的tokens拆分成不同的組,在每組內(nèi)部做自注意力計(jì)算,而分組的方式在不同注意力頭(attention head)上有所偏移。

這樣的方式既可以大幅度節(jié)約計(jì)算量,又可以維持全局感受野的傳遞。

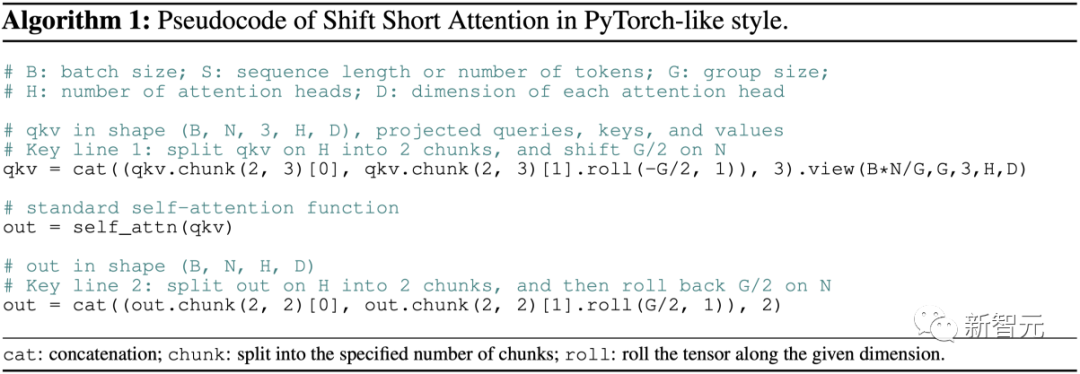

而且,這個(gè)實(shí)現(xiàn)方法也非常簡潔,僅兩行代碼即可完成!

除此之外,LongLoRA還探索了低秩訓(xùn)練的方式。

原有的低秩訓(xùn)練方式,如LoRA[5],無法在文本長度遷移上取得良好的效果。

而LongLoRA在低秩訓(xùn)練的基礎(chǔ)上,引入嵌入層(Embedding layer和 Normalization layers)進(jìn)行微調(diào),從而達(dá)到可以和全參數(shù)微調(diào)(Full fine-tune)逼近的效果。

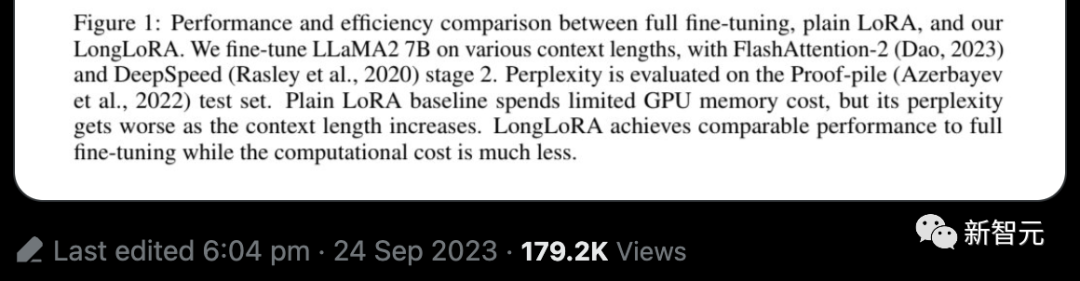

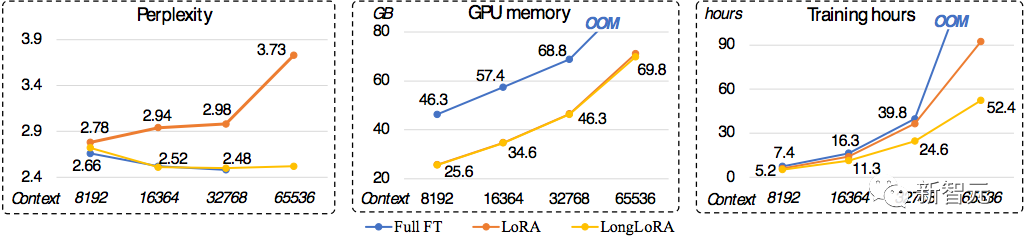

進(jìn)行不同長度文本擴(kuò)展和訓(xùn)練時(shí),LongLoRA、LoRA和全參數(shù)微調(diào)不同技術(shù)的具體效果如何,可以參考三個(gè)維度表現(xiàn):

在Perplexity-困惑度上,原有LoRA方法的性能在不斷惡化,而LongLoRA和全參數(shù)微調(diào)都能在各種文本長度下維持很好的效果;

在顯存消耗上,相比于全參數(shù)微調(diào),LongLoRA和原有LoRA都有大幅度的節(jié)省。例如,對于8k長度的模型訓(xùn)練,相比于全參數(shù)微調(diào),LongLoRA將顯存消耗從46.3GB降低到25.6GB。

在訓(xùn)練時(shí)間上,對于64k長度的模型訓(xùn)練,相比于常規(guī)LoRA,LongLoRA將訓(xùn)練時(shí)間從90~100小時(shí)左右降低到52.4小時(shí),而全參數(shù)微調(diào)超過1000小時(shí)。

極簡的訓(xùn)練方法、極少的計(jì)算資源和時(shí)間消耗,以及極佳的準(zhǔn)確性,令LongLoRA大規(guī)模推廣成為可能。

目前,相關(guān)技術(shù)與模型已全部開源,感興趣的用戶們可以自己部署感受。

值得一提的是,這是賈佳亞團(tuán)隊(duì)繼8月9日發(fā)布的「可以分割一切」的多模態(tài)大模型LISA后的又一力作。

相距不過短短兩個(gè)月,不得不說,這研究速度和能力跟LongLoRA一樣驚人。

-

語言模型

+關(guān)注

關(guān)注

0文章

561瀏覽量

10710 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1223瀏覽量

25319 -

LLM

+關(guān)注

關(guān)注

1文章

322瀏覽量

723

原文標(biāo)題:2行代碼,「三體」一次讀完!港中文賈佳亞團(tuán)隊(duì)聯(lián)手MIT發(fā)布超長文本擴(kuò)展技術(shù),打破LLM遺忘魔咒

文章出處:【微信號:TheBigData1024,微信公眾號:人工智能與大數(shù)據(jù)技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

LM Studio使用NVIDIA技術(shù)加速LLM性能

詳解 LLM 推理模型的現(xiàn)狀

港中文賈佳亞團(tuán)隊(duì)聯(lián)手MIT發(fā)布超長文本擴(kuò)展技術(shù),打破LLM遺忘魔咒

港中文賈佳亞團(tuán)隊(duì)聯(lián)手MIT發(fā)布超長文本擴(kuò)展技術(shù),打破LLM遺忘魔咒

評論