在這篇 NeurIPS23 論文中,來自魯汶大學(xué)、新加坡國立大學(xué)和中科院自動化所的研究者提出了一種視覺 「讀腦術(shù)」,能夠從人類的大腦活動中以高分辨率出解析出人眼觀看到的圖像。

人類的感知不僅由客觀刺激塑造,而且深受過往經(jīng)驗的影響,這些共同促成了大腦中的復(fù)雜活動。在認(rèn)知神經(jīng)科學(xué)領(lǐng)域,解碼大腦活動中的視覺信息成為了一項關(guān)鍵任務(wù)。功能性磁共振成像(fMRI)作為一種高效的非侵入性技術(shù),在恢復(fù)和分析視覺信息,如圖像類別方面發(fā)揮著重要作用。

然而,由于 fMRI 信號的噪聲特性和大腦視覺表征的復(fù)雜性,這一任務(wù)面臨著不小的挑戰(zhàn)。針對這一問題,本文提出了一個雙階段 fMRI 表征學(xué)習(xí)框架,旨在識別并去除大腦活動中的噪聲,并專注于解析對視覺重建至關(guān)重要的神經(jīng)激活模式,成功從大腦活動中重建出高分辨率且語義上準(zhǔn)確的圖像。

論文鏈接:https://arxiv.org/abs/2305.17214

項目鏈接:https://github.com/soinx0629/vis_dec_neurips/

論文中提出的方法基于雙重對比學(xué)習(xí)、跨模態(tài)信息交叉及擴散模型,在相關(guān) fMRI 數(shù)據(jù)集上取得了相對于以往最好模型接近 40% 的評測指標(biāo)提升,在生成圖像的質(zhì)量、可讀性及語義相關(guān)性相對于已有方法均有肉眼可感知的提升。該工作有助于理解人腦的視覺感知機制,有益于推動視覺的腦機接口技術(shù)的研究。相關(guān)代碼均已開源。

功能性磁共振成像(fMRI)雖廣泛用于解析神經(jīng)反應(yīng),但從其數(shù)據(jù)中準(zhǔn)確重建視覺圖像仍具挑戰(zhàn),主要因為 fMRI 數(shù)據(jù)包含多種來源的噪聲,這些噪聲可能掩蓋神經(jīng)激活模式,增加解碼難度。此外,視覺刺激引發(fā)的神經(jīng)反應(yīng)過程復(fù)雜多階段,使得 fMRI 信號呈現(xiàn)非線性的復(fù)雜疊加,難以逆轉(zhuǎn)并解碼。

傳統(tǒng)的神經(jīng)解碼方式,例如嶺回歸,盡管被用于將 fMRI 信號與相應(yīng)刺激關(guān)聯(lián),卻常常無法有效捕捉刺激和神經(jīng)反應(yīng)之間的非線性關(guān)系。近期,深度學(xué)習(xí)技術(shù),如生成對抗網(wǎng)絡(luò)(GAN)和潛在擴散模型(LDMs),已被采用以更準(zhǔn)確地建模這種復(fù)雜關(guān)系。然而,將視覺相關(guān)的大腦活動從噪聲中分離出來,并準(zhǔn)確進(jìn)行解碼,依然是該領(lǐng)域的主要挑戰(zhàn)之一。

為了應(yīng)對這些挑戰(zhàn),該工作提出了一個雙階段 fMRI 表征學(xué)習(xí)框架,該方法能夠有效識別并去除大腦活動中的噪聲,并專注于解析對視覺重建至關(guān)重要的神經(jīng)激活模式。該方法在生成高分辨率及語義準(zhǔn)確的圖像方面,其 50 分類的 Top-1 準(zhǔn)確率超過現(xiàn)有最先進(jìn)技術(shù) 39.34%。

方法概述

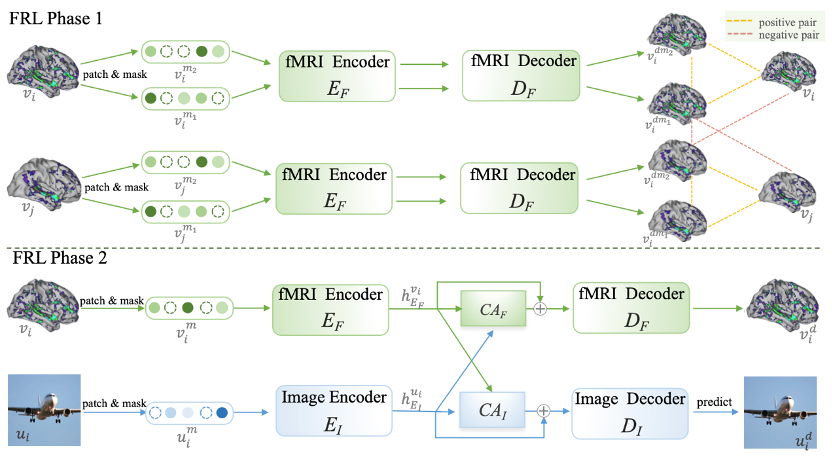

fMRI 表征學(xué)習(xí) (FRL)

第一階段:預(yù)訓(xùn)練雙對比掩模自動編碼器 (DC-MAE)

為了在不同人群中區(qū)分共有的大腦活動模式和個體噪聲,本文引入了 DC-MAE 技術(shù),利用未標(biāo)記數(shù)據(jù)對 fMRI 表征進(jìn)行預(yù)訓(xùn)練。DC-MAE 包含一個編碼器 和一個解碼器

和一個解碼器 ,其中

,其中 以遮蔽的 fMRI 信號為輸入,

以遮蔽的 fMRI 信號為輸入, ?則被訓(xùn)練以預(yù)測未遮蔽的 fMRI 信號。所謂的 “雙重對比” 是指模型在 fMRI 表征學(xué)習(xí)中優(yōu)化對比損失并參與了兩個不同的對比過程。

?則被訓(xùn)練以預(yù)測未遮蔽的 fMRI 信號。所謂的 “雙重對比” 是指模型在 fMRI 表征學(xué)習(xí)中優(yōu)化對比損失并參與了兩個不同的對比過程。

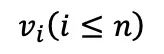

在第一階段的對比學(xué)習(xí)中,每個包含 n 個 fMRI 樣本 v 的批次中的樣本 被隨機遮蔽兩次,生成兩個不同的遮蔽版本

被隨機遮蔽兩次,生成兩個不同的遮蔽版本 和

和 ,作為對比的正樣本對。隨后,1D 卷積層將這兩個版本轉(zhuǎn)換為嵌入式表示,分別輸入至 fMRI 編碼器

,作為對比的正樣本對。隨后,1D 卷積層將這兩個版本轉(zhuǎn)換為嵌入式表示,分別輸入至 fMRI 編碼器 。解碼器

。解碼器 ?接收這些編碼的潛在表示,產(chǎn)生預(yù)測值

?接收這些編碼的潛在表示,產(chǎn)生預(yù)測值 和

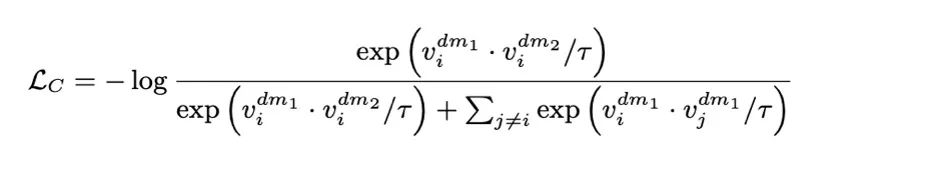

和 。通過 InfoNCE 損失函數(shù)計算的第一次對比損失,即交叉對比損失,來優(yōu)化模型:

。通過 InfoNCE 損失函數(shù)計算的第一次對比損失,即交叉對比損失,來優(yōu)化模型:

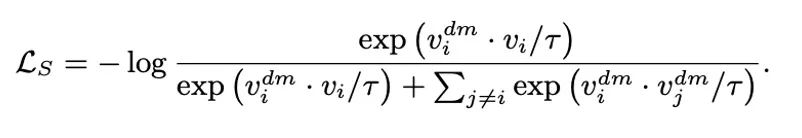

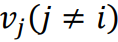

在第二階段對比學(xué)習(xí)中,每個未遮蔽的原始圖像 及其相應(yīng)的遮蔽圖像

及其相應(yīng)的遮蔽圖像 形成一對天然正樣本。這里的

形成一對天然正樣本。這里的 代表解碼器

代表解碼器 預(yù)測出的圖像。第二次對比損失,也就是自對比損失,根據(jù)以下公式進(jìn)行計算:

預(yù)測出的圖像。第二次對比損失,也就是自對比損失,根據(jù)以下公式進(jìn)行計算:

優(yōu)化自對比損失 能夠?qū)崿F(xiàn)遮蔽重建。無論是

能夠?qū)崿F(xiàn)遮蔽重建。無論是 還是

還是 ,負(fù)樣本

,負(fù)樣本 都來自同一批次的實例。

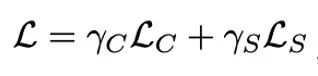

都來自同一批次的實例。 和

和 共同按如下方式優(yōu)化:

共同按如下方式優(yōu)化: ,其中超參數(shù)

,其中超參數(shù) 和

和 用于調(diào)節(jié)各損失項的權(quán)重。

用于調(diào)節(jié)各損失項的權(quán)重。

-

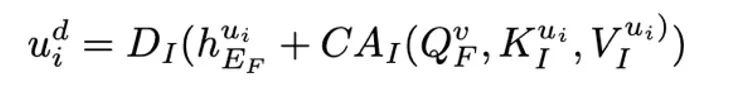

第二階段:使用跨模態(tài)指導(dǎo)進(jìn)行調(diào)整

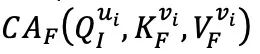

考慮到 fMRI 記錄的信噪比較低且高度卷積的特性,專注于與視覺處理最相關(guān)且對重建最有信息價值的大腦激活模式對 fMRI 特征學(xué)習(xí)器來說至關(guān)重要。

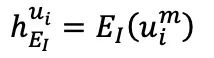

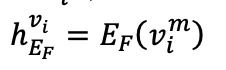

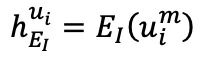

在第一階段預(yù)訓(xùn)練后,fMRI 自編碼器通過圖像輔助進(jìn)行調(diào)整,以實現(xiàn) fMRI 的重建,第二階段同樣遵循此過程。具體而言,從 n 個樣本批次中選擇一個樣本 及其對應(yīng)的 fMRI 記錄的神經(jīng)反應(yīng)

及其對應(yīng)的 fMRI 記錄的神經(jīng)反應(yīng) 。

。 和

和 經(jīng)過分塊和隨機遮蔽處理,分別轉(zhuǎn)變?yōu)?/span>

經(jīng)過分塊和隨機遮蔽處理,分別轉(zhuǎn)變?yōu)?/span> 和

和 ,然后分別輸入到圖像編碼器

,然后分別輸入到圖像編碼器 和 fMRI 編碼器

和 fMRI 編碼器 中,生成

中,生成 和

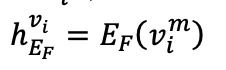

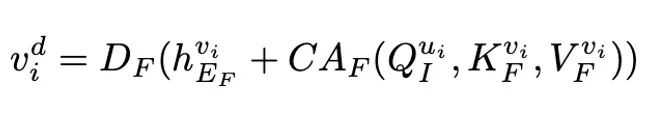

和 。為重建 fMRI

。為重建 fMRI ,利用交叉注意力模塊將

,利用交叉注意力模塊將 和

和 進(jìn)行合并:

進(jìn)行合并:

W 和 b 分別代表相應(yīng)線性層的權(quán)重和偏置。 是縮放因子,

是縮放因子, 是鍵向量的維度。CA 是交叉注意力(cross-attention)的縮寫。

是鍵向量的維度。CA 是交叉注意力(cross-attention)的縮寫。 加上

加上 后,輸入到 fMRI 解碼器中以重建

后,輸入到 fMRI 解碼器中以重建 ,得到

,得到 :

:

圖像自編碼器中也進(jìn)行了類似的計算,圖像編碼器 的輸出

的輸出 通過交叉注意力模塊

通過交叉注意力模塊 與

與 的輸出合并,然后用于解碼圖像

的輸出合并,然后用于解碼圖像 ,得到

,得到 :

:

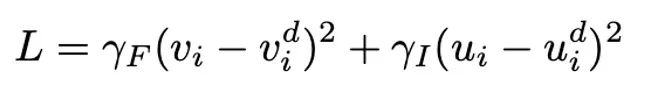

通過優(yōu)化以下?lián)p失函數(shù),fMRI 和圖像自編碼器共同進(jìn)行訓(xùn)練:

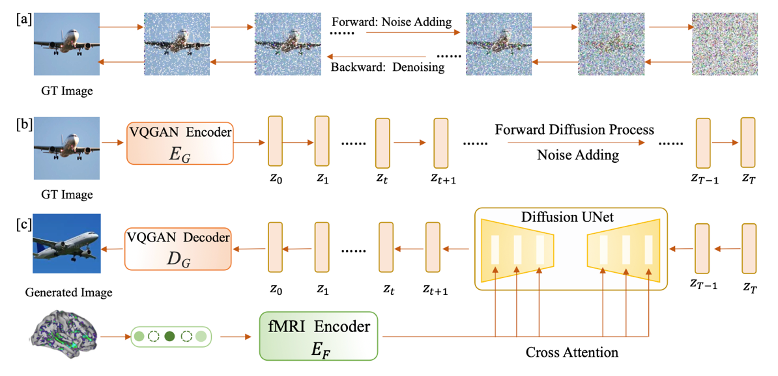

使用潛在擴散模型 (LDM) 生成圖像

在完成 FRL 第一階段和第二階段的訓(xùn)練后,使用 fMRI 特征學(xué)習(xí)器的編碼器 來驅(qū)動一個潛在擴散模型(LDM),從大腦活動生成圖像。如圖所示,擴散模型包括一個向前的擴散過程和一個逆向去噪過程。向前過程逐漸將圖像降解為正態(tài)高斯噪聲,通過逐漸引入變方差的高斯噪聲。

來驅(qū)動一個潛在擴散模型(LDM),從大腦活動生成圖像。如圖所示,擴散模型包括一個向前的擴散過程和一個逆向去噪過程。向前過程逐漸將圖像降解為正態(tài)高斯噪聲,通過逐漸引入變方差的高斯噪聲。

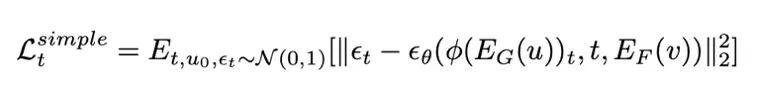

該研究通過從預(yù)訓(xùn)練的標(biāo)簽至圖像潛在擴散模型(LDM)中提取視覺知識,并利用 fMRI 數(shù)據(jù)作為條件生成圖像。這里采用交叉注意力機制,將 fMRI 信息融入 LDM,遵循穩(wěn)定擴散研究的建議。為了強化條件信息的作用,這里采用了交叉注意力和時間步條件化的方法。在訓(xùn)練階段,使用 VQGAN 編碼器 和經(jīng) FRL 第一和第二階段訓(xùn)練的 fMRI 編碼器

和經(jīng) FRL 第一和第二階段訓(xùn)練的 fMRI 編碼器 處理圖像 u 和 fMRI v,并在保持 LDM 不變的情況下微調(diào) fMRI 編碼器,損失函數(shù)為:

處理圖像 u 和 fMRI v,并在保持 LDM 不變的情況下微調(diào) fMRI 編碼器,損失函數(shù)為:

其中, 是擴散模型的噪聲計劃。在推理階段,過程從時間步長 T 的標(biāo)準(zhǔn)高斯噪聲開始,LDM 依次遵循逆向過程逐步去除隱藏表征的噪聲,條件化在給定的 fMRI 信息上。當(dāng)?shù)竭_(dá)時間步長零時,使用 VQGAN 解碼器

是擴散模型的噪聲計劃。在推理階段,過程從時間步長 T 的標(biāo)準(zhǔn)高斯噪聲開始,LDM 依次遵循逆向過程逐步去除隱藏表征的噪聲,條件化在給定的 fMRI 信息上。當(dāng)?shù)竭_(dá)時間步長零時,使用 VQGAN 解碼器 將隱藏表征轉(zhuǎn)換為圖像。

將隱藏表征轉(zhuǎn)換為圖像。

實驗

重建結(jié)果

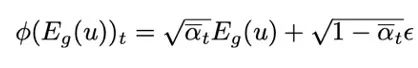

通過與 DC-LDM、IC-GAN 和 SS-AE 等先前研究的對比,并在 GOD 和 BOLD5000 數(shù)據(jù)集上的評估中顯示,該研究提出的模型在準(zhǔn)確率上顯著超過這些模型,其中相對于 DC-LDM 和 IC-GAN 分別提高了 39.34% 和 66.7%

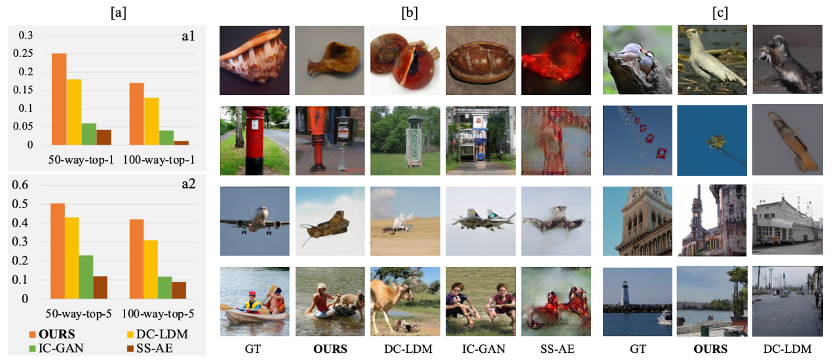

在 GOD 數(shù)據(jù)集的其他四名受試者上的評估顯示,即使在允許 DC-LDM 在測試集上進(jìn)行調(diào)整的情況下,該研究提出的模型在 50 種方式的 Top-1 分類準(zhǔn)確率上也顯著優(yōu)于 DC-LDM,證明了提出的模型在不同受試者大腦活動重建方面的可靠性和優(yōu)越性。

實驗結(jié)果表明,利用所提出的 fMRI 表示學(xué)習(xí)框架和預(yù)先訓(xùn)練的 LDM,可以更好的重建大腦的視覺活動,大大優(yōu)于目前的基線。該工作有助于進(jìn)一步挖掘神經(jīng)解碼模型的潛力。

原文標(biāo)題:NeurIPS23|視覺 「讀腦術(shù)」:從大腦活動中重建你眼中的世界

文章出處:【微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

-

物聯(lián)網(wǎng)

+關(guān)注

關(guān)注

2930文章

46185瀏覽量

391551

原文標(biāo)題:NeurIPS23|視覺 「讀腦術(shù)」:從大腦活動中重建你眼中的世界

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯(lián)網(wǎng)技術(shù)研究所】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

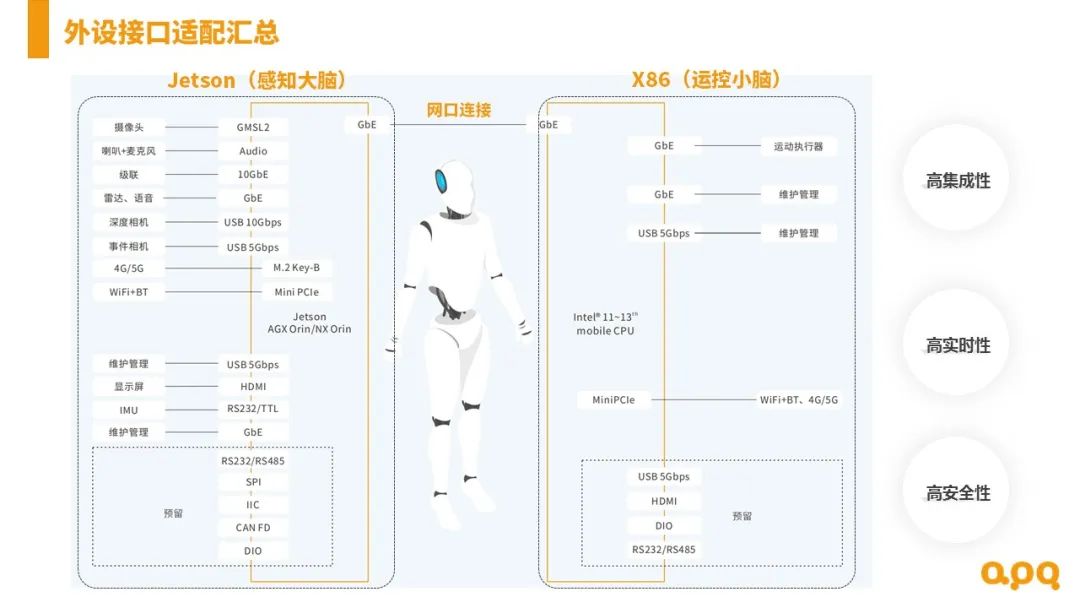

從感知到運控:具身智能機器人控制器的雙腦協(xié)同設(shè)計與場景適配

具身智能×邊緣計算:AI的“大腦”和“身體”如何聯(lián)手闖蕩世界?

雙編碼器:開啟人工智能的"雙腦協(xié)同"新紀(jì)元

腦電基礎(chǔ)系列之腦電電極的分類與技術(shù)對比

腦電偽跡系列之腦電偽跡處理與技術(shù)剖析

腦電偽跡全解析:類型、成因與影響

Meta非入侵式腦機技術(shù):AI讀取大腦信號打字準(zhǔn)確率80%

如何才從ADS1118中讀回命令寄存器中的值呢?

SynSense時識科技亮相CES,展現(xiàn)類腦智能“芯”實力

使用ADS1299進(jìn)行腦電信號采集時采集不到腦電信號,怎么解決?

解鎖機器人視覺與人工智能的潛力,從“盲人機器”改造成有視覺能力的機器人(上)

神經(jīng)重建在自動駕駛模擬中的應(yīng)用

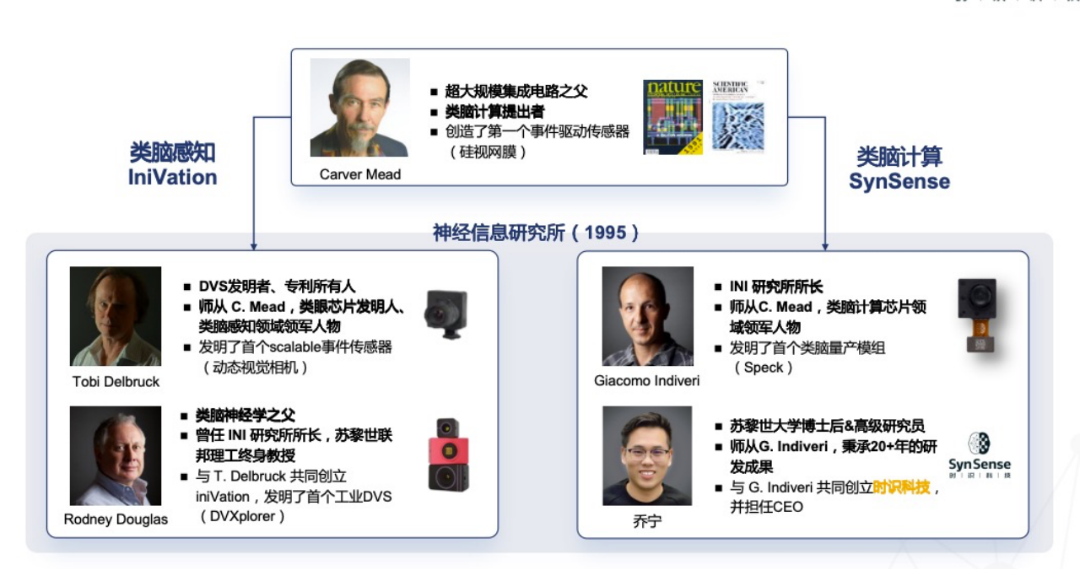

SynSense時識科技收購瑞士類腦視覺傳感器公司iniVation 100%股權(quán)

SynSense時識科技成功收購瑞士類腦視覺傳感器公司iniVation,類腦智能航母蓄勢待發(fā)

腦機接囗疲勞預(yù)測解決方案

NeurIPS23|視覺 「讀腦術(shù)」:從大腦活動中重建你眼中的世界

NeurIPS23|視覺 「讀腦術(shù)」:從大腦活動中重建你眼中的世界

評論