人工智能(AI)領(lǐng)域中的大模型(Large Model)逐漸成為研究的熱點(diǎn)。大模型,顧名思義,是指擁有海量參數(shù)和高度復(fù)雜結(jié)構(gòu)的深度學(xué)習(xí)模型。它的出現(xiàn),不僅推動了AI技術(shù)的突破,更為各行各業(yè)帶來了革命性的變化。

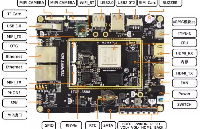

RK3588是瑞芯微推出的新一代旗艦級高端處理器,采用8nm工藝設(shè)計(jì),搭載四核A76+四核A55的八核CPU和Arm高性能GPU,內(nèi)置6T算力的NPU。能夠高效地處理AI算法和模型,為大模型的運(yùn)行提供了強(qiáng)大的硬件支持。

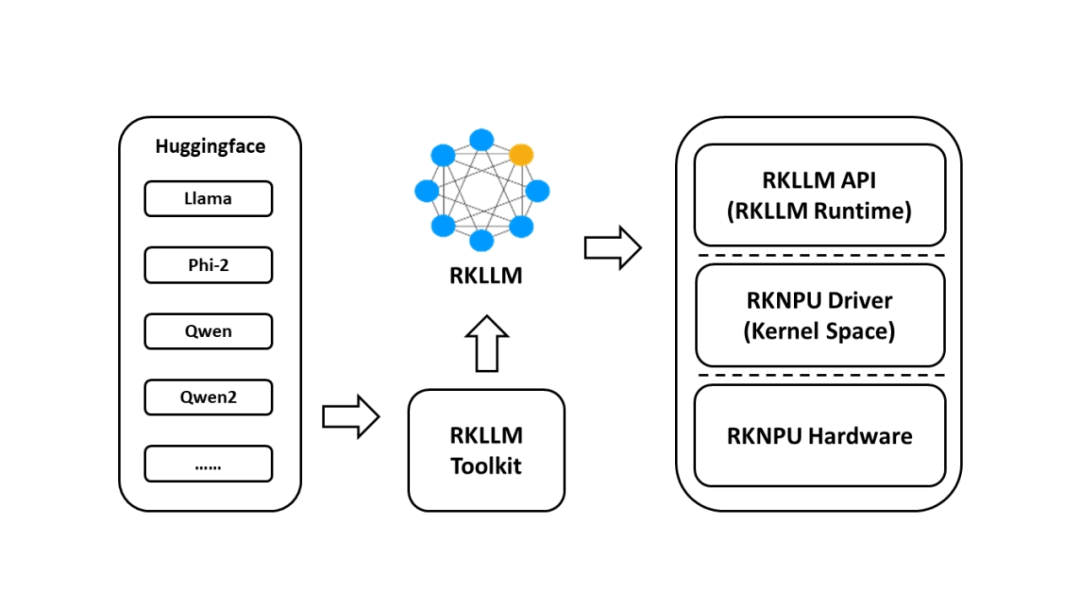

在北京迅為推出的搭載了RK3588處理器的iTOP-RK3588開發(fā)板上,使用RKLLM 工具套件支持在iTOP-RK3588平臺上進(jìn)行LLM(大型語言模型)模型的轉(zhuǎn)換和部署。它與Hugging Face模型架構(gòu)兼容(Hugging Face是廣泛用于自然語言處理任務(wù)的模型架構(gòu)。

目前,該系統(tǒng)支持以下模型:LLaMA、Qwen、Qwen2和Phi-2。支持量化技術(shù),即使用w8a8(8位權(quán)重,8位激活)和w4a16(4位權(quán)重,16位激活)精度進(jìn)行模型量化。這可以在目標(biāo)平臺上更高效地存儲和計(jì)算模型,減小內(nèi)存占用。

iTOP-RK3588開發(fā)板體驗(yàn)大模型

為了讓用戶更快速的體驗(yàn)RKLLM ,北京迅為已經(jīng)對Linux內(nèi)核源碼中的NPU版本進(jìn)行了升級,升級到了最新的0.9.6版本,具體如下所示:

默認(rèn)以將RKLLM動態(tài)庫集成在了Ubuntu和Debian系統(tǒng)中,用戶可以直接拷貝轉(zhuǎn)換完成的RKLLM大預(yù)言模型和推理程序進(jìn)行測試。

審核編輯:劉清

-

處理器

+關(guān)注

關(guān)注

68文章

19842瀏覽量

234057 -

人工智能

+關(guān)注

關(guān)注

1805文章

48887瀏覽量

247749 -

GPU芯片

+關(guān)注

關(guān)注

1文章

305瀏覽量

6155 -

RK3588

+關(guān)注

關(guān)注

7文章

412瀏覽量

5702 -

大模型

+關(guān)注

關(guān)注

2文章

3083瀏覽量

3955

原文標(biāo)題:更新 | 基于北京迅為iTOP-RK3588大語言模型部署測試

文章出處:【微信號:迅為電子,微信公眾號:迅為電子】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

技術(shù)分享|iTOP-RK3588開發(fā)板Ubuntu20系統(tǒng)旋轉(zhuǎn)屏幕方案

基于北京迅為iTOP-RK3588大語言模型部署測試

基于北京迅為iTOP-RK3588大語言模型部署測試

評論