01

研究成果概述

在光照不足的環(huán)境下實(shí)現(xiàn)動(dòng)態(tài)場(chǎng)景的清晰、高幀率視頻是經(jīng)典成像領(lǐng)域的難題。近日,浙江大學(xué)光電科學(xué)與工程學(xué)院汪凱巍、白劍教授團(tuán)隊(duì)聯(lián)合蘇黎世聯(lián)邦理工等國(guó)外科研團(tuán)隊(duì),為行業(yè)提供了基于事件相機(jī)(一種仿生傳感器)的解決方案。團(tuán)隊(duì)提出了一種基于事件相機(jī)的統(tǒng)一幀插值與自適應(yīng)去模糊框架(REFID)。該框架基于雙向遞歸網(wǎng)絡(luò),結(jié)合事件流和圖像信息,自適應(yīng)地融合來(lái)自不同時(shí)間點(diǎn)的信息,從而能夠在模糊的輸入幀情況下同步實(shí)現(xiàn)高質(zhì)量的插幀與模糊圖像還原。此外,研究團(tuán)隊(duì)還發(fā)布了高分辨率事件-視頻數(shù)據(jù)集 HighREV,為事件相機(jī)低級(jí)視覺(jué)任務(wù)提供了新的測(cè)試基準(zhǔn)。

相關(guān)研究成果以“A Unified Framework for Event-based Frame Interpolation with Ad-hoc Deblurring in the Wild”為題于發(fā)表于人工智能領(lǐng)域頂級(jí)期刊IEEE Transactions on Pattern Analysis and Machine Intelligence (TPAMI) 。

02

研究背景

發(fā)明歷史超過(guò)60年的數(shù)字圖像傳感器,本質(zhì)上是基于光子積分原理的:當(dāng)我們打開(kāi)快門(mén)時(shí),每個(gè)像元上發(fā)生光電轉(zhuǎn)換將光子轉(zhuǎn)化為電子實(shí)現(xiàn)圖像信息記錄,每完成一輪累積就輸出一幅圖(幀)。然而,當(dāng)在光線不足的環(huán)境中拍攝動(dòng)態(tài)場(chǎng)景時(shí),由于需要長(zhǎng)時(shí)間打開(kāi)快門(mén)累積足夠的光子會(huì)帶來(lái)“運(yùn)動(dòng)模糊”,同時(shí)也無(wú)法獲得高幀率視頻。

最近十年逐漸被行業(yè)關(guān)注的事件相機(jī)是一種類生物視覺(jué)傳感器,它的輸出不依賴光子累積,因而具有高時(shí)間分辨率(微秒級(jí))和高動(dòng)態(tài)范圍(超過(guò)140dB)的優(yōu)勢(shì),能夠捕捉傳統(tǒng)幀相機(jī)無(wú)法記錄的快速運(yùn)動(dòng)信息。因此,將事件信息與傳統(tǒng)圖像傳感器融合,指導(dǎo)每一幀圖像去除運(yùn)動(dòng)模糊,同時(shí)通過(guò)幀與幀之間的事件信息進(jìn)行插值,有望同步實(shí)現(xiàn)暗光下的高幀率和清晰成像。

03

研究亮點(diǎn)

1

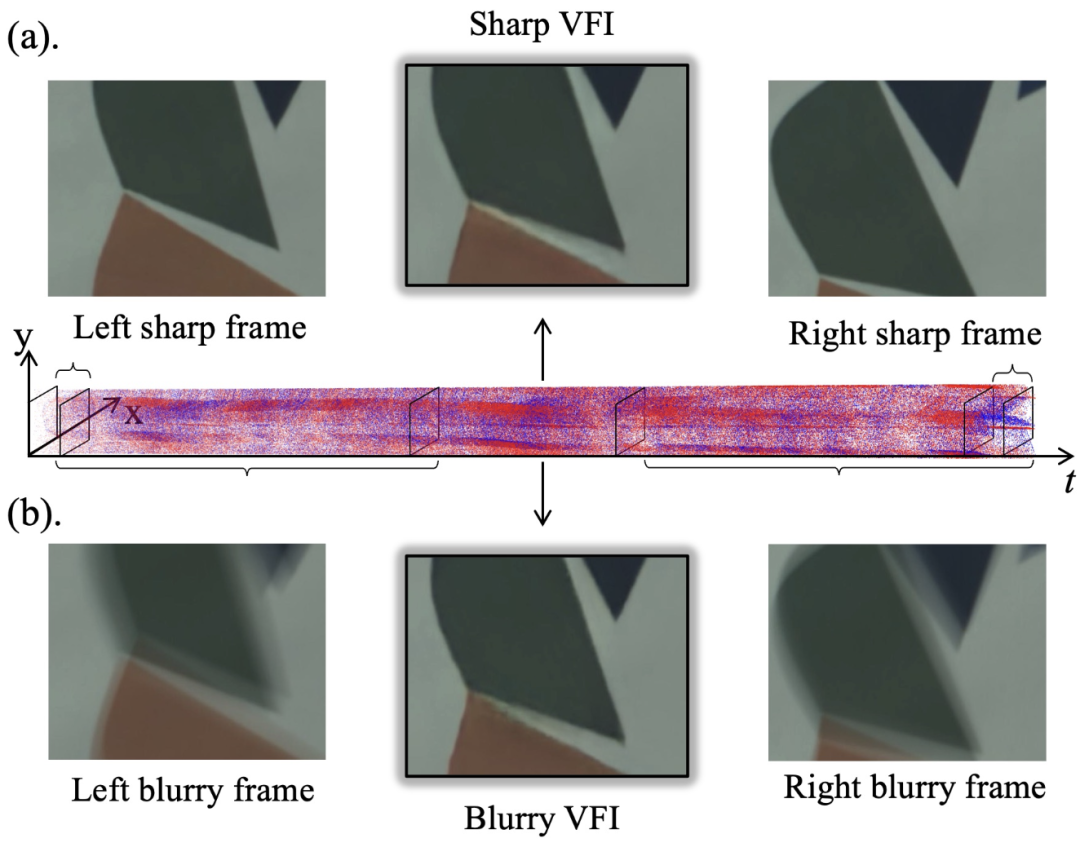

提出統(tǒng)一的事件相機(jī)幀插值與去模糊框架(REFID),能夠同時(shí)對(duì)銳利的視頻和模糊的視頻進(jìn)行插幀。如圖1所示

?采用雙向遞歸網(wǎng)絡(luò)(bidirectional recurrent network),充分利用時(shí)間維度信息,在插值過(guò)程中自適應(yīng)去模糊。

?設(shè)計(jì)了事件引導(dǎo)的自適應(yīng)通道注意力模塊(EGACA),動(dòng)態(tài)調(diào)整事件流與圖像信息的融合權(quán)重,提升插值質(zhì)量。

圖1. 統(tǒng)一的事件相機(jī)幀插值與去模糊框架, 同時(shí)實(shí)現(xiàn)對(duì)銳利的視頻和模糊的視頻進(jìn)行還原和插幀

2

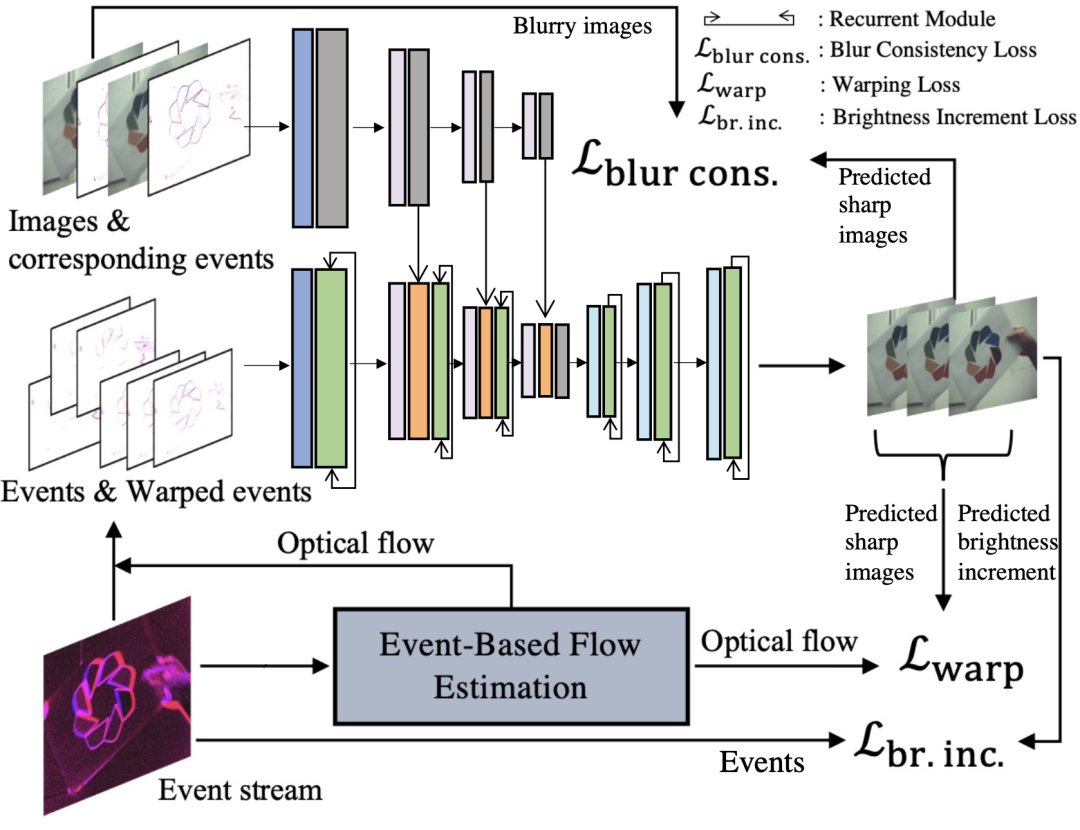

引入自監(jiān)督學(xué)習(xí)策略,提高模型泛化能力:

?通過(guò)事件生成模型和運(yùn)動(dòng)補(bǔ)償機(jī)制,構(gòu)建自監(jiān)督損失,提高模型在無(wú)監(jiān)督環(huán)境下的適應(yīng)性。

?在真實(shí)數(shù)據(jù)集(HighREV)上進(jìn)行自監(jiān)督微調(diào),實(shí)現(xiàn)從合成數(shù)據(jù)到真實(shí)數(shù)據(jù)的無(wú)縫遷移。引入自監(jiān)督學(xué)習(xí)策略,提高模型泛化能力:

?通過(guò)事件生成模型和運(yùn)動(dòng)補(bǔ)償機(jī)制,構(gòu)建自監(jiān)督損失,提高模型在無(wú)監(jiān)督環(huán)境下的適應(yīng)性。

?在真實(shí)數(shù)據(jù)集(HighREV)上進(jìn)行自監(jiān)督微調(diào),實(shí)現(xiàn)從合成數(shù)據(jù)到真實(shí)數(shù)據(jù)的無(wú)縫遷移。

圖2:自監(jiān)督訓(xùn)練/微調(diào)框架

3

構(gòu)建高分辨率事件-顏色視頻數(shù)據(jù)集(HighREV):

?采用1632×1224分辨率的事件相機(jī)采集數(shù)據(jù),涵蓋室內(nèi)外場(chǎng)景,提供高質(zhì)量事件流與RGB視頻對(duì)齊數(shù)據(jù)。

?該數(shù)據(jù)集填補(bǔ)了現(xiàn)有事件相機(jī)數(shù)據(jù)集中高分辨率和彩色數(shù)據(jù)的空缺,為事件相機(jī)的低級(jí)視覺(jué)任務(wù)提供新的測(cè)試基準(zhǔn)。

實(shí)驗(yàn)驗(yàn)證:

?在標(biāo)準(zhǔn)基準(zhǔn)數(shù)據(jù)集(GoPro、HighREV)上,REFID在清晰幀插值、模糊幀插值、單幀去模糊任務(wù)上均超越了當(dāng)前最先進(jìn)的方法。

?在自監(jiān)督微調(diào)場(chǎng)景下,REFID在真實(shí)世界數(shù)據(jù)集上的性能顯著提升,證明了其魯棒性和泛化能力。

圖3: 模糊視頻插幀和銳利視頻插幀結(jié)果(經(jīng)過(guò)了慢放處理)。左側(cè)視頻展示暗光下的原始視頻,可以看到運(yùn)動(dòng)帶來(lái)的模糊和由于低幀率帶來(lái)的不連續(xù);中間視頻為對(duì)標(biāo)算法的效果;右側(cè)視頻為本文提出的新方法的效果,實(shí)現(xiàn)了高幀率清晰成像

04

總結(jié)與展望

人工智能在應(yīng)用端的落地需要為智能終端提供穩(wěn)定可靠的視覺(jué)信息,事件相機(jī)作為一種仿生傳感器可以提供高時(shí)間分辨率的視覺(jué)信息,有望補(bǔ)充傳統(tǒng)傳感器在面對(duì)復(fù)雜場(chǎng)景下的不足。本研究提出的算法框架結(jié)合了兩者的優(yōu)勢(shì),突破了傳統(tǒng)算法在運(yùn)動(dòng)模糊場(chǎng)景下的局限,首次在同一框架內(nèi)同時(shí)實(shí)現(xiàn)高幀率清晰成像。該方法有望在瞬態(tài)信息捕捉、慢動(dòng)作視頻生成、視頻編輯、增強(qiáng)現(xiàn)實(shí)(AR)、智能駕駛等領(lǐng)域發(fā)揮重要作用。

-

仿生傳感器

+關(guān)注

關(guān)注

1文章

10瀏覽量

2915

原文標(biāo)題:前沿進(jìn)展|汪凱巍團(tuán)隊(duì)在IEEE TPAMI發(fā)文報(bào)道基于事件相機(jī)的高時(shí)間分辨清晰成像研究

文章出處:【微信號(hào):zjuopt,微信公眾號(hào):浙大光電】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

矩陣變換器驅(qū)動(dòng)異步電機(jī)模糊自適應(yīng)PI控制

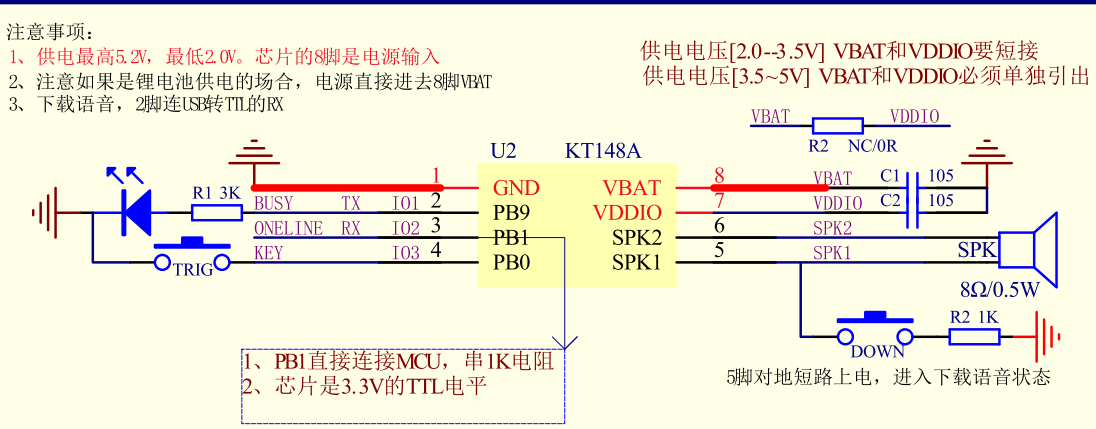

KT148A語(yǔ)音芯片的一線通訊起始信號(hào)6ms,一幀數(shù)據(jù)有幾個(gè)起始信號(hào)

永磁同步電機(jī)自適應(yīng)高階滑模Type-2模糊控制

GLAD應(yīng)用:大氣像差與自適應(yīng)光學(xué)

求助,關(guān)于利用DLPC3438投影與相機(jī)進(jìn)行同步的疑問(wèn)求解

使用自己做的PCB板卡,發(fā)現(xiàn)DLP9500第一幀圖像故障,怎么解決?

基于自適應(yīng)優(yōu)化的高速交叉矩陣設(shè)計(jì)

山澤HDMI 2.1:讓每一幀畫(huà)面都栩栩如生

Teledyne Lecroy示波器插值算法

UHF RFID自適應(yīng)射頻干擾對(duì)消技術(shù)

步進(jìn)電機(jī)如何自適應(yīng)控制?步進(jìn)電機(jī)如何細(xì)分驅(qū)動(dòng)控制?

TDP1204和TMDS1204如何使用自適應(yīng)均衡

TUSB1146的自適應(yīng)均衡帶來(lái)的益處

基于事件相機(jī)的統(tǒng)一幀插值與自適應(yīng)去模糊框架(REFID)

基于事件相機(jī)的統(tǒng)一幀插值與自適應(yīng)去模糊框架(REFID)

評(píng)論