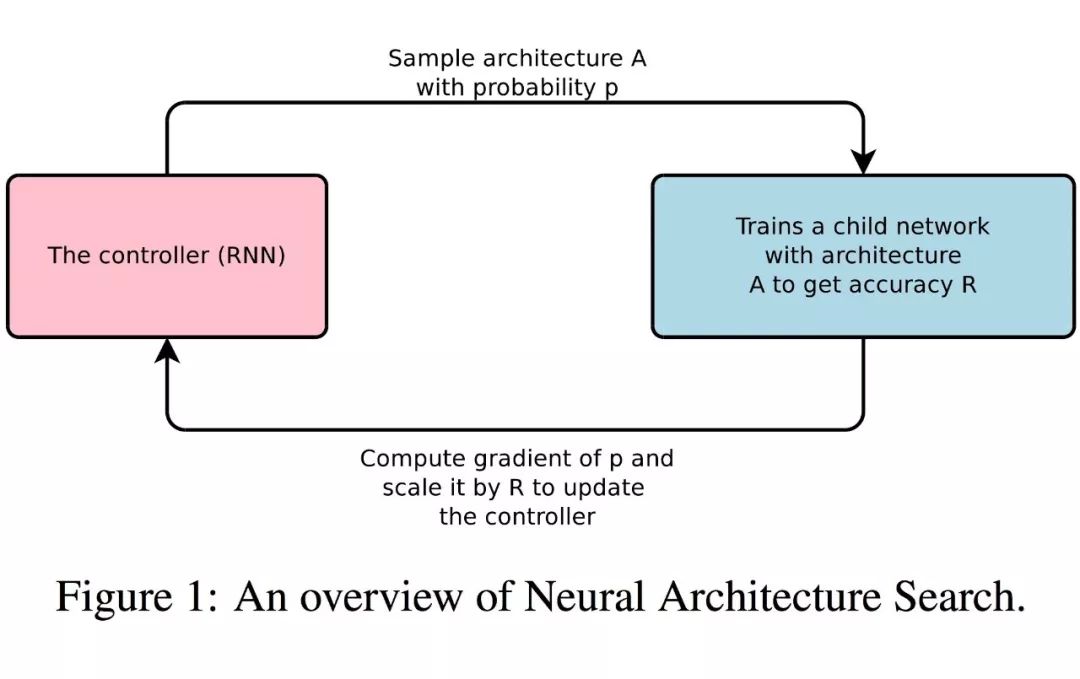

谷歌AutoML是一個基于谷歌在圖像識別領域的最新研究成果——神經架構搜索(Neural Architecture Search,NAS )開發而成的機器學習云軟件工具包。NAS作為算法,面對給定的特定數據集,它會搜索最合適的神經網絡來對該數據集執行特定任務。

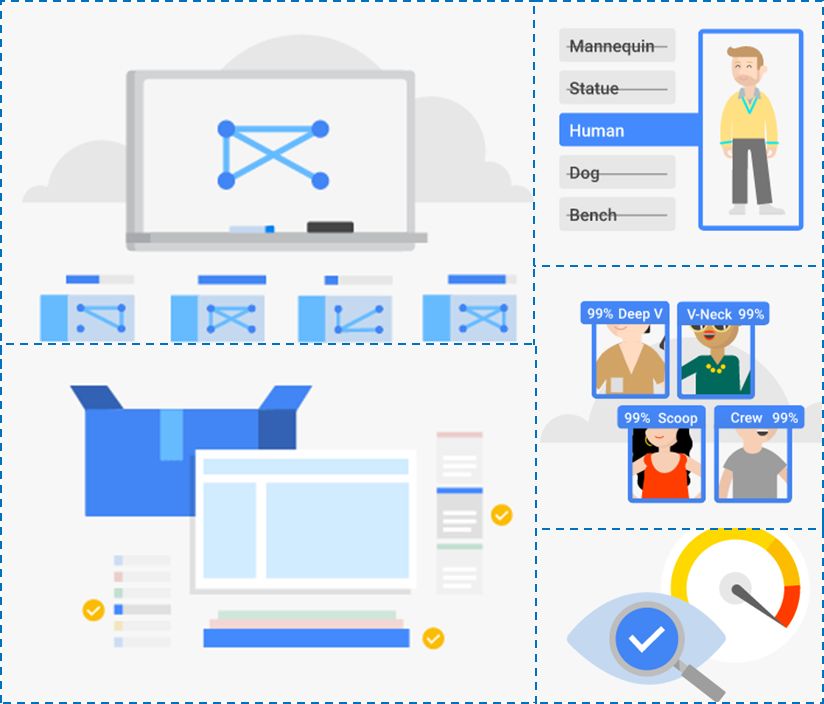

AutoML是一套實現機器學習的工具,可以輕松地訓練高性能的深層網絡,而不需要用戶掌握任何深層學習或人工智能知識,你要做的所有事只是給數據貼上標簽。Google將使用NAS為你的特定數據集和任務找到最佳神經網絡,這種方法比人類手動設計神經網絡表現的更加出色。

它具有可以提供個性化的機器學習模型,用戶需要做的就是提供你需要訓練的數據。在圖形化的界面下整個流程十分容易上手,完全改變了過去復雜的研究過程。同時所有的機器學習技術都是最先進的,你可以在這里用最棒的技術訓練出先進的算法。

AutoML完全改變了整個機器學習的游戲規則,面對許多應用程序APP,不再需要專門的技能和知識。許多公司只需要選擇合適的深度網絡來完成更簡單的任務,例如圖像分類、語音識別和文本處理。屆時他們不再需要雇傭5個機器學習博士,而只要雇傭一個能夠操作鼠標和組織數據的人。

目前只有很少的一部分企業擁有研究和部署機器學習和人工智能業務的能力。只有很有限的一部分人能夠創造先進的機器學習模型。即使是一家已經開始涉足人工智能的公司,依舊需要大量的努力來建立時間緊迫過程復雜的定制化機器學習需求。雖然市面上有很多包含預處理模型的API提供,但將AI帶給每一個人還有很長的路要走。

但AutoML彌補了人工智能在應用上的不足和技術的限制,并使更多的企業更好的利用AI并從中受益。它可以幫助經驗有限的公司利用自己的數據來通過最為先進的機器學習技術來建立定制化的模型。這一技術不僅可以提高機器學習專家的生產力,更幫助缺乏經驗的工程師們構建出他們夢想中的強大AI系統。

毫無疑問,企業使用“人工智能”的方式將會發生巨大轉變。但究竟是如何變化的呢?這種變化對誰有利?那些深度機器學習領域的人會怎樣呢?這篇文章將詳細分析Google的AutoML以及軟件2.0帶來的變化,對機器學習領域的企業和開發人員意味著什么。

AutoML發展越快,企業要投入的研發越少

人工智能領域的許多企業,尤其是初創企業,在深度學習的背景下,都在做相對簡單的事情。這些企業大部分的成果價值來自于它們最終組合出來的產品。例如,大多數計算機視覺初創公司都在使用某種圖像分類網絡,這實際上將是AutoML在該工具包中的第一個入門工具。事實上,作為當前最先進的圖像分類網絡,Google的NASNet已經在TensorFlow中公開了代碼。現在,企業可以跳過產品開發流程中的復雜的實驗研究步驟,只需把學習神經網絡轉移過來去完成他們設定的目標任務即可。由于實驗研究減少,因此可以將更多的業務資源用于產品設計、開發和重要的數據處理。

說到這里,下面就要嘮一嘮產品。

產品體驗變得更加重要

由于更多的時間花在產品設計和開發上,公司將會加快產品更新換代的速度。公司的主要價值將會更多的體現在他們的產品或技術有多好用方面。產品設計得夠好嗎?使用夠方便嗎?數據流程的設置方式是否能夠快速輕松地改進模型?這些新的問題將是公司優化其產品并能夠比競爭對手更快的更新產品的關鍵所在。尖端研究也將不再是提高技術性能的主要驅動力。主要的驅動力變成了數據和資源。數據和資源變得至關重要

如果研究變成公司中不那么重要的一部分,那么一個公司要如何脫穎而出呢?如何在競爭中鶴立雞群呢?當然,銷售、市場營銷以及我們剛才討論的產品設計都非常重要,但是,這些深度學習技術表現的巨大驅動因素是數據和資源。擁有的針對任務的數據越干凈、越多樣化 (兼顧質量和數量),就越能使用諸如AutoML等軟件工具來改進模型。這意味著獲取和處理數據需要大量資源。所有這些都部分地表明了我們正在脫離編寫大量代碼的繁雜生活。

軟件2.0 : 深度學習成為大多數人工具箱中的另一個工具

使用谷歌AutoML,你要做的就是上傳已經標簽好的數據,這樣就萬事俱備了!對于那些對這個領域理解不深需求也不深的人來說,他們只是想借用這種技術的杠桿力量,來撬動更大的成果。深度學習的應用APP變得更容易獲得。在工具包中使用更少的編碼,就可獲取更多的使用工具。事實上,對大多數人來說,深度學習只是工具箱中的另一個常規工具罷了。Andrej Karpathy在sofeware 2.0上寫了一篇很棒的文章,講述了辛苦的碼農如何從編寫大量代碼轉向更多的進行產品設計和使用工具的,然后讓AI完成其余的工作。

但是,這一切還需要創新科學和科研。

創新科學和研究仍有重要的空間

盡管有了這些易于使用的工具,但發展的進程并沒有結束。就像當汽車被發明出來時,我們也沒有停止繼續開發它們,即使現在它們已經變得很高級了,我們還在不停的研發。人工智能還有很多可以提升的空間。比如AI還不夠有創造力,也不會推理,也不能處理復雜的任務。它需要海量的標記數據,而獲取這些數據耗時又耗錢。訓練仍然需要很長時間才能達到最高精度。深度學習模型的性能對于一些簡單的任務(如分類)是很好使的,但是在本地化等方面只是表現的尚可,有時甚至很差(取決于任務的復雜性)。我們甚至都沒能從內部深入了解深層網絡。

所有這些都為科學和研究提供了施展拳腳的空間,特別是為當前人工智能技術的推進提供了機會。在商業方面,一些公司,尤其是科技巨頭(如谷歌、微軟、Facebook、蘋果、亞馬遜)需要通過科學和研究去創新現有的工具來和其他公司競爭。這些公司確實都可以獲得大量的數據和資源,設計出出色的產品,進行大規模的銷售和營銷等,他們確實可以利用這些資源使自己在這場競爭中木秀于林,而這些競爭優勢也可以來自于尖端的創新。

然后還留下最后一個問題~

Good or Bad?

總的來說,創造人工智能技術的這種轉變是一件好事。大多數企業將利用現有的機器學習工具,而不是去創建新的工具,因為也確實沒必要這樣做。接近尖端的人工智能對許多人來說不再高不可攀,這意味著對所有人來說這都是一項更好的技術。人工智能也是一個相當“開放”的領域,例如Andrew Ng這樣的行業內的大咖創造了非常受歡迎的課程來教授人們了解這一重要的新技術。讓事情變得更容易理解有助于人們向快節奏的技術領域過渡。

這種轉變以前也發生過很多次。計算機編程從匯編級編碼開始。后來轉到了C語言這樣的代碼。今天很多人認為C語言太復雜了,所以使用c++。很多時候,甚至不需要像c++這樣復雜的東西,所以只需要使用Python或R的超高級語言。如果你不需要一些超低級別的東西,那么你就沒有必要使用它(例如C代碼優化、從零開始的深度網絡的研發),而且可以簡單地使用一些更高級別的和內置的東西(例如Python、遷移學習、AI工具)。

與此同時,在人工智能技術的科學和研究方面繼續努力至關重要。我們一定可以通過設計基于人工智能的新產品為世界帶來巨大的價值。但這需要新的科學來推動。人類的創造力永遠是寶貴的。

-

神經網絡

+關注

關注

42文章

4814瀏覽量

103480 -

圖像識別

+關注

關注

9文章

526瀏覽量

39088 -

深度學習

+關注

關注

73文章

5560瀏覽量

122762

原文標題:谷歌AutoML將如何改寫商業界對深度學習使用的游戲規則?

文章出處:【微信號:thejiangmen,微信公眾號:將門創投】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

谷歌AutoML是一個基于谷歌在圖像識別領域的最新研究成果

谷歌AutoML是一個基于谷歌在圖像識別領域的最新研究成果

評論