近日,來自愛丁堡大學(xué)的研究人員提出了一種結(jié)合深度神經(jīng)網(wǎng)絡(luò)和樹模型的新型模型——深度神經(jīng)決策樹(Deep Neural Decision Trees, DNDT)。

這種模型不僅具有了基于樹模型的可解釋性的優(yōu)點(diǎn),同時(shí)還可以利用神經(jīng)網(wǎng)絡(luò)中的梯度下降法來進(jìn)行訓(xùn)練,并可方便地利用現(xiàn)有的神經(jīng)網(wǎng)絡(luò)框架實(shí)現(xiàn),將使得神經(jīng)網(wǎng)絡(luò)的過程得以用樹的方式得到有效的解釋。論文的作者均來自于愛丁堡大學(xué)信息學(xué)院感知、運(yùn)動(dòng)和行為研究所ipab。

對于感知模型來說可解釋性是十分重要的,特別是在一些涉及倫理、法律、醫(yī)學(xué)和金融等場景下尤其如此,同樣在關(guān)鍵領(lǐng)域的控制中,我們希望能夠回溯所有的步驟來保證模型因果邏輯和結(jié)果的正確性。深度神經(jīng)網(wǎng)絡(luò)在計(jì)算機(jī)視覺、語音識別和語言模型等很多領(lǐng)域取得了成功,但作為缺乏可解釋性的黑箱模型,限制了它在模型必須求證因果領(lǐng)域的應(yīng)用,在這些領(lǐng)域中我們需要明確決策是如何產(chǎn)生的以便評測驗(yàn)證整個(gè)決策過程。除此之外,在類似于商業(yè)智能等領(lǐng)域,知曉每一個(gè)因素是如何影響最終決策比決策本身有時(shí)候更為重要。與此不同的是,基于決策樹模型(包括C4.5和CART等)擁有清晰的可解釋性,可以追隨樹的結(jié)構(gòu)回溯出決策產(chǎn)生的因由。

愛丁堡大學(xué)的研究人員們基于樹和神經(jīng)網(wǎng)絡(luò)的結(jié)構(gòu)提出了一種新型的模型——深度神經(jīng)決策樹(DNDT),并探索了樹和網(wǎng)絡(luò)之間的相互作用。DNDT是一種具有特殊結(jié)構(gòu)的神經(jīng)網(wǎng)絡(luò),任意一種配置下的DNDT都對應(yīng)著決策樹,這使其具有了可解釋性。同時(shí)由于DNDT實(shí)現(xiàn)自神經(jīng)網(wǎng)絡(luò),使得它擁有了很多傳統(tǒng)決策樹不曾具有的特性:

1.DNDT可以通過已有的神經(jīng)網(wǎng)絡(luò)工具便捷的實(shí)現(xiàn),可能只需要幾行即可;

一個(gè)實(shí)現(xiàn)的例子

2.所有的參數(shù)可以通過隨機(jī)梯度下降法(SGD)同時(shí)優(yōu)化,代替了復(fù)雜的貪婪優(yōu)化過程;

3.具有大規(guī)模處理數(shù)據(jù)的能力,可以利用mini-batch和GPU加速;

4.可以作為一個(gè)模塊插入到現(xiàn)有的神經(jīng)網(wǎng)絡(luò)模型中,并整體訓(xùn)練。

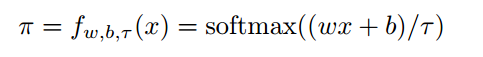

在這種網(wǎng)絡(luò)中研究人員們使用了一種稱為soft binning function的函數(shù),并將它用于DNDT中的分支操作。一個(gè)典型的soft binning函數(shù)可以得到輸入標(biāo)量的二進(jìn)制值,與Hard binning不同的是,這是一種可微的近似。這使得決策樹中的的參數(shù)是可導(dǎo)的,也就可以利用梯度下降法來進(jìn)行訓(xùn)練了。下式是MDMT中的一層神經(jīng)元表示:

其中w為權(quán)重參數(shù)[1,2,。。。,n+1],b表示為[0,-β1,-β2...-βn],代表了n個(gè)分支點(diǎn)。式中的τ代表了溫度因子,其趨向于0時(shí)將為生成one-hot編碼。下圖是不同τ作用下的softbinning函數(shù):

其中x在[0,1]區(qū)間內(nèi),此時(shí)的分割點(diǎn)為0.33和0.66,三個(gè)圖分別代表了τ為1,0,1和0.01的情況,越小意味著分支越陡峭。其中,

o1 = x

o2 = 2x-0.33

o3 = 3x-0.99

在決策過程中,通過上式給出的二進(jìn)制函數(shù)利用克羅內(nèi)克內(nèi)積來實(shí)現(xiàn),下圖中顯示了DNDT在Iris數(shù)據(jù)集上的學(xué)習(xí)過程,上半部分描述了深度神經(jīng)決策樹的運(yùn)行過程,其中紅色表示為可訓(xùn)練的變量,黑色數(shù)字為常量。下半部分作為對比顯示了先前決策樹的分類過程。

通過本文提出的方法,研究人員將決策樹的訓(xùn)練過程轉(zhuǎn)換為了訓(xùn)練二進(jìn)制分支點(diǎn)和葉子分類器。同時(shí)由于前傳過程是可微的,所以所有的點(diǎn)都可以同時(shí)利用SGD的方法來訓(xùn)練。由于可以利用與神經(jīng)網(wǎng)絡(luò)類似的mini-batch,DNDT可以便捷的實(shí)例規(guī)模化。但目前存在的問題是克羅內(nèi)克積的存在使得特征的規(guī)模化不易實(shí)現(xiàn)。目前的解決方案是引入多棵樹來來訓(xùn)練特征集中的子特征組合,避免了較“寬”的數(shù)據(jù)。

研究人員通過實(shí)驗(yàn)驗(yàn)證了中模型的有效性,在常見的14個(gè)數(shù)據(jù)集上(特別是Tabular類型的數(shù)據(jù))取得了較好的結(jié)果。其中決策樹使用了超參數(shù),“基尼”尺度和“best”分支;神經(jīng)網(wǎng)絡(luò)使用了兩個(gè)隱藏層共50個(gè)神經(jīng)元作為基準(zhǔn)。而DNDT則使用了1最為分支點(diǎn)數(shù)目的超參數(shù)。

研究顯示DNDT模型隨著分割點(diǎn)的增加,整體激活的比重卻在下降,顯示了這種模型具有正則化的作用。

同時(shí)研究還顯示了分割點(diǎn)數(shù)量對于每一個(gè)特征的影響;

并利用了GPU來對計(jì)算過程進(jìn)行了加速。

在未來還會探索DNDT與CNN的結(jié)合與應(yīng)用,并將SGD應(yīng)用到整個(gè)模型的全局優(yōu)化中去,并嘗試基于決策樹的遷移學(xué)習(xí)過程。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4814瀏覽量

103724 -

gpu

+關(guān)注

關(guān)注

28文章

4949瀏覽量

131324 -

決策樹

+關(guān)注

關(guān)注

3文章

96瀏覽量

13832

原文標(biāo)題:愛丁堡大學(xué)研究人員提出「深度神經(jīng)決策樹」,可結(jié)合深度神經(jīng)網(wǎng)絡(luò)和樹模型

文章出處:【微信號:thejiangmen,微信公眾號:將門創(chuàng)投】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

如何優(yōu)化BP神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)率

BP神經(jīng)網(wǎng)絡(luò)與深度學(xué)習(xí)的關(guān)系

如何訓(xùn)練BP神經(jīng)網(wǎng)絡(luò)模型

深度學(xué)習(xí)入門:簡單神經(jīng)網(wǎng)絡(luò)的構(gòu)建與實(shí)現(xiàn)

人工神經(jīng)網(wǎng)絡(luò)的原理和多種神經(jīng)網(wǎng)絡(luò)架構(gòu)方法

卷積神經(jīng)網(wǎng)絡(luò)的實(shí)現(xiàn)工具與框架

卷積神經(jīng)網(wǎng)絡(luò)與傳統(tǒng)神經(jīng)網(wǎng)絡(luò)的比較

深度學(xué)習(xí)中的卷積神經(jīng)網(wǎng)絡(luò)模型

RNN模型與傳統(tǒng)神經(jīng)網(wǎng)絡(luò)的區(qū)別

如何使用Python構(gòu)建LSTM神經(jīng)網(wǎng)絡(luò)模型

Moku人工神經(jīng)網(wǎng)絡(luò)101

深度神經(jīng)決策樹:深度神經(jīng)網(wǎng)絡(luò)和樹模型結(jié)合的新模型

深度神經(jīng)決策樹:深度神經(jīng)網(wǎng)絡(luò)和樹模型結(jié)合的新模型

評論