【導語】之前我們為大家介紹過一項非常酸爽的研究“Talking Face Generation”:給定音頻或視頻后(輸入),可以讓任意一個人的面部特征與輸入的音視頻信息保持一致,也就是說出輸入的這段話。當時就想到了“楊超越的聲音+高曉松的臉”這樣的神仙搭配。不過,近期一項新研究再度抓到了筆者的眼睛!在最新的研究中,研究者僅需要音頻信息就生成了人臉... ...如此鬼畜的操作,此乃頭一次見啊!接下來就為大家介紹一下這項工作!

音頻和圖像是人類最常用的兩種信號傳輸模式,圖像傳達的信息非常直觀,而語音包含的信息其實比我們想象的要更豐富,包括說話人的身份,性別和情緒狀態等等。從這兩個信號中提取的特征通常是高度相關的,可以讓人僅聆聽聲音就可以想象他的視覺外觀。WAV2PIX 的工作就是僅利用語音輸入,來生成說話者的人臉圖像。其實這就是一個跨模態的視覺生成任務。

談到這項研究的貢獻,主要有三點:

提出了一個能夠直接從原始的語音信號生成人臉的條件GAN:WAV2PIX;

提供了一個在語音和人臉兩方面綜合質量很高的一個數據集:Youtubers;

實驗證明論文的方法可以生成真實多樣的人臉。

論文收集了大V用戶(Youtubers)上傳到 Youtube 的演講視頻,這些視頻通常具有高質量的說話環境、表達方式、人臉特征等。Youtubers 數據集主要由兩部分組成:一個是自動生成的數據集和一個手動處理后的高質量的子集。

主要的預處理工作:

音頻最初下載的是高級音頻編碼(AAC)格式,44100 Hz,立體聲。因此轉換為 WAV 格式,并重新采樣到 16 kHz,每個樣例占 16 位并轉換為單聲道。

采用基于 Haar 特征的人臉檢測器來檢測正臉。僅采納置信度高的幀

保存檢測出來的那幀圖像及前后兩秒的語音幀,以及一個標簽(identity)。

方法介紹

研究主要由三個模塊構成:一個是語音編碼器,一個是圖片生成網絡,一個是圖片判別網絡。

語音編碼器(Speech Encoder):已有的方法大多數是手工提取音頻特征,并不是針對生成網絡的任務進行優化的,而 SEGAN 提出了一種在波形上用于語音處理的方法。因此作者在已有的工作 SEGAN 上進行修改。修改為具有 6 層一維網絡,并且每層的 kernel 大小是 15x15,步長為 4,然后每層卷積網絡后面使用 LeakyReLU 激活函數,網絡的輸入通道是 1。輸入 16kHZ 下1 秒的語音片段,上述的卷積網絡可以得到一個 4x1024 的張量,然后采用三個全連接網絡將特征數量從 4x1024 降到 128。作為生成器網絡的輸入。

圖片生成器(Image Generator Network):輸入是語音編碼器的 128 向量。采用二維轉置卷積、插值、dropout 等方式將輸入轉為 64x64x3 或者 128x128x3 的張量。在 G 的損失函數中添加了一個輔助損失用于保持說話人的標簽(Identity)。

圖片判別器(Image Discriminator Network):判別器由幾層步長為 2,kernel 大小是 4x4 的卷積網絡組成,并使用譜歸一化和 LeakyReLU 激活函數。當張量為 4x4 時,作者拼接了語音的輸入,并采用最后一層網絡來計算 D 網絡的分數。

實驗過程

訓練:將手動處理后的數據集作為訓練集,采用數據增強等手動。值得注意的是,在處理時將每張圖像復制了 5 次,并將其與 4 秒音頻里面隨機采樣的 5 個不同的1秒音頻塊進行匹配。因此總共有 24K 左右的圖像-音頻對用于模型訓練。其它超參數采用參考的文獻設置。

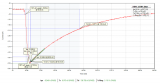

評估:下圖給出了可視化的結果,雖然生成的圖像都比較模糊,但基本可以觀察到人的面部特征,并且有不同的面部表情。

作者進一步微調了一個預訓練的 VGG-FACE Descriptor 網絡,用于量化測試結果,在作者提供的數據集上,可以達到 76.81% 的語音識別準確率和 50.08% 的生成圖像準確率。

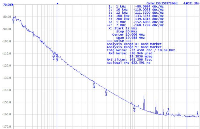

為了評估模型生成圖像的真實程度,作者定義了一個 68 個人臉關鍵點的精度檢測分數。如下圖所示,測試結果精度可以達到 90.25%。表明在大多數情況下生成的圖像保留了基本的面部特征。

感興趣的小伙伴們可以下載閱讀研究一下~

-

語音

+關注

關注

3文章

399瀏覽量

38692 -

AI

+關注

關注

88文章

35123瀏覽量

279673

原文標題:僅用語音,AI 就能“腦補”你的臉! | 技術頭條

文章出處:【微信號:mcuworld,微信公眾號:嵌入式資訊精選】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

直線度測量儀的精度如何評估?

鋰電池外殼氣密性檢測儀的檢測精度可以達到多少

《DNESP32S3使用指南-IDF版_V1.6》第六十章 貓臉檢測實驗

腦電偽跡系列之腦電偽跡處理與技術剖析

影響OTDR測試結果的因素

直線電機的精度能達到多少?和重復定位精度一樣嗎

使用ADS1299進行腦電信號采集時采集不到腦電信號,怎么解決?

使用LMH7322測量脈沖占空比,誤差精度達到0.1怎么改進?

視覺檢測精度能達到 0.01 嗎

僅憑聲音,AI 就能“腦補”你的臉!測試結果精度可以達到 90.25%

僅憑聲音,AI 就能“腦補”你的臉!測試結果精度可以達到 90.25%

評論