納米光子介質(zhì)在人工神經(jīng)干涉中的應(yīng)用

本文中,學(xué)者們介紹了一種納米光子神經(jīng)介質(zhì),可以執(zhí)行相當(dāng)于人工神經(jīng)計(jì)算的復(fù)雜和非線性模式映射。具體而言,他們的工作證明了通過納米光子介質(zhì)的光波能夠執(zhí)行人工神經(jīng)計(jì)算,測(cè)試集的精度約為84%。

許多現(xiàn)有的光學(xué)神經(jīng)計(jì)算技術(shù)通過利用分層前饋網(wǎng)絡(luò)遵循數(shù)字ANN的架構(gòu)。但是對(duì)于新的納米光子神經(jīng)介質(zhì)(NNM),研究人員表明,通過利用光學(xué)反射,可以超越分層前饋網(wǎng)絡(luò)的范例,以連續(xù)和無層的方式實(shí)現(xiàn)人工神經(jīng)計(jì)算。

復(fù)雜信息是輸入光的波前編碼。該介質(zhì)轉(zhuǎn)換波前可以實(shí)現(xiàn)復(fù)雜的計(jì)算任務(wù),例如圖像識(shí)別。在輸出端,光能集中在明確定義的位置,例如,可以將其解釋為圖像中物體的身份。這些計(jì)算媒體可以小到幾十個(gè)波長(zhǎng),并提供超高的計(jì)算密度。他們利用亞波長(zhǎng)散射體實(shí)現(xiàn)復(fù)雜的輸入/輸出映射,超越了傳統(tǒng)納米光子器件的功能。

一段時(shí)間以來,AI社區(qū)一直在尋找減少神經(jīng)網(wǎng)絡(luò)訓(xùn)練和推理所需的內(nèi)存和功耗的方法。與傳統(tǒng)方法不同,NNM非常具有前景,因?yàn)樗哪芎淖畹汀?/p>

該方法的固有并行性可以顯著提高計(jì)算速度。結(jié)合超高計(jì)算密度,NNM方法可用作各種信息設(shè)備中的模擬預(yù)處理單元。

原文:shorturl.at/sJPS4

無監(jiān)督數(shù)據(jù)增強(qiáng)(UDA),實(shí)現(xiàn)更高效,更連續(xù)的半監(jiān)督學(xué)習(xí)

在最近的一篇論文中,Google AI研究人員證明,數(shù)據(jù)增強(qiáng)也可以應(yīng)用于未標(biāo)記的數(shù)據(jù),用來推進(jìn)半監(jiān)督學(xué)習(xí)。他們的方法,即所謂的無監(jiān)督數(shù)據(jù)增強(qiáng)或UDA,能夠促進(jìn)模型預(yù)測(cè)在未標(biāo)記的樣本和增強(qiáng)的未標(biāo)記樣本之間保持一致。

在評(píng)估方面,UDA取得了出色的成果。例如,在IMDb文本分類數(shù)據(jù)集中,UDA僅使用20個(gè)標(biāo)記樣本實(shí)現(xiàn)了4.20的錯(cuò)誤率,超過了在25,000個(gè)標(biāo)記樣本上訓(xùn)練的傳統(tǒng)模型。

在標(biāo)準(zhǔn)的半監(jiān)督學(xué)習(xí)基準(zhǔn)CIFAR-10和SVHN上,UDA優(yōu)于所有前述方法,CIFAR-10的錯(cuò)誤率為2.7%,僅有4,000個(gè)樣本,SVHN的錯(cuò)誤率為2.85%,只有250個(gè)樣本。

UDA也適用于像ImageNet這樣的大型數(shù)據(jù)集。當(dāng)使用標(biāo)記組的10%進(jìn)行訓(xùn)練時(shí),UDA將前1/前5精度從55.1/77.3%提高到68.7/88.5%。對(duì)于具有130萬額外未標(biāo)記數(shù)據(jù)的完整ImageNet,UDA進(jìn)一步將性能從78.3/94.4%提升至79.0/94.5%。

這項(xiàng)工作表明,可以應(yīng)用數(shù)據(jù)增強(qiáng)來增強(qiáng)半監(jiān)督學(xué)習(xí)。對(duì)于半監(jiān)督學(xué)習(xí)方法的數(shù)據(jù)稀缺,這一方法非常有效。此外,即使有大規(guī)模數(shù)據(jù),UDA也能提供強(qiáng)勁的收益。

為了避免UDA過度擬合,研究人員提出了一種稱為TSA的技術(shù),用于存在大量未標(biāo)記數(shù)據(jù)的情況。這種學(xué)習(xí)已被證明與數(shù)據(jù)提升相匹配并且令人驚訝地超越了監(jiān)督學(xué)習(xí)。

增強(qiáng)神經(jīng)網(wǎng)絡(luò)的泛化

Google AI的研究人員建議在網(wǎng)絡(luò)層使用標(biāo)準(zhǔn)化的邊際分配作為推廣差距的預(yù)測(cè)因子。在對(duì)邊際分布與概括之間的關(guān)系進(jìn)行實(shí)證研究后,他們證明了距離的正確歸一化和邊際分布的一些基本統(tǒng)計(jì)可以準(zhǔn)確地預(yù)測(cè)廣義差距。

研究人員還介紹了深度模型推廣(DEMOGEN)數(shù)據(jù)集,包括756個(gè)訓(xùn)練深度模型,以及他們?cè)贑IFAR-10和CIFAR-100數(shù)據(jù)集上的訓(xùn)練和測(cè)試性能。這些模型是CNN和ResNet-32的變體,具有不同的流行正則化技術(shù)和超參數(shù)設(shè)置,從而引發(fā)了廣泛的泛化行為。例如,在CIFAR-10上訓(xùn)練的CNN模型的測(cè)試精度范圍為60%至90.5%,一般化差距為1%至35%。

這項(xiàng)工作為AI社區(qū)提供了一個(gè)用于研究泛化的工具。它還鼓勵(lì)進(jìn)一步研究隱藏層中的泛化間隙預(yù)測(cè)器和邊緣分布。

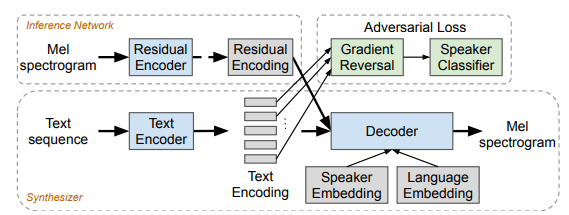

多語言語音合成和跨語言語音克隆

學(xué)者們提出了一種基于Tacotron(中文語音合成)的多人多種語言文本到語音(TTS)的合成算法,能夠在多種語言中生成高質(zhì)量的語音。模型結(jié)構(gòu)采用基于注意力機(jī)制的序列到序列模型,根據(jù)輸入文本序列生成倒譜梅頻(log-mel,來自MFCC梅爾頻率倒譜系數(shù))圖幀序列。

該模型是通過使用音位輸入表示來設(shè)計(jì)的,以激勵(lì)跨語言的模型容量共享。它還包含了一個(gè)對(duì)抗性的損失,以幫助理清它的說話者表示。通過對(duì)每種語言的多名使用者進(jìn)行訓(xùn)練,加入自動(dòng)編碼輸入,并在訓(xùn)練期間來幫助穩(wěn)定注意力,從而進(jìn)一步擴(kuò)大了訓(xùn)練規(guī)模。

該模型對(duì)三種語言的高質(zhì)量語音合成和語音訓(xùn)練的跨語言傳輸具有重要的應(yīng)用潛力。例如,不需要任何雙語或并行語言的訓(xùn)練,它就能夠使用英語使用者的聲音合成流利的西班牙語。此外,該模型在學(xué)習(xí)說外語的同時(shí)還會(huì)適量調(diào)節(jié)口音。

它可以擴(kuò)展并利用大量低質(zhì)的訓(xùn)練數(shù)據(jù),來支持更多的使用者和語言。

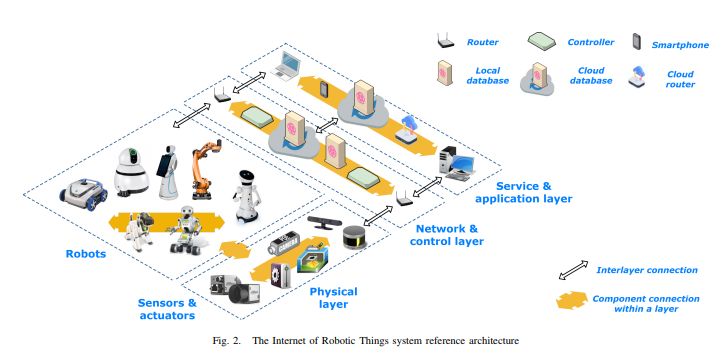

機(jī)器人物聯(lián)網(wǎng)的分析、挑戰(zhàn)與解決方案

機(jī)器人物聯(lián)網(wǎng)(IoRT)是一種新引入的理論,旨在定義機(jī)器人在物聯(lián)網(wǎng)場(chǎng)景中的綜合運(yùn)用。物聯(lián)網(wǎng)和機(jī)器人研究領(lǐng)域的研究現(xiàn)在已經(jīng)緊密地聯(lián)系在一起了,不能再分別看待。

它們的緊密聯(lián)系使兩個(gè)研究領(lǐng)域走到了一起,研究人員只有合作才能推動(dòng)這兩個(gè)領(lǐng)域的進(jìn)步。本文試圖將這兩個(gè)領(lǐng)域結(jié)合在一起,提供了關(guān)于互聯(lián)網(wǎng)機(jī)器人的一個(gè)概述,分析和挑戰(zhàn),可能的解決方案。該研究探討了IoRT架構(gòu)、智能空間集成以及機(jī)器人應(yīng)用等問題。

當(dāng)兩個(gè)或兩個(gè)以上的領(lǐng)域緊密聯(lián)系在一起時(shí),將它們的研究和開發(fā)結(jié)合起來,并快速推進(jìn)它們就變得至關(guān)重要。機(jī)器人和物聯(lián)網(wǎng)結(jié)合的時(shí)代已經(jīng)到來,目的是幫助研究人員共同努力,推動(dòng)相關(guān)理論、模型和應(yīng)用的發(fā)展。

它們的綜合運(yùn)用將有助于促進(jìn)研究,這些研究可用于幫助開發(fā)更多更好的應(yīng)用,例如家庭自動(dòng)化、衛(wèi)生健康、交通、物流等。

-

機(jī)器人

+關(guān)注

關(guān)注

213文章

29708瀏覽量

212697 -

語音合成

+關(guān)注

關(guān)注

2文章

92瀏覽量

16492

原文標(biāo)題:合成特朗普的西班牙語演講,新研究實(shí)現(xiàn)跨語言語音克隆 | 一周AI最火論文

文章出處:【微信號(hào):BigDataDigest,微信公眾號(hào):大數(shù)據(jù)文摘】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

VirtualLab Fusion:分層介質(zhì)元件

VirtualLab:立方體分束器上的受抑全內(nèi)反射(FTIR)

機(jī)器人主控芯片平臺(tái)有哪些 機(jī)器人主控芯片一文搞懂

開售RK3576 高性能人工智能主板

光子 AI 處理器的核心原理及突破性進(jìn)展

VirtualLab Fusion應(yīng)用:分層介質(zhì)元件

EastWave應(yīng)用:自動(dòng)計(jì)算光子晶體透反率

樂視網(wǎng)新增被執(zhí)行人信息,涉及金額超1.1億

廣匯汽車及關(guān)聯(lián)公司成被執(zhí)行人,標(biāo)的金額超10億

人工神經(jīng)網(wǎng)絡(luò)的原理和多種神經(jīng)網(wǎng)絡(luò)架構(gòu)方法

開源項(xiàng)目 ! 利用邊緣計(jì)算打造便攜式視覺識(shí)別系統(tǒng)

嵌入式和人工智能究竟是什么關(guān)系?

Moku人工神經(jīng)網(wǎng)絡(luò)101

超導(dǎo)納米線延遲線單光子成像器件進(jìn)展及應(yīng)用

納米光子介質(zhì)能夠執(zhí)行人工神經(jīng)計(jì)算 因?yàn)樗哪芎淖畹?/h1>

納米光子介質(zhì)能夠執(zhí)行人工神經(jīng)計(jì)算 因?yàn)樗哪芎淖畹?/h1>

評(píng)論