一.導論

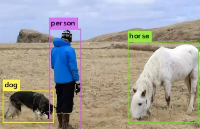

目前深度學習已經在2D計算機視覺領域取得了非凡的成果,比如使用一張圖像進行目標檢測,語義分割,對視頻當中的物體進行目標跟蹤等任務都有非常不錯的效果。傳統(tǒng)的3D計算機視覺則是基于純立體幾何來實現的,而目前我們使用深度學習在3D計算機視覺當中也可以得到一些不錯的效果,目前甚至有超越傳統(tǒng)依靠立體幾何識別準確率的趨勢。因此咱們現在來介紹一下深度學習在3D計算機視覺當中的應用吧!本博文參考了前幾天斯坦福大學最新出的CS231n課程(2020/8/11新出),新課增加了3D計算機視覺和視頻/動作分類的lecture,同時豐富了生成對抗網絡(GAN)的內容,但暫時國內還無人翻譯,因此小編將其翻譯整理成博文的形式供大家參考,如有錯誤之處,請大家見諒,同時歡迎大家討論。

二.3D計算機視覺訓練集以及表示方法

在3D計算機視覺當中,我們可以采用于訓練的模型共有以上幾種,分別是:

1.Depth Map(深度圖)

2.Voxel Grid(翻譯過來很奇怪,因此就保留原英語)

4.PointCloud(三維點云)

5.Mesh

那么什么是Depth Map(深度圖)呢?咱們來看看

三.Depth Map(深度圖)

深度圖的圖像如下所示:

在左上角有一張關于斯坦福大學寢室的圖片,我們可以將其轉化為右上角的深度圖,其中深度圖當中不同的顏色表示了不同物體距離攝像頭的距離,距離攝像頭的距離越大,則顯示出來的顏色則越紅。我們假設有一個神經網絡,我們只需要輸入一張圖片,就可以得到圖片當中的所有位置距離攝像頭的距離,這樣是不是很酷呢?那么我們如何使用神經網絡對一系列的圖片訓練成為深度圖的形式呢?一些研究人員便立馬想到可以使用全卷積神經網絡(Fully convolutional Network)來實現這個過程,全卷積神經網絡(Fully convolutional Network)是我們之前在2D計算機視覺當中所采用的用于圖像分割的神經網絡,之前圖像分割得到的是每一個像素點顯示的是屬于某一個物體類別的概率值,而現在我們把同樣的神經網絡用于深度圖當中就可以得到圖像當中某一個像素距離攝像頭的遠近大小。這樣就可以完美得到咱們的深度圖訓練模型了,我們甚至可以把這個全卷積神經網絡替換成U-net以期在一些特定數據集上得到更好的效果。模型如下所示:

這個模型首先也是輸出一個3通道的彩色圖片,經過一個全卷積神經網絡(FCN)然后對深度圖進行估計,輸出的深度圖僅僅具有兩個維度,因為第三個維度為1,意味著我們輸出的深度圖實際上是黑白的,用黑色或者白色的深度來表示距離攝像頭的距離,圖像當中使用了彩色僅僅是因為看起來更加方便。同時這里的loss使用了L2距離進行損失函數的編寫。

但是!!!!細心的同學肯定會發(fā)現其中有一定的問題,那就是同一個物體,擁有不同的大小,他們如果僅僅通過一張圖片來判定他們離攝像頭的距離是不一定準確的。因為圖片當中并沒有包含物體有關深度的信息。

比如我們有兩只形狀完全相同的鳥,但是其中一只鳥是另一只鳥大小的2倍,我們把小鳥放到離攝像頭更近的位置,將大鳥放到離攝像頭更遠的位置,那么僅僅通過一張圖片我們就會認為這兩只鳥離我們的攝像頭距離是一樣大的!如下圖所示:

那么這樣我們又該如何解決呢?聰明的研究人員設計了一個具有尺寸不變特征的的loss function來解決了這個問題,這個loss function的寫法如下:

至于這個公式為什么會讓圖片的深度信息得以保留,這里不再贅述,感興趣的同學可以翻看一下提出這個loss的論文,在2016年的世界頂級人工智能會議論文NIPS上發(fā)表,于紐約大學(New York University)提出,論文的鏈接如下:https://papers.nips.cc/paper/5539-depth-map-prediction-from-a-single-image-using-a-multi-scale-deep-network.pdf

同時呢,在深度圖當中還有一種圖叫做垂直表面法向量圖,它的圖像如下所示:

最后輸出圖像當中的不同顏色代表了這個物體的表面所朝空間當中的方向,比如綠色代表這個物體的表面是朝向右邊的,而紅色則代表這個物體的表面是朝向左邊的。我們也可以使用全卷積神經網絡(Fully convolutional Network)對這種輸出的圖像進行處理,其中的結構如下所示:

最后的Loss采用了(x*y)/(|x|*|y||)的方法,因為我們所預測的圖像具備圖像的方向和深度的信息,而圖像的方向和大小正好可以由向量表示,豈不美哉?每一個訓練集當中的圖片的其中一個像素點都可以由一個向量來表示,同時具備深度(長度)和方向的信息。而原圖當中某個像素點的大小可以表示為向量x,通過神經網絡推測之后的同一個像素點則可以表示為向量y,因此我們可以使用公式(x*y)/(|x|*|y||)來衡量這兩個向量之間的差距,其中(x*y)中的乘法使用了點乘,因此上下相除可得cos(theta)也就是圖片當中某個像素點所具備的loss的大小,將整個圖片當中所有像素點的大小加起來則可以得到整個圖像當中l(wèi)oss的大小了。

四.Voxel Grid網格表示法

如上圖所示,我們可以將一張二維的圖片轉為一張三維的Voxel grid圖,什么是Voxel grid圖呢?Voxel grid圖就是在一個三維的,大小為V*V*V的空間立體當中,由一系列1*1*1正方體網格堆砌出來的三維立體圖形,Voxel grid圖當中的每一個網格只具有兩個值,1或者0,1表示這個地方有正方體,0表示這個地方沒有正方體。一個Mesh圖當中只保留物體的形狀和大小信息,而不保留物體的顏色以及紋理的信息。

我們先來看一個有趣的問題,用什么方法可以對三維Voxel grid圖進行分類呢?我們暫時不考慮將二維圖像恢復到三維Voxel grid圖的情況的話,常見的手段是使用立體3D卷積,如下圖所示:

3D立體卷積和我們的2D卷積有一點不同之處,那就是卷積核的神奇之處是它竟然是一個正立方體!而不是一個二維的平面!在上圖當中,我們的輸入是一個四通道的1*30*30*30的Voxel grid圖,輸入的圖像可能是一個椅子,也可能是一個床。我們通過三維卷積,不斷地進行卷積以及池化的操作,接著使用全連接神經網絡將其展開,最后使用softmax函數將其繼續(xù)擰分類。我們使用3D卷積能夠對立體圖像的特征進行更為有效的檢測,因為一個立體的圖像不僅僅有長和寬上面的信息,還有其有關深度的相關信息,因此需要采用3D卷積。3D卷積的動態(tài)圖如下所示,這個例題動態(tài)圖當中卷積核的大小為3*3*3:

再回到我們剛才的問題,如何將一個二維的圖像轉化為Voxel grid圖呢,我們可以采用的卷積神經網絡如下所示:

首先我們將二維的圖像首先送入到一個2D卷積神經網絡當中,用于提取這個二維圖像的特征,然后通過全連接神經網絡或者Flatten層將其展平一個一維的向量,這樣就可以更加方便地轉化reshape為四通道進行三維卷積的形式,前面我們已經說過三維卷積能夠更好地抽象地還原和提取到圖像在三維空間上的個特征,因此我們對剛才二維圖像抽象出來的特征通過三維卷積進行還原,這是一個通過三維卷積進行上采樣的過程。最后輸出的結果就可以得到我們的Voxels grid圖啦!

但是使用三維卷積常常就會用更為昂貴的代價來換取更為準確的結果,因為三維卷積使用的參數過多,如下圖所示:

我們僅僅儲存1024^3個Voxels grid網格就需要電腦4GB的顯存,實在是太大了!好多電腦的顯存還沒有這么大呢!因此有些研究人員則直接使用二維卷積對圖像進行三維的還原,當然效果肯定沒這么好啦,如下圖所示:

這個思想就很和我們的自編碼器(Auto-Encoders)很像了。

五.采用隱函數

我們還可以采用物體在三維空間當中的函數圖像來表示一個立體物體,我們再用神經網絡來重新擬合出這個函數就好啦,個人覺得在這種方法不太合理,如下所示:

六.采用3D點云

采用3D點云應該是目前比較靠譜的方案,

在3D點云當中每一個點,都有三個參數,分別是每個點在x,y,z軸上的位置,對3D點云進行分類的話和對Mesh分類的方法差不多,也是經過一定的神經網絡再經過softmax函數就可以得到最后的分類了!如下圖所示:

這就是今天小編給大家分享的全部內容啦!

-

計算機視覺

+關注

關注

9文章

1708瀏覽量

46754 -

3D視覺

+關注

關注

4文章

452瀏覽量

28225 -

深度學習

+關注

關注

73文章

5560瀏覽量

122758

原文標題:一文入門當今最火的3D視覺

文章出處:【微信號:vision263com,微信公眾號:新機器視覺】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

英飛凌邊緣AI平臺通過Ultralytics YOLO模型增加對計算機視覺的支持

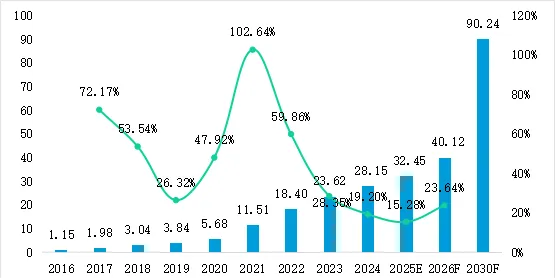

從2D走向3D的視覺傳感器

【小白入門必看】一文讀懂深度學習計算機視覺技術及學習路線

英特爾推出全新實感深度相機模組D421

立體視覺新手必看:英特爾? 實感? D421深度相機模組

晶體管計算機和電子管計算機有什么區(qū)別

如何利用ARMxy ARM嵌入式計算機的NPU進行深度學習模型的訓練和優(yōu)化?

ARMxy ARM嵌入式計算機搭載 1 TOPS NPU支持深度學習

深度學習在3D計算機視覺當中的應用

深度學習在3D計算機視覺當中的應用

評論