作者:Valentina Alto

編譯:ronghuaiyang

導(dǎo)讀

使用Keras實(shí)現(xiàn)圖像分類中的激活熱圖的可視化,幫助更有針對性的改進(jìn)模型。

類別激活圖(CAM)是一種用于計(jì)算機(jī)視覺分類任務(wù)的強(qiáng)大技術(shù)。它允許研究人員檢查被分類的圖像,并了解圖像的哪些部分/像素對模型的最終輸出有更大的貢獻(xiàn)。

基本上,假設(shè)我們構(gòu)建一個(gè)CNN,目標(biāo)是將人的照片分類為“男人”和“女人”,然后我們給它提供一個(gè)新照片,它返回標(biāo)簽“男人”。有了CAM工具,我們就能看到圖片的哪一部分最能激活“Man”類。如果我們想提高模型的準(zhǔn)確性,必須了解需要修改哪些層,或者我們是否想用不同的方式預(yù)處理訓(xùn)練集圖像,這將非常有用。

在本文中,我將向你展示這個(gè)過程背后的思想。為了達(dá)到這個(gè)目的,我會使用一個(gè)在ImageNet上預(yù)訓(xùn)練好的CNN, Resnet50。

我在這個(gè)實(shí)驗(yàn)中要用到的圖像是,這只金毛獵犬:

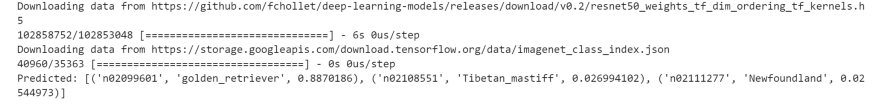

首先,讓我們在這張圖上嘗試一下我們預(yù)訓(xùn)練模型,讓它返回三個(gè)最有可能的類別:

from keras.applications.resnet50 import ResNet50 from keras.preprocessing import image from keras.applications.resnet50 import preprocess_input, decode_predictions import numpy as npmodel = ResNet50(weights='imagenet')img_path = 'golden.jpg' img = image.load_img(img_path, target_size=(224, 224)) x = image.img_to_array(img) x = np.expand_dims(x, axis=0) x = preprocess_input(x)preds = model.predict(x) # decode the results into a list of tuples (class, description, probability) print('Predicted:', decode_predictions(preds, top=3)[0])

如你所見,第一個(gè)結(jié)果恰好返回了我們正在尋找的類別:Golden retriver。

現(xiàn)在我們的目標(biāo)是識別出我們的照片中最能激活黃金標(biāo)簽的部分。為此,我們將使用一種稱為“梯度加權(quán)類別激活映射(Grad-CAM)”的技術(shù)(官方論文:https://arxiv.org/abs/1610.02391)。

這個(gè)想法是這樣的:想象我們有一個(gè)訓(xùn)練好的CNN,我們給它提供一個(gè)新的圖像。它將為該圖像返回一個(gè)類。然后,如果我們?nèi)∽詈笠粋€(gè)卷積層的輸出特征圖,并根據(jù)輸出類別對每個(gè)通道的梯度對每個(gè)通道加權(quán),我們就得到了一個(gè)熱圖,它表明了輸入圖像中哪些部分對該類別激活程度最大。

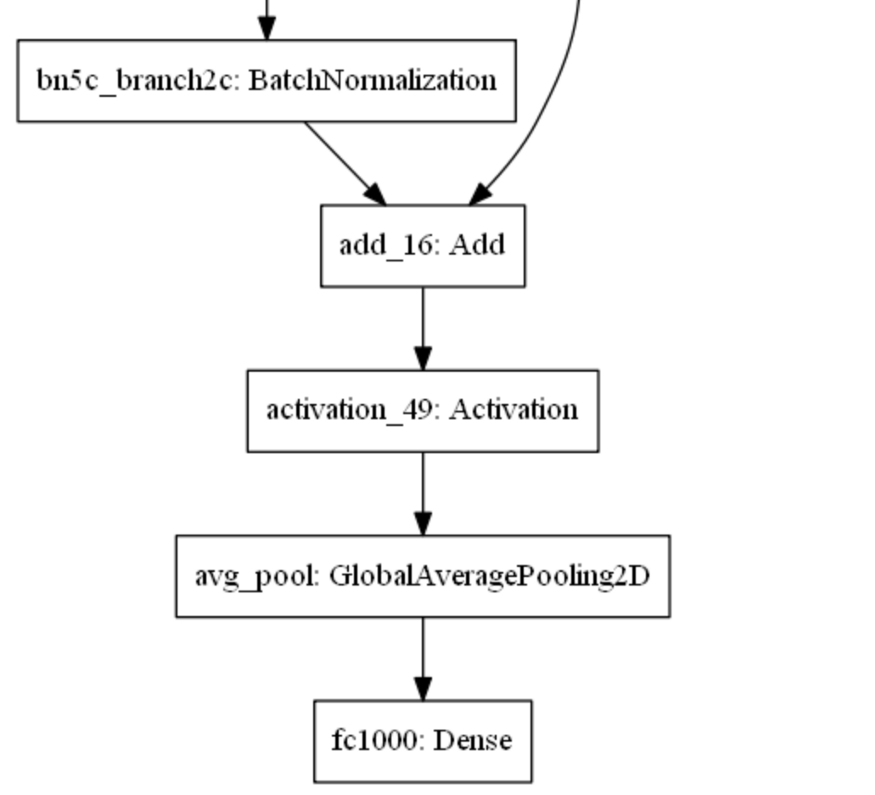

讓我們看看使用Keras的實(shí)現(xiàn)。首先,讓我們檢查一下我們預(yù)先訓(xùn)練過的ResNet50的結(jié)構(gòu),以確定我們想要檢查哪個(gè)層。由于網(wǎng)絡(luò)結(jié)構(gòu)很長,我將在這里只顯示最后的block:

from keras.utils import plot_model plot_model(model)

讓我們使用最后一個(gè)激活層activation_49來提取我們的feature map。

golden = model.output[:, np.argmax(preds[0])] last_conv_layer = model.get_layer('activation_49') from keras import backend as K grads = K.gradients(golden, last_conv_layer.output)[0] pooled_grads = K.mean(grads, axis=(0, 1, 2)) iterate = K.function([model.input], [pooled_grads, last_conv_layer.output[0]]) pooled_grads_value, conv_layer_output_value = iterate([x]) for i in range(pooled_grads.shape[0]): conv_layer_output_value[:, :, i] *= pooled_grads_value[i] heatmap = np.mean(conv_layer_output_value, axis=-1) import matplotlib.pyplot as plt heatmap = np.maximum(heatmap, 0) heatmap /= np.max(heatmap) plt.matshow(heatmap)

這個(gè)熱圖上看不出什么東西出來。因此,我們將該熱圖與輸入圖像合并如下:

import cv2 img = cv2.imread(img_path) heatmap = cv2.resize(heatmap, (img.shape[1], img.shape[0])) heatmap = np.uint8(255 * heatmap) heatmap = cv2.applyColorMap(heatmap, cv2.COLORMAP_JET) merged= heatmap * 0.4 + imgplt.imshow(merged)

如你所見,圖像的某些部分(如鼻子部分)特別的指示出了輸入圖像的類別。

英文原文:https://valentinaalto.medium.com/class-activation-maps-in-deep-learning-14101e2ec7e1

本文轉(zhuǎn)自:AI公園,作者:Valentina Alto,編譯:ronghuaiyang,

轉(zhuǎn)載此文目的在于傳遞更多信息,版權(quán)歸原作者所有。

審核編輯:何安

-

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5558瀏覽量

122699

發(fā)布評論請先 登錄

結(jié)構(gòu)可視化:利用數(shù)據(jù)編輯器剖析數(shù)據(jù)內(nèi)在架構(gòu)?

VirtualLab Fusion應(yīng)用:3D系統(tǒng)可視化

可視化組態(tài)物聯(lián)網(wǎng)平臺是什么

VirtualLab Fusion中的可視化設(shè)置

VirtualLab Fusion應(yīng)用:光波導(dǎo)k域布局可視化(“神奇的圓環(huán)”)

七款經(jīng)久不衰的數(shù)據(jù)可視化工具!

光學(xué)系統(tǒng)的3D可視化

什么是大屏數(shù)據(jù)可視化?特點(diǎn)有哪些?

如何找到適合的大屏數(shù)據(jù)可視化系統(tǒng)

Minitab 數(shù)據(jù)可視化技巧

智慧能源可視化監(jiān)管平臺——助力可視化能源數(shù)據(jù)管理

深度學(xué)習(xí)中類別激活熱圖可視化背后的思想

深度學(xué)習(xí)中類別激活熱圖可視化背后的思想

評論