在前不久落下帷幕的第十六屆國(guó)際語(yǔ)義評(píng)測(cè)比賽(The 16th International Workshop on Semantic Evaluation,SemEval 2022)中,哈工大社會(huì)計(jì)算與信息檢索研究中心(HIT-SCIR)與哈工大訊飛聯(lián)合實(shí)驗(yàn)室的聯(lián)合團(tuán)隊(duì)在多語(yǔ)種慣用語(yǔ)識(shí)別任務(wù)子賽道SubtaskA(one-shot)中獲得冠軍。本期我們將對(duì)這個(gè)任務(wù)的奪冠系統(tǒng)進(jìn)行簡(jiǎn)要介紹,更多具體細(xì)節(jié)請(qǐng)參考我們的論文。

論文標(biāo)題:HITat SemEval-2022 Task 2: Pre-trained Language Model for Idioms Detection

論文作者:初征,楊子清,崔一鳴,陳志剛,劉銘

論文鏈接:http://arxiv.org/abs/2204.06145

任務(wù)介紹

Task 2 Subtask A子賽道是跨語(yǔ)言慣用語(yǔ)檢測(cè)任務(wù)。任務(wù)給出多種語(yǔ)言的含多字短語(yǔ)的語(yǔ)句,參賽隊(duì)伍需要利用模型判斷目標(biāo)句子中的多字短語(yǔ)的使用方法是慣用語(yǔ)用法 (Idiomatic)還是字面用法(Literal)。任務(wù)共覆蓋三種語(yǔ)言,包括英語(yǔ)、葡萄牙語(yǔ)和加利西亞語(yǔ)。與普通的慣用語(yǔ)檢測(cè)任務(wù)相比,該評(píng)測(cè)更加強(qiáng)調(diào)考察模型的跨語(yǔ)言遷移能力。在zero-shot設(shè)置下,不提供加利西亞語(yǔ)的訓(xùn)練數(shù)據(jù),需要模型通過(guò)英語(yǔ)和葡萄牙語(yǔ)的數(shù)據(jù)集進(jìn)行zero-shot遷移;在one-shot下提供少量加利西亞語(yǔ)的訓(xùn)練數(shù)據(jù),需要模型具備在不同語(yǔ)言之下良好的few-shot遷移能力。

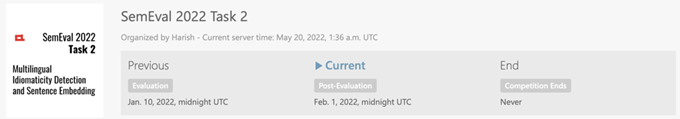

圖1是任務(wù)數(shù)據(jù)示例。在第一句中,big fish為字面義,表示大魚(yú);第二句中,big fish為隱含義(慣用語(yǔ)),表示大人物。模型需要利用訓(xùn)練數(shù)據(jù)對(duì)這兩種用法做出區(qū)分。

圖1:SemEval-2022 Task2 SubtaskA任務(wù)數(shù)據(jù)示例

系統(tǒng)介紹

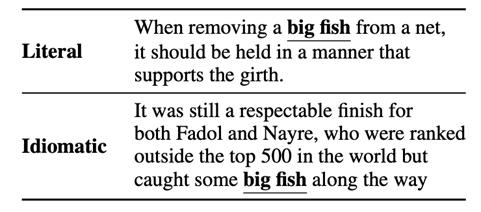

提交的系統(tǒng)使用XLM-RoBERTa作為編碼器,在預(yù)處理過(guò)程中對(duì)訓(xùn)練數(shù)據(jù)的慣用語(yǔ)短語(yǔ)(MWE)進(jìn)行特殊標(biāo)記,在訓(xùn)練過(guò)程中使用R-Drop作為輔助訓(xùn)練目標(biāo),在訓(xùn)練結(jié)束后,根據(jù)訓(xùn)練數(shù)據(jù)的統(tǒng)計(jì)信息制定了啟發(fā)式規(guī)則對(duì)模型預(yù)測(cè)結(jié)果進(jìn)行校正。此外還嘗試了數(shù)據(jù)增強(qiáng)、對(duì)比學(xué)習(xí)輔助訓(xùn)練、對(duì)抗訓(xùn)練等方法,整體結(jié)構(gòu)如圖2所示:

1. 預(yù)處理:對(duì)輸入的樣本進(jìn)行截?cái)唷?biāo)記MWE、數(shù)據(jù)增強(qiáng)等操作。

2. 模型訓(xùn)練:采用XLM-R作為基模型,以cross-entropy損失作為主要訓(xùn)練目標(biāo),以R-drop等方式優(yōu)化輔助目標(biāo)。

3. 后處理:根據(jù)訓(xùn)練數(shù)據(jù)特征對(duì)模型預(yù)測(cè)結(jié)果進(jìn)行校正。

下面將針對(duì)部分主要優(yōu)化技巧進(jìn)行簡(jiǎn)要介紹。

圖2:SemEval-2022 Task2 Subtask A 系統(tǒng)結(jié)構(gòu)

1、數(shù)據(jù)預(yù)處理

數(shù)據(jù)截?cái)啵簽榱吮M可能地減少截?cái)嗨a(chǎn)生的文本信息丟失,在設(shè)定句子最大長(zhǎng)度前對(duì)長(zhǎng)度信息進(jìn)行了統(tǒng)計(jì),最終確定使用128作為最大長(zhǎng)度可保證絕大多數(shù)句子不被截?cái)唷?/p>

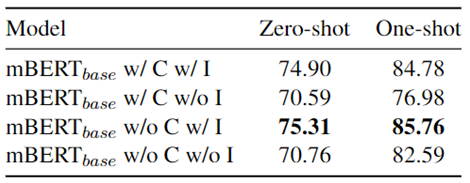

短語(yǔ)標(biāo)記:任務(wù)的每一條數(shù)據(jù)提供了目標(biāo)句子中要被預(yù)測(cè)的慣用語(yǔ)短語(yǔ),為了能夠讓模型能夠關(guān)注到慣用語(yǔ),對(duì)句子中的慣用語(yǔ)使用特殊符號(hào)進(jìn)行標(biāo)記。例如,包含慣用語(yǔ)bigfish的文本 caught some bigfish along the way 將被標(biāo)記為caught some[SEP] big fish [SEP] along the way。由于預(yù)訓(xùn)練對(duì)于命名實(shí)體具有識(shí)別能力,而在該任務(wù)的數(shù)據(jù)中,命名實(shí)體幾乎都進(jìn)行首字母大寫(xiě)變形并且標(biāo)注為非慣用語(yǔ)用法,在后續(xù)的實(shí)驗(yàn)中改善了慣用語(yǔ)標(biāo)注方法,僅標(biāo)注未經(jīng)過(guò)變形的慣用語(yǔ)短語(yǔ)。對(duì)比實(shí)驗(yàn)結(jié)果如圖3所示,I表示標(biāo)記慣用語(yǔ),C表示使用上下文文本。對(duì)比w/ I 和 w/o I的實(shí)驗(yàn),可驗(yàn)證這一改動(dòng)能夠提高性能效果。

上下文信息:此外,我們還發(fā)現(xiàn),不使用任務(wù)提供的額外上下文文本數(shù)據(jù),而僅使用包含慣用語(yǔ)的句子(w/o C),能取得更優(yōu)的效果,如圖3第三行所示。原因可能為不包含上下文文本數(shù)據(jù)的短文本能使模型更聚焦于待判別的慣用短語(yǔ)。

圖3: 上下文以及標(biāo)注慣用語(yǔ)對(duì)結(jié)果的影響

2、模型訓(xùn)練

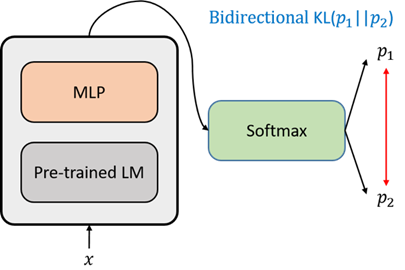

訓(xùn)練過(guò)程使用XLM-RoBERTa作為編碼器,接池化層和softmax分類器。對(duì)不同池化方法進(jìn)行了實(shí)驗(yàn),結(jié)果表明池化方法對(duì)最終結(jié)果沒(méi)有顯著影響,為了簡(jiǎn)便,使用[SEP]作為句子向量表示。訓(xùn)練過(guò)程中嘗試了多種輔助手段,包括R-Drop、對(duì)抗訓(xùn)練、數(shù)據(jù)增強(qiáng)、對(duì)比學(xué)習(xí)輔助目標(biāo)等。實(shí)驗(yàn)結(jié)果表明,R-Drop以及對(duì)抗訓(xùn)練能夠顯著提高模型表現(xiàn),并且相較于對(duì)抗訓(xùn)練,R-Drop能夠取得更大的性能提升,結(jié)果詳見(jiàn)下一節(jié)。

圖4:R-Drop示意圖

3、后處理

在訓(xùn)練結(jié)束后,根據(jù)訓(xùn)練數(shù)據(jù)的分布統(tǒng)計(jì)信息制定了啟發(fā)式規(guī)則。對(duì)于在訓(xùn)練集中僅出現(xiàn)過(guò)一次的短語(yǔ),因缺乏不同標(biāo)簽對(duì)應(yīng)的訓(xùn)練數(shù)據(jù),我們采用訓(xùn)練集中僅出現(xiàn)過(guò)的標(biāo)簽作為預(yù)測(cè)標(biāo)簽,以減少訓(xùn)練集的人工標(biāo)記偏差對(duì)結(jié)果的影響。

實(shí)驗(yàn)結(jié)果

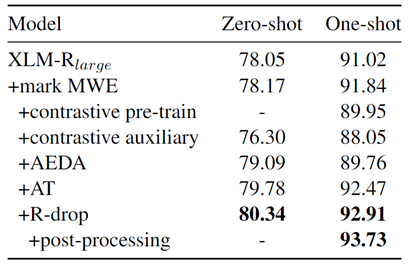

模型的最終效果及消融實(shí)驗(yàn)如圖5所示。

圖5:不同方法對(duì)結(jié)果的影響

標(biāo)記MWE(mark MWE)可以同時(shí)提升zero-shot和one-shot效果;我們還嘗試了對(duì)比學(xué)習(xí)方法,然而在zero-shot和one-shot上均沒(méi)有提升;AEDA是一個(gè)簡(jiǎn)單的操作標(biāo)點(diǎn)符號(hào)的數(shù)據(jù)增強(qiáng)策略,對(duì)zero-shot有一定幫助;在兩種提升模型穩(wěn)定性的方法(對(duì)抗訓(xùn)練和R-drop)中,R-drop有更好的表現(xiàn)。最后,后處理策略對(duì)訓(xùn)練集中出現(xiàn)的偏差做了很好的校正。顯著地提升了效果。

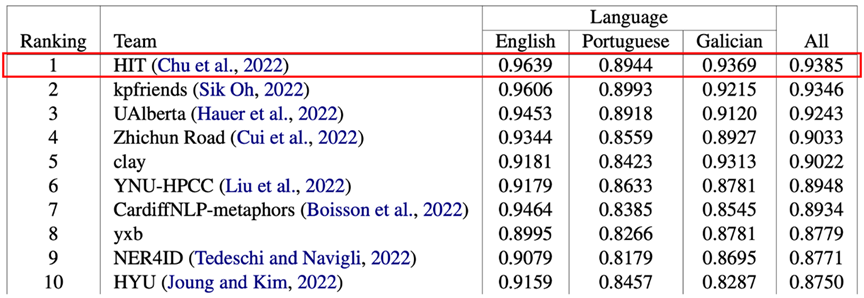

多語(yǔ)種慣用語(yǔ)識(shí)別任務(wù)子賽道Subtask A(one-shot)最終榜單:HIT-SCIR與HFL聯(lián)合團(tuán)隊(duì)排名第一

結(jié)論

基于多語(yǔ)言預(yù)訓(xùn)練模型,我們構(gòu)建了一個(gè)多語(yǔ)言慣用語(yǔ)識(shí)別系統(tǒng)。通過(guò)對(duì)輸入格式、模型訓(xùn)練方式、預(yù)測(cè)結(jié)果后處理等方面的優(yōu)化,最終系統(tǒng)整體性能較baseline有較為顯著的提升,并在one-shot賽道上取得最優(yōu)成績(jī)。在后續(xù)研究中,可嘗試探索如何讓預(yù)訓(xùn)練模型利用訓(xùn)練數(shù)據(jù)之外的語(yǔ)料,如慣用語(yǔ)詞典等,以進(jìn)一步提升預(yù)測(cè)效果,并降低對(duì)標(biāo)注數(shù)據(jù)資源的需求,發(fā)揮多語(yǔ)言模型的zero-shot能力。

審核編輯 :李倩

-

編碼器

+關(guān)注

關(guān)注

45文章

3786瀏覽量

137601 -

數(shù)據(jù)

+關(guān)注

關(guān)注

8文章

7250瀏覽量

91521

原文標(biāo)題:競(jìng)賽 | SemEval 2022: 多語(yǔ)種慣用語(yǔ)識(shí)別評(píng)測(cè)冠軍系統(tǒng)簡(jiǎn)介

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語(yǔ)言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

回顧科大訊飛26周年慶精彩瞬間

普強(qiáng)信息入選2024語(yǔ)音識(shí)別技術(shù)公司TOP30榜單

聲智科技出席G20青年企業(yè)家聯(lián)盟走進(jìn)海淀活動(dòng)

九芯電子NRK330X系列:智能AI專用語(yǔ)音識(shí)別芯片

ASR與傳統(tǒng)語(yǔ)音識(shí)別的區(qū)別

訊維智能語(yǔ)音轉(zhuǎn)寫(xiě)系統(tǒng):開(kāi)啟智能會(huì)議記錄新篇章!

訊維智能語(yǔ)音轉(zhuǎn)寫(xiě)系統(tǒng)核心優(yōu)勢(shì)大解析!

冠軍說(shuō)|第二屆OpenHarmony競(jìng)賽訓(xùn)練營(yíng)冠軍團(tuán)隊(duì)專訪

ChatGPT 的多語(yǔ)言支持特點(diǎn)

HarmonyOS NEXT應(yīng)用元服務(wù)開(kāi)發(fā)多語(yǔ)種場(chǎng)景

HarmonyOS NEXT應(yīng)用元服務(wù)開(kāi)發(fā)多語(yǔ)種場(chǎng)景

智能自行車碼表:基于2605C語(yǔ)音芯片的創(chuàng)新開(kāi)發(fā)方案

思必馳AI多語(yǔ)種技術(shù)助力中國(guó)企業(yè)加快全球布局

訊維智能語(yǔ)音轉(zhuǎn)寫(xiě)系統(tǒng)確保企業(yè)數(shù)據(jù)的安全性

NVIDIA AI Foundry 為全球企業(yè)打造自定義 Llama 3.1 生成式 AI 模型

SemEval 2022: 多語(yǔ)種慣用語(yǔ)識(shí)別評(píng)測(cè)冠軍系統(tǒng)簡(jiǎn)介

SemEval 2022: 多語(yǔ)種慣用語(yǔ)識(shí)別評(píng)測(cè)冠軍系統(tǒng)簡(jiǎn)介

評(píng)論