谷歌、DeepMind:以 Transformer 為例,淺析歸納偏置對模型縮放的影響。

Transformer 模型的縮放近年來引發了眾多學者的研究興趣。然而,對于模型架構所施加的不同歸納偏置的縮放性質,人們了解得并不多。通常假設,在特定標度(計算、大小等)的改進可以遷移到不同的規模和計算區域。

不過,理解架構和標度律之間的相互作用至關重要,設計在不同標度上表現良好的模型具有重要的研究意義。有幾個問題還需要搞清楚:模型體系架構之間的縮放性不同嗎?如果是這樣,歸納偏置如何影響縮放表現?又如何影響上游(預訓練)和下游(遷移)任務?

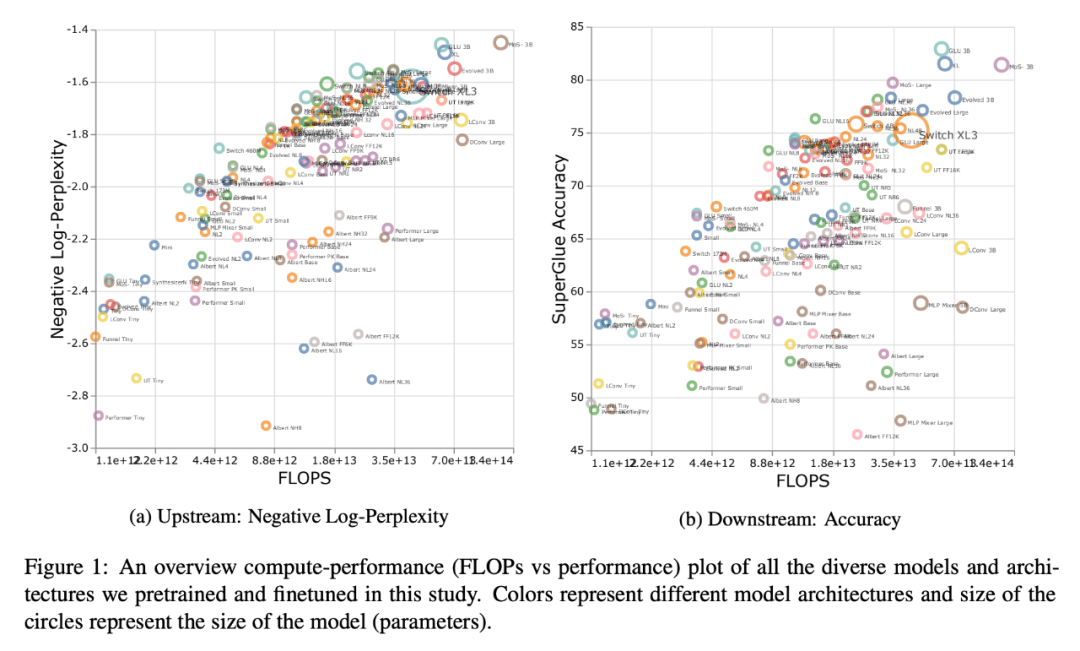

在最近的一篇論文中,谷歌的研究者試圖了解歸納偏置(體系架構)對語言模型標度律的影響。為此,研究者在多個計算區域和范圍內(從 1500 萬到 400 億參數)預訓練和微調了十種不同的模型架構。總體來說,他們預訓練和微調了 100 多種不同體系架構和大小的模型,并提出了在縮放這十種不同體系架構方面的見解和挑戰。

論文鏈接:https://arxiv.org/pdf/2207.10551.pdf

他們還注意到,縮放這些模型并不像看起來那么簡單,也就是說,縮放的復雜細節與本文中詳細研究的體系架構選擇交織在一起。例如,Universal Transformers (和 ALBERT) 的一個特性是參數共享。與標準的 Transformer 相比,這種體系架構的選擇不僅在性能方面,而且在計算指標如 FLOPs、速度和參數量方面顯著 warp 了縮放行為。相反,像 Switch Transformers 這樣的模型則截然不同,它的 FLOPs 和參數量之間的關系是不尋常的。

具體來說,本文的主要貢獻如下:

首次推導出不同歸納偏置和模型架構的標度律。研究者發現這個標度系數在不同的模型中有很大的不同,并指出這是模型開發中的一個重要考慮因素。事實證明,在他們考慮的所有十種體系架構中,普通的 Transformer 擁有最好的縮放性能,即使它在每個計算區域的絕對性能不是最好的。

研究者觀察到,在一個計算標度區域中運行良好的模型不一定是另一個計算標度區域中的最佳模型。此外,他們發現,某些模型盡管在低計算區域表現良好 ,但是難以進行縮放。這意味著很難通過在某個計算區域進行逐點對比來獲得模型縮放性的全貌。

研究者發現,當涉及到縮放不同的模型架構時,上游預訓練的困惑度可能與下游遷移不太相關。因此,底層架構和歸納偏置對于下游遷移也是至關重要的。

研究者強調了在某些架構下進行縮放的困難,并展示了一些模型沒有進行縮放(或以消極趨勢進行縮放)。他們還發現線性時間注意力模型(比如 Performer)難以進行擴展的趨勢。

方法與實驗

在論文的第三章,研究者概述了整體的實驗設置,并介紹了實驗中評估的模型。

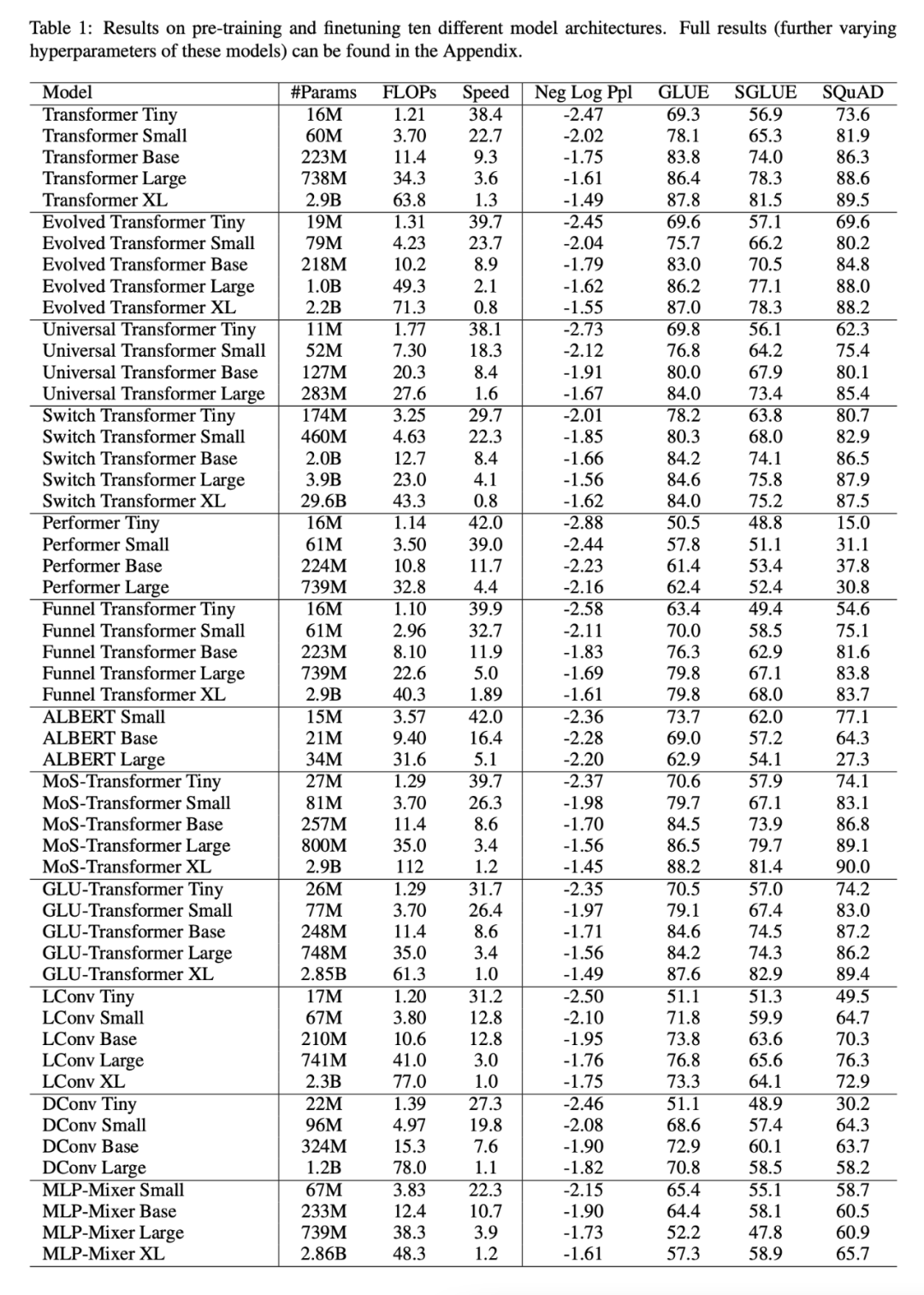

下表 1 展示了本文的主要結果,包括可訓練參數量、FLOPs(單次正向傳遞)和速度(每秒步數)等,此外還包括了驗證困惑度(上游預訓練)和 17 個下游任務的結果。

所有模型的縮放方式是否相同?

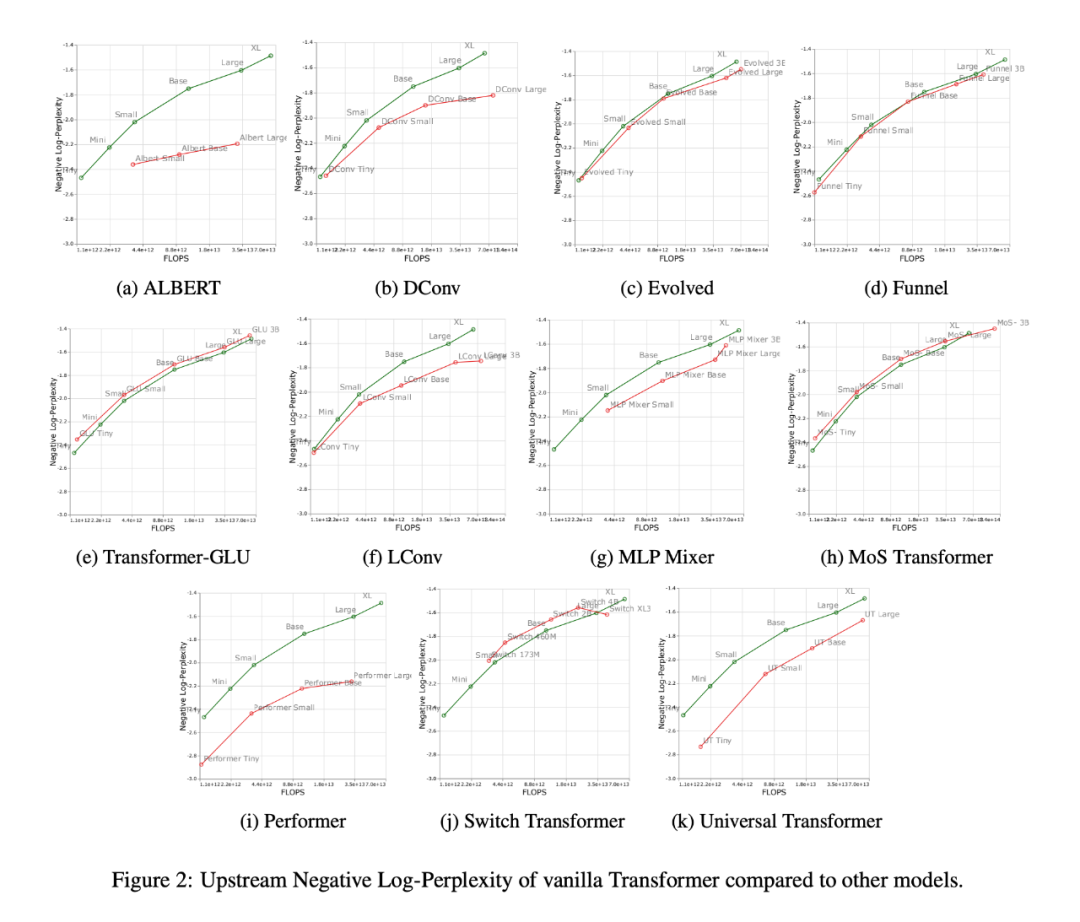

下圖 2 展示了增加 FLOPs 數量時所有模型的縮放行為。可以觀察到,所有模型的縮放行為是相當獨特和不同的,即其中大多數不同于標準 Transformer。也許這里最大的發現是,大多數模型(例如 LConv、Evolution)似乎都與標準 Transformer 表現相當或更好,但無法按照更高的計算預算去縮放。

另一個有趣的趨勢是,「線性」Transformer,如 Performer,不能按比例縮放。如圖 2i 所示,從 base 到 large scale 相比,預訓練的困惑度只下降了 2.7% 。而對于 vanilla Transformer 來說這一數字是 8.4%。

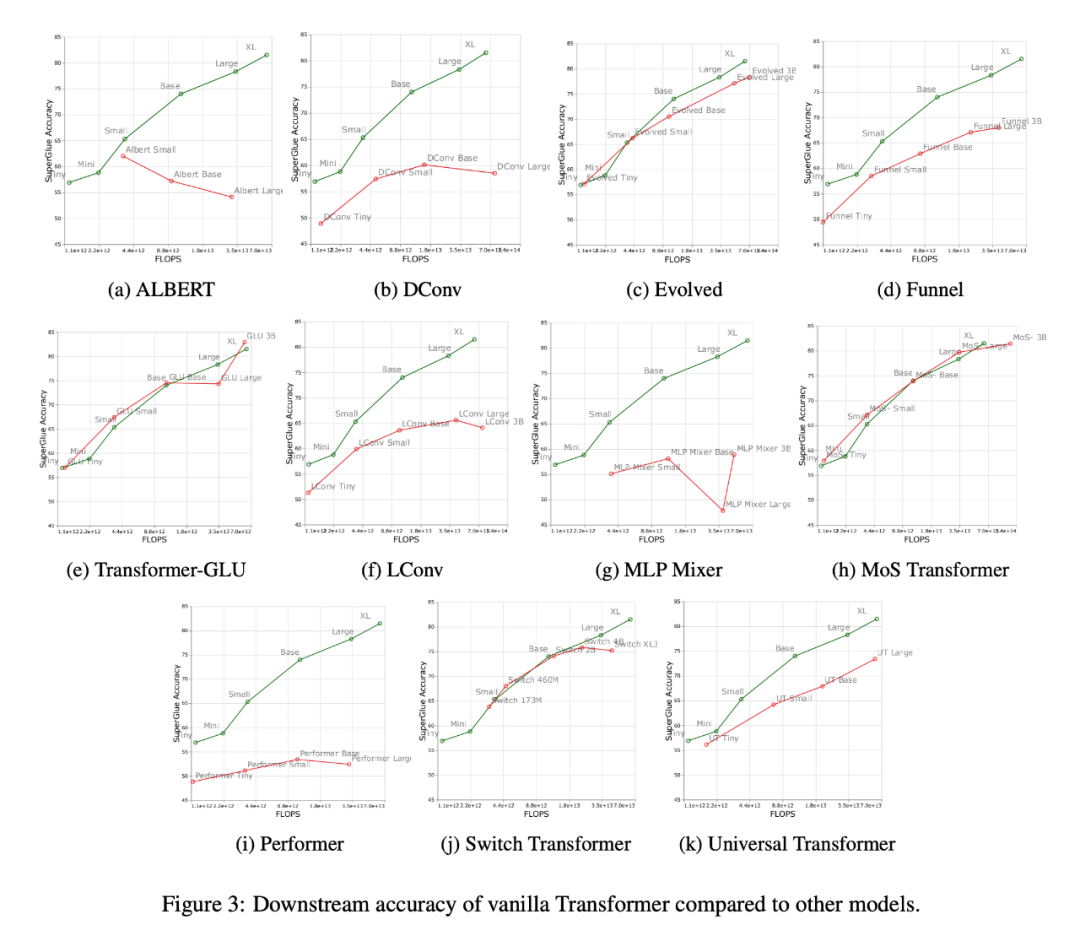

下圖 3 展示了下游遷移任務上所有模型的縮放曲線,可以發現,和 Transformer 相比,大多數模型有著不同的縮放曲線,在下游任務中變化明顯。值得注意的是,大多數模型都有不同的上游或下游縮放曲線。

研究者發現,一些模型如 Funnel Transformer 和 LConv,似乎在上游表現相當不錯,但在下游受到很大影響。至于 Performer,上游和下游的性能差距似乎更大。值得注意的是,SuperGLUE 的下游任務通常需要編碼器上的偽交叉注意力,而卷積這樣的模型是無法處理的(Tay et al., 2021a)。

因此,研究者發現盡管某些模型擁有良好的上游性能,但可能還是難以學習下游任務。

每一標度的最佳模型是否有所不同?

下圖 1 展示了根據上游或下游性能進行計算時的帕累托邊界。圖的顏色代表不同的模型,可以觀察到,每個標度和計算區域的最佳模型可能是不同的。此外,從上圖 3 中也可以看到這一點。例如,Evolved Transformer 似乎在微小(tiny)到小(small)的區域(下游)和標準 Transformer 一樣表現很好,但是當放大模型時,這種情況迅速改變。研究者在 MoS-Transformer 也觀察到了這一點,它在某些區域的表現明顯優于普通的 Transformer ,但在其他區域則不然。

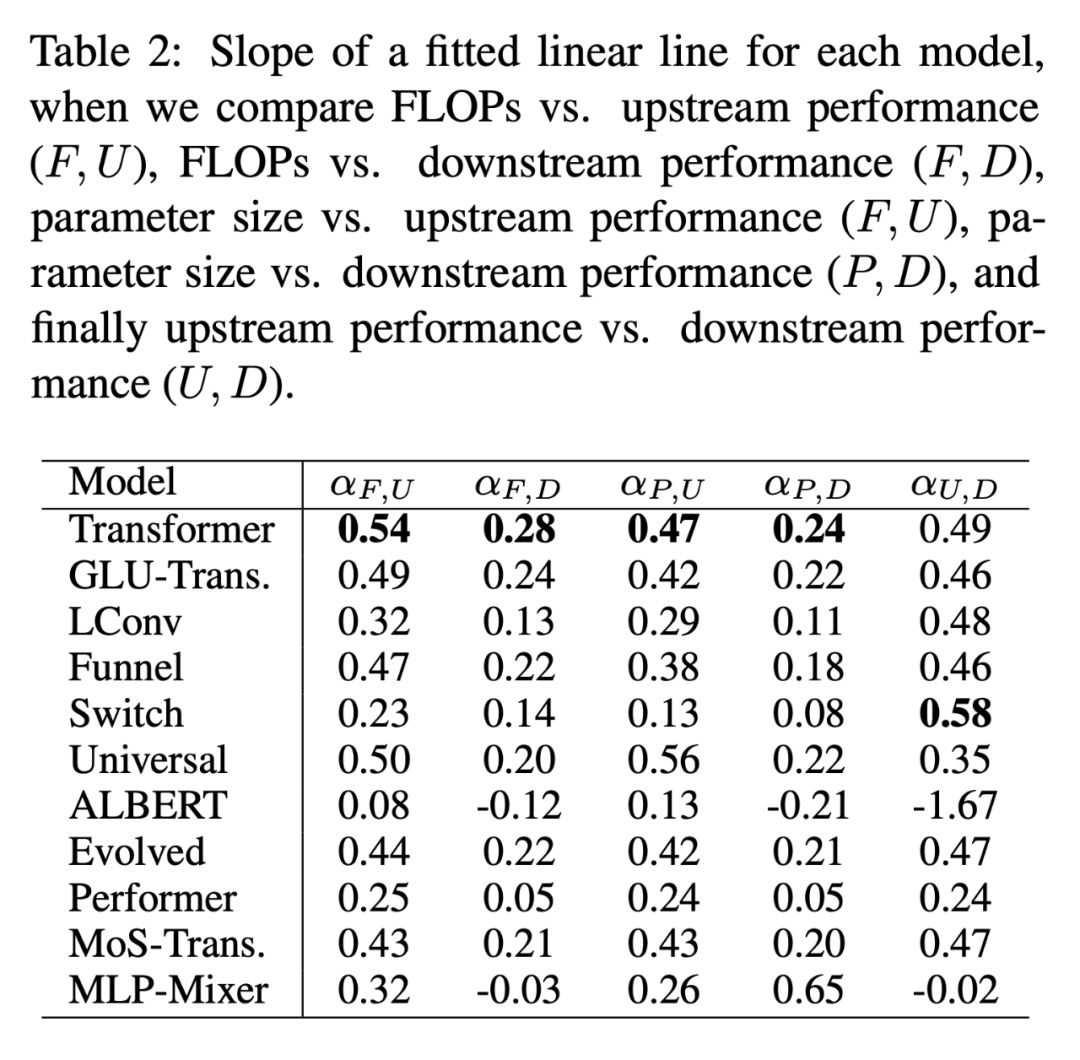

每個模型的標度律

下表 2 給出了多種情況下每個模型的擬合線性直線 α 的斜率。研究者通過繪制 F(FLOPs)、U (上游困惑度)、D (下游準確率)和 P(參數量)得到了α。一般來說,α 描述了模型的縮放性,例如 α_F,U 根據上游性能繪制 FLOPs。唯一的例外是α_U,D,它是衡量上游和下游性能的度量,高的 α_U,D 值意味著向下游任務遷移的模型縮放更佳。總體來說,α 值是一個度量,表示一個模型在縮放上的相對表現。

Scaling Protocols 是否以同樣的方式影響模型體系架構?

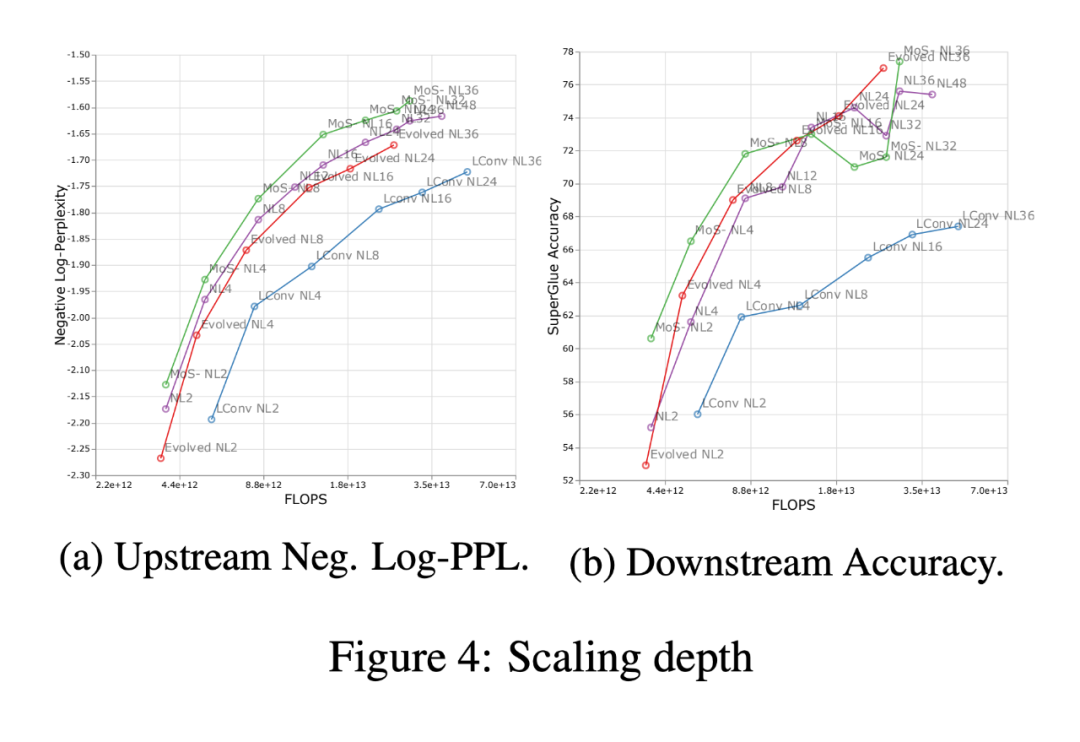

下圖 4 展示了四個模型體系架構(MoS-Transformer、Transformer、Evolved Transformer、LConv)中縮放深度的影響。

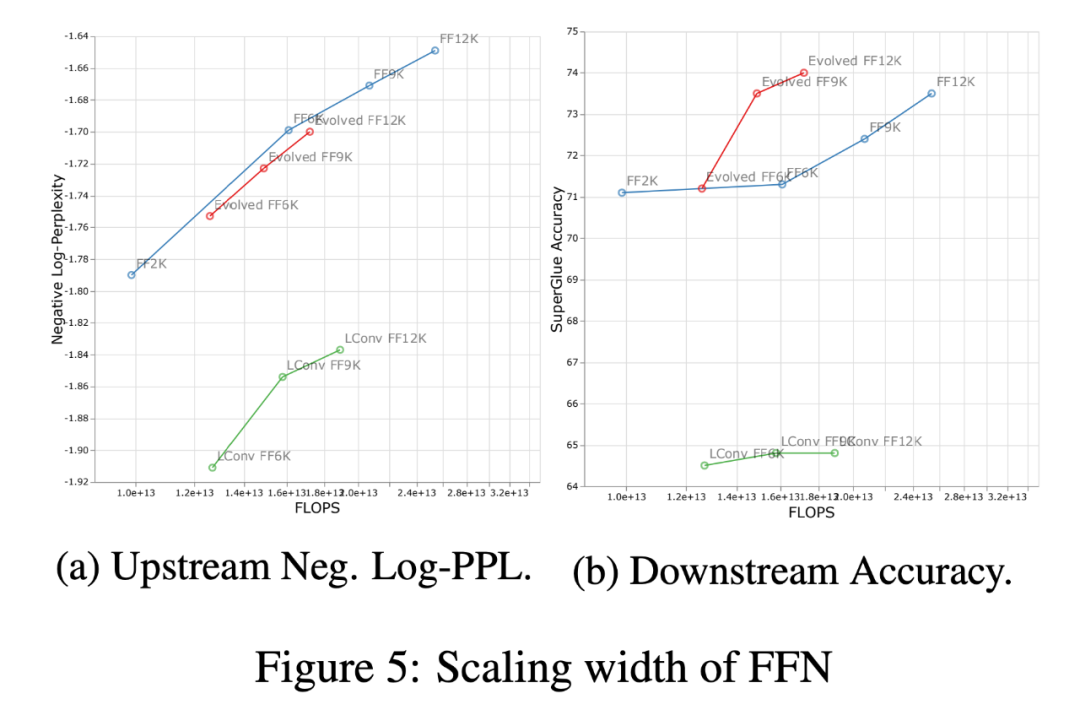

下圖 5 展示了在相同的四個體系架構中縮放寬度的影響。首先,在上游(負對數困惑)曲線上可以注意到,雖然不同的架構在絕對性能上有明顯的差異,但縮放趨勢仍然非常相似。在下游,除了 LConv 之外,深度縮放(上圖 4)在大多數體系架構上的作用似乎是一樣的。同時,相對于寬度縮放,似乎 Evolved Transformer 在應用寬度縮放時會稍微好一點。值得注意的是,與寬度縮放相比,深度縮放對下游縮放的影響要大得多。

審核編輯 :李倩

-

谷歌

+關注

關注

27文章

6228瀏覽量

107755 -

模型

+關注

關注

1文章

3500瀏覽量

50144 -

Transformer

+關注

關注

0文章

151瀏覽量

6431

原文標題:谷歌、DeepMind新研究:歸納偏置如何影響模型縮放?

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯網技術研究所】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

一種基于正交與縮放變換的大模型量化方法

淺析歸納偏置對模型縮放的影響

淺析歸納偏置對模型縮放的影響

評論