在多傳感器信息融合技術中,相機和3D激光雷達在其特性高度互補的前提下得到了快速發展和廣泛應用。在許多基于相機和3D激光雷達的應用中,相機內參以及相機和3D激光雷達外參的聯合標定是后期檢測、跟蹤和SLAM技術的重要基礎。隨著算法的更新和迭代,標定的準確性、速度和范圍都有所提高,但仍缺乏對相機和3D激光雷達標定的系統和全面的調查。本文首先介紹了兩種傳感器的性能比較和應用現狀;其次,介紹了標定過程、標定目標的選擇和標定模型的建立;然后根據分類,介紹了攝像機內部參數標定和聯合外部參數標定的原理和算法;最后,總結并給出了相機和3D激光雷達標定的未來發展!

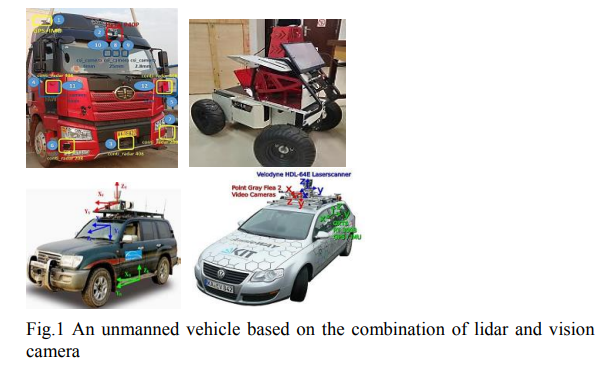

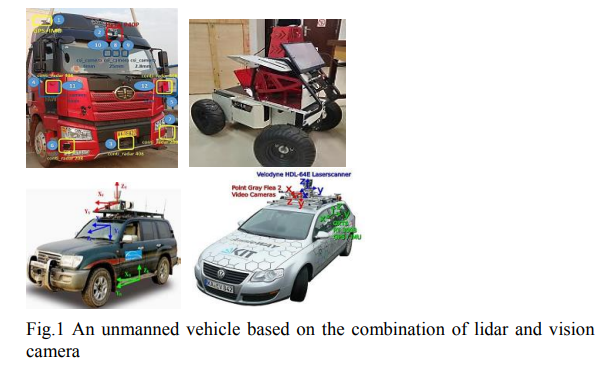

以無人車和機器人為代表的地面無人平臺由于其自主性、靈活性和體積小,在偵察、安全檢查和防爆任務中具有廣闊的應用前景。近年來,出現了許多關于無人平臺環境感知和場景理解的研究,在眾多關鍵技術中,獲取目標姿態信息是無人平臺實現目標感知和環境場景理解的關鍵前提,如圖1所示。

在多傳感器信息融合技術中,相機和3D激光雷達在其特性高度互補的前提下得到了快速發展和廣泛應用。在許多基于相機和3D激光雷達的應用中,相機內參以及相機和3D激光雷達外參的聯合標定是后期檢測、跟蹤和SLAM技術的重要基礎。隨著算法的更新和迭代,標定的準確性、速度和范圍都有所提高,但仍缺乏對相機和3D激光雷達標定的系統和全面的調查。本文首先介紹了兩種傳感器的性能比較和應用現狀;其次,介紹了標定過程、標定目標的選擇和標定模型的建立;然后根據分類,介紹了攝像機內部參數標定和聯合外部參數標定的原理和算法;最后,總結并給出了相機和3D激光雷達標定的未來發展!

以無人車和機器人為代表的地面無人平臺由于其自主性、靈活性和體積小,在偵察、安全檢查和防爆任務中具有廣闊的應用前景。近年來,出現了許多關于無人平臺環境感知和場景理解的研究,在眾多關鍵技術中,獲取目標姿態信息是無人平臺實現目標感知和環境場景理解的關鍵前提,如圖1所示。

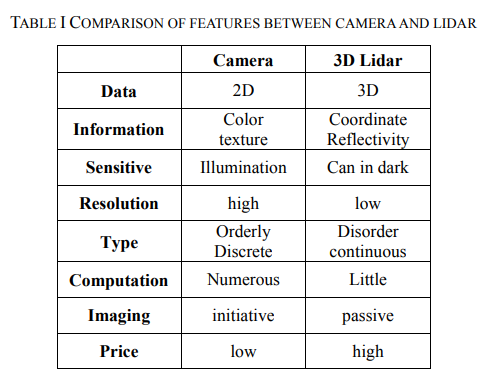

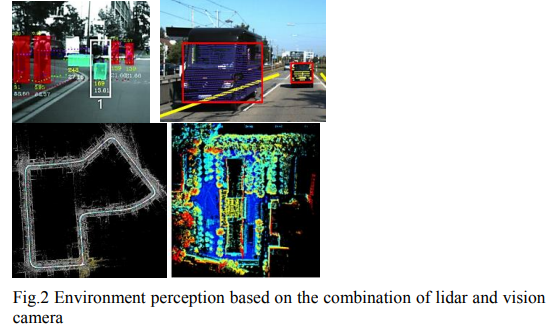

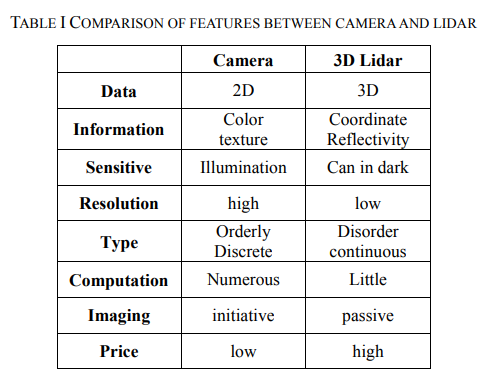

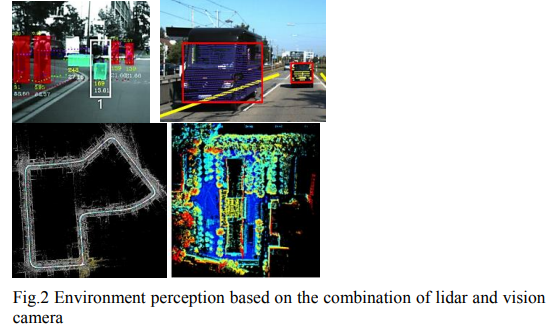

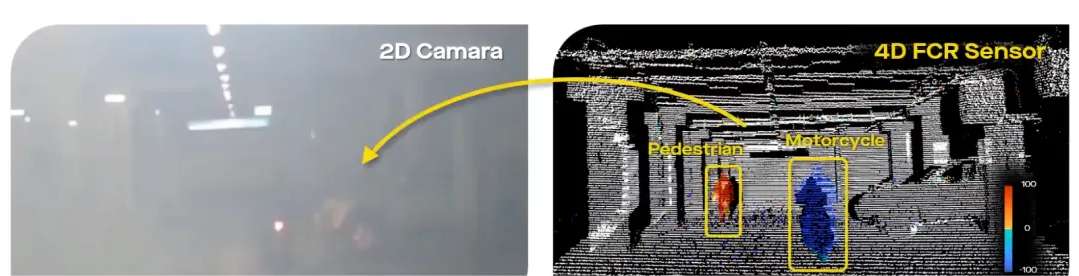

現階段,大多數無人平臺采用“激光雷達+視覺攝像頭”解決方案,以實現完整的環境感知。其中,激光雷達在目標表面獲得高精度、離散的三維點云數據,受環境影響較小,具有良好的魯棒性;視覺攝像機可以獲得高分辨率、高質量的二維視覺信息,在環境感知和目標檢測方面具有很大的優勢。由于相機和激光雷達的信息具有高度互補性,融合兩者不僅可以克服單一傳感器在環境感知方面的缺點,還可以獲得更豐富的目標觀測數據,提高其環境感知的準確性,如圖2和表I所示。

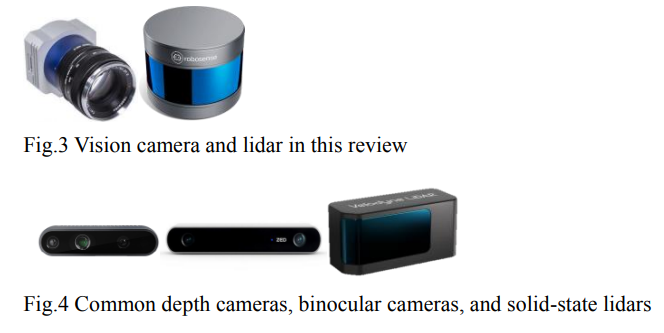

由于激光雷達數據點稀疏,視覺相機分辨率高,激光雷達和視覺相機的聯合校準是實現兩者融合的基礎環節。為了響應激光雷達和視覺相機的聯合校準,已經提出了各種標定方法。然而,這些方法大多是根據實際需要進行的,因此沒有系統的解決方案,并且缺乏開源校準數據集,各種方法也不統一,很難為研究人員提供明確的參考。在此基礎上,本文總結了近年來激光雷達與單相機聯合標定的先進標定方法。本文將重點討論聯合標定系統構建、標定板設計、標定參數求解等基本問題,如圖3和圖4所示。

標定系統的構建

一個典型的標定系統可以分為以下步驟:首先根據要求選擇激光雷達、視覺相機和標定板,然后根據一定的方法建立標定目標在不同坐標系中的轉換關系,最后求解轉換矩陣。其中,標定板的選擇、坐標系轉換關系的建立、標定方程的求解是關鍵環節。

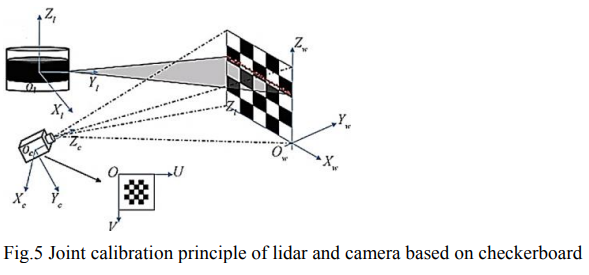

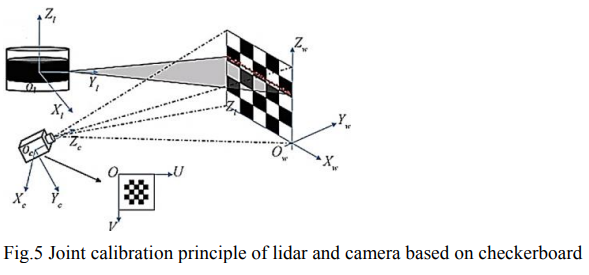

圖5顯示了基于標定板的激光雷達和相機聯合標定所涉及的四個主要坐標系!像素坐標系(u,v),相機坐標系,圖像平面坐標系(x,y),激光雷達坐標系。

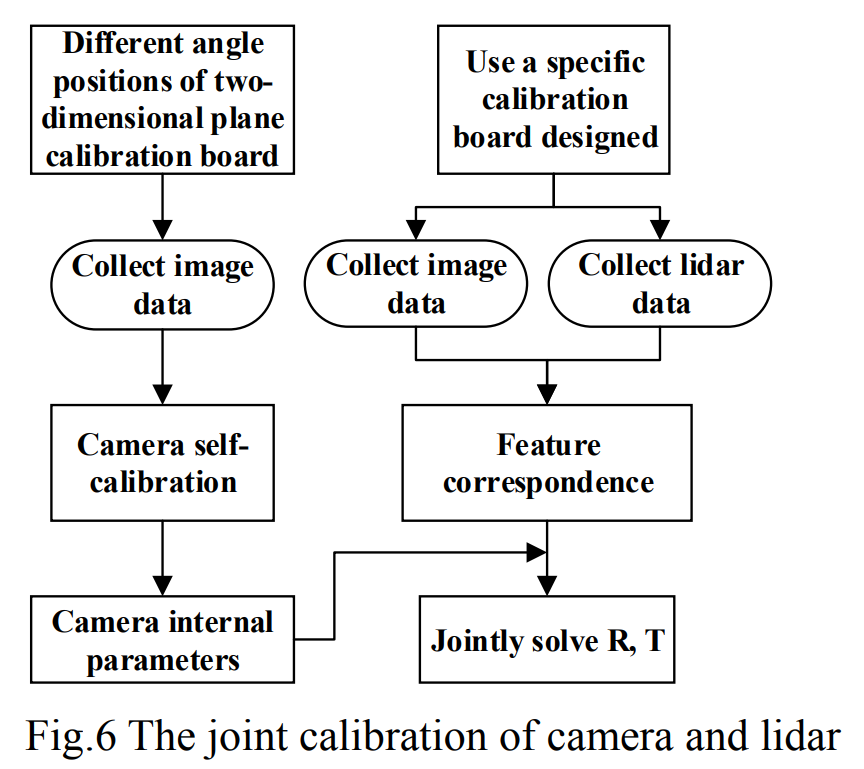

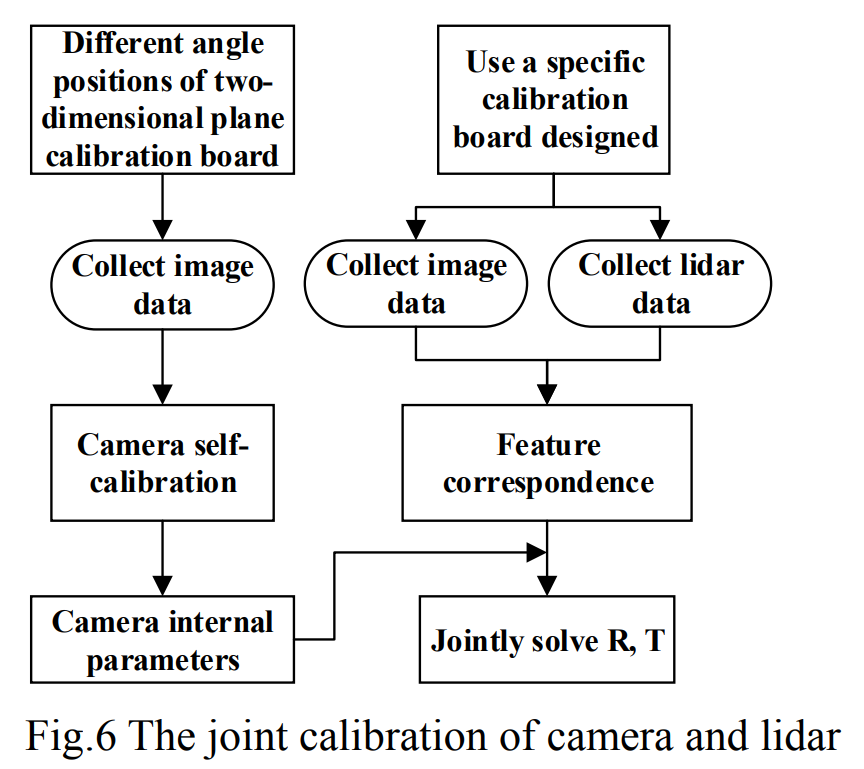

相機和激光雷達的聯合標定通常包括兩部分:內部參數標定和外部參數標定。內部參數標定主要解決攝像機CCD傳感器本身畸變和安裝的影響;外部參數標定主要用于建立兩個傳感器之間的坐標轉換方程。如圖6所示,這是相機和激光雷達聯合校準的流程圖!

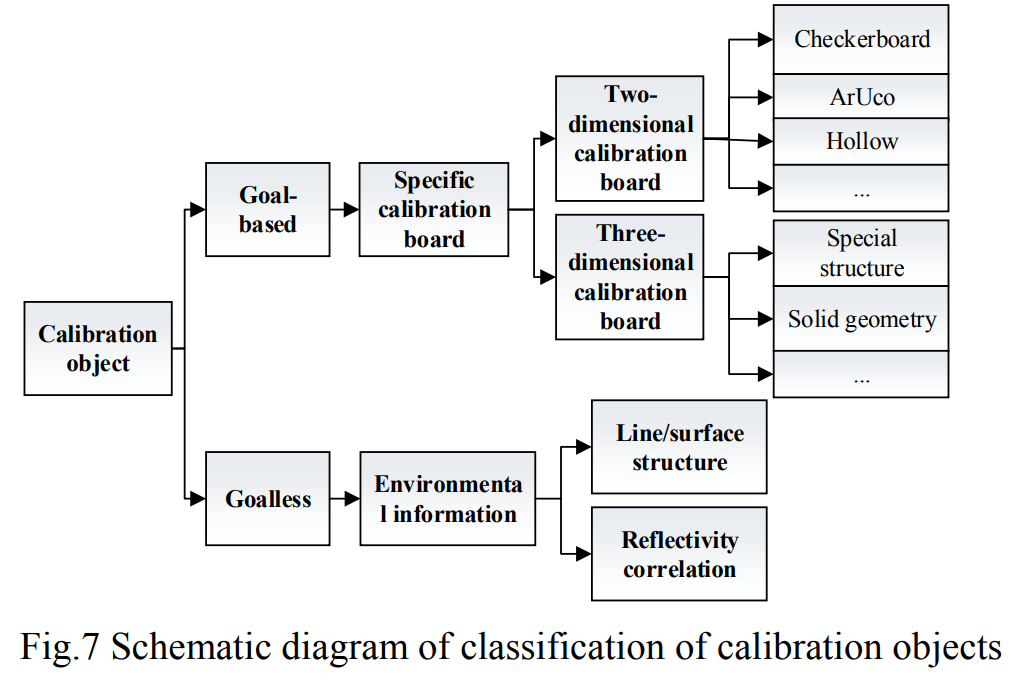

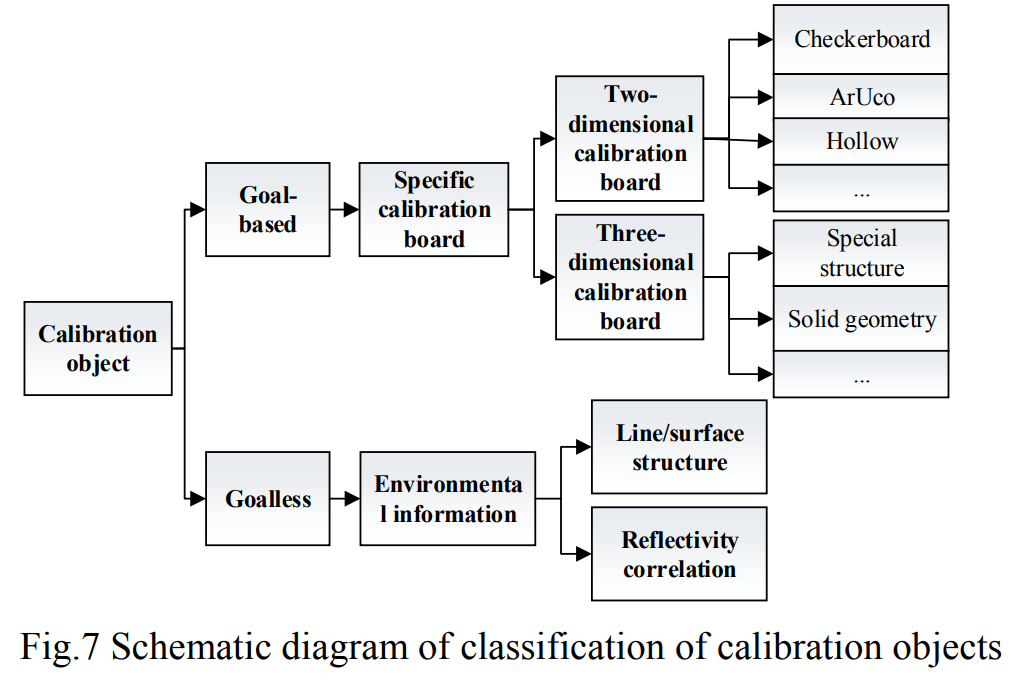

標定板的選擇根據標定對象和提取的特征點而不同,標定可以通過兩種方式進行:基于目標的標定或無目標標定。基于目標的標定通常使用特定的標定板以便于算法提取特定的特征點,而無目標標定方法通常直接使用環境中的材料或結構特征來提取和匹配以實現標定,以增加標定的范圍和便利,如圖7所示。

1)Target-based Calibration

基于目標標定的特點是在標定過程中使用特定形式的標定板。這樣,特征點易于捕獲,所需算法簡單,計算能力小。但缺點也很明顯:一是必須在使用傳感器之前對其進行標定,而且不能進行實時標定。另一個是二維平面板(如棋盤)需要獲得清晰的對應關系,這不僅使得最終的標定精度嚴重依賴于3D和2D特征點,還需要人工干預!

二維標定板

二維標定板通常取決于特定的標定目標,最常用的是棋盤。張[1]首先提出了一種棋盤標定板,通過具有多個姿態的棋盤來估計二維激光雷達和相機之間的參數。Ranjith Unnikrishnan等人[2]基于Zhang提出的相機和2D激光雷達的標定方法,提出了3D激光雷達和相機外部參數的標定方法,如圖8所示。

然而,由于激光雷達的縱向光束之間的距離大且采集分辨率低,很難通過邊緣提取來保證精確頂點的精度。Lyu[3]手動調整棋盤在激光點云中的位置,以便掃描線可以掃描到棋盤的頂點,但這將增加標定過程的時間和復雜性。

同樣為了解決點云邊緣擬合不準確的問題,康國華等人[4]使用點云中心的粗配準來實現點云的整體精細配準。從另一個角度來看,除了輸出三維點云的坐標信息,激光雷達還可以帶回反射強度信息。[5] 對不同材料的激光雷達反射強度設置閾值,以獲得激光雷達點云,并在此基礎上設計了一種新的標定板。

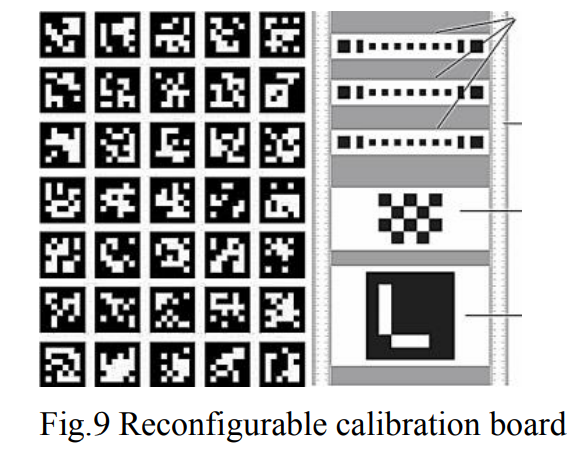

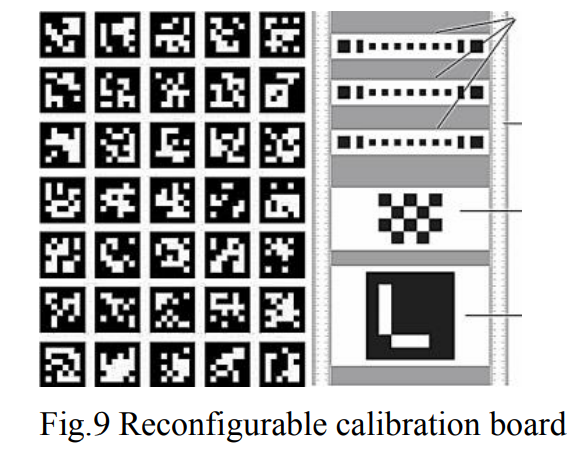

ArUco標記是一種特殊的編碼模式,便于檢測和糾正標簽本身的錯誤。霍爾等人提出了一種用于由多個單元組成的實驗裝置的校準板。方法[6]使用ArUco標記計算相機坐標系中標定板的角點,激光雷達點提取擬合的邊緣線,然后可以計算激光雷達相機的外部參數。在實際應用中,這種方法與棋盤中的激光雷達一樣,包括不穩定的邊緣提取和線擬合算法,這將給校準帶來很大的誤差。此外,由于需要多個標定板,該方法更加復雜。為了增加激光雷達點云的可提取特征,出現了一個空心標定板。Dong等人[7]和Zhung等人[8]的工作有些相似,他們在黑白棋盤的中心構造了一個空心圓孔,并將圓孔的中心校準為特征點。然而,由于激光雷達點云沒有明顯的特征,因此只能從整個圓孔點云近似計算中心的坐標,如圖9所示。

最近,黃強等人[9]提出了一種基于可重構標定板的激光雷達和視覺傳感器的聯合標定方法,使用類似條形碼的方法來自動識別激光雷達的特征點,并添加了相機驗證機制,以減輕標定過程中相機識別不穩定導致的錯誤。

三維標定板

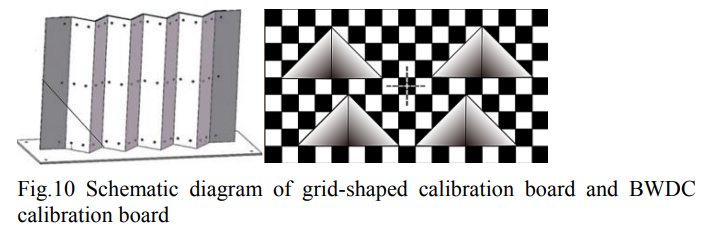

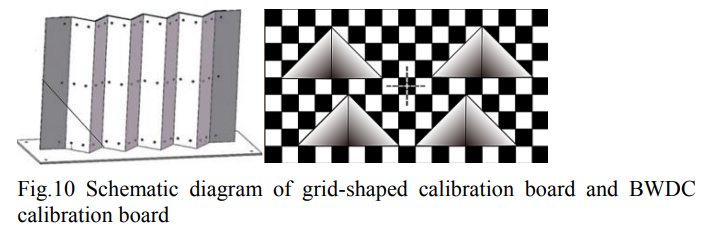

三維標定板的目的是更好地幫助激光雷達找到特征點,從而更好地匹配特征點。當背景不純凈時,上一節中提到的中空平板可能會導致像素混合,周世輝等人[10]分析了平面空心標定板產生的混合像素誤差,設計了一種特殊的網格狀標定板,并基于特征點匹配方法實現了工業相機和激光雷達的高精度聯合校準,以實現像素級圖像融合效果。蔡懷宇等人[11] 設計了具有梯度深度信息、平面角度信息和位置信息的標定板(BWDC)。該方法不僅從一維提取特征,而且有效地利用了激光雷達提取三維信息的能力。然而,這對標定板的設計和制造精度提出了很高的要求,增加了成本和誤差。如圖10所示。

Pusztai等人[12]使用具有三個垂直邊的長方體作為標定對象,通過提取長方體的邊緣來估計長方體的3D頂點,并將其與從圖像中提取的2D頂點進行匹配,這種方法是通用的,因為它可以用于普通的盒子。類似地,Xiaojin Gong等人[13]提出了基于任意三面體的3D激光雷達相機的外部標定。由于用于標定的三面體目標可以是正交或非正交的,這通常出現在結構化環境中,因此它具有廣泛的應用。

2)Targetless Calibration

無目標標定不需要人工標定目標,在線標定更方便,但精度低,魯棒性差。例如,當遇到需要在線標定的情況時,固定傳感器的相對位置會因機械振動而改變,其標定參數也會隨著時間而變得不準確。由于大多數融合方法對標定誤差極為敏感,其性能和可靠性受到嚴重損害。此外,大多數標定過程需要從頭開始,因此手動連續更新校準參數既麻煩又不切實際,為了擺脫標定板的限制,并通過自然場景實現在線標定,研究人員進行了大量研究!

其中一些方法使用RGB紋理和激光雷達反射率之間的相關性,一些方法提取圖像和激光點云中的邊緣[17]或線特征[18]進行相關性測量。Castorena等人[19]使用深度和強度邊緣的自然對齊結合高斯混合模型進行標定,并獲得了一種自動、無目標、完全數據驅動的全局匹配優化方法。這些方法需要相對精確的初始參數,否則很容易陷入局部極值,因此,用于自識別場景的無目標標定方法通常用于微調外部參數。還有一些基于里程計的軌跡配準[20],時間序列視覺幀的密集點云和激光點云的配準[21],甚至還有基于深度學習的方法[22]、[23]。這些方法不僅高度依賴于環境,還受到視覺或激光里程計精度的影響,目前的技術精度低,不具有普遍性,需要進一步研究和開發。

3)標定方程建立

在相機傳感器獲取過程中,為了確定空間物體表面上的點的三維幾何位置與其在圖像中的對應點之間的關系,必須建立相機成像的幾何模型。

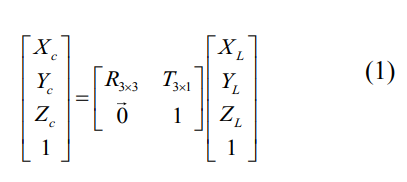

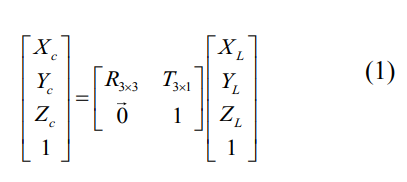

(1) 三維坐標轉換:攝像機坐標系到激光雷達坐標系的轉換,公式如下:

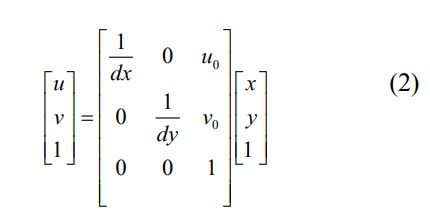

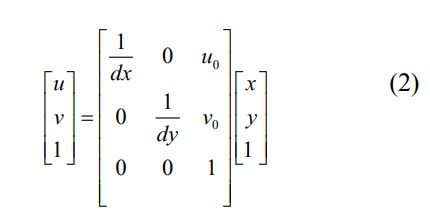

(2) 二維坐標轉換:從像素坐標系到圖像坐標系的轉換,公式如下:

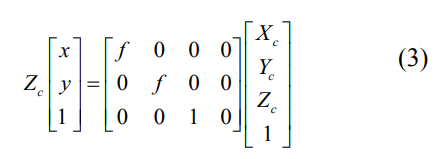

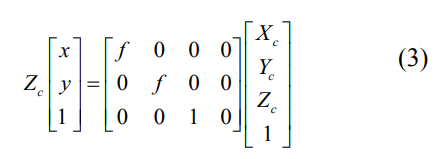

(3) 基于針孔成像原理的坐標轉換:攝像機坐標系到圖像坐標系的轉換,公式如下:

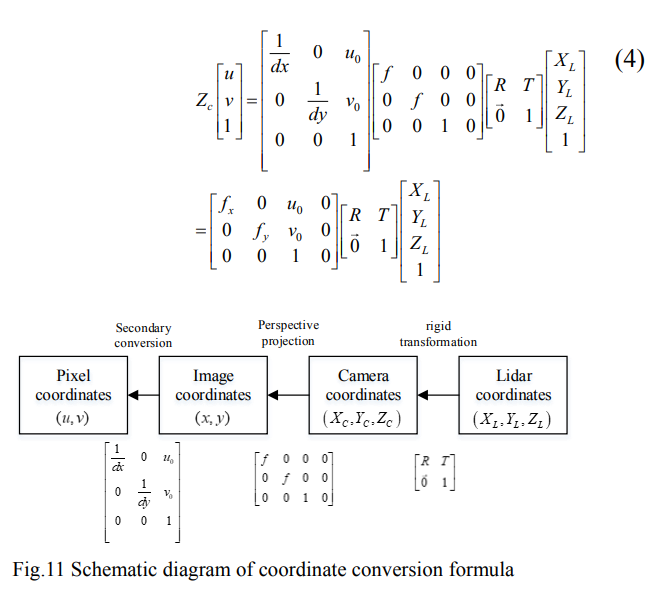

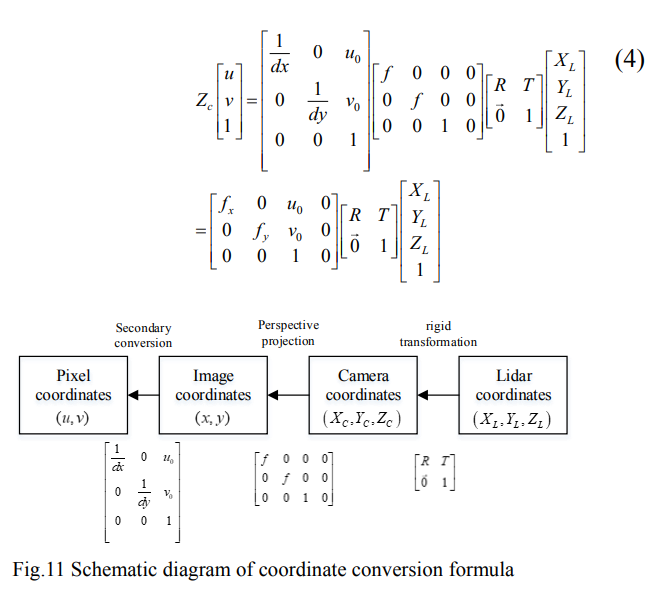

(4) 合并轉換:激光雷達坐標系到像素坐標系的轉換如圖11所示進行組合和推導,公式如下:

參數求解1)相機內參

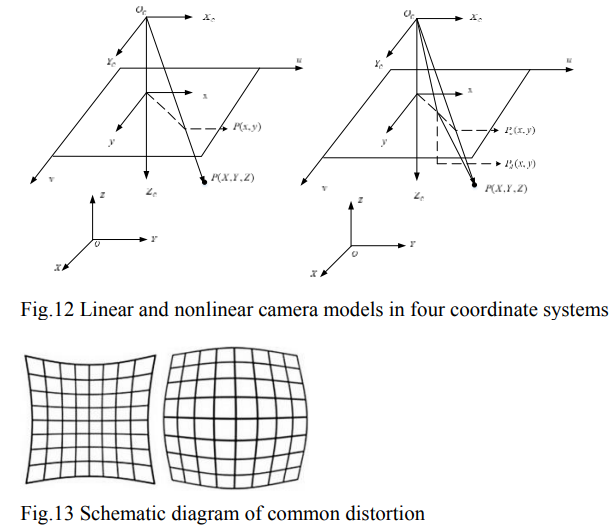

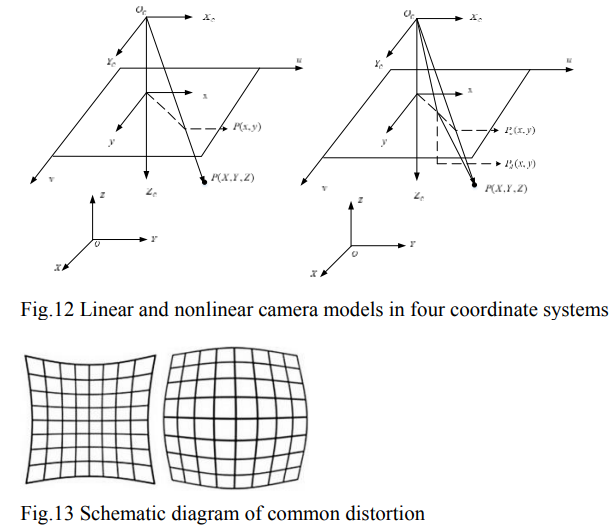

為了簡化計算,假設了一個線性理想針孔相機,如圖12中的a所示。但實際由于相機鏡頭精度和裝配過程的偏差,相機成像不可避免地引入了失真。真實圖片和兩個常見相機圖片的失真如圖13所示,導致圖像失真,如圖12中的b所示。

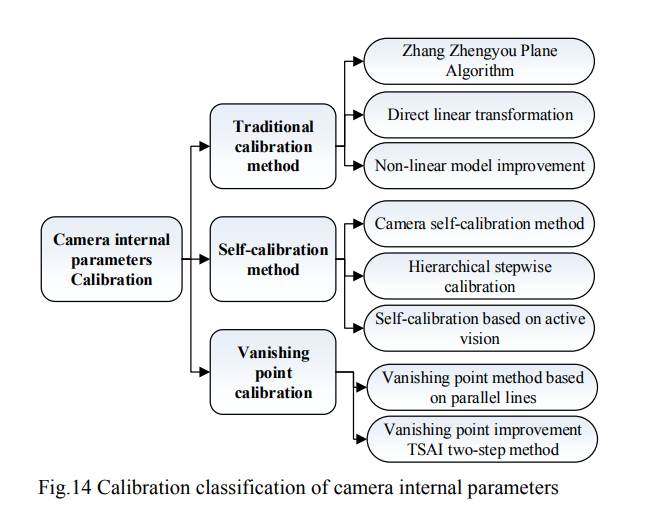

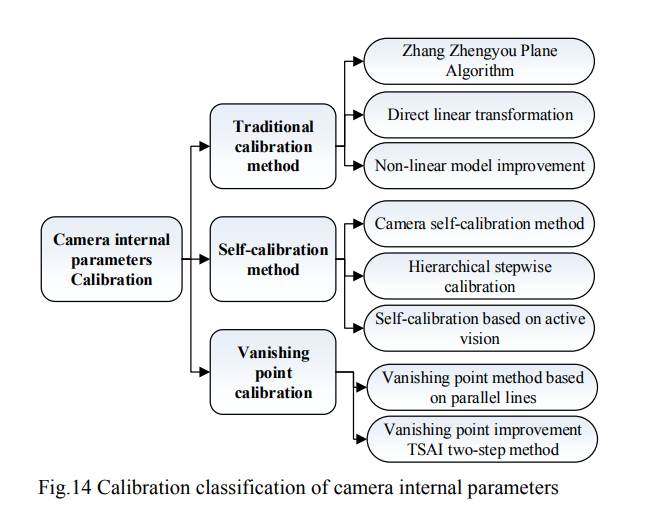

內部參數是視覺測量的重要校準參數之一,它反映了計算機圖像坐標中空間點與成像點之間的精確對應關系,如圖14所示。

傳統的攝像機校準方法。傳統的相機標定方法使用具有已知結構和高精度的標定目標或三維標定場作為空間參考對象。在建立世界坐標系之后,獲得每個特征點的空間坐標,根據空間點和圖像點之間的對應關系,建立了相機內部參數的約束條件。最后,通過優化算法獲得內部參數,在相機內部參數的計算中,使用最廣泛的方法是張正友方法[24]。受張正友方法的啟發,許多開源庫函數,如OpenCV、ROS、matlab和一些工具箱[25][26]都使用這種方法進行開發和標定!相機自標定方法。相機自標定方法是指使用包含由相機捕獲的重疊場景的一組圖像來建立對應關系的過程,在不依賴于標定參考對象的情況下完成幾何校準。由于只使用其自身的約束,因此它與攝影機和周圍環境之間的相對運動狀態無關,它具有更高的靈活性,適用于因條件惡劣而無法使用校準目標的情況。使用絕對二次曲線和極線變換的特性來求解Kruppa方程的相機自校準方法[27]、[28]、[29]。這種直接求解Kruppa方程的方法在求解過程中優化參數過多,容易陷入局部最優。當圖像噪聲較大時,校準精度會降低,魯棒性會變差,用分層逐步標定方法代替。它使用投影校準作為基礎,選擇某一圖片作為標準,并執行投影對準,從而減少未知數。然后使用非線性優化算法來解決所有未知問題[30]。另一個分支是基于主動視覺的相機自標定技術,主動視覺系統是指將攝像機精確安裝在可控平臺上。主動控制相機按照指定的運動軌跡完成照片拍攝,最后使用相機運動參數確定內部參數[31]、[32],它的缺點是對實驗設備的要求更高,對模型參數的限制更大,并且抗噪聲能力較差。基于消失點標定的方法。20世紀90年代以來,國內外大量學者開始研究基于消失點標定的方法。幾何上,世界直線的消失點是通過平行于直線并穿過相機中心和圖像平面的光線的交點獲得的,因此,消失點僅取決于直線的方向,與其特定位置無關[33]、[34]、[35]。消失點標定方法不需要對象控制點,而是使用相機自身參數之間的約束關系來建立模型。這大大提高了標定的靈活性,實現了實時在線標定,并具有廣泛的應用。其缺點是魯棒性差和精度低,因為在大多數基于消失點標定的方法中,相機中的方位角元素是通過單個圖像的消失點來校準的,而傳統的消失點標定算法需要三組場景中相互正交的平行線。然而,由于噪聲等因素的影響,它在實際應用中常常受到限制。相機的內部參數和失真參數是相機的固有參數,出廠后通常是固定的。因此,許多制造商現在直接提供相機的內部出廠時的參數。同時,隨著相機設計的內部優化,其失真控制越來越好。這也是內部參數標定算法研究和更新緩慢的原因!

2)外參求解

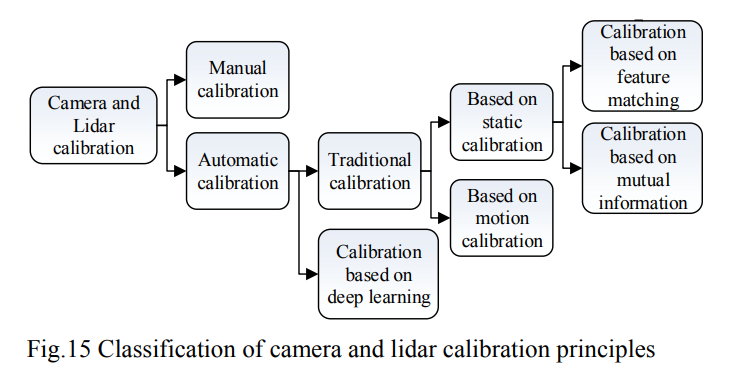

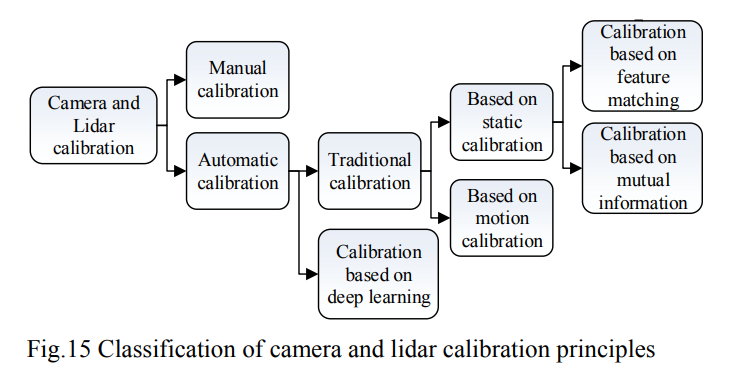

從數據選擇方法來看,可分為手動標定解決方案和自動標定解決方案。手動標定是早期開發和使用的第一種標定方法,它以其簡單有效的操作和高精度而深受標定人員的喜愛。然而,隨著科學技術的發展,圖像和點云中的數據量巨大,導致勞動力成本急劇增加。單一的手動標定已不能滿足人們對速度、自動化和魯棒性的需求,自動標定已應運而生,如圖15所示,激光雷達中相機的外部參數根據不同的原理進行標定!

手動外部參數標定

對于相機激光雷達外部參數標定,校準對象可以提供準確的幾何尺寸信息,手動操作可以提供準確匹配信息。最常用的方法是使用棋盤來確定一系列用于校準的3D點對。例如,Dhall[36]等人手動選擇3D點并使用最小二乘法解決問題,Scaramuzza[37]等人提出了一種快速標定方法,該方法不依賴于標定對象,而是基于點特征。作者從相機圖像和激光雷達點云中手動選擇一系列具有不連續深度的對應點來解決問題。手動camera-激光雷達有多種標定方法。不同的方法在不同的具體應用場景中達到了高精度,對于需要實時在線標定的系統,手動標定的主要問題是過度依賴人工操作,以及特殊的標定對象,這嚴重降低了自主性和智能性。

自動外部參數標定

隨著智能應用的迫切需求,近十年來誕生了大量相機激光雷達外部參數的自動標定方法。這些方法分為基于特征匹配的方法、基于互信息的方法,基于運動的方法和基于深度學習的方法。

a) 基于特征匹配的標定方法

基于特征匹配的方法通過選擇特征點并基于標定板獲得上述兩個系統中特征點的坐標,根據特征匹配,直接獲得激光雷達坐標系與相機像素坐標系之間的轉換關系,然后通過求解標定矩陣轉換方程或使用監督學習等方法來計算轉換矩陣以及內部和外部參數,目前基于激光雷達點云邊緣提取的特征匹配方法主要分為間接法和直接法兩種。

間接法:大多數方法將激光雷達點轉換為圖像,然后執行邊緣提取。Wang等人[39]使用Canny算法提取圖像的邊緣,并使用邊界檢測器從3D激光雷達點云生成距離圖像,建立點云數據和距離圖像之間的對應關系。通過像素對應合并2D圖像和3D點云數據,以獲得具有3D信息的邊緣圖像。通常,相機的分辨率和點云是不同的,這種方法可能會引入一些錯誤。

直接法:在圖像中,灰度值突然變化的地方形成了圖像的邊緣,這種變化稱為圖像梯度。基于圖像邊緣的特征,Xia等人[40]提出了3D點云梯度的概念,然后基于用于快速邊緣提取的激光雷達點云。該擬合方法可以提取更多的邊緣特征,具有較高的精度,并且對點的密度不敏感。

b) 基于互信息的標定方法

基于互信息的方法的主要思想是在相機圖像和激光雷達點云中找到相關變量。通過計算相機圖像的灰度值與相關變量(例如激光雷達的反射率或激光雷達反射的角度)之間的相互信息,然后最大化互信息以優化校準外部參數。Pandney等人[41]認為,激光雷達點云的反射率與相機圖像的灰度值之間存在很強的相關性,通過核密度估計方法計算反射率和灰度值的概率。最后,通過Barzilai-Borwein最速下降法計算互信息并優化外部參數。Taylor等人[42]認為,與相機圖像點對應的3D點的法線與相機之間的角度將影響反射強度,通過計算激光雷達點云的反射率和對應于相機圖像點的上述角度之間的相互信息來執行校準。可以看出,當兩個傳感器執行緊密的數據融合時,兩個傳感器之間的精確外部參數尤為重要。由于激光雷達點云的稀疏性,無法直接提取散射在校準板角落的激光雷達點,這將帶來更大的誤差,也將導致精確的拐角計算。因此,基于直接提取的反射強度特征點的激光雷達相機外部標定方法可以有效地補償這一問題。然而,基于互信息的方法的效果與傳感器所在環境中目標物體的材料和反射率有關,并且容易受到諸如光照條件和天氣變化等因素的干擾。

c) 基于運動的標定方法

基于運動的方法通常從連續運動數據或多視圖數據中求解外部參數。首先,分別計算相機和激光雷達的運動,然后通過手眼標定來解決相機和激光雷達的直接外部參數。Taylor[43]等人提出了一套標定方法,可應用于由激光雷達、相機和導航傳感器組成的任何系統。作者首先登記每個傳感器的連續幀,然后使用連接以校準外部參數。Ishikawa[44]等人使用KLT跟蹤器跟蹤激光雷達在圖像平面上的投影點,并通過投影誤差不斷優化缺少3D比例的平移向量,取得了比泰勒更準確的結果。趙[45]使用相機的前后幀圖像重建城市場景3D并計算姿態變化,并計算激光雷達點云的前后幀ICP,以獲得點云的空間變化。同時,有許多研究通過關鍵幀和運動恢復結構等技術實現了無人機和激光雷達點云上的圖像配準。例如,Nedevschi等人[46]使用特征匹配來檢測車輛行駛過程中傳感器的偏移。該方法通過對圖像執行距離變換來找到圖像中的邊緣,同時,將激光雷達點云轉換為距離圖像。根據邊緣信息建立目標函數。該方法可以消除車輛運動過程中產生的漂移,并自動調整外部參數。

可以看出,基于運動的方法適合于求解標定參數和大規模場景的初始值。但是基于運動的方法的主要缺點是單眼相機的運動缺乏3D尺度信息,而且在姿態估計和數據本身之間存在很大的誤差,準確度需要突破。由于可以通過立體視覺恢復比例問題,因此大大簡化了標定問題,因此,這種方法更適用于立體攝像機。

d) 基于深度學習的校準方法

隨著近年來深度學習的快速發展。自動駕駛中的各種感知任務可以通過深度學習實現并表現良好,激光雷達和攝像頭的外部參數標定也可以通過神經網絡進行預測。Schneider[47]等人提出了第一種將深度學習應用于標定問題的方法,通過RegNet神經網絡分別提取相機圖像和激光雷達點云,然后進行回歸。Ganesh Iyer[48]和其他人設計了一個幾何監督的深度網絡,可以實時自動估計3D LiDAR和2D相機之間的6-DoF剛體變換。其中,CalibNet減少了對校準目標的需求,從而大大節省了校準工作。最近,Kaiwen Yuan等人[49]提出了一種基于RGGNet的激光雷達相機標定方法。該方法考慮黎曼幾何,并使用深度生成模型學習隱式公差模型。該方法既考慮了標定誤差,又考慮了誤差范圍內的公差,取得了較好的標定效果。對于深度神經網絡,不需要預先提取圖像和激光雷達點云的特征來建立兩個數據的映射和連接。相反,它直接交給神經網絡中的節點,以找到潛在的關系。對于標定問題,監督學習顯然是不夠的。很難直接獲得外部參數的真實值,并且很難提供可靠且可觀的訓練集。因此,無監督學習或半監督學習更適合于外部參數標定問題。然而,現有算法對使用條件要求更高,大量的訓練是巨大的計算量,而泛化能力亟待提高。

審核編輯:郭婷

現階段,大多數無人平臺采用“激光雷達+視覺攝像頭”解決方案,以實現完整的環境感知。其中,激光雷達在目標表面獲得高精度、離散的三維點云數據,受環境影響較小,具有良好的魯棒性;視覺攝像機可以獲得高分辨率、高質量的二維視覺信息,在環境感知和目標檢測方面具有很大的優勢。由于相機和激光雷達的信息具有高度互補性,融合兩者不僅可以克服單一傳感器在環境感知方面的缺點,還可以獲得更豐富的目標觀測數據,提高其環境感知的準確性,如圖2和表I所示。

由于激光雷達數據點稀疏,視覺相機分辨率高,激光雷達和視覺相機的聯合校準是實現兩者融合的基礎環節。為了響應激光雷達和視覺相機的聯合校準,已經提出了各種標定方法。然而,這些方法大多是根據實際需要進行的,因此沒有系統的解決方案,并且缺乏開源校準數據集,各種方法也不統一,很難為研究人員提供明確的參考。在此基礎上,本文總結了近年來激光雷達與單相機聯合標定的先進標定方法。本文將重點討論聯合標定系統構建、標定板設計、標定參數求解等基本問題,如圖3和圖4所示。

標定系統的構建

一個典型的標定系統可以分為以下步驟:首先根據要求選擇激光雷達、視覺相機和標定板,然后根據一定的方法建立標定目標在不同坐標系中的轉換關系,最后求解轉換矩陣。其中,標定板的選擇、坐標系轉換關系的建立、標定方程的求解是關鍵環節。

圖5顯示了基于標定板的激光雷達和相機聯合標定所涉及的四個主要坐標系!像素坐標系(u,v),相機坐標系,圖像平面坐標系(x,y),激光雷達坐標系。

相機和激光雷達的聯合標定通常包括兩部分:內部參數標定和外部參數標定。內部參數標定主要解決攝像機CCD傳感器本身畸變和安裝的影響;外部參數標定主要用于建立兩個傳感器之間的坐標轉換方程。如圖6所示,這是相機和激光雷達聯合校準的流程圖!

標定板的選擇根據標定對象和提取的特征點而不同,標定可以通過兩種方式進行:基于目標的標定或無目標標定。基于目標的標定通常使用特定的標定板以便于算法提取特定的特征點,而無目標標定方法通常直接使用環境中的材料或結構特征來提取和匹配以實現標定,以增加標定的范圍和便利,如圖7所示。

1)Target-based Calibration

基于目標標定的特點是在標定過程中使用特定形式的標定板。這樣,特征點易于捕獲,所需算法簡單,計算能力小。但缺點也很明顯:一是必須在使用傳感器之前對其進行標定,而且不能進行實時標定。另一個是二維平面板(如棋盤)需要獲得清晰的對應關系,這不僅使得最終的標定精度嚴重依賴于3D和2D特征點,還需要人工干預!

二維標定板

二維標定板通常取決于特定的標定目標,最常用的是棋盤。張[1]首先提出了一種棋盤標定板,通過具有多個姿態的棋盤來估計二維激光雷達和相機之間的參數。Ranjith Unnikrishnan等人[2]基于Zhang提出的相機和2D激光雷達的標定方法,提出了3D激光雷達和相機外部參數的標定方法,如圖8所示。

然而,由于激光雷達的縱向光束之間的距離大且采集分辨率低,很難通過邊緣提取來保證精確頂點的精度。Lyu[3]手動調整棋盤在激光點云中的位置,以便掃描線可以掃描到棋盤的頂點,但這將增加標定過程的時間和復雜性。

同樣為了解決點云邊緣擬合不準確的問題,康國華等人[4]使用點云中心的粗配準來實現點云的整體精細配準。從另一個角度來看,除了輸出三維點云的坐標信息,激光雷達還可以帶回反射強度信息。[5] 對不同材料的激光雷達反射強度設置閾值,以獲得激光雷達點云,并在此基礎上設計了一種新的標定板。

ArUco標記是一種特殊的編碼模式,便于檢測和糾正標簽本身的錯誤。霍爾等人提出了一種用于由多個單元組成的實驗裝置的校準板。方法[6]使用ArUco標記計算相機坐標系中標定板的角點,激光雷達點提取擬合的邊緣線,然后可以計算激光雷達相機的外部參數。在實際應用中,這種方法與棋盤中的激光雷達一樣,包括不穩定的邊緣提取和線擬合算法,這將給校準帶來很大的誤差。此外,由于需要多個標定板,該方法更加復雜。為了增加激光雷達點云的可提取特征,出現了一個空心標定板。Dong等人[7]和Zhung等人[8]的工作有些相似,他們在黑白棋盤的中心構造了一個空心圓孔,并將圓孔的中心校準為特征點。然而,由于激光雷達點云沒有明顯的特征,因此只能從整個圓孔點云近似計算中心的坐標,如圖9所示。

最近,黃強等人[9]提出了一種基于可重構標定板的激光雷達和視覺傳感器的聯合標定方法,使用類似條形碼的方法來自動識別激光雷達的特征點,并添加了相機驗證機制,以減輕標定過程中相機識別不穩定導致的錯誤。

三維標定板

三維標定板的目的是更好地幫助激光雷達找到特征點,從而更好地匹配特征點。當背景不純凈時,上一節中提到的中空平板可能會導致像素混合,周世輝等人[10]分析了平面空心標定板產生的混合像素誤差,設計了一種特殊的網格狀標定板,并基于特征點匹配方法實現了工業相機和激光雷達的高精度聯合校準,以實現像素級圖像融合效果。蔡懷宇等人[11] 設計了具有梯度深度信息、平面角度信息和位置信息的標定板(BWDC)。該方法不僅從一維提取特征,而且有效地利用了激光雷達提取三維信息的能力。然而,這對標定板的設計和制造精度提出了很高的要求,增加了成本和誤差。如圖10所示。

Pusztai等人[12]使用具有三個垂直邊的長方體作為標定對象,通過提取長方體的邊緣來估計長方體的3D頂點,并將其與從圖像中提取的2D頂點進行匹配,這種方法是通用的,因為它可以用于普通的盒子。類似地,Xiaojin Gong等人[13]提出了基于任意三面體的3D激光雷達相機的外部標定。由于用于標定的三面體目標可以是正交或非正交的,這通常出現在結構化環境中,因此它具有廣泛的應用。

2)Targetless Calibration

無目標標定不需要人工標定目標,在線標定更方便,但精度低,魯棒性差。例如,當遇到需要在線標定的情況時,固定傳感器的相對位置會因機械振動而改變,其標定參數也會隨著時間而變得不準確。由于大多數融合方法對標定誤差極為敏感,其性能和可靠性受到嚴重損害。此外,大多數標定過程需要從頭開始,因此手動連續更新校準參數既麻煩又不切實際,為了擺脫標定板的限制,并通過自然場景實現在線標定,研究人員進行了大量研究!

其中一些方法使用RGB紋理和激光雷達反射率之間的相關性,一些方法提取圖像和激光點云中的邊緣[17]或線特征[18]進行相關性測量。Castorena等人[19]使用深度和強度邊緣的自然對齊結合高斯混合模型進行標定,并獲得了一種自動、無目標、完全數據驅動的全局匹配優化方法。這些方法需要相對精確的初始參數,否則很容易陷入局部極值,因此,用于自識別場景的無目標標定方法通常用于微調外部參數。還有一些基于里程計的軌跡配準[20],時間序列視覺幀的密集點云和激光點云的配準[21],甚至還有基于深度學習的方法[22]、[23]。這些方法不僅高度依賴于環境,還受到視覺或激光里程計精度的影響,目前的技術精度低,不具有普遍性,需要進一步研究和開發。

3)標定方程建立

在相機傳感器獲取過程中,為了確定空間物體表面上的點的三維幾何位置與其在圖像中的對應點之間的關系,必須建立相機成像的幾何模型。

(1) 三維坐標轉換:攝像機坐標系到激光雷達坐標系的轉換,公式如下:

(2) 二維坐標轉換:從像素坐標系到圖像坐標系的轉換,公式如下:

(3) 基于針孔成像原理的坐標轉換:攝像機坐標系到圖像坐標系的轉換,公式如下:

(4) 合并轉換:激光雷達坐標系到像素坐標系的轉換如圖11所示進行組合和推導,公式如下:

參數求解

1)相機內參

為了簡化計算,假設了一個線性理想針孔相機,如圖12中的a所示。但實際由于相機鏡頭精度和裝配過程的偏差,相機成像不可避免地引入了失真。真實圖片和兩個常見相機圖片的失真如圖13所示,導致圖像失真,如圖12中的b所示。

內部參數是視覺測量的重要校準參數之一,它反映了計算機圖像坐標中空間點與成像點之間的精確對應關系,如圖14所示。

傳統的攝像機校準方法。傳統的相機標定方法使用具有已知結構和高精度的標定目標或三維標定場作為空間參考對象。在建立世界坐標系之后,獲得每個特征點的空間坐標,根據空間點和圖像點之間的對應關系,建立了相機內部參數的約束條件。最后,通過優化算法獲得內部參數,在相機內部參數的計算中,使用最廣泛的方法是張正友方法[24]。受張正友方法的啟發,許多開源庫函數,如OpenCV、ROS、matlab和一些工具箱[25][26]都使用這種方法進行開發和標定!相機自標定方法。相機自標定方法是指使用包含由相機捕獲的重疊場景的一組圖像來建立對應關系的過程,在不依賴于標定參考對象的情況下完成幾何校準。由于只使用其自身的約束,因此它與攝影機和周圍環境之間的相對運動狀態無關,它具有更高的靈活性,適用于因條件惡劣而無法使用校準目標的情況。使用絕對二次曲線和極線變換的特性來求解Kruppa方程的相機自校準方法[27]、[28]、[29]。這種直接求解Kruppa方程的方法在求解過程中優化參數過多,容易陷入局部最優。當圖像噪聲較大時,校準精度會降低,魯棒性會變差,用分層逐步標定方法代替。它使用投影校準作為基礎,選擇某一圖片作為標準,并執行投影對準,從而減少未知數。然后使用非線性優化算法來解決所有未知問題[30]。另一個分支是基于主動視覺的相機自標定技術,主動視覺系統是指將攝像機精確安裝在可控平臺上。主動控制相機按照指定的運動軌跡完成照片拍攝,最后使用相機運動參數確定內部參數[31]、[32],它的缺點是對實驗設備的要求更高,對模型參數的限制更大,并且抗噪聲能力較差。基于消失點標定的方法。20世紀90年代以來,國內外大量學者開始研究基于消失點標定的方法。幾何上,世界直線的消失點是通過平行于直線并穿過相機中心和圖像平面的光線的交點獲得的,因此,消失點僅取決于直線的方向,與其特定位置無關[33]、[34]、[35]。消失點標定方法不需要對象控制點,而是使用相機自身參數之間的約束關系來建立模型。這大大提高了標定的靈活性,實現了實時在線標定,并具有廣泛的應用。其缺點是魯棒性差和精度低,因為在大多數基于消失點標定的方法中,相機中的方位角元素是通過單個圖像的消失點來校準的,而傳統的消失點標定算法需要三組場景中相互正交的平行線。然而,由于噪聲等因素的影響,它在實際應用中常常受到限制。相機的內部參數和失真參數是相機的固有參數,出廠后通常是固定的。因此,許多制造商現在直接提供相機的內部出廠時的參數。同時,隨著相機設計的內部優化,其失真控制越來越好。這也是內部參數標定算法研究和更新緩慢的原因!

2)外參求解

從數據選擇方法來看,可分為手動標定解決方案和自動標定解決方案。手動標定是早期開發和使用的第一種標定方法,它以其簡單有效的操作和高精度而深受標定人員的喜愛。然而,隨著科學技術的發展,圖像和點云中的數據量巨大,導致勞動力成本急劇增加。單一的手動標定已不能滿足人們對速度、自動化和魯棒性的需求,自動標定已應運而生,如圖15所示,激光雷達中相機的外部參數根據不同的原理進行標定!

手動外部參數標定

對于相機激光雷達外部參數標定,校準對象可以提供準確的幾何尺寸信息,手動操作可以提供準確匹配信息。最常用的方法是使用棋盤來確定一系列用于校準的3D點對。例如,Dhall[36]等人手動選擇3D點并使用最小二乘法解決問題,Scaramuzza[37]等人提出了一種快速標定方法,該方法不依賴于標定對象,而是基于點特征。作者從相機圖像和激光雷達點云中手動選擇一系列具有不連續深度的對應點來解決問題。手動camera-激光雷達有多種標定方法。不同的方法在不同的具體應用場景中達到了高精度,對于需要實時在線標定的系統,手動標定的主要問題是過度依賴人工操作,以及特殊的標定對象,這嚴重降低了自主性和智能性。

自動外部參數標定

隨著智能應用的迫切需求,近十年來誕生了大量相機激光雷達外部參數的自動標定方法。這些方法分為基于特征匹配的方法、基于互信息的方法,基于運動的方法和基于深度學習的方法。

a) 基于特征匹配的標定方法

基于特征匹配的方法通過選擇特征點并基于標定板獲得上述兩個系統中特征點的坐標,根據特征匹配,直接獲得激光雷達坐標系與相機像素坐標系之間的轉換關系,然后通過求解標定矩陣轉換方程或使用監督學習等方法來計算轉換矩陣以及內部和外部參數,目前基于激光雷達點云邊緣提取的特征匹配方法主要分為間接法和直接法兩種。

間接法:大多數方法將激光雷達點轉換為圖像,然后執行邊緣提取。Wang等人[39]使用Canny算法提取圖像的邊緣,并使用邊界檢測器從3D激光雷達點云生成距離圖像,建立點云數據和距離圖像之間的對應關系。通過像素對應合并2D圖像和3D點云數據,以獲得具有3D信息的邊緣圖像。通常,相機的分辨率和點云是不同的,這種方法可能會引入一些錯誤。

直接法:在圖像中,灰度值突然變化的地方形成了圖像的邊緣,這種變化稱為圖像梯度。基于圖像邊緣的特征,Xia等人[40]提出了3D點云梯度的概念,然后基于用于快速邊緣提取的激光雷達點云。該擬合方法可以提取更多的邊緣特征,具有較高的精度,并且對點的密度不敏感。

b) 基于互信息的標定方法

基于互信息的方法的主要思想是在相機圖像和激光雷達點云中找到相關變量。通過計算相機圖像的灰度值與相關變量(例如激光雷達的反射率或激光雷達反射的角度)之間的相互信息,然后最大化互信息以優化校準外部參數。Pandney等人[41]認為,激光雷達點云的反射率與相機圖像的灰度值之間存在很強的相關性,通過核密度估計方法計算反射率和灰度值的概率。最后,通過Barzilai-Borwein最速下降法計算互信息并優化外部參數。Taylor等人[42]認為,與相機圖像點對應的3D點的法線與相機之間的角度將影響反射強度,通過計算激光雷達點云的反射率和對應于相機圖像點的上述角度之間的相互信息來執行校準。可以看出,當兩個傳感器執行緊密的數據融合時,兩個傳感器之間的精確外部參數尤為重要。由于激光雷達點云的稀疏性,無法直接提取散射在校準板角落的激光雷達點,這將帶來更大的誤差,也將導致精確的拐角計算。因此,基于直接提取的反射強度特征點的激光雷達相機外部標定方法可以有效地補償這一問題。然而,基于互信息的方法的效果與傳感器所在環境中目標物體的材料和反射率有關,并且容易受到諸如光照條件和天氣變化等因素的干擾。

c) 基于運動的標定方法

基于運動的方法通常從連續運動數據或多視圖數據中求解外部參數。首先,分別計算相機和激光雷達的運動,然后通過手眼標定來解決相機和激光雷達的直接外部參數。Taylor[43]等人提出了一套標定方法,可應用于由激光雷達、相機和導航傳感器組成的任何系統。作者首先登記每個傳感器的連續幀,然后使用連接以校準外部參數。Ishikawa[44]等人使用KLT跟蹤器跟蹤激光雷達在圖像平面上的投影點,并通過投影誤差不斷優化缺少3D比例的平移向量,取得了比泰勒更準確的結果。趙[45]使用相機的前后幀圖像重建城市場景3D并計算姿態變化,并計算激光雷達點云的前后幀ICP,以獲得點云的空間變化。同時,有許多研究通過關鍵幀和運動恢復結構等技術實現了無人機和激光雷達點云上的圖像配準。例如,Nedevschi等人[46]使用特征匹配來檢測車輛行駛過程中傳感器的偏移。該方法通過對圖像執行距離變換來找到圖像中的邊緣,同時,將激光雷達點云轉換為距離圖像。根據邊緣信息建立目標函數。該方法可以消除車輛運動過程中產生的漂移,并自動調整外部參數。

可以看出,基于運動的方法適合于求解標定參數和大規模場景的初始值。但是基于運動的方法的主要缺點是單眼相機的運動缺乏3D尺度信息,而且在姿態估計和數據本身之間存在很大的誤差,準確度需要突破。由于可以通過立體視覺恢復比例問題,因此大大簡化了標定問題,因此,這種方法更適用于立體攝像機。

d) 基于深度學習的校準方法

隨著近年來深度學習的快速發展。自動駕駛中的各種感知任務可以通過深度學習實現并表現良好,激光雷達和攝像頭的外部參數標定也可以通過神經網絡進行預測。Schneider[47]等人提出了第一種將深度學習應用于標定問題的方法,通過RegNet神經網絡分別提取相機圖像和激光雷達點云,然后進行回歸。Ganesh Iyer[48]和其他人設計了一個幾何監督的深度網絡,可以實時自動估計3D LiDAR和2D相機之間的6-DoF剛體變換。其中,CalibNet減少了對校準目標的需求,從而大大節省了校準工作。最近,Kaiwen Yuan等人[49]提出了一種基于RGGNet的激光雷達相機標定方法。該方法考慮黎曼幾何,并使用深度生成模型學習隱式公差模型。該方法既考慮了標定誤差,又考慮了誤差范圍內的公差,取得了較好的標定效果。對于深度神經網絡,不需要預先提取圖像和激光雷達點云的特征來建立兩個數據的映射和連接。相反,它直接交給神經網絡中的節點,以找到潛在的關系。對于標定問題,監督學習顯然是不夠的。很難直接獲得外部參數的真實值,并且很難提供可靠且可觀的訓練集。因此,無監督學習或半監督學習更適合于外部參數標定問題。然而,現有算法對使用條件要求更高,大量的訓練是巨大的計算量,而泛化能力亟待提高。

審核編輯:郭婷

-

傳感器

+關注

關注

2564文章

52805瀏覽量

765573 -

機器人

+關注

關注

213文章

29627瀏覽量

212231 -

激光雷達

+關注

關注

971文章

4219瀏覽量

192459

原文標題:激光雷達與視覺聯合標定綜述!(系統介紹/標定板選擇/在線離線標定等)

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

為什么割草機都在轉向3D激光雷達技術

一徑科技NZ1全場景廣角3D激光雷達,面向泛機器人應用場景

激光雷達技術在自動駕駛汽車中的應用

Lidwave Odem 4D激光雷達榮獲2025年CES創新獎

禾賽科技CES 2025發布迷你型超半球3D激光雷達JT系列

禾賽科技推出面向機器人領域的迷你3D激光雷達

禾賽在CES 2025發布迷你3D激光雷達JT系列

一則消息引爆激光雷達行業!特斯拉竟然在自研激光雷達?

激光雷達技術或可助力防御無人機

激光雷達在SLAM算法中的應用綜述

相機和3D激光雷達的性能比較和應用現狀

相機和3D激光雷達的性能比較和應用現狀

評論