介紹

當(dāng)前,對(duì)于一個(gè)場(chǎng)景的快速重建是重要的,目標(biāo)是實(shí)現(xiàn)一個(gè)快速的、全面的三維重建模型。可以應(yīng)用于野外的林業(yè)資源保護(hù)、火災(zāi)和地震的災(zāi)后搶救、邊境安防、油田或者海上平臺(tái)油氣設(shè)施、電力設(shè)施監(jiān)測(cè)都有十分重要的價(jià)值。

現(xiàn)在對(duì)于野外覆蓋常用衛(wèi)星。對(duì)衛(wèi)星來(lái)說(shuō),存在分辨率不足的問(wèn)題,無(wú)法清晰構(gòu)建出野外的三維場(chǎng)景。而對(duì)于較精確的雷達(dá)激光掃描重建,既有造價(jià)昂貴的缺點(diǎn),又十分笨重,在野外環(huán)境中進(jìn)行三維重建十分不方便。

隨著自動(dòng)控制、無(wú)線傳輸?shù)燃夹g(shù)的發(fā)展,無(wú)人機(jī)的應(yīng)用領(lǐng)域也越來(lái)越多。無(wú)人機(jī)具備成木低,應(yīng)用范圍廣,機(jī)動(dòng)性能好,降低野外作業(yè)人員危險(xiǎn)等優(yōu)點(diǎn)。因此基于圖像的三維重建方法是解決上述問(wèn)題的有效手段。

三維重建一直以來(lái)就是國(guó)內(nèi)外學(xué)者研宄的熱點(diǎn)問(wèn)題,并取得了一些重大的成果。華盛頓大學(xué)的GRAIL實(shí)驗(yàn)室,采用多核并行技術(shù)耗時(shí)21小時(shí)完成了對(duì)羅馬城的稀疏點(diǎn)云的重建,成功地實(shí)現(xiàn)了對(duì)海量數(shù)據(jù)的大場(chǎng)景稀疏點(diǎn)云的三維重建[1-2]。吳常常實(shí)現(xiàn)的VisualSFM算法是較為完善的開(kāi)源視覺(jué)重建算法[3],在該算法使用多核捆綁調(diào)整[4]進(jìn)行參數(shù)優(yōu)化。但是,其對(duì)于紋理較弱的場(chǎng)景,不能進(jìn)行三維重建。

基于深度學(xué)習(xí)的方法已經(jīng)引起了人們的廣泛關(guān)注,并在圖像處理中得到了廣泛的應(yīng)用。一些研究者提出了基于深度神經(jīng)網(wǎng)絡(luò)的三維重建算法。Ummenhofer等人中提出的 DeMoN 給出了從連續(xù)的無(wú)約束圖像對(duì)中恢復(fù)圖像深度和相機(jī)運(yùn)動(dòng)的端到端神經(jīng)網(wǎng)絡(luò)[5],并且還可以輸出表面法線、匹配對(duì)之間的光流,該框架由多個(gè)編碼器-解碼器組成。該網(wǎng)絡(luò)只單純利用兩個(gè)圖像之間的RGB信息而沒(méi)有利用幾何信息進(jìn)行估計(jì),三維重建準(zhǔn)確度較低,效果不好。

總體框架

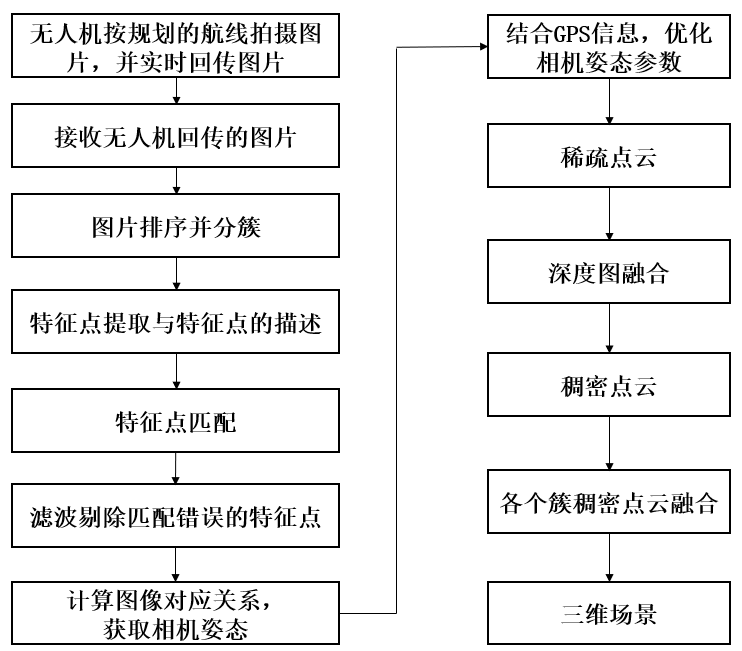

本文介紹的方法,整體流程圖如圖1所示。

圖1.整體流程圖

具體步驟如下:

步驟1:首先要對(duì)無(wú)人機(jī)的飛行路徑進(jìn)行之字形規(guī)劃,無(wú)人機(jī)拍攝的正射影像可以完全覆蓋所需拍攝的場(chǎng)景,進(jìn)而獲取精確、詳細(xì)的圖像序列,無(wú)人機(jī)在拍攝圖像的過(guò)程中,實(shí)時(shí)的將圖片與RTK信息回傳給地面站。

步驟2:地面站接收無(wú)人機(jī)拍攝的圖片后,將圖片按順序進(jìn)行排列,并將圖像按照每20張分成一個(gè)簇。

步驟3:對(duì)每個(gè)簇中的圖片進(jìn)行提取特征點(diǎn),并對(duì)特征點(diǎn)進(jìn)行描述。

步驟4:接著進(jìn)行特征匹配,使用濾波算法來(lái)剔除匹配錯(cuò)誤的特征點(diǎn)。

步驟5:通過(guò)運(yùn)動(dòng)恢復(fù)結(jié)構(gòu)技術(shù)獲取相近圖像之間的對(duì)應(yīng)關(guān)系,初步獲取相機(jī)在三維空間中的姿態(tài)及位置信息。

步驟6:圖像中包含GPS信息,利用光束法平差來(lái)優(yōu)化相機(jī)姿態(tài)參數(shù),得到各個(gè)圖像簇的稀疏點(diǎn)云。

步驟7:然后,通過(guò)恢復(fù)每張圖像的深度圖,基于深度圖融合的方法,將這些深度圖融合,得到各個(gè)圖像簇的稠密點(diǎn)云。

步驟8:最后,將各個(gè)圖像簇的稠密點(diǎn)云進(jìn)行融合,得到整個(gè)場(chǎng)景的三維信息。

具體步驟:

首先,確定無(wú)人機(jī)拍攝野外場(chǎng)景的具體范圍,并對(duì)無(wú)人機(jī)的飛行路徑進(jìn)行規(guī)劃,這里選用之字形往返式的規(guī)劃路徑方式。這種方式對(duì)于無(wú)人機(jī)的飛行具有簡(jiǎn)單、便捷的特點(diǎn),飛行路線大多都是直線,轉(zhuǎn)彎的次數(shù)較少,消耗的能量也較少,并且可以完全覆蓋所需要拍攝的場(chǎng)景。

此外,無(wú)人機(jī)所搭載的相機(jī)也有一定的要求,需要使用帶有RTK載波相位差分技術(shù)的照相機(jī),無(wú)人機(jī)在拍攝場(chǎng)景時(shí),同時(shí)可以記錄拍攝點(diǎn)位的GPS信息。

在無(wú)人機(jī)拍攝的圖像后,需要將圖像以及相應(yīng)的RTK信息實(shí)時(shí)回傳給地面站。

地面站在接收到無(wú)人機(jī)拍攝的圖片后,將圖片按順序進(jìn)行排列,這種有序的圖像序列,為后續(xù)的特征匹配節(jié)省很多時(shí)間。

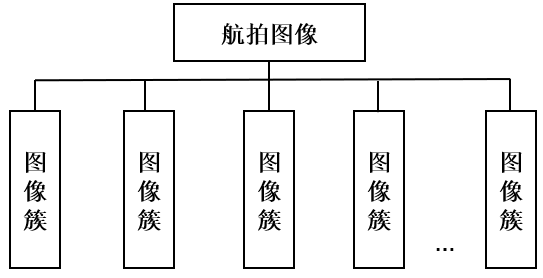

如圖2所示,圖片按順序排列好之后,將圖片按照每20張分成一個(gè)簇,后續(xù)就是對(duì)圖像簇進(jìn)行操作,各個(gè)圖像簇之間并行處理,提高效率。

圖2. 圖像分簇

對(duì)每個(gè)簇中的圖片進(jìn)行提取特征點(diǎn),這里提取SIFT特征點(diǎn),因?yàn)镾IFT特征具有區(qū)分性好,對(duì)旋轉(zhuǎn)、尺度縮放、亮度變化保持不變性,對(duì)視角變化、仿射變換、噪聲也保持一定程度的穩(wěn)定性等優(yōu)點(diǎn),因此這里使用SIFT特征提取算子對(duì)圖像集進(jìn)行特征提取。

提取了圖像的特征點(diǎn)之后,需要對(duì)圖像進(jìn)特征匹配。在接收?qǐng)D像后已經(jīng)對(duì)圖像順序進(jìn)行了排序,在特征匹配階段,只需要對(duì)各個(gè)圖像簇中相鄰的兩幅圖像進(jìn)行特征匹配,對(duì)于n張輸入圖像,能夠?qū)⑵ヅ潆A段的時(shí)間復(fù)雜度從O(n2)降低到O(n)。

對(duì)于特征匹配,包括多種兩兩圖像之間的匹配算法可供選擇。對(duì)于基于標(biāo)量的特征描述符,有暴力匹配、近似最近鄰匹配、層級(jí)哈希匹配和快速層級(jí)哈希匹配四種方式。對(duì)于二進(jìn)制描述符,主要為暴力匹配。暴力匹配對(duì)參考圖像中的每個(gè)特征點(diǎn),在另一幅待匹配圖上計(jì)算所有特征點(diǎn)和該點(diǎn)歐式距離,再利用距離比等條件進(jìn)行剔除,最終得到匹配集。該方法時(shí)間復(fù)雜度較高,搜索效率較低。

近似最近鄰匹配的方法針對(duì)大數(shù)據(jù)集時(shí)它的效果要好于暴力匹配。層級(jí)哈希匹配和快速層級(jí)哈希匹配主要是利用局部敏感哈希將一個(gè)圖像上的特征點(diǎn)映射成為一個(gè)哈希編碼,在利用SIFT特征計(jì)算兩幅圖像之間的匹配的時(shí)候,對(duì)于第一幅圖像上的某個(gè)特征點(diǎn),搜索第二幅圖像上和該特征點(diǎn)哈希編碼的漢明距離小于某個(gè)閾值的特征點(diǎn),然后根據(jù)SIFT特征描述符的相似性和比率測(cè)試確定最終的匹配。

其中快速層級(jí)哈希匹配在速度上更快,利用預(yù)先計(jì)算好的散列區(qū)域,提升了匹配速度。所以, 這里采用快速層級(jí)哈希匹配處理兩幅圖像之間的匹配問(wèn)題。

在匹配的過(guò)程中,會(huì)存在一些誤匹配的情況,這對(duì)后期的三維重建會(huì)產(chǎn)生很大的影響,所以這里需要剔除匹配錯(cuò)誤的特征點(diǎn),這里采用RANSAC(Random Sample Consensus,隨機(jī)抽樣一致)算法來(lái)剔除誤匹配的點(diǎn)。RANSAC算法可以從一組包含“外點(diǎn)”的觀測(cè)數(shù)據(jù)集中,通過(guò)迭代方式估計(jì)數(shù)學(xué)模型的參數(shù),進(jìn)而剔除誤匹配的點(diǎn)。

RANSAC算法的具體步驟:

(1)首先從數(shù)據(jù)集中隨機(jī)選出一組局內(nèi)點(diǎn)(其數(shù)目要保證能夠求解出模型的所有參數(shù)),計(jì)算出一套模型參數(shù)。

(2)用得到的模型去測(cè)試其他所有的數(shù)據(jù)點(diǎn),如果某點(diǎn)的誤差在設(shè)定的誤差閾值之內(nèi),就判定其為局內(nèi)點(diǎn),否則為局外點(diǎn),只保留目前為止局內(nèi)點(diǎn)數(shù)目最多的模型,將其記錄為最佳模型。

(3)重復(fù)執(zhí)行1,2步足夠的次數(shù)(即達(dá)到預(yù)設(shè)的迭代次數(shù))后,使用最佳模型對(duì)應(yīng)的局內(nèi)點(diǎn)來(lái)最終求解模型參數(shù),該步可以使用最小二乘法等優(yōu)化算法。

(4)最后可以通過(guò)估計(jì)局內(nèi)點(diǎn)與模型的錯(cuò)誤率來(lái)評(píng)估模型。

在得到圖像中特征點(diǎn)的匹配關(guān)系后,通過(guò)運(yùn)動(dòng)恢復(fù)結(jié)構(gòu)技術(shù)來(lái)計(jì)算相鄰圖像之間的對(duì)應(yīng)關(guān)系,初步獲取相機(jī)在三維空間中的姿態(tài)及位置信息。

因?yàn)闊o(wú)人機(jī)拍攝的圖像中包含有GPS信息,利用圖像和GPS間的約束,使用光束法平差對(duì)相機(jī)的姿態(tài)位置進(jìn)行優(yōu)化調(diào)整,得到準(zhǔn)確的相機(jī)位姿以及場(chǎng)景路標(biāo)點(diǎn)。這里使用全局式SFM(Structure from motion,運(yùn)動(dòng)恢復(fù)結(jié)構(gòu))來(lái)輸出各個(gè)圖像簇的稀疏點(diǎn)云,因?yàn)槿质絊FM的重建速度相比于增量式SFM和層級(jí)式SFM的重建速度都快,并且重建效果可以達(dá)到要求。通過(guò)這種方式生成的稀疏點(diǎn)云具有尺寸及地理編碼信息。

通過(guò)計(jì)算出每張圖像的深度圖,利用深度圖融合,來(lái)生成三維稠密點(diǎn)云。基于深度圖融合的方法,需要首先將每張圖像對(duì)應(yīng)起來(lái),即通過(guò)旋轉(zhuǎn)、平移等坐標(biāo)變換對(duì)兩張圖像進(jìn)行匹配,這些對(duì)應(yīng)信息可以從SFM結(jié)果得到,然后再根據(jù)同一個(gè)空間點(diǎn)在各個(gè)深度圖中對(duì)應(yīng)的深度信息來(lái)共同恢復(fù)該空間點(diǎn)的三維位置。如果融合后的點(diǎn)云數(shù)量過(guò)多,還需要進(jìn)行三維點(diǎn)云精簡(jiǎn)處理,進(jìn)而得到各個(gè)圖像簇的稠密點(diǎn)云。

根據(jù)各所述稠密深度圖對(duì)應(yīng)的位移及所述旋轉(zhuǎn)關(guān)系,對(duì)各個(gè)圖像簇對(duì)應(yīng)的稠密點(diǎn)云進(jìn)行融合,在融合的過(guò)程中需要剔除一些重疊的點(diǎn)云,進(jìn)而得到整個(gè)場(chǎng)景的三維信息。

總結(jié)

本文介紹了基于圖像的三維重建方法。首先通過(guò)無(wú)人機(jī)按照規(guī)劃好的路線拍攝圖片,無(wú)人機(jī)在拍攝完圖片的過(guò)程中,將圖片實(shí)時(shí)的回傳給地面。在地面端接收無(wú)人機(jī)回傳的圖片,將接收的圖像按順序進(jìn)行排列,并將圖像按照每20張作為一個(gè)簇,分別對(duì)每簇中的圖像進(jìn)行提取特征點(diǎn),并對(duì)特征點(diǎn)進(jìn)行描述。

接著進(jìn)行特征匹配,使用濾波算法來(lái)剔除匹配錯(cuò)誤的特征點(diǎn)。根據(jù)匹配的特征點(diǎn),通過(guò)運(yùn)動(dòng)恢復(fù)結(jié)構(gòu)技術(shù)獲取相鄰圖像之間的對(duì)應(yīng)關(guān)系,初步獲取相機(jī)在三維空間中的姿態(tài)及位置信息。進(jìn)而利用光束法平差來(lái)優(yōu)化相機(jī)姿態(tài)參數(shù),得到各個(gè)圖像簇的稀疏點(diǎn)云。然后,通過(guò)恢復(fù)每張圖像的深度圖,基于深度圖融合的方法,將這些深度圖融合,得到各個(gè)圖像簇的稠密點(diǎn)云。最后將各個(gè)圖像簇的稠密點(diǎn)云進(jìn)行融合,得到整個(gè)場(chǎng)景的三維信息。

審核編輯:劉清

-

解碼器

+關(guān)注

關(guān)注

9文章

1174瀏覽量

41975 -

編碼器

+關(guān)注

關(guān)注

45文章

3796瀏覽量

138019 -

RGB

+關(guān)注

關(guān)注

4文章

807瀏覽量

59924 -

無(wú)人機(jī)

+關(guān)注

關(guān)注

231文章

10841瀏覽量

186744 -

激光雷達(dá)

+關(guān)注

關(guān)注

971文章

4234瀏覽量

192836

原文標(biāo)題:一文帶你理解基于圖像的三維重建

文章出處:【微信號(hào):vision263com,微信公眾號(hào):新機(jī)器視覺(jué)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

航天宏圖全棧式3DGS實(shí)景三維重建系統(tǒng)解決方案

激光三維掃描技術(shù):無(wú)噴粉條件下高反光表面三維重建的光學(xué)原理與應(yīng)用

一種基于基礎(chǔ)模型對(duì)齊的自監(jiān)督三維空間理解方法

使用DLP LightCrafter4500投影結(jié)構(gòu)光進(jìn)行三維重建遇到的疑問(wèn)求解

請(qǐng)問(wèn)DLP LightCrafter 3000在hdmi模式下如何關(guān)閉gamma?

請(qǐng)問(wèn)DLP3010投影圖像DMD格柵如何模糊化?

三維測(cè)量在醫(yī)療領(lǐng)域的應(yīng)用

三維測(cè)量技術(shù)在工業(yè)中的應(yīng)用

商湯科技運(yùn)用AI大模型實(shí)現(xiàn)實(shí)景三維重建

CASAIM與邁普醫(yī)學(xué)達(dá)成合作,三維掃描技術(shù)助力醫(yī)療輔具實(shí)現(xiàn)高精度三維建模和偏差比對(duì)

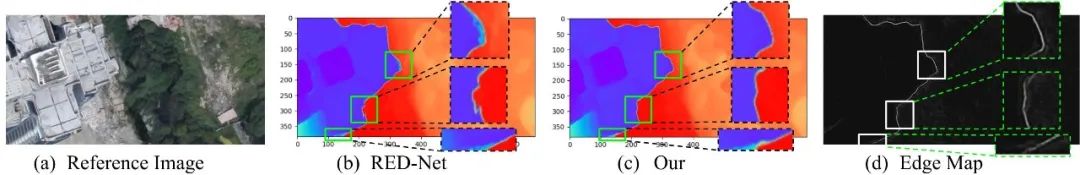

建筑物邊緣感知和邊緣融合的多視圖立體三維重建方法

三維可視化技術(shù)的應(yīng)用現(xiàn)狀和發(fā)展前景

三維打印技術(shù)原理

留形科技借助NVIDIA平臺(tái)提供高效精確的三維重建解決方案

基于大模型的仿真系統(tǒng)研究一——三維重建大模型

介紹一種基于圖像的三維重建方法

介紹一種基于圖像的三維重建方法

評(píng)論