同時,書生·浦語面向大模型研發與應用的全鏈條工具鏈全線升級,與InternLM-20B一同繼續全面開放,向企業和開發者提供免費商用授權。

今年6月首次發布以來,書生·浦語歷多輪升級,在開源社區和產業界產生廣泛影響。InternLM-20B模型性能先進且應用便捷,以不足三分之一的參數量,達到當前被視為開源模型標桿的Llama2-70B的能力水平。

代碼庫

https://github.com/InternLM/InternLM

魔搭社區

https://modelscope.cn/organization/Shanghai_AI_Laboratory

?

?書生·浦語“增強版”

增的不只是量

相比國內社區之前陸續開源的7B和13B規格模型,20B量級模型具備更強大的綜合能力,在復雜推理和反思能力上尤為突出,因此對于實際應用能夠帶來更有力的性能支持。

另一方面,20B量級模型可以在單卡上進行推理,經過低比特量化后,可以運行在單塊消費級GPU上,給實際使用帶來很大的便利。

InternLM-20B是基于2.3T Tokens預訓練語料從頭訓練的中量級語言大模型。相較于InternLM-7B,訓練語料經過更高水平的多層次清洗,補充了高知識密度和用于強化理解及推理能力的訓練數據。

在理解能力、推理能力、數學能力、編程能力等考驗語言模型技術水平方面,InternLM-20B與此前已開源模型相比,性能顯著增強:優異的綜合性能,通過更高水平的數據清洗和高知識密度的數據補充,以及更優的模型架構設計和訓練,顯著提升了模型的理解、推理、數學與編程能力。

InternLM-20B全面領先量級相近的開源模型,使之以不足三分之一的參數量,評測成績達到了被視為開源模型的標桿Llama2-70B水平。

-

擁有強大的工具調用能力,實現大模型與現實場景的有效連接,并具備代碼解釋和反思修正能力,為智能體(Agent)的構建提供了良好的技術基礎。

-

支持更長語境,支持長度達16K的語境窗口,更有效地支撐長文理解、長文生成和超長對話,長語境同時成為支撐在InternLM-20B之上打造智能體(Agent)的關鍵技術基礎。

-

具備更安全的價值對齊,書生·浦語團隊對InternLM-20B進行了基于SFT(監督微調)和RLHF(基于人類反饋的強化學習方式)兩階段價值對齊以及專家紅隊的對抗訓練,當面對帶有偏見的提問時,它能夠給出正確引導。

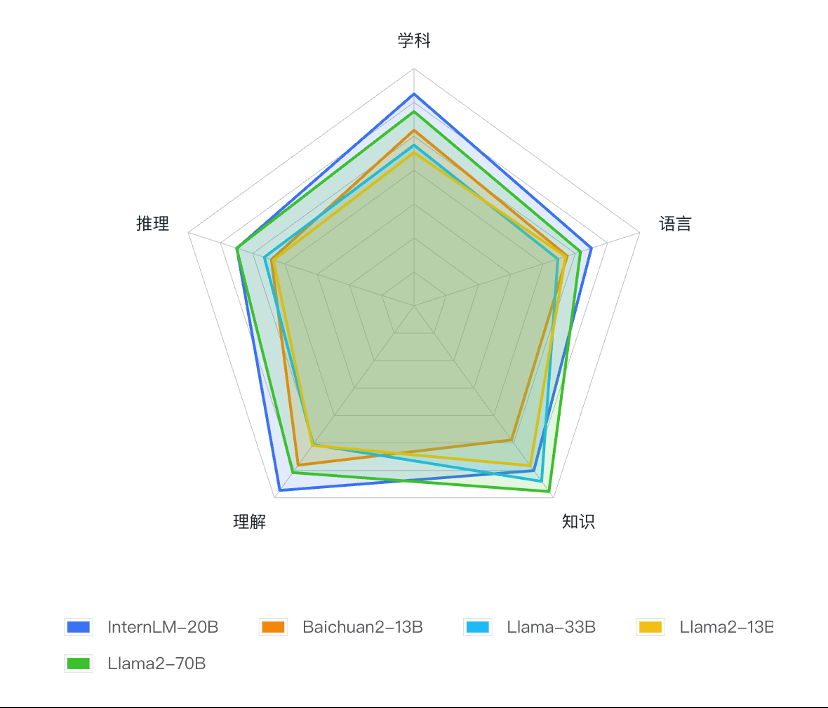

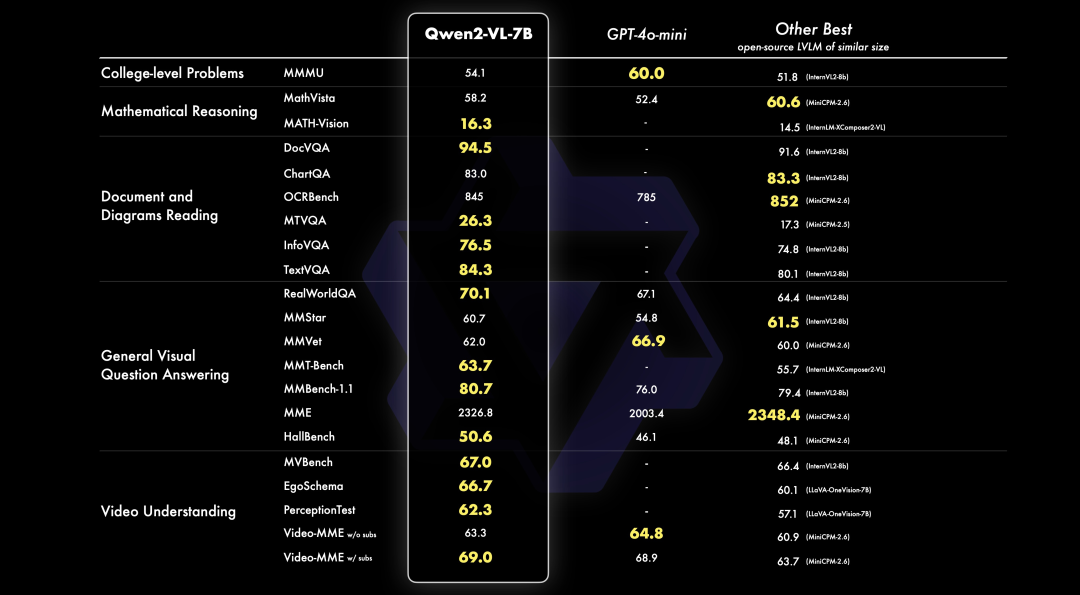

基于OpenCompass的InternLM-20B及相近量級開源模型測評結果

基于OpenCompass的InternLM-20B及相近量級開源模型測評結果

全鏈條工具體系再鞏固

各環節全面升級

今年7月,商湯科技與上海AI實驗室聯合發布書生·浦語的同時,在業內率先開源了覆蓋數據、預訓練、微調、部署和評測的全鏈條工具體系。

歷經數月升級,書生·浦語全鏈條開源工具體系鞏固升級,并向全社會提供免費商用。

全面升級的全鏈條工具體系

數據-OpenDataLab開源“書生·萬卷”預訓練語料

書生·萬卷是開源的多模態語料庫,包含文本數據集、圖文數據集、視頻數據集三部分,數據總量超過2TB。

目前,書生·萬卷1.0已被應用于書生·多模態、書生·浦語的訓練,為模型性能提升起到重要作用。

預訓練-InternLM高效預訓練框架

除了大模型外,InternLM倉庫也開源了預訓練框架InternLM-Train。深度整合了Transformer模型算子,使訓練效率得到提升,并提出了獨特的Hybrid Zero技術,使訓練過程中的通信效率顯著提升,實現了高效率千卡并行,訓練性能達行業領先水平。

微調-InternLM全參數微調、XTuner輕量級微調

InternLM支持對模型進行全參數微調,支持豐富的下游應用。同時,低成本大模型微調工具箱XTuner也在近期開源,支持多種大模型及LoRA、QLoRA等微調算法。

通過XTuner,最低僅需 8GB 顯存即可對7B模型進行低成本微調,在24G顯存的消費級顯卡上就能完成20B模型的微調。

部署-LMDeploy支持十億到千億參數語言模型的高效推理

LMDeploy涵蓋了大模型的全套輕量化、推理部署和服務解決方案,支持了從十億到千億級參數的高效模型推理,在吞吐量等性能上超過FasterTransformer、vLLM和Deepspeed等社區主流開源項目。

評測-OpenCompass一站式、全方位大模型評測平臺

OpenCompass大模型評測平臺構建了包含學科、語言、知識、理解、推理五大維度的評測體系,支持超過50個評測數據集和30萬道評測題目,支持零樣本、小樣本及思維鏈評測,是目前最全面的開源評測平臺。

自7月發布以來,受到學術界和產業界廣泛關注,目前已為阿里巴巴、騰訊、清華大學等數十所企業及科研機構廣泛應用于大模型研發。

應用-Lagent輕量靈活的智能體框架

書生·浦語團隊同時開源了智能體框架,支持用戶快速將一個大語言模型轉變為多種類型的智能體,并提供典型工具為大語言模型賦能。

Lagent集合了ReAct、AutoGPT 及ReWoo等多種類型的智能體能力,支持智能體調用大語言模型進行規劃推理和工具調用,并可在執行中及時進行反思和自我修正。

基于書生·浦語大模型,目前已經發展出更豐富的下游應用,將于近期陸續向學術及產業界分享。

面向大模型掀起的新一輪創新浪潮,商湯科技堅持原創技術研究,通過前瞻性打造新型人工智能基礎設施,建立大模型及研發體系,持續推動AI創新和落地,引領人工智能進入工業化發展階段,同時賦能整個AI社區生態的繁榮發展。全鏈條工具體系開源鏈接

“書生·萬卷”預訓練語料

https://github.com/opendatalab/WanJuan1.0

InternLM預訓練框架

https://github.com/InternLM/InternLM

XTuner微調工具箱

https://github.com/InternLM/xtuner

LMDeploy推理工具鏈

https://github.com/InternLM/lmdeploy

OpenCompas大模型評測平臺

https://github.com/open-compass/opencompass

Lagent智能體框架

https://github.com/InternLM/lagent

相關閱讀,戳這里

《AI考生今日抵達,商湯與上海AI實驗室等發布“書生·浦語”大模型》

《大語言模型“書生·浦語”多項專業評測拔頭籌》

原文標題:性能超越開源模型標桿Llama2-70B,書生·浦語大模型InternLM-20B開源發布

文章出處:【微信公眾號:商湯科技SenseTime】歡迎添加關注!文章轉載請注明出處。

-

商湯科技

+關注

關注

8文章

557瀏覽量

36713

原文標題:性能超越開源模型標桿Llama2-70B,書生·浦語大模型InternLM-20B開源發布

文章出處:【微信號:SenseTime2017,微信公眾號:商湯科技SenseTime】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

使用 NPU 插件對量化的 Llama 3.1 8b 模型進行推理時出現“從 __Int64 轉換為無符號 int 的錯誤”,怎么解決?

阿里云發布開源多模態推理模型QVQ-72B-Preview

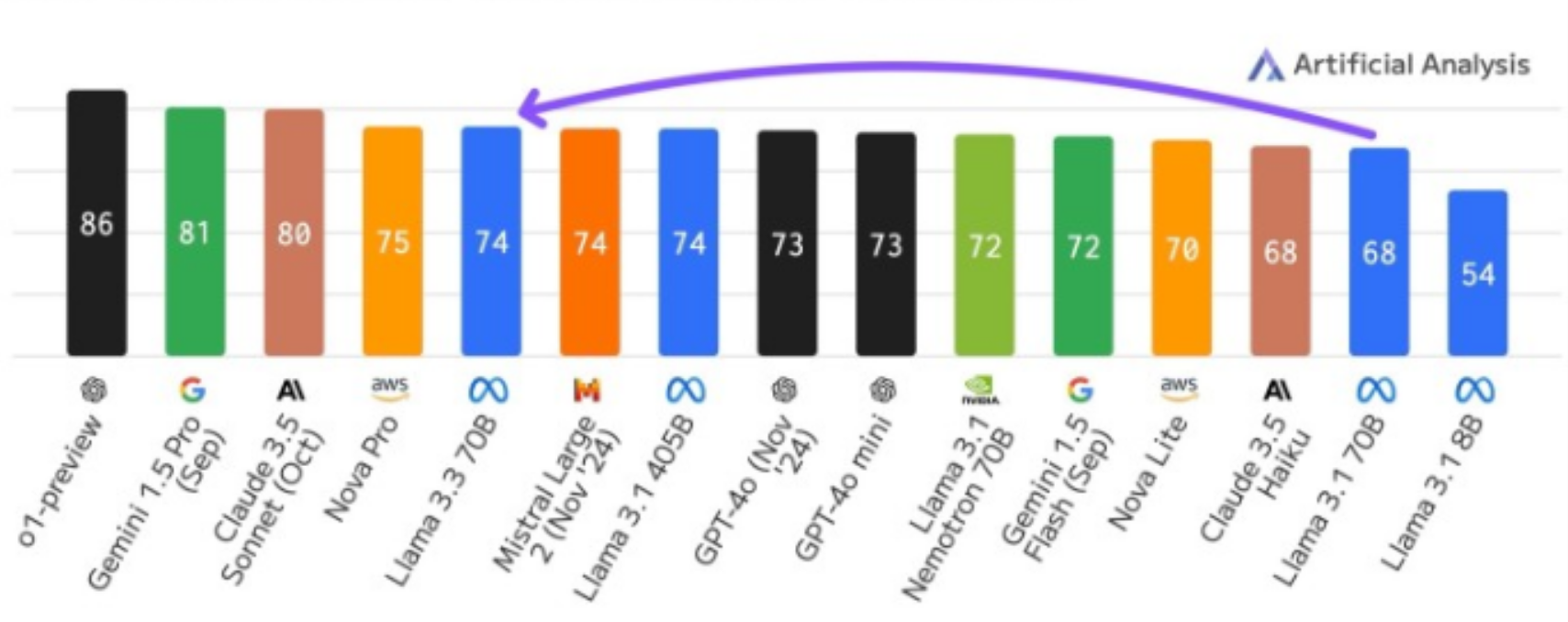

Meta重磅發布Llama 3.3 70B:開源AI模型的新里程碑

Meta推出Llama 3.3 70B,AI大模型競爭白熱化

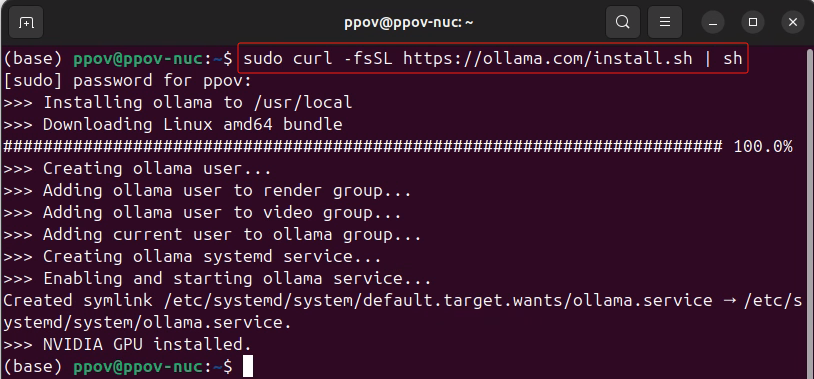

用Ollama輕松搞定Llama 3.2 Vision模型本地部署

阿里通義千問代碼模型全系列開源

Meta發布Llama 3.2量化版模型

Llama 3 與開源AI模型的關系

PerfXCloud重磅升級 阿里開源最強視覺語言模型Qwen2-VL-7B強勢上線!

英偉達發布AI模型 Llama-3.1-Nemotron-51B AI模型

源2.0-M32大模型發布量化版 運行顯存僅需23GB 性能可媲美LLaMA3

性能超越開源模型標桿Llama2-70B,書生·浦語大模型InternLM-20B開源發布

性能超越開源模型標桿Llama2-70B,書生·浦語大模型InternLM-20B開源發布

評論