引言

昆侖芯科技公眾號(hào)全新欄目“用芯指南”重磅推出!面向AI行業(yè)技術(shù)從業(yè)者,系列好文將提供手把手的昆侖芯產(chǎn)品使用指南。第一期圍繞昆侖芯自研效能工具——昆侖芯Anyinfer展開,這是一款基于昆侖芯AI加速卡的高效模型推理部署框架。種種行業(yè)痛點(diǎn),昆侖芯Anyinfer輕松搞定。

當(dāng)下,AI技術(shù)蓬勃發(fā)展,AI算法應(yīng)用需求井噴。行業(yè)技術(shù)從業(yè)者在項(xiàng)目的不同階段面臨種種現(xiàn)實(shí)問題,這些問題無疑也增加了項(xiàng)目的復(fù)雜性和不確定性:

算法選型:

技術(shù)從業(yè)者極有可能遇到不同框架格式的算法模型;即便是同一個(gè)開源算法的實(shí)現(xiàn),也可能是經(jīng)過不同訓(xùn)練框架導(dǎo)出,因此模型的保存格式也會(huì)有所不同。

算法驗(yàn)證:

想在AI加速卡上評(píng)估算法的推理效果,就要針對(duì)不同推理框架的接口構(gòu)造上百行代碼的推理程序;如果效果不達(dá)預(yù)期,可能還需要更換其他框架的模型,這就需要重新構(gòu)造一份不同的推理程序......

真正到了算法部署階段,則將迎來更加嚴(yán)峻的挑戰(zhàn)。

以上種種業(yè)內(nèi)痛點(diǎn),是否也在困擾您?看完這篇,基于昆侖芯AI加速卡的高效模型推理部署框架——昆侖芯Anyinfer,幫您一鍵全搞定!

1昆侖芯Anyinfer

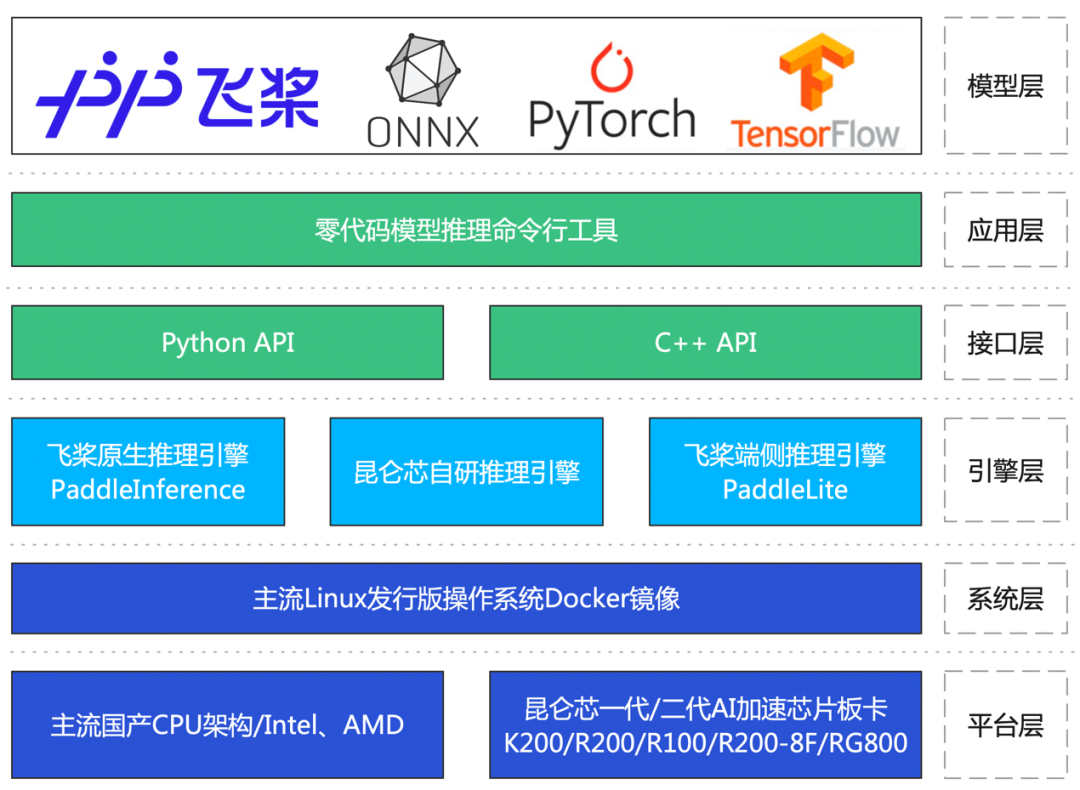

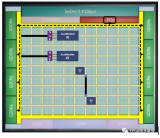

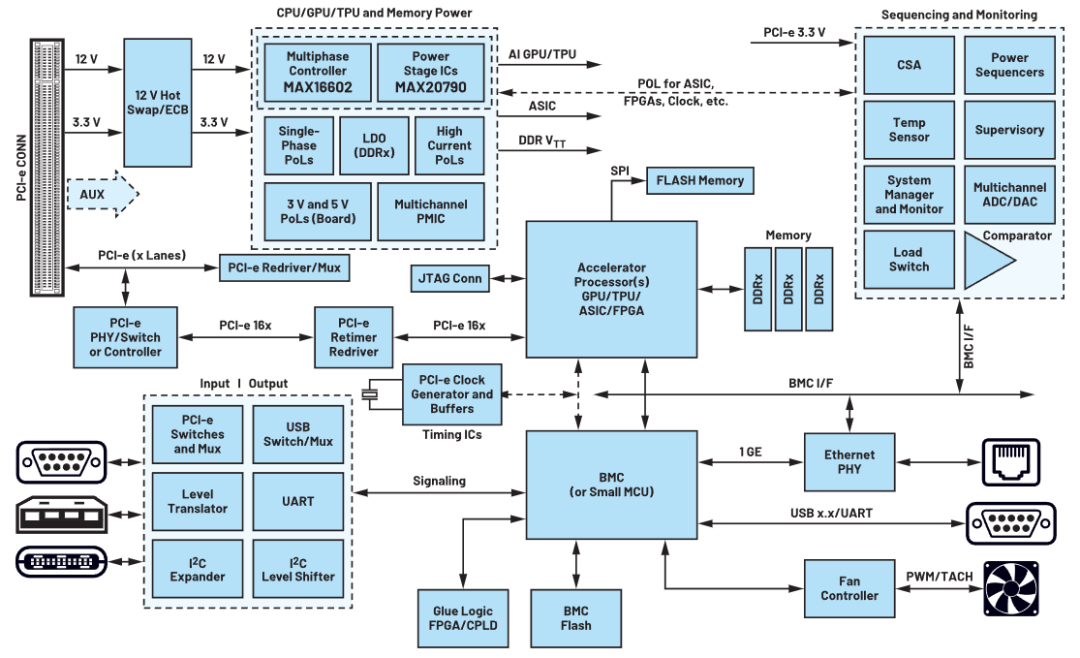

1.昆侖芯Anyinfer架構(gòu)圖

2.昆侖芯Anyinfer核心優(yōu)勢(shì)

A強(qiáng)兼容性

在多個(gè)平臺(tái)上支持零代碼推理PaddlePaddle、PyTorch、ONNX、TensorFlow等多個(gè)主流框架格式的眾多領(lǐng)域模型。

B高人效

內(nèi)置多款推理引擎,針對(duì)不同領(lǐng)域,用戶無需學(xué)習(xí)特定框架編程接口,更不用編寫多份推理程序,零代碼驗(yàn)證模型在不同框架中的效果。

C零代碼

只需一行命令,即可完成模型驗(yàn)證評(píng)估,無需依據(jù)模型構(gòu)建輸入數(shù)據(jù),也無需撰寫模型轉(zhuǎn)換、前后處理及推理腳本代碼。

D部署友好

支持C++與Python兩套接口邏輯統(tǒng)一的API,用戶在生產(chǎn)環(huán)境中部署模型更方便。

2運(yùn)行演示

1. 快速完成算法模型驗(yàn)證評(píng)估

一行命令,即可輕松驗(yàn)證模型精度、一鍵評(píng)估模型的推理性能等關(guān)鍵指標(biāo)。

AONNX、PyTorch和TensorFlow模型在昆侖芯AI加速卡和CPU上的計(jì)算精度對(duì)比

BPaddlePaddle模型在昆侖芯AI加速卡上的推理性能統(tǒng)計(jì)

2.獲取模型性能分析報(bào)告,為下一步模型優(yōu)化做足準(zhǔn)備

在初步完成算法模型的驗(yàn)證評(píng)估后,可利用昆侖芯Anyinfer深入研究模型中各個(gè)層面的性能,包括推理框架層面和算子執(zhí)行層面等,助力進(jìn)一步調(diào)優(yōu)模型的推理性能。

一鍵開啟昆侖芯自研推理引擎的性能分析模式,統(tǒng)計(jì)框架層和算子層面的計(jì)算耗時(shí)

一鍵開啟Paddle inference的性能分析模式,統(tǒng)計(jì)框架層和算子層面的耗時(shí)

3. 模型的基礎(chǔ)性能調(diào)優(yōu)

完成對(duì)模型的性能評(píng)估后,可以使用基礎(chǔ)的調(diào)優(yōu)方法來提高模型的推理性能。昆侖芯Anyinfer提供了一項(xiàng)非常便捷的功能:最佳QPS搜索。此功能將以往需要修改多個(gè)參數(shù)并多次執(zhí)行的操作化繁為簡,快速確定最適合項(xiàng)目需求的配置,提高用戶體驗(yàn)。

搜索最佳QPS

4. 模型的高性能部署

完成算法模型的驗(yàn)證后,最關(guān)鍵的一步來了!昆侖芯Anyinfer可輕松應(yīng)對(duì)生產(chǎn)環(huán)境部署這一挑戰(zhàn)。僅需三個(gè)統(tǒng)一的C++接口,即可順利將驗(yàn)證后的模型部署至生產(chǎn)環(huán)境中。

此外,昆侖芯Anyinfer還提供了方便的調(diào)試功能,例如算子的自動(dòng)精度對(duì)比、模型轉(zhuǎn)換等。同時(shí),也提供了豐富的使用示例,包括多輸入、多線程、多進(jìn)程、多流推理等。種種行業(yè)痛點(diǎn),昆侖芯Anyinfer輕松搞定。簡潔而強(qiáng)大的解決方案,幫您把模型推理部署變得簡單、高效。

目前,昆侖芯Anyinfer已在多個(gè)行業(yè)客戶中投入使用,切實(shí)降低了行業(yè)客戶人力成本,提高了項(xiàng)目交付效率,助力客戶在行業(yè)競(jìng)爭(zhēng)中取得領(lǐng)先優(yōu)勢(shì)。

審核編輯:湯梓紅

-

算法

+關(guān)注

關(guān)注

23文章

4699瀏覽量

94773 -

AI

+關(guān)注

關(guān)注

87文章

34274瀏覽量

275455 -

模型

+關(guān)注

關(guān)注

1文章

3488瀏覽量

50010 -

昆侖芯科技

+關(guān)注

關(guān)注

0文章

33瀏覽量

828

原文標(biāo)題:一鍵搞定!昆侖芯Anyinfer助您零代碼實(shí)現(xiàn)昆侖芯AI加速卡模型推理

文章出處:【微信號(hào):昆侖芯科技,微信公眾號(hào):昆侖芯科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

大模型向邊端側(cè)部署,AI加速卡朝高算力、小體積發(fā)展

EdgeBoard FZ5 邊緣AI計(jì)算盒及計(jì)算卡

MLU220-M.2邊緣端智能加速卡支持相關(guān)資料介紹

壓縮模型會(huì)加速推理嗎?

LCD轉(zhuǎn)VGA視頻加速卡

基于NVIDIA Triton的AI模型高效部署實(shí)踐

昆侖芯2代AI芯片為開發(fā)者提供靈活便捷的部署方案

昆侖芯科技產(chǎn)業(yè)級(jí)AI模型部署全攻略

昆侖芯新品R100正式發(fā)布,強(qiáng)大算力賦能邊緣推理場(chǎng)景

昆侖芯完成OpenCloudOS社區(qū)首個(gè)兼容性認(rèn)證,軟硬協(xié)同加速AI技術(shù)落地

HPC領(lǐng)域的一款大殺器-HBX-G500大帶寬加速卡

瞬變對(duì)AI加速卡供電的影響

首發(fā) | 昆侖芯 | 國產(chǎn)AI卡Deepseek訓(xùn)練推理全版本適配、性能卓越,一鍵部署等您來(附文檔下載方式)

邊緣AI新突破:MemryX AI加速卡與RK3588打造高效多路物體檢測(cè)方案

邊緣AI運(yùn)算革新 DeepX DX-M1 AI加速卡結(jié)合Rockchip RK3588多路物體檢測(cè)解決方案

介紹一款基于昆侖芯AI加速卡的高效模型推理部署框架

介紹一款基于昆侖芯AI加速卡的高效模型推理部署框架

評(píng)論