日前,北京理工大學光電學院王涌天教授、劉越教授團隊成員徐怡博教授與來自谷歌公司和美國萊斯大學研究人員合作,開發了一種具有優異壓縮比和吞吐量的基于單像素光電探測器的高光譜視頻成像系統,成果發表于Nature Communications 15, 1456 (2024)。徐怡博教授為論文第一作者兼通訊作者,谷歌公司陸李陽博士、萊斯大學Saragadam 博士和Kevin Kelly博士也對此工作做出了貢獻。

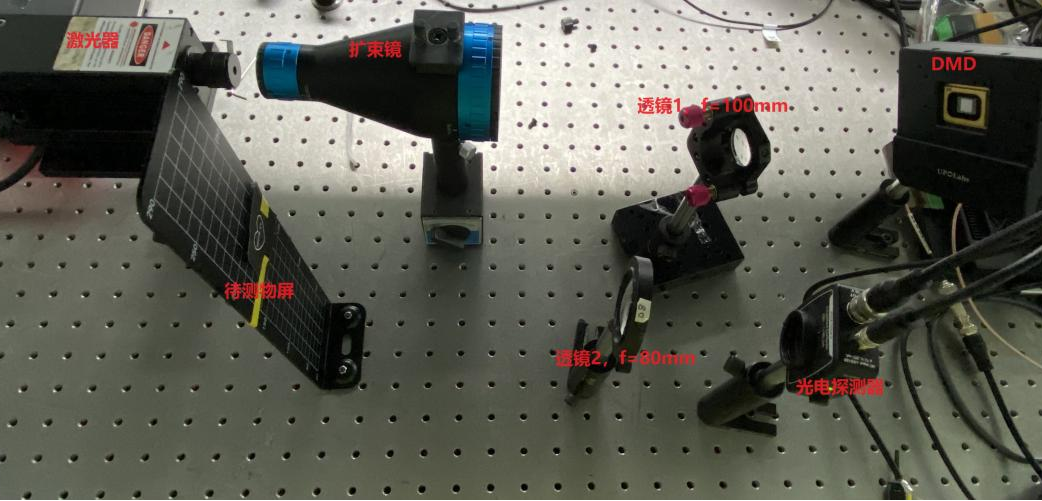

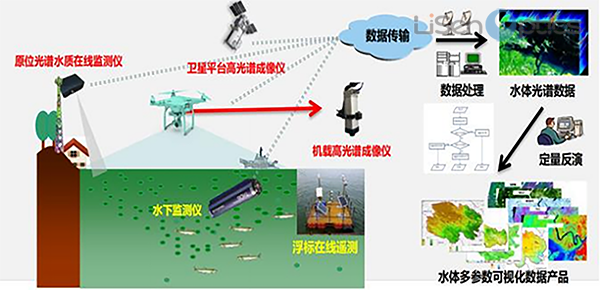

高光譜視頻成像捕獲場景的精細空間、光譜和時間信息,在生物熒光成像、遙感、監控、自動駕駛等領域中具有廣泛應用。高光譜視頻數據量極大,現有方法記錄高維數據時占用大量傳輸帶寬和存儲空間,給無人機、手機、行星探測器和衛星等資源受限系統帶來巨大壓力。如何在保留信息的前提下最大限度減少采樣數據量、大幅提升采樣壓縮比是高光譜視頻成像中的關鍵問題。

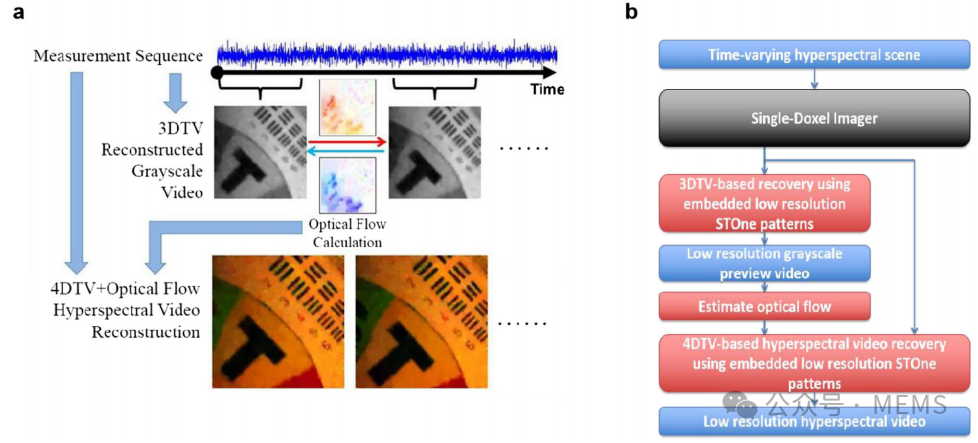

該研究利用四維高光譜視頻的高度可壓縮性,設計一種空間-光譜聯合編碼方案,提出基于四維空間信號稀疏度模型的優化重建和深度學習重建方法,實現了基于單像素探測器、可在低帶寬下實現高通量的高光譜視頻成像系統。如圖1,優化重建方法先從包含互補圖案的原始測量中重建灰度視頻并提取光流,然后通過光流輔助四維全變分正則化優化方法實現高光譜視頻重建。

圖1 光流輔助四維全變分正則化高光譜視頻重建過程示意圖與流程圖

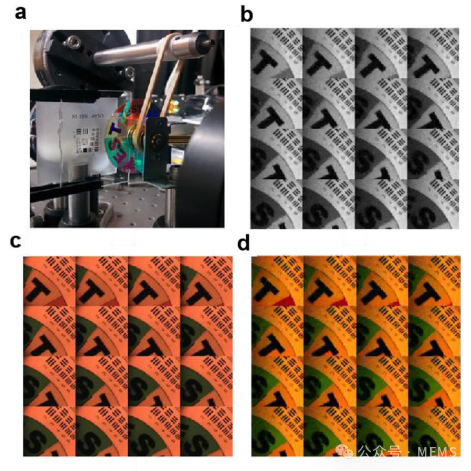

實驗中重建視頻空間大小為128 × 128,具有64個光譜頻道,幀率約4幀/秒,壓縮比約為900:1。圖2展示從重建的高光譜頻幀中均勻選取16幀并轉換為人工RGB圖像,與彩色相機記錄的畫面對比,可見實現了高精度的重建。

圖2 單像素成像實驗優化算法重建結果

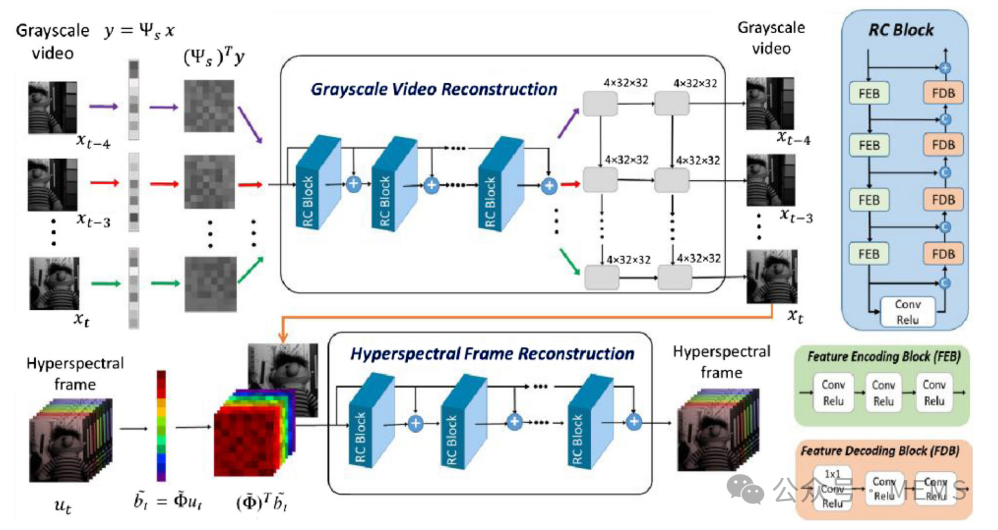

如圖3,深度學習重建方法由兩個階段組成。先基于長短期記憶(LSTM)網絡的模型利用5個相鄰幀之間的時間相關性,從“結構化隨機”編碼測量中重建灰度視頻。再基于殘差連接的卷積神經網絡(CNN)的高光譜重建網絡,從深度空間-光譜聯合壓縮測量值及第一階段的灰度視頻中恢復高光譜幀。

圖3 高光譜視頻重建的深度學習方法示意圖

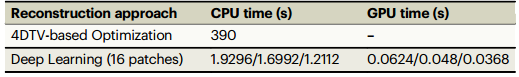

如表1所示,對比基于兩種方法重建高光譜幀的時間,可見深度學習方法在重建速度上有顯著的提升。

表1 基于四維全變分的優化方法和深度學習方法的重構時間

論文鏈接:

https://www.nature.com/articles/s41467-024-45856-1

-

RGB

+關注

關注

4文章

806瀏覽量

59738 -

光電探測器

+關注

關注

4文章

272瀏覽量

20948 -

深度學習

+關注

關注

73文章

5557瀏覽量

122626 -

卷積神經網絡

+關注

關注

4文章

369瀏覽量

12249

原文標題:基于單像素光電探測器的高光譜視頻成像系統,具有優異壓縮比和吞吐量

文章出處:【微信號:MEMSensor,微信公眾號:MEMS】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

VirtualLab:通用探測器

新型范德華異質結探測器實現寬帶偏振探測

雷達探測器的工作原理 雷達探測器與激光探測器區別

光電探測器選型噪聲問題

一種基于單像素光電探測器的高光譜視頻成像系統設計

一種基于單像素光電探測器的高光譜視頻成像系統設計

評論