最近神經網絡的成功不斷擴展著模型的架構,并促成了架構搜索的出現,即神經網絡自動學習架構。架構搜索的傳統方法是神經演化,如今,硬件的發展能實現大規模的演變,生成可以與手工設計相媲美的圖像分類模型。但是,新的技術雖然可行,卻無法讓開發者決定在具體的環境下(即搜索空間和數據集)使用哪種方法。

在本篇論文中,研究人員使用流行的異步進化算法(asynchronous evolutionary algorithm)的正則化版本,并將其與非正則化的形式以及強化學習方法進行比較。硬件條件、計算能力和神經網絡訓練代碼都相同,在這之中研究人員探索在不同的數據集、搜索空間和規模下模型的表現情況。以下是論智對論文的編譯總結。

實驗方法

我們使用不同的算法搜索神經網絡分類器的空間,進行基線研究后,所得到的最好的模型將被擴大尺寸,以生產更高質量的圖像分類器。我們在不同的計算規模上執行搜索過程。另外,我們還研究了非神經網絡模擬中的進化算法。

1.搜索空間

所有神經進化和強化學習實驗都使用基線研究的搜索空間設計,它需要尋找兩個類似于Inception的模塊體系結構,這兩個結構在前饋模式中堆疊以形成圖像分類器。

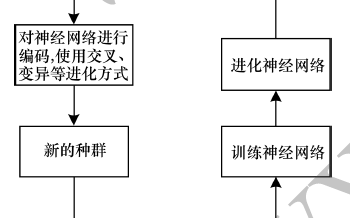

2.架構搜索算法

對于進化算法,我們使用聯賽選擇算法(tournament selection)或正則化的變體。標準的聯賽選擇算法是對訓練模型P的數量進行周期化的改進。在每個循環中,隨機選擇一個S模型的樣本。樣本的最佳模型將生成具有變化架構的另一模型,它將被訓練然后添加到模型樣本中。最差的模型將被刪除。我們將這種方法稱為非正則進化(NRE)。它的變體,正則化進化(RE)則是一種自然的修正:無需刪除樣本中最差的模型,而是刪除樣本中最老的模型(即第一個被訓練的模型)。在NRE和RE中,樣本初始化的架構都是隨機的。

3.實驗設置

為了對比進化算法和強化學習算法,我們將在不同的計算規模上進行實驗。

小規模試驗

首先進行的實驗可以在CPU上進行,我們部署了SP-I、SP-II和SP-III三種搜索空間,利用G-CIFAR、MNIST或者G-ImageNet數據集進行實驗。

大規模實驗

然后再部署基線研究的設置。這里僅用SP-I搜索空間和CIFAR-10數據集,兩種模型各在450個GPU上訓練將近7天。

4.模型擴展

我們要將進化算法或強化學習發現的架構轉化為全尺寸、精確的模型。擴展后的模型將在CIFAR-10或ImageNet上進行訓練,程序與基線研究的相同。

實驗結果

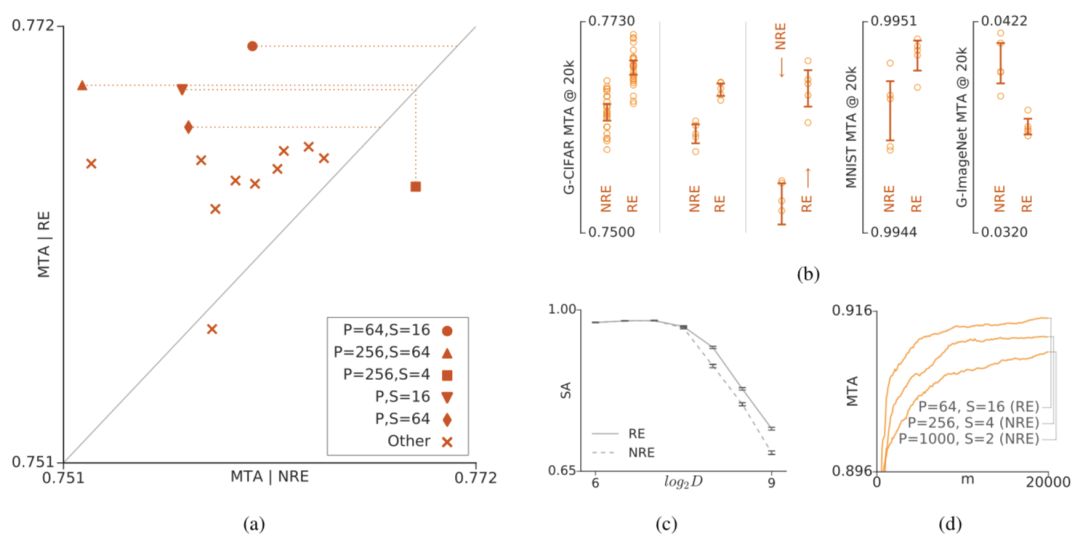

正則化與非正則化進化的對比。(a)表示在G-CIFAR數據集上非正則化進化和正則化進化用不同的元參數進行的小規模實驗結果對比。P代表樣本數量,S代表樣本大小。(b)表示NRE和RE在五種不同情況下的表現,從左至右分別為:G-CIFAR/SP-I、G-CIFAR/SP-II、G-CIFAR/SP-III、MNIST/SP-I和G-ImageNet/SP-I。(c)表示模擬結果,豎軸表示模擬的精確度,橫軸表示問題的維度。(d)表示在CIFAR-10上進行的三次大規模試驗。

接著,我們在不同的情況下對強化學習和進化算法進行了小規模實驗,結果如下:

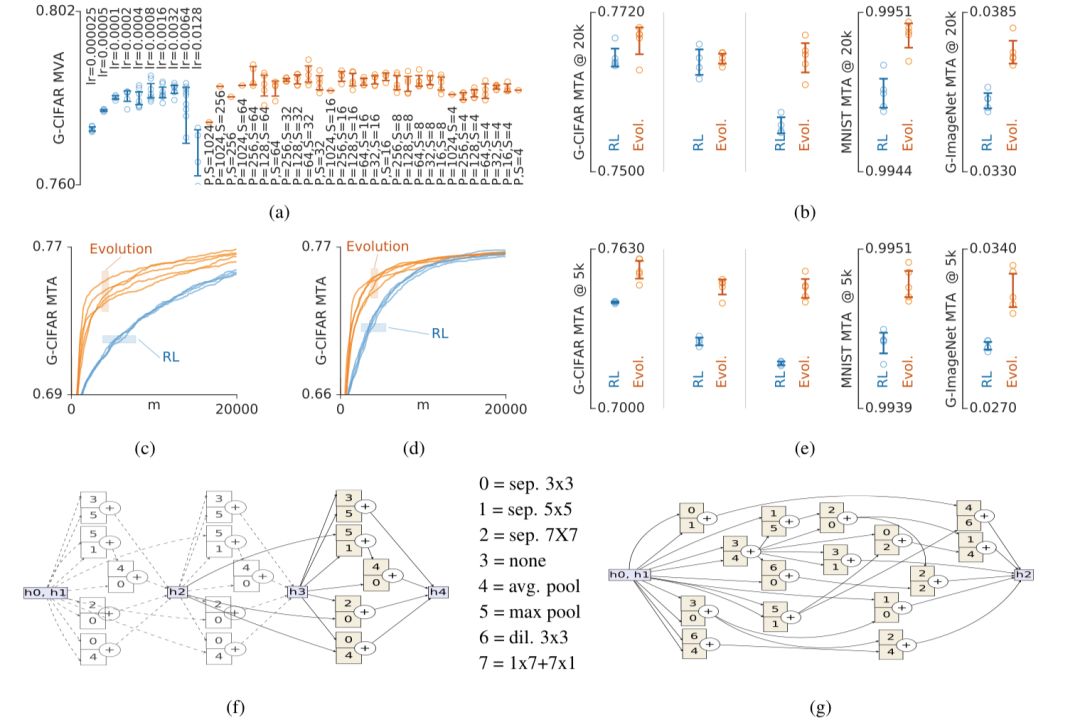

(a)顯示了在G-CIFAR上對超參數進行優化的實驗總結,豎軸表示實驗中前100名的模型的平均有效精度。結果表明所所有方法都不夠敏感。(b)同樣是在模型五種不同情況下的表現:G-CIFAR/SP-I、G-CIFAR/SP-II、G-CIFAR/SP-III、MNIST/SP-I和G-ImageNet/SP-I。(c)和(d)表示模型分別在G-CIFAR/SP-II和G-CIFAR/SP-III上的表現細節,橫軸表示模型的數量。(e)表示在資源有限的情況下,可能需要盡早停止實驗。說明了在初始狀態下,進化算法的精確度比強化學習增長得快得多。(f)和(g)分別是SP-I和SP-III最頂尖的架構。

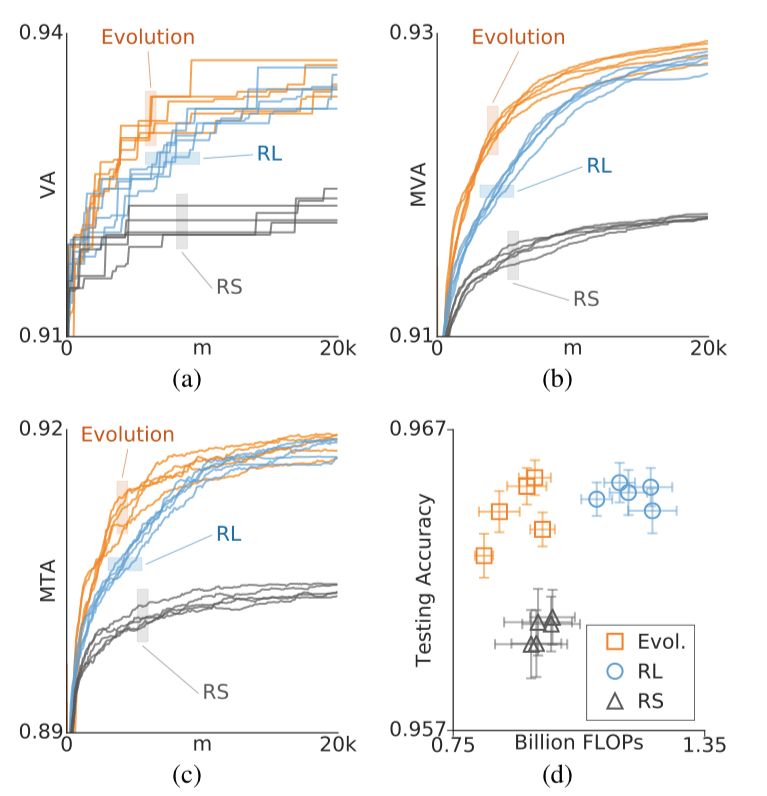

比較完小規模實驗,接著進行的是大規模實驗。結果如下圖所示,黃色代表進化算法,藍色代表強化學習:

除了(d)圖,所有橫軸均表示模型的數量(m)。(a)、(b)、(c)三圖分別展示了三種算法在五次相同實驗的情況,進化算法和強化學習實驗使用了最佳元參數。

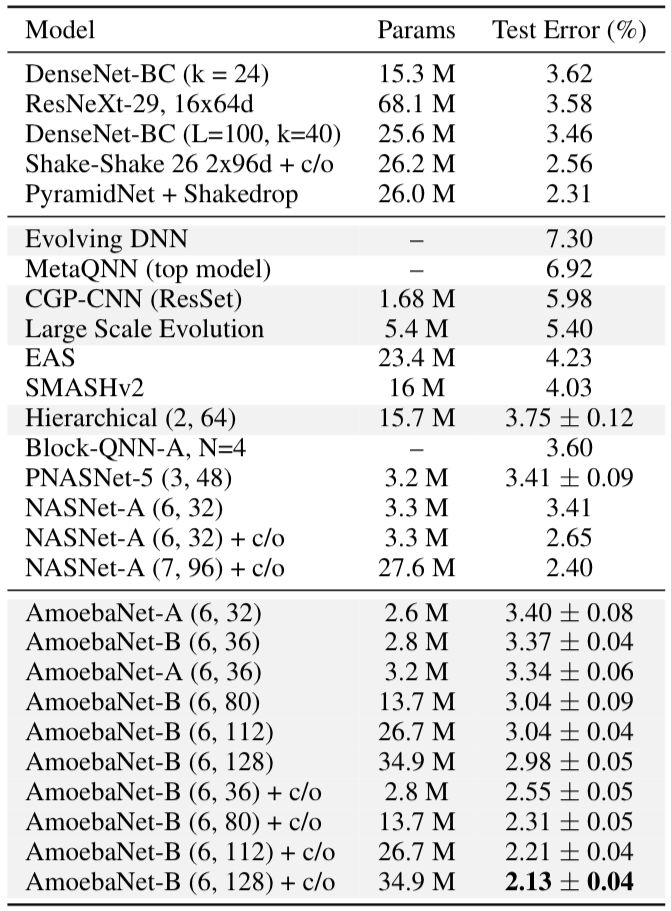

經過進化實驗,我們確定了最佳模型并將其命名為AmoebaNet-A。通過調整N和F,我們可以降低測試錯誤率,如表1所示:

表1

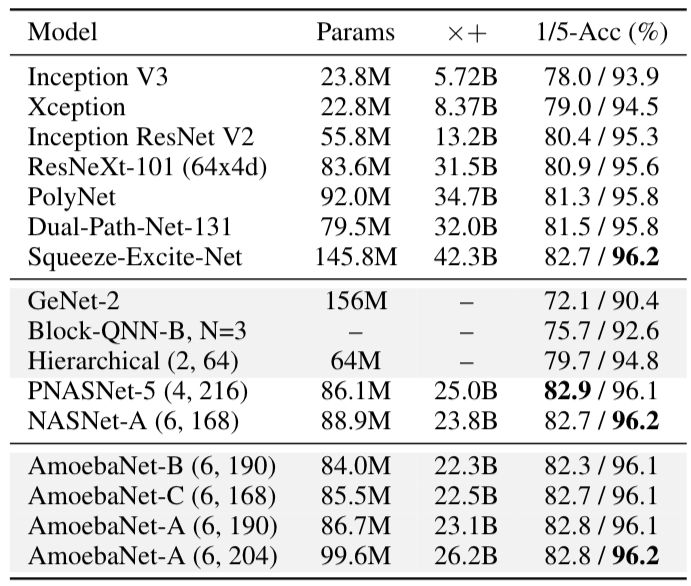

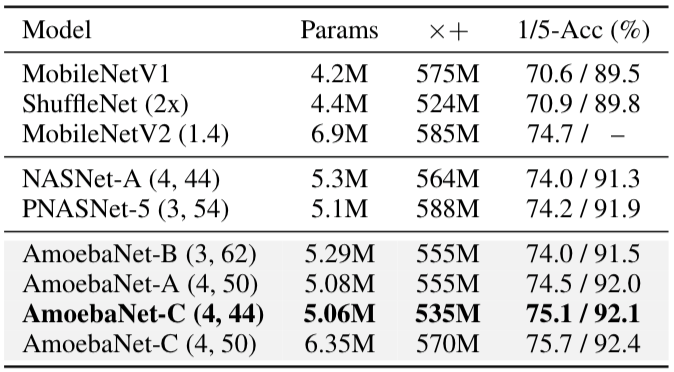

在相同的實驗條件下,基線研究得到了NASNet-A。表2顯示,在CIFAR-10數據集中,AmoebaNet-A在匹配參數時錯誤率較低,在匹配錯誤時,參數較少。同時在ImageNet上的表現也是目前最好的。

表2

最后我們對比了手動設計、其他架構以及我們模型的性能對比,準確率均高于其他兩種。

表3

結語

大規模的實驗過程圖表明,強化學習和進化算法都接近一般精度漸近線,所以我們需要關注的是哪個算法更快到達。圖中顯示強化學習要用兩倍的時間到達最高精度的一半,換句話說,進化算法的速度大約比強化學習快一倍。但是我們忽略了進一步量化這一效果。另外,搜索空間的大小還需進一步評估。大空間所需專業資源較少,而小空間能更快更好地獲得結果。因此,在較小空間中很難區分哪種搜索算法更好。

不過,這一研究僅僅是在特定環境下分析進化算法和強化學習之間關系的第一個實證研究,我們希望今后的工作能進一步總結二者,闡釋兩種方法的優點。

-

進化算法

+關注

關注

0文章

10瀏覽量

7460 -

強化學習

+關注

關注

4文章

269瀏覽量

11527

原文標題:圖像分類器結構搜索的正則化異步進化方法

文章出處:【微信號:jqr_AI,微信公眾號:論智】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

深度強化學習實戰

深度學習技術的開發與應用

圖像分類的方法之深度學習與傳統機器學習

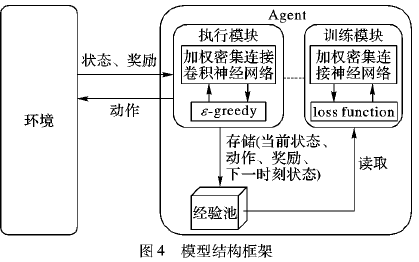

使用加權密集連接卷積網絡的深度強化學習方法說明

谷歌和DeepMind研究人員合作提出新的強化學習方法Dreamer 可利用世界模型實現高效的行為學習

深度學習中圖像分割的方法和應用

模型化深度強化學習應用研究綜述

解析圖像分類器結構搜索的正則化異步進化方法 并和強化學習方法進行對比

解析圖像分類器結構搜索的正則化異步進化方法 并和強化學習方法進行對比

評論