OpenAI,這個只公開宣揚消耗全球所有能源和納稅人5000億美元一半的機構,最近被震撼到了核心。Deepseek,一家由中國對沖基金運營的新AI初創(chuàng)公司,據(jù)稱創(chuàng)建了一個名為R1的新型開源權重模型,該模型在所有指標上都超越了OpenAI的最佳模型。

而他們僅用600萬美元就做到了這一點,而他們使用的GPU內(nèi)存帶寬只有OpenAI的一半。

除了這家中國初創(chuàng)公司以百分之一的資源擊敗OpenAI所帶來的尷尬(據(jù)Deepseek所言),他們的模型還能“提煉”其他模型,使它們在較慢的硬件上運行得更好。

這意味著Raspberry Pi現(xiàn)在可以更好地運行其中一個最好的本地Qwen AI模型。

OpenAI的整個護城河都建立在人們無法獲得訓練和運行大型AI模型所需的瘋狂能源和GPU資源之上。

但如果每個人都能隨時購買一個GPU并免費運行一個足夠好的模型,那么這個護城河就會消失。

Raspberry PiAI

但聳人聽聞的標題并沒有告訴你全部的故事。

從技術上講,Raspberry Pi可以運行Deepseek R1,但這與Deepseek R1 671b(一個400GB的模型)并不相同。

那個模型(實際擊敗ChatGPT的模型)仍然需要大量的GPU計算能力。

但巨大的不同在于,假設你有幾塊3090顯卡,你就可以在家里運行它。你不需要為運行OpenAI那些花哨的模型而付費。

你只需安裝Ollama,下載Deepseek,就可以盡情玩耍。

而且,即使你沒有一堆GPU,你也可以在任何有足夠內(nèi)存的計算機上技術上運行Deepseek。

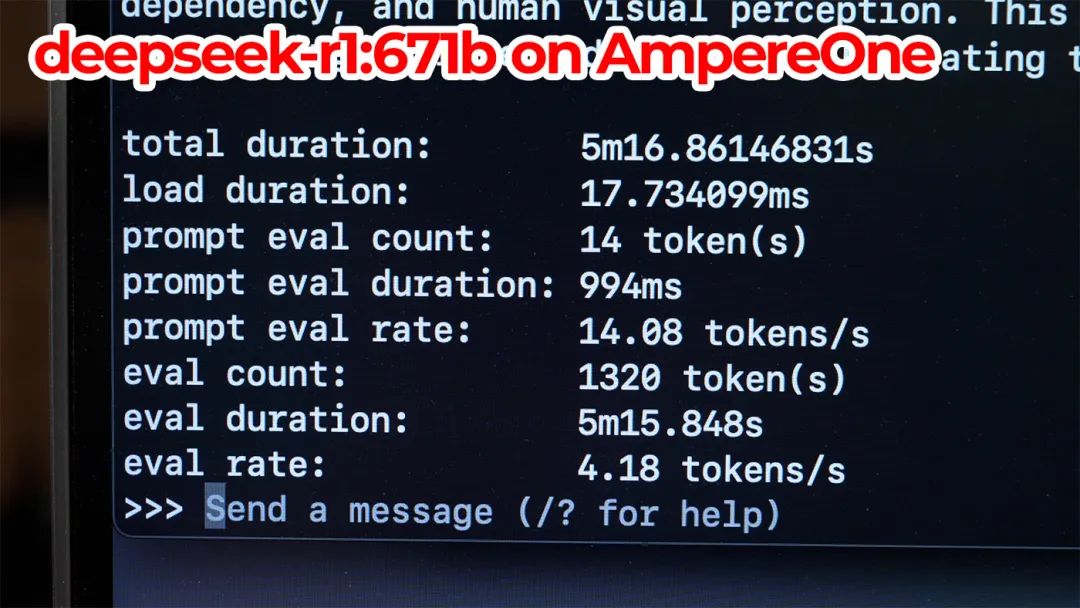

我使用Ollama在擁有512GB內(nèi)存的AmpereOne 192核服務器上測試了Deepseek R1 671B,它的運行速度僅為每秒4個標記以上。這不算特別快,但AmpereOne也不會讓你花費10萬美元!

盡管它只使用了數(shù)百瓦的功率——這確實非常令人驚訝——但一個嘈雜的機架式服務器并不適合放在每個人的客廳里。

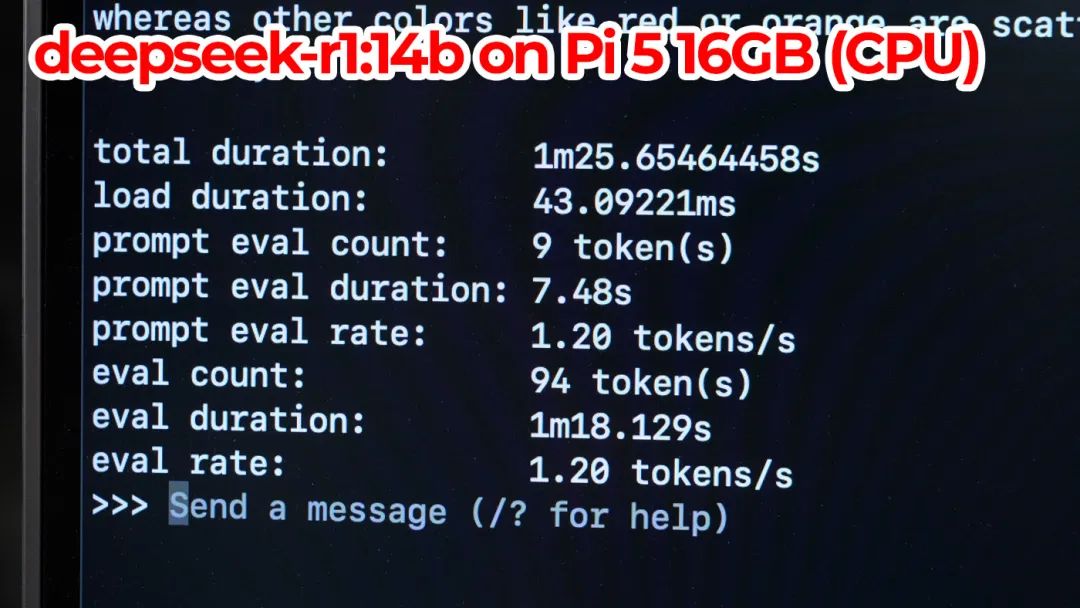

但Raspberry Pi可以。所以讓我們看看較小的14b模型在Raspberry Pi上的運行情況:

它……肯定不會贏得任何速度紀錄。我得到的運行速度大約是每秒1.2個標記。

它能運行,但如果你想要一個用于橡膠鴨調(diào)試的聊天機器人,或者給你下一個博客文章標題提供幾個想法,這并不有趣。

Raspberry Pi GPU AI

但我們可以加快很多速度。我們只需要一個外置顯卡,因為GPU及其上的VRAM比CPU和系統(tǒng)內(nèi)存更快。

我一直在用AMD W7700顯卡測試這個設置。它有16GB的高速VRAM,只要它能容納整個AI模型,它就應該快得多:

型號 | 大小 | 參數(shù) | 后臺 | ngl | 測試 | t/s |

qwen2 14B Q4_K - Medium | 8.37 GiB | 14.77 B | Vulkan | 99 | pp512 | 193.31 ± 0.35 |

qwen2 14B Q4_K - Medium | 8.37 GiB | 14.77 B | Vulkan | 99 | pp4096 | 168.01 ± 0.25 |

qwen2 14B Q4_K - Medium | 8.37 GiB | 14.77 B | Vulkan | 99 | tg128 | 24.41 ± 0.24 |

qwen2 14B Q4_K - Medium | 8.37 GiB | 14.77 B | Vulkan | 99 | pp4096+tg128 | 54.26 ± 0.92 |

llama-bench報告每秒24到54個標記,而這個GPU甚至不是針對LLM(大型語言模型)設計的——你可以更快。完整的測試結果,請查看我的ollama-benchmark倉庫:在配備AMD W7700的Pi 5上測試Deepseek R1 Qwen 14B。

結論

AI仍然處于巨大的泡沫中。Deepseek發(fā)布后,英偉達在一天內(nèi)市值蒸發(fā)了超過5000億美元。

但他們的股價仍然是2023年的8倍,而且現(xiàn)在似乎并沒有人們減少對AI的炒作。

-

樹莓派

+關注

關注

121文章

2009瀏覽量

107489 -

DeepSeek

+關注

關注

1文章

798瀏覽量

1760

發(fā)布評論請先 登錄

樹莓派6 傳聞:發(fā)布日期與規(guī)格!

樹莓派小技巧:無需鍵盤或顯示器,如何通過WiFi設置樹莓派?

用樹莓派“揪出”家里的耗電怪獸!

樹莓派“吉尼斯世界記錄”:將樹莓派的性能發(fā)揮到極致的項目!

樹莓派+Ubuntu:工業(yè)界的“絕配”如何掀起智能風暴!

夢幻組合:樹莓派+Deepseek

夢幻組合:樹莓派+Deepseek

評論