基于高斯的場景表示在新視角下會出現幾何失真,這大大降低了基于高斯的跟蹤方法的準確性。這些幾何不一致主要源于高斯基元的深度建模以及在深度融合過程中表面之間的相互干擾。為了解決這些問題,我們提出了一種基于二維高斯的增量重建策略,并結合了表面感知深度渲染機制,這顯著提高了幾何精度和多視角一致性。此外,所提出的局部地圖設計在跟蹤過程中動態隔離可見表面,減輕了全局地圖中被遮擋區域引起的錯位,同時隨著高斯密度的增加保持了計算效率。

? 文章:

GauS-SLAM: Dense RGB-D SLAM with Gaussian Surfels

? 作者:

Yongxin Su, Lin Chen, Kaiting Zhang, Zhongliang Zhao, Chenfeng Hou, Ziping Yu*

? 論文鏈接:

https://arxiv.org/abs/2505.01934

? 編譯:

INDEMIND

01本文核心內容

在過去的十年里,稠密視覺SLAM一直是計算機視覺領域的一個基礎研究方向。近期在地圖表示方面的進展越來越多地聚焦于將神經模型與傳統3D特征(如點、體素和表面元素)相結合,從而實現更靈活和精確的地圖構建。盡管有這些創新,當前的方法在諸如姿態優化、收斂困難以及持續學習過程中的災難性遺忘等方面仍面臨重大挑戰。

基于三維高斯潑濺(3D Gaussian Splatting, 3DGS) 的顯式表示方法在三維重建和稠密SLAM任務中展現了潛力。

過去的研究提出了基于高斯模型的跟蹤和建圖流程。然而,這些基于高斯的跟蹤方法常常會因姿態估計不準確和收斂問題而受到影響。相比之下,一些研究通過將跟蹤與高斯模型分離,并利用成熟的里程計方法來解決這些問題。盡管這種分離式設計提高了實時性能,但它本質上缺乏耦合系統所能提供的重建與定位之間的相互強化。

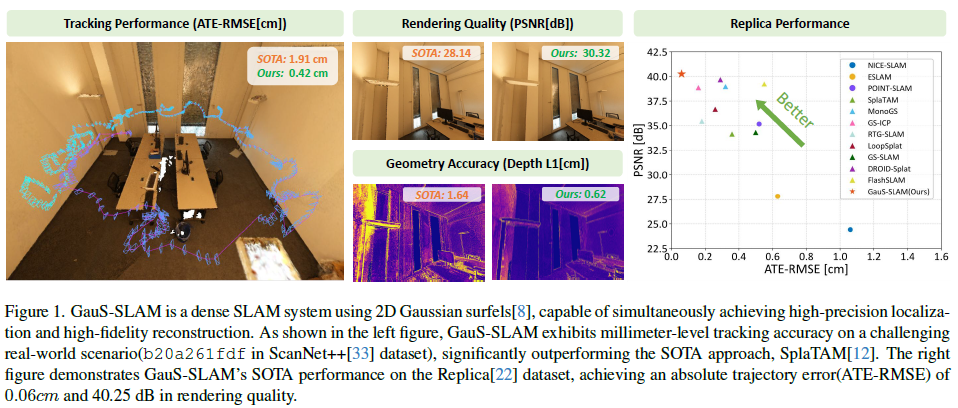

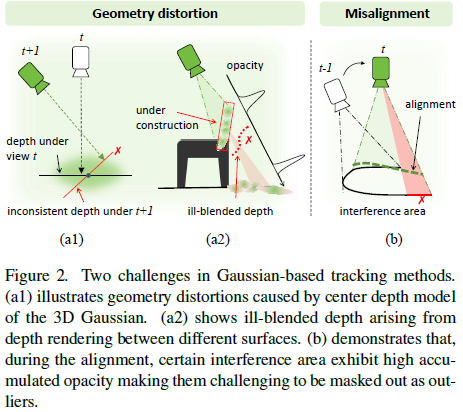

在本文中,我們重點關注在基于高斯的耦合SLAM框架中遇到的兩個關鍵挑戰,如圖2所示。

幾何失真問題

在大多數基于高斯的跟蹤方法中,相機變換是通過將觀測結果與當前視角的渲染結果對齊來估計的。在此過程中,透視引起的幾何失真會導致幀與高斯模型之間的錯位,從而降低跟蹤精度。

問題原因在于。首先,基于高斯的深度表示模型存在固有的不一致性,其中中心深度模型三維高斯基元的多視圖深度估計不一致(如圖2(a1)所示),而二維高斯曲面元素通過相交深度模型有效解決了這種不一致性。第二個原因源于不同表面在深度融合過程中的相互干擾。如圖2(a2)所示,在重建椅子靠背時,遠處深度較大的地板導致深度融合效果不佳。為解決深度融合的模糊性,我們提出了一種基于高斯曲面元素的增量重建策略,并結合表面感知深度渲染方案,顯著提高了高斯場景的幾何精度和視圖一致性。

幀與高斯模型對齊過程中的異常值剔除

正如SplaTAM所展示的,異常值消除至關重要,他們的方法通過遮蔽累積不透明度低的區域來實現。然而,如圖2(b)所示,累積不透明度高的干擾區域仍然難以遮蔽,尤其是在相機圍繞物體移動時。我們的方法限制了相機的移動范圍通過跟蹤到一張小的局部地圖,從而將這些干擾區域與全局地圖隔離開來。此外,通過定期重置局部地圖,我們確保相機跟蹤始終在高斯原語的子集內運行,避免隨著高斯數量的增加而導致跟蹤效率下降。

為此,我們提出了GauS-SLAM,這是一種稠密SLAM系統,它在緊密耦合的前端/后端框架中利用二維高斯基元和局部地圖架構,成功解決了多視角幾何失真與異常值干擾難題,在RGB-D數據集上實現了優異的定位精度和視圖合成質量。

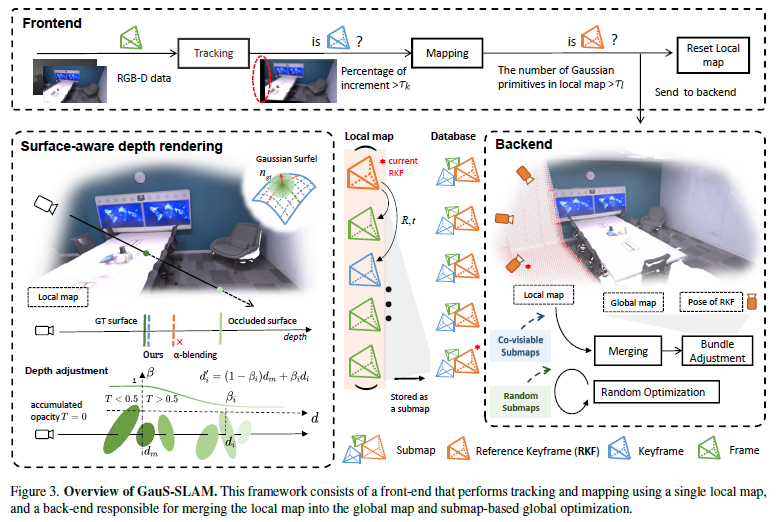

02方法架構

GauS-SLAM概述。該框架由前端和后端組成,前端使用單個局部地圖進行跟蹤和建圖,后端負責將局部地圖合并到全局地圖中,并進行基于子地圖的全局優化。

前端

在前端,所有的優化過程都在本地地圖中進行。本地地圖的第一幀作為參考關鍵幀(RKF)。在處理新幀時,前端首先執行相機跟蹤以估計其相對于RKF的位姿。然后根據新觀測到的場景比例是否超過預定義閾值,用來評估該幀是否符合關鍵幀(KF)的條件。增量式地圖構建在KF上進行。如果本地地圖中的高斯基元數量超過指定閾值,前端將幀和本地高斯地圖發送到后端,并重新初始化一個新的本地地圖以繼續跟蹤和構建地圖。此時,當前幀在新的本地地圖中被標記為新的RKF。

后端

系統的后端主要負責合并本地地圖并優化全局地圖。在接收到本地地圖后,后端將本地地圖中的幀作為子地圖存儲在數據庫中,并將本地高斯地圖整合到全局地圖中。具體來說,首先將本地地圖中的高斯基元的不透明度重置為0.01,然后根據其RKF位姿添加到全局地圖中。隨后,當前子地圖及其共視子地圖將被共同選中用于本地映射。為了確定子地圖之間的共視性,我們使用NetVLAD從每個子地圖的第一幀和最后一幀中提取的視覺特征。映射過程完成后,不透明度低于0.05的高斯基元將被修剪。這一步有效地消除了本地地圖和全局地圖之間的重疊部分,從而防止了高斯基元的持續累積。

為了減少軌跡誤差的累積,將應用束調整(BA)來優化共視子地圖中涉及的的位姿及全局地圖。在BA過程中,幀將從共視子地圖中隨機選取,并通過最小化以下公式來進行優化。

當后端不繁忙時,會從數據庫中的子地圖中隨機選擇一幀來優化全局地圖,我們將其稱為隨機優化。這一過程有效地緩解了遺忘問題,并增強了高斯場景的全局一致性。在前端和后端完成重建后,隨機優化會繼續運行一段時間以減少漂浮的高斯,確保全局地圖得到均勻優化。我們將此過程稱為最終細化,實驗表明這顯著提高了渲染質量。

03實驗結果

與SOTA基線的比較

1.跟蹤性能

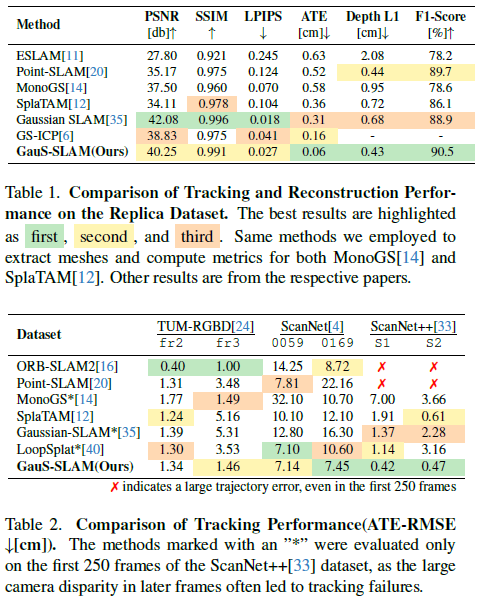

在四個數據集上所選序列的跟蹤性能比較分別在表1和表2中給出。我們提出的GauS-SLAM實現了毫米級定位精度,在Replica和ScanNet++數據集上建立了新的SOTA性能。具體而言,在Replica數據集上,我們的方法表現出色,ATE-RMSE為0.06厘米,比之前的SOTA方法GSICP提高了62.5%,比我們的基線SplaTAM提升了83%。盡管在TUM RGB-D和ScanNet數據集中存在曝光變化和運動模糊等挑戰因素,GauS-SLAM仍保持了競爭力。值得注意的是,在ScanNet的某些序列中,它甚至超過了具有閉環校正的SLAM方法。

2.渲染和重建性能

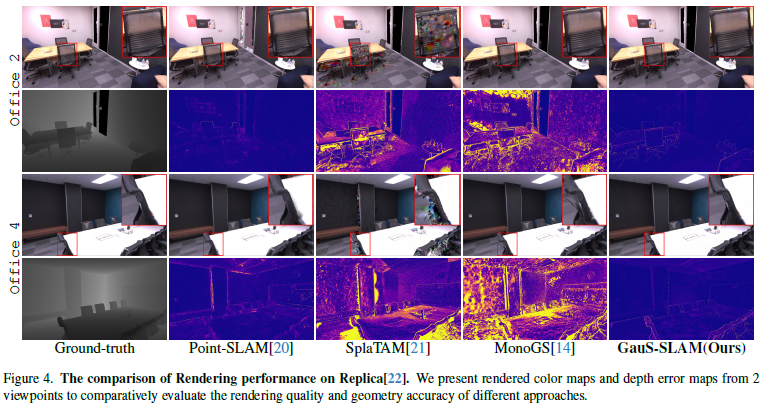

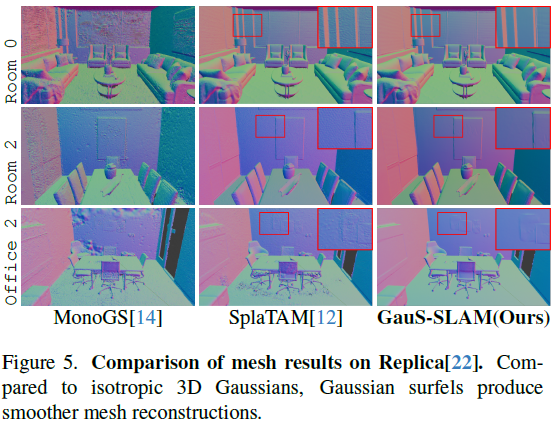

在表1展示了GauS-SLAM在Replica數據集上的渲染和重建性能。盡管2DGS的渲染質量已被實驗證明不如3DGS,但GauS-SLAM卻超越了大多數基于3D高斯的方法。值得注意的是,它在峰值信噪比(PSNR)上比我們的基線算法SplaTAM高出6分貝。這一改進歸功于我們新穎的基于局部地圖的設計,這使得高斯基元的初始化更加準確。更詳細的比較見圖4。通過采用表面感知深度渲染方法,我們的方法在深度L1和F1分數方面均優于其他基于高斯的算法。值得注意的是,各向同性高斯基元往往會產生不均勻的網格表面,如圖5所示,而2D高斯點則能產生明顯更平滑的結果。

3.幾何一致性

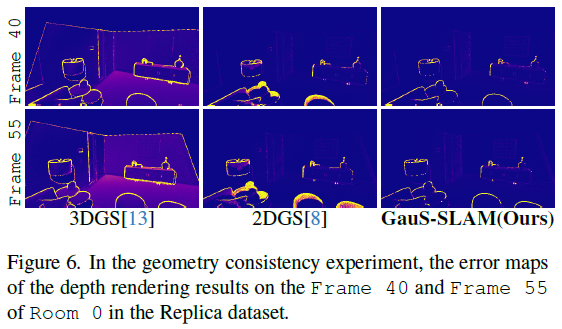

為了評估渲染方法的幾何一致性,我們設計了以下實驗。首先,我們在ReplicaRoom0數據集的前四幀上使用真實姿態對模型進行完全訓練。然后,我們計算前60個視角下渲染深度圖的平均L1誤差,將其作為幾何一致性評估的指標,該指標用于消融研究。我們在圖6中展示了第40幀和第55幀的誤差圖。雖然2DGS展示了更高的視圖一致性,但在物體邊界區域也觀察到了顯著的深度誤差。這種現象的發生是因為來自不同表面的深度值共同影響最終的渲染深度。我們提出的表面感知深度渲染策略有效地減輕了被遮擋表面對渲染結果的影響,從而增強了幾何一致性。

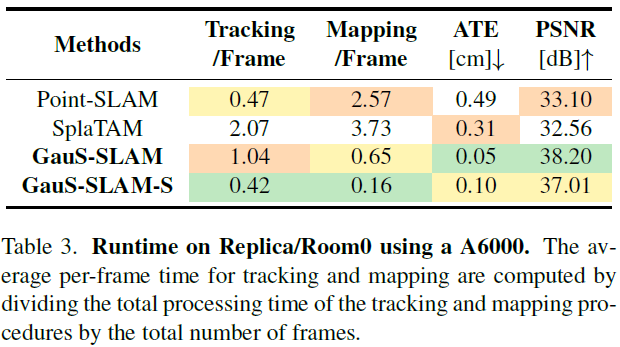

4.運行時間比較

表3展示了GauS在Room0序列(分辨率為1200×680)上跟蹤和建圖過程的平均每幀時間。與我們的基線SplaTAM相比,GauS-SLAM我們不僅在渲染質量和跟蹤精度方面取得了顯著改進,而且在時間效率上提高了三倍多。具體而言,我們開發了一個更高效的模型GauS-SLAM-S,將跟蹤迭代次數從40次減少到25次,并減少了建圖次數。迭代次數從40次減少到30次,同時將關鍵幀閾值降低至5%。

04總結

在本文中,我們探討了高斯表示法中相機跟蹤的兩個關鍵挑戰:多視圖場景中的幾何失真以及幀對模型對齊過程中的異常值剔除。為了解決這些問題,我們基于2DGS提出了一種表面感知深度渲染策略,并設計了一個融合關鍵幀和局部地圖的SLAM系統。我們的實驗結果表明,所提出的GauS-SLAM在四個基準數據集上的跟蹤和渲染性能均優于基線方法。特別是在Replica和ScanNet++數據集上,它實現了最先進的跟蹤性能,突顯了2D高斯在相機跟蹤任務中的有效性。

-

計算機

+關注

關注

19文章

7657瀏覽量

90682 -

SLAM

+關注

關注

24文章

440瀏覽量

32479 -

三維重建

+關注

關注

0文章

27瀏覽量

10080

原文標題:精度與效率的雙重突破!基于高斯的稠密視覺SLAM

文章出處:【微信號:gh_c87a2bc99401,微信公眾號:INDEMIND】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

什么是SLAM?視覺SLAM怎么實現?

激光SLAM與視覺SLAM有什么區別?

基于視覺的slam自動駕駛

單目視覺SLAM仿真系統的設計與實現

視覺SLAM的技術資料總結

基于深度學習的視覺SLAM綜述

一種基于直接法的動態稠密SLAM方案

視覺SLAM開源方案匯總 視覺SLAM設備選型

視覺SLAM是什么?視覺SLAM的工作原理 視覺SLAM框架解讀

什么是SLAM?基于3D高斯輻射場的SLAM優勢分析

MG-SLAM:融合結構化線特征優化高斯SLAM算法

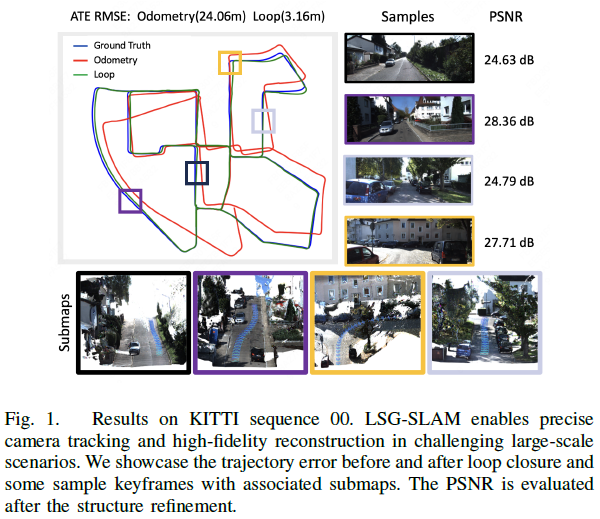

三維高斯潑濺大規模視覺SLAM系統解析

基于高斯的稠密視覺SLAM研究

基于高斯的稠密視覺SLAM研究

評論