針對基于 Diffusion 和 LLM 類別的 TTS 模型,NVIDIA Triton 和 TensorRT-LLM 方案能顯著提升推理速度。在單張 NVIDIA Ada Lovelace GPU 上,F5-TTS 模型每秒可生成長達 25 秒的音頻;Spark-TTS 在流式合成場景下,首包延遲可低至 200 余毫秒。

Text-to-Speech (TTS) 是智能語音技術的核心組成部分。隨著大模型時代的到來,TTS 模型的參數量和計算量持續增長,如何高效利用 GPU 部署 TTS 模型,構建低延遲、高吞吐的生產級應用,已成為開發者日益關注的焦點。

本文將圍繞兩款 Github 社區流行的 TTS 模型——F5-TTS[1]和 Spark-TTS[2]——詳細介紹運用NVIDIA Triton推理服務器和 TensorRT-LLM 框架實現高效部署的實踐經驗,包括部署方案的實現細節、具體使用方法及最終的推理效果等。開發者可根據不同的應用場景選擇合適的方案,并可利用性能分析工具調整配置,以最大化利用 GPU 資源。

方案介紹

當前主流的 TTS 大模型大致可分為兩類:非自回歸擴散模型和自回歸 LLM 模型。非自回歸擴散模型因其解碼速度快,易于實現高吞吐性能;而自回歸 LLM 模型則以更佳的擬人效果和對流式合成的天然支持為特點。實踐中,常有方案將兩者結合,先使用自回歸 LLM 生成語義 Token,再利用非自回歸擴散模型生成音頻細節。

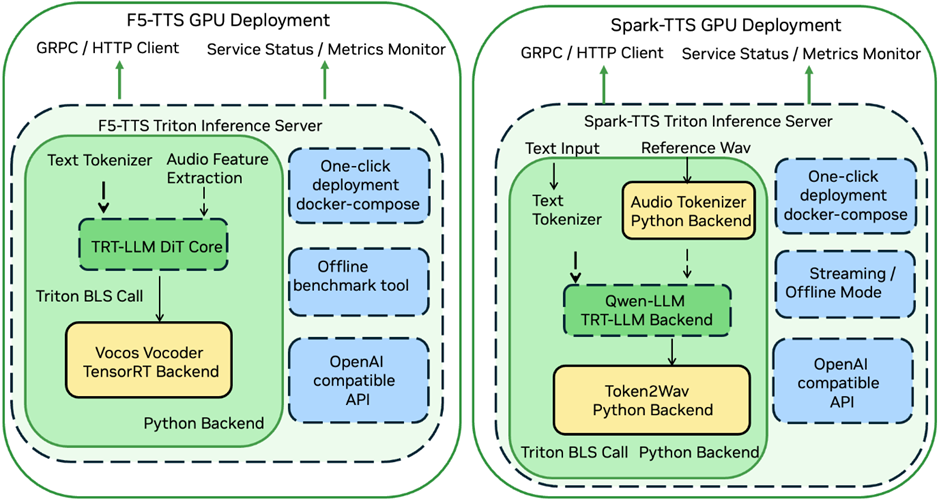

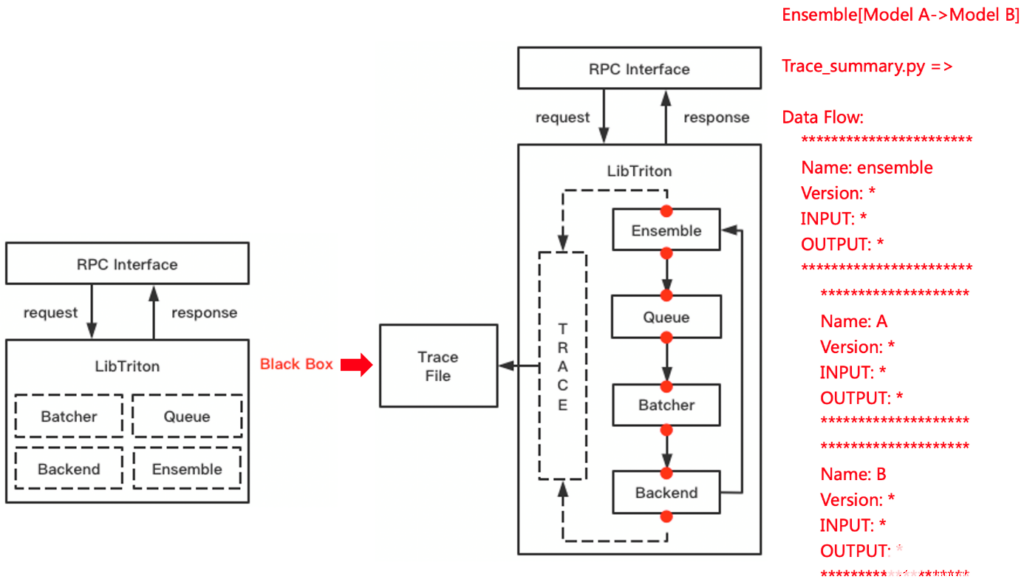

圖1: TTS 部署方案結構

F5-TTS

F5-TTS 是一款非自回歸擴散 TTS 模型,它基于 DiT (Diffusion Transformer) 和 Flow-matching 算法,移除了傳統非自回歸 TTS 模型中的 Duration 模塊,使模型能直接學習文本到語音特征的對齊。

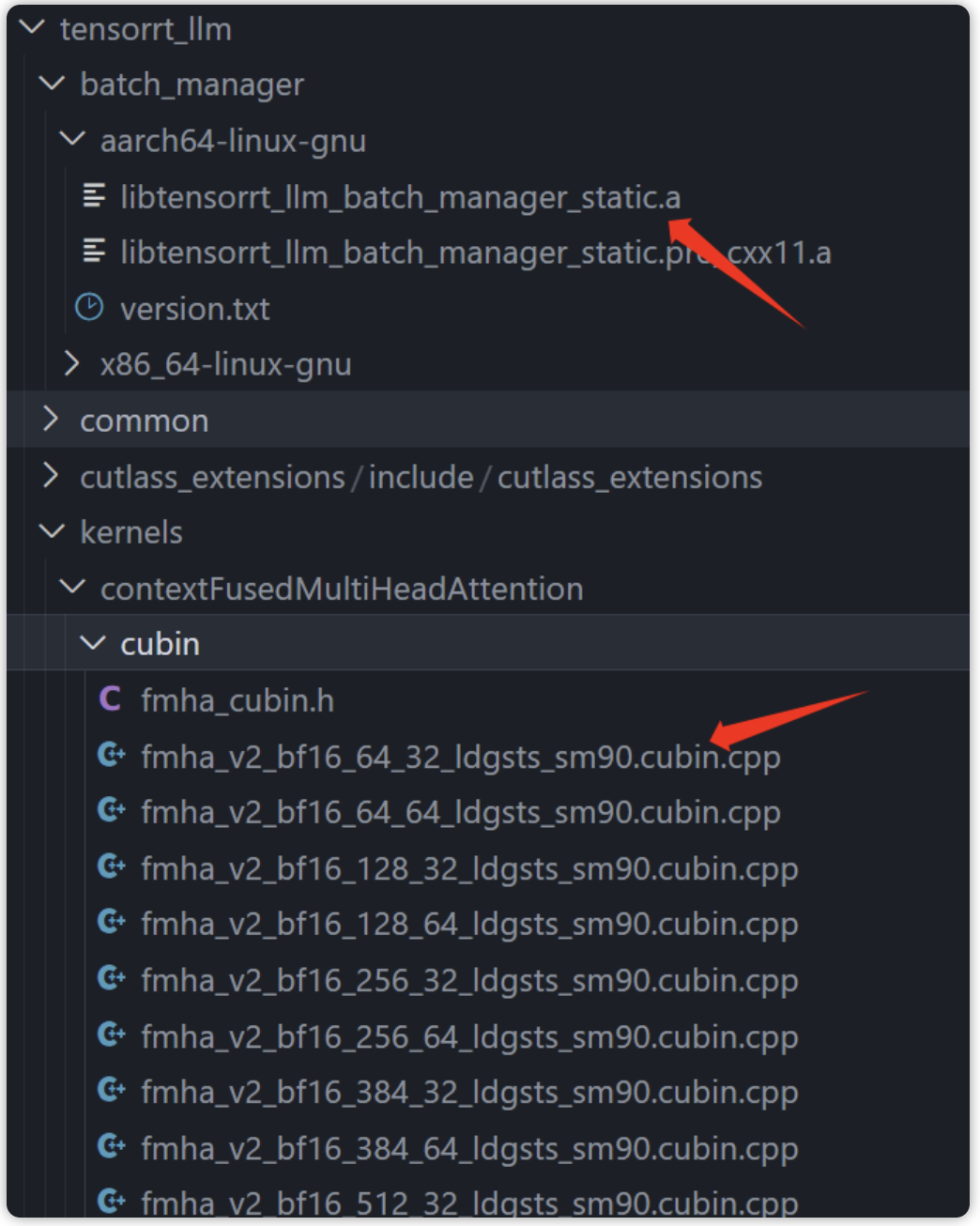

其推理加速方案利用NVIDIA TensorRT-LLM加速計算密集的 DiT 模塊,并采用 NVIDIA TensorRT 優化 Vocos 聲碼器,最后通過 NVIDIA Triton 進行服務部署。

方案地址:

https://github.com/SWivid/F5-TTS/tree/main/src/f5_tts/runtime/triton_trtllm

Spark-TTS

Spark-TTS 是一款自回歸 LLM TTS 模型,它采用經過擴詞表預訓練的 Qwen2.5-0.5B LLM 來預測 Speech Token,并基于 VAE Decoder 重構最終音頻。

其部署方案通過 NVIDIA TensorRT-LLM 加速基于 LLM 的語義 Token 預測模塊,并借助 NVIDIA Triton 串聯其余組件,支持離線合成與流式推理兩種模式。

方案地址:

https://github.com/SparkAudio/Spark-TTS/tree/main/runtime/triton_trtllm

方案性能

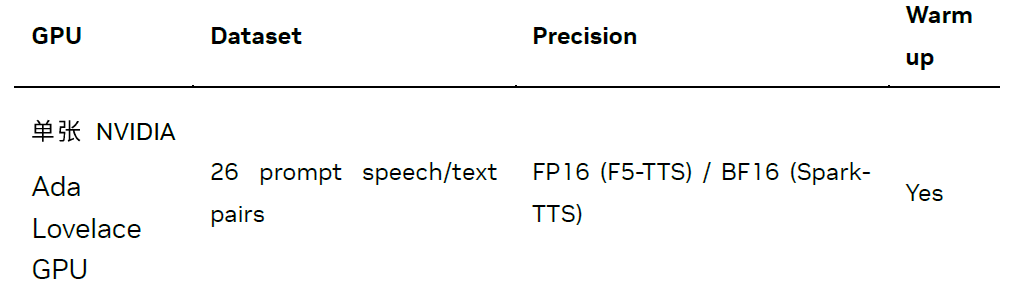

我們從WenetSpeech4TTS 測試集[3]中選取了 26 組 Prompt Audio 和 Target Text 音頻文本對,在 Zero-shot 音色克隆任務上測試了模型的推理性能。測試細節如下:

F5-TTS

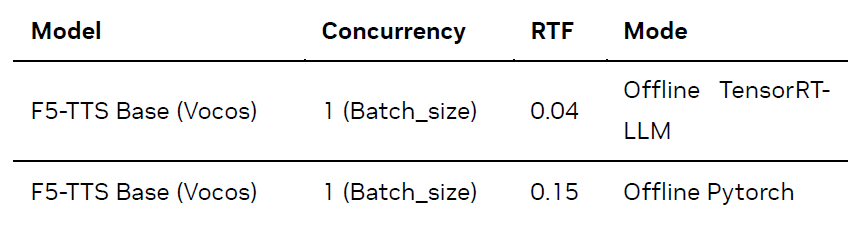

針對 F5-TTS,我們在 Offline 模式下(即直接在本地進行推理,不涉及服務部署和請求調度)測試了 TensorRT-LLM 推理方案的性能:

測試結果如下(Batch Size 固定為 1,因當前 F5-TTS 版本暫不支持 Batch 推理;Flow-matching 推理步數固定為 16):

如上表所示,與原生 PyTorch 實現(默認啟用 SDPA 加速)相比,NVIDIA TensorRT-LLM方案在 Ada Lovelace GPU 上實現了約 3.6 倍的加速,每秒可生成的音頻時長從 7 秒提升至 25 秒。

Spark-TTS

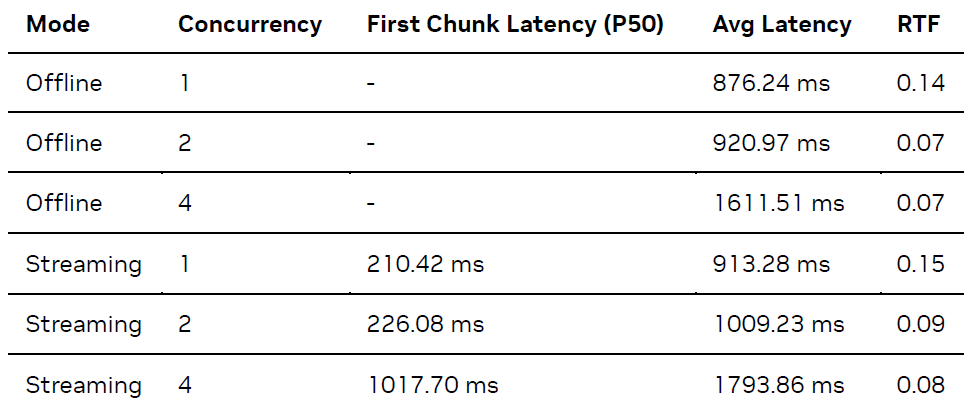

對于 Spark-TTS,我們在 Client-Server 模式下(即客戶端向服務器發送請求)測試了端到端推理服務的性能。測試結果如下(Offline 模式不統計首包延遲,Streaming 模式首包音頻長度為 1 秒):

上表結果中,LLM 模塊默認啟用了 TensorRT-LLM 的inflightbatching 模式。為模擬多路并發場景,我們基于 Python asyncio 庫實現了一個異步并發客戶端。此部署方案在 Ada Lovelace GPU 上,每秒可生成約 15 秒音頻,流式模式下的首包延遲低至 200 余毫秒。

快速上手

本節將指導您如何快速部署和測試 F5-TTS 與 Spark-TTS 模型。在此之前,建議您先克隆對應的代碼倉庫,并進入runtime/triton_trtllm目錄操作。

F5-TTS

詳細步驟請參考F5-TTS/src/f5_tts/runtime/triton_trtllm/README.md和run.sh腳本。

1. 最簡部署 (Docker Compose):這是啟動 F5-TTS 服務最快捷的方式。

# 根據您的模型選擇,例如 F5TTS_Base MODEL=F5TTS_Base docker compose up

(注意:F5TTS_v1_Base的支持可能仍在開發中,請檢查項目 README)

2. 手動部署與服務啟動:如果您需要更細致地控制部署流程,可以使用run.sh腳本分階段執行。

# 腳本參數:[model_name] # 例如,執行階段0到4,使用 F5TTS_Base 模型 bashrun.sh04F5TTS_Base

這個命令會依次執行以下主要步驟:

Stage 0:下載 F5-TTS 模型文件。

Stage 1:轉換模型權重為 TensorRT-LLM 格式并構建引擎。

Stage 2:導出 Vocos 聲碼器為 TensorRT 引擎。

Stage 3:構建 Triton 推理服務器所需的模型倉庫。

Stage 4:啟動 Triton 推理服務器。

3. 測試服務:服務啟動后,您可以使用提供的客戶端腳本進行測試。

gRPC 客戶端 (數據集 Benchmark):

# 示例命令,對應 run.sh stage 5 # 具體參數(如 num_task, dataset)請根據需求調整 python3 client_grpc.py --num-tasks 1 --huggingface-dataset yuekai/seed_tts --split-name wenetspeech4tts --log-dir ./log_f5_grpc_bench

HTTP 客戶端(單句測試):

# 示例命令,對應 run.sh stage6 # audio, reference_text, target_text 請替換為您的測試數據 python3 client_http.py--reference-audio ../../infer/examples/basic/basic_ref_en.wav --reference-text "Some call me nature, others call me mother nature." --target-text "I don't really care what you call me. I've been a silent spectator, watching species evolve, empires rise and fall. But always remember, I am mighty and enduring."

4. OfflineTensorRT-LLM基準測試:如果您希望直接測試 TensorRT-LLM 在 Offline 模式下的性能(不通過 Triton 服務),可以執行run.sh中的 Stage 7。

# 此命令對應 run.sh stage 7 # 環境變量如 F5_TTS_HF_DOWNLOAD_PATH, model, vocoder_trt_engine_path, F5_TTS_TRT_LLM_ENGINE_PATH # 通常在 run.sh 腳本頂部定義,請確保它們已正確設置或替換為實際路徑。 batch_size=1 model=F5TTS_Base# 示例模型名稱 split_name=wenetspeech4tts backend_type=trt log_dir=./log_benchmark_batch_size_${batch_size}_${split_name}_${backend_type} # 確保以下路徑變量已設置,或直接替換 # F5_TTS_HF_DOWNLOAD_PATH=./F5-TTS (示例) # F5_TTS_TRT_LLM_ENGINE_PATH=./f5_trt_llm_engine (示例) # vocoder_trt_engine_path=vocos_vocoder.plan (示例) rm-r$log_dir2>/dev/null # ln -s ... # 符號鏈接通常在 run.sh 中處理,按需創建 torchrun --nproc_per_node=1 benchmark.py --output-dir$log_dir --batch-size$batch_size --enable-warmup --split-name$split_name --model-path$F5_TTS_HF_DOWNLOAD_PATH/$model/model_1200000.pt --vocab-file$F5_TTS_HF_DOWNLOAD_PATH/$model/vocab.txt --vocoder-trt-engine-path$vocoder_trt_engine_path --backend-type$backend_type --tllm-model-dir$F5_TTS_TRT_LLM_ENGINE_PATH||exit1

Spark-TTS

詳細步驟請參考Spark-TTS/runtime/triton_trtllm/README.md和run.sh腳本。

1. 最簡部署 (Docker Compose):

dockercompose up

2. 手動部署與服務啟動:使用run.sh腳本進行分階段部署。

#腳本參數:[service_type] #service_type 可為'streaming'或'offline',影響模型倉庫配置 #例如,執行階段0到3,部署為 offline 服務 bash run.sh 0 3 offline

此命令會執行:

Stage 0:下載 Spark-TTS 模型。

Stage 1:轉換模型權重并構建 TensorRT 引擎。

Stage 2:根據指定的 service_type (streaming/offline) 創建 Triton 模型倉庫。

Stage 3:啟動 Triton 推理服務器。

3. 測試服務 (Client-Server 模式):服務啟動后,可使用客戶端腳本進行測試。

gRPC 客戶端 (數據集 Benchmark):此命令對應run.sh中的 stage 4。

# 示例:測試 offline 模式,并發數為2

# bash run.sh 4 4 offline

# 其核心命令如下:

num_task=2

mode=offline# 或 streaming

python3 client_grpc.py

--server-addr localhost

--model-name spark_tts

--num-tasks$num_task

--mode$mode

--huggingface-dataset yuekai/seed_tts

--split-name wenetspeech4tts

--log-dir ./log_concurrent_tasks_${num_task}_${mode}

單句測試客戶端: 此命令對應run.sh中的 stage 5。

Streaming 模式 (gRPC):

# bash run.sh55streaming # 其核心命令如下: python client_grpc.py --server-addr localhost --reference-audio ../../example/prompt_audio.wav --reference-text $prompt_audio_transcript --target-text $target_audio_text --model-name spark_tts --chunk-overlap-duration 0.1 --mode streaming

Offline 模式 (HTTP):

# bash run.sh 5 5 offline # 其核心命令如下: python client_http.py --reference-audio ../../example/prompt_audio.wav --reference-text$prompt_audio_transcript --target-text$target_audio_text --model-name spark_tts

兼容 OpenAI 格式的 API

許多開源對話項目 (如 OpenWebUI)[4]已支持 OpenAI 格式的 TTS API。為方便開發者集成,我們提供了兼容 OpenAI API 的服務,用法如下:

git clone https://github.com/yuekaizhang/Triton-OpenAI-Speech.git

cdTriton-OpenAI-Speech

docker compose up

curl$OPENAI_API_BASE/audio/speech

-H"Content-Type: application/json"

-d '{

"model":"spark_tts",

"input":$target_audio_text,

"voice":"leijun",

"response_format":"pcm"

}'|

sox-t raw-r16000-e signed-integer-b16-c1-output3_from_pcm.wav

總結

無論是 F5-TTS 或是 Spark-TTS,都可以看到 NVIDIA Triton 推理服務器和 TensorRT-LLM 框架可以大幅提升 TTS 模型的推理速度,也方便開發者進行模型部署。我們將持續增加對更多語音多模態模型的部署支持。

除了TTS,NVIDIA 技術團隊也為多種社區流行的多模態模型開發了最佳實踐,詳細方案介紹以及教程,請參閱 mair-hub[5]項目。

近期我們還將舉辦一場和該主題相關的在線研討會,歡迎大家報名參加,共同交流和探討。

作者

張悅鎧

張悅鎧是 NVIDIA 解決方案架構師,碩士畢業于約翰霍普金斯大學,導師為 Shinji Watanabe 教授,主要研究方向為語音識別。NVIDIA 中文語音識別解決方案主要開發者,對基于 GPU 的語音識別服務部署及優化有豐富經驗。

-

NVIDIA

+關注

關注

14文章

5274瀏覽量

105911 -

gpu

+關注

關注

28文章

4921瀏覽量

130787 -

模型

+關注

關注

1文章

3500瀏覽量

50105 -

LLM

+關注

關注

1文章

322瀏覽量

710

原文標題:使用 NVIDIA Triton 和 TensorRT-LLM 部署 TTS 應用的最佳實踐

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA Triton助力騰訊PCG加速在線推理

基于NVIDIA Triton的AI模型高效部署實踐

周四研討會預告 | 注冊報名 NVIDIA AI Inference Day - 大模型推理線上研討會

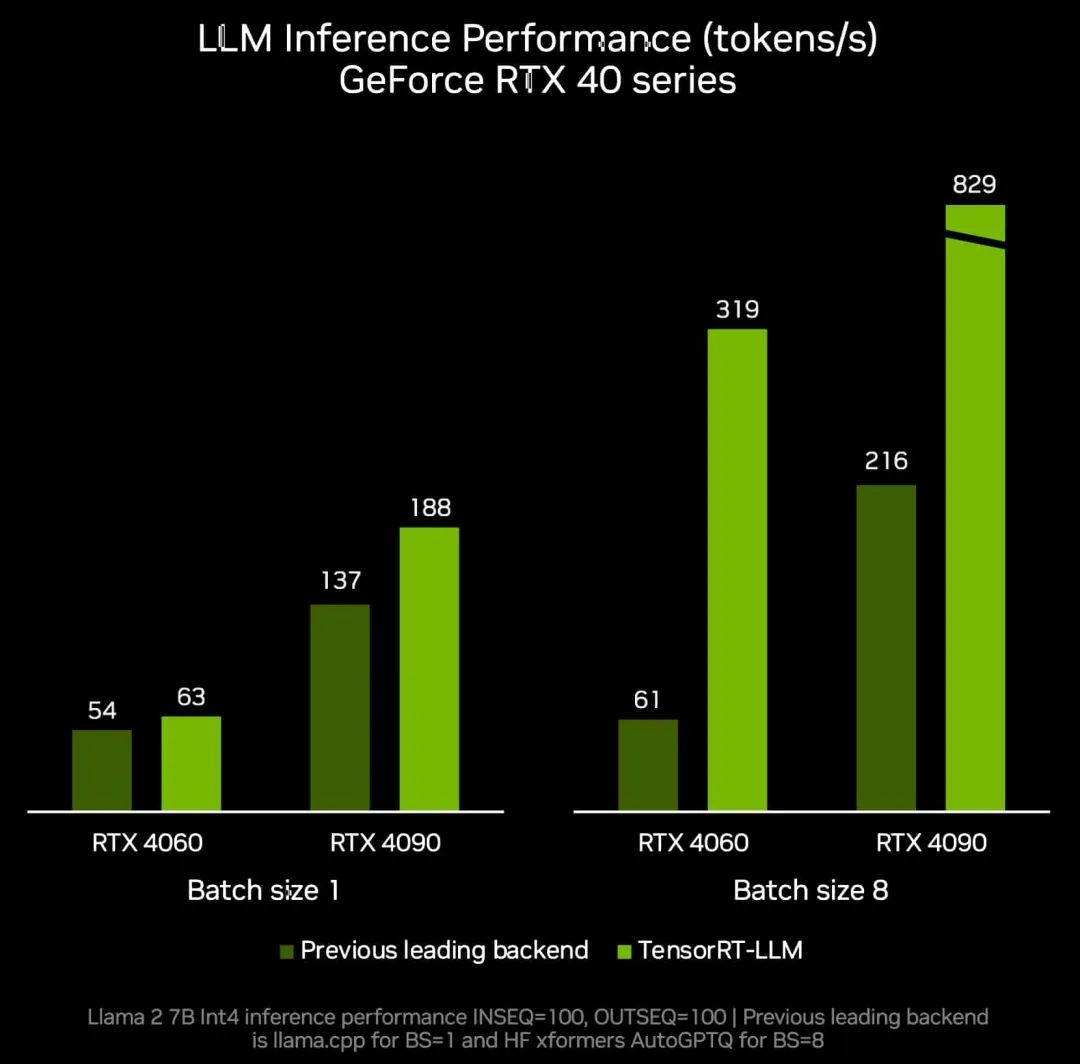

現已公開發布!歡迎使用 NVIDIA TensorRT-LLM 優化大語言模型推理

點亮未來:TensorRT-LLM 更新加速 AI 推理性能,支持在 RTX 驅動的 Windows PC 上運行新模型

如何在 NVIDIA TensorRT-LLM 中支持 Qwen 模型

利用NVIDIA產品技術組合提升用戶體驗

NVIDIA加速微軟最新的Phi-3 Mini開源語言模型

魔搭社區借助NVIDIA TensorRT-LLM提升LLM推理效率

NVIDIA Nemotron-4 340B模型幫助開發者生成合成訓練數據

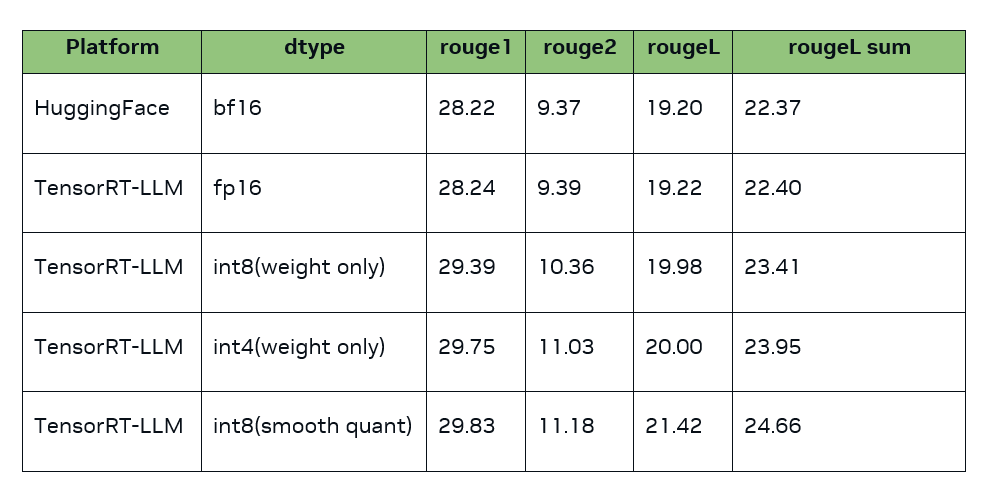

TensorRT-LLM低精度推理優化

NVIDIA TensorRT-LLM Roadmap現已在GitHub上公開發布

解鎖NVIDIA TensorRT-LLM的卓越性能

在NVIDIA TensorRT-LLM中啟用ReDrafter的一些變化

使用NVIDIA Triton和TensorRT-LLM部署TTS應用的最佳實踐

使用NVIDIA Triton和TensorRT-LLM部署TTS應用的最佳實踐

評論