【導讀】從立體圖像或視頻幀中進行遮擋物的檢測,對許多計算機視覺應用而言都是非常重要的。在本文中,我們利用卷積神經網絡來解決傳統交錯的計算框架中遮擋物檢測問題。

我們提出一個對稱的卷積神經網絡結構 (SymmNet),它能夠直接利用圖像對的信息,而無需提前估計視覺差異或動作的影響。我們所提出的網絡是一種左右的對稱結構,在學習雙目下的遮擋問題的同時,旨在共同改善檢測結果。通過綜合的實驗分析來驗證我們模型的有效性:實驗結果表明,在立體圖像和運動遮擋問題中,我們的模型能夠取得當前最先進的檢測表現。

▌前言

對多視角圖像或視頻序列數據的遮擋或無遮擋區域的定位問題,一直以來是許多計算機視覺任務中非常感興趣的研究方向。解決這個問題我們需要考慮與其最相關的兩個任務:立體圖像計算和視頻光流估計。

圖像中被遮擋的像素是違反了圖像內部的對應約束,從而導致像素匹配的模糊性。當前最先進的處理立體圖像和光流方法都是基于對遮擋物的檢測:通過在視差和運動計算過程中排除遮擋物的像素,或通過修復這些被遮擋的區域。因此,遮擋物檢測也被應用于幫助改善諸如動作識別、目標追蹤和 3D 重建等任務的表現。

現有的大多數方法都是視差或光流估計來解決遮擋物的檢測問題。最簡單也是最廣泛使用的方法是左右交叉檢查 (left-right-cross-checking,LRC),這種方法直接通過預先計算的視差結果來推斷遮擋的位置。然而,LRC 方法中未引入遮擋物的先驗知識,這將無法精確地計算出視差結果,影響后續的檢測結果。其他一些研究提出通過交替改進視差和運動準確性,來迭代地改善遮擋物的映射圖。總的說來,先前研究中對遮擋物的檢測依賴于預先計算的視差或光流估計,這種方法容易受到噪聲、低或重復的紋理特征的理影響,具有很大局限性。

這促使我們探索一種檢測立體圖像或視頻連續幀中遮擋物的解決方案。在本文中,我們主要關注的是立體圖像的遮擋物檢測問題。隨著卷積神經網絡 (CNN) 在單目深度和相機定位方面的成功應用,我們利用 CNN 結構來解決遮擋物檢測中的視差估計問題。我們將遮擋檢測視為二元分類問題,并提出一種對稱卷積網絡 (SymmNet) 作為分類器。SymmNet是一種利用雙目圖像信息的沙漏架構 (hourglass architecture)。利用左右對稱的網絡結構,我們能夠推斷出雙眼條件下遮擋物的情況,從而同時同步改善左右的檢測結構。

本文的貢獻主要包含以下三個方面:

這項工作是第一個無需利用視差和運動估計的先驗知識,而直接對遮擋物進行檢測的研究。

我們提出了一個對稱卷積神經網絡結構 SymmNet,它能直接以圖像對作為輸入并進行協同工作。

我們進行了綜合的實驗以驗證我們的模型設計,實驗結果表明該方法在立體圖像和運動遮擋的檢測方面有著非常有前景的表現。

▌模型結構

我們提出了一種對稱結構的卷積神經網絡 (SymmNet),通過左右對稱結構來預測堆疊雙目圖像流的遮擋問題。下圖1說明了我們所提出的網絡的簡要架構,我們遵循 FlowNet 的結構來構建一個完整的卷積網絡,其中包含一個收縮部分 (contractive) 和擴展部分 (expanding),以跳躍連接的方式連接這兩部分。

圖1 SymmNet 網絡結構。中間層和殘差連接在圖中省略。網絡以雙目圖像對作為輸入,輸出的是雙目圖像中的遮擋物。沿著特征通道,網絡整體呈一種左右對稱的結構。

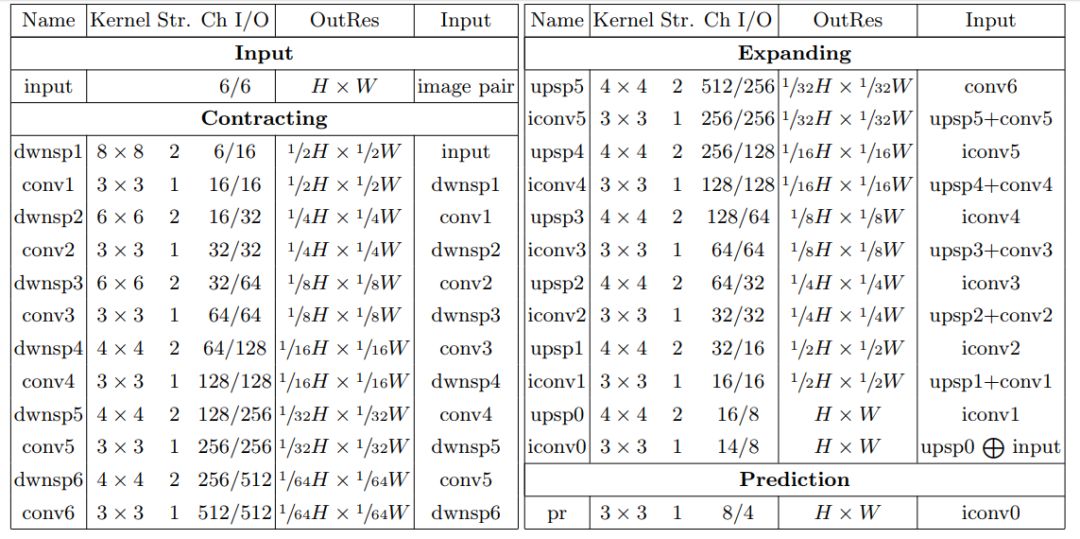

下表1中列出了詳細的逐層定義。由于遮擋物檢測可能依賴于來自廣闊視野的信息,因此網絡的收縮模塊通過特征子采樣來編碼大型結構。它包含6個步長為2下采樣層來逐步增加接收域,并且將特征映射圖的空間大小縮小64倍。為了在擴展模塊中獲得原始輸入分辨率的逐像素預測,我們使用6個反卷積層進行上采樣特征。在每個下采樣或上采樣層后都連接一個卷積層來平滑結果輸出。為了保留更多的局部細粒度信息,低層次的特征通過跳躍連接進行解碼。每層后采用 ReLU 作為層激活函數,以更好應對梯度消失問題。

表1 SymmNet 結構參數。除預測層 pr,其余每一層后都接上一個ReLU 函數,而 pr 層后激活函數采用的是 softmax 函數以輸出檢測概率。表格的排列方式是從上到下,從左到右的,其中 + 代表加法運算,⊕ 代表的是跳躍連接中的串聯操作。

與 FlowNet 結構不同,我們的 SymmNet 模型采取了幾種網絡修剪策略以提高網絡的計算效率。首先,我們對特征通道的數量進行壓縮。第一層有16個過濾器。每次對特征映射圖的空間大小進行下采樣時,網絡的特征長度都將翻倍,并在收縮模塊的最后一層達到最大值,該層包含512個過濾器。然后,我們更換了跳躍連接中的連接方式,并相應地減小擴展模塊的特征長度以匹配收縮模塊。另一個修改是我們的網絡在擴展模塊后又包含一個額外上采樣模塊,以獲得全分辨率的輸出。由上采樣到全分辨率,原始圖像的特征將與最后一層的卷積層特征相連接。這是出于圖像低層次特征可以幫助定位遮擋物的考慮而做的處理。

▌實驗

我們在 SceneFlow 數據集上訓練我們的模型,該數據集由合成序列渲染后的立體圖像構成。該數據集的規模足夠大,共包含35454對訓練數據和和4370 對測試數據,以此訓練的模型不會產生過擬合現象。此外,該數據集還提供了密集而完美的地面實況差異的兩種視圖,可用于生成雙目圖像中真實的遮擋物。我們首先進行對比實驗以驗證我們模型的有效性,接著在 SceneFlow 和 Middleburry 數據集上對比其他方法。然后,我們在 MPI Sintel 數據集上測試模型學習運動遮擋物的容量。最終,我們還測試了我們結構的效率,包括運行的時間和內存使用。

值得注意的是,我們采用三個在遮擋物檢測任務中廣泛使用的評估指標,包括精度值 P,回召值 R 以及 F 分數。在預測遮擋物時,我們將閾值設置為0.5。

▌結構分析

為了驗證模型設計的有效性,我們在 SceneFlow 數據集上測試了SymmNet 及其一些變體。在圖2我們提供了示例結果,并在圖4中可視化 PR 曲線結果。

圖2 不同結構變體的示例結果。MonoNet (L/R) 的第一排是MonoNetL 的結果,而第二行是 MonoNetR 的結果。MonoNetL中的粉色箭頭指向圖像邊緣發生的假遮擋現象,而 MonoNetR中的箭頭指向錯誤的遮擋物形狀。

圖3 PR曲線。在 PR 曲線上標注了最大 Fscore。曲線越靠近右上角代表該模型的表現更好。因此我們可以看到 SymmNet 的表現由于其他兩種變體結構。

我們提出的 SymmNet 模型能夠直接對輸入圖像的遮擋進行建模,無需基于視差計算的先驗知識。從結果上看,我們的模型明顯優于其他變體結構,驗證了 SymmNet 模型結構的有效性。

▌整體性能

我們在 SceneFlow 和 Middlebury 數據集上驗證 SymmNet 模型的整體性能,并其他兩種檢測器進行比較。定性結果及定量結果分別如下圖4,圖5及表2所示。

圖4 SceneFlow 數據集的定性結果。真正的正樣本 (true positive) 估計用青色標記,假陰性 (false negative) 用洋紅色標記,假陽性 (false positive) 用黃色標記。綠色框標記錯誤發生在第一行中傾斜平面上以及第二行中無紋理區域。

圖5. Middlebury 數據集的定性結果。真正的正樣本 (true positive) 估計用青色標記,假陰性 (false negative) 用洋紅色標記,假陽性 (false positive) 用黃色標記。

表2 定量估計結果。所有的評估結果中,值越高表示模型性能越好,在這里我們用粗體來突出顯示最佳的表現。

▌運動遮擋檢測

盡管 SymmNet 模型的設計是用于立體圖像中遮擋物的檢測,但它也可以應用于以兩個連續幀作為輸入的運動遮擋檢測任務。我們在 MPI Sintel 數據集上驗證并展示模型的表現。實驗結果如下圖6所示:在運動遮擋檢測任務中,即使真實的遮擋區域比立體圖像中的區域小得多,我們的模型仍然可以做得很好的預測。

圖6 模型在 MPI 數據集上的定性結果。從左到右依次是:兩個輸入幀的平均圖像;真實的遮擋物圖像;我們模型預測的遮擋物圖像。

▌運行時間和內存需求

我們在單個 NVIDIA Tesla M40 GPU 上,測試以 PyTorch 框架實現的運行時間。結果表明,我們的模型能夠在 SceneFlow 數據集的訓練時間只需兩天。在預測一張 540×960 的圖像對時,模型需要 0.07s 的運行時間和 651M 的顯卡內存。總的說來,對時間和內存的低要求使我們的模型有很強的可用性,并能應用于其他任務的預處理模塊,如目標追蹤,人體姿勢估計和行為識別等。

▌總結

我們提出了一種名為 SymmNet 的 CNN 模型來檢測立體圖像或視頻序列中的遮擋。與傳統方法通過預先計算的視差或光流估計結果來推斷被遮擋的像素不同,我們的模型能夠直接從原始圖像中進行學習。SymmNet 模型是一種左右對稱的結構,以協作的方式提取雙目圖像信息并學習圖像中的遮擋。實驗結果驗證了我們模型具有良好的立體和運動遮擋檢測的能力。

-

神經網絡

+關注

關注

42文章

4785瀏覽量

101269 -

圖像

+關注

關注

2文章

1089瀏覽量

40599 -

計算機視覺

+關注

關注

8文章

1701瀏覽量

46168

原文標題:學術 | 據說以后在探頭下面用帽子擋臉沒用了:用于遮擋物檢測的對稱卷積神經網絡——SymmNet

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

利用卷積神經網絡來解決傳統交錯的計算框架中遮擋物檢測問題

利用卷積神經網絡來解決傳統交錯的計算框架中遮擋物檢測問題

評論