本文是對Keras的創(chuàng)造者、谷歌AI研究員Francois Chollet的專訪,內(nèi)容包括Fran?ois從何開始對深度學(xué)習(xí)感興趣、Keras的創(chuàng)建背后的動機,F(xiàn)ran?ois對TensorFlow等其他框架的看法、給初學(xué)者的建議等。

本文作者Sanyam Bhutani專訪了一系列他心目中的“AI英雄”,包括GAN的創(chuàng)造者Ian Goodfellow、最年輕的Kaggle Grandmasters等等。

這次,他的采訪對象是機器學(xué)習(xí)社區(qū)最偉大的貢獻者之一、Keras的創(chuàng)造者,也是最好的深度學(xué)習(xí)書籍的作者之一:Francois Chollet。

Francois Chollet目前是Google AI的研究員,也是Keras開發(fā)的核心人物。

Francois Chollet

Sanyam Bhutani:你好,F(xiàn)ran?ois,非常感謝你抽出時間參加這次采訪。能和你談話真是我的榮幸。

Francois Chollet:謝謝你邀請我,我很樂意回答你的問題。

問:你現(xiàn)在在 Google AI Research工作,并且你創(chuàng)建了最受歡迎的深度學(xué)習(xí)庫之一。你能告訴我們你是怎么開始的嗎?是什么讓你對深度學(xué)習(xí)開始感興趣?

Francois Chollet:我研究人工智能已經(jīng)有很長一段時間了,但在我還是學(xué)生時,我對學(xué)習(xí)視覺感知的層疊、模塊化、層次化表示的這些具體問題很感興趣。當(dāng)時,Jeff Hawkins寫了一本相當(dāng)發(fā)人深省的書(書名是:On Intelligence),內(nèi)容包括大腦中的分層信息處理,MIT的一些人一直在研究受人類視覺皮層啟發(fā)的視覺感知層級模型,就是HMAX模型家族。

這些觀點給我的印象非常深刻,并且我認(rèn)為是正確的,所以我開始研究自己的算法。那時我沒有使用神經(jīng)網(wǎng)絡(luò),我開始使用基于矩陣分解的堆疊特征學(xué)習(xí)器。我想要學(xué)習(xí)的不僅僅是視覺特征的層次結(jié)構(gòu),而是視覺-時間特征的層次結(jié)構(gòu),我想找到視覺特征與時間的相關(guān)性,而不僅僅是與空間的相關(guān)性。2012年年中,當(dāng)我在東京大學(xué)做研究時,我獲得了一些初步的成功——我將我的設(shè)置應(yīng)用到無監(jiān)督的few-shot手勢識別中,并取得了一些非常好的結(jié)果。幾個月后,Hinton的實驗室贏得了ImageNet競賽冠軍(我在東京大學(xué)的實驗室也參加了這個競賽),他們在GPU上訓(xùn)練深度卷積神經(jīng)網(wǎng)絡(luò)(deep convnet),因此我對這種方法很感興趣。

這是人們現(xiàn)在已經(jīng)忽略的東西,但是用反向傳播訓(xùn)練的端到端可微模型只是學(xué)習(xí)感知的模塊化層次表示問題的一種解決方案,還有其他途徑尚未得到探索。這個問題本身只是AI領(lǐng)域的眾多問題之一。

問:你能分享一下創(chuàng)建Keras的最初動機嗎?你有沒有想到它會變得如此受歡迎?

Fran?ois Chollet:沒有,我絕對沒想到它會變得如此之大。我最初是希望它能在當(dāng)時使用深度學(xué)習(xí)的一小群人中引起一些轟動,那是在2015年3月(做深度學(xué)習(xí)的可能有幾千人),但當(dāng)時沒有人知道深度學(xué)習(xí)能在接下來的幾年里變得如此熱門。

我開始創(chuàng)建Keras是為了我自己。我當(dāng)時在業(yè)余進行自然語言處理的研究,希望找到一個好的工具來使用RNNs。LSTM算法在當(dāng)時基本上還不為人所知,但隨著神經(jīng)網(wǎng)絡(luò)在機器學(xué)習(xí)領(lǐng)域日益突出,一些人開始研究LSTM在自然語言處理中的應(yīng)用。據(jù)我所知,當(dāng)時LSTM還沒有可重用的開源實現(xiàn),所以我用Theano做了一個。后來我做了更多的層。它就變成了一個框架。我把它命名為Keras,并且開源了它,一切是從那里發(fā)展起來的。

使它與眾不同的原因是:與其他框架相比,它非常易于得到,也易于使用;它支持RNNs和convnets(我想它是第一個支持convnets的框架),并且它允許你通過Python代碼而不是通過配置文件來定義模型(在這之前,通過配置文件來定義模型是最流行的方法,特別是對于Caffe和PyLearn2)。

問:你對Keras成為TensorFlow 2.0的默認(rèn)API有何看法?你為什么覺得這是有必要的?

Francois Chollet:TensorFlow是一個非常強大的框架,但是它長期以來一直受到可用性問題的困擾,特別是它是一個龐大的、有時令人困惑的API。TensorFlow 2在很大程度上解決了這些問題。TensorFlow 2改進的核心是兩件事:eager execution和Keras API。 Eager execution為TensorFlow帶來了一種命令式的編碼風(fēng)格,使其更直觀、更易于調(diào)試。Keras API將使用模式整合到一個連貫的、真正高效且令人愉快的workflows中,適合于從研究到應(yīng)用程序開發(fā)到部署的各種用戶配置文件。我對即將發(fā)布的內(nèi)容感到非常興奮。你應(yīng)該很快就會看到了!

問:除了TF和Keras之外,你認(rèn)為還有哪些框架看起來很有前景?

Francois Chollet:我認(rèn)為MXNet和它的高級APIGluon很有前景,它們都受到Keras和Chainer的啟發(fā)。MXNet利用了許多與TensorFlow 2一致的想法—— eager execution和symbolic execution的混合。與TensorFlow一樣,它是為數(shù)不多的具有實際生產(chǎn)級和可擴展性的框架。MXNet背后有很多工程力量——亞馬遜有一個龐大的團隊在做這件事。這是一個嚴(yán)肅的項目,有一些非常好的想法和可靠的執(zhí)行力。

問:對于那些懷著有朝一日在谷歌工作的夢想而對深度學(xué)習(xí)感興趣的讀者和初學(xué)者,你有什么建議?

Fran?ois Chollet:我認(rèn)為你不應(yīng)該把你的夢想和外在的身份標(biāo)志聯(lián)系在一起,比如為一家知名公司工作,或者賺一筆錢,或者獲得某個特別的title。要弄清楚你生命的價值是什么,然后堅持你的價值觀。永遠不必為某一個決定后悔。

問:你能告訴我們你生命里的一天是什么樣的嗎?

Francois Chollet:不是很吸引人,主要是review代碼,與人交談,寫設(shè)計文檔,等等。我仍然編寫大量的代碼。

問:人們普遍認(rèn)為,要在深度學(xué)習(xí)中取得重大成果,需要有大量資源。你認(rèn)為一個人如果沒有谷歌研究員可能擁有的資源,能夠?qū)@個領(lǐng)域做出重大貢獻嗎?

Francois Chollet:當(dāng)然,有一些類型的問題需要行業(yè)規(guī)模的訓(xùn)練資源。但是,有很多問題只需要有一個GPU,就能取得重大進展。目前阻礙AI研究的主要原因不是缺乏硬件,而是缺乏多樣化的思維。如果你的資源有限,那么不要把時間花在擔(dān)心GPU上,而是擔(dān)心你是否在處理正確的問題,是否在提出正確的問題。

問:你一直是“AI倫理”的倡導(dǎo)者。你能分享一些在構(gòu)建“AI產(chǎn)品”時必須注意的方面嗎?

Francois Chollet:其他人對機器學(xué)習(xí)的倫理問題的討論比我好得多。比如Kate Crawford,還有Meredith Whittaker。我想對此感興趣的人都應(yīng)該看看他們的作品。

問:你覺得機器學(xué)習(xí)被過度炒作了嗎?

Fran?ois Chollet:在某種程度上,的確是。我認(rèn)為機器學(xué)習(xí)在某種程度上既被高估了,也被低估了。一方面,人們往往過度高估了當(dāng)前機器學(xué)習(xí)系統(tǒng)的智能和泛化能力,將機器學(xué)習(xí)視為一根魔杖,遇到任意問題只要揮揮魔杖,問題就能消失。當(dāng)然,這在很大程度上是錯誤的,我們的算法中很少有真正的智能,它們的應(yīng)用范圍非常狹窄。

但與此同時,大多數(shù)人仍然低估了今天的相對粗糙的系統(tǒng)所能取得的成就,如果我們系統(tǒng)地將它們應(yīng)用于它們可能解決的每一個問題的話。在某種程度上,機器學(xué)習(xí)是我們這個時代的蒸汽動力:這是一種非常基本的機制,但如果大規(guī)模使用,它仍有可能深刻地改變世界。

問:你認(rèn)為博士或碩士學(xué)位的專業(yè)水平是必要的嗎,還是一個人可以在不成為“專家”的情況下對深度學(xué)習(xí)領(lǐng)域做出貢獻?

Francois Chollet:當(dāng)今在深度學(xué)習(xí)領(lǐng)域很多重要貢獻的人都沒有博士學(xué)位。要想對一個領(lǐng)域做出有意義的貢獻,無論是系統(tǒng)開發(fā)還是新研究,你必須要有一定水平的專業(yè)知識。但很明顯,你不需要通過博士課程就能獲得專業(yè)知識,而擁有博士學(xué)位并不能保證你在任何領(lǐng)域都能做出有意義的貢獻——理論上應(yīng)該是這樣,但就我所知,現(xiàn)實與這個理論不太相符。

事實上,除非你的目標(biāo)是成為一名學(xué)者,否則我認(rèn)為獲得博士學(xué)位并不是獲得專業(yè)知識的最佳途徑。最好的道路是能讓你快速、開放地成長的道路。在團隊合作和專家密切指導(dǎo)下開展各種項目,你能最快地學(xué)到知識。在實踐中,典型的博士項目不是那樣的。

問:在我們結(jié)束之前,對于那些對如何開啟深度學(xué)習(xí)感到不知所措的初學(xué)者,你有什么建議嗎?

Fran?ois Chollet:10年后,你能買到一本教科書,上面會可以很好地總結(jié)2010年到2020年期間AI的進展。今天發(fā)布的大量內(nèi)容可能看起來很重要,但其中大部分都是噪音。要專注于大問題。

Sanyam Bhutani:非常感謝你接受這個采訪。

-

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4811瀏覽量

103059 -

機器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8497瀏覽量

134243

原文標(biāo)題:專訪Keras之父:關(guān)于深度學(xué)習(xí)、Keras的誕生和給初學(xué)者的建議

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

基于stm32h743IIK在cubeai上部署keras模型,模型輸出結(jié)果都是同一組概率數(shù)組,為什么?

如何將Keras H5模型轉(zhuǎn)換為中間表示 (IR) 格式?

轉(zhuǎn)換Keras H5模型,為什么無法確定--input_shape參數(shù)的值?

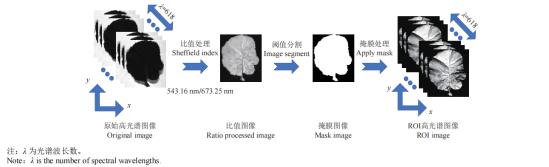

基于高光譜深度特征的油菜葉片鋅含量檢測

專訪Keras之父:從何開始對深度學(xué)習(xí)感興趣、Keras的創(chuàng)建背后的動機

專訪Keras之父:從何開始對深度學(xué)習(xí)感興趣、Keras的創(chuàng)建背后的動機

評論