從 2017 年開始,fast.ai 創始人、數據科學家 Jeremy Howard 以每年一迭代的方式更新“針對編程者的深度學習課程”(Practical Deep Learning For Coders)。這場免費的課程可以教大家如何搭建最前沿的模型、了解深度學習的基礎知識。直到今年已經是第三個年頭了。

1 月 24 日,fast.ai 上線 2019 版深度學習新課程。據介紹,該課程 100% 全新,包括以前從未涵蓋過的深度學習入門課程,甚至其中某些技術成果還尚未發表學術論文。

如以往一樣,Jeremy Howard 公開了本次課程將涵蓋的所有細節內容。他表示,本次課程共有七節,每節課大約 2 小時,當然,預計完成課后作業的時間將有 10 小時。

課程將涉及的應用案例

本次課程設計關鍵應用包括:

計算機視覺(例如按品種分類寵物照片)

圖像分類

圖像定位(分割和激活圖)

圖像關鍵點

NLP(如電影評論情緒分析)

語言建模

文檔分類

表格數據(如銷售預測)

分類數據

連續數據

協作過濾(如電影推薦)

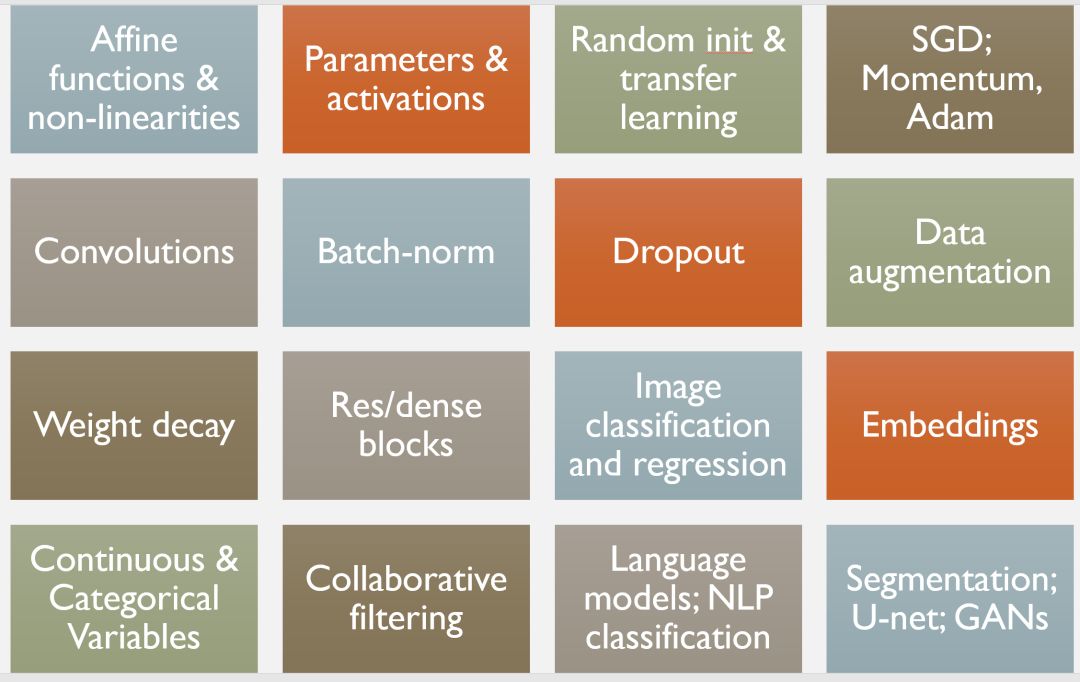

課程涵蓋的基礎

課程鏈接傳送:https://course.fast.ai

目標人群:至少有一年的編程經驗,且最好是 Python,fast.ai 還提供了Python 相關的學習資源。

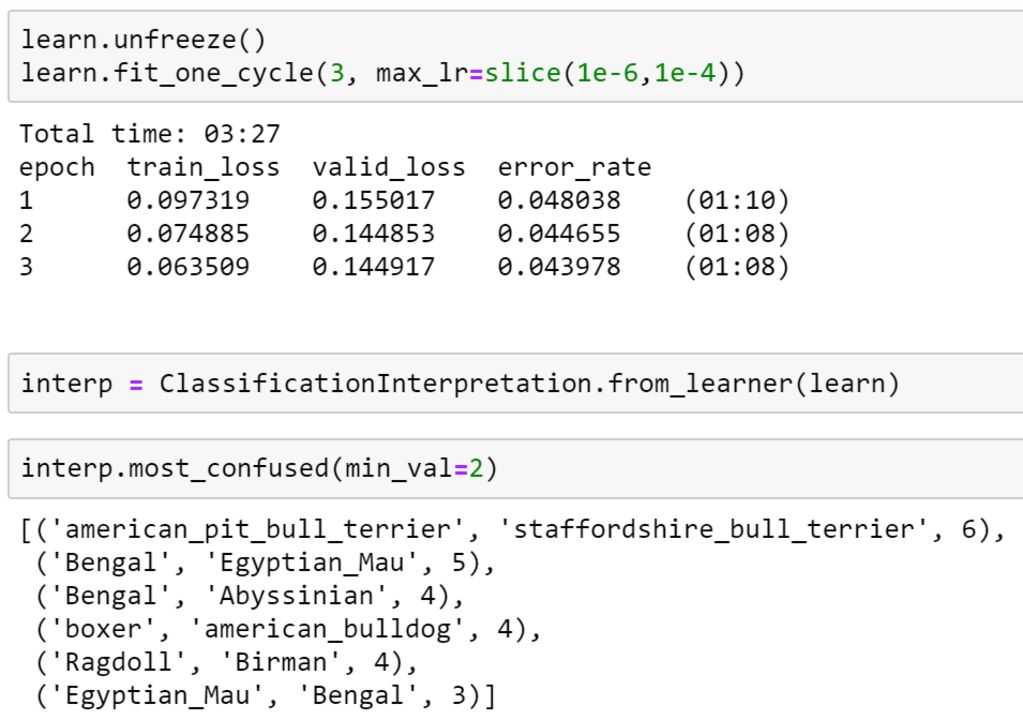

第 1 課:圖像分類

該系列課程第一課,是訓練一個能以最高精準度識別寵物品種的圖像分類器。其中,遷移學習的使用時本次課程的基礎。我們將了解如何分析模型,以了解其失效模型,或許還能發現,模型出錯的地方與育種專家犯了相同的錯誤。

訓練和分析寵物品種分類器

我們將討論課程的整體方法,這與先理論再實際應用的方式不同,課程旨在先進行實際應用再深入研究。

我們還將討論如何在訓練神經網絡時設置最重要的超參數:學習率(這主要基于 Leslie Smith 的 learning rate finder)。最后,還會介紹“標簽”的問題,并了解 fast.ai 所提供的功能,如可以輕松將標簽添加到圖像中。

第 2 課:數據清洗與構建;梯度下降法(SGD)

本節課程將學習如何使用自己的數據構建圖像分類模型,主要包括以下幾方面:

圖像收集

并行下載

創建驗證集

數據清洗,通過模型找到數據問題

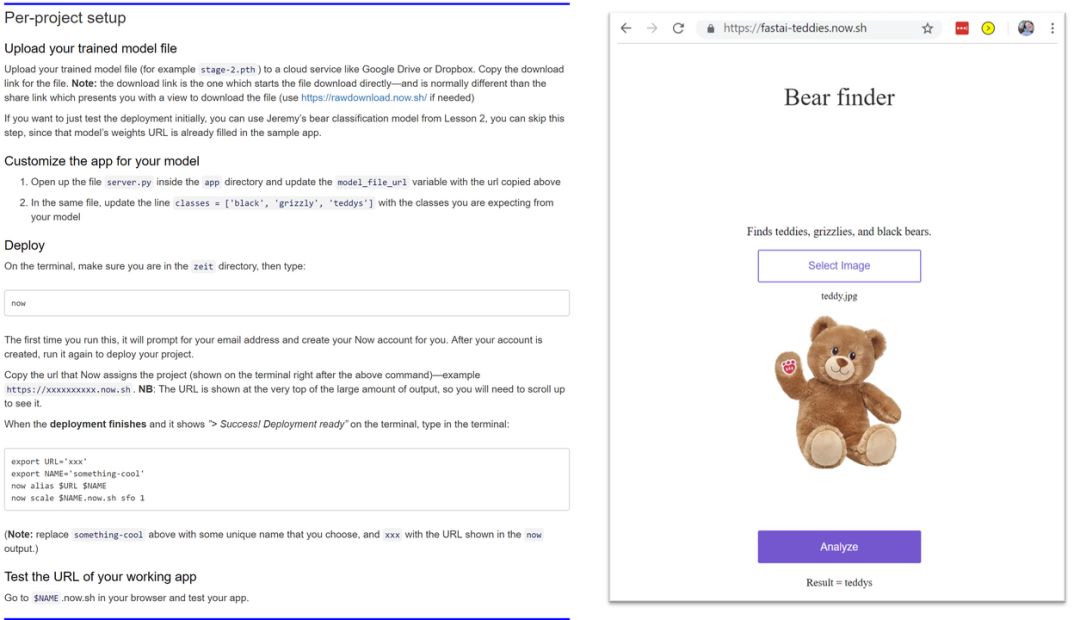

如下圖所示,我們可以創建一個可區分泰迪熊和灰熊任務的模型。

將模型投入生產

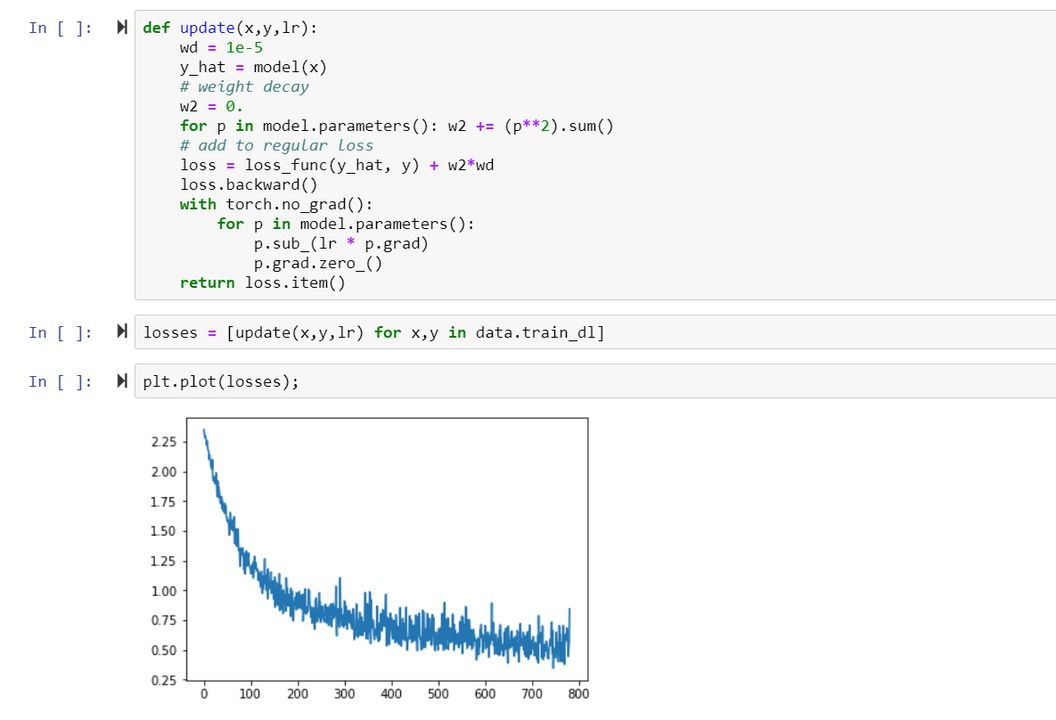

課程后半部分,將完整訓練一個較為簡單的模型,同時創建一個梯度下降循環。(注:在此過程中,將學習到很多新的術語,所以請確保做好筆記,因為在整個課程中都會引用這個新術語。)

第3課:數據塊;多標簽分類;分割

本節課開始將主要研究一個有趣的數據集,叫做“Planet’s Understanding the Amazon from Space”。為了將這些數據轉化為模型需要的形式,將使用 fast.ai 工具之一的數據塊 API。

Planet 數據集的一個重要特征是,它是一個多標簽數據集。也就是說,每個Planet圖像可包含多個標簽,而之前看過的數據集,每個圖像只有一個標簽。此外,可能還需要對多標簽數據集進行修改。

圖像分割模型的結果

接下來的圖像分割,是一個標記圖像中每個像素的過程,其中一個類別顯示該像素描繪的對象類型。將使用與早期圖像分類類似的技術,所以不需要太多調整。

本課程中還會使用到 CamVid 數據集,該模型誤差遠低于在學術文獻中找到的任何模型。

假設:如果你的因變量是連續值而不是類別怎么辦?我們將重點回答這個問題,查看關鍵點數據集,并構建一個精準預測面部關鍵點的模型。

第 4 課:NLP;表格數據;協同過濾;嵌入(Embeddings)

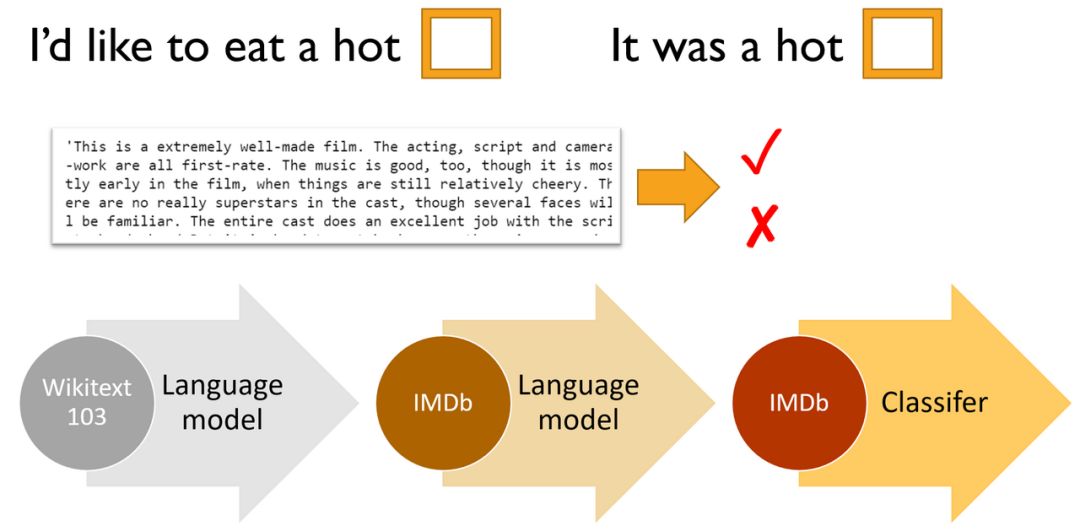

使用 IMDb 電影評論數據集深入研究自然語言處理(NLP)。在這項任務中,目標是預測電影評論是積極的還是消極的,這稱為“情緒分析”。此前,在 fast.ai 2018 課程里提到的 ULMFit 算法,對 NLP 的發展起著重要作用。紐約時報曾報道:“新系統開始瓦解自然語言的代碼。”ULMFiT 被認為是當今最準確的情緒分析算法。

基本步驟如下:

(首選)創建(或下載預訓練的)語言模型,該模型在大型語料庫(如維基百科)上訓練。(“語言模型”指的是學習預測句子下一個單詞的任意一種模型。)

使用目標語料庫(案例為 IMDb 電影評論)微調該語言模型。

在微調語言模型中刪除編碼器,并用分類器進行替換。然后對微調該模型以完成最終分類任務(情緒分類)。

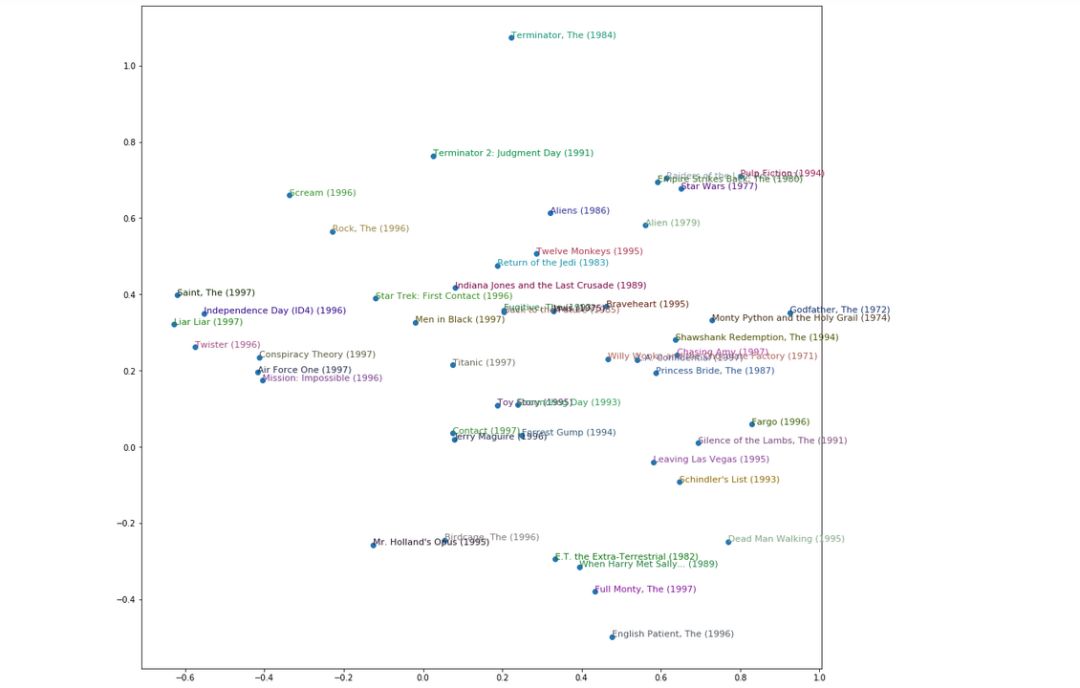

在學習 NLP 的過程中,我們將通過覆蓋表格數據(如電子表格和數據庫表格)以及協作過濾(推薦系統)來完成使用的編碼器深度學習的實際應用。

對于表格數據,我們還將看到如何使用分類變量和連續變量,以及如何使用 fast.ai. tabular 模塊來設置和訓練模型。

在課程中期,我們主要研究了如何在每個關鍵應用領域中構建和解釋模型,包括:計算機視覺、NLP、表格數據、協同過濾等。

在課程的后半部分,我們將了解這些模型如何真正起作用、如何從頭開始創建的過程,會涉及以下幾部分:

激活

參數

圖層(仿射和非線性)

損失函數

第 5 課:反向傳播;加速SGD;構建神經網絡

本節課程中,將所有的訓練融合在一起,以便討論反向傳播時準確理解發生了什么,并利用這些只是從頭構建一個簡單的神經網絡。

在這個過程中,可以看到嵌入層的權重,以找出模型從分類變量的中學到了什么。

盡管嵌入在 NLP 的單詞嵌入環境中最廣為人知,但它們對一般的分類變量也同樣重要,例如表格數據或協同過濾。它們甚至可以與非神經模型一起使用并取得巨大成功。

第 6 課:正規化;卷積;數據倫理

本節課主要討論一些改進訓練和避免過度擬合的技術:

Dopout:在訓練期間隨機刪除激活,使模型正規化

數據增強:在訓練期間修改模型輸入,以便有效增加數據大小

批量標準化:調整模型的參數化,使損失表面更加平滑

單個圖像的數據增強示例

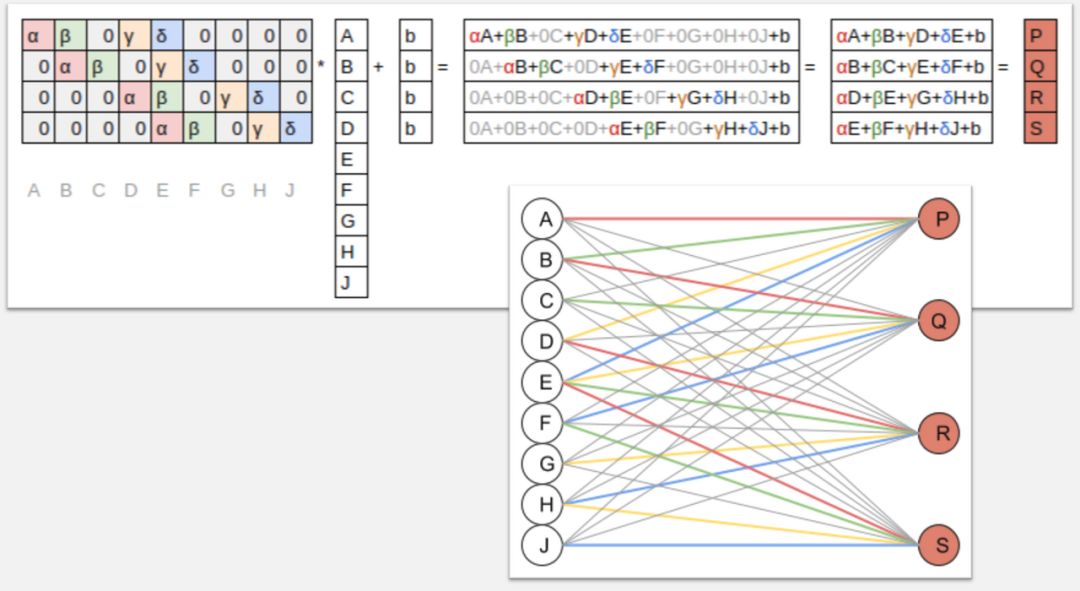

接下來,我們將學習有關卷積的所有內容,卷積可被視為矩陣乘法的一種變體,也是現代計算機視覺模型的核心操作基礎。

我們將創建一個類激活圖。這是一個熱圖,顯示圖像的哪些部分在進行與測試時最重要。

卷積如何運作

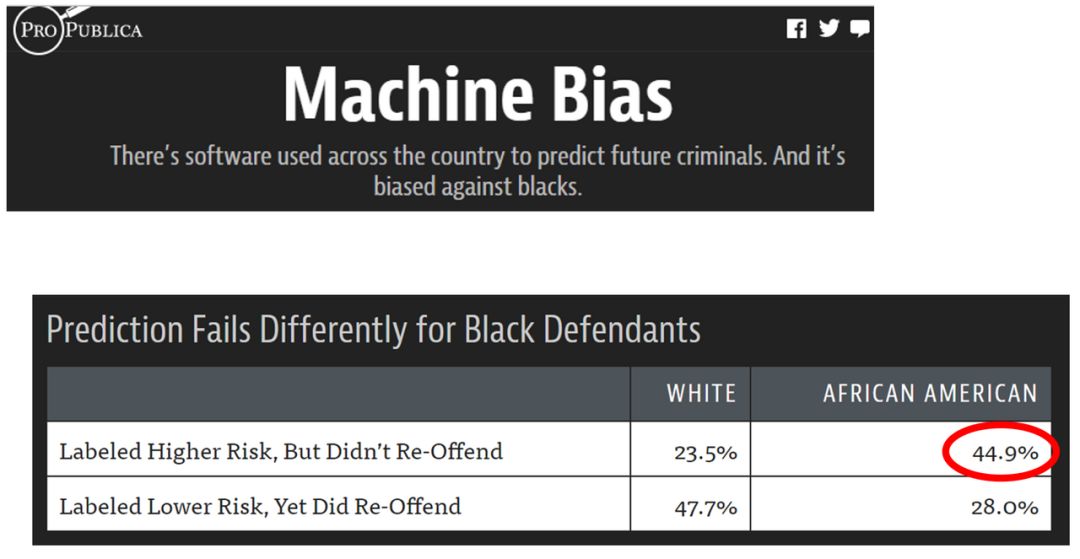

最后,我們還將提到:數據倫理。同學們將了解到模型出錯的一些方法,尤其是反饋循環,其原因以及如何避免這些問題。我們還將研究數據偏差可能導致偏向算法的方式,并討論數據科學家可以而且應該提出的問題,以確保他們的工作不會導致意外的負面結果。

美國司法系統中算法偏差的例子

第 7 課:構建 ResNet、U-Net;生成對抗網絡

在最后一講中,我們將研究現代架構中最重要的技術之一:跳躍連接(skip connection)。跳躍連接是 ResNet 最重要的應用,其主要在課程中用于圖像分類,同樣它還是很多前沿成果的基石。

我們還將研究 U-Net 架構,使用不同類型的跳躍連接極大改善了分段結果。

ResNet跳躍連接對損失表面的影響

然后,使用 U-Net 架構來訓練超分辨率模型。這是一種可以提高低質量圖像分辨率的模型,該模型不僅會提高分辨率,還會刪除 jpeg 圖片上偽跡和文本水印。

為了使我們的模型產生高質量的結果,需要創建一個自定義損失函數,其中包含特征損失(也稱為感知損失)以及 gram 損失。這些技術可用于許多其他類型的 圖像生成模型,例如圖像著色。

使用特征損失和 gram 損失的超分辨率結果

我們將了解到一種稱為生成性對抗性損失(用于生成性對抗性網絡 GAN)的損失函數,可以在某些情況下以犧牲速度為代價來提高生成模型的質量。

例如,上文提到的還未發表的一些論文中所涉及的應用:

利用遷移學習,更快更可靠地訓練 GAN

將架構創新和損失函數方法以前所未有的方式進行結合

結果令人驚嘆,只需要幾個短短幾小時便可進行訓練(與以前需要幾天的方法相比)。

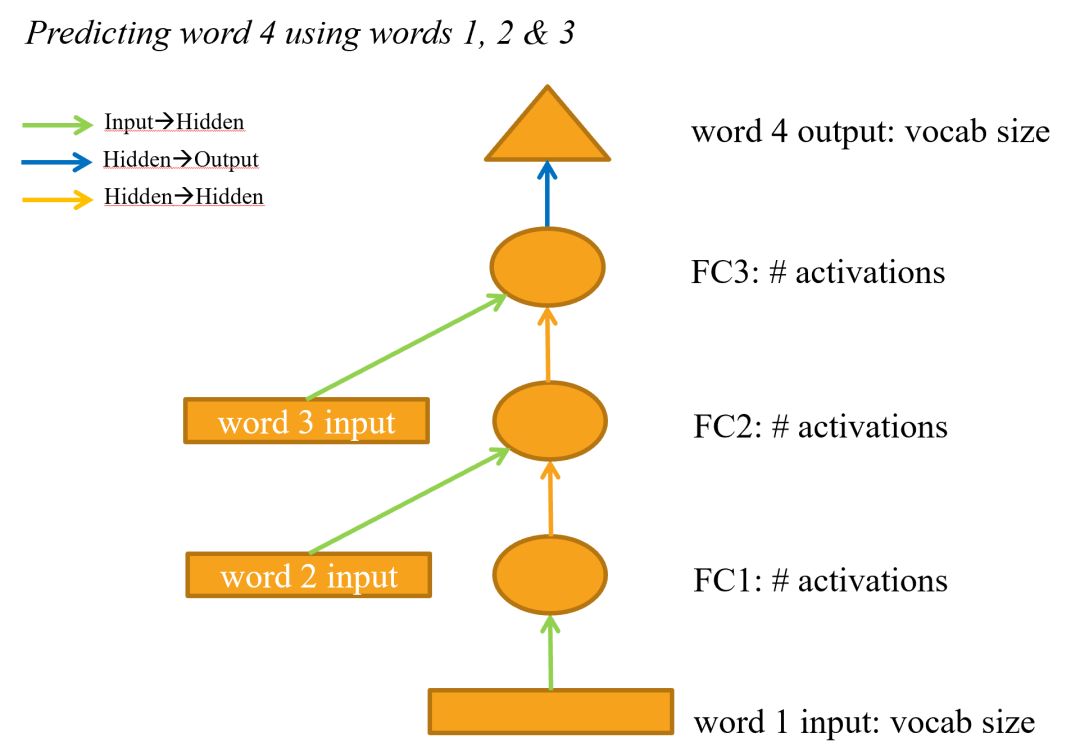

一個循環神經網絡

最后,我們還將學到如何從頭開始創建遞歸神經網絡(RNN)。實際上,RNN 不僅是整套課程中 NLP 應用的基礎模型,還被證明是規則的多層神經網絡的一個簡單重構。

課前須知:

1、Google Cloud 和微軟 Azure 作為贊助方,已將課程所需的全部功能集成到基于 GPU 的平臺上,并且提供“一鍵式”平臺服務,如 Crestle 和Gradient 服務。

2、完成第一堂課后,學生可以在自己的數據上訓練圖像分類模型。整個上半部分重點是實用技術,僅展示在實踐中用到的技術相關理論知識;課程的后半部分,將深入研究理論。直到最后一節課,將學習構建和訓練一個 Resnet 的神經網絡,以求接近最佳準確性。

3、 課程使用 PyTorch 庫進行教學,可更輕松訪問推薦的深度學習模型最佳實踐,同時也可以直接使用所有底層的 PyTorch 功能。

4、學習內容同樣適用于 TensorFlow/keras、CNTK、MXnet 或者任何其他深度學習庫的任何任務。

5、電腦需要連接到安裝了 fast.ai 庫的云 GPU 供應商服務,或設置一個適合自己的 GPU。同時,還需要了解運行深度學習訓練的 Jupyter Notebook 環境的基礎知識。

6、課程筆記本提供了新的交互式GUI,用于使用模型查找和修復錯誤標記或錯誤收集的圖像。

7、(強烈)建議學院參加該課程的在線社區。

-

圖像分類

+關注

關注

0文章

96瀏覽量

12124 -

計算機視覺

+關注

關注

9文章

1708瀏覽量

46637 -

深度學習

+關注

關注

73文章

5557瀏覽量

122609

原文標題:2019最新實戰!給程序員的7節深度學習必修課,最好還會Python!

文章出處:【微信號:rgznai100,微信公眾號:rgznai100】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

誠邀高校老師參加:2025暑期AI具身智能 + 嵌入式師資班,教您把前沿技術 “搬進” 課堂

【免費送,全新AD25(入門+進階)兩套 PCB Layout視頻教程 】張飛實戰電子x志博PCB:攜手共創PCB學習新征程

《AI Agent 應用與項目實戰》----- 學習如何開發視頻應用

行業集結:共同定制 RK3566 集成 AI 眼鏡的前沿 AR 方案

《AI Agent 應用與項目實戰》第1-2章閱讀心得——理解Agent框架與Coze平臺的應用

HarmonyOS開發寶典震撼來襲,卓越應用開發之旅一觸即發,輕松啟程!

【免費領取】AI人工智能學習資料(學習路線圖+100余講課程+虛擬仿真平臺體驗+項目源碼+AI論文)

【全新課程資料】正點原子《基于GD32 ARM32單片機項目實戰入門》培訓課程資料上線!

【全新課程資料】正點原子《ESP32基礎及項目實戰入門》培訓課程資料上線!

【全新課程資料】正點原子《ESP32物聯網項目實戰》培訓課程資料上線!

課程上線 - RT-Thread應用開發實踐課程上線慕課平臺啦!

NVIDIA推出全新深度學習框架fVDB

HDC2024華為發布鴻蒙原生智能:AI與OS深度融合,開啟全新的AI時代

fast.ai上線2019深度學習新課程啦,100%全新前沿實戰

fast.ai上線2019深度學習新課程啦,100%全新前沿實戰

評論