Google LLC 在其云平臺上推出了一項新的“ 可解釋AI ”服務,旨在使機器學習模型做出決策的過程更加透明。

谷歌表示,這樣做的想法是,這將有助于建立對這些模型的更大信任。這很重要,因為大多數(shù)現(xiàn)有模型往往相當不透明。只是不清楚他們?nèi)绾巫龀鰶Q定。

Google Cloud AI戰(zhàn)略總監(jiān)Tracy Frey在 今天的博客中解釋說,Explainable AI旨在提高機器學習模型的可解釋性。她說,這項新服務的工作原理是量化每個數(shù)據(jù)因素對模型產(chǎn)生的結果的貢獻,幫助用戶了解其做出決定的原因。

換句話說,它不會以通俗易懂的方式來解釋事物,但是該分析對于首先構建機器學習模型的數(shù)據(jù)科學家和開發(fā)人員仍然有用。

可解釋的AI有進一步的局限性,因為它提出的任何解釋都將取決于機器學習模型的性質(zhì)以及用于訓練它的數(shù)據(jù)。

她寫道:“任何解釋方法都有局限性。” “一方面,AI解釋反映了數(shù)據(jù)中發(fā)現(xiàn)的模型的模式,但它們并未揭示數(shù)據(jù)樣本,總體或應用程序中的任何基本關系。我們正在努力為客戶提供最直接,最有用的解釋方法,同時保持其局限性透明。”

但是,可解釋的AI可能很重要,因為準確解釋特定機器學習模型為何得出結論的原因對于組織內(nèi)的高級管理人員很有用,他們最終負責這些決策。對于高度嚴格的行業(yè)來說,這尤其重要,而信心絕對至關重要。谷歌表示,對于處于這一位置的許多組織而言,目前沒有任何可解釋性的人工智能已經(jīng)超出范圍。

在相關新聞中,Google還發(fā)布了所謂的“模型卡”,作為其Cloud Vision應用程序編程界面的面部檢測和對象檢測功能的文檔。

這些模型卡詳細說明了這些預先訓練的機器學習模型的性能特征,并提供了有關其性能和限制的實用信息。谷歌表示,其目的是幫助開發(fā)人員就使用哪種模型以及如何負責任地部署它們做出更明智的決定。

-

谷歌

+關注

關注

27文章

6231瀏覽量

108096 -

機器學習

+關注

關注

66文章

8501瀏覽量

134568

發(fā)布評論請先 登錄

大模型在半導體行業(yè)的應用可行性分析

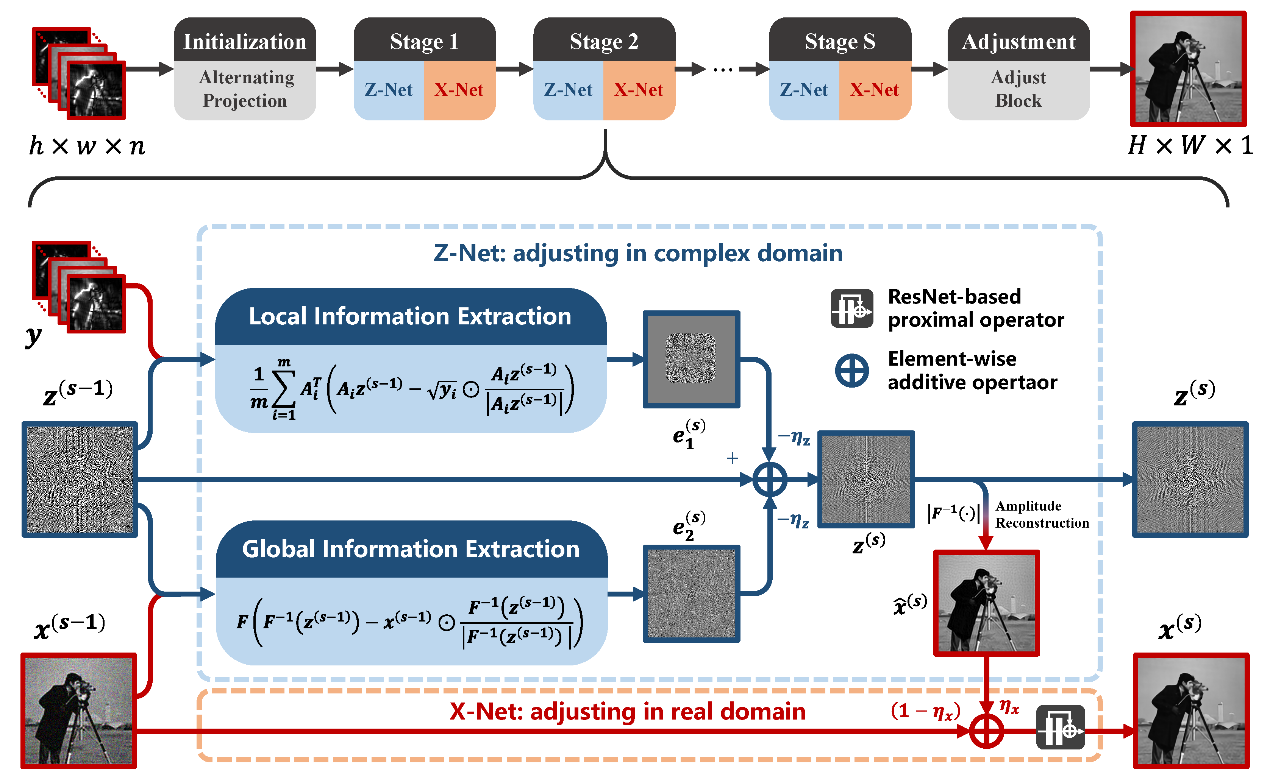

中國科學院西安光機所在計算成像可解釋性深度學習重建方法取得進展

AI大模型在汽車應用中的推理、降本與可解釋性研究

了解DeepSeek-V3 和 DeepSeek-R1兩個大模型的不同定位和應用選擇

機器學習模型市場前景如何

小白學解釋性AI:從機器學習到大模型

Explainable AI旨在提高機器學習模型的可解釋性

Explainable AI旨在提高機器學習模型的可解釋性

評論