古諺道:“熟讀唐詩三百首,不會作詩也會吟。” 這句話放在目前的人工智能語言模型中也非常適用。

此前,OpenAI 的研究人員開發(fā)出 “GPT-3”,這是一個由 1750 億個參數(shù)組成的 AI 語言模型,堪稱有史以來訓(xùn)練過的最大的語言模型,可以進行原始類比、生成配方、甚至完成基本代碼編寫。

如今,這一記錄被打破了。近日,谷歌研究人員開發(fā)出一個新的語言模型,它包含了超過 1.6 萬億個參數(shù),這是迄今為止最大規(guī)模的人工智能語言模型,比之前谷歌開發(fā)的語言模型 T5-XXL 的規(guī)模大了 4 倍。

參數(shù)是機器學(xué)習(xí)算法的關(guān)鍵所在,它們是從歷史訓(xùn)練數(shù)據(jù)中學(xué)習(xí)到的模型的一部分。一般而言,在語言領(lǐng)域中參數(shù)的數(shù)量和復(fù)雜度之間的相關(guān)性非常好。這一點類似于 GPU 中晶體管的數(shù)量,在同樣的制程工藝下,晶體管越多其算力便越強,而語言模型包含的參數(shù)愈多就愈接近人類自然語言。

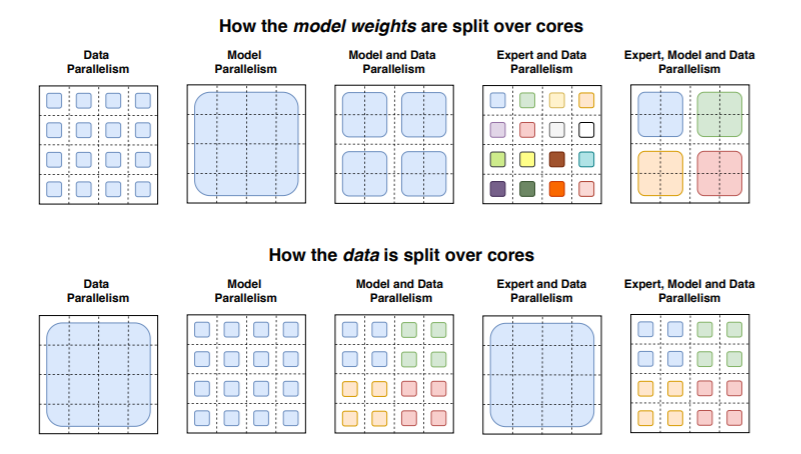

正如研究人員在一篇論文中指出的那樣,大規(guī)模的訓(xùn)練是通向強大模型的有效途徑,在大數(shù)據(jù)集和參數(shù)計數(shù)的支持下,簡單的體系結(jié)構(gòu)遠遠超過了更復(fù)雜的算法。但是,有效的大規(guī)模培訓(xùn)在計算上非常密集。這就是為什么研究人員熱衷于他們所說的 “開關(guān)變壓器”,這是一種 “稀疏激活” 技術(shù),它只使用模型權(quán)重的一個子集或者在模型中轉(zhuǎn)換輸入數(shù)據(jù)的參數(shù)。

“開關(guān)變壓器” 是早在 90 年代初首次提出的一種人工智能模型范例,大體意思是將多個專家或?qū)iT處理不同任務(wù)的模型放在一個更大的模型中,并有一個 “門控網(wǎng)絡(luò)” 來選擇為任何給定數(shù)據(jù)咨詢哪些專家。

在一項實驗中,研究人員使用 32 個 TPU 內(nèi)核對幾個不同的 “開關(guān)變壓器” 模型進行了預(yù)訓(xùn)練,這些 TPU 內(nèi)核位于一個從 Reddit、Wikipedia 和其他網(wǎng)絡(luò)資源中搜集的 750GB 大小的文本數(shù)據(jù)語料庫中,任務(wù)則是讓這些模型預(yù)測段落中 15% 的單詞被遮住的缺失單詞,以及其他挑戰(zhàn),比如檢索文本來回答一系列越來越難的問題。

研究人員稱,包含了 1.6 萬億參數(shù)和 2048 名專家的模型 Switch-C 顯示 “完全沒有訓(xùn)練不穩(wěn)定性”。然而,在桑福德問答數(shù)據(jù)集的基準測試中,Switch-C 的得分居然比僅包含 3950 億個參數(shù)和 64 名專家的模型 Switch-XXL 還要低一點,對此,研究人員認為是因為微調(diào)質(zhì)量、計算要求和參數(shù)數(shù)量之間的不透明關(guān)系所致。

在這種情況下,“開關(guān)變壓器” 導(dǎo)致了一些下游任務(wù)的收益。例如,研究人員稱在使用相同數(shù)量的計算資源的情況下,它可以使訓(xùn)練前的加速速度提高 7 倍以上。他們還證明 “稀疏激活” 技術(shù)可以用來創(chuàng)建更小、更密集的模型,這些模型可以對任務(wù)進行微調(diào),其質(zhì)量增益為大型模型的 30%。

對此他們表示:雖然這項工作主要集中在超大模型上,但我們也發(fā)現(xiàn)只有兩名專家的模型可以提高性能,同時很容易適應(yīng)通用 GPU 或 TPU 的內(nèi)存限制。另外,通過將稀疏模型提取為稠密模型,可以實現(xiàn) 10 到 100 倍的壓縮率,同時獲得專家模型約 30% 的質(zhì)量增益。

在另一個測試中,“開關(guān)變壓器” 模型被訓(xùn)練在 100 多種不同語言之間進行翻譯,研究人員觀察到 101 種語言的 “普遍改善”,91% 的語言受益于比基線模型快 4 倍以上的速度。未來,研究人員還計劃將 “開關(guān)變壓器” 應(yīng)用于新的領(lǐng)域,比如圖像和文本。他們認為,模型稀疏性可以賦予優(yōu)勢,在一系列不同的媒體以及多模態(tài)模型。

美中不足的是,研究人員的工作沒有考慮到這些語言模型在現(xiàn)實世界中的影響,比如模型通常會放大一些公開數(shù)據(jù)中的偏見。對此,OpenAI 公司指出,這可能導(dǎo)致在女性代詞附近放置 “淘氣”;而在 “恐怖主義” 等詞附近放置 “伊斯蘭” 等。根據(jù)米德爾伯里國際研究所的說法,這種偏見可能被惡意行為者利用,通過散布錯誤信息、造謠和謊言來煽動不和。

而路透社也曾報道稱,谷歌的研究人員現(xiàn)在被要求在研究人臉和情緒分析以及種族分類等話題之前,先咨詢法律、政策和公關(guān)團隊,性別或政治派別。

綜上所述,盡管谷歌訓(xùn)練的 1.6 萬億參數(shù)的人工智能語言模型還沒辦法做到真正意義上的人工智能,存在一些不足之處需要完善和優(yōu)化,但隨著在摩爾定律下電子設(shè)備算力的不斷提升,近些年 AI 語言模型參數(shù)量級呈指數(shù)倍發(fā)展,相信在不久的將來,或許真的會出現(xiàn)一個無限接近熟讀人類歷史所有文明記錄的超級模型,能夠和人類完全實現(xiàn)自然語言交流,不妨讓我們好好期待一下吧!

原文標(biāo)題:GPT-3記錄被打破!谷歌推出1.6萬億參數(shù)的人工智能語言模型

文章出處:【微信公眾號:DeepTech深科技】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

責(zé)任編輯:haq

-

谷歌

+關(guān)注

關(guān)注

27文章

6230瀏覽量

107798 -

人工智能

+關(guān)注

關(guān)注

1805文章

48871瀏覽量

247671

原文標(biāo)題:GPT-3記錄被打破!谷歌推出1.6萬億參數(shù)的人工智能語言模型

文章出處:【微信號:deeptechchina,微信公眾號:deeptechchina】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

如何借助大語言模型打造人工智能生態(tài)系統(tǒng)

OpenAI即將推出GPT-5模型

人工智能大模型年度發(fā)展趨勢報告

嵌入式和人工智能究竟是什么關(guān)系?

《AI for Science:人工智能驅(qū)動科學(xué)創(chuàng)新》第一章人工智能驅(qū)動的科學(xué)創(chuàng)新學(xué)習(xí)心得

英偉達預(yù)測機器人領(lǐng)域或迎“GPT-3時刻”

Jim Fan展望:機器人領(lǐng)域即將迎來GPT-3式突破

Kiwi Talks | 傳統(tǒng)以太網(wǎng)、UEC超以太網(wǎng)、超節(jié)點-Ethernet RDMA 打響進階賽

谷歌推出1.6萬億參數(shù)的人工智能語言模型,打破GPT-3記錄

谷歌推出1.6萬億參數(shù)的人工智能語言模型,打破GPT-3記錄

評論