從頭開始創(chuàng)建一個(gè)新的人工智能深度學(xué)習(xí)模型是一個(gè)非常耗費(fèi)時(shí)間和資源的過程。解決這個(gè)問題的一個(gè)常見方法是采用遷移學(xué)習(xí)。為了使這一過程更加簡(jiǎn)單,NVIDIA TAO Toolkit,它可以將工程時(shí)間框架從 80 周縮短到 8 周。 TAO 工具包支持計(jì)算機(jī)視覺和對(duì)話 AI ( ASR 和 NLP )用例。

在本文中,我們將介紹以下主題:

安裝 TAO 工具包并訪問預(yù)訓(xùn)練模型

微調(diào)預(yù)訓(xùn)練語音轉(zhuǎn)錄模型

將微調(diào)模型導(dǎo)出到 NVIDIA Riva

跟隨 download the Jupyter notebook。

安裝 TAO 工具包并下載預(yù)訓(xùn)練模型

在安裝 TAO 工具包之前,請(qǐng)確保您的系統(tǒng)上安裝了以下組件:

Python [3 。 6 。 9]

docker ce 》 19 。 03 。 5

nvidia-DOCKR2 3 。 4 。 0-1

有關(guān)安裝 nvidia docker 和 docker 的更多信息,請(qǐng)參閱Prerequisites。您可以使用 pip 安裝 TAO 工具包。我們建議使用virtual environment以避免版本沖突。

安裝完成后,下一步是獲得一些經(jīng)過預(yù)訓(xùn)練的模型。 NVIDIA 提供了許多人工智能或機(jī)器學(xué)習(xí)模型,不僅在對(duì)話人工智能領(lǐng)域,而且在 NGC 或 NVIDIA GPU 云上的廣泛領(lǐng)域。 NGC 目錄是一套精心策劃的 GPU 優(yōu)化軟件,用于 AI 、 HPC 和可視化。

要從 NGC 下載資源,請(qǐng)使用NGC API key登錄注冊(cè)表。您可以免費(fèi)創(chuàng)建和使用一個(gè)。

圖 1 。獲取 NGCAPI 密鑰

CitriNet是由 NVIDIA 構(gòu)建的最先進(jìn)的自動(dòng)語音識(shí)別( ASR )模型,可用于生成語音轉(zhuǎn)錄。您可以從Speech to Text English Citrinet型號(hào)卡下載此型號(hào)。

為了提供流暢的體驗(yàn),工具包在后臺(tái)下載并運(yùn)行 Docker 容器,使用前面提到的規(guī)范文件。所有細(xì)節(jié)都隱藏在 TAO 啟動(dòng)器中。您可以通過定義 JSON 文件~/.tao_mounts.json來指定裝載 Docker 容器的首選位置。您可以在Jupyter notebook中找到裝載文件。

這樣,您就安裝了 TAO 工具包,下載了一個(gè)經(jīng)過預(yù)訓(xùn)練的 ASR 模型,并指定了 TAO 工具包啟動(dòng)器的安裝點(diǎn)。在下一節(jié)中,我們將討論如何使用 TAO 工具包在您選擇的數(shù)據(jù)集上微調(diào)此模型。

微調(diào)模型

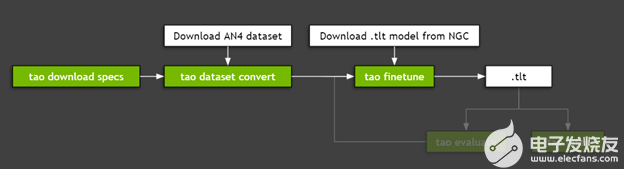

使用 TAO 工具包微調(diào)模型包括三個(gè)步驟:

下載規(guī)范文件。

預(yù)處理數(shù)據(jù)集。

使用超參數(shù)進(jìn)行微調(diào)。

圖 3 顯示了微調(diào)模型所需的步驟。

圖 2 。 TAO 工具包工作流

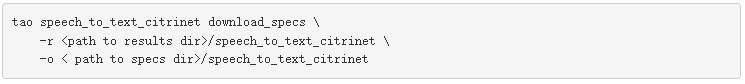

步驟 1 :下載規(guī)范文件

NVIDIA TAO Toolkit 是一種低代碼或無代碼的解決方案,通過規(guī)范文件簡(jiǎn)化模型的培訓(xùn)或微調(diào)。通過這些文件,您可以自定義特定于模型的參數(shù)、培訓(xùn)師參數(shù)、優(yōu)化器和所用數(shù)據(jù)集的參數(shù)。可以將這些規(guī)范文件下載到先前裝載的文件夾:

以下是 TAO 工具包附帶的 YAML 文件。有關(guān)更多信息,請(qǐng)參閱Downloading Sample Spec Files。

create_tokenizer.yaml

dataset_convert_an4.yaml

dataset_convert_en.yaml

dataset_convert_ru.yaml

evaluate.yaml

export.yaml

finetune.yaml

infer_onnx.yaml

infer.yaml

train_citrinet_256.yaml

train_citrinet_bpe.yaml

這些規(guī)范文件可供自定義和使用。從預(yù)處理和模型評(píng)估到推理和導(dǎo)出模型,都有相應(yīng)的功能。這使您能夠完成開發(fā)或定制模型的過程,而無需構(gòu)建復(fù)雜的代碼庫。下載等級(jí)庫文件后,現(xiàn)在可以繼續(xù)預(yù)處理數(shù)據(jù)。

步驟 2 :預(yù)處理數(shù)據(jù)集

在本演練中,您將使用CMU’s AN4 Dataset,這是一個(gè)小型普查數(shù)據(jù)集,其中包含地址、數(shù)字和其他個(gè)人信息的記錄。這與客戶支持對(duì)話中對(duì)話的初始步驟所需的轉(zhuǎn)錄類型類似。具有類似內(nèi)容的較大自定義數(shù)據(jù)集可用于實(shí)際應(yīng)用程序。

您可以直接下載和解壓縮 AN4 數(shù)據(jù)集,或使用以下命令:

TAO 工具包培訓(xùn)和微調(diào)模塊期望數(shù)據(jù)以特定格式呈現(xiàn)。可以使用 dataset _ convert 命令完成此預(yù)處理。我們將 AN4 和 Mozilla 的通用語音數(shù)據(jù)集的規(guī)范文件與 TAO 啟動(dòng)器一起打包。您可以在步驟 1 中定義的目錄中找到這些規(guī)范文件。

這些清單文件(圖 3 )包含在后面的步驟中使用的以下信息:

音頻文件的路徑

每個(gè)文件的持續(xù)時(shí)間

每個(gè)文件的文字內(nèi)容

圖 3 。已處理清單文件的結(jié)構(gòu)

此命令將音頻文件轉(zhuǎn)換為 WAV 文件,并生成訓(xùn)練和測(cè)試清單文件。

在大多數(shù)情況下,您都會(huì)進(jìn)行預(yù)處理,但 CitriNet 模型是一個(gè)特例。它需要以子詞標(biāo)記化的形式進(jìn)行進(jìn)一步處理,為文本創(chuàng)建子詞詞匯表。這與 Jasper 或 QuartzNet 不同,因?yàn)樵谒鼈兊那闆r下,詞匯表中只有單個(gè)字符被視為元素。在 CitriNet 中,子字可以是一個(gè)或多個(gè)字符。這可以使用以下命令完成:

到目前為止,您已經(jīng)建立了一個(gè)工具,為諸如遷移學(xué)習(xí)之類的復(fù)雜問題提供低代碼或無代碼解決方案。您已經(jīng)下載了一個(gè)預(yù)訓(xùn)練的模型,將音頻文件處理為必要的格式,并執(zhí)行了標(biāo)記化。您使用的命令不到 10 個(gè)。現(xiàn)在,所有必要的細(xì)節(jié)都已散列出來,您可以繼續(xù)微調(diào)模型。

步驟 3 :使用超參數(shù)進(jìn)行微調(diào)

正如在前面的步驟中所做的那樣,您正在與規(guī)范文件交互。有關(guān)更多信息,請(qǐng)參閱Creating an Experiment Spec File。如果要調(diào)整 FFT 窗口大小的大小,可以指定幾乎所有內(nèi)容,從特定于訓(xùn)練的參數(shù)(如優(yōu)化器)到特定于數(shù)據(jù)集的參數(shù),再到模型配置本身。

是否要更改學(xué)習(xí)速率和調(diào)度程序,或者在詞匯表中添加新字符?無需打開代碼庫并對(duì)其進(jìn)行掃描以進(jìn)行更改。所有這些定制都很容易獲得,并可在整個(gè)團(tuán)隊(duì)中共享。這減少了在嘗試新想法和分享結(jié)果以及模型配置方面的摩擦,從而提高了準(zhǔn)確性。

以下是如何微調(diào)數(shù)據(jù)集:

最后,要繼續(xù),請(qǐng)根據(jù)需要修改規(guī)范文件并運(yùn)行以下命令。此命令使用先前下載的數(shù)據(jù)集微調(diào)下載的模型。有關(guān)更多信息,請(qǐng)參閱Fine-Tuning the Model。

在對(duì)模型進(jìn)行微調(diào)或培訓(xùn)后,自然會(huì)評(píng)估模型并評(píng)估是否需要進(jìn)一步微調(diào)。為此, NVIDIA 為evaluate your model和run inference提供了功能。

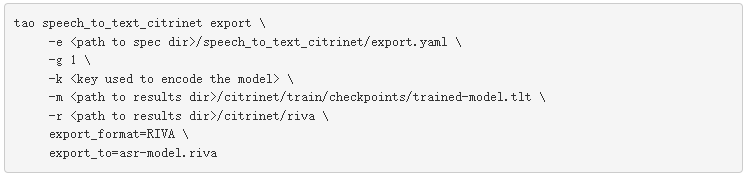

將微調(diào)模型導(dǎo)出到 Riva

在生產(chǎn)環(huán)境中部署模型會(huì)帶來一系列挑戰(zhàn)。為此,您可以使用NVIDIA Riva,一種 GPU 加速 AI 語音 SDK 來開發(fā)實(shí)時(shí)轉(zhuǎn)錄和虛擬助理等應(yīng)用程序。

Riva 使用其他 NVIDIA 產(chǎn)品:

NVIDIA Triton Inference Server用于簡(jiǎn)化大規(guī)模生產(chǎn)中模型的部署。

NVIDIA TensorRT用于通過優(yōu)化 NVIDIA GPU s 的模型來加速模型并提供更好的推理性能。

如果您對(duì)使用本演練中微調(diào)的模型感興趣,可以使用以下命令將其導(dǎo)出到 Riva 。

在下一篇文章中,我們將介紹如何安裝 NVIDIA Riva 在生產(chǎn)環(huán)境中部署這些模型,以及如何使用NGC Catalog中的眾多模型之一。

關(guān)于作者

About Tanay Varshney

Tanay Varshney 是 NVIDIA 的一名深入學(xué)習(xí)的技術(shù)營(yíng)銷工程師,負(fù)責(zé)廣泛的 DL 軟件產(chǎn)品。他擁有紐約大學(xué)計(jì)算機(jī)科學(xué)碩士學(xué)位,專注于計(jì)算機(jī)視覺、數(shù)據(jù)可視化和城市分析的橫斷面。

About Sirisha Rella

Sirisha Rella 是 NVIDIA 的技術(shù)產(chǎn)品營(yíng)銷經(jīng)理,專注于計(jì)算機(jī)視覺、語音和基于語言的深度學(xué)習(xí)應(yīng)用。 Sirisha 獲得了密蘇里大學(xué)堪薩斯城分校的計(jì)算機(jī)科學(xué)碩士學(xué)位,是國(guó)家科學(xué)基金會(huì)大學(xué)習(xí)中心的研究生助理。

審核編輯:郭婷

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5274瀏覽量

105992 -

人工智能

+關(guān)注

關(guān)注

1805文章

48871瀏覽量

247675

發(fā)布評(píng)論請(qǐng)先 登錄

嵌入式和人工智能究竟是什么關(guān)系?

人工智能、機(jī)器學(xué)習(xí)和深度學(xué)習(xí)存在什么區(qū)別

使用遷移學(xué)習(xí)定制人工智能深度學(xué)習(xí)模型

使用遷移學(xué)習(xí)定制人工智能深度學(xué)習(xí)模型

評(píng)論