/ 導(dǎo)讀 /

2021年10月25日,特斯拉市值站上萬(wàn)億美金,成為美股第五家市值破萬(wàn)億的企業(yè),幾乎超過美股全部主要車企市值的總和。特斯拉在資本市場(chǎng)的成功,刺激著投資者的神經(jīng),也促使市場(chǎng)再一次將視野聚焦在自動(dòng)駕駛領(lǐng)域,進(jìn)一步思考自動(dòng)駕駛技術(shù)路線的發(fā)展方向。

本文希望從技術(shù)角度客觀分析和回答以下問題:自動(dòng)駕駛等級(jí)提升需要解決什么關(guān)鍵問題?怎樣的自動(dòng)駕駛方案更加具有實(shí)現(xiàn)大規(guī)模無(wú)人駕駛的可能性?自動(dòng)駕駛作為現(xiàn)實(shí)世界的AI問題,難點(diǎn)在哪里?以上問題促使我們理性客觀地思考該如何去實(shí)現(xiàn)自動(dòng)駕駛——這一承載了太多期望、不斷挑撥大眾神經(jīng)的技術(shù)生產(chǎn)力變革,從而推動(dòng)行業(yè)冷靜且務(wù)實(shí)地向前發(fā)展。

自動(dòng)駕駛的眼睛:

基于高質(zhì)量圖像成像的視覺雷達(dá)

隨著自動(dòng)駕駛等級(jí)的不斷提高,控制權(quán)和責(zé)任主體逐漸從駕駛員轉(zhuǎn)換為車輛,智駕系統(tǒng)的定位也將由擴(kuò)增人的感知能力到接管車輛自主駕駛。由此對(duì)智駕系統(tǒng)之于物理世界環(huán)境理解的要求完全不同,將由對(duì)物理世界部分信息的提取提升到事無(wú)巨細(xì)的全面感知與理解。而這種變化,首要就是對(duì)2D圖像成像與3D建模的越來(lái)越高的要求:1)更高分辨率和環(huán)境適應(yīng)度的2D圖像成像;2)對(duì)物理世界準(zhǔn)確且稠密的實(shí)時(shí)3D建模。

Camera是自動(dòng)駕駛感知物理世界最重要的傳感器,其分辨率的提升將極大的提升圖像的信息承載量,使得自動(dòng)駕駛系統(tǒng)能夠感知更加細(xì)節(jié)和更遠(yuǎn)距離的行車環(huán)境。當(dāng)前主流自動(dòng)駕駛前視攝像頭的分辨率已經(jīng)到800萬(wàn)像素以上,而更高的分辨率也是未來(lái)必然發(fā)生的事情。自動(dòng)駕駛汽車面臨的是一個(gè)開放性的外部環(huán)境,除了分辨率的提升,還需要提升自動(dòng)駕駛在各種行車路況下的圖像成像質(zhì)量,比如不同的光線環(huán)境,傍晚、夜晚等,不同的氣候環(huán)境,雨雪霧天等。相對(duì)于傳統(tǒng)汽車應(yīng)用的車載成像,自動(dòng)駕駛對(duì)于車載成像質(zhì)量的要求將極大提升,如何通過成像計(jì)算獲取更高質(zhì)量的圖像就成為一個(gè)要解決的關(guān)鍵性問題。

自動(dòng)駕駛汽車在三維物理世界中運(yùn)行,必然要求對(duì)物理世界進(jìn)行更加深刻的三維理解。當(dāng)前的高級(jí)別輔助駕駛在道路上不斷出現(xiàn)各種各樣的事故,這些事故的發(fā)生很大程度上是由于沒有識(shí)別到未被樣本庫(kù)所覆蓋的異形、非標(biāo)等物體,比如一輛拉著一棵樹的貨車等,而這些corner case是無(wú)法被窮盡的。對(duì)于行車環(huán)境的實(shí)時(shí)稠密3D建模不僅可以識(shí)別異形和非標(biāo)等物體,還能判斷路面坑洼與起伏,這無(wú)疑將大大提升自動(dòng)駕駛的安全級(jí)別。當(dāng)前自動(dòng)駕駛的3D環(huán)境感知,主要依賴激光雷達(dá)等主動(dòng)投射測(cè)量裝置,但其在分辨率上遠(yuǎn)低于Camera,也不具備顏色信息。隨著深度學(xué)習(xí)的發(fā)展,單目深度估計(jì)、雙目立體視覺、SFM、MVS等問題已經(jīng)可以被深度神經(jīng)網(wǎng)絡(luò)所建模,從而可以基于多目視覺通過AI的方法實(shí)時(shí)生成3D點(diǎn)云,其視覺點(diǎn)云天然與圖像對(duì)齊,并且其分辨率也能達(dá)到圖像分辨率的級(jí)別。因此,如何通過多目視覺實(shí)現(xiàn)高分辨率的實(shí)時(shí)稠密3D建模,即視覺雷達(dá),是另外一個(gè)要解決的關(guān)鍵性問題。

視覺傳感器的信息承載量極高,目前遠(yuǎn)未被充分挖掘,但無(wú)論2D圖像成像還是實(shí)時(shí)稠密3D建模都需要強(qiáng)有力的算法和算力進(jìn)行支撐,這需要算法和算力進(jìn)行協(xié)同設(shè)計(jì)。視覺傳感器+算力+算法的傳感器計(jì)算模式,將更加本質(zhì)的推動(dòng)解決自動(dòng)駕駛當(dāng)前面臨的關(guān)鍵問題,即從2D和3D層面對(duì)物理世界進(jìn)行事無(wú)巨細(xì)的感知與理解。

鑒智機(jī)器人核心團(tuán)隊(duì)擁有超過十年的圖像處理、AI算法和算力設(shè)計(jì)的行業(yè)經(jīng)驗(yàn),將以視覺傳感器為核心,通過解決車載ISP、視覺雷達(dá)等視覺傳感器2D、3D成像的核心問題,打造更加強(qiáng)大的自動(dòng)駕駛之眼,從而推動(dòng)自動(dòng)駕駛安全等級(jí)的提升。

1.1 從手機(jī)ISP到車載ISP

ISP(Image Signal Processor)是指通過一系列數(shù)字圖像處理算法完成對(duì)數(shù)字圖像的成像處理。在攝像機(jī)成像的整個(gè)環(huán)節(jié)中,ISP負(fù)責(zé)接收感光元件的原始信號(hào)數(shù)據(jù),可以理解為整個(gè)攝像機(jī)圖像輸出的第一步處理流程。ISP在提高圖像質(zhì)量、增強(qiáng)數(shù)據(jù)的一致性等方面有著極其關(guān)鍵的作用。

得益于智能手機(jī)的發(fā)展和手機(jī)攝像頭像素越來(lái)越高,手機(jī)ISP在過去幾年得到了快速的發(fā)展和進(jìn)步,手機(jī)拍照和錄像的質(zhì)量也越來(lái)越高,甚至到了驚艷的地步。比如在夜晚等場(chǎng)景,可以拍到比人眼看到的更清晰、光照更充足、色彩更豐富的照片;比如在進(jìn)出隧道等光照變化劇烈的場(chǎng)景,也可以錄制出比人眼表現(xiàn)更穩(wěn)定、更清晰的視頻。這些效果除了源于手機(jī)攝像頭硬件上的升級(jí),專門的AI ISP處理算法和處理芯片也起到了至關(guān)重要的作用。

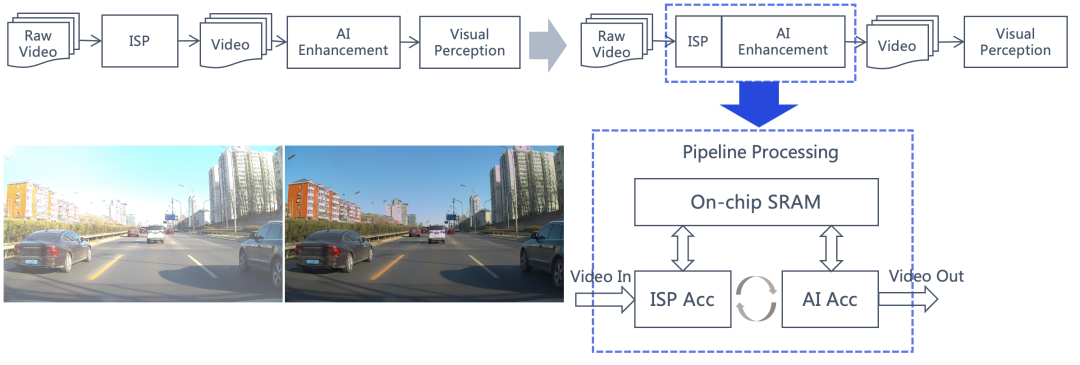

隨著自動(dòng)駕駛對(duì)車載成像質(zhì)量的階躍式提升需求,車載ISP,特別是針對(duì)駕駛場(chǎng)景優(yōu)化的AI ISP處理算法和處理芯片,將迎來(lái)爆發(fā)式的發(fā)展。AI在車載ISP整個(gè)流程中將變得越來(lái)越重要,特別是在降噪、去模糊、HDR等問題上,可以在夜晚、陽(yáng)光直射、進(jìn)出隧道等暗光、強(qiáng)光、高動(dòng)態(tài)場(chǎng)景得到遠(yuǎn)超人眼的成像效果,同時(shí)最大程度上解決由Sensor引起的噪點(diǎn)、模糊等問題。將AI計(jì)算前置在ISP計(jì)算Pipeline中,通過流式計(jì)算,使得ISP的計(jì)算Pipeline不被打斷,也將大大提升AI ISP的性能功耗比。

鑒智機(jī)器人擁有全鏈路的芯片級(jí)ISP IP的設(shè)計(jì)能力,將解決ISP特別是AI ISP在車載場(chǎng)景的核心問題,讓車載攝像頭成像更清晰,從而進(jìn)一步提高視覺雷達(dá)點(diǎn)云生成和圖像語(yǔ)義感知等后續(xù)任務(wù)的準(zhǔn)確性。

圖1:鑒智機(jī)器人擁有全鏈路的ISP算法和算法硬核化設(shè)計(jì)能力

1.2 從2D感知到視覺雷達(dá)

面對(duì)大規(guī)模自動(dòng)駕駛,對(duì)3D點(diǎn)云的信息稠密程度、場(chǎng)景泛化性、性能可擴(kuò)展性方面提出了更高的要求。基于視覺雷達(dá),通過雙目或者多目立體視覺計(jì)算,產(chǎn)生實(shí)時(shí)稠密的3D點(diǎn)云是更優(yōu)的方式。

雙目立體視覺是機(jī)器視覺的一種重要形式,與人眼類似,它是基于視差原理,通過計(jì)算圖像對(duì)應(yīng)點(diǎn)間的位置偏差,來(lái)獲取物體三維幾何信息的方法,和基于TOF、結(jié)構(gòu)光原理的深度相機(jī)不同,它不對(duì)外主動(dòng)投射光源,完全依靠拍攝的兩張圖片(彩色RGB或者灰度圖)來(lái)計(jì)算深度。

傳統(tǒng)的雙目立體匹配算法針對(duì)弱紋理、反光等區(qū)域效果比較差,同時(shí)對(duì)于物體語(yǔ)義信息利用比較少,算法適用范圍具有局限性,點(diǎn)云效果上限比較明顯。隨著深度學(xué)習(xí)技術(shù)的發(fā)展,基于CNN、Cost Volume、Transformer的立體匹配算法展現(xiàn)出來(lái)了極強(qiáng)的算法效果和潛力。目前知名自動(dòng)駕駛數(shù)據(jù)集KITTI上的立體匹配任務(wù)排名靠前的基本都是基于深度學(xué)習(xí)的算法。基于深度學(xué)習(xí)的雙目立體匹配算法對(duì)于計(jì)算芯片的AI算力提出了比較高的要求,對(duì)于研發(fā)模式也提出了新的要求,需要從傳統(tǒng)的雙目相機(jī)研發(fā)模式變成以AI為核心、軟硬結(jié)合、數(shù)據(jù)驅(qū)動(dòng)的研發(fā)模式。

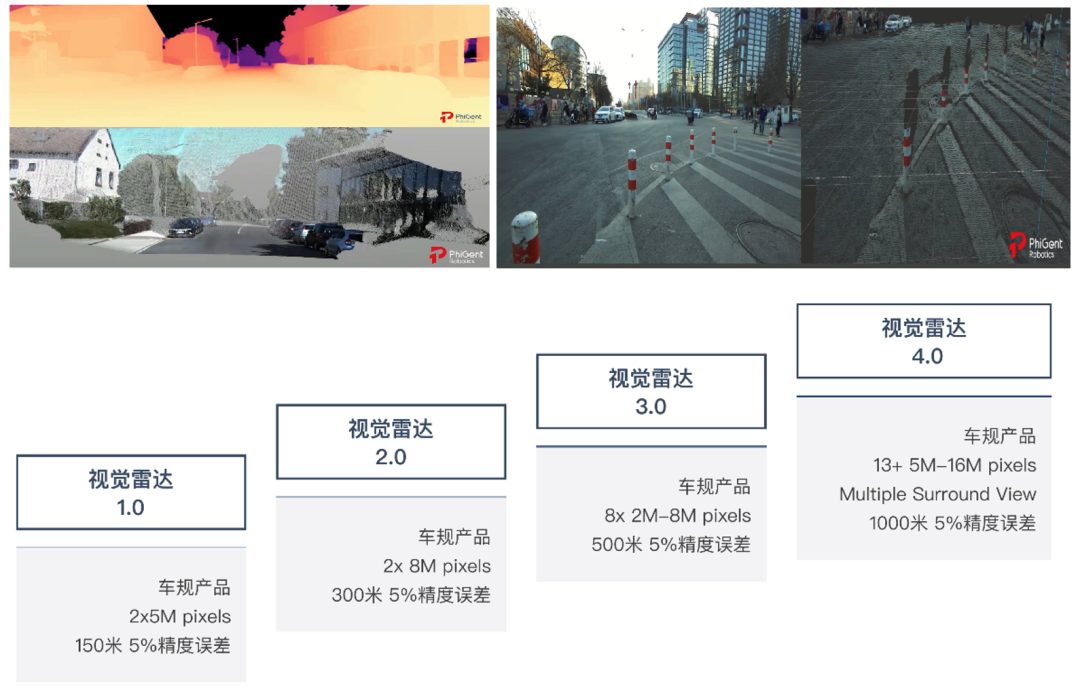

從雙目立體視覺更進(jìn)一步,充分利用相機(jī)的運(yùn)動(dòng)信息和多個(gè)相機(jī)間的幾何約束,通過相機(jī)姿態(tài)估計(jì)、深度估計(jì)、光流估計(jì)、MVS等算法,以及任務(wù)之間互相監(jiān)督的一系列自監(jiān)督算法,可以得到360度的點(diǎn)云數(shù)據(jù),也就是視覺雷達(dá),從而形成與圖像分辨率相匹配的稠密點(diǎn)云。同時(shí),以攝像頭+算力+算法為核心的視覺雷達(dá),還具有產(chǎn)業(yè)鏈成熟可控、成本可控、器件穩(wěn)定性有保證、滿足車規(guī)等優(yōu)勢(shì),更容易實(shí)現(xiàn)大規(guī)模前裝量產(chǎn)上車使用。

圖2:鑒智機(jī)器人視覺雷達(dá)Roadmap

自動(dòng)駕駛的大腦: 全流程數(shù)據(jù)驅(qū)動(dòng)的強(qiáng)單車智能

自動(dòng)駕駛的大腦負(fù)責(zé)從感知到?jīng)Q策的駕駛?cè)鞒蹋彩亲詣?dòng)駕駛最復(fù)雜、最核心和難度最高的部分。傳統(tǒng)的以規(guī)則為核心的軟件1.0工程化系統(tǒng),在可維護(hù)性、擴(kuò)展性和進(jìn)化性上都具有一定的局限性。以AI和軟件2.0為核心,全流程數(shù)據(jù)驅(qū)動(dòng)的感知、預(yù)測(cè)、規(guī)控算法和強(qiáng)單車智能的解決方案,無(wú)疑是實(shí)現(xiàn)大規(guī)模無(wú)人駕駛更可行的方案。

鑒智機(jī)器人核心團(tuán)隊(duì)在AI算法和應(yīng)用、軟件2.0的基礎(chǔ)設(shè)施、數(shù)據(jù)驅(qū)動(dòng)的大規(guī)模實(shí)踐上擁有豐富的經(jīng)驗(yàn),將通過全流程數(shù)據(jù)驅(qū)動(dòng)的自動(dòng)駕駛大腦,建立強(qiáng)單車智能,從而降低對(duì)外部基礎(chǔ)設(shè)施的依賴,更加利于自動(dòng)駕駛的復(fù)制與推廣。

2.1 深度學(xué)習(xí)帶來(lái)的2D感知技術(shù)突破

感知是自動(dòng)駕駛獲取信息的第一步, 所謂感知是指通過攝像頭或其他傳感器識(shí)別所看到的物體并理解該物體是什么,這對(duì)自動(dòng)駕駛是至關(guān)重要的環(huán)節(jié)。自動(dòng)駕駛車輛首先是要識(shí)別車道線,然后還要識(shí)別紅綠燈、標(biāo)志牌,除此之外就是識(shí)別障礙物比如前后左右有沒有車輛,有沒有行人,才能夠進(jìn)一步規(guī)劃行駛路線。

過去十年是人工智能技術(shù)的黃金十年,深度學(xué)習(xí)改變了計(jì)算機(jī)視覺整個(gè)領(lǐng)域,也帶來(lái)了2D感知各個(gè)方向技術(shù)的突破。2D感知主要有圖像分類、圖像(物體)識(shí)別、細(xì)粒度識(shí)別(人臉識(shí)別)等方向,所采用的技術(shù)也從最早的模板匹配、線性分類到現(xiàn)在所廣泛使用的深層卷積神經(jīng)網(wǎng)絡(luò),再到最近刷新各大視覺任務(wù)榜單的Transformer。隨著硬件計(jì)算能力的不斷提升、算法范式的不斷改進(jìn)、可利用數(shù)據(jù)資源的不斷增長(zhǎng),基于攝像頭的2D感知已經(jīng)成為了乘用車智能駕駛的主流方案,同時(shí)也成為了很多解決方案的核心差異點(diǎn)。

鑒智機(jī)器人核心團(tuán)隊(duì)在國(guó)內(nèi)最早基于深度學(xué)習(xí)在2D視覺感知各個(gè)方向開展系統(tǒng)性研究和大規(guī)模落地應(yīng)用,在眾多全球最具影響力的2D感知AI比賽和評(píng)測(cè)中獲得冠軍,發(fā)表頂級(jí)會(huì)議和期刊論文幾十余篇,在多個(gè)業(yè)務(wù)領(lǐng)域?qū)崿F(xiàn)了人工智能2D感知技術(shù)的大規(guī)模應(yīng)用落地。

(a)目標(biāo)檢測(cè)、人體骨骼點(diǎn)

(b)全景分割

(c)360°視覺感知

(d)單目

測(cè)距

圖3:鑒智機(jī)器人在2D感知方向具有世界一流的核心能力 2.2 從2D感知到4D感知

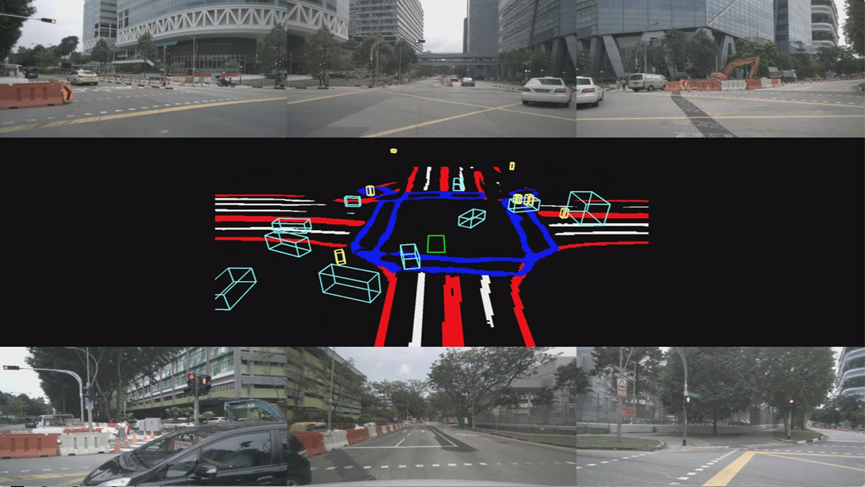

如果說(shuō)2D感知還是在平面上檢測(cè)、識(shí)別、分割物體,那么加入深度信息后,基礎(chǔ)的2D感知即轉(zhuǎn)化為3D感知。如果進(jìn)一步在3D的基礎(chǔ)上加入時(shí)間這一維度,進(jìn)化得到的則是4D感知。在自動(dòng)駕駛領(lǐng)域,4D感知可以完整且連續(xù)的探測(cè)車輛周圍的物體。

基于深度學(xué)習(xí)和三維視覺技術(shù)不斷發(fā)展,隨著Cost Volume、Optical Flow、differentiable Homography、Transformer等技術(shù)的成熟,以及多傳感器融合、眾包重建、稠密重建、自動(dòng)標(biāo)注等方向不斷發(fā)展,可以高效率的提供高質(zhì)量、大規(guī)模的4D場(chǎng)景數(shù)據(jù),端到端的4D感知正在成為技術(shù)趨勢(shì)。相比于傳統(tǒng)的2D感知+后融合的方案,端到端的4D感知擁有很多優(yōu)勢(shì),可以解決測(cè)距抖動(dòng)較大、多攝像頭拼接不準(zhǔn)確、時(shí)序結(jié)果不穩(wěn)定、迭代效率較低等一系列問題。

更進(jìn)一步,基于端到端的4D感知,可以進(jìn)行更好的4D預(yù)測(cè),一方面可對(duì)于交通參與者進(jìn)行更優(yōu)的運(yùn)動(dòng)軌跡預(yù)測(cè),從而實(shí)現(xiàn)性能更加優(yōu)異的規(guī)劃控制;另一方面可對(duì)于道路行駛區(qū)域預(yù)測(cè)更加精細(xì)的3D結(jié)構(gòu)化信息,在線生成局部實(shí)時(shí)3D地圖,降低對(duì)高精地圖等基礎(chǔ)設(shè)施的依賴。

圖4:鑒智機(jī)器人針對(duì)復(fù)雜路口駕駛場(chǎng)景的4D感知結(jié)果

自動(dòng)駕駛被認(rèn)為是目前最重要的硬科技創(chuàng)新之一。在汽車行業(yè)百年未有之大變革的歷史性時(shí)刻,中國(guó)由于在電動(dòng)汽車領(lǐng)域的提前布局、全面開花,以及完整產(chǎn)業(yè)鏈的巨大優(yōu)勢(shì),國(guó)內(nèi)企業(yè)在自動(dòng)駕駛方向擁有非常好的機(jī)會(huì)和產(chǎn)業(yè)優(yōu)勢(shì),有機(jī)會(huì)通過電動(dòng)化和智能化實(shí)現(xiàn)百年汽車工業(yè)這一最重要的支柱產(chǎn)業(yè)的超車和領(lǐng)先。但自動(dòng)駕駛的發(fā)展速度仍然低于大眾和市場(chǎng)的預(yù)期,這里存在若干影響自動(dòng)駕駛等級(jí)提升的關(guān)鍵性問題亟待解決,鑒智機(jī)器人基于自身在AI算法、AI算力層面的積累,致力于解決自動(dòng)駕駛成像計(jì)算和下一代自動(dòng)駕駛方案的關(guān)鍵性問題,從而推動(dòng)自動(dòng)駕駛的創(chuàng)新發(fā)展。

審核編輯 :李倩

-

傳感器

+關(guān)注

關(guān)注

2553文章

51528瀏覽量

757408 -

雷達(dá)

+關(guān)注

關(guān)注

50文章

2975瀏覽量

118158 -

自動(dòng)駕駛

+關(guān)注

關(guān)注

785文章

13960瀏覽量

167287

原文標(biāo)題:通過傳感器計(jì)算打造視覺雷達(dá),下一代自動(dòng)駕駛系統(tǒng)的關(guān)鍵構(gòu)成

文章出處:【微信號(hào):WW_CGQJS,微信公眾號(hào):傳感器技術(shù)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

相關(guān)推薦

英飛凌發(fā)布RASIC? CTRX8191F雷達(dá)MMIC,助力自動(dòng)駕駛升級(jí)

借助谷歌Gemini和Imagen模型生成高質(zhì)量圖像

馬斯克重申:純視覺是自動(dòng)駕駛的未來(lái)

感知融合為自動(dòng)駕駛與機(jī)器視覺解開當(dāng)前無(wú)解場(chǎng)景之困

自動(dòng)駕駛技術(shù)的典型應(yīng)用 自動(dòng)駕駛技術(shù)涉及到哪些技術(shù)

激光雷達(dá)與純視覺方案,哪個(gè)才是自動(dòng)駕駛最優(yōu)選?

FPGA在自動(dòng)駕駛領(lǐng)域有哪些優(yōu)勢(shì)?

FPGA在自動(dòng)駕駛領(lǐng)域有哪些應(yīng)用?

行易道與韓國(guó)自動(dòng)駕駛公司簽署技術(shù)開發(fā)協(xié)議

Arbe推出軟件定義雷達(dá)架構(gòu),推動(dòng)駕駛輔助和自動(dòng)駕駛快速發(fā)展

未來(lái)已來(lái),多傳感器融合感知是自動(dòng)駕駛破局的關(guān)鍵

百度自動(dòng)駕駛蘿卜快跑入選“2023年度中國(guó)車谷經(jīng)濟(jì)高質(zhì)量發(fā)展企業(yè)”

環(huán)宇智行成功入選“2023年度中國(guó)車谷經(jīng)濟(jì)高質(zhì)量發(fā)展企業(yè)”名單

自動(dòng)駕駛的眼睛:基于高質(zhì)量圖像成像的視覺雷達(dá)

自動(dòng)駕駛的眼睛:基于高質(zhì)量圖像成像的視覺雷達(dá)

評(píng)論