本篇綜述通過對現有的多模態圖像合成與編輯方法的歸納總結,對該領域目前的挑戰和未來方向進行了探討和分析。

近期 OpenAI 發布的 DALLE-2 和谷歌發布的 Imagen 等實現了令人驚嘆的文字到圖像的生成效果,引發了廣泛關注并且衍生出了很多有趣的應用。而文字到圖像的生成屬于多模態圖像合成與編輯領域的一個典型任務。 近日,來自馬普所和南洋理工等機構的研究人員對多模態圖像合成與編輯這一大領域的研究現狀和未來發展做了詳細的調查和分析。

論文地址:https://arxiv.org/pdf/2112.13592.pdf

項目地址:https://github.com/fnzhan/MISE

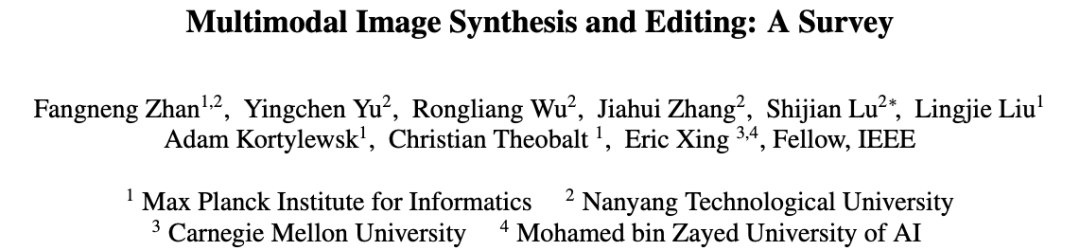

在第一章節,該綜述描述了多模態圖像合成與編輯任務的意義和整體發展,以及本論文的貢獻與總體結構。 在第二章節,根據引導圖片合成與編輯的數據模態,該綜述論文介紹了比較常用的視覺引導(比如 語義圖,關鍵點圖,邊緣圖),文字引導,語音引導,場景圖(scene graph)引導和相應模態數據的處理方法以及統一的表示框架。 在第三章節,根據圖像合成與編輯的模型框架,該論文對目前的各種方法進行了分類,包括基于 GAN 的方法,自回歸方法,擴散模型方法,和神經輻射場(NeRF)方法。

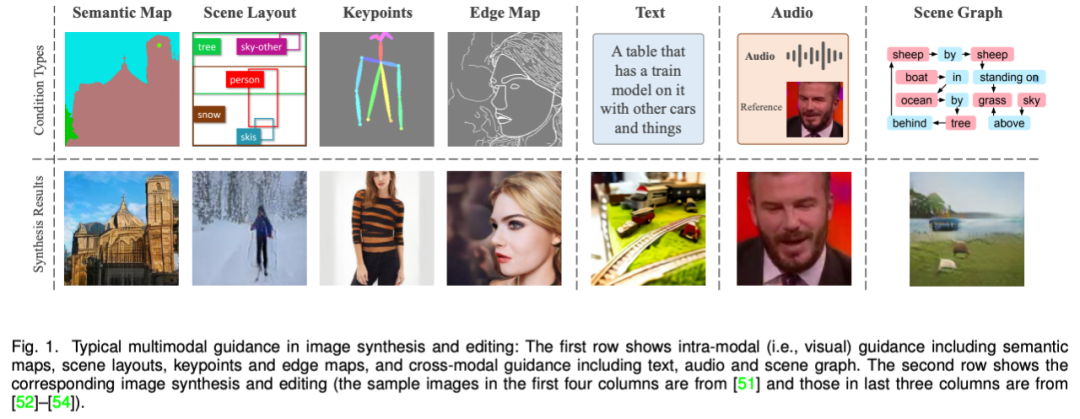

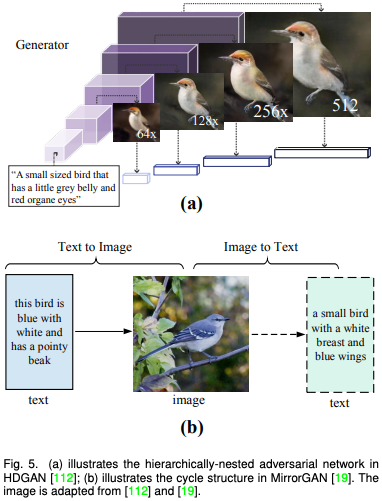

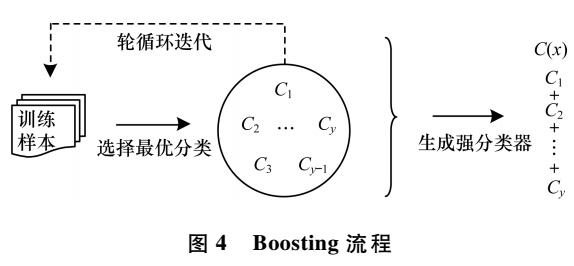

由于基于 GAN 的方法一般使用條件 GAN 和 無條件 GAN 反演,因此該論文將這一類別進一步分為模態內條件(例如語義圖,邊緣圖),跨模態條件(例如文字和語音),和 GAN 反演(統一模態)并進行了詳細描述。

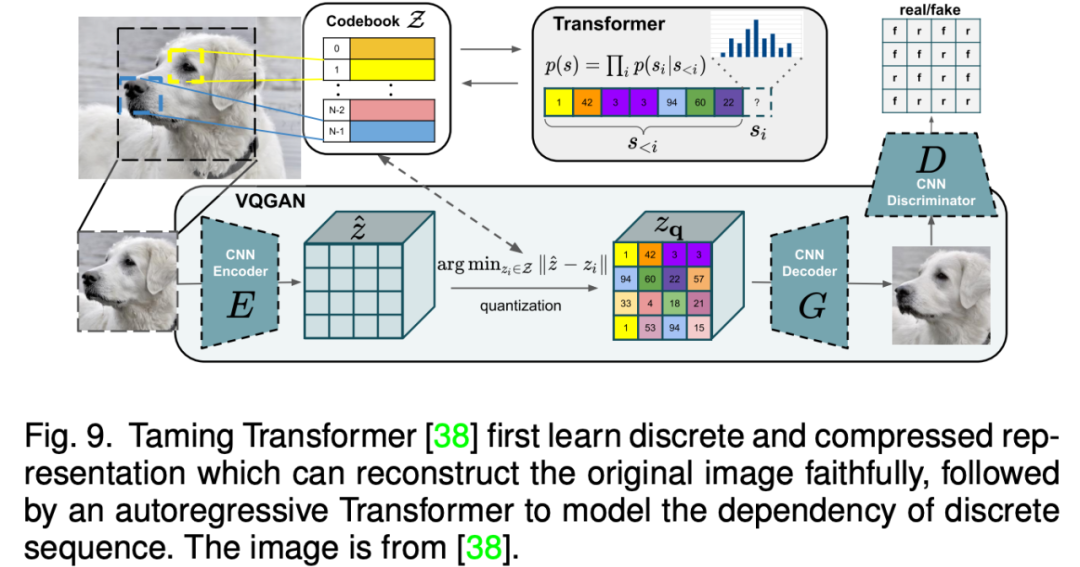

相比于基于 GAN 的方法,自回歸模型方法能夠更加自然的處理多模態數據,以及利用目前流行的 Transformer 模型。自回歸方法一般先學習一個向量量化編碼器將圖片離散地表示為 token 序列,然后自回歸式地建模 token 的分布。由于文本和語音等數據都能表示為 token 并作為自回歸建模的條件,因此各種多模態圖片合成與編輯任務都能統一到一個框架當中。

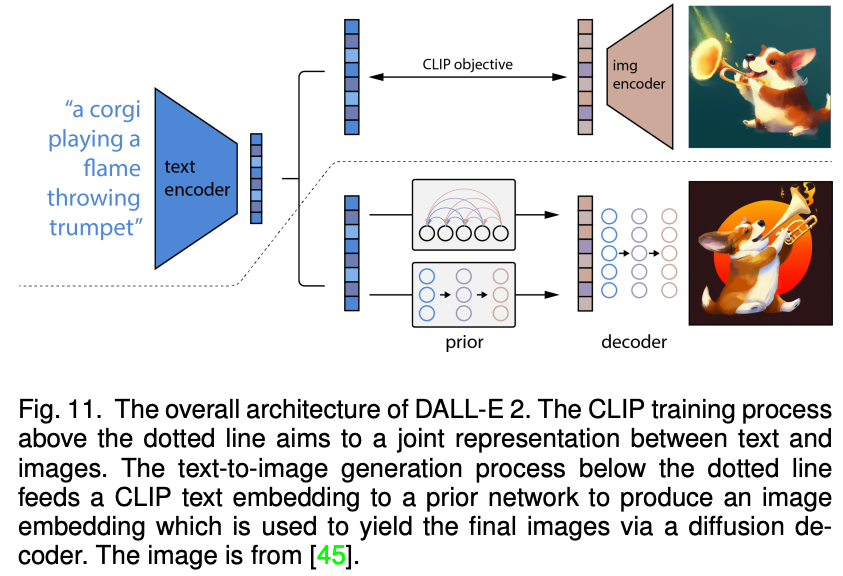

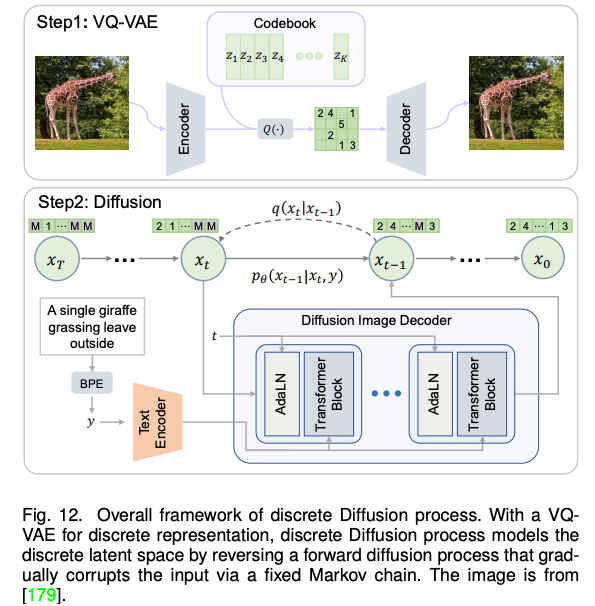

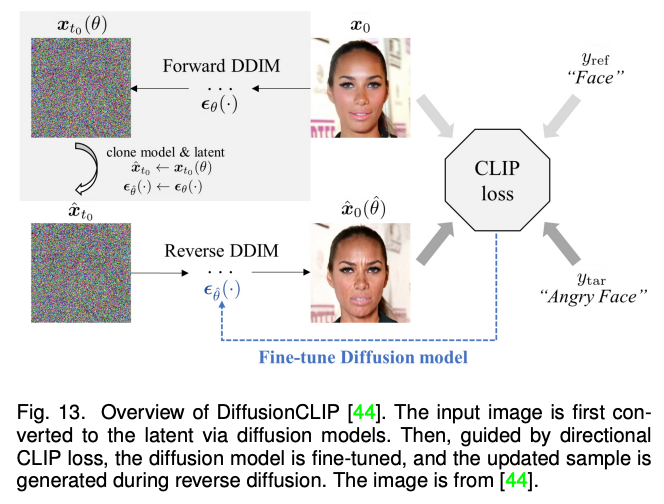

近期,火熱的擴散模型也被廣泛應用于多模態合成與編輯任務。例如效果驚人的 DALLE-2 和 Imagen 都是基于擴散模型實現的。相比于 GAN,擴散式生成模型擁有一些良好的性質,比如靜態的訓練目標和易擴展性。該論文依據條件擴散模型和預訓練擴散模型對現有方法進行了分類與詳細分析。

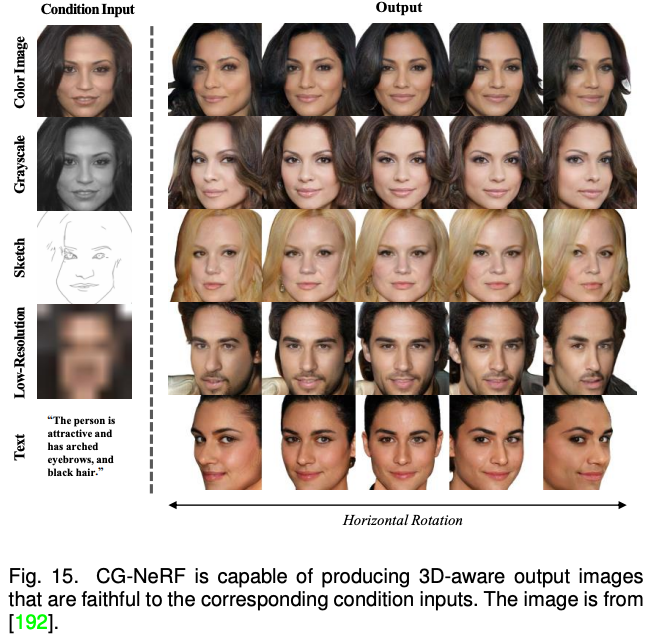

以上方法主要聚焦于 2D 圖像的多模態合成與編輯。近期隨著神經輻射場(NeRF)的迅速發展,3D 感知的多模態合成與編輯也吸引了越來越多的關注。由于需要考慮多視角一致性,3D 感知的多模態合成與編輯是更具挑戰性的任務。本文針對單場景優化 NeRF,生成式 NeRF 和 NeRF 反演的三種方法對現有工作進行了分類與總結。 隨后,該綜述對以上四種模型方法的進行了比較和討論。總體而言,相比于 GAN,目前最先進的模型更加偏愛自回歸模型和擴散模型。而 NeRF 在多模態合成與編輯任務的應用為這個領域的研究打開了一扇新的窗戶。

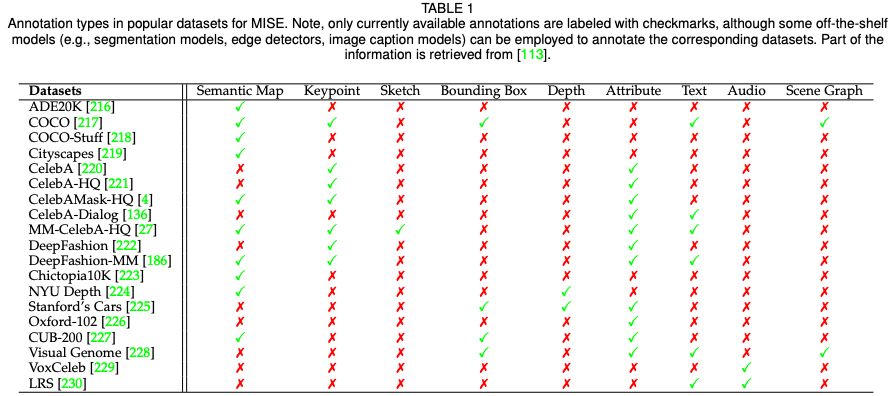

在第四章節,該綜述匯集了多模態合成與編輯領域流行的數據集以及相應的模態標注,并且針對各模態典型任務(語義圖像合成,文字到圖像合成,語音引導圖像編輯)對當前方法進行了定量的比較。 在第五章節,該綜述對此領域目前的挑戰和未來方向進行了探討和分析,包括大規模的多模態數據集,準確可靠的評估指標,高效的網絡架構,以及 3D 感知的發展方向。 在第六和第七章節,該綜述分別闡述了此領域潛在的社會影響和總結了文章的內容與貢獻。

-

谷歌

+關注

關注

27文章

6228瀏覽量

107740 -

數據

+關注

關注

8文章

7249瀏覽量

91320 -

圖像

+關注

關注

2文章

1094瀏覽量

41084

原文標題:多模態圖像合成與編輯這么火,馬普所、南洋理工等出了份詳細綜述

文章出處:【微信號:CVSCHOOL,微信公眾號:OpenCV學堂】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

基于多通道分類合成的SAR圖像分類研究

高分辨率合成孔徑雷達圖像的直線特征多尺度提取方法

基于超圖的多模態關聯特征處理方法

基于雙殘差超密集網絡的多模態醫學圖像融合方法

基于聯合壓縮感知的多模態目標統一跟蹤方法

簡述文本與圖像領域的多模態學習有關問題

VisCPM:邁向多語言多模態大模型時代

大模型+多模態的3種實現方法

多模態圖像合成與編輯方法

多模態圖像合成與編輯方法

評論