嵌入式 AI

AI 簡報 20221104 期

1. 端側智能化,在MCU中集成AI功能!

原文:

https://mp.weixin.qq.com/s/VJL4CZBTRzJKAlYv8EG3vw

在MCU中集成AI功能

IoT應用由感知、計算、執行、連接和安全幾部分組成。工作流程基本是:首先,由傳感器檢測環境信息,將模擬信號轉換為數字信號,傳遞給MCU;接著,MCU對這些數據進行計算分析和處理,得出決策結果,傳遞給執行層;再接著,執行層根據指令完成相應的動作。在這個過程中,必要的數據也會通過無線連接的方式上傳到云端進行云AI運算或存儲。

過去AI運算多在云端,現在逐漸向邊緣端發展。目前的情況是一般在云端進行機器學習(簡稱ML)訓練,推理除了在云端完成,也可以在設備端進行。在邊緣端進行ML的處理,可以提高本地的設備響應,減少云端上傳的數據帶寬,提高本地數據的安全性。當前一些企業會在MCU中添加特定加速器,通過專用算力進行ML的運算,從而釋放CPU的通用算力。

隨著5G技術的發展,人們對傳統產品的延遲和能耗提出了更高的要求。在MCU中融入人工智能算法,可以將MCU低功耗、低成本、實時性、穩定性、開發周期短、廣闊的市場覆蓋率等特性與人工智能強大的處理能力相結合,從而更有利于終端智能化。

在應用層面,圖像和語音處理是MCU+AI的重要應用方向,比如圖形識別、語音助手喚醒詞處理以及其他用于各種安全系統的聲音分類等應用。人工智能終將會滲透進人們生活的方方面面,而通過MCU來完成一些AI運算,也是未來的重要趨勢。

越來越多的廠商布局

從目前的情況來看,全球主要幾家MCU廠商都已經在該領域有所布局,包括意法半導體、瑞薩、恩智浦、英飛凌等等。

意法半導體從2007年起開始設計基于ARM Cortex-M的STM32 32位MCU系列,目前意法半導體通用MCU銷量已位居全球首位,擁有基于ARM Cortex-M0/M0+/M3/M4/M7/M33,ARM Cortex A7等多個內核,超過1200個料號的多系列、多功能覆蓋的全面MCU產品線。

該公司此前表示,近幾年,智能家電的快速發展,對MCU的性能、互聯提出了越來越高的要求,基于MCU平臺運行人工智能和機器學習,發展性能更高、功耗更低的邊緣計算,正在成為行業熱點。面對這樣的趨勢,意法半導體很早就開始布局智能的MCU。

意法半導體的軟件工具STM32CubeMX中就集成了AI模塊,可以方便客戶將訓練好的AI模型轉換為MCU上運行的軟件,使MCU可以方便實現AI功能。

瑞薩電子在MCU領域也有很深的積累。今年6月9日,該公司宣布買下美國從事機器學習模型開發的新創企業Reality AI。

Reality AI公司的強項在于聲音和視覺之外的傳感器數據解析,例如工廠偵測異音或是汽車的語音辨識等都可應用到相關技術。瑞薩買下Reality AI,將可以結合自家MCU 產品,以及該公司的開發環境和推論軟體等,對外提供支持AI運算的MCU。此前,雖然瑞薩有自行研發機器控制用途的MCU,但AI相關應用軟件都是向外部合作伙伴購買的。

恩智浦也推出了內置NPU的MCU,該公司表示,AI應用最開始是在云端,而現在有一個很明顯的趨勢,從PC到嵌入式端的需求越來越多。人臉/語音識別門鎖、以及包括語音識別、物體識別等在內的各種識別裝置,都提出了在本地實現更多推理的需求。

以前的應用對一款微控制器的要求是,按下按鈕就有很快的反應。現在就不止這些了,人們希望處理器本身具有預知性,這就需要增加人工智能技術。

恩智浦推出了針對MCU現有應用場景進行升級的內置NPU的MCX,在傳統控制應用基礎上增加AI元素,在醫療設備、無人機或者工業控制中加上智能識別、故障檢測、語音控制等。

基于NPU的MCX可以應用在一些更新的場景中,比如可以識別物體的秤,只需把物體放在秤上就可以直接結賬;在醫學檢測中,可以用于檢測含瘧疾的紅細胞;在交通出行中,可以幫助智能車識別障礙,自動做出判斷和處理等等。

小結

整體而言,隨著物聯網時代的發展,作為物聯網設備中必不可少的計算大腦的MCU,也迎來了很好的市場增長機會。同時隨著AI、5G技術發展,一些新興應用場景也給MCU提出了新的要求,需要具備一定的AI功能。因此過去幾年越來越多的廠商在MCU中集成AI功能。

2. 半年內第二塊國產全功能GPU,附帶首個游戲顯卡!摩爾線程造芯神速,張建中“黃”氣逼人

原文:

https://mp.weixin.qq.com/s/TMhMjFZbw96n4CUkVQ_z1w

他來了,他來了。

手持GPU,一身黑皮衣、下裝牛仔褲、黃皮膚長頭發,黑框眼鏡之下擋不住硬漢氣場。

但他不是英偉達的老黃。

他是曾經老黃左膀右臂之一的老張——

張建中,James,此前在英偉達中國區任職一把手長達 15 年時間。

現在更被人熟知的頭銜,是國內 GPU 公司摩爾線程的創始人兼 CEO。

而這次剛剛捂熱的 GPU,已經是他在今年量產上市的第 2 個了——

時隔,僅半年之久。

不僅如此,附著在這塊 GPU 上的標簽還有更多:

國產、全功能、全球首個、中高端……

而且基于它,張建中更是發布了國內首個中高端游戲顯卡。

講真,很難想象這般 " 速度 " 是由一家剛剛成立 2 年的公司所創造的。

由此不免讓人心生疑問:

在做到快的同時,質量和性能上是否也一并跟上了呢?

我們不妨一同來看看。

全球首個支持 PCIe 接口的全功能 GPU

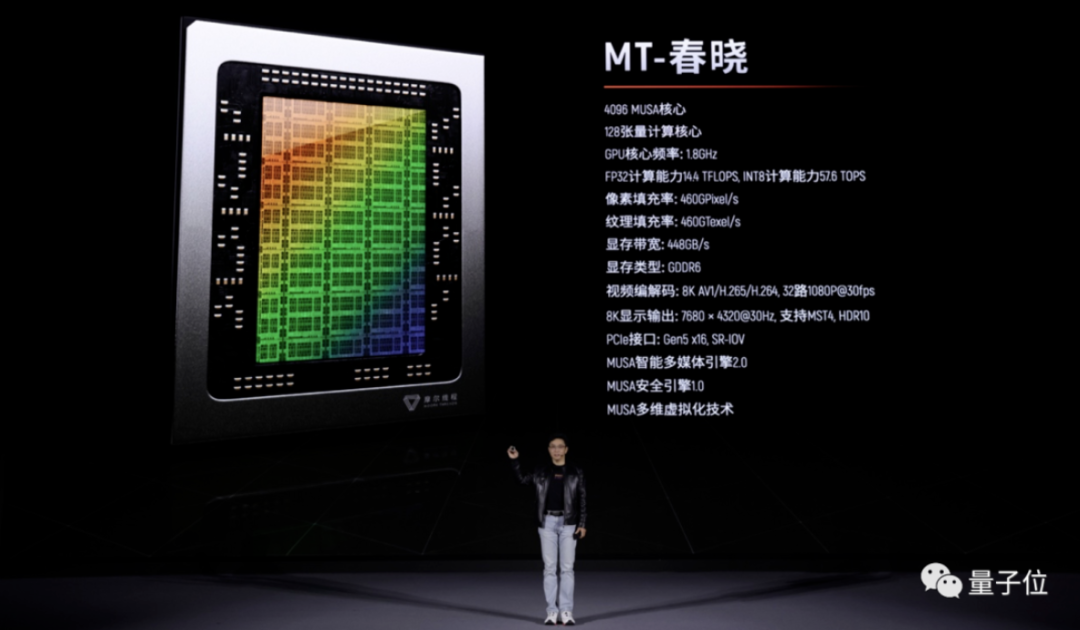

摩爾線程的第二個國產全功能 GPU,名為"MT- 春曉 "。

張建中也是將它作為打頭陣的產品發布。

據了解,春曉集成了 220 億個晶體管,內置 4096MUSA 架構通用計算核心以及 128 張量計算核心,可以支持 FP32、FP16 和 INT8 等計算精度。

其它重點參數如下:

GPU 核心頻率:1.8GHz

FP32 計算能力:14.4 TFLOPS

INT8 計算能力:57.6 TOPS

顯存寬帶:448GB/s

顯存類型:GDDR6

張健中在現場還提及,春曉解鎖了一項 " 全球第一 ":

因為它是業內唯一支持 PCIe Gen5 接口的 GPU。

(許多廠商已經達成共識,PCIe Gen5 將會是未來消費級以及企業級存儲設備的重點發展方向。)

那么與半年前摩爾線程所發布的" 蘇堤 "GPU相比,二者又有何區別?

張建中表示在摩爾線程 GPU 四大引擎方面,春曉做到了全面升級:

現代圖形渲染引擎性能最高提升 3-5 倍

AI 計算加速引擎性能最高提升 4 倍

智能多媒體引擎性能最高提升 4 倍

物理仿真引擎性能最高提升 2.5 倍

至于為什么摩爾線程要在半年時間就將自家 GPU 推陳出新,這個問題我們請教了下張健中:

我們第一個全功能 GPU 蘇堤,實際上屬于中低端處理器,在 GPU 行業中可以滿足國內國產化應用的需求。

但對于大部分主流用戶,他們還是期待更高性能的 GPU,因此我們快速發布了春曉,去滿足高端的游戲玩家,滿足更多用戶對圖形和計算的需要。

如此一來,我們的產品就能夠覆蓋高中低端的所有用戶。

而提到了游戲,張建中基于春曉 GPU,便發布了另一款 " 國內第一 " 的產品。

國內首款游戲顯卡

其實摩爾線程在半年前基于蘇堤也發布過顯卡產品MTT S60。

但這張顯卡的 " 用武之地 " 似乎更多面向的是產業,也就是 B 端。

而這次基于春曉打造的這張顯卡MTT S80,則是能讓更多大眾摸得著的那種了——國內首款游戲顯卡。

在現場,張建中還用了一個比較有意思的詞來形容它:" 國潮 "。

3. 平頭哥造芯模式,正式跑通!

原文:

https://mp.weixin.qq.com/s/Xem30MmEIP9FTuxUU9hpjg

“生死看淡,不服就干”,平頭哥造芯模式,正式跑通。

2022云棲大會現場,新進展再次由阿里云智能總裁張建鋒對外宣布。

倚天710已大規模應用,成為中國首個云上大規模應用的自研CPU。

在核心應用場景中,算力性價比提升30%以上,單位算力功耗(耗電量)降低60%以上。

張建鋒還宣布,倚天710的部署規模還會進一步擴大,未來兩年20%的新增算力都將使用自研CPU。

更直白翻譯,就是以后阿里云的芯片部署中,每10顆CPU芯片里就有2顆自研CPU。

這個進展和應用,為何重要?

首先,大規模部署代表著芯片產品獲得了市場檢驗,也意味著最難的生態一環達成閉環——雖然不如新硬件來的“刺激”,但意義和價值卻絲毫不遜于新品發布,甚至長遠來看,量級簡直不能相提并論。

其次,倚天710,作為一款基于Arm架構的云端CPU,想要在x86占主導地位的全球云計算和服務器芯片生態中立足,更是難上加難,目標十中有二更是Arm架構在云端里程碑式的新突破。

最后,倚天710的大規模部署,不僅是中國首個自研CPU的應用紀錄,還意味著誕生在造芯浪潮中的平頭哥模式干出來了!

縱觀半導體半個世紀的發展史,檢驗造芯模式的核心關鍵一以貫之:

-

造出來(設計和流片)

-

用得上(需求和性能)

-

用得好(功耗和成本)

-

離不開(工具和生態)

而在倚天710的進展中,這四大流程關鍵,平頭哥都(一口氣)完成了實踐證明。

唯一待解之謎,只剩下造芯模式的通關速度——

傳統IT時代的造芯公司和通用芯片,短則5~7年,長則可能10年……

而平頭哥的倚天710,僅僅用了2年。

所以這種模式和速度背后,根本原因是什么?

是半導體領域也面臨世紀變革?

抑或一個時代果真有一個時代的造芯模式?

4. 國產AI制藥新突破!深勢科技發布一站式藥研計算設計平臺Hermite

原文:

https://mp.weixin.qq.com/s/V-T4m1cX7VA0xILXL2p6bg

年度最受關注賽道——AI制藥,傳來最新進展:

深勢科技的新一代藥物計算設計平臺Hermite正式發布,并且迅速引發圈內熱議和關注。

傳統上,研發一款新藥平均需要耗費10-15年時間、花費26億美元,其中包括大量失敗嘗試的支出。

而AI for Science的新范式正是被寄予了提高研發成功率,從而加速研發周期、減少成本、最終提高新藥研發投資回報率的厚望。

此輪AI制藥熱潮始于預測蛋白質結構的AlphaFold系列,但這只是新藥研發的第一步。

后續還需要結構精修,到苗頭化合物篩選,再到先導化合物優化和性質預測等等。

這眾多環節,也都急需相應的新工具,新算法和不斷進步的認知。

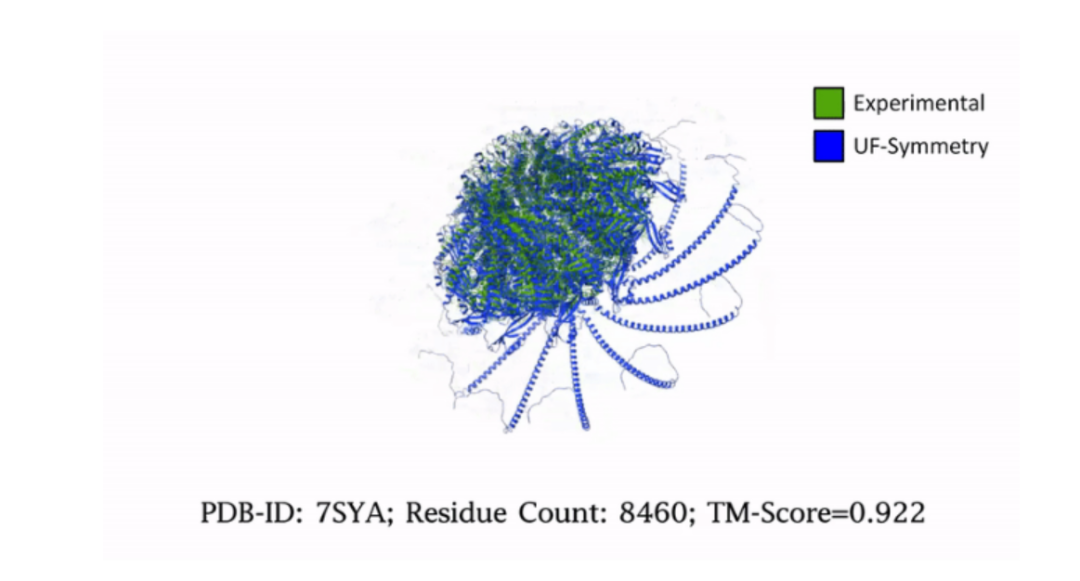

在科研工具方面,深勢科技團隊于去年推出Uni-Fold,全尺寸復現AlphaFold 2,并開源了訓練代碼與推理代碼,為國際上首家。

如今近一年過去,不但Uni-Fold在功能和速度上迎來諸多改進,還有更多后續核心功能集中發布。

這些功能整合在Hermite平臺上,致力于為藥物研發工作者提供在CADD(計算機輔助藥物設計)中數據、算法、算力三位一體的一站式解決方案。

藥物研發一站式解決方案Hermite

Hermite平臺的四大核心功能,對應著小分子藥物設計領域的各項流程。

首先,蛋白質結構預測與優化工具Uni-Fold是一個起點。

Uni-Fold做到精度與AlphaFold 2接近,但效率比AlphaFold 2 顯著提升,并克服了AlphaFold 2未開源訓練代碼、硬件支持單一、模型不可商用等局限性,

最近的升級中,Uni-Fold還在超大規模蛋白復合物預測上取得新突破,對包括離子通道、新冠病毒刺突糖蛋白等在內的對稱蛋白的進一步研究具有重大意義。

預測出靶點蛋白質的結構就可以進入苗頭化合物篩選環節,對應的是超高通量虛擬篩選工具Uni-Docking。

Uni-Docking在保持篩選精度的前提下,在GPU上實現了比單核CPU 1600倍的加速,最快0.5小時可完成1200萬可采買分子數據庫的篩選。

與MM GB/PBSA組成虛擬篩選工作流后,準確性還能進一步得到提升,將千萬級分子數據庫的虛擬篩選推入可及、可用、可靠的時代。

有了靶點和苗頭化合物,接下來還需要預測藥靶結合模式,對應工具為Uni-IFD。

通過模擬藥物分子與靶點結合產生的“誘導契合”效應,Uni-IFD可以精確預測藥物與靶點的結合模式。

同時,Uni-Aquasite可以通過計算得到每個水分子的自由能,尋找對藥靶結合影響較大的水分子。

最后,則是基于自由能微擾的先導化合物優化工具Uni-FEP。

Uni-FEP 基于自由能微擾理論、分子動力學、增強采樣算法,以化學精度高效評估蛋白質與配體的結合親和能。克服了傳統分子對接方法打分函數不準、采樣不足的問題。

適用于R基團優化、骨架躍遷、電荷轉移、大環成環等多種不同的優化場景,以實現工業規模的先導化合物優化。

5. 谷歌、OpenAI學者談AI:語言模型正在努力「攻克」數學

原文:

https://mp.weixin.qq.com/s/vAmpymJvkK8HRWFFCjMyiw

如果問計算機擅長什么,在所有的答案里,數學必須榜上有名。在經歷了漫長的研究之后,頂尖學者們在研究計算機關于數學計算方面的發展,取得了令人驚訝的成績。

論文地址:

https://arxiv.org/pdf/2206.14858.pdf

就拿去年來說,來自加州大學伯克利分校、OpenAI 和 Google 的研究人員在語言模型方面取得了長足的進步,GPT-3、DALL·E 2 等被開發出來。然而,直到現在,語言模型還無法解決一些簡單的、用語言描述的數學問題,例如「Alice 比 Bob 多五個球,Bob 在給 Charlie 四個球后有兩個球。問 Alice 有幾個球?」這對語言模型來說,想要給出正確答案,可能就有點「吃力」了。

「當我們說計算機非常擅長數學時,意思是它們非常擅長特定的、具體的事情,」來自谷歌的機器學習專家 Guy Gur-Ari 表示。計算機擅長算術是不假,但在特定的模式之外,計算機就無能為力了,簡單的文字描述題都回答不了。

谷歌研究員 Ethan Dyer 曾經表示:做數學研究的人有一套僵化的推理系統,對于他們熟知的和不了解的內容,這兩者之間有著明顯的鴻溝。

解決文字問題或定量推理問題很棘手,因為不同于其他問題,這兩者需要魯棒性和嚴謹性。如果過程中的任何一步出現錯誤,將會導致錯誤的答案。DALL·E 在繪畫方面令人印象深刻,盡管它生成的圖像有時會很奇怪,可能遺漏人的手指、眼睛長得奇怪…… 這些我們都能接受,但是它在數學方面出現了錯誤,我們的容忍度就會非常小。來自 OpenAI 的機器學習專家 Vineet Kosaraju 也曾表達過這種想法,「我們對語言模型所犯的數學錯誤(比如將 10 誤解為 1 和 0,而不是 10)容忍性還是比較小的。」

「我們研究數學僅僅是因為我們發現它獨立且非常有趣,」OpenAI 機器學習專家 Karl Cobbe 說。

隨著機器學習模型在更大的數據樣本上訓練而成,它們的魯棒性更好、出錯也更少。但擴大模型規模似乎只能通過定量推理進行。研究人員意識到,對于語言模型所犯的錯誤似乎需要更有針對性的方法來解決。

Minerva 基于谷歌自研的 Pathways 語言模型 (PaLM),具有更多的數學數據集,包含 arXiv、 LaTeX 等數學格式。Minerva 還采用了其他策略,在思維鏈提示(chain-of-thought prompting)中,Minerva 將更大的問題分解成小塊。此外,Minerva 還使用多數投票(majority voting),不是要求模型給出一個答案,而是要求它提出 100 種答案。在這些答案中,Minerva 選擇最常見的一種答案。

這些新策略的收益是巨大的,Minerva 在 MATH 上的準確率高達 50%,在 GSM8K 以及 MMLU(包括化學和生物學在內的一組更通用的 STEM 問題)上的準確率接近 80%。當 Minerva 被要求重做稍微調整過的問題時,它的表現同樣很好,這表明它的能力不僅僅是來自記憶。

Minerva 可能有奇怪、混亂的推理,但仍然得出正確的答案。盡管像 Minerva 這樣的模型可能會得出與人類相同的答案,但它們所遵循的實際過程可能大不相同。

谷歌機器學習專家 Ethan Dyer 表示,「我認為存在這樣一種觀念,即數學相關人士有一些嚴格的推理系統,了解某事和不了解某事之間存在明顯的區別。」但人們給出的答案不一致,會犯錯誤,也無法應用核心概念。在機器學習前沿中,邊界是模糊的。

6. AI挑戰國際數學奧林匹克競賽,Meta神經定理證明器拿到多項SOTA

原文:

https://mp.weixin.qq.com/s/n1zOPNKcshJsE2umROVWfA

論文地址:

https://arxiv.org/pdf/2205.11491.pdf

數學定理證明一直被視為構建智能機器的關鍵能力。證明一個特定的猜想是真是假,需要使用符號推理等數學知識,比簡單的識別、分類等任務要難得多。

近日,Meta AI 構建了一個神經定理證明器 HyperTree Proof Search(HTPS),已經解決了 10 場國際數學奧林匹克競賽 (IMO) 中的問題,比以往任何系統都更多。此外,該 AI 模型的性能比數學基準 miniF2F 上的 SOTA 方法高出 20%,比 Metamath 基準上的 SOTA 方法高出 10%。

在一定意義上,定理證明要比構建 AI 來玩國際象棋等棋盤游戲更具挑戰性。當研究者試圖證明一個定理時,可能移動的動作空間不僅很大而且有可能是無限的。相比較而言,在國際象棋或圍棋中,這些游戲的一系列走法會被預測出來,即使算法沒有給出最好的走法也影響不大。而在定理證明中,當算法走入死胡同就沒辦法解決了,性能再好的求解器也只是白費力氣。Meta AI的新方法解決了這個棘手的問題,LeCun也轉推稱贊。

我們用一個例子來說明 HTPS 的優勢:假設 a 和 b 都是質因子為 7 的自然數,并且 7 也是 a + b 的質因子,如果假設 7^7 可以整除(a + b)^7 - a^7 - b^7,那么請證明 a + b 至少是 19。

假如讓人類來證明的話,他們大概率會用到二項式。而 HTPS 使用 Contraposition 方法,大大簡化了方程,然后再檢查多種不同的情況。

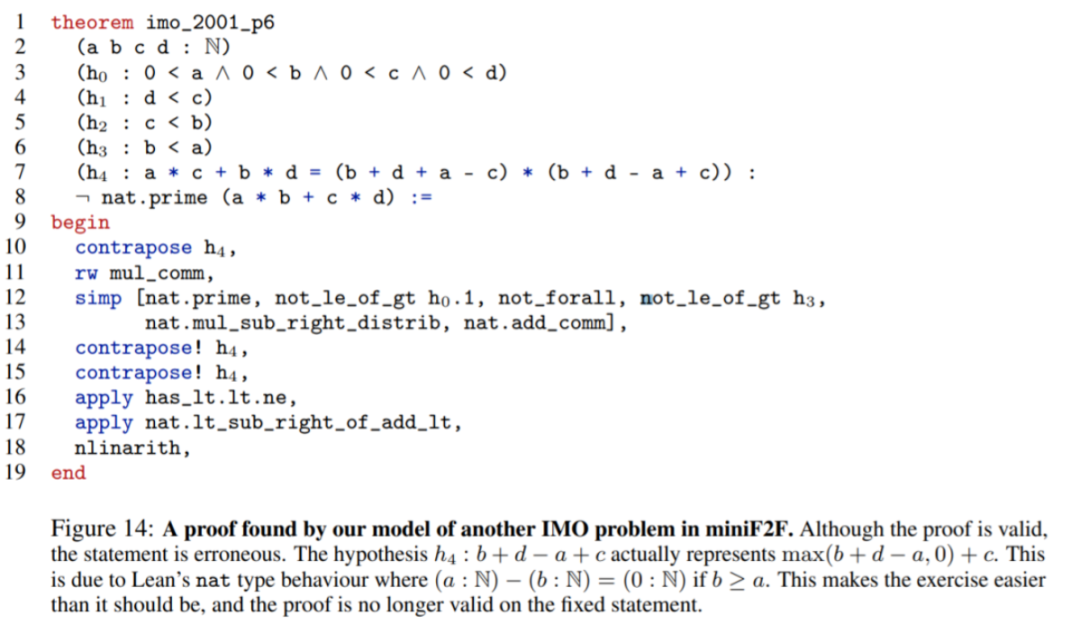

如下圖為本文模型發現的證明示例,即在 miniF2F 中另一個 IMO 問題的證明:

7. 一文匯總超參自動優化方法

原文:

https://mp.weixin.qq.com/s/E2osIx2PEoR7ateEIN0FLQ

一、網格搜索(Grid Search)

網格搜索是暴力搜索,在給定超參搜索空間內,嘗試所有超參組合,最后搜索出最優的超參組合。sklearn已實現該方法,使用樣例如下:

1fromsklearnimportsvm,datasets

2fromsklearn.model_selectionimportGridSearchCV

3importpandasaspd

4

5#導入數據

6iris=datasets.load_iris()

7#定義超參搜索空間

8parameters={'kernel':('linear','rbf'),'C':[1,10]}

9#初始化模型

10svc=svm.SVC()

11#網格搜索

12clf=GridSearchCV(estimator=svc,

13param_grid=parameters,

14scoring='accuracy',

15n_jobs=-1,

16cv=5)

17clf.fit(iris.data,iris.target)

18返回:GridSearchCV(cv=5,estimator=SVC(),n_jobs=-1,

19param_grid={'C':[1,10],'kernel':('linear','rbf')},

20scoring='accuracy')

21

22#打印結果

23print('詳細結果:

',pd.DataFrame.from_dict(clf.cv_results_))

24print('最佳分類器:

',clf.best_estimator_)

25print('最佳分數:

',clf.best_score_)

26print('最佳參數:

',clf.best_params_).

27返回:

28詳細結果:

29mean_fit_timestd_fit_timemean_score_timestd_score_timeparam_C...split3_test_scoresplit4_test_scoremean_test_scorestd_test_scorerank_test_score

3000.0007880.0003940.0001940.0003891...0.9666671.00.9800000.0163301

3110.0008040.0004020.0001990.0003991...0.9333331.00.9666670.0210824

3220.0005930.0004840.0005930.00048410...0.9666671.00.9733330.0388733

3330.0005930.0004840.0003990.00048910...0.9666671.00.9800000.0163301

34[4rowsx15columns]

35最佳分類器:

36SVC(C=1,kernel='linear')

37最佳分數:

380.9800000000000001

39最佳參數:

40{'C':1,'kernel':'linear'}

sklearn.model_selection.GridSearchCV[1]的重要參數說明:

-

estimator: scikit-learn模型。

-

param_grid: 超參搜索空間,即超參數字典。

-

scoring: 在交叉驗證中使用的評估策略。

-

n_jobs: 并行任務數,-1為使用所有CPU。

-

cv: 決定采用幾折交叉驗證。

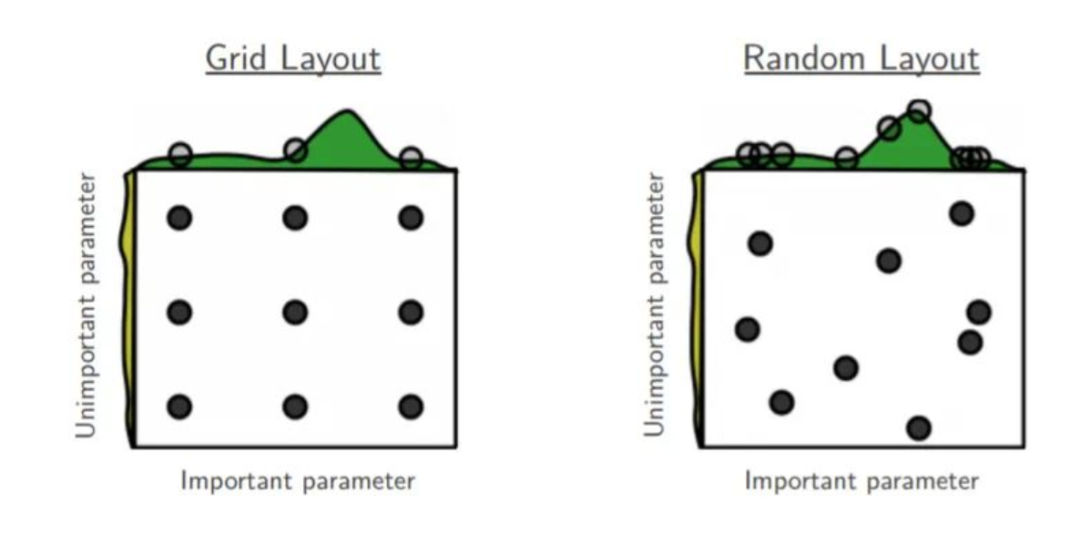

二、隨機搜索(Randomized Search)

隨機搜索是在搜索空間中采樣出超參組合,然后選出采樣組合中最優的超參組合。隨機搜索的好處如下圖所示:

解釋圖1,如果目前我們要搜索兩個參數,但參數A重要而另一個參數B并沒有想象中重要,網格搜索9個參數組合(A, B),而由于模型更依賴于重要參數A,所以只有3個參數值是真正參與到最優參數的搜索工作中。反觀隨機搜索,隨機采樣9種超參組合,在重要參數A上會有9個參數值參與到搜索工作中,所以,在某些參數對模型影響較小時,使用隨機搜索能讓我們有更多的探索空間。

同樣地,sklearn實現了隨機搜索[3],樣例代碼如下:

1fromsklearnimportsvm,datasets

2fromsklearn.model_selectionimportRandomizedSearchCV

3importpandasaspd

4fromscipy.statsimportuniform

5

6

7#導入數據

8iris=datasets.load_iris()

9#定義超參搜索空間

10distributions={'kernel':['linear','rbf'],'C':uniform(loc=1,scale=9)}

11#初始化模型

12svc=svm.SVC()

13#網格搜索

14clf=RandomizedSearchCV(estimator=svc,

15param_distributions=distributions,

16n_iter=4,

17scoring='accuracy',

18cv=5,

19n_jobs=-1,

20random_state=2021)

21clf.fit(iris.data,iris.target)

22返回:RandomizedSearchCV(cv=5,estimator=SVC(),n_iter=4,n_jobs=-1,

23param_distributions={'C':0x000001F372F9A190>,

24'kernel':['linear','rbf']},

25random_state=2021,scoring='accuracy')

26

27

28#打印結果

29print('詳細結果:

',pd.DataFrame.from_dict(clf.cv_results_))

30print('最佳分類器:

',clf.best_estimator_)

31print('最佳分數:

',clf.best_score_)

32print('最佳參數:

',clf.best_params_)

33返回:

34詳細結果:

35mean_fit_timestd_fit_timemean_score_timestd_score_timeparam_C...split3_test_scoresplit4_test_scoremean_test_scorestd_test_scorerank_test_score

3600.0005980.0004890.0002000.0004006.4538...0.9666671.00.9866670.0163301

3710.0009970.0000020.0000000.0000004.99782...0.9666671.00.9800000.0266673

3820.0007980.0003990.0003990.0004883.81406...0.9666671.00.9800000.0163303

3930.0005980.0004880.0002000.0003995.36286...0.9666671.00.9866670.0163301

40[4rowsx15columns]

41最佳分類器:

42SVC(C=6.453804509266643)

43最佳分數:

440.9866666666666667

45最佳參數:

46{'C':6.453804509266643,'kernel':'rbf'}

相比于網格搜索,sklearn隨機搜索中主要改變的參數是param_distributions,負責提供超參值分布范圍。

三、貝葉斯優化(Bayesian Optimization)

我寫本文的目的主要是沖著貝葉斯優化來的,一直有所耳聞卻未深入了解,所以我就來查漏補缺了。以下內容主要基于Duane Rich在《How does Bayesian optimization work?》[4]的回答。

關于超參數更多的解讀,請大家點擊原文了解更多。

END

愛我就給我點在看

點擊閱讀原文進入官網

-

RT-Thread

+關注

關注

32文章

1375瀏覽量

41597

原文標題:【AI簡報第20221104期】端側智能化,在MCU中集成AI功能!、平頭哥造芯模式跑通了

文章出處:【微信號:RTThread,微信公眾號:RTThread物聯網操作系統】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

酒店智能化都用到哪些芯片之高速互聯型MCU CH32V317

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

AI大模型端側部署正當時:移遠端側AI大模型解決方案,激活場景智能新范式

【AI簡報第20221104期】端側智能化,在MCU中集成AI功能!、平頭哥造芯模式跑通了

【AI簡報第20221104期】端側智能化,在MCU中集成AI功能!、平頭哥造芯模式跑通了

評論