GMMSeg 同時(shí)具備判別式與生成式模型的優(yōu)勢,在語義分割領(lǐng)域,首次實(shí)現(xiàn)使用單一的模型實(shí)例,在閉集 (closed-set) 及開放世界 (open-world) 分割任務(wù)中同時(shí)取得先進(jìn)性能。

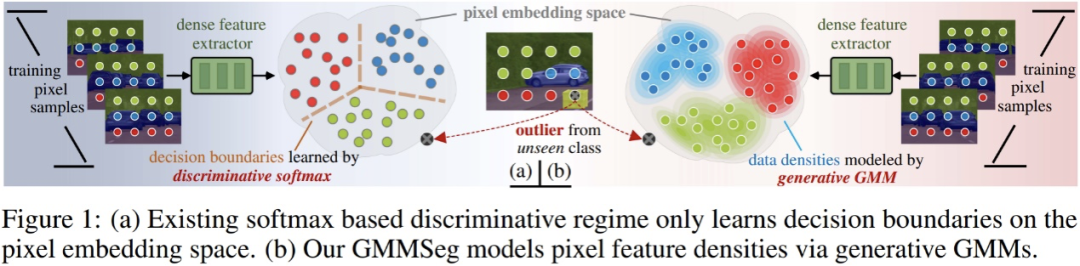

當(dāng)前主流語義分割算法本質(zhì)上是基于 softmax 分類器的判別式分類模型,直接對 p (class|pixel feature) 進(jìn)行建模,而完全忽略了潛在的像素?cái)?shù)據(jù)分布,即 p (class|pixel feature)。這限制了模型的表達(dá)能力以及在 OOD (out-of-distribution) 數(shù)據(jù)上的泛化性。 在最近的一項(xiàng)研究中,來自浙江大學(xué)、悉尼科技大學(xué)、百度研究院的研究者們提出了一種全新的語義分割范式 —— 基于高斯混合模型(GMM)的生成式語義分割模型 GMMSeg。

GMMSeg: Gaussian Mixture based Generative Semantic Segmentation Models

論文鏈接:https://arxiv.org/abs/2210.02025

代碼鏈接:https://github.com/leonnnop/GMMSeg

GMMSeg 對像素與類別的聯(lián)合分布進(jìn)行建模,通過 EM 算法在像素特征空間學(xué)習(xí)高斯混合分類器 (GMM Classifier),以生成式范式對每一個(gè)類別的像素特征分布進(jìn)行精細(xì)捕捉。與此同時(shí),GMMSeg 采用判別式損失來端到端的優(yōu)化深度特征提取器。這使得 GMMSeg 同時(shí)具備判別式與生成式模型的優(yōu)勢。 實(shí)驗(yàn)結(jié)果表明,GMMSeg 在多種分割網(wǎng)絡(luò)架構(gòu) (segmentation architecture) 及骨干網(wǎng)絡(luò) (backbone network) 上都獲得了性能提升;同時(shí),無需任何后處理或微調(diào),GMMSeg 可以直接被應(yīng)用到異常分割 (anomaly segmentation) 任務(wù)。 迄今為止,這是第一次有語義分割方法能夠使用單一的模型實(shí)例,在閉集 (closed-set) 及開放世界 (open-world) 條件下同時(shí)取得先進(jìn)性能。這也是生成式分類器第一次在大規(guī)模視覺任務(wù)中展示出優(yōu)勢。 判別式 v.s. 生成式分類器

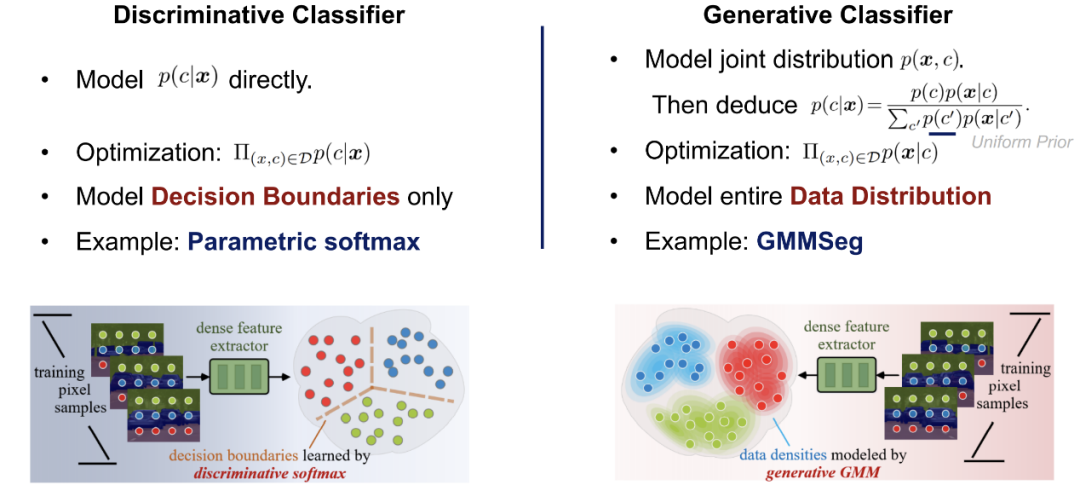

在深入探討現(xiàn)有分割范式以及所提方法之前,這里簡略引入判別式以及生成式分類器的概念。 假設(shè)有數(shù)據(jù)集合 D,其包含成對的樣本 - 標(biāo)簽對 (x, y);分類器的最終目標(biāo)是預(yù)測樣本分類概率 p (y|x)。分類方法可以被分為兩類:判別式分類器以及生成式分類器。

判別式分類器:直接建模條件概率 p (y|x);其僅僅學(xué)習(xí)分類的最優(yōu)決策邊界,而完全不考慮樣本本身的分布,也因此無法反映樣本的特性。

生成式分類器:首先建模聯(lián)合概率分布 p (x, y),而后通過貝葉斯定理推導(dǎo)出分類條件概率;其顯式地對數(shù)據(jù)本身的分布進(jìn)行建模,往往針對每一個(gè)類別都會(huì)建立對應(yīng)的模型。相比于判別式分類器,其充分考慮了樣本的特征信息。

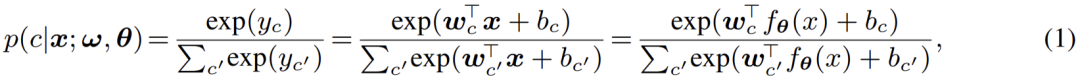

主流語義分割范式:判別式 Softmax 分類器 目前主流的逐像素分割模型大多使用深度網(wǎng)絡(luò)抽取像素特征,而后使用 softmax 分類器進(jìn)行像素特征分類。其網(wǎng)絡(luò)架構(gòu)由兩部分組成: 第一部分為像素特征提取器,其典型架構(gòu)為編碼器 - 解碼器對,通過將 RGB 空間的像素輸入映射到 D - 維度的高維空間獲取像素特征。 第二部分為像素分類器,即主流的 softmax 分類器;其將輸入的像素特征編碼為 C - 類實(shí)數(shù)輸出(logits),而后利用 softmax 函數(shù)對輸出(logits)歸一化并賦予概率意義,即利用 logits 計(jì)算像素分類的后驗(yàn)概率:

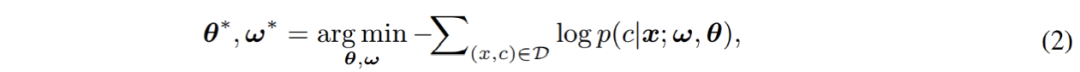

最終,由兩個(gè)部分構(gòu)成的完整模型將通過 cross-entropy 損失進(jìn)行端到端的優(yōu)化:

在此過程中,模型忽略了像素本身的分布,而直接對像素分類預(yù)測的條件概率 p (c|x) 進(jìn)行估計(jì)。由此可見,主流的 softmax 分類器本質(zhì)為判別式分類器。 判別式分類器結(jié)構(gòu)簡單,并因其優(yōu)化目標(biāo)直接針對于縮小判別誤差,往往能夠取得優(yōu)異的判別性能。然而與此同時(shí),其有一些尚未引起已有工作重視的致命缺點(diǎn),極大的影響了 softmax 分類器的分類性能及泛化性:

首先,其僅僅對決策邊界進(jìn)行建模;完全忽視了像素特征的分布,也因而無法對每一個(gè)類別的具體特性進(jìn)行建模與利用;削弱了其泛化性以及表達(dá)能力。

其次,其使用單一的參數(shù)對 (w,b) 建模一個(gè)類別;換言之,softmax 分類器依賴于單模分布 (unimodality) 假設(shè);這種極強(qiáng)且過于簡化的假設(shè)在實(shí)際應(yīng)用往往不能成立,這導(dǎo)致其只能夠取得次優(yōu)的性能。

最后,softmax 分類器的輸出無法準(zhǔn)確反映真實(shí)的概率意義;其最終的預(yù)測只能作為與其他類別進(jìn)行比較時(shí)的參考。這也正是大量主流分割模型較難檢測出 OOD 輸入的根本原因。

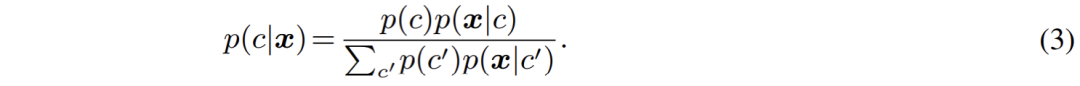

針對這些問題,作者認(rèn)為應(yīng)該對目前主流的判別式范式進(jìn)行重新思考,并在本文中給出了對應(yīng)的方案:生成式語義分割模型 ——GMMSeg。 生成式語義分割模型:GMMSeg 作者從生成式模型的角度重新梳理了語義分割過程。相較于直接建模分類概率 p (c|x),生成式分類器對聯(lián)合分布 p (x, c) 進(jìn)行建模,而后使用貝葉斯定理推導(dǎo)出分類概率:

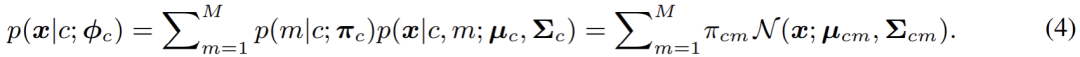

其中,出于泛化性考慮,類別先驗(yàn) p (c) 往往被設(shè)置為 uniform 分布,而如何對像素特征的類別條件分布 p (x|c) 進(jìn)行建模,就成為了當(dāng)前的首要問題。 在本文中,即 GMMSeg 中,采用高斯混合模型對 p (x|c) 進(jìn)行建模,其形式如下:

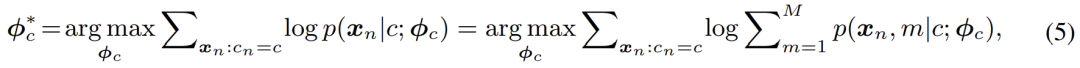

在分模型 (component) 數(shù)目不受限的情況下,高斯混合模型理論上能夠擬合任意的分布,因而十分優(yōu)雅且強(qiáng)大;同時(shí),其混合模型的本質(zhì)也使得建模多模分布 (multimodality),即建模類內(nèi)變化,變得可行。基于此,本文采用極大似然估計(jì)來優(yōu)化模型的參數(shù):

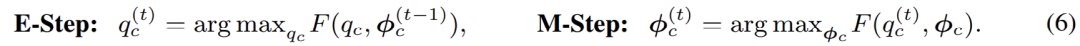

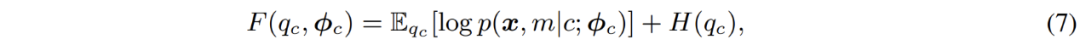

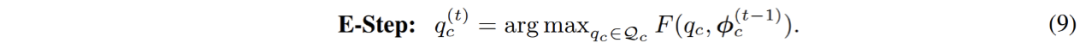

其經(jīng)典的解法為 EM 算法,即通過交替執(zhí)行 E-M - 兩步逐步優(yōu)化 F - 函數(shù):

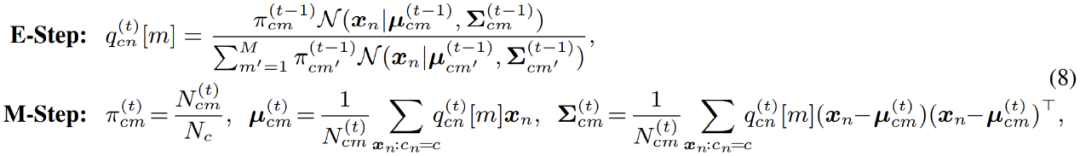

具體到高斯混合模型的優(yōu)化;EM 算法實(shí)際上在 E - 步中,對數(shù)據(jù)點(diǎn)屬于每一個(gè)分模型的概率進(jìn)行了重新估計(jì)。換言之,其相當(dāng)于在 E - 步中對像素點(diǎn)進(jìn)行了軟聚類 (soft clustering);而后,在 M - 步,即可利用聚類結(jié)果,再次更新模型參數(shù)。

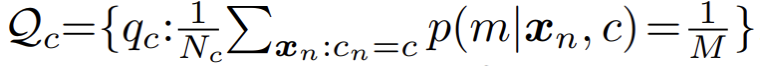

然而在實(shí)際應(yīng)用中,作者發(fā)現(xiàn)標(biāo)準(zhǔn)的 EM 算法收斂緩慢,且最終結(jié)果較差。作者懷疑是由于 EM 算法對參數(shù)優(yōu)化初始值過于敏感,導(dǎo)致其難以收斂到更優(yōu)的局部極值點(diǎn)。受到近期一系列基于最優(yōu)傳輸理論 (optimal transport) 的聚類算法的啟發(fā),作者對混合分模型分布額外引入了一個(gè) uniform 先驗(yàn):

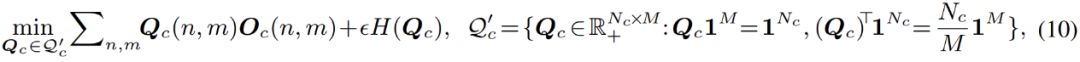

相應(yīng)的,參數(shù)優(yōu)化過程中的 E - 步驟被轉(zhuǎn)化為約束優(yōu)化問題,如下:

這個(gè)過程可以被直觀的理解成,對聚類過程引入了一個(gè)均分的約束:在聚類過程中,數(shù)據(jù)點(diǎn)能夠被一定程度上均勻的分配給每一個(gè)分模型。引入此約束之后,此優(yōu)化過程就等價(jià)于下式列出的最優(yōu)傳輸問題:

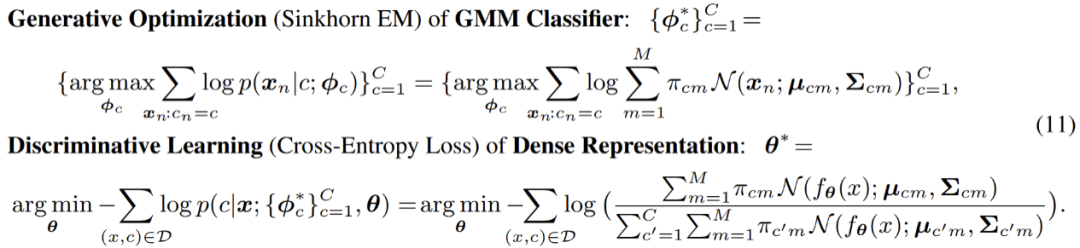

此式可以利用 Sinkhorn-Knopp 算法快速求解。而整個(gè)改進(jìn)過后的優(yōu)化過程被命名為 Sinkhorn EM,其被一些理論工作證明,具有與標(biāo)準(zhǔn) EM 算法相同的全局最優(yōu)解,且更不容易陷入局部最優(yōu)解。 在線混合 (Online Hybrid) 優(yōu)化 之后,在完整的優(yōu)化過程中,文章中使用了一種在線混合 (online hybrid) 的優(yōu)化模式:通過生成式 Sinkhorn EM,在逐漸更新的特征空間中,不斷對高斯混合分類器進(jìn)行優(yōu)化;而對于完整框架中另一個(gè)部分,即像素特征提取器部分,則基于生成式分類器的預(yù)測結(jié)果,使用判別式 cross-entropy 損失進(jìn)行優(yōu)化。兩個(gè)部分交替優(yōu)化,互相對齊,使得整個(gè)模型緊密耦合,并且能夠進(jìn)行端到端的訓(xùn)練:

在此過程中,特征提取部分只通過梯度反向傳播優(yōu)化;而生成式分類器部分,則只通過 SinkhornEM 進(jìn)行優(yōu)化。正是這種交替式優(yōu)化的設(shè)計(jì),使得整個(gè)模型能夠緊湊的融合在一起,并同時(shí)繼承來自判別式以及生成式模型的優(yōu)勢。 最終,GMMSeg 受益于其生成式分類的架構(gòu)以及在線混合的訓(xùn)練策略,展示出了判別式 softmax 分類器所不具有的優(yōu)勢:

其一,受益于其通用的架構(gòu),GMMSeg 與大部分主流分割模型兼容,即與使用 softmax 進(jìn)行分類的模型兼容:只需要替換掉判別式 softmax 分類器,即可無痛增強(qiáng)現(xiàn)有模型的性能。

其二,由于 hybrid 訓(xùn)練模式的應(yīng)用,GMMSeg 兼并了生成式以及判別式分類器的優(yōu)點(diǎn),且一定程度上解決了 softmax 無法建模類內(nèi)變化的問題;使得其判別性能大大提升。

其三,GMMSeg 顯式建模了像素特征的分布,即 p (x|c);GMMSeg 能夠直接給出樣本屬于各個(gè)類別的概率,這使得其能夠自然的處理未曾見過的 OOD 數(shù)據(jù)。

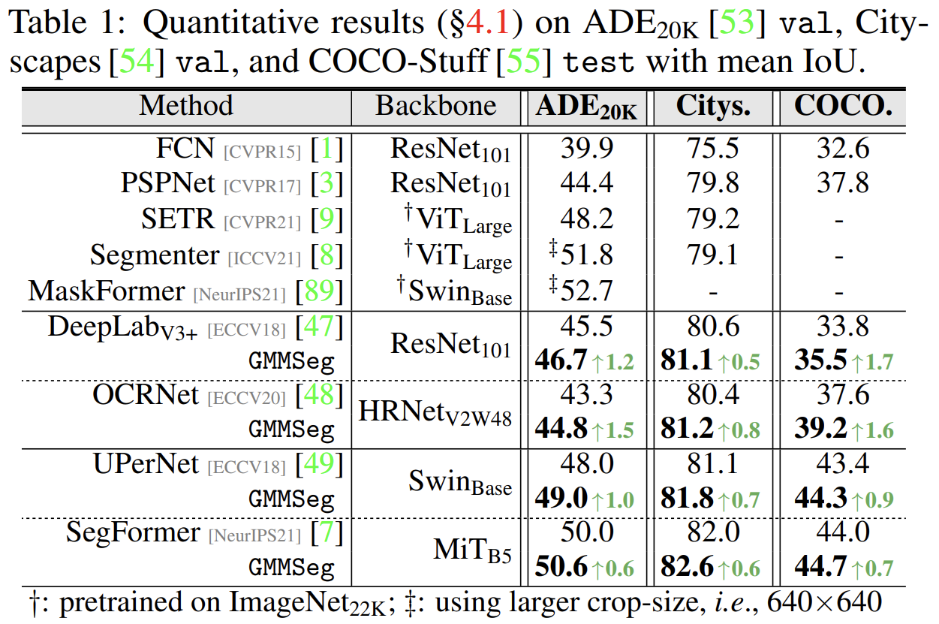

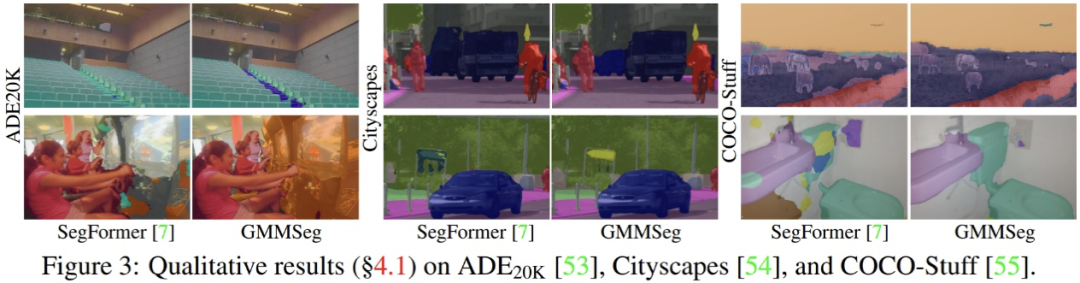

實(shí)驗(yàn)結(jié)果 實(shí)驗(yàn)結(jié)果表明,不論是基于 CNN 架構(gòu)或者是基于 Transformer 架構(gòu),在廣泛使用的語義分割數(shù)據(jù)集 (ADE20K, Cityscapes, COCO-Stuff) 上,GMMSeg 都能夠取得穩(wěn)定且明顯的性能提升。

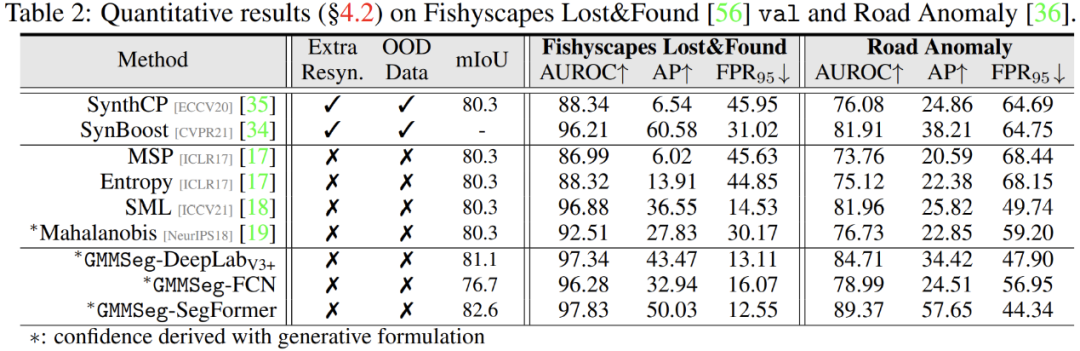

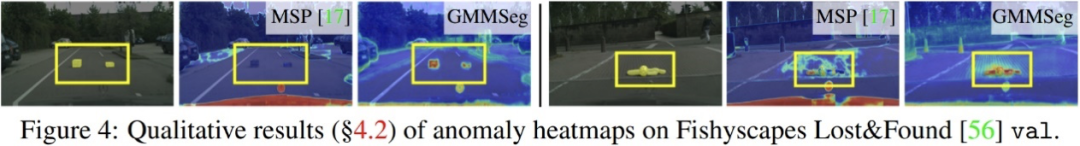

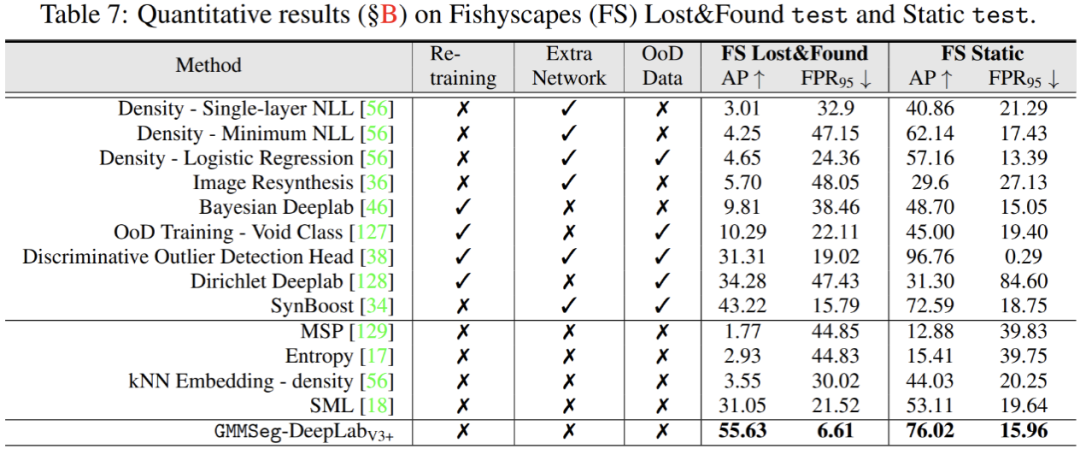

除此之外,在異常分割任務(wù)中,無需對在閉集任務(wù),即常規(guī)語義分割任務(wù)中訓(xùn)練完畢的模型做任何的修改,GMMSeg 即可在所有通用評(píng)價(jià)指標(biāo)上,超越其他需要特殊后處理的方法。

審核編輯 :李倩

-

算法

+關(guān)注

關(guān)注

23文章

4701瀏覽量

94926 -

分類器

+關(guān)注

關(guān)注

0文章

153瀏覽量

13421

原文標(biāo)題:NeurIPS 2022 | GMMSeg:生成式語義分割新范式!可同時(shí)處理閉集和開集識(shí)別

文章出處:【微信號(hào):CVer,微信公眾號(hào):CVer】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評(píng)論請先 登錄

2025設(shè)備管理新范式:生成式AI在故障知識(shí)庫中的創(chuàng)新應(yīng)用

請問NanoEdge AI數(shù)據(jù)集該如何構(gòu)建?

是否可以輸入隨機(jī)數(shù)據(jù)集來生成INT8訓(xùn)練后量化模型?

GMMSeg:生成式語義分割新范式!可同時(shí)處理閉集和開集識(shí)別

GMMSeg:生成式語義分割新范式!可同時(shí)處理閉集和開集識(shí)別

評(píng)論