ReID任務(wù)的目的是從海量圖像中檢索出與給定query相同ID的實(shí)例。

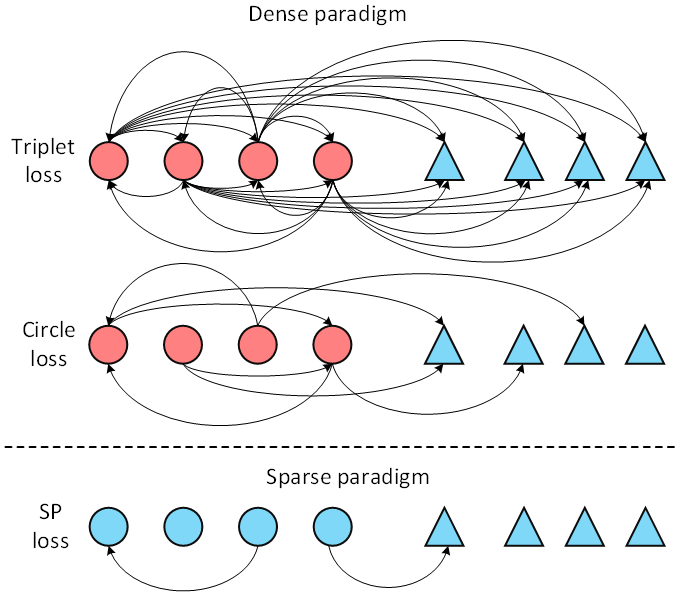

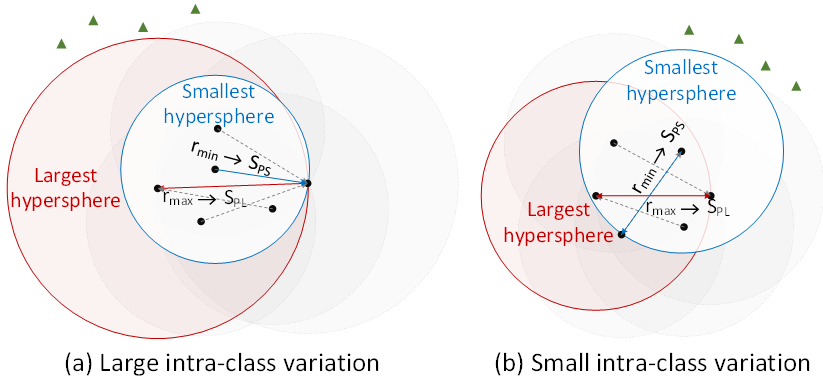

Pairwise損失函數(shù)在ReID 任務(wù)中發(fā)揮著關(guān)鍵作用。現(xiàn)有方法都是基于密集采樣機(jī)制,即將每個(gè)實(shí)例都作為錨點(diǎn)(anchor)采樣其正樣本和負(fù)樣本構(gòu)成三元組。這種機(jī)制不可避免地會(huì)引入一些幾乎沒(méi)有視覺(jué)相似性的正對(duì),從而影響訓(xùn)練效果。為了解決這個(gè)問(wèn)題,我們提出了一種新穎的損失范式,稱為稀疏Pairwise (SP) 損失,在ReID任務(wù)中針對(duì)mini-batch的每一類篩選出少數(shù)合適的樣本對(duì)來(lái)構(gòu)造損失函數(shù)(如圖1所示)。基于所提出的損失框架,我們進(jìn)一步提出了一種自適應(yīng)正挖掘策略,可以動(dòng)態(tài)地適應(yīng)不同類別內(nèi)部的變化。大量實(shí)驗(yàn)表明,SP 損失及其自適應(yīng)變體AdaSP 損失在多個(gè)ReID數(shù)據(jù)集上均優(yōu)于其他成對(duì)損失方法,并取得了state-of-the-art性能。

圖1. Sparse pairwise損失與Dense pairwise損失之間的差異

Adaptive Sparse Pairwise Loss for Object Re-Identification

論文地址:https://arxiv.org/abs/2303.18247

Github地址(已開(kāi)源):

https://github.com/Astaxanthin/AdaSP

研究動(dòng)機(jī):

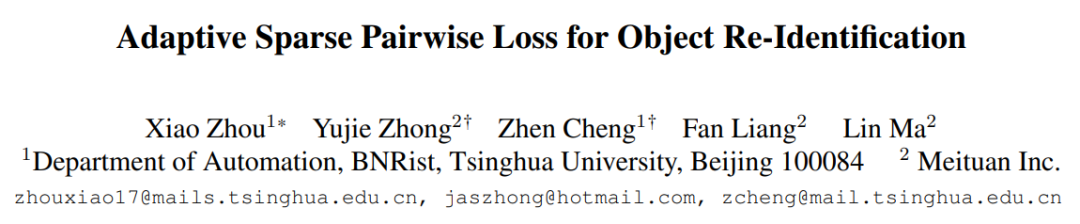

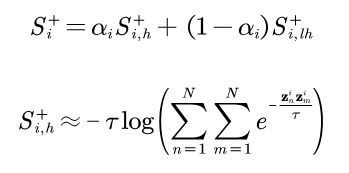

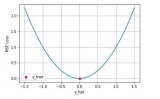

ReID任務(wù)中的由于光照變化、視角改變和遮擋等原因會(huì)造成同一類中不同實(shí)例的視覺(jué)相似度很低(如圖2所示),因此由視覺(jué)相似度很低的實(shí)例(我們稱之為harmful positive pair)構(gòu)成的正樣本對(duì)會(huì)對(duì)特征表示的學(xué)習(xí)過(guò)程帶來(lái)不利的影響,從而使訓(xùn)練收斂至局部極小點(diǎn)。現(xiàn)有的方法都是以每個(gè)樣本作為錨(anchor)密集采樣正樣本對(duì)來(lái)構(gòu)造度量損失函數(shù),不可避免的會(huì)引入大量壞對(duì)影響訓(xùn)練結(jié)果。基于此,我們提出了稀疏Pairwise損失函數(shù)以降低對(duì)壞對(duì)的采樣概率,從而減輕壞對(duì)在訓(xùn)練過(guò)程的不利影響。

圖2. 行人ReID數(shù)據(jù)集上不同級(jí)別的類內(nèi)差異

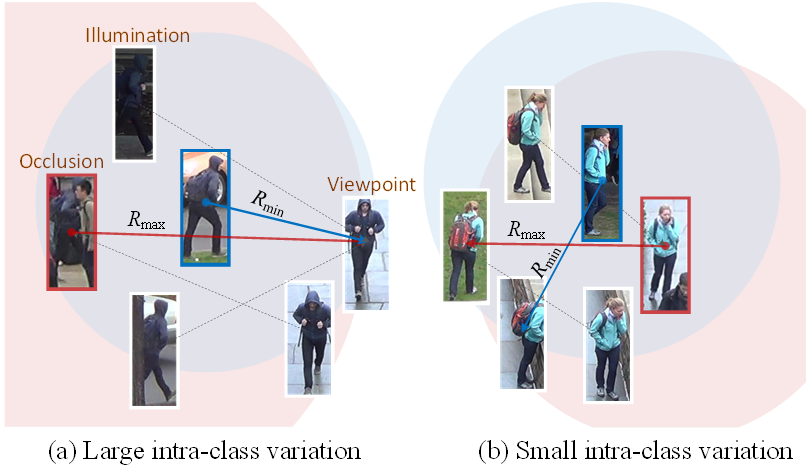

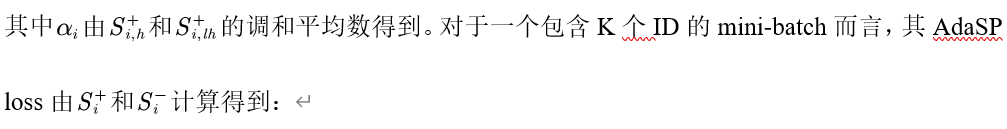

方法介紹:我們提出的稀疏Pairwise損失函數(shù)(命名為SP loss)針對(duì)每一類僅采樣一個(gè)正樣本對(duì)和一個(gè)負(fù)樣本對(duì)。其中負(fù)樣本對(duì)為該類別與其他所有類別間最難的負(fù)樣本對(duì),而正樣本對(duì)為所有樣本的hard positive pair集合中的最不難positive pair(least-hard mining):

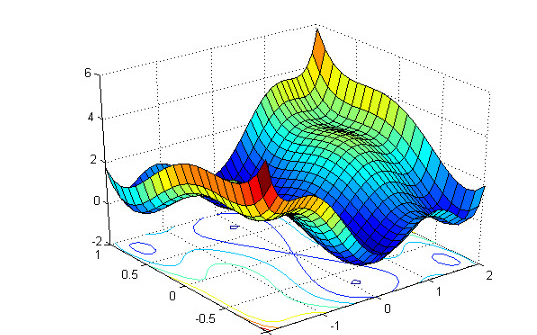

從幾何角度看,以最難positive pair的距離作為半徑的超球面是能夠覆蓋所有類內(nèi)樣本的最大球,而以hard positive pair集合中最不難positive pair的距離作為半徑的超球面是能夠副高所有類內(nèi)樣本的最小球,如圖3所示。利用最小球能夠有效的避免過(guò)于難的harmful positive pair對(duì)于訓(xùn)練過(guò)程的影響,我們從理論上證明了針對(duì)一個(gè)mini-batch,我們的方法采樣得到的正樣本對(duì)中harmful positive pair的期望占比小于Triplet-BH和Circle等密集采樣方法。

圖3. 不同級(jí)別類內(nèi)差異差異下的最大和最小覆蓋球。

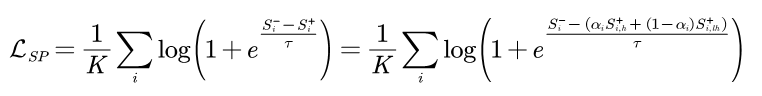

為了適應(yīng)不同類別可能具有不同的類內(nèi)差異,我們?cè)赟P loss的基礎(chǔ)上增加了自適應(yīng)策略構(gòu)成AdaSP loss:

該loss通過(guò)動(dòng)態(tài)調(diào)整構(gòu)造loss所用到的正樣本對(duì)相似度以適應(yīng)不同的類內(nèi)差異。

實(shí)驗(yàn)結(jié)果:

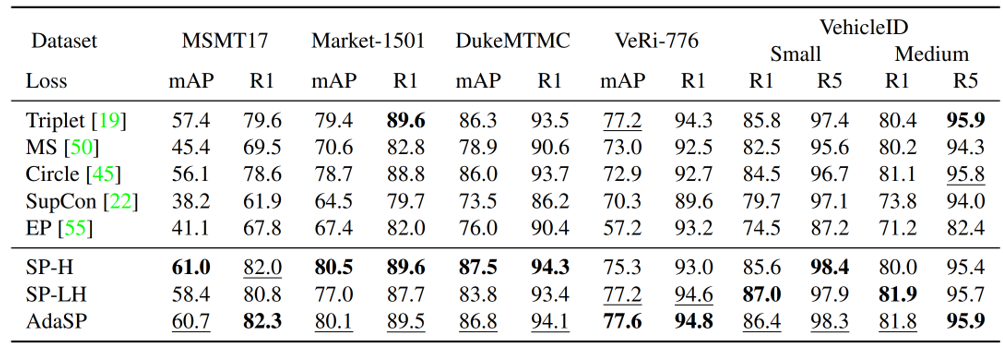

我們?cè)诙鄠€(gè)行人ReID數(shù)據(jù)集(包括MSMT17,Market1501,DukeMTMC,CUHK03)和車輛ReID數(shù)據(jù)集(包括VeRi-776,VehicleID,VERIWild)上驗(yàn)證了AdaSP loss的有效性。實(shí)驗(yàn)結(jié)果顯示AdaSP loss在單獨(dú)使用時(shí)超過(guò)Triplet-BH,Circle,MS,Supcon,EP等已有度量損失函數(shù),如表1所示;AdaSP loss在不同骨干網(wǎng)絡(luò)(包括ResNet-50/101/152,ResNet-IBN,MGN,ViT,DeiT)上的ReID性能均優(yōu)于Triplet-BH;此外,AdaSP loss結(jié)合分類損失函數(shù)在ReID任務(wù)上達(dá)到了State-of-the-art的性能。

表1. 在不同數(shù)據(jù)集上不同度量損失函數(shù)的性能比較

具體細(xì)節(jié)可以參考原文。

審核編輯 :李倩

-

函數(shù)

+關(guān)注

關(guān)注

3文章

4372瀏覽量

64292 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1223瀏覽量

25295 -

REID

+關(guān)注

關(guān)注

1文章

18瀏覽量

11006

原文標(biāo)題:CVPR 2023 | 清華&美團(tuán)提出稀疏Pairwise損失函數(shù)!ReID任務(wù)超已有損失函數(shù)!

文章出處:【微信號(hào):CVer,微信公眾號(hào):CVer】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

對(duì)象檢測(cè)邊界框損失函數(shù)–從IOU到ProbIOU介紹

TensorFlow損失函數(shù)(定義和使用)詳解

keras常用的損失函數(shù)Losses與評(píng)價(jià)函數(shù)Metrics介紹

神經(jīng)網(wǎng)絡(luò)中的損失函數(shù)層和Optimizers圖文解讀

機(jī)器學(xué)習(xí)經(jīng)典損失函數(shù)比較

機(jī)器學(xué)習(xí)實(shí)用指南:訓(xùn)練和損失函數(shù)

三種常見(jiàn)的損失函數(shù)和兩種常用的激活函數(shù)介紹和可視化

深度學(xué)習(xí)的19種損失函數(shù)你了解嗎?帶你詳細(xì)了解

計(jì)算機(jī)視覺(jué)的損失函數(shù)是什么?

損失函數(shù)的簡(jiǎn)要介紹

機(jī)器學(xué)習(xí)和深度學(xué)習(xí)中分類與回歸常用的幾種損失函數(shù)

表示學(xué)習(xí)中7大損失函數(shù)的發(fā)展歷程及設(shè)計(jì)思路

詳細(xì)分析14種可用于時(shí)間序列預(yù)測(cè)的損失函數(shù)

語(yǔ)義分割25種損失函數(shù)綜述和展望

清華&美團(tuán)提出稀疏Pairwise損失函數(shù)!ReID任務(wù)超已有損失函數(shù)!

清華&美團(tuán)提出稀疏Pairwise損失函數(shù)!ReID任務(wù)超已有損失函數(shù)!

評(píng)論