引用表達分割(Referring Expression Segmentation,簡稱引用分割或RES)是一個基礎的視覺語言多模態(tài)任務。給定一張圖像和一個描述該圖像中某個對象的自然語言表達式,RES旨在找到該目標對象并將其分割。現(xiàn)有的引用分割數(shù)據(jù)集和方法通常僅支持單目標表達式,即一個表達式指代一個目標對象。而對于多目標和無目標表達式的情況,則沒有考慮在內。嚴重限制了引用分割的實際應用。 基于這個問題,來自新加坡南洋理工大學的研究者們定義了一個名為廣義引用分割(Generalized Referring Expression Segmentation,GRES)的新任務,將經典的引用分割擴展到允許表達式指代任意數(shù)量的目標對象。同時,文章還構建了第一個大規(guī)模的GRES數(shù)據(jù)集gRefCOCO,其同時包含多目標、無目標和單目標表達式。

論文地址:https://arxiv.org/abs/2306.00968

項目主頁:https://henghuiding.github.io/GRES/

RES在圖形編輯、視頻制作、人機交互和機器人等眾多應用領域具有巨大潛力。目前,大多數(shù)現(xiàn)有方法都遵循在知名數(shù)據(jù)集ReferIt和RefCOCO中定義的RES規(guī)則,并在近年來取得了巨大進展。然而,大多數(shù)經典的引用分割方法對任務有預定義的強約束:

1.傳統(tǒng)的RES不考慮無目標表達式,即在圖像中沒有匹配對象的自然表達語句。這意味著如果語句描述的目標在輸入圖像中不存在,現(xiàn)有的RES方法的行為是未定義的。在這種假設下,輸入表達式必須與圖像中的某個對象匹配,否則會不可避免地出現(xiàn)錯誤。

2.大多數(shù)現(xiàn)有數(shù)據(jù)集,例如最流行的RefCOCO,幾乎不包含多目標表達式,即在一句話中同時指向多個目標物體的表達式。這意味著如果需要同時查找多個目標,用戶需要分多次鍵入查詢指令且每次只能指向一個目標物體。

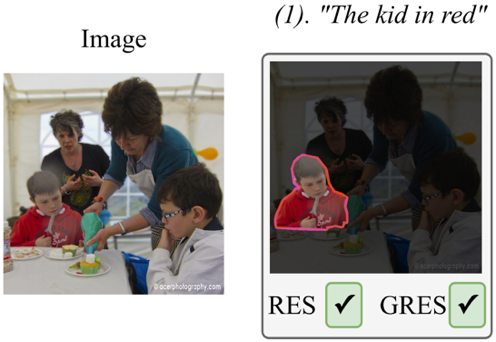

圖1:引用分割的實例,使用“The kid in red”來指示并分割圖片中的紅衣服小男孩

新任務:廣義引用表達式分割

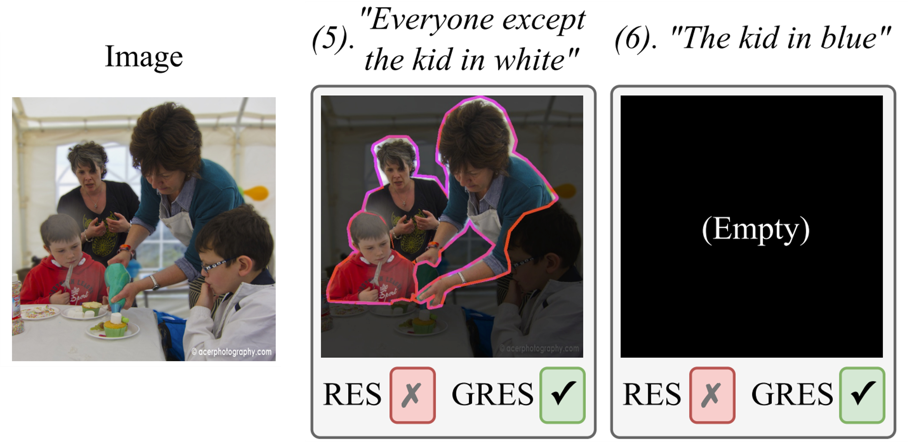

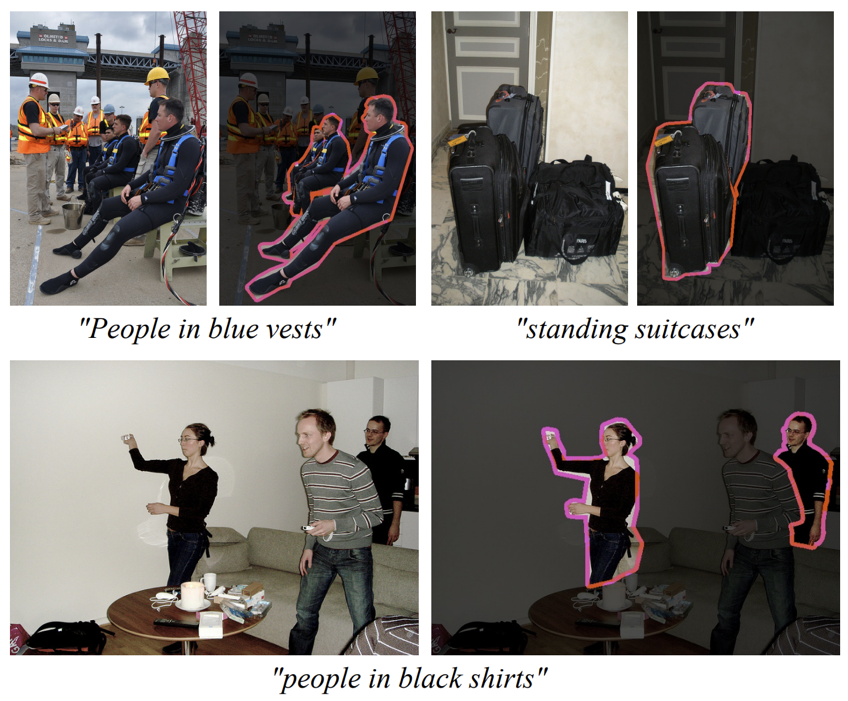

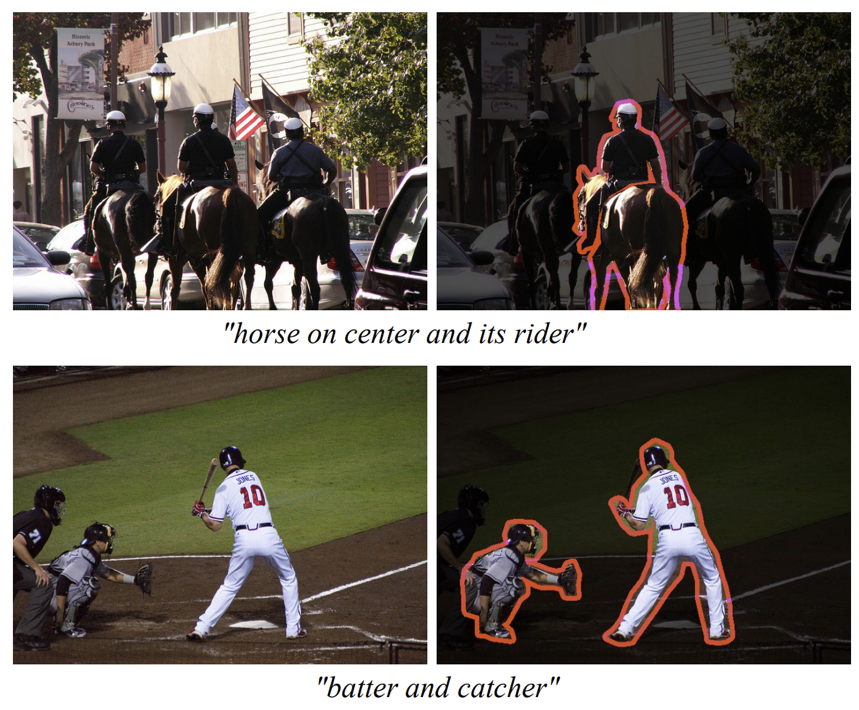

在文章中,為了解決傳統(tǒng)RES存在的問題,研究者們提出了一個名為廣義引用表達分割(Generalized Referring Expression Segmentation,簡稱GRES或廣義引用分割)的新任務,允許表達式指向任意數(shù)量的目標對象。與經典的RES類似,GRES接受一張圖像和一句自然語言表達式作為輸入。但與傳統(tǒng)RES不同,GRES進一步支持了多目標表達式,即在單個表達式中指定多個目標對象,例如圖2中的“Everyone except the kid in white”,以及無目標表達式,即表達式沒有指向圖像中的任何對象,例如圖2中的“the kid in blue”。GRES為輸入表達式提供了更大的靈活性,可以更好地支撐引用分割的實際應用。

圖2:多目標表達式和無目標表達式示例

新數(shù)據(jù)集:gRefCOCO

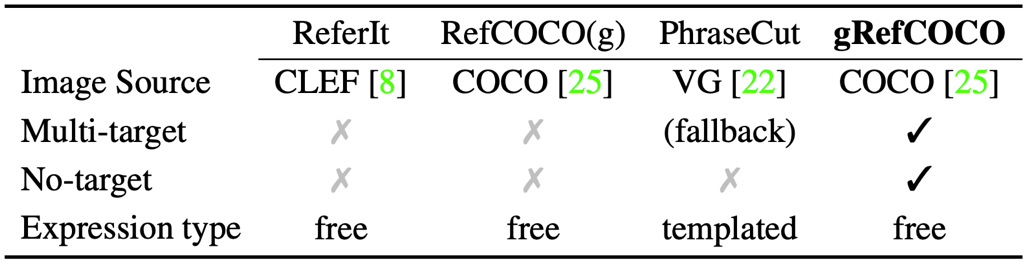

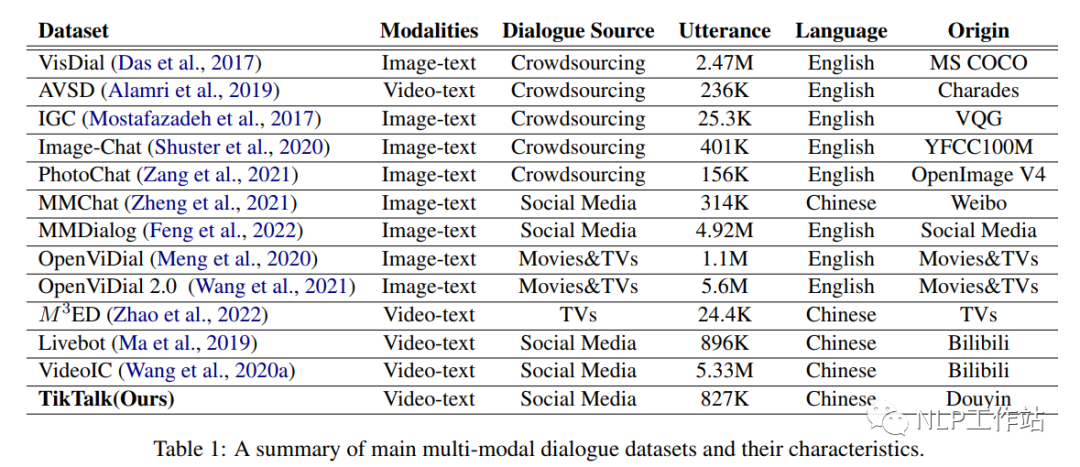

然而,現(xiàn)有的幾個引用表達數(shù)據(jù)集,如RefCOCO系列,幾乎不包含多目標表達式或無目標表達式樣本,只有單目標表達式樣本,如表1所示。

表1:gRefCOCO與其他引用表達式數(shù)據(jù)集的比較

為了促進對GRES的研究工作,本文構建了新的大規(guī)模引用分割數(shù)據(jù)集gRefCOCO。它進一步包含多目標表達式和無目標表達式。該數(shù)據(jù)集共有278,232個表達式,其中包括80,022個多目標表達式和32,202個無目標表達式,涉及19,994張圖像中的60,287個不同物體。

gRefCOCO數(shù)據(jù)集的多目標表達式主要有以下難點:

1.計數(shù)表達式:處理包含計數(shù)的表達式,需要區(qū)分基數(shù)詞和序數(shù)詞,如“two”和“second”,并具備對象計數(shù)能力。

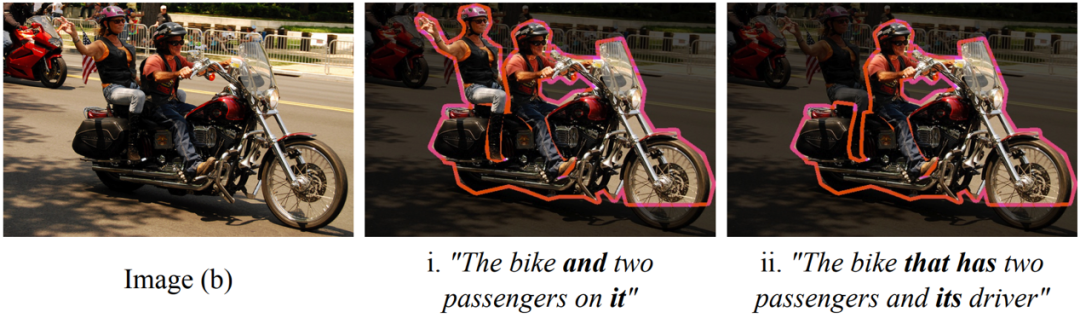

2.復合句結構:理解復合句結構中的多個元素之間的關系,包括“A and B”、“A except B”和“A with B or C”。如圖3中的第一個表達式。

3.屬性的范圍:要處理多目標表達式中的不同目標之間的屬性共享或差異,需深入理解各個屬性以及它們與相應對象之間的關系。

4.復雜關系:多目標表達式中的關系描述更復雜,需要理解并推斷目標之間的關系,例如通過關鍵詞“and”來指示目標數(shù)量。模型需對圖像和表達式中的所有實例及其相互作用有深入理解。如圖3中的第二個表達式,使用了復雜的句子來表達目標與非目標之間的關系。

圖3:gRefCOCO樣本示例

無目標表達式的構建主要遵循兩個原則:

1.表達式不能與圖像完全無關。例如,給定圖1中的圖像,“the kid in blue”是可以接受的,因為圖像中確實存在“kid”和“blue”,但沒有一個“kind in blue”。但是像“狗”、“汽車”、“河流”等與該圖像中的任何內容都完全無關的表達式是不可接受的。

2.如果規(guī)則1中所要求的表達式很難想出,標注員可以選擇從RefCOCO同一split中的其他圖像中選取具有迷惑性的表達式。

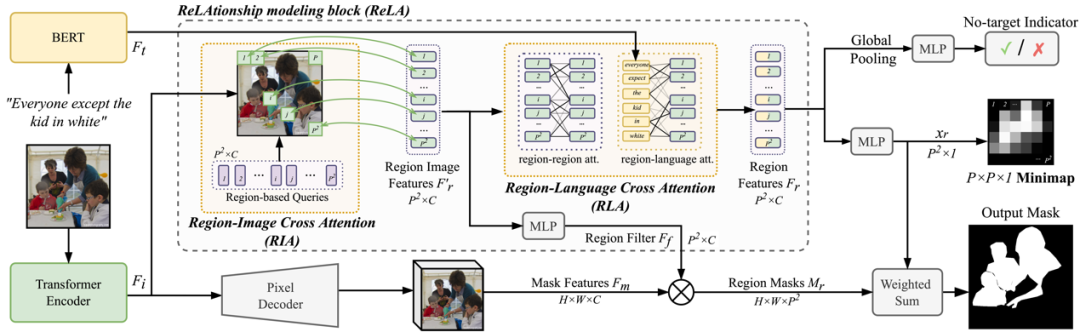

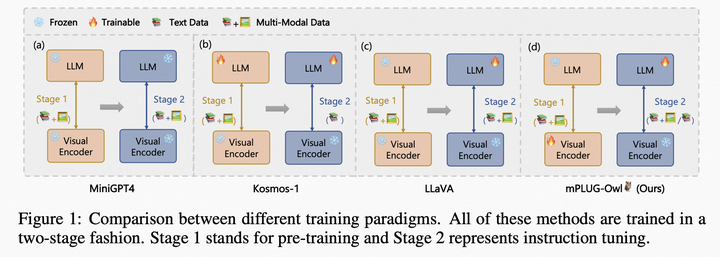

新模型:ReLA

GRES中多目標表達式中的關系和屬性描述更加復雜。與經典的引用分割(RES)相比,對于廣義引用表達分割(GRES)來說,更具挑戰(zhàn)性的是對圖像中區(qū)域之間的復雜交互關系進行建模,并捕捉所有對象的細粒度屬性。本文提出了一個新的基準模型ReLA,明確地對圖像的不同部分和表達式中的不同單詞進行信息交換和相互作用,以分析它們之間的依賴關系。通過這種方式,我們能夠更好地理解圖像和表達式之間的復雜交互。

所提出的關系(ReLAtionship)建模方法具有兩個主要模塊,即區(qū)域-圖像交叉注意力(Region-Image Cross Attention,RIA)和區(qū)域-語言交叉注意力(Region-Language Cross Attention,RLA)。RIA模塊靈活地收集區(qū)域圖像特征,而RLA模塊則捕捉區(qū)域之間的關系以及區(qū)域與語言之間的依賴關系。通過這兩個模塊,我們能夠更好地建模圖像和表達式之間的復雜交互,并提高引用表達分割的性能。

實驗

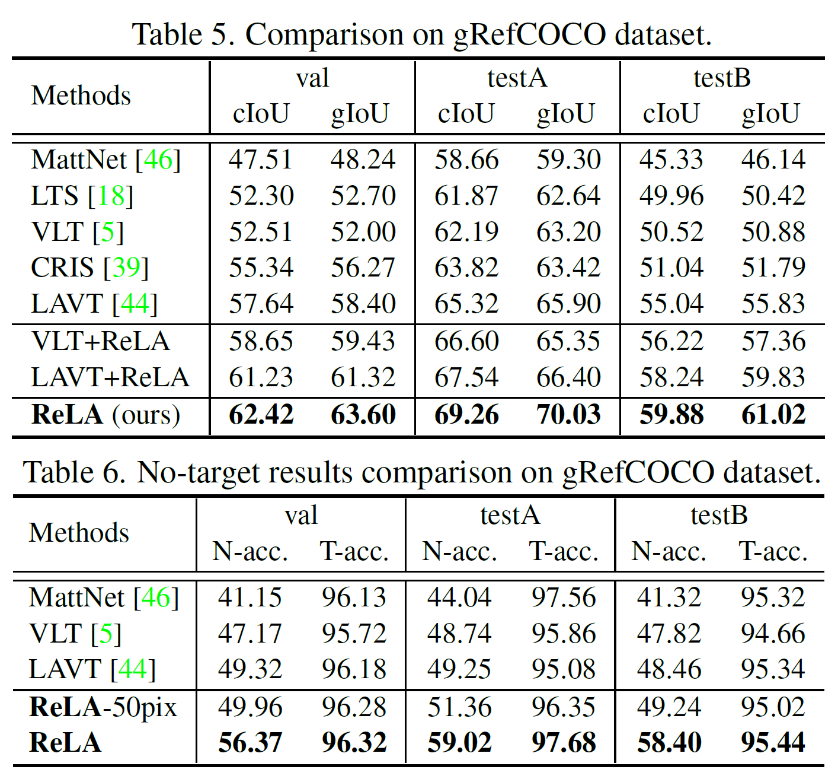

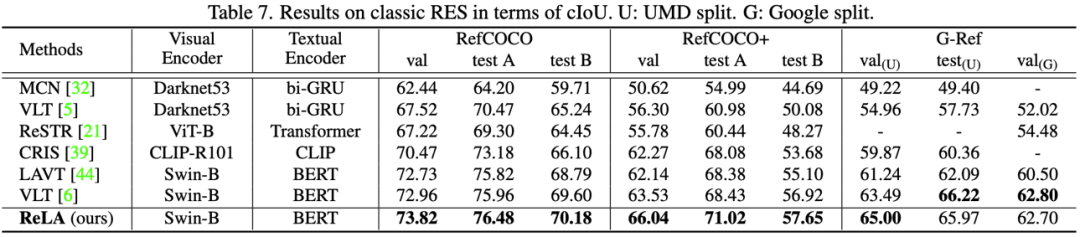

根據(jù)GRES任務的特性,文章提出了新的測評指標:gIoU、N-acc、T-acc,分別用來衡量整體分割性能、正確識別無目標表達式的性能、和無目標表達式對引用分割的影響。

提出的基準方法ReLA在GRES和傳統(tǒng)單目標RES上均取得了最佳性能。這證明了顯式建模不同圖像區(qū)域和詞語之間的關系對引用分割的有效性。

對多目標表達式的分割結果可視化如下:

對無目標表達式的分割結果可視化如下:

總結

本文分析并解決了經典引用分割(RES)任務的局限性,即無法處理多目標和無目標表達式。基于此,本文定義了一個名為廣義引用表達分割(GRES)的新任務,允許表達式中包含任意數(shù)量的目標。為支持GRES的研究,本文構建了一個大規(guī)模的數(shù)據(jù)集gRefCOCO、提出了基準方法ReLA,用于顯式建模不同圖像區(qū)域和詞語之間的關系。該方法在經典的RES任務和新提出的GRES任務上取得了最佳結果。GRES降低了對自然語言輸入的限制,擴大了引用分割的應用范圍,如多實例和無正確對象的情況,期待GRES能夠打開了新的應用領域。

-

機器人

+關注

關注

213文章

29583瀏覽量

212041 -

圖像

+關注

關注

2文章

1094瀏覽量

41107 -

數(shù)據(jù)集

+關注

關注

4文章

1223瀏覽量

25330

發(fā)布評論請先 登錄

請問UCOSIII如何切換到新任務?

黑莓10更多細節(jié)曝光:全新任務管理器

多文化場景下的多模態(tài)情感識別

美國宇航局朝著發(fā)射新任務邁出了一大步

DocumentAI的模型、任務和基準數(shù)據(jù)集

基于圖文多模態(tài)領域典型任務

一個真實閑聊多模態(tài)數(shù)據(jù)集TikTalk

中文多模態(tài)對話數(shù)據(jù)集

如何利用LLM做多模態(tài)任務?

自動駕駛深度多模態(tài)目標檢測和語義分割:數(shù)據(jù)集、方法和挑戰(zhàn)

廣義引用分割問題GRES的應用案例解析

多模態(tài)上下文指令調優(yōu)數(shù)據(jù)集MIMIC-IT

2025未來產業(yè)創(chuàng)新任務 | 清潔氫

多模態(tài)新任務和新數(shù)據(jù)集!NTU提出廣義引用分割問題GRES

多模態(tài)新任務和新數(shù)據(jù)集!NTU提出廣義引用分割問題GRES

評論