本文作者 | 黃巍

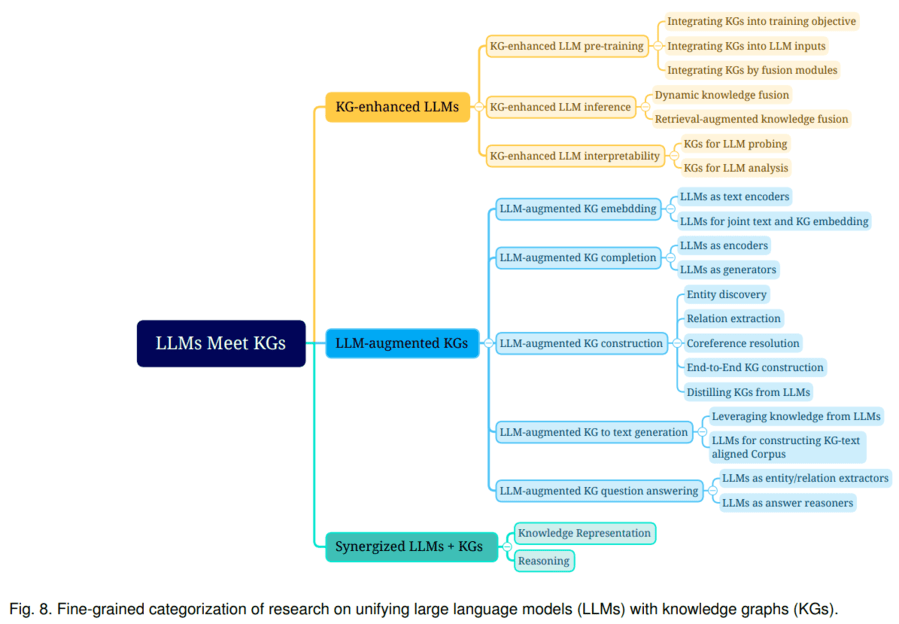

《Unifying Large Language Models and Knowledge Graphs: A Roadmap》總結(jié)了大語言模型和知識(shí)圖譜融合的三種路線:1)KG增強(qiáng)的LLM,可在LLMs的預(yù)訓(xùn)練和推理階段引入KGs;2)LLM增強(qiáng)KG,LLM可用于KG構(gòu)建、KG embedding、KG補(bǔ)全、基于KG的文本生成、KBQA(基于圖譜的問答)等多種場(chǎng)景;3)LLM+KG協(xié)同使用,主要用于知識(shí)表示和推理兩個(gè)方面。該文綜述了以上三個(gè)路線的代表性研究,探討了未來可能的研究方向。

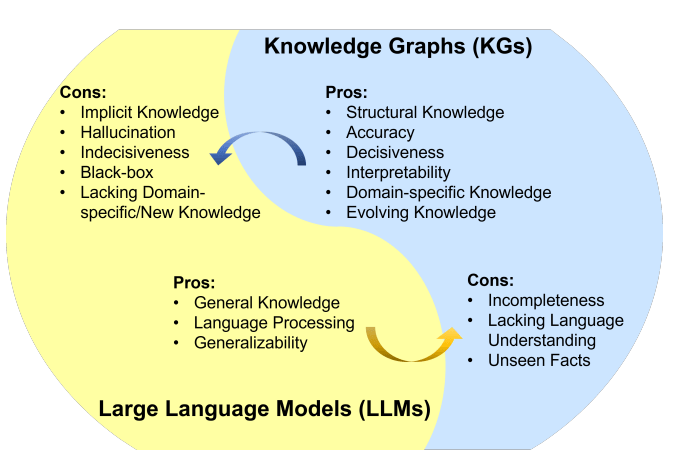

知識(shí)圖譜(KG)和大語言模型(LLM)都是知識(shí)的表示形式。KG是符號(hào)化的知識(shí)庫,具備一定推理能力,且結(jié)果可解釋性較好。但存在構(gòu)建成本高、泛化能力不足、更新難等不足。LLM是參數(shù)化的概率知識(shí)庫,具備較強(qiáng)語義理解和泛化能力,但它是黑盒模型,可能編造子虛烏有的內(nèi)容,結(jié)果的可解釋性較差。可見,將LLM和KG協(xié)同使用,同時(shí)利用它們的優(yōu)勢(shì),是一種互補(bǔ)的做法。

LLM和KG的融合路線,可分為以下類型:

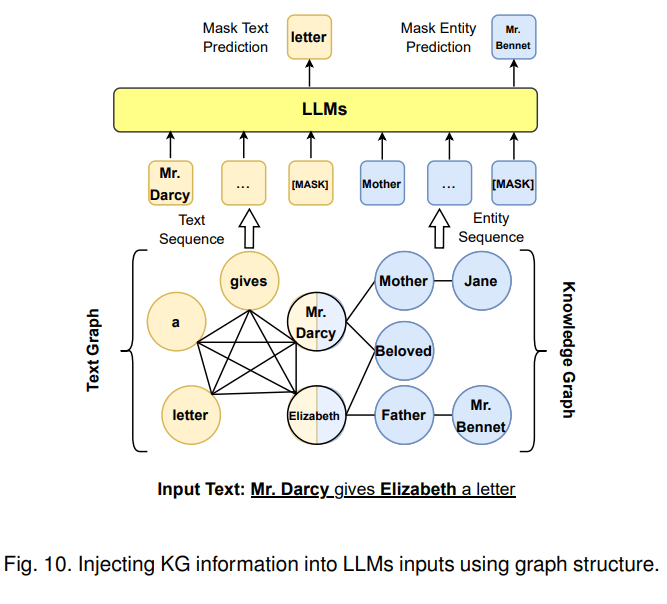

第一種融合路線是KG增強(qiáng)LLM,可在LLM預(yù)訓(xùn)練、推理階段引入KG。以KG增強(qiáng)LLM預(yù)訓(xùn)練為例,一個(gè)代表工作是百度的ERNIE 3.0將圖譜三元組轉(zhuǎn)換成一段token文本作為輸入,并遮蓋其實(shí)體或者關(guān)系來進(jìn)行預(yù)訓(xùn)練,使模型在預(yù)訓(xùn)練階段直接學(xué)習(xí)KG蘊(yùn)含的知識(shí)。

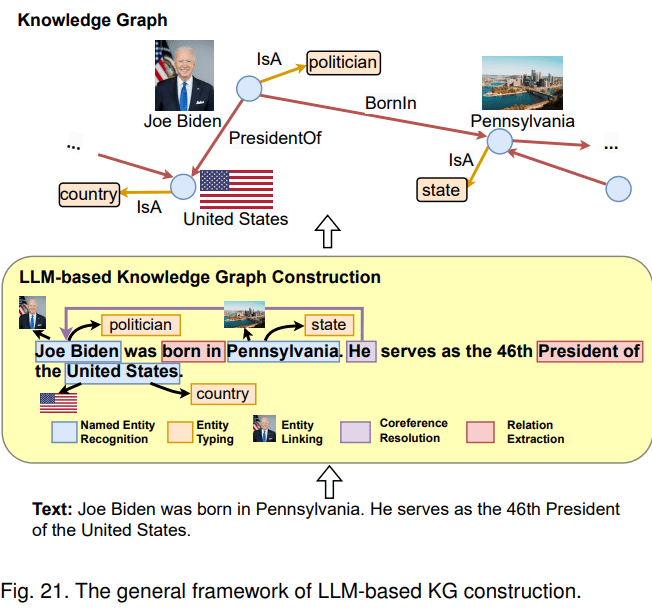

第二種融合路線是LLM增強(qiáng)KG。LLM可用于KG構(gòu)建、KG embedding、KG補(bǔ)全、基于KG的文本生成、KBQA(基于圖譜的問答)等多種場(chǎng)景。以KG構(gòu)建為例,這是一項(xiàng)成本很高的工作,一般包含1) entity discovery 實(shí)體挖掘 2) coreference resolution 指代消解 3) relation extraction 關(guān)系抽取任務(wù)。LLM本身蘊(yùn)含知識(shí),且具備較強(qiáng)的語義理解能力,因此,可利用LLM從原始數(shù)據(jù)中抽取實(shí)體、關(guān)系,進(jìn)而構(gòu)建知識(shí)圖譜。

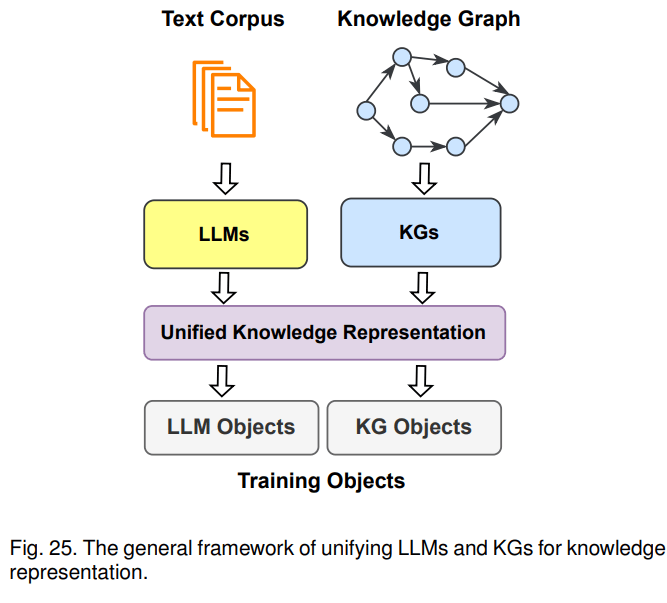

第三種融合路線是KG+LLM協(xié)同使用,主要用于知識(shí)表示和推理兩個(gè)方面。以知識(shí)表示為例,文本語料庫和知識(shí)圖譜都蘊(yùn)含了大量的知識(shí),文本中的知識(shí)通常是非結(jié)構(gòu)化的,圖譜里的知識(shí)則是結(jié)構(gòu)化的,針對(duì)一些下游任務(wù),需要將其對(duì)齊進(jìn)行統(tǒng)一的表示。比如,KEPLER是一個(gè)統(tǒng)一的模型來進(jìn)行統(tǒng)一表示,它將文本通過LLM轉(zhuǎn)成embedding表示,然后把KG embedding的優(yōu)化目標(biāo)和語言模型的優(yōu)化目標(biāo)結(jié)合起來,一起作為KEPLER模型的優(yōu)化目標(biāo),最后得到一個(gè)能聯(lián)合表示文本語料和圖譜的模型。示意圖如下:

小結(jié)

上述方法都在嘗試打破LLM和KG兩類不同知識(shí)表示的邊界,促使LLM這種概率模型能利用KG靜態(tài)的、符號(hào)化的知識(shí);促使KG能利用LLM參數(shù)化的概率知識(shí)。從現(xiàn)有落地案例來看,大模型對(duì)知識(shí)的抽象程度高,泛化能力強(qiáng),用戶開箱即用,體驗(yàn)更好。且如果采用大模型+搜索的方案,用戶更新知識(shí)的成本也較低,往知識(shí)庫加文檔即可。在實(shí)際業(yè)務(wù)場(chǎng)景落地時(shí),如果條件允許,優(yōu)先考慮使用大模型。當(dāng)前chatGPT火爆,也印證了其可用性更好。如遇到以下場(chǎng)景時(shí),可以考慮將LLM和KG結(jié)合使用:

?對(duì)知識(shí)可信度和可解釋性要求高的場(chǎng)景,比如醫(yī)療、法律等,可以考慮再建設(shè)知識(shí)圖譜來降低大模型回答錯(cuò)誤知識(shí)的概率,提高回答的可信度和可解釋性。

?已經(jīng)有一個(gè)蘊(yùn)含豐富知識(shí)的圖譜,再做大模型建設(shè)時(shí)。可以參考KG增強(qiáng)LLM的方法,將其知識(shí)融合到LLM中。

?涉及基于圖譜的多條推理能力的場(chǎng)景。

?涉及基于圖譜可視化展示的場(chǎng)景,比如企查查、天眼查等。

參考文獻(xiàn):

1.Unifying Large Language Models and Knowledge Graphs: A Roadmaphttps://arxiv.org/abs/2306.08302

原文標(biāo)題:知識(shí)圖譜與大模型結(jié)合方法概述

文章出處:【微信公眾號(hào):華為DevCloud】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

-

華為

+關(guān)注

關(guān)注

216文章

35082瀏覽量

255257

原文標(biāo)題:知識(shí)圖譜與大模型結(jié)合方法概述

文章出處:【微信號(hào):華為DevCloud,微信公眾號(hào):華為DevCloud】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

輕輕松松學(xué)電工(識(shí)圖篇)

典型電路原理、電路識(shí)圖從入門到精通等資料

電路識(shí)圖從入門到精通高清電子資料

淵亭KGAG升級(jí)引入“高級(jí)策略推理”

微軟發(fā)布《GraphRAG實(shí)踐應(yīng)用白皮書》助力開發(fā)者

利智方:驅(qū)動(dòng)企業(yè)知識(shí)管理與AI創(chuàng)新加速的平臺(tái)

傳音旗下人工智能項(xiàng)目榮獲2024年“上海產(chǎn)學(xué)研合作優(yōu)秀項(xiàng)目獎(jiǎng)”一等獎(jiǎng)

知識(shí)圖譜與大模型結(jié)合方法概述

知識(shí)圖譜與大模型結(jié)合方法概述

評(píng)論