由 NVIDIA RTX 和 GeForce RTX 技術驅動的 AI PC 時代已經到來。在這一背景下,一種評估 AI 加速性能的新方法應運而生,同時還帶來了一套新術語,這套術語成了用戶選擇臺式電腦和筆記本電腦的參考標準。

雖然 PC 游戲玩家了解每秒幀數(FPS)及類似的統計數據,但衡量 AI 性能需要新的指標。

TOPS 脫穎而出

TOPS,即每秒萬億次運算是首要的基準指標。“萬億”是這里的關鍵詞:生成式 AI 任務背后的處理運算量是巨大的。您可以將 TOPS 視為原始性能指標,類似于發動機的額定功率。這個數值自然是越大越好。

例如,比較一下微軟最近發布的 Windows 11 AI PC,其中就包含每秒至少可執行 40 萬億次運算的神經處理單元(NPU)。40 TOPS 的算力足以勝任一些輕量級 AI 輔助任務,例如詢問本地聊天機器人昨天的筆記在哪里。

但許多生成式 AI 的算力需求遠不止于此。NVIDIA RTX 和 GeForce RTX GPU 可在所有生成式任務中提供卓越的性能,其中 GeForce RTX 4090 GPU 的算力可達 1177 TOPS。這就是處理 AI 輔助數字內容創作(DCC)、PC 游戲 AI 超分辨率、根據文本或視頻生成圖像、與本地大語言模型(LLM)交互等任務所需的算力。

以 Token 衡量性能

TOPS 只是一項基礎衡量指標。LLM 的性能以模型生成的 Token 數量來衡量。

Token 是 LLM 的輸出,它可以是句子中的一個詞,甚至可以是標點符號或空格這類更小的片段。AI 加速任務的性能可以用“每秒 Token 數”來衡量。

另一個重要因素則是 batch size,也就是在一次推理過程中可同時處理的輸入數量。由于大語言模型(LLM)是許多現代 AI 系統的核心,處理多個輸入(例如來自單個應用或跨多個應用)的能力將成為關鍵的差異化因素。雖然較大的 batch size 可以提升并發輸入的性能,但也需要占用更多的內存,尤其是運行較大的模型時。

RTX GPU 非常適合 LLM,因為它們擁有大量專用的顯存(VRAM)、Tensor Core 和 TensorRT-LLM 軟件。

GeForce RTX GPU 最多可提供 24GB 的高速 VRAM,而 NVIDIA RTX GPU 最多可提供 48GB 的高速 VRAM,可支持更大的模型和更大的 batch size。RTX GPU 還可利用 Tensor Core,這是一種專用的 AI 加速器,可顯著加速深度學習和生成式 AI 模型中的計算密集型運算。應用在使用 NVIDIA TensorRT 軟件開發套件(SDK)的情況下可輕松實現超高性能。該套件可在超過 1 億臺由 RTX GPU 驅動的 Windows PC 和工作站上解鎖超高性能生成式 AI。

結合了大顯存、專用 AI 加速器和優化的軟件,RTX GPU 的吞吐量得到了巨大提升,尤其是在 batch size 增加的情況下。

文本生圖像,速度超以往

測量圖像生成速度是評估性能的另一種方法。最直接的一個方法是使用 Stable Diffusion,這是一種基于圖像的熱門 AI 模型,可讓用戶輕松地將文本描述轉換為復雜的視覺畫面。

借由 Stable Diffusion,用戶可以通過輸入關鍵詞快速獲得想要的圖像相比于 CPU 或 NPU,使用 RTX GPU 運行 AI 模型時可以更快生成所需結果。

在熱門的 Automatic1111 界面使用 TensorRT 擴展程序時,相應性能表現甚至會更好。借助 SDXL 模型,RTX 用戶通過提示生成圖像的速度至多可提升至原來的 2 倍,這可大幅簡化 Stable Diffusion 工作流。

另一個熱門的 Stable Diffusion 用戶界面 ComfyUI 在上周也支持了 TensorRT 加速。現在,RTX 用戶文生圖的速度可提升多達 60%。RTX 用戶還可使用 Stable Video Diffusion 將這些圖像轉換為視頻,在 TensorRT 的助力下,轉換速度甚至可提升多達 70%。

全新的 UL Procyon AI 圖像生成基準測試現已支持 TensorRT 加速。與最快的非 TensorRT 加速狀態相比,TensorRT 加速可在 GeForce RTX 4080 SUPER GPU 上帶來 50% 的速度提升。

適用于 Stable Diffusion 3 的 TensorRT 加速近期發布,前者是 Stability AI 備受期待的全新文本轉圖像模型。此外,全新的 TensorRT-Model Optimizer 可進一步提升性能。與非 TensorRT 加速狀態相比,它可帶來顯著的速度提升,同時減少顯存消耗。

當然,眼見方能為實。真正的考驗來自于不斷迭代提示詞這種真實場景。在 RTX GPU 上,用戶通過改進提示詞來優化圖像的速度可得到顯著提升,每次迭代只需數秒即可完成。而在 Macbook Pro M3 Max 上,完成相同的迭代需要耗費數分鐘。此外,如果在由 RTX 驅動的 PC 或工作站上本地運行,用戶可以同時享受到速度和安全性方面的優勢,并讓所有內容保持私密。

測試結果出爐,相關技術開源

不過,且不要僅聽我們的一面之詞。開源的 Jan.ai 背后的 AI 研究人員和工程師團隊最近將 TensorRT-LLM 集成到了其本地聊天機器人應用中,然后親自測試了這些優化效果。

研究人員在社區使用的各種 GPU 和 CPU 上,以開源的 llama.cpp 推理引擎為對照,測試了 TensorRT-LLM 的實際表現。他們發現 TensorRT“在相同硬件上比 llama.cpp 快 30-70%”,并且在進行連續處理時效率更高。該團隊還提供了測試方法,邀請其他人親自測試生成式 AI 的性能。

無論是游戲還是生成式 AI,速度才是其致勝法寶。在確定性能冠軍時,TOPS、每秒 Token 數和 batch size 均需納入考量。

-

NVIDIA

+關注

關注

14文章

5258瀏覽量

105861 -

PC

+關注

關注

9文章

2144瀏覽量

156108 -

內存

+關注

關注

8文章

3111瀏覽量

75030 -

AI

+關注

關注

88文章

34421瀏覽量

275731

原文標題:解碼 RTX AI PC 和工作站上的 AI 性能

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

潤開鴻推出基于OpenHarmony的桌面操作系統及AI PC工作站

英特爾發布全新GPU,AI和工作站迎來新選擇

首創開源架構,天璣AI開發套件讓端側AI模型接入得心應手

Banana Pi 發布 BPI-AI2N & BPI-AI2N Carrier,助力 AI 計算與嵌入式開發

NVIDIA Blackwell RTX PRO 提供工作站和服務器兩種規格,助力設計師、開發者、數據科學家和創作人員構建代理式

工業機器人工作站的建設意義

快速升級DELL與HP工作站儲存效能,實現高效工作流!

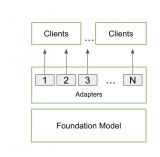

NVIDIA推出面向RTX AI PC的AI基礎模型

提升企業效能:迷你工作站的潛力

RTX AI PC和工作站提供強大AI性能

RTX AI PC和工作站提供強大AI性能

評論