NVIDIA 于近日發(fā)布NVIDIA RTX AI套件,這一工具和 SDK 集合能夠幫助 Windows 應(yīng)用開發(fā)者定制、優(yōu)化和部署適用于 Windows 應(yīng)用的 AI 模型。該套件免費提供,不要求使用者具備 AI 框架和開發(fā)工具方面的經(jīng)驗,并且可以為本地和云端部署提供絕佳的 AI 性能。

生成式預(yù)訓(xùn)練轉(zhuǎn)換器(GPT)模型的普及為 Windows 開發(fā)者創(chuàng)造了將 AI 功能集成到應(yīng)用中的絕佳機會。但要實現(xiàn)這些功能仍面臨著巨大的挑戰(zhàn)。首先,您需要根據(jù)應(yīng)用的特定需求來定制模型。其次,需要優(yōu)化模型,使其在適應(yīng)各種硬件的同時,仍然能夠提供絕佳的性能。之后,需要一條同時適用于云端和本地 AI 的簡便部署路徑。

NVIDIA RTX AI 套件為 Windows 應(yīng)用開發(fā)者提供了端到端工作流。您可以根據(jù)應(yīng)用的特定要求,使用常用的微調(diào)技術(shù)對 Hugging Face 的預(yù)訓(xùn)練模型進行定制,并將它們量化到適合消費類 PC 的規(guī)模。然后,可以對它們進行優(yōu)化,使其能夠在整個NVIDIA GeForce RTX GPU系列以及云端 NVIDIA GPU 上發(fā)揮絕佳性能。

當(dāng)需要部署時,無論您是選擇將經(jīng)過優(yōu)化的模型與應(yīng)用捆綁在一起,還是在應(yīng)用安裝/更新時下載模型,亦或是建立一個云微服務(wù),RTX AI 套件都能提供多種途徑來滿足您的應(yīng)用需求。該套件還包含NVIDIA AI 推理管理器(AIM)SDK,能夠根據(jù)用戶的系統(tǒng)配置或當(dāng)前的工作負載讓應(yīng)用在本地或云端運行 AI。

適用于各種應(yīng)用的強大定制 AI

當(dāng)今的生成式模型在龐大的數(shù)據(jù)集上訓(xùn)練而成。整個訓(xùn)練過程可能需要數(shù)周時間,并使用數(shù)百顆全球最強大的 GPU。雖然這些計算資源對大多數(shù)開發(fā)者來說遙不可及,但開源預(yù)訓(xùn)練模型可以讓您獲得強大的 AI 功能。

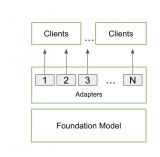

開源預(yù)訓(xùn)練基礎(chǔ)模型通常在通用數(shù)據(jù)集上訓(xùn)練而成,因此在各種任務(wù)中都能夠提供不錯的結(jié)果。但應(yīng)用往往需要專門的行為,例如游戲角色需要以特定的方式說話、科學(xué)寫作助手需要理解特定行業(yè)的術(shù)語等。

微調(diào)是一種可以根據(jù)應(yīng)用需求,在額外的數(shù)據(jù)上對預(yù)訓(xùn)練模型進行進一步訓(xùn)練的技術(shù),例如游戲角色的對話示例。

RTX AI 套件包含NVIDIA AI Workbench等支持微調(diào)的工具。今年早些時候發(fā)布的 AI Workbench 是一款用于在本地 RTX GPU 和云端中組織并運行模型訓(xùn)練、調(diào)優(yōu)與優(yōu)化項目的工具。RTX AI 套件還包含使用 QLoRA 進行微調(diào)的 AI Workbench 項目,QLoRA 是當(dāng)今最常用、效果最好的技術(shù)之一。

為了實現(xiàn)參數(shù)高效微調(diào),該套件使用 Hugging Face Transformer 庫來充分發(fā)揮 QLoRA 的作用,在減少內(nèi)存使用的同時實現(xiàn)了定制化,而且可以在搭載 RTX GPU 的客戶端設(shè)備上高效運行。

微調(diào)完成后的下一步是優(yōu)化。

針對 PC 和云端進行優(yōu)化

AI 模型優(yōu)化需要解決兩大難題。首先,PC 用于運行 AI 模型的內(nèi)存和計算資源有限。其次,PC 和云端之間存在各種具有不同功能的目標硬件。

RTX AI 套件包含以下用于優(yōu)化 AI 模型并使其作好部署準備的工具。

NVIDIA TensorRT 模型優(yōu)化器:即使較小的 LLM 也需要 14 GB 或以上的內(nèi)存。適用于 Windows 的 NVIDIA TensorRT 模型優(yōu)化器正式發(fā)布,它所提供的模型量化工具可在不顯著降低準確性的情況下,將模型規(guī)模最多縮小至原來的三分之一。其中的 INT4 AWQ 后訓(xùn)練量化等方法便于在 RTX GPU 上運行最先進的 LLM。這樣一來,較小的模型不僅可以更加容易地適應(yīng)典型系統(tǒng)上可用的 GPU 內(nèi)存,還能通過減少內(nèi)存帶寬瓶頸來提高性能。

NVIDIA TensorRT Cloud:為了在每個系統(tǒng)上都能獲得絕佳的性能,可以針對每個 GPU 專門優(yōu)化模型。當(dāng)前推出的NVIDIA TensorRT Cloud開發(fā)者預(yù)覽版是一項云服務(wù),用于為 PC 中的 RTX GPU 以及云端中的 GPU 構(gòu)建經(jīng)過優(yōu)化的模型引擎。它還為流行的生成式 AI 模型提供了預(yù)構(gòu)建的減重引擎,這些引擎可與微調(diào)的權(quán)重合并成優(yōu)化的引擎。與預(yù)訓(xùn)練模型相比,使用 TensorRT Cloud 構(gòu)建并使用 TensorRT 運行時運行的引擎可以實現(xiàn)高達 4 倍的性能提升。

優(yōu)化微調(diào)模型后的下一步是部署。

開發(fā)一次即可實現(xiàn)隨處部署

如果您的應(yīng)用能夠在本地或云端執(zhí)行推理,就能為大多數(shù)用戶提供絕佳的體驗。將模型部署在設(shè)備上可以實現(xiàn)更低的延遲,并且不需要在運行時調(diào)用云,但對硬件有一定的要求。將模型部署在云端則可以支持在任何硬件上運行的應(yīng)用,但服務(wù)提供商需要承擔(dān)持續(xù)的運營成本。在完成模型開發(fā)后,您就可以使用 RTX AI 套件將其部署到任意位置,且該套件中的工具既適用于設(shè)備端路徑,也適用于云端路徑,例如:

NVIDIA AI 推理管理器(AIM):當(dāng)前推出的 AIM 搶先體驗版為 PC 開發(fā)者簡化了 AI 集成的復(fù)雜性,并且可以在 PC 端和云端無縫協(xié)調(diào) AI 推理。NVIDIA AIM 利用必要的 AI 模型、引擎和依賴關(guān)系對 PC 環(huán)境進行預(yù)配置,并支持 GPU、NPU、CPU 等各種不同加速器的所有主要推理后端(TensorRT、ONNX Runtime、GGUF、Pytorch)。它還能執(zhí)行運行時兼容性檢查,以此確定 PC 是否能在本地運行模型,或者根據(jù)開發(fā)者策略切換到云端。

借助 NVIDIA AIM,開發(fā)者既可以利用NVIDIA NIM在云端進行部署,也可以利用 TensorRT 等工具在本地設(shè)備上進行部署。

NVIDIA NIM:NVIDIA NIM 是一套易于使用的微服務(wù),能夠加速云、數(shù)據(jù)中心和工作站中的生成式 AI 模型部署。NIM 屬于NVIDIA AI Enterprise軟件套裝的一部分。RTX AI 套件提供的工具可將經(jīng)過優(yōu)化的模型與其依賴關(guān)系打包并上傳至?xí)捍娣?wù)器,然后啟動 NIM。這一步將調(diào)入經(jīng)過優(yōu)化的模型,并創(chuàng)建一個端點供應(yīng)用調(diào)用。

您還可以使用 NVIDIA AI 推理管理器(AIM)插件在設(shè)備上部署模型,有助于管理本地和云推理的細節(jié),減輕開發(fā)者的集成負擔(dān)。

NVIDIA TensorRT:NVIDIA TensorRT 10.0和TensorRT-LLM推理后端為配備張量核的 NVIDIA GPU 提供同類產(chǎn)品中的最佳性能。新發(fā)布的 TensorRT 10.0 簡化了將 AI 模型部署到 Windows 應(yīng)用中的流程。減重引擎可壓縮 99% 以上的已編譯引擎大小,因此可直接在終端用戶設(shè)備上使用模型權(quán)重對其進行重新調(diào)整。此外,TensorRT 還為 AI 模型提供軟硬件前向兼容性,使其能與較新的運行時或硬件配合使用。TensorRT-LLM 加入了在 RTX GPU 上加速生成式 AI LLM 和 SLM 的專門優(yōu)化措施,可進一步加速 LLM 推理。

?這些工具使開發(fā)者能夠在應(yīng)用運行時準備好模型。

RTX AI 加速生態(tài)系統(tǒng)

包括 Adobe、Blackmagic Design、Topaz Labs 等在內(nèi)的頂尖創(chuàng)意獨立軟件開發(fā)商(ISV)正在將 NVIDIA RTX AI 套件集成到他們的應(yīng)用中,以提供在 RTX PC 上運行的 AI 加速應(yīng)用,從而提升數(shù)百萬創(chuàng)作者的用戶體驗。

如果您想要在 RTX PC 上構(gòu)建基于 RAG 和智能體的加速工作流,可以通過 LangChain 和 LlamaIndex 等開發(fā)者框架獲得 RTX AI 套件的功能和組件(如 TensorRT-LLM)。此外,常用的生態(tài)系統(tǒng)工具(如 Automatic1111、Comfy.UI、Jan.AI、OobaBooga 和 Sanctum.AI)也可通過 RTX AI 套件實現(xiàn)加速。通過這些集成,您可以輕松構(gòu)建經(jīng)過優(yōu)化的 AI 加速應(yīng)用,將其部署到設(shè)備和云端 GPU 上,并在應(yīng)用中實現(xiàn)能夠在各種本地和云環(huán)境中運行推理的混合功能。

將強大的 AI

加入到 Windows 應(yīng)用中

NVIDIA RTX AI 套件為 Windows 應(yīng)用開發(fā)者提供了一套端到端工作流,使他們能夠充分利用預(yù)訓(xùn)練模型,對這些模型進行定制和優(yōu)化,并將它們部署到本地或云端運行。借助快速、強大的混合 AI,由 AI 驅(qū)動的應(yīng)用既能夠快速擴展,又能在各個系統(tǒng)上提供絕佳的性能。RTX AI 套件使您能夠為更多用戶帶來更多由 AI 驅(qū)動的功能,讓用戶在游戲、生產(chǎn)、內(nèi)容創(chuàng)建等所有活動中都能享受到 AI 所帶來的好處。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5267瀏覽量

105898 -

WINDOWS

+關(guān)注

關(guān)注

4文章

3608瀏覽量

91056 -

AI

+關(guān)注

關(guān)注

88文章

34505瀏覽量

275994 -

應(yīng)用開發(fā)

+關(guān)注

關(guān)注

0文章

63瀏覽量

9686

原文標題:借助適用于 Windows RTX PC 的 NVIDIA RTX AI 套件簡化 AI 驅(qū)動的應(yīng)用開發(fā)

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業(yè)解決方案】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

NVIDIA技術(shù)助力企業(yè)創(chuàng)建主權(quán)AI智能體

NVIDIA計劃打造全球首個工業(yè)AI云平臺

AI端側(cè)部署開發(fā)(SC171開發(fā)套件V3)

首創(chuàng)開源架構(gòu),天璣AI開發(fā)套件讓端側(cè)AI模型接入得心應(yīng)手

使用NVIDIA RTX PRO Blackwell系列GPU加速AI開發(fā)

NVIDIA推出面向RTX AI PC的AI基礎(chǔ)模型

NVIDIA RTX AI Toolkit擁抱LoRA技術(shù)

使用全新NVIDIA AI Blueprint開發(fā)視覺AI智能體

Arm推出GitHub平臺AI工具,簡化開發(fā)者AI應(yīng)用開發(fā)部署流程

NVIDIA生成式AI進入ROS社區(qū)

RTX AI PC和工作站提供強大AI性能

揭秘NVIDIA AI Workbench 如何助力應(yīng)用開發(fā)

NVIDIA RTX AI套件簡化AI驅(qū)動的應(yīng)用開發(fā)

NVIDIA RTX AI套件簡化AI驅(qū)動的應(yīng)用開發(fā)

評論