作者 /Google DeepMind 研究副總裁 Clement Farabet 和Google DeepMind 總監 Tris Warkentin

AI 有可能解決人類面臨的一些最緊迫的問題,但前提是每個人都擁有構建 AI 的工具。這就是我們在今年早些時候推出 Gemma的原因,Gemma 是一系列輕量級開放模型系列,采用了與創建 Gemini 模型相同的研究和技術。我們還陸續推出了 CodeGemma、RecurrentGemma 和 PaliGemma,以此不斷發展我們的 Gemma 系列,上述每個模型都能為不同的 AI 任務提供獨特的功能,并且可以通過與 Hugging Face、NVIDIA 和 Ollama 等合作伙伴的集成輕松訪問。

現在,我們正式向全球研究人員和開發者發布 Gemma 2。Gemma 2 分為 90 億 (9B) 和 270 億 (27B) 兩種參數版本,與第一代相比,其性能更強、推理效率更高,并且在安全性方面也有顯著提升。事實上,作為一種有競爭力的替代方案,Gemma 2 27B 的性能可以與規模是其兩倍的模型相媲美,截至去年 12 月,只有專有模型才能達到此性能水準。如今,這可以在單個 NVIDIA H100 Tensor Core GPU 或 TPU 的主機上實現,從而顯著降低了部署成本。

效率與性能躍階的

全新開放模型標準

我們在重新設計的架構上構建了 Gemma 2,旨在提供卓越的性能和推理效率。以下是它脫穎而出的原因:

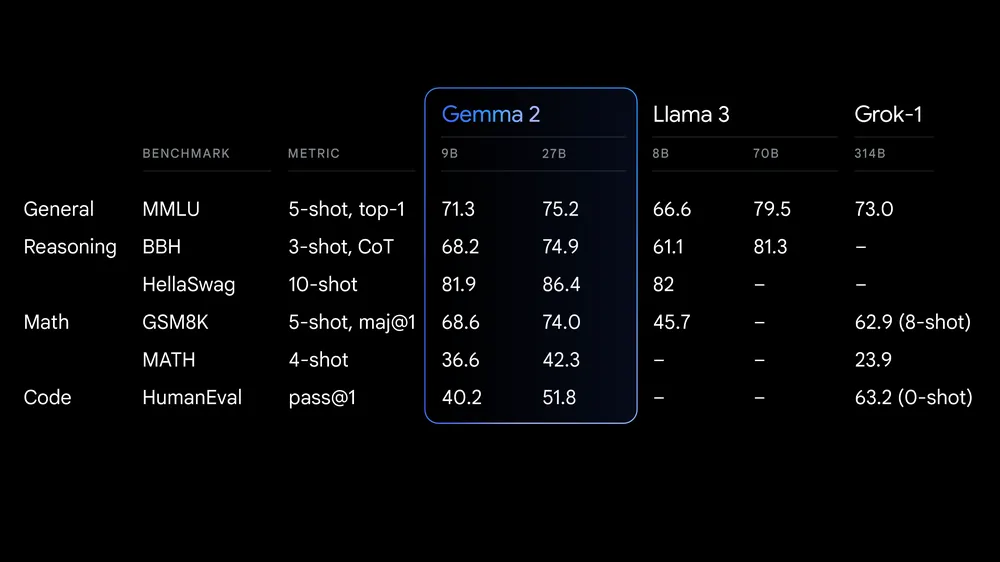

非凡性能:Gemma 2 27B 在同類規模的模型中性能最優,甚至比其規模大兩倍以上的模型更具競爭力。而 Gemma 2 9B 模型也具有一流的性能,優于 Llama 3 8B 以及其他相同規模類別的開放模型。如需了解詳細性能分析,請查閱技術報告。

立竿見影的降本增效:Gemma 2 27B 模型旨在助您使用單個 Google Cloud TPU 主機、NVIDIA A100 80GB Tensor Core GPU 或 NVIDIA H100 Tensor Core GPU 以全精度高效運行推理,從而顯著降低成本,同時保持高效性能。這使得 AI 部署更加易于訪問且經濟實惠。

跨硬件的極速推理:Gemma 2 經過優化,可以在一系列硬件上以不可思議的速度運行,包括強大的游戲本電腦、高端臺式機和云端配置等。您可以在 Google AI Studio 中以全精度體驗 Gemma 2,在 CPU 上使用 Gemma.cpp 量化版本解鎖本地性能,或者通過 Hugging Face Transformer 在配備 NVIDIA RTX 或 GeForce RTX 的家用電腦上試用。

專為開發者和研究人員打造

Gemma 2 不僅功能更強大,并且還能夠更輕松地集成到您的工作流程中:

開放且易于訪問:就像最初的 Gemma 模型一樣,Gemma 2 可在我們商業友好型的 Gemma 許可下使用,支持開發者和研究人員分享和商業化他們的創新成果。

廣泛的框架兼容性:由于 Gemma 2 與 Hugging Face Transformer 等主要 AI 框架兼容,并且通過原生 Keras 3.0、vLLM、Gemma.cpp、Llama.cpp 和 Ollama 兼容 JAX、PyTorch 和 TensorFlow,因此您可以輕松地將其與您偏好的工具和工作流一起使用。此外,我們還通過 NVIDIA TensorRT-LLM 優化了 Gemma,支持該模型在 NVIDIA 加速基礎架構上運行,或作為 NVIDIA NIM 推理微服務運行,并將很快優化支持 NVIDIA NeMo。您現在便可以使用 Keras 和 Hugging Face 進行微調。我們正在積極努力,以提供更多參數高效的微調選項。

輕松部署:從七月開始,Google Cloud 客戶將能夠在 Vertex AI 上輕松部署和管理 Gemma 2。

探索新的 Gemma 手冊,其中包含一系列實用示例和指南,幫助您構建自己的應用并針對特定任務微調 Gemma 2 模型。還可了解如何輕松使用您的工具與 Gemma 集成,包括用于如檢索增強生成等常見任務。

負責任的 AI 開發

我們致力于為開發者和研究人員提供負責任地構建和部署 AI 所需的資源,包括使用我們負責任的生成式 AI 工具包 (Responsible Generative AI Toolkit)。最近開源的 LLM Comparator 可幫助開發者和研究人員深入評估語言模型。現在,您可以使用配套的 Python 庫對您的模型和數據進行比較評估,并在應用中可視化結果。此外,我們正在積極致力于為 Gemma 模型開源文本水印技術 SynthID。

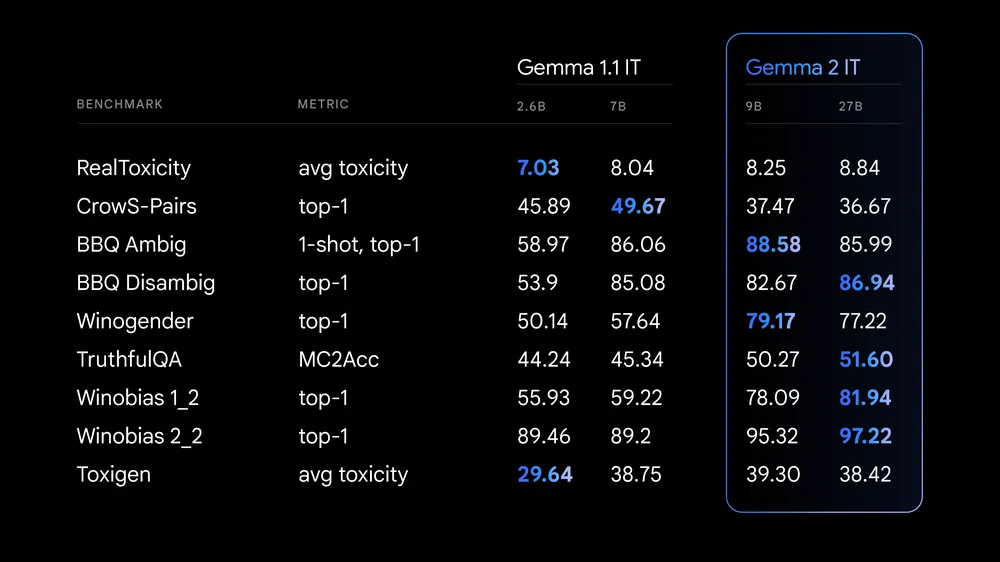

在訓練 Gemma 2 時,我們遵循穩健的內部安全流程和過濾預訓練數據,并根據一套全面的指標開展嚴格的測試和評估,以識別和減輕潛在的偏見和風險。我們在大量的與安全和代表性危害相關的公共基準上發布我們的結果。

使用 Gemma 構建的項目

我們首次推出 Gemma 時獲得了超過 1,000 萬次的下載量,并促成了無數鼓舞人心的項目。例如,Navarasa 利用 Gemma 創建了一個基于印度語言多樣性的模型。

如今,Gemma 2 將幫助開發者落地更具雄心的項目,在他們的 AI 創作中釋放全新的性能和潛力。我們將不懈地探索新的架構,并開發專門的 Gemma 變體,以應對更廣泛的 AI 任務和挑戰。這包括即將推出的Gemma 2 2.6B 模型,旨在進一步彌合輕量級可訪問性與強大性能之間的差距。您可以參閱技術報告以詳細了解。

開始構建

Gemma 2 現已在 Google AI Studio 中推出,因此您可以在無需硬件要求的情況下測試 Gemma 2 27B 的全部性能。您還可以從 Kaggle 和 Hugging Face 模型下載 Gemma 2 的模型權重,Vertex AI Model Garden 中也即將推出。

為了方便研究和開發,您還可通過 Kaggle 或 Colab notebook 免費使用 Gemma 2。首次使用 Google Cloud 的用戶可能有資格獲得 300 美元積分。學術研究人員可以通過申請 Gemma 2 學術研究計劃 (Gemma 2 Academic Research Program)獲取 Google Cloud 積分,從而加速 Gemma 2 的研究。申請現已開放,截止日期為 8 月 9 日。

-

Google

+關注

關注

5文章

1788瀏覽量

58701 -

AI

+關注

關注

88文章

34413瀏覽量

275695 -

模型

+關注

關注

1文章

3499瀏覽量

50066

原文標題:效率與性能提升 | 可供開發者和研究人員使用的 Gemma 2 現已發布

文章出處:【微信號:Google_Developers,微信公眾號:谷歌開發者】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

谷歌新一代 TPU 芯片 Ironwood:助力大規模思考與推理的 AI 模型新引擎?

谷歌 Gemini 2.0 Flash 系列 AI 模型上新

Traco Power推出全新TXO系列開放式框架AC/DC電源

NVIDIA推出開放式Llama Nemotron系列模型

谷歌發布Gemini 2.0 AI模型

2024年聯想創新開放日盛大開啟

NVIDIA推出全新生成式AI模型Fugatto

谷歌將推出Gemini大型語言模型

谷歌全新推出開放式視覺語言模型PaliGemma

智譜AI宣布GLM-4-Flash大模型免費開放

Google Gemma 2模型的部署和Fine-Tune演示

谷歌推出效率與性能躍階的全新開放模型標準

谷歌推出效率與性能躍階的全新開放模型標準

評論