來源:微軟研究院AI頭條

概要:1月17日,院友袁進輝博士回到微軟亞洲研究院做了題為《打造最強深度學習引擎》的報告,分享了深度學習框架方面的技術進展。

1月17日,院友袁進輝博士回到微軟亞洲研究院做了題為《打造最強深度學習引擎》的報告,分享了深度學習框架方面的技術進展。報告中主要講解了何為最強的計算引擎?專用硬件為什么快?大規模專用硬件面臨著什么問題?軟件構架又應該解決哪些問題?

首先,我們一起來開一個腦洞:想象一個最理想的深度學習引擎應該是什么樣子的,或者說深度學習引擎的終極形態是什么?看看這會給深度學習框架和AI專用芯片研發帶來什么啟發。

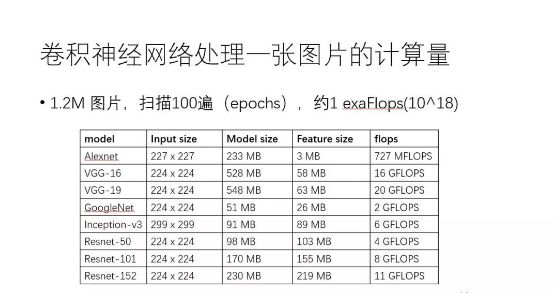

以大家耳熟能詳的卷積神經網絡CNN 為例,可以感覺一下目前訓練深度學習模型需要多少計算力。下方這張表列出了常見CNN模型處理一張圖片需要的內存容量和浮點計算次數,譬如VGG-16網絡處理一張圖片就需要16Gflops。值得注意的是,基于ImageNet數據集訓練CNN,數據集一共大約120萬張圖片,訓練算法需要對這個數據集掃描100遍(epoch),這意味著10^18次浮點計算,即1exaFlops。簡單演算一下可發現,基于一個主頻為2.0GHz的CPU core來訓練這樣的模型需要好幾年的時間。

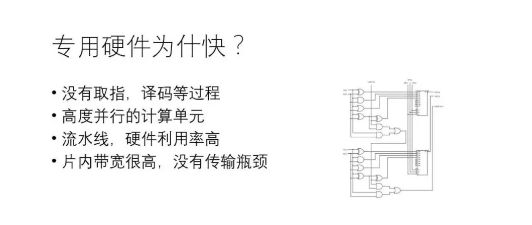

專用硬件比通用硬件(如CPU、GPU)快,有多種原因,主要包括:(1)通用芯片一般經歷“取指-譯碼-執行”(甚至包括“取數據”)的步驟才能完成一次運算,專用硬件大大減小了“取指-譯碼”等開銷,數據到達即執行;(2)專用硬件控制電路復雜度低,可以在相同的面積下集成更多對運算有用的器件,可以在一個時鐘周期內完成通用硬件需要數千上萬個時鐘周期才能完成的操作;(3)專用硬件和通用硬件內都支持流水線并行,硬件利用率高;(4)專用硬件片內帶寬高,大部分數據在片內傳輸。顯然,如果不考慮物理現實,不管什么神經網絡,不管問題的規模有多大,都實現一套專用硬件是效率最高的做法。問題是,這行得通嗎?

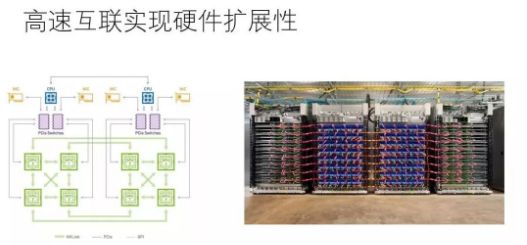

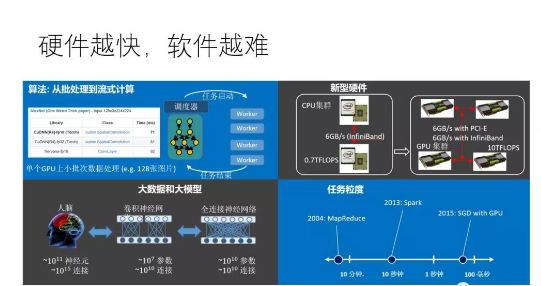

現實中,不管是通用硬件(如GPU)還是專用硬件(如TPU) 都可以通過高速互聯技術連接在一起,通過軟件協調多個設備來完成大規模計算。使用最先進的互聯技術,設備和設備之間傳輸帶寬可以達到100Gbps或者更多,這比設備內部帶寬低上一兩個數量級,不過幸好,如果軟件“調配得當”,在這個帶寬條件下也可能使得硬件計算飽和。當然,“調配得當”技術挑戰極大,事實上,單個設備速度越快,越難把多個設備“調配得當”。

當前深度學習普遍采用隨機梯度下降算法(SGD),一般一個GPU處理一小塊兒數據只需要100毫秒的時間,那么問題的關鍵就成了,“調配”算法能否在100毫秒的時間內為GPU處理下一塊數據做好準備,如果可以的話,那么GPU就會一直保持在運算狀態,如果不可以,那么GPU就要間歇性的停頓,意味著設備利用率降低。理論上是可以的,有個叫運算強度(Arithmetic intensity)的概念,即flops per byte,表示一個字節的數據上發生的運算量,只要這個運算量足夠大,意味著傳輸一個字節可以消耗足夠多的計算量,那么即使設備間傳輸帶寬低于設備內部帶寬,也有可能使得設備處于滿負荷狀態。進一步,如果采用比GPU更快的設備,那么處理一塊兒數據的時間就比100毫秒更低,譬如10毫秒,在給定的帶寬條件下,“調配”算法能用10毫秒的時間為下一次計算做好準備嗎?事實上,即使是使用不那么快(相對于TPU 等專用芯片)的GPU,當前主流的深度學習框架在某些場景(譬如模型并行)已經力不從心了。

一個通用的深度學習軟件框架要能對任何給定的神經網絡和可用資源都能最高效的“調配”硬件,這需要解決三個核心問題:(1)資源分配,包括計算核心,內存,傳輸帶寬三種資源的分配,需要綜合考慮局部性和負載均衡的問題;(2)生成正確的數據路由(相當于前文想象的專用硬件之間的連線問題);(3)高效的運行機制,完美協調數據搬運和計算,硬件利用率最高。

事實上,這三個問題都很挑戰,本文暫不討論其解法,假設我們能夠解決這些問題的話,會有什么好處呢?

假設我們能解決前述的三個軟件上的難題,那就能“魚與熊掌兼得”:軟件發揮靈活性,硬件發揮高效率,任給一個深度學習任務,用戶不需要重新連線,就能享受那種“無限大專用硬件”的性能,何其美好。更令人激動的是,當這種軟件得以實現時,專用硬件可以比現在所有AI芯片都更簡單更高效。讀者可以先想象一下怎么實現這種美好的前景。

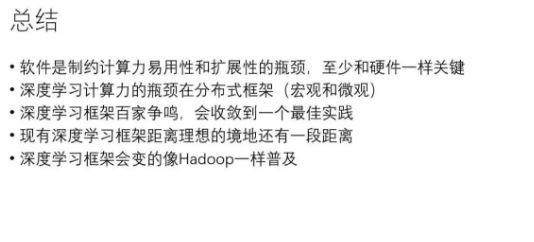

讓我們重申一下幾個觀點:(1)軟件真的非常關鍵;(2)我們對宏觀層次(設備和設備之間)的優化更感興趣;(3)深度學習框架存在一個理想的實現,正如柏拉圖心中那個最圓的圓,當然現有的深度學習框架還相距甚遠;(4)各行各業的公司,只要有數據驅動的業務,最終都需要一個自己的“大腦”,這種“大腦”不應該只被少數巨頭公司獨享。

-

硬件

+關注

關注

11文章

3464瀏覽量

67276 -

深度學習

+關注

關注

73文章

5557瀏覽量

122565 -

cnn

+關注

關注

3文章

354瀏覽量

22665

原文標題:深度學習引擎的終極形態是什么?

文章出處:【微信號:AItists,微信公眾號:人工智能學家】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

袁進輝:分享了深度學習框架方面的技術進展

袁進輝:分享了深度學習框架方面的技術進展

評論