你有沒有發現,現在人工智能(AI)越來越火了?聊天機器人能陪你談天說地,自動駕駛汽車能自己避障,手機拍照能自動美顏……這些背后都離不開一種神秘的技術——AI加速卡。

但很多人可能會問:AI加速卡到底是什么?它和普通顯卡有什么區別?為什么AI訓練必須用它?企業該怎么選?

今天,我們就用最通俗的語言,帶你徹底搞懂AI加速卡,看看它為什么是AI時代的"算力心臟"。同時,我們還會結合國內AI企業的實際應用案例,看看它如何在真實場景中發揮作用。

一、AI加速卡到底是個啥?

AI加速卡(AI Accelerator Card),簡單來說,就是一塊專門幫AI計算提速的硬件。它的核心任務是讓AI模型訓練得更快、推理更高效,就像給電腦裝了個"超級外掛"。

普通顯卡(比如游戲顯卡)主要用來處理圖像、視頻,讓畫面更流暢。而AI加速卡則是專門為深度學習計算設計的,擅長處理海量數據、矩陣運算等AI任務。

舉個例子:

假如你在訓練一個AI模型,比如讓電腦識別貓和狗:

● 普通顯卡:就像用自行車運貨,速度慢,效率低,跑幾個小時都不一定訓練完。

●AI加速卡:就像用超級卡車運貨,速度快,效率高,原本需要1天的任務,現在可能只要1小時就搞定。

核心優勢對比:

| 對比項 | 普通顯卡(如NVIDIA RTX系列) | AI加速卡(如NVIDIA A100/H100、國產加速卡) |

| 設計目標 | 圖形渲染、游戲 | AI計算、深度學習 |

| 計算方式 | GPU通用計算 | 針對矩陣運算優化 |

| 算力(FP16) | 幾十到幾百TFLOPS | 幾千TFLOPS |

| 內存帶寬 | 幾百GB/s | 1TB/s+ |

| 功耗 | 200-300W | 300-700W |

可以看到,AI加速卡在算力、內存帶寬等關鍵指標上遠超普通顯卡,是AI訓練和推理的"專業選手"。

二、AI加速卡有啥用?它解決了哪些問題?

1. 突破算力瓶頸,讓AI訓練更快

AI模型越復雜,需要的算力就越大。比如GPT-3(一個超大型語言模型),如果用普通顯卡訓練,可能要跑幾個月,而用AI加速卡集群(多塊加速卡協同工作),時間可以縮短到幾周甚至幾天。

數據對比:

| 模型 | 計算量(FLOPS) | 普通GPU訓練時間 | AI加速卡訓練時間?? |

| ResNet-50 | 10^14 | ~1天 | ~1小時 |

| BERT-Large | 3×10^18 | ~數周 | ~幾天 |

| GPT-3 | 3.14×10^23 | 不可行 | ~幾個月(需超級計算機) |

結論:AI加速卡能大幅縮短訓練時間,讓企業更快推出AI產品。

案例分享:AI質檢加速方案??

在工業質檢領域,華頡科技曾為某大型汽車制造廠部署了一套AI質檢加速系統,利用4塊NVIDIA A100加速卡構建計算集群。

●原方案:使用30臺普通服務器(搭載消費級GPU),處理一輛車的質檢數據需要12分鐘,每日僅能檢測300輛車。

●升級后:采用華頡優化后的計算方案,單臺計算節點(搭載A100)可替代10臺傳統服務器,整體檢測效率提升15倍,每日汽車質檢能力突破4500輛,同時功耗降低40%。

華頡的技術負責人提到:"AI加速卡不僅是算力的提升,更是整個生產線的效率革命。"

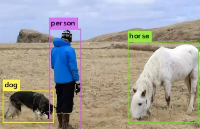

2. 提高推理效率,讓AI應用更流暢

AI推理(Inference)就是讓訓練好的模型跑起來,比如人臉識別、語音轉文字等。AI加速卡能讓推理速度更快,延遲更低。

舉例:

某自動駕駛公司采用AI加速卡后:

● 每秒可處理上千幀攝像頭數據(普通CPU只能處理幾十幀)

●識別準確率提高10%+

●整體系統延遲降低50%

適用場景:

●智能監控(實時分析監控視頻)

●語音助手(快速響應語音指令)

●醫療影像(快速分析CT、MRI圖像)

●工業質檢(高速檢測產品缺陷)

3. 降低企業AI部署成本

很多人以為AI加速卡很貴,但長期來看,它能降低企業AI部署成本。比如:

●減少服務器數量(單卡算力=多臺服務器)

●節省電費(AI加速卡能耗比更高)

●縮短模型訓練時間,提高研發效率

舉例:

某電商平臺采用AI加速卡后,商品推薦系統訓練時間從7天→8小時,研發效率提升20倍,而硬件成本反而降低了30%。

三、AI加速卡和普通顯卡的區別

很多人分不清AI加速卡和普通顯卡的區別,下面我們用最通俗的方式對比:

| 對比項 | 普通顯卡(如NVIDIA RTX 4090) | AI加速卡(如NVIDIA A100) |

| 用途 | 玩游戲、剪視頻、3D渲染 | AI訓練、AI推理 |

| 計算方式 | 通用計算(啥都能干,但不專精) | 專用計算(專攻AI任務,如矩陣運算) |

| 算力 | 強,但不夠AI專用 | 超強,專為AI優化 |

| 價格 | 幾千到一萬 | 幾萬到幾十萬(企業級) |

| 典型用戶 | 游戲玩家、設計師 | AI工程師、企業、科研機構 |

一句話總結:

普通顯卡是"萬金油",啥都能干,但不夠專業;AI加速卡是"專家",專門干AI的活兒,效率更高。

四、AI加速卡怎么選?(企業級選購指南)

如果你是企業或開發者,想部署AI加速卡,需要考慮以下幾點:

1. 算力需求

● 小型企業:單卡或小規模集群(如NVIDIA RTX 6000 Ada)

●中型企業:中型集群(A100、H100)

●大型企業/科研:超大規模集群(H100、未來可能的B100)

2. 內存和帶寬

AI模型越大,需要的顯存就越多。例如:

●普通CV(計算機視覺)模型:32GB顯存夠用

●大型NLP(自然語言處理)模型:80GB顯存起步

3. 成本和生態

●進口卡(NVIDIA/AMD):生態完善,但價格高

●國產卡(如華為昇騰、寒武紀):價格低,但生態還在發展中

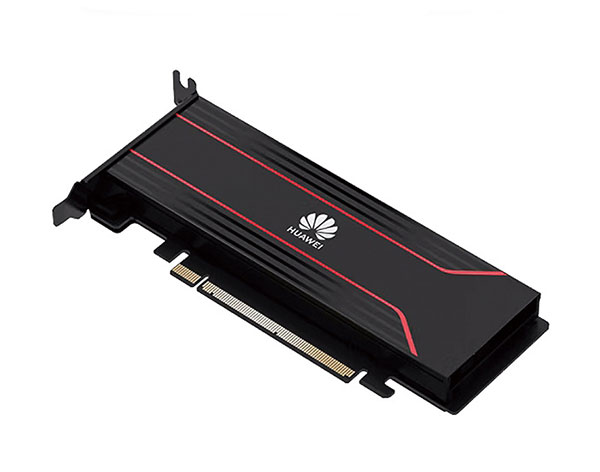

案例分享:國產加速卡方案

某中小型AI創業公司由于預算有限,選擇了華頡的國產AI加速卡——華為昇騰910,替代原定的NVIDIA方案。

● 對比:

原方案(NVIDIA A100):4卡集群成本約80萬元

國產方案(華為昇騰910):4卡集群成本約40萬元,性能接近A100的80%

●結果:

模型訓練時間從2周→2.5天,研發成本降低50%,滿足了業務的快速迭代需求。

華頡的技術總監表示:"國產加速卡在特定場景下性價比極高,是中小企業的明智之選。"

4. 未來擴展性

AI技術發展很快,算力需求會越來越大,建議選擇支持擴展的方案(如多卡互聯NVLink)。

AI加速卡到底是個啥?

AI加速卡到底是個啥?五、AI加速卡的未來發展

1. 技術趨勢

●更高效的架構:未來AI加速卡會采用光子計算、存算一體等技術,進一步提升算力。

●更低的功耗:能耗比(TFLOPS/W)會持續優化,助力綠色AI。

●軟件生態優化:更多AI框架(PyTorch、TensorFlow)將深度優化,讓加速卡更容易上手。

2. 市場趨勢

根據IDC預測:

●2023年全球AI加速卡市場規模約120億美元

●2026年預計突破450億美元

●中國市場份額將超過30%

結論:AI加速卡是AI時代的"剛需",未來幾年需求還會持續增長。

六、結語:AI加速卡——AI時代的"算力引擎"

AI加速卡,就是AI時代的"超級計算器",它能讓AI訓練更快、推理更高效、成本更低。無論你是AI從業者,還是企業決策者,了解AI加速卡都能幫你更好地擁抱AI技術。

在落地案例上,華頡科技已幫助汽車制造、AI創業公司等數十家企業優化AI算力方案,既有國際大廠的"硬核選擇",也有國產加速卡的性價比之選。

所以,下次再聽到"AI加速卡",你就知道它不是普通的顯卡,而是AI世界的算力心臟!

-

AI

+關注

關注

87文章

33701瀏覽量

274437 -

國產化

+關注

關注

0文章

108瀏覽量

7964 -

AI算法

+關注

關注

0文章

259瀏覽量

12553

發布評論請先 登錄

一文給你講透!DA板卡到底是什么?它和主板又有哪些不同?

Banana Pi 發布 BPI-AI2N & BPI-AI2N Carrier,助力 AI 計算與嵌入式開發

邊緣AI新突破:MemryX AI加速卡與RK3588打造高效多路物體檢測方案

【「AI Agent應用與項目實戰」閱讀體驗】書籍介紹

FPGA+AI王炸組合如何重塑未來世界:看看DeepSeek東方神秘力量如何預測......

當我問DeepSeek AI爆發時代的FPGA是否重要?答案是......

【小白入門必看】一文讀懂深度學習計算機視覺技術及學習路線

AI加速卡到底是個啥?一文讓小白也能看懂AI時代的“超級計算器”!

AI加速卡到底是個啥?一文讓小白也能看懂AI時代的“超級計算器”!

評論