1. Yolov5簡介

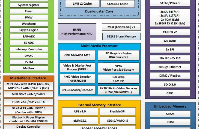

YOLOv5 模型是 Ultralytics 公司于 2020 年 6 月 9 日公開發布的。YOLOv5 模型是基于 YOLOv3 模型基礎上改進而來的,有 YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x 四個模型。YOLOv5 相比YOLOv4 而言,在檢測平均精度降低不多的基礎上,具有均值權重文件更小,訓練時間和推理速度更短的特點。YOLOv5 的網絡結構分為輸入端BackboneNeck、Head 四個部分。

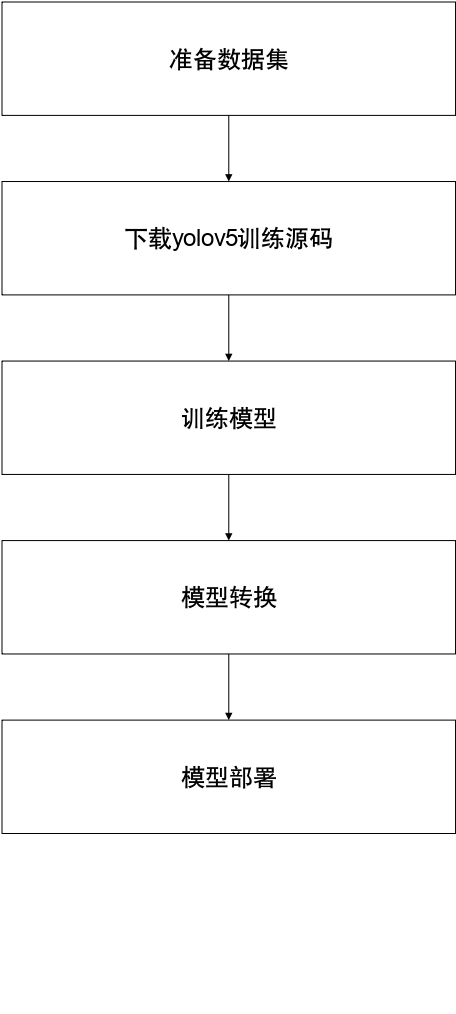

本教程針對目標檢測算法yolov5的訓練和部署到EASY-EAI-Orin-nano(RK3576)進行說明,而數據標注方法可以參考我們往期的文章。

2. 準備數據集

2.1 數據集下載

本教程以口罩檢測為例,數據集的百度網盤下載鏈接為:

https://pan.baidu.com/s/17nJq2dQXxTHwc8eo8sNj5A?pwd=1234 提取碼:1234

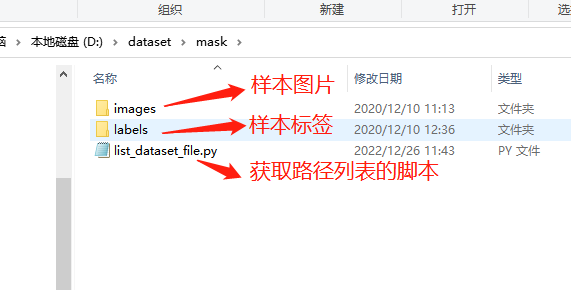

解壓完成后得到以下三個文件:

2.2 生成路徑列表

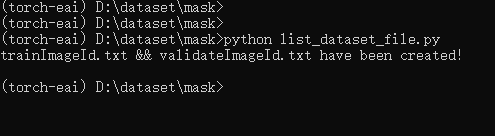

在數據集目錄下執行腳本list_dataset_file.py:

python list_dataset_file.py

執行現象如下圖所示:

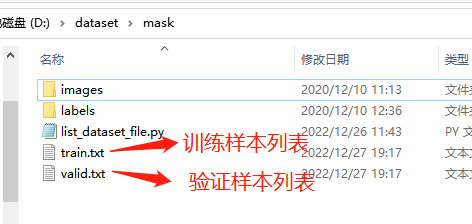

得到訓練樣本列表文件train.txt和驗證樣本列表文件valid.txt,如下圖所示:

3. Yolov5目標檢測算法訓練

3.1 訓練源碼下載

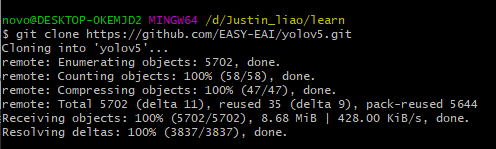

通過git工具,在PC端克隆遠程倉庫(注:此處可能會因網絡原因造成卡頓,請耐心等待):

git clone https://github.com/EASY-EAI/yolov5.git

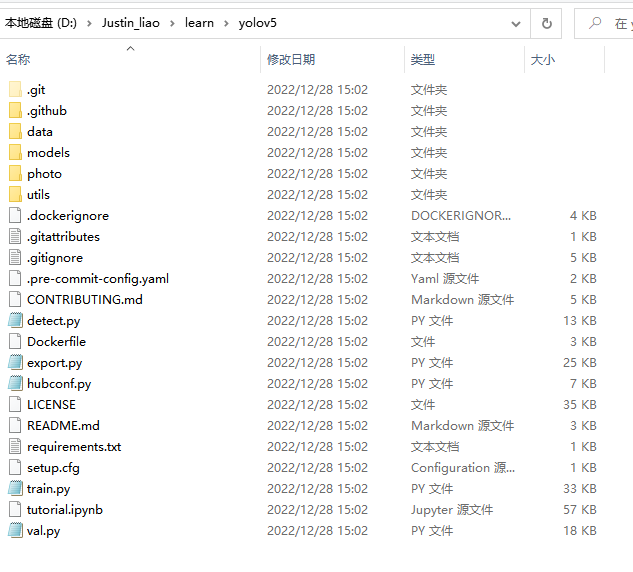

得到下圖所示目錄:

3.2 訓練模型

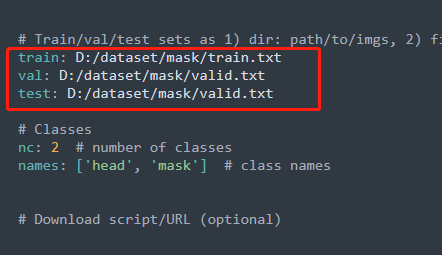

切換到yolov5的工作目錄,接下來以訓練一個口罩檢測模型為例進行說明。需要修改data/mask.yaml里面的train.txt和valid.txt的路徑。

執行下列腳本訓練算法模型:

python train.py --data mask.yaml --cfg yolov5s.yaml --weights "" --batch-size 64

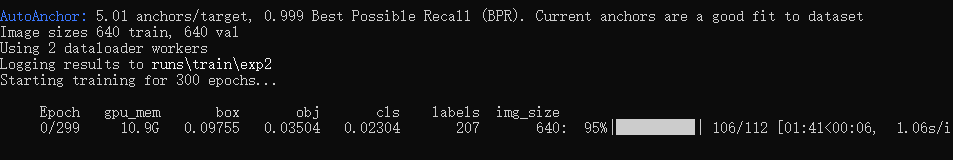

開始訓練模型,如下圖所示:

關于算法精度結果可以查看./runs/train/results.csv獲得。

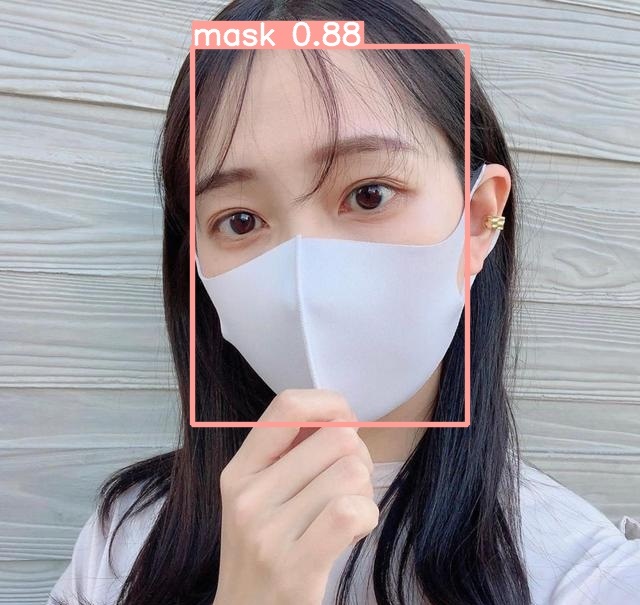

3.3 在PC端進行模型預測

訓練完畢后,在./runs/train/exp/weights/best.pt生成通過驗證集測試的最好結果的模型。同時可以執行模型預測,初步評估模型的效果:

python detect.py --source data/images --weights ./runs/train/exp/weights/best.pt --conf 0.5

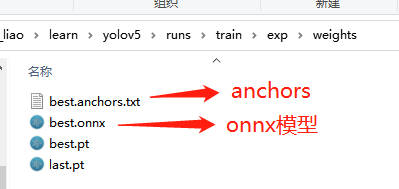

3.4 pt模型轉換為onnx模型

算法部署到EASY-EAI-Nano需要轉換為RKNN模型,而轉換RKNN之前可以把模型先轉換為ONNX模型,同時會生成best.anchors.txt:

python export.py --include onnx --rknpu RV1126 --weights ./runs/train/exp/weights/best.pt

生成如下圖所示:

4. rknn-toolkit模型轉換

4.1 rknn-toolkit模型轉換環境搭建

onnx模型需要轉換為rknn模型才能在EASY-EAI-Orin-nano運行,所以需要先搭建rknn-toolkit模型轉換工具的環境。當然tensorflow、tensroflow lite、caffe、darknet等也是通過類似的方法進行模型轉換,只是本教程onnx為例。

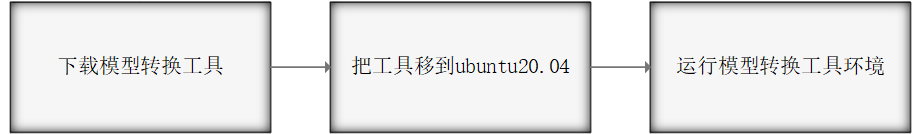

4.1.1 概述

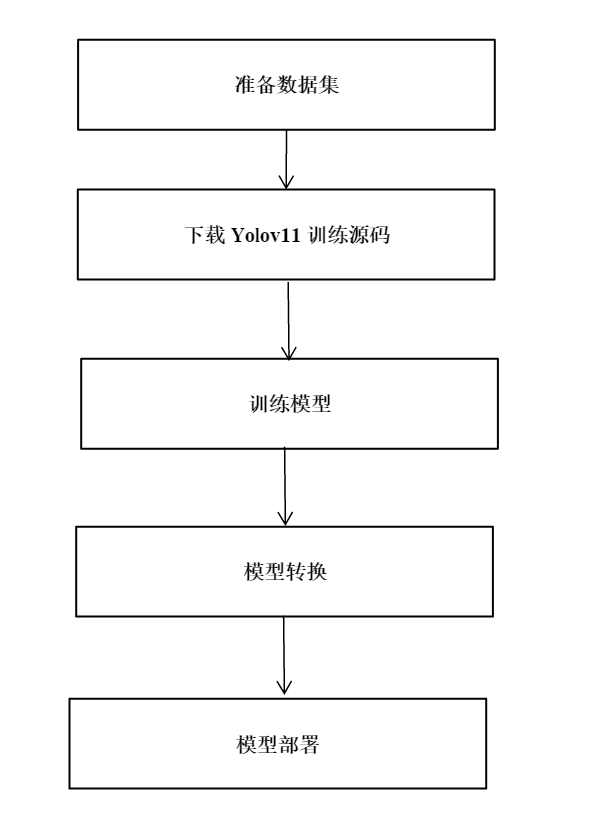

模型轉換環境搭建流程如下所示:

4.1.2 下載模型轉換工具

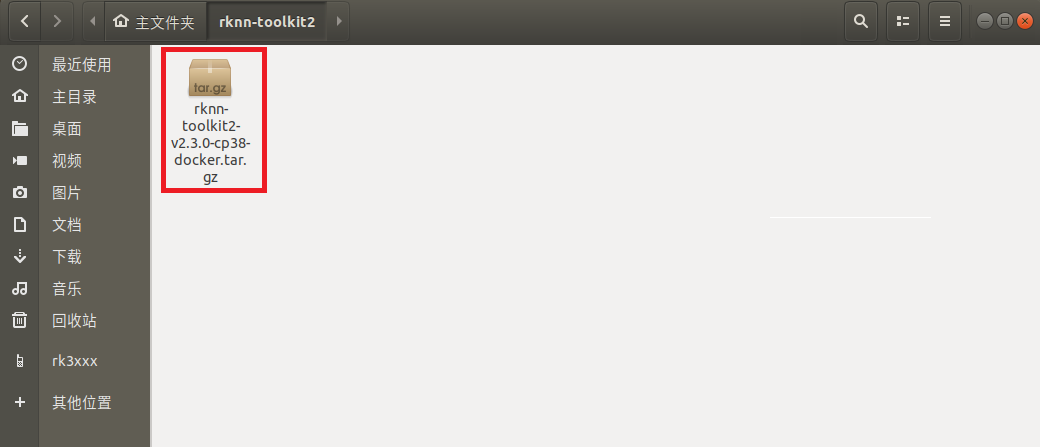

為了保證模型轉換工具順利運行,請下載網盤里“06.AI算法開發/01.rknn-toolkit2模型轉換工具/rknn-toolkit2-v2.3.0/docker/rknn-toolkit2-v2.3.0-cp38-docker.tar.gz”。

網盤下載鏈接:https://pan.baidu.com/s/1J86chdq1klKFnpCO1RCcEA?pwd=1234提取碼:1234

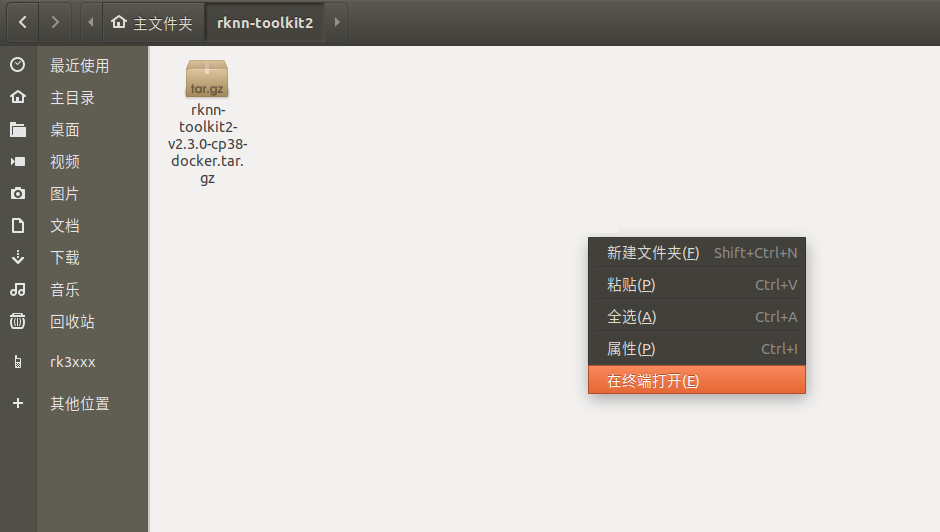

4.1.3 把工具移到ubuntu20.04

把下載完成的docker鏡像移到我司的虛擬機ubuntu20.04的rknn-toolkit2目錄,如下圖所示:

4.1.4 運行模型轉換工具環境

在該目錄打開終端

執行以下指令加載模型轉換工具docker鏡像:

docker load --input rknn-toolkit2-v2.3.0-cp38-docker.tar.gz

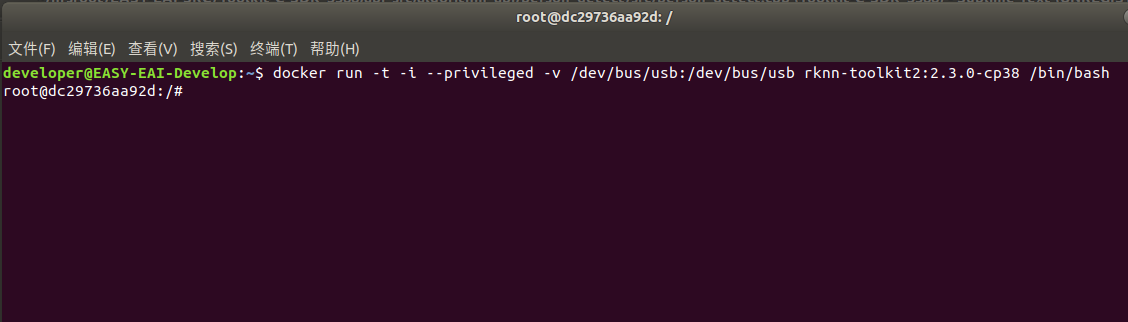

執行以下指令進入鏡像bash環境:

docker run -t -i --privileged -v /dev/bus/usb:/dev/bus/usb rknn-toolkit2:2.3.0-cp38 /bin/bash

現象如下圖所示:

輸入“python”加載python相關庫,嘗試加載rknn庫,如下圖環境測試成功:

至此,模型轉換工具環境搭建完成。

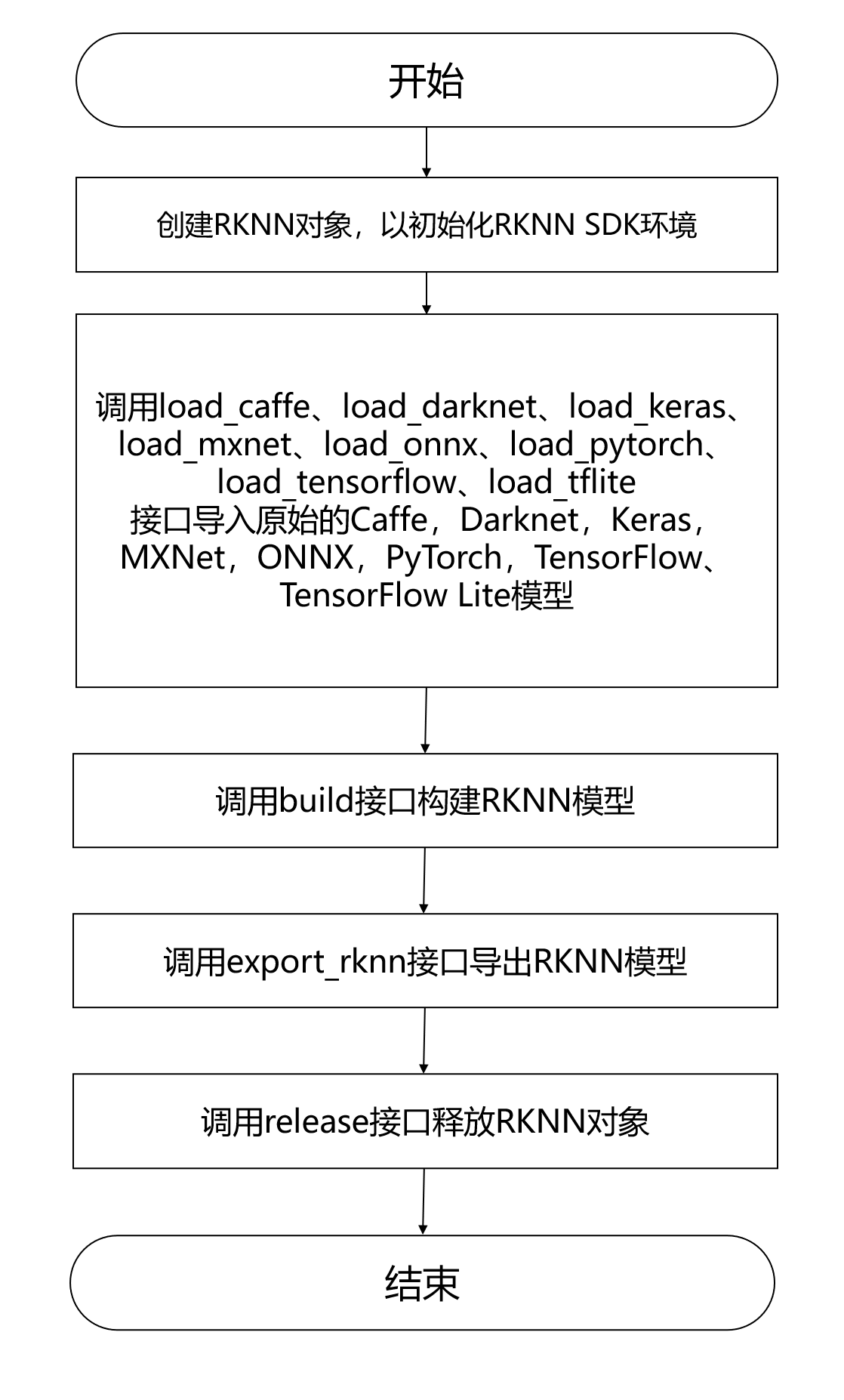

4.2 型轉換為RKNN

EASY-EAI-Orin-nano支持.rknn后綴的模型的評估及運行,對于常見的tensorflow、tensroflow lite、caffe、darknet、onnx和Pytorch模型都可以通過我們提供的 toolkit 工具將其轉換至 rknn 模型,而對于其他框架訓練出來的模型,也可以先將其轉至 onnx 模型再轉換為 rknn 模型。 模型轉換操作流程入下圖所示:

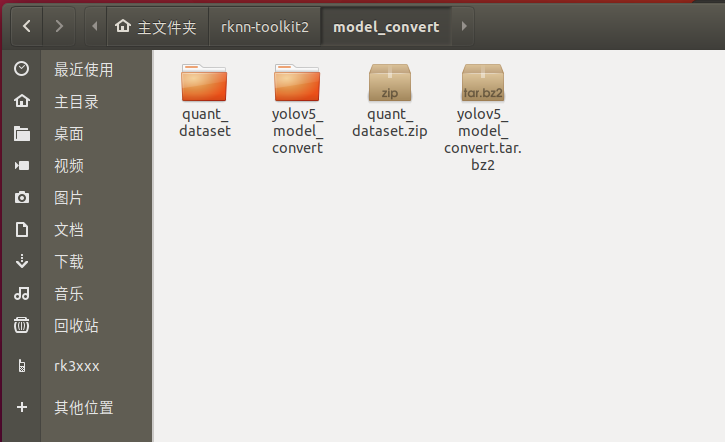

4.2.1 模型轉換Demo下載

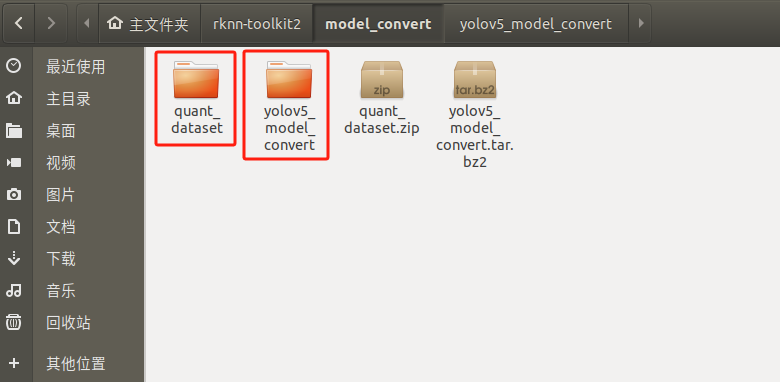

下載百度網盤鏈接:https://pan.baidu.com/s/1yWWn9JryiAOrSBNGWxuFMw?pwd=1234 提取碼:1234。把 yolov5_model_convert.tar.bz2和quant_dataset.zip解壓到虛擬機,如下圖所示:

4.2.2 進入模型轉換工具docker環境

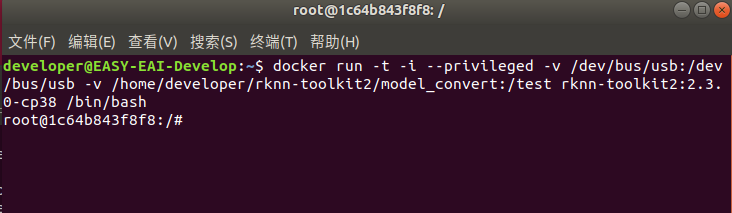

執行以下指令把工作區域映射進docker鏡像,其中/home/developer/rknn-toolkit2/model_convert為工作區域,/test為映射到docker鏡像,/dev/bus/usb:/dev/bus/usb為映射usb到docker鏡像:

docker run -t -i --privileged -v /dev/bus/usb:/dev/bus/usb -v /home/developer/rknn-toolkit2/model_convert:/test rknn-toolkit2:2.3.0-cp38 /bin/bash

執行成功如下圖所示:

4.2.3 模型轉換Demo目錄結構介紹

模型轉換測試Demo由yolov5_model_convert和quant_dataset組成。yolov5_model_convert存放軟件腳本,quant_dataset存放量化模型所需的數據。如下圖所示:

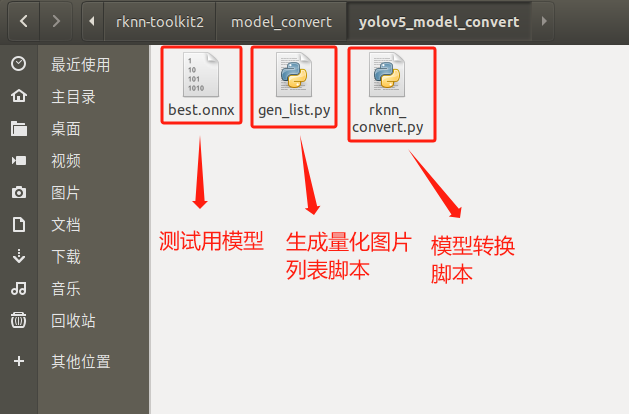

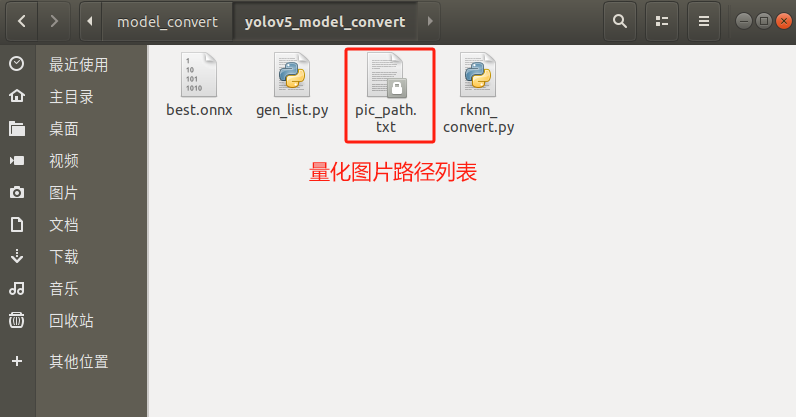

yolov5_model_convert文件夾存放以下內容,如下圖所示:

4.2.4 生成量化圖片列表

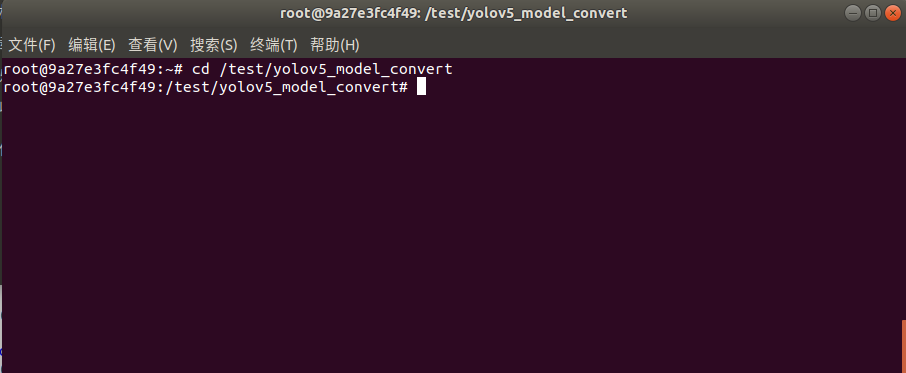

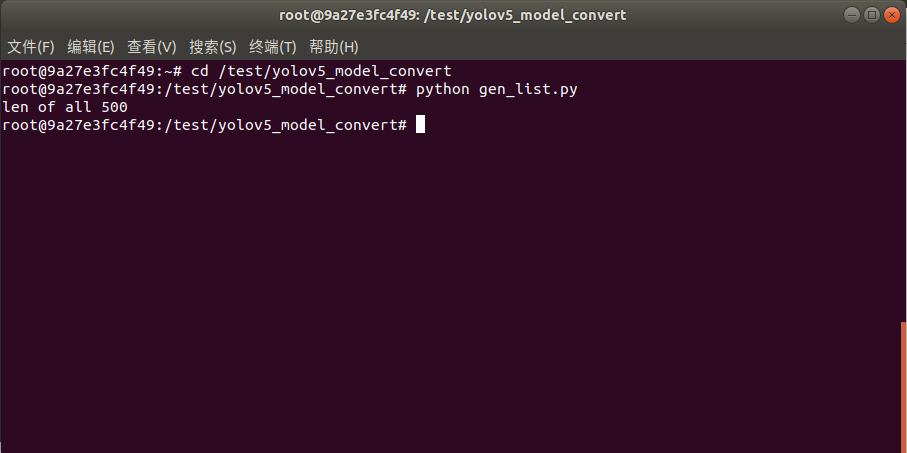

在docker環境切換到模型轉換工作目錄:

cd /test/yolov5_model_convert

如下圖所示:

執行gen_list.py生成量化圖片列表:

python gen_list.py

命令行現象如下圖所示:

生成“量化圖片列表”如下文件夾所示:

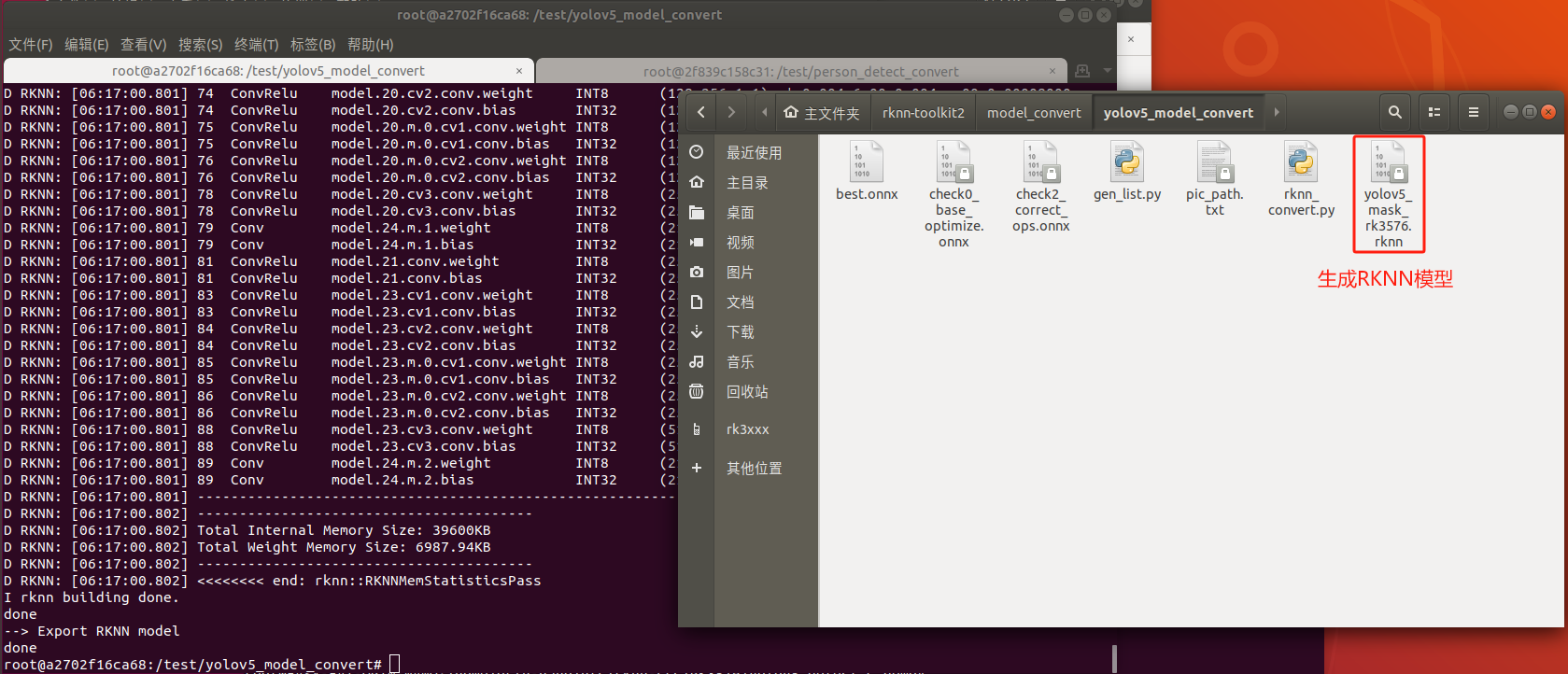

4.2.5 onnx模型轉換為rknn模型

rknn_convert.py腳本默認進行int8量化操作,腳本代碼清單如下所示:

import os import urllib import traceback import time import sys import numpy as np import cv2 from rknn.api import RKNN ONNX_MODEL = 'best.onnx' RKNN_MODEL = './bsd_person.rknn' DATASET = './pic_path.txt' QUANTIZE_ON = True if __name__ == '__main__': # Create RKNN object rknn = RKNN(verbose=True) if not os.path.exists(ONNX_MODEL): print('model not exist') exit(-1) # pre-process config print('--> Config model') rknn.config(reorder_channel='0 1 2', mean_values=[[0, 0, 0]], std_values=[[255, 255, 255]], optimization_level=3, target_platform = 'rv1126', output_optimize=1, quantize_input_node=QUANTIZE_ON) print('done') # Load ONNX model print('--> Loading model') ret = rknn.load_onnx(model=ONNX_MODEL) if ret != 0: print('Load yolov5 failed!') exit(ret) print('done') # Build model print('--> Building model') ret = rknn.build(pre_compile=True,do_quantization=QUANTIZE_ON, dataset=DATASET) if ret != 0: print('Build yolov5 failed!') exit(ret) print('done') # Export RKNN model print('--> Export RKNN model') ret = rknn.export_rknn(RKNN_MODEL) if ret != 0: print('Export yolov5rknn failed!') exit(ret) print('done')

把onnx模型best.onnx放到yolov5_model_convert目錄,并執行rknn_convert.py腳本進行模型轉換:

python rknn_convert.py

生成模型如下圖所示,此模型可以在rknn環境和EASY EAI Orin nano環境運行:

5. 模型部署示例

5.1 模型部署示例介紹

本小節展示yolov5模型的在EASY EAI Orin nano的部署過程,該模型僅經過簡單訓練供示例使用,不保證模型精度。

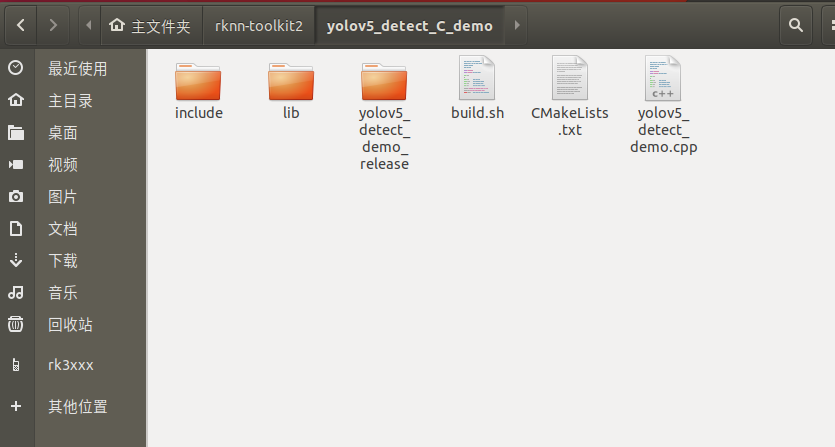

5.2 源碼下載以及例程編譯

下載yolov5 C Demo示例文件。

百度網盤鏈接: (https://pan.baidu.com/s/1adoQOIsm1C5GIxeh0UnK5g?pwd=1234提取碼:1234)。

下載程序包移至ubuntu環境后,執行以下指令解壓:

tar -xvf yolov5_detect_C_demo.tar.bz2

下載解壓后如下圖所示:

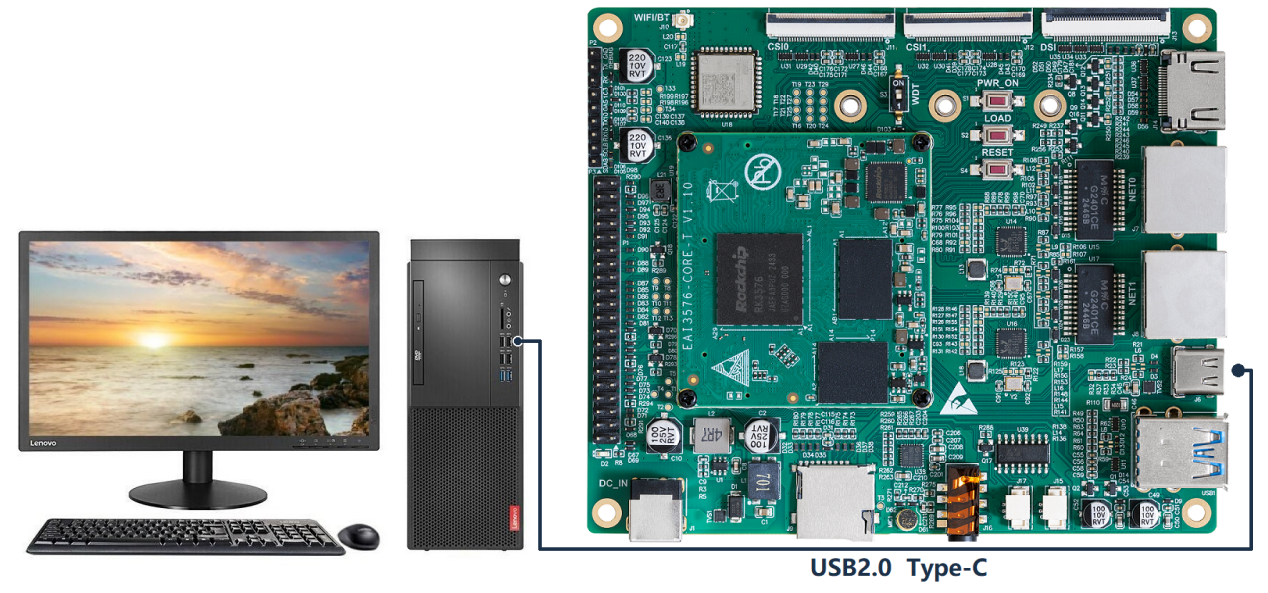

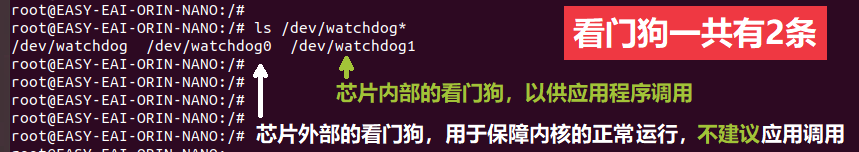

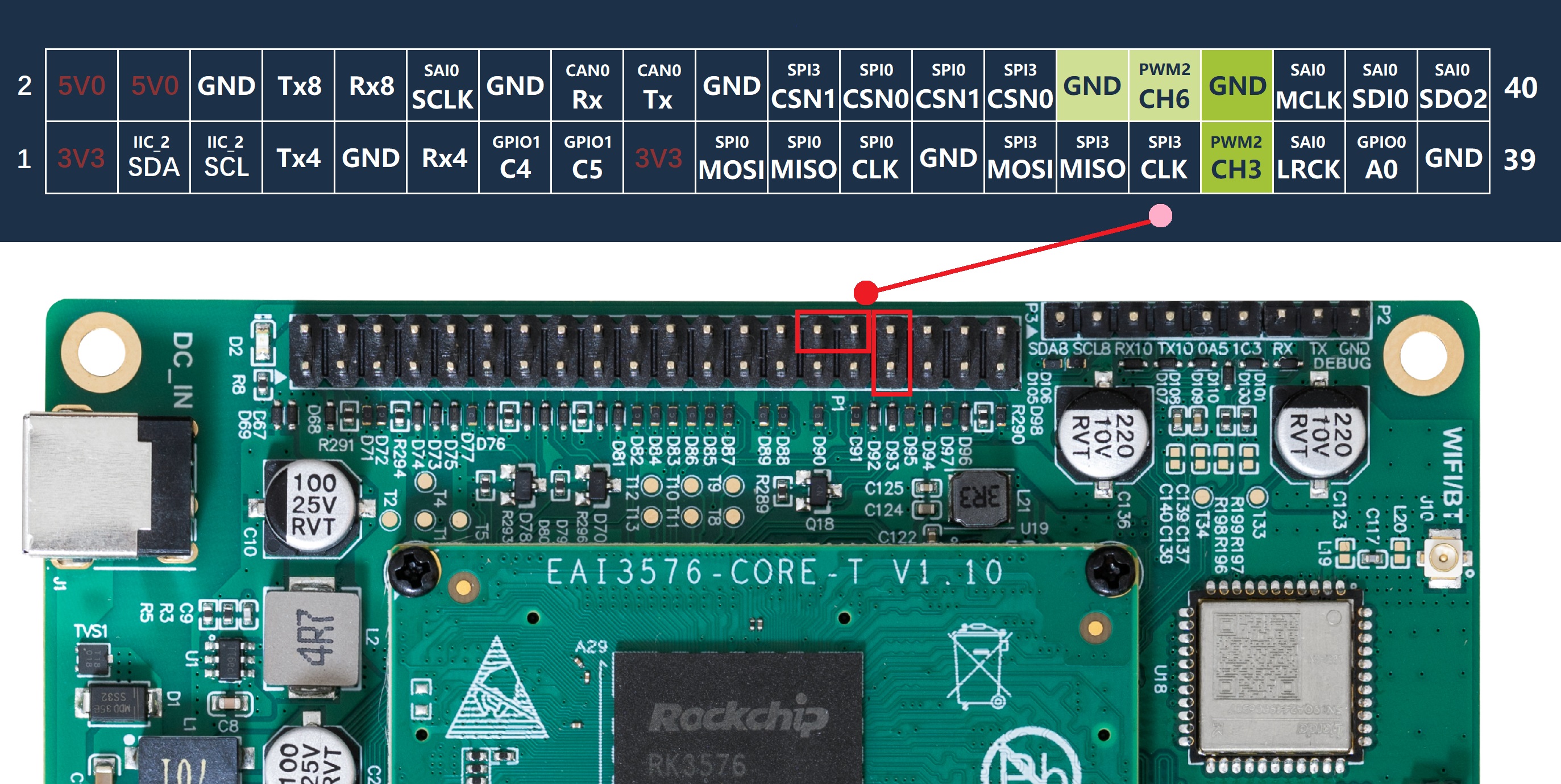

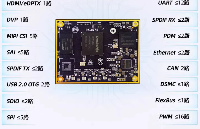

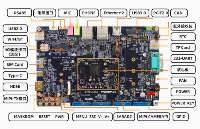

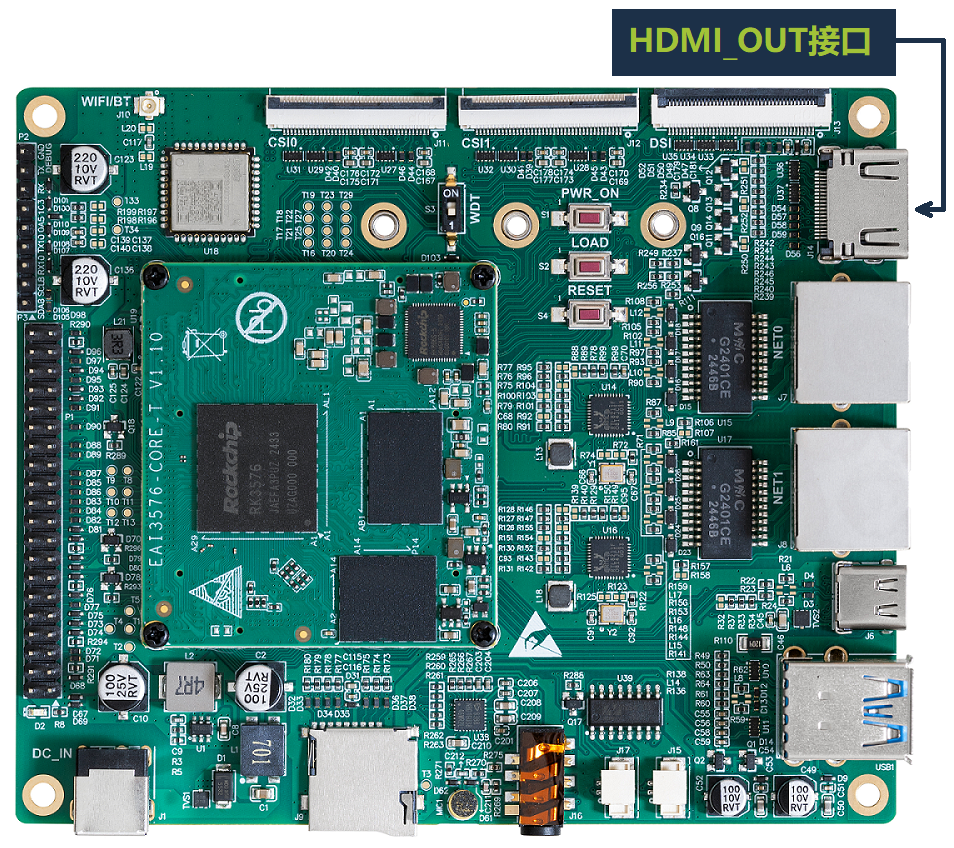

通過adb接口連接EASY-EAI-Orin-nano,,連接方式如下圖所示:

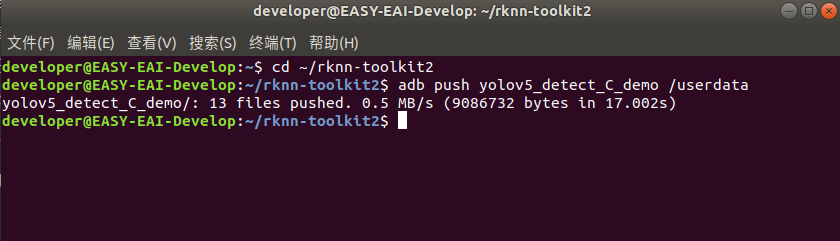

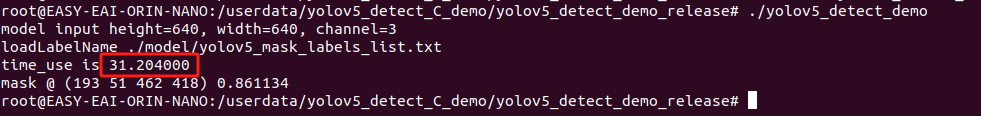

接下來需要通過adb把源碼傳輸到板卡上,先切換目錄然后執行以下指令:

cd ~/rknn-toolkit2 adb push yolov5_detect_C_demo /userdata

登錄到板子切換到例程目錄執行編譯操作:

adb shell cd /userdata/yolov5_detect_C_demo chmod 777 build.sh ./build.sh

5.3 在開發板執行yolov5 目標檢測算法

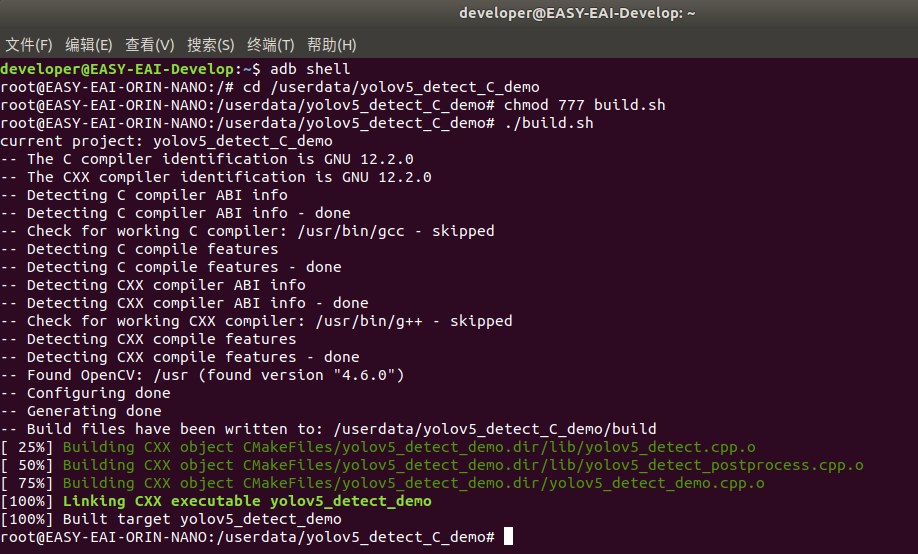

編譯成功后切換到可執行程序目錄,如下所示:

cd /userdata/yolov5_detect_C_demo/yolov5_detect_demo_release

運行例程命令如下所示:

chmod 777 yolov5_detect_demo ./yolov5_detect_demo

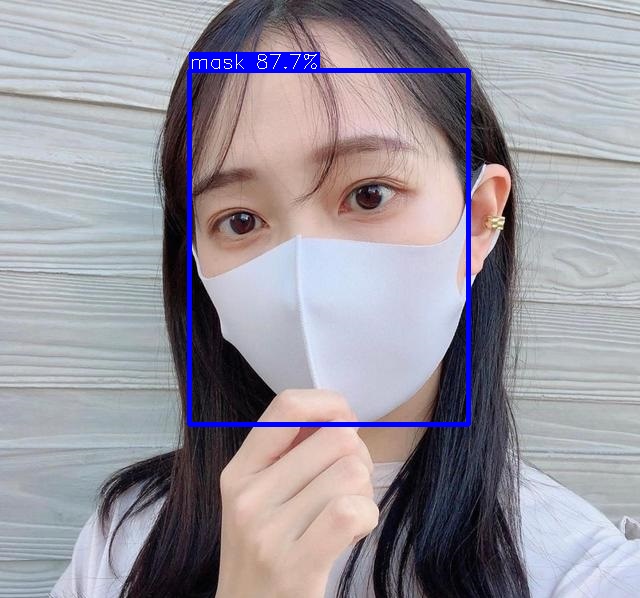

執行結果如下圖所示,算法執行時間為31ms:

退出板卡環境,取回測試圖片:

exit adb pull /userdata/yolov5_detect_C_demo/yolov5_detect_demo_release/result.jpg .

測試結果如下圖所示:

至此,yolov5目標檢測例程已成功在板卡運行。

6. 資料下載

| 資料名稱 | 鏈接 |

| 訓練代碼github | https://github.com/EASY-EAI/yolov5 |

| 算法教程完整源碼包 |

https://pan.baidu.com/s/1wlD6z7G9puELd0zgRC3BjA?pwd=1234 提取碼:1234 |

審核編輯 黃宇

-

開發板

+關注

關注

25文章

5679瀏覽量

104632 -

rk3576

+關注

關注

1文章

173瀏覽量

719

發布評論請先 登錄

【米爾RK3576開發板評測】+項目名稱YOLOV5目標檢測

RK3576 yolov11-seg訓練部署教程

基于RK3576開發板的MIPI-DSI使用

基于RK3576開發板的yolov5訓練部署教程

基于RK3576開發板的yolov5訓練部署教程

評論