當(dāng)前基于神經(jīng)輻射場(chǎng)(NeRF)或3D高斯?jié)姙R(3DGS)的SLAM方法在重建靜態(tài)3D場(chǎng)景方面表現(xiàn)出色,但在動(dòng)態(tài)環(huán)境中的跟蹤和重建方面卻面臨著挑戰(zhàn)。現(xiàn)有的基于NeRF的SLAM方法解決動(dòng)態(tài)問(wèn)題通常依賴(lài)于RGB-D輸入,而很少有方法能適應(yīng)純RGB輸入。為了克服這些局限性,我們提出了Dy3DGS-SLAM,這是首個(gè)使用單目RGB輸入的針對(duì)動(dòng)態(tài)場(chǎng)景的3D高斯?jié)姙R(3DGS)SLAM方法。實(shí)驗(yàn)結(jié)果證明,Dy3DGS-SLAM在動(dòng)態(tài)環(huán)境中實(shí)現(xiàn)了最先進(jìn)的跟蹤和渲染效果,優(yōu)于或達(dá)到了現(xiàn)有的RGB-D方法的水平。

? 文章:

Dy3DGS-SLAM: Monocular 3D Gaussian Splatting SLAM for Dynamic Environments

? 作者:

Mingrui Li, Yiming Zhou, Hongxing Zhou, Xinggang Hu, Florian Roemer, Hongyu Wang, Ahmad Osman

? 論文鏈接:

https://arxiv.org/abs/2506.05965

? 編譯:

INDEMIND

01 本文核心內(nèi)容

近期,基于NeRF或3DGS的密集SLAM系統(tǒng)引起了廣泛關(guān)注。這些系統(tǒng)在靜態(tài)場(chǎng)景中實(shí)現(xiàn)了逼真的渲染效果,并逐漸向大規(guī)模或更具挑戰(zhàn)性的場(chǎng)景拓展。然而,由于現(xiàn)實(shí)世界中存在大量動(dòng)態(tài)物體,這類(lèi)SLAM系統(tǒng)在應(yīng)對(duì)這一挑戰(zhàn)時(shí)卻表現(xiàn)不佳。另一個(gè)受到關(guān)注的問(wèn)題是如何在不依賴(lài)RGB-D傳感器,僅使用單目RGB輸入的情況下取得更好的效果,該類(lèi)傳感器更易獲取,且具有更大的潛力。

盡管一些基于NeRF的方法,如DN-SLAM、DDNSLAM、NID-SLAM和RoDyn-SLAM已嘗試解決動(dòng)態(tài)物體的問(wèn)題,但它們往往依賴(lài)于預(yù)定義的動(dòng)態(tài)先驗(yàn)或嚴(yán)重依賴(lài)深度先驗(yàn)來(lái)確定動(dòng)態(tài)物體掩碼,這使得它們?cè)趦H有單目RGB輸入的環(huán)境中難以適用。

此外,由于NeRF表示的局限性,渲染精度受到限制,常常導(dǎo)致嚴(yán)重的渲染偽影。基于3DGS的諸如SplaTAM、Photo-SLAM和MonoGS等SLAM系統(tǒng)在靜態(tài)環(huán)境中表現(xiàn)良好,但在動(dòng)態(tài)場(chǎng)景中往往會(huì)遇到跟蹤失敗和建圖錯(cuò)誤的問(wèn)題。因此,我們提出了Dy3DGS-SLAM,這是首個(gè)專(zhuān)為動(dòng)態(tài)環(huán)境設(shè)計(jì)的僅使用RGB的3DGS-SLAM系統(tǒng)。我們利用光流來(lái)獲取動(dòng)態(tài)掩碼,無(wú)需依賴(lài)預(yù)定義的移動(dòng)對(duì)象,盡管這些掩碼在紋理均勻或快速運(yùn)動(dòng)的區(qū)域可能會(huì)有噪聲。為了解決這個(gè)問(wèn)題,我們引入了單目深度估計(jì),提供互補(bǔ)的空間線(xiàn)索,特別是在處理遮擋和深度不連續(xù)性時(shí)。然后,我們提出了一種深度正則化的掩碼融合策略,結(jié)合了這兩種模態(tài)的優(yōu)勢(shì),減輕了各自的局限性,生成了更精確、更穩(wěn)健的動(dòng)態(tài)掩碼。

在跟蹤方面,我們將估計(jì)的深度和融合后的掩碼納入運(yùn)動(dòng)損失中,有效地在位姿估計(jì)網(wǎng)絡(luò)中恢復(fù)尺度和位姿,從而獲得更準(zhǔn)確的跟蹤結(jié)果。在渲染方面,為了解決瞬態(tài)干擾和遮擋問(wèn)題,我們根據(jù)動(dòng)態(tài)像素的顏色和深度對(duì)動(dòng)態(tài)高斯分布進(jìn)行懲罰。與基準(zhǔn)方法相比,我們的方法顯著減少了渲染偽影,并極大地提高了幾何精度。

本文的貢獻(xiàn)可概括為:

?提出了Dy3DGS-SLAM,這是首個(gè)僅基于RGB的適用于動(dòng)態(tài)環(huán)境的3DGS-SLAM系統(tǒng),能夠在動(dòng)態(tài)環(huán)境中實(shí)現(xiàn)穩(wěn)健的跟蹤和高保真度的重建。

? 提出了一種掩碼融合方法,通過(guò)結(jié)合光流的運(yùn)動(dòng)線(xiàn)索和深度估計(jì)的幾何一致性,能夠準(zhǔn)確地覆蓋動(dòng)態(tài)對(duì)象。基于融合后的掩碼,我們引入了新穎的運(yùn)動(dòng)和渲染損失,以有效減輕動(dòng)態(tài)對(duì)象在跟蹤和渲染中的干擾。

? 在三個(gè)真實(shí)數(shù)據(jù)集上的實(shí)驗(yàn)結(jié)果表明,與基準(zhǔn)方法相比,我們的方法在跟蹤和渲染性能方面表現(xiàn)更優(yōu)。

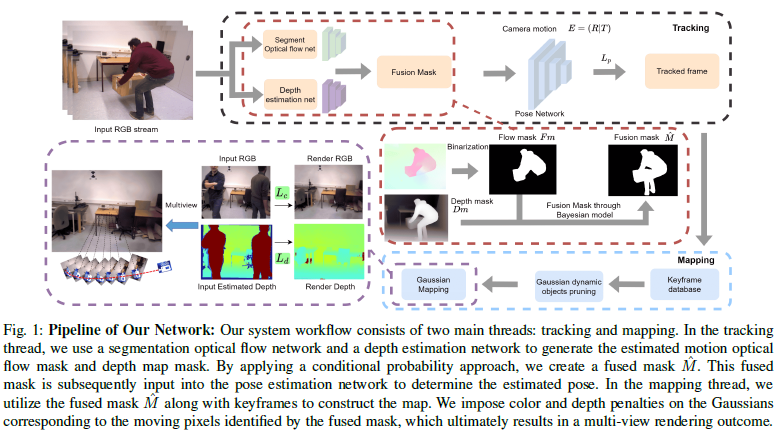

02 方法架構(gòu)

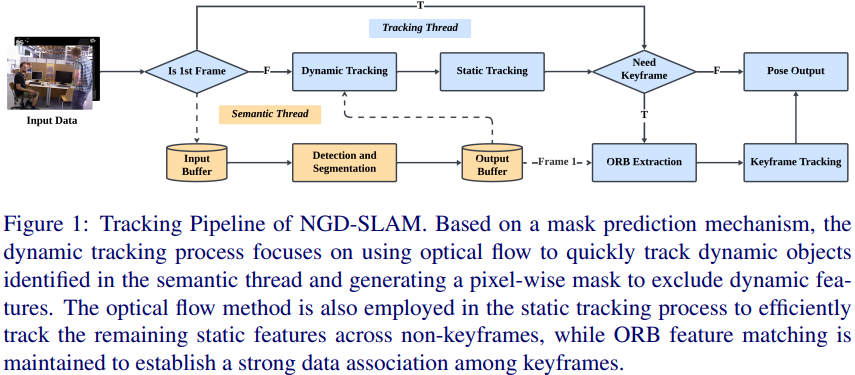

我們的系統(tǒng)流程如圖1所示。我們解決了將從光流獲得的動(dòng)態(tài)掩碼與從單目輸入估計(jì)的深度圖融合的問(wèn)題,從而得到精確的動(dòng)態(tài)融合掩碼。我們提出了運(yùn)動(dòng)估計(jì)網(wǎng)絡(luò),并引入了結(jié)合深度估計(jì)的運(yùn)動(dòng)損失,使網(wǎng)絡(luò)能夠迭代地優(yōu)化精確的相機(jī)位姿。我們對(duì)被標(biāo)記為動(dòng)態(tài)的像素對(duì)應(yīng)的高斯分布進(jìn)行懲罰,并基于單目深度應(yīng)用額外的渲染損失,以?xún)?yōu)化場(chǎng)景細(xì)節(jié)。最后,我們利用多視圖一致性合成靜態(tài)場(chǎng)景。

03 實(shí)驗(yàn)結(jié)果

A.實(shí)驗(yàn)細(xì)節(jié)與指標(biāo)

數(shù)據(jù)集和實(shí)現(xiàn)細(xì)節(jié)

我們?cè)谌齻€(gè)來(lái)自真實(shí)世界的公開(kāi)數(shù)據(jù)集上進(jìn)行了評(píng)估:TUMRGB-D、AirDOS-Shibuya和BONNRGB-D,這些數(shù)據(jù)集均捕捉了真實(shí)的室內(nèi)環(huán)境。

我們?cè)谝慌_(tái)配備單個(gè)RTX3090TiGPU的臺(tái)式機(jī)上進(jìn)行了SLAM實(shí)驗(yàn)。我們展示了針對(duì)實(shí)時(shí)應(yīng)用設(shè)計(jì)的多進(jìn)程實(shí)現(xiàn)的結(jié)果。與3DGS框架一致,時(shí)間關(guān)鍵的光柵化和梯度計(jì)算均使用CUDA實(shí)現(xiàn)。

指標(biāo)和基線(xiàn)方法

為評(píng)估相機(jī)跟蹤精度,我們報(bào)告關(guān)鍵幀絕對(duì)軌跡誤差(ATE)的均方根誤差(RMSE)。對(duì)于運(yùn)行時(shí)性能和網(wǎng)絡(luò)迭代速度,我們分別測(cè)量每秒幀數(shù)(FPS)和毫秒(ms)。GPU使用情況以兆字節(jié)(MB)為單位進(jìn)行評(píng)估。我們將我們的Dy3DGS-SLAM方法與傳統(tǒng)動(dòng)態(tài)SLAM方法(如ORB-SLAM3、Droid-SLAM、DynaSLAM、DytanVO和ReFusion以及基于 NeRF 的最新 RGB-D 傳感器方法(包括 NICE-SLAM、ESLAM、Co-SLAM和NID-SLAM)進(jìn)行比較。此外,我們還考慮了基于3DGS的SplaTAM。

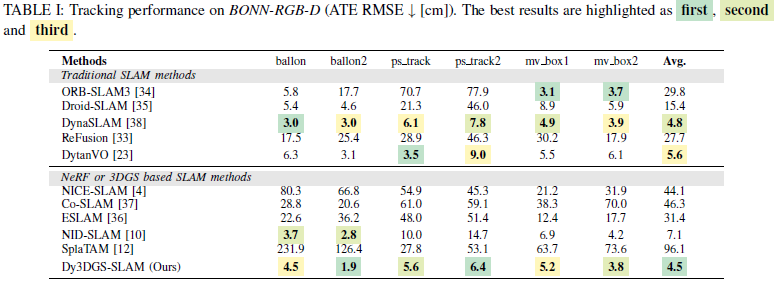

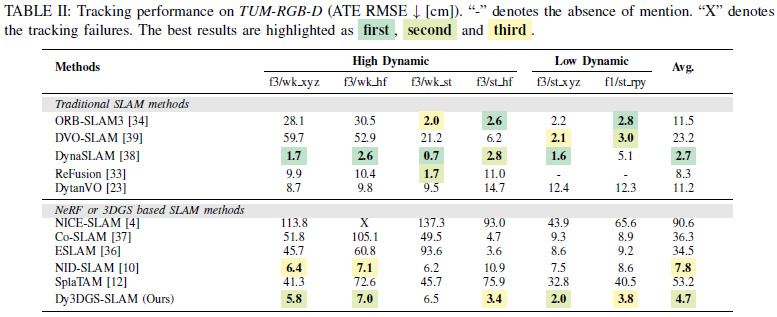

B.在TUM和BonnRGB-D上的跟蹤評(píng)估。

跟蹤

如表II所示,我們展示了來(lái)自TUM數(shù)據(jù)集的三個(gè)高度動(dòng)態(tài)序列、一個(gè)輕度動(dòng)態(tài)序列和兩個(gè)靜態(tài)序列的結(jié)果。

得益于我們提出的動(dòng)態(tài)掩碼融合方法,我們的系統(tǒng)在跟蹤性能方面優(yōu)于基于RGB-D的方法,甚至可與傳統(tǒng)的SLAM方法相媲美。此外,我們?cè)诟鼜?fù)雜且更具挑戰(zhàn)性的BONN數(shù)據(jù)集上評(píng)估了跟蹤性能,如表I所示。即使在這些更復(fù)雜和大規(guī)模的場(chǎng)景中,我們的方法也取得了卓越的性能。我們的方法優(yōu)于所有其他方法,NID-SLAM是唯一一個(gè)結(jié)果接近我們的方法。此外,我們的方法在性能上優(yōu)于傳統(tǒng)方法。這表明我們的動(dòng)態(tài)掩碼融合能夠有效地去除動(dòng)態(tài)物體并增強(qiáng)跟蹤過(guò)程。

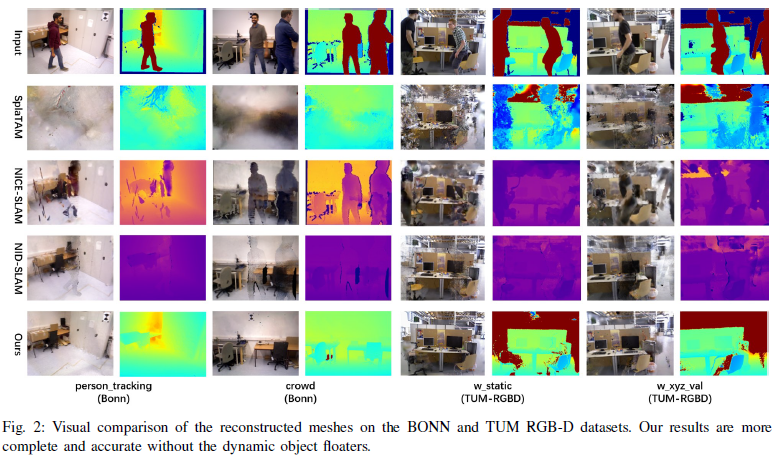

建圖

為了全面評(píng)估我們所提出系統(tǒng)在動(dòng)態(tài)場(chǎng)景中的性能,我們分析了從定性角度來(lái)看結(jié)果。我們將渲染的圖像與從生成的高斯圖中獲得的真實(shí)姿態(tài)進(jìn)行比較,使用與其他方法相同的視角。選擇了四個(gè)具有挑戰(zhàn)性的序列:來(lái)自波恩數(shù)據(jù)集的人群和人員跟蹤,以及來(lái)自TUMRGBD數(shù)據(jù)集的f3walkxyzval和f3walkstatic。如圖2所示,我們的方法在幾何和紋理細(xì)節(jié)方面顯示出顯著優(yōu)勢(shì),尤其是在減少偽影方面。值得注意的是,我們的方法基于單目系統(tǒng),并已在兩個(gè)真實(shí)世界數(shù)據(jù)集上得到驗(yàn)證,證明了僅使用簡(jiǎn)單相機(jī)即可準(zhǔn)確記錄動(dòng)態(tài)場(chǎng)景的能力。這突顯了我們的方法在有效追蹤和重建室內(nèi)環(huán)境方面的潛力,使其成為深度傳感器不可用的應(yīng)用場(chǎng)景中的寶貴工具。

04 總結(jié)

我們提出了Dy3DGS-SLAM,這是首個(gè)基于3DGS的單目RGB輸入的動(dòng)態(tài)場(chǎng)景SLAM方法。該方法首先通過(guò)光流估計(jì)生成動(dòng)態(tài)對(duì)象掩碼,將這些掩碼與單目深度估計(jì)相結(jié)合,創(chuàng)建融合掩碼并恢復(fù)尺度,從而準(zhǔn)確捕捉動(dòng)態(tài)對(duì)象掩碼。為了進(jìn)一步提高位姿精度,我們基于融合掩碼優(yōu)化了損失函數(shù),減少了多次迭代帶來(lái)的計(jì)算成本。此外,為了增強(qiáng)渲染性能,我們應(yīng)用了額外的光度和深度損失,以消除瞬態(tài)干擾偽影并提高幾何精度。實(shí)驗(yàn)結(jié)果表明,與基線(xiàn)方法相比,Dy3DGS-SLAM在動(dòng)態(tài)環(huán)境中實(shí)現(xiàn)了最先進(jìn)的跟蹤和渲染性能。

-

相機(jī)

+關(guān)注

關(guān)注

4文章

1442瀏覽量

54513 -

RGB

+關(guān)注

關(guān)注

4文章

804瀏覽量

59650 -

SLAM

+關(guān)注

關(guān)注

24文章

436瀏覽量

32355

原文標(biāo)題:Dy3DGS-SLAM:適用于動(dòng)態(tài)環(huán)境的3DGS-SLAM,僅需單目RGB

文章出處:【微信號(hào):gh_c87a2bc99401,微信公眾號(hào):INDEMIND】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

一種適用于模擬/數(shù)字混合信號(hào)環(huán)境的接地技術(shù)

一種適用于室內(nèi)復(fù)雜環(huán)境的高精度、環(huán)境自適應(yīng)性強(qiáng)的定位算法

一種適用于嵌入式系統(tǒng)的模塊動(dòng)態(tài)加載技術(shù)

一種適用于醫(yī)學(xué)領(lǐng)域的頻率可調(diào)濾波器

一種特別適用于片上LDO系統(tǒng)的過(guò)流保護(hù)電路

一種適用于任意余數(shù)基的高性能后向轉(zhuǎn)換結(jié)構(gòu)_楊鵬

一種適用于SoC的瞬態(tài)增強(qiáng)型線(xiàn)性穩(wěn)壓器_張琪

一種適用于鋼管廠(chǎng)的自動(dòng)稱(chēng)重及重量分?jǐn)?b class='flag-5'>系統(tǒng)_郭雅默

基于一種適用于惡劣安裝環(huán)境的MS6000水情監(jiān)測(cè)系統(tǒng)介紹

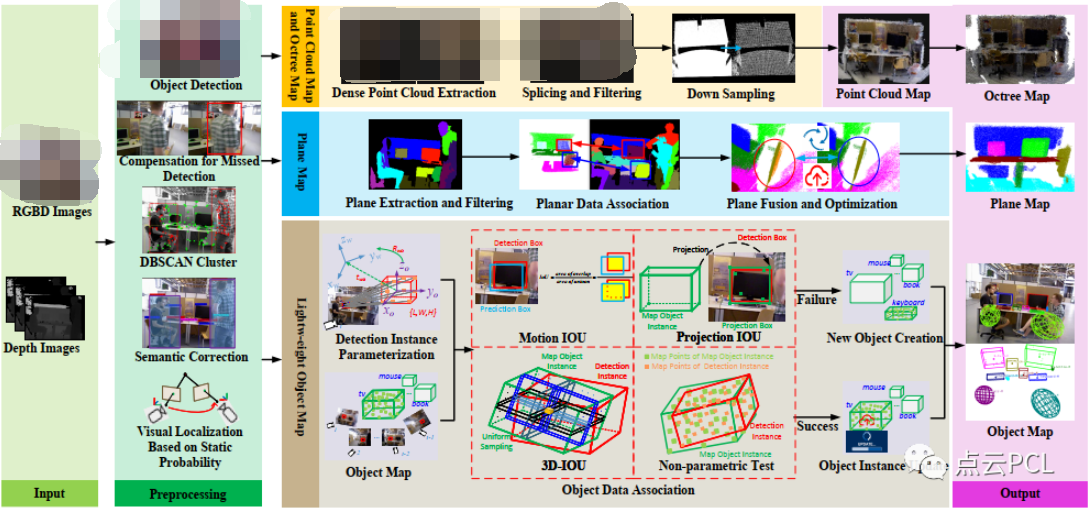

一種適用于動(dòng)態(tài)場(chǎng)景的SLAM方法

一種基于直接法的動(dòng)態(tài)稠密SLAM方案

一種適用于動(dòng)態(tài)場(chǎng)景的多層次地圖構(gòu)建算法

一種適用于動(dòng)態(tài)環(huán)境的實(shí)時(shí)視覺(jué)SLAM系統(tǒng)

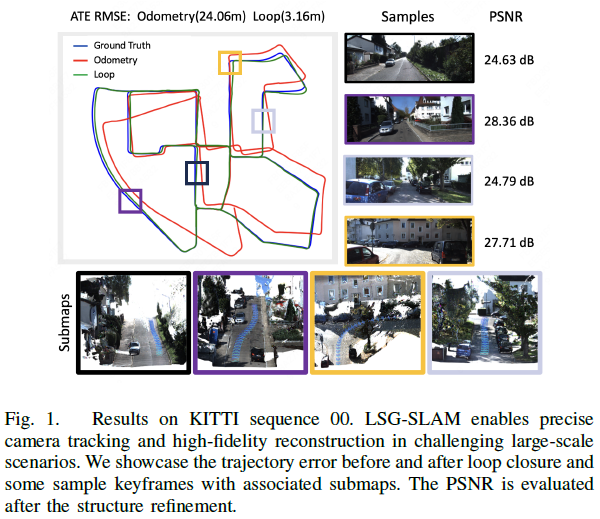

三維高斯?jié)姙R大規(guī)模視覺(jué)SLAM系統(tǒng)解析

一種適用于動(dòng)態(tài)環(huán)境的3DGS-SLAM系統(tǒng)

一種適用于動(dòng)態(tài)環(huán)境的3DGS-SLAM系統(tǒng)

評(píng)論