編者按:深度卷積神經(jīng)網(wǎng)絡(luò)對(duì)視覺(jué)系統(tǒng)來(lái)說(shuō)是個(gè)不錯(cuò)的模型,但這些靜態(tài)系統(tǒng)不能解釋現(xiàn)實(shí)視覺(jué)反應(yīng)中的短暫動(dòng)態(tài)行為。于是神經(jīng)科學(xué)家們建造了一個(gè)基于任務(wù)的深度循環(huán)網(wǎng)絡(luò),加入循環(huán)單元可以解決更困難的視覺(jué)問(wèn)題。以下是論智的編譯。

摘要

前饋卷積神經(jīng)網(wǎng)絡(luò)(CNN)是目前最先進(jìn)的目標(biāo)分類(lèi)任務(wù)工具,例如ImageNet。另外,他們是靈長(zhǎng)類(lèi)動(dòng)物大腦中視覺(jué)系統(tǒng)中精準(zhǔn)定量平均響應(yīng)時(shí)間的模型。然而,生物視覺(jué)系統(tǒng)的兩種普遍存在的結(jié)構(gòu)特征是典型CNN不具備的,即皮質(zhì)區(qū)域內(nèi)的局部循環(huán),以及下游區(qū)域到上游區(qū)域的遠(yuǎn)距離反饋。在這篇文章中,我們研究了循環(huán)結(jié)構(gòu)在提高分類(lèi)性能時(shí)的作用,我們發(fā)現(xiàn),在ImageNet任務(wù)中,標(biāo)準(zhǔn)的循環(huán)形式(vanilla RNN和LSTM)無(wú)法在深度CNN中達(dá)到良好表現(xiàn)。相反,能將兩種結(jié)構(gòu)特征——bypassing和gating——結(jié)合起來(lái)的結(jié)構(gòu)能將任務(wù)精確度極大地提升。

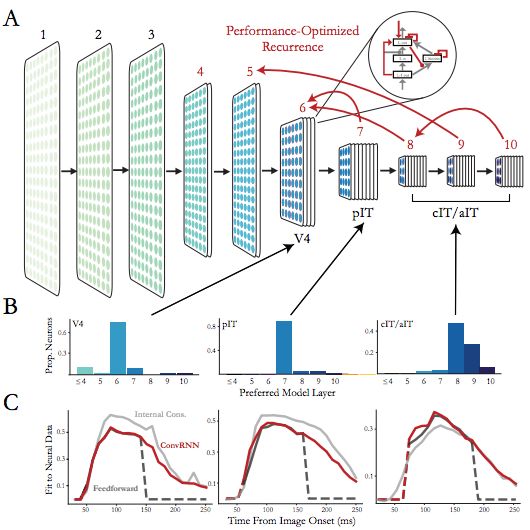

我們將這些設(shè)計(jì)原則應(yīng)用在數(shù)千個(gè)模型中的自動(dòng)搜索上,它們確定了局部循環(huán)單元和遠(yuǎn)距離反饋連接對(duì)目標(biāo)辨認(rèn)很有用。另外,這些經(jīng)過(guò)任務(wù)優(yōu)化的卷積RNN能比反饋網(wǎng)絡(luò)更好地解釋靈長(zhǎng)類(lèi)動(dòng)物神經(jīng)系統(tǒng)中神經(jīng)元的活動(dòng),說(shuō)明大腦的循環(huán)連接在執(zhí)行不同的視覺(jué)動(dòng)作時(shí)非常重要。

背景介紹

大腦的傳感器系統(tǒng)必須在含有噪音的復(fù)雜感知數(shù)據(jù)中檢測(cè)出有意義的模式。視覺(jué)環(huán)境可以揭示物體正面或負(fù)面的價(jià)值,例如食物種類(lèi)、危險(xiǎn)的信號(hào)或難忘的人。然而這些信號(hào)在不同場(chǎng)景中的位置、姿勢(shì)、背景和前景都相差很大,所以從低屬性圖像中很難辨別出目標(biāo)物體。

最近的研究表明,針對(duì)任務(wù)優(yōu)化的深度卷積神經(jīng)網(wǎng)絡(luò)(CNN)是靈長(zhǎng)類(lèi)動(dòng)物大腦的視覺(jué)編碼精確的量化模型。CNN經(jīng)過(guò)訓(xùn)練,可以識(shí)別ImageNet中的物體,并且能比其他模型更好地解釋視覺(jué)系統(tǒng)中的神經(jīng)元反饋。模型的各個(gè)卷積層分辨提供不同視覺(jué)區(qū)域的線性預(yù)測(cè)。

但是,靈長(zhǎng)動(dòng)物的視覺(jué)系統(tǒng)有些結(jié)構(gòu)并沒(méi)有被前饋CNN完全模仿,即皮質(zhì)區(qū)域的局部循環(huán)連接和不同區(qū)域的遠(yuǎn)距離連接。目前還不清楚循環(huán)的作用,有科學(xué)家猜想循環(huán)是用來(lái)填補(bǔ)缺失的數(shù)據(jù),或進(jìn)行從上到下基于注意力的特征調(diào)整。

雖然經(jīng)過(guò)增強(qiáng)的有循環(huán)結(jié)構(gòu)的CNN可以用來(lái)解決相對(duì)簡(jiǎn)單的遮擋或預(yù)測(cè)任務(wù),但這些模型既不能適應(yīng)復(fù)雜的任務(wù)(前饋CNN可以解決),也不能解釋神經(jīng)反饋。事實(shí)上,由于目標(biāo)識(shí)別的復(fù)雜性和多樣性,ImageNet中的很多圖片質(zhì)量都參差不齊,所以有可能要用到上述的循環(huán)處理機(jī)制。而且最近很多對(duì)ImageNet高效的解決方法都提出在多個(gè)圖層之中用同樣的結(jié)構(gòu)基序。于是我們選擇研究循環(huán)結(jié)構(gòu)究竟能否提高模型在ImageNet數(shù)據(jù)集上的分類(lèi)表現(xiàn)。雖然其他工作用CNN的輸出最為RNN的輸入解決視覺(jué)任務(wù),在這里我們將循環(huán)結(jié)構(gòu)和CNN本身結(jié)合,因?yàn)檫@類(lèi)結(jié)構(gòu)在神經(jīng)科學(xué)中是非常常見(jiàn)的。

模型結(jié)構(gòu)

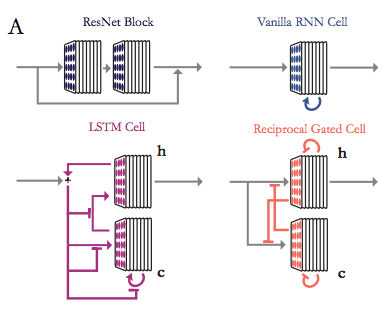

為了研究卷積RNN的空間結(jié)構(gòu),我們用TensorFlow庫(kù)增強(qiáng)標(biāo)準(zhǔn)的、有局部和遠(yuǎn)距離循環(huán)結(jié)構(gòu)的CNN,如圖所示:

卷積循環(huán)網(wǎng)絡(luò)中含有局部循環(huán)和遠(yuǎn)程前饋連接的結(jié)合

在卷積RNN的每個(gè)圖層中,來(lái)自較高層的前饋輸入被重新修改尺寸,以匹配前饋輸入的空間維度。兩種類(lèi)型的輸入都由標(biāo)準(zhǔn)的2D卷積處理。如果該層有任何局部循環(huán),則輸出會(huì)輸入到下一個(gè)循環(huán)單元。

在這項(xiàng)工作中,所有形式的循環(huán)都向前饋基礎(chǔ)模型中添加了參數(shù)。由于這樣可以提升模型的性能,我們訓(xùn)練了兩種與卷積RNN相對(duì)照的模型:

有更多卷積過(guò)濾層的前饋模型(更寬)或者更多層的模型(更深),以匹配循環(huán)模型中參數(shù)的數(shù)量;

將卷積模型展開(kāi)后進(jìn)行復(fù)制,其中的參數(shù)數(shù)量和原始的卷積RNN一樣。

實(shí)驗(yàn)結(jié)果

新型RNN結(jié)構(gòu)提高了任務(wù)處理性能

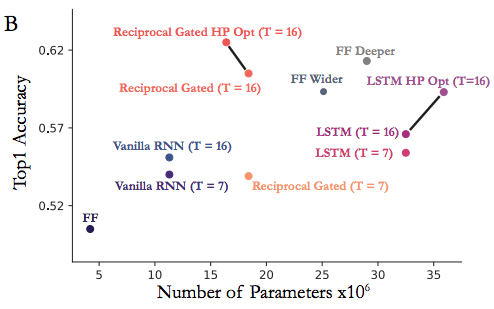

我們首先測(cè)試了有著標(biāo)準(zhǔn)RNN單位的增強(qiáng)CNN(例如vanilla RNN和LSTM)能夠提高在ImageNet目標(biāo)物體辨認(rèn)上的表現(xiàn)。二者對(duì)比如圖所示:

結(jié)果發(fā)現(xiàn)在類(lèi)似AlexNet這樣的六層前饋上,精確度稍有提升。

但這里的循環(huán)結(jié)構(gòu)存在兩個(gè)問(wèn)題,首先,由于單一參數(shù)數(shù)量的增多,這些卷積RNN并沒(méi)有檢測(cè)性能提升了多少。其次,將前饋模型做得更寬或更深,比單純地增加標(biāo)準(zhǔn)RNN單元性能提升得更多,參數(shù)卻更少。這說(shuō)明標(biāo)準(zhǔn)RNN結(jié)構(gòu)雖然適用于很多種任務(wù),但是不適合深度CNN中的任務(wù)。

我們研究后發(fā)現(xiàn)這是因?yàn)闃?biāo)準(zhǔn)RNN中缺少兩種關(guān)鍵屬性:

Gating,即隱藏狀態(tài)的值決定下一步的輸入有多少能通過(guò)、保留或丟棄;

Bypassing,即一個(gè)零初始化的隱藏狀態(tài)允許前饋輸入通過(guò)下一層。

重要的是,這兩種特征都是為了解決梯度消失的問(wèn)題。于是我們將兩種特征部署到循環(huán)結(jié)構(gòu)中。具體結(jié)果如圖:

之后經(jīng)過(guò)對(duì)更深的循環(huán)結(jié)構(gòu)進(jìn)行超參數(shù)優(yōu)化后,我們用卷積RNN模擬了靈長(zhǎng)類(lèi)動(dòng)物腹流(參與物體識(shí)別)神經(jīng)。

結(jié)語(yǔ)

實(shí)際上,這篇論文詳細(xì)介紹了CNN中的循環(huán)單元能在目標(biāo)識(shí)別中有效提高性能,我們的發(fā)現(xiàn)能提高不同的局部循環(huán)結(jié)構(gòu)對(duì)應(yīng)大腦中不同的行為的概率。我們相信通過(guò)將該方法應(yīng)用到CNN上,我們能提高現(xiàn)有的很多方法的性能。未來(lái)的實(shí)驗(yàn)將探尋不同的任務(wù)是否能在卷積RNN對(duì)神經(jīng)的反饋上取代監(jiān)督目標(biāo)辨別。另外還將測(cè)試模型能否低于其他形式的噪聲。

-

傳感器

+關(guān)注

關(guān)注

2564文章

52700瀏覽量

764578 -

神經(jīng)網(wǎng)絡(luò)

+關(guān)注

關(guān)注

42文章

4811瀏覽量

103002 -

視覺(jué)系統(tǒng)

+關(guān)注

關(guān)注

3文章

345瀏覽量

31193

原文標(biāo)題:任務(wù)導(dǎo)向的視覺(jué)系統(tǒng)卷積循環(huán)模型

文章出處:【微信號(hào):jqr_AI,微信公眾號(hào):論智】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

什么是RNN (循環(huán)神經(jīng)網(wǎng)絡(luò))?

利用深度循環(huán)神經(jīng)網(wǎng)絡(luò)對(duì)心電圖降噪

結(jié)合小波變換的LSTM循環(huán)神經(jīng)網(wǎng)絡(luò)的稅收預(yù)測(cè)

一種門(mén)控循環(huán)單元興趣點(diǎn)推薦算法

PyTorch教程10.2之門(mén)控循環(huán)單元(GRU)

python最簡(jiǎn)單for循環(huán)例子

python如何一直循環(huán)一個(gè)代碼

循環(huán)指令loop規(guī)定循環(huán)次數(shù)

循環(huán)神經(jīng)網(wǎng)絡(luò)和遞歸神經(jīng)網(wǎng)絡(luò)的區(qū)別

循環(huán)神經(jīng)網(wǎng)絡(luò)和卷積神經(jīng)網(wǎng)絡(luò)的區(qū)別

循環(huán)神經(jīng)網(wǎng)絡(luò)的基本原理是什么

循環(huán)神經(jīng)網(wǎng)絡(luò)的基本概念

循環(huán)神經(jīng)網(wǎng)絡(luò)算法有哪幾種

循環(huán)神經(jīng)網(wǎng)絡(luò)算法原理及特點(diǎn)

技術(shù)干貨驛站 ▏深入理解C語(yǔ)言:嵌套循環(huán)與循環(huán)控制的底層原理

一個(gè)基于任務(wù)的深度循環(huán)網(wǎng)絡(luò),加入循環(huán)單元可以解決更困難的視覺(jué)問(wèn)題

一個(gè)基于任務(wù)的深度循環(huán)網(wǎng)絡(luò),加入循環(huán)單元可以解決更困難的視覺(jué)問(wèn)題

評(píng)論