統(tǒng)計學(xué)和機器學(xué)習(xí)的真正差別。統(tǒng)計學(xué)和機器學(xué)習(xí)在很多情況下是被混淆的,大部分人其實并不能很好的區(qū)分二者。介于此,本文詳解的講解了二者實際的差異,非常有指導(dǎo)意義。

很多人并不能很好的區(qū)分統(tǒng)計學(xué)和機器學(xué)習(xí),因為之間確實有太多的相同之處。目前流行的一種說法是,機器學(xué)習(xí)和統(tǒng)計學(xué)之間的主要區(qū)別在于它們的目的:機器學(xué)習(xí)模型旨在使最準(zhǔn)確的預(yù)測成為可能;統(tǒng)計模型被設(shè)計用于推斷變量之間的關(guān)系。

這種說法在技術(shù)上來說沒有問題,但它沒有給出特別明確或令人滿意的答案。說機器學(xué)習(xí)是關(guān)于準(zhǔn)確的預(yù)測,而統(tǒng)計模型設(shè)計用于推理幾乎是無意義的陳述,除非你精通這些概念。

因為統(tǒng)計數(shù)據(jù)和統(tǒng)計模型是不一樣的。統(tǒng)計學(xué)是數(shù)據(jù)的數(shù)學(xué)研究,沒有數(shù)據(jù)就無法進(jìn)行統(tǒng)計;統(tǒng)計模型是數(shù)據(jù)的模型,用于推斷數(shù)據(jù)中的關(guān)系或創(chuàng)建能夠預(yù)測未來值的模型。通常,這兩者是相輔相成的。

實際上,我們需要討論兩件事:首先,統(tǒng)計數(shù)據(jù)與機器學(xué)習(xí)有何不同?其次,統(tǒng)計模型與機器學(xué)習(xí)有何不同。所以今天,我們就來詳細(xì)解讀一下二者的區(qū)別。

統(tǒng)計學(xué)模型與機器學(xué)習(xí)在線性回歸上的差異

可能因為統(tǒng)計建模和機器學(xué)習(xí)中使用的方法的相似性,使人們認(rèn)為它們是同一個東西。可以理解,但根本不是這樣。

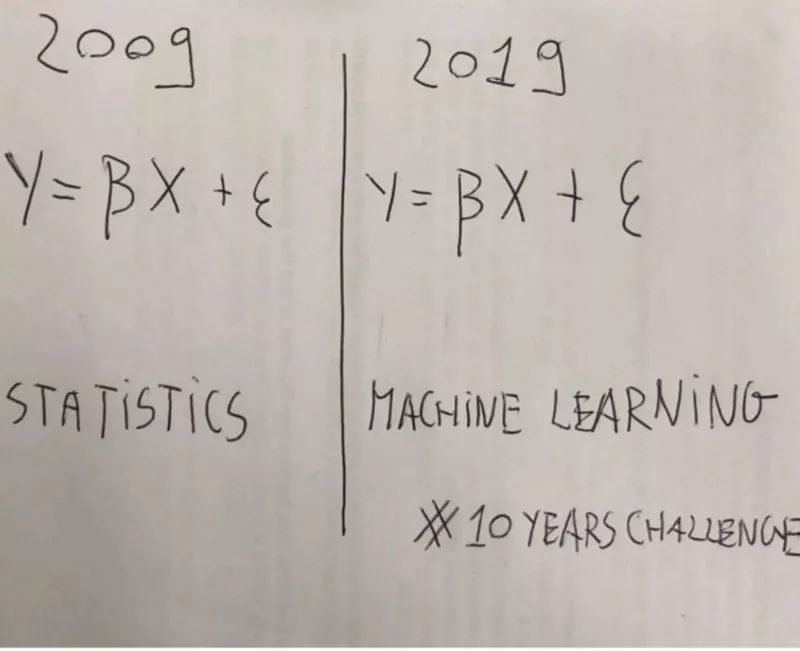

最明顯的例子是線性回歸,這可能是造成這種誤解的主要原因。線性回歸是一種統(tǒng)計方法,我們訓(xùn)練線性回歸量并獲得與統(tǒng)計回歸模型相同的結(jié)果,旨在最小化數(shù)據(jù)點之間的平方誤差。

在一個案例中,我們做了“訓(xùn)練”模型的事情,其中涉及使用數(shù)據(jù)的一個子集。我們不知道模型將如何執(zhí)行,直到在訓(xùn)練期間能夠“測試”出此數(shù)據(jù)不存在的、被稱為測試集的其他數(shù)據(jù)。在這種情況下,機器學(xué)習(xí)的目的是在測試集上獲得最佳性能。

對于統(tǒng)計模型,我們只要找出可以最小化所有數(shù)據(jù)的均方誤差(假設(shè)數(shù)據(jù)是一個線性回歸量,加上一些隨機噪聲,本質(zhì)上通常是高斯噪聲),無需訓(xùn)練,也無需測試。

一般來說,特別是在研究中(例如下面的傳感器示例),模型的要點是表征數(shù)據(jù)與結(jié)果變量之間的關(guān)系,而不是對未來數(shù)據(jù)進(jìn)行預(yù)測。我們將此過程稱為統(tǒng)計推斷,而不是預(yù)測。但我們?nèi)匀豢梢允褂么四P瓦M(jìn)行預(yù)測,但評估模型的方式不涉及測試集,而是涉及評估模型參數(shù)的重要性和穩(wěn)健性。

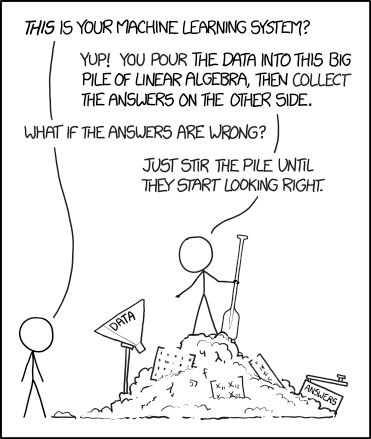

(受監(jiān)督的)機器學(xué)習(xí)的目的是獲得可以進(jìn)行可重復(fù)預(yù)測的模型。我們通常不關(guān)心模型是否可解釋,機器學(xué)習(xí)只看重結(jié)果。而統(tǒng)計建模更多的是發(fā)現(xiàn)變量之間的關(guān)系和這些關(guān)系的重要性,同時也適合預(yù)測。

舉例說明這兩個程序之間差異。一名環(huán)境科學(xué)家主要研究傳感器數(shù)據(jù)。如果試圖證明傳感器能夠響應(yīng)某種刺激(例如氣體濃度),就會使用統(tǒng)計模型來確定信號響應(yīng)是否具有統(tǒng)計顯著性。

他會嘗試?yán)斫膺@種關(guān)系并測試其可重復(fù)性,以便能夠準(zhǔn)確地表征傳感器響應(yīng)并根據(jù)這些數(shù)據(jù)做出推斷。可能測試的一些事情包括實際上,響應(yīng)是否是線性的?響應(yīng)是否可以歸因于氣體濃度而不是傳感器中的隨機噪聲?等等。

而同時,我們還可以獲得20個不同傳感器的陣列,可以用來嘗試預(yù)測新近表征的傳感器的響應(yīng)。我們不認(rèn)為一個預(yù)測傳感器結(jié)果的20個不同變量的模型具備多少可解釋性。由于化學(xué)動力學(xué)和物理變量與氣體濃度之間的關(guān)系引起的非線性,這個模型可能會比神經(jīng)網(wǎng)絡(luò)更深奧。我希望這個模型有意義,但只要我能做出準(zhǔn)確的預(yù)測就已經(jīng)很不錯了。

如果試圖證明數(shù)據(jù)變量之間的關(guān)系達(dá)到一定程度的統(tǒng)計顯著性,那么發(fā)論文的時候應(yīng)該會使用統(tǒng)計模型而不是機器學(xué)習(xí)。這是因為我們更關(guān)心變量之間的關(guān)系,而不是做出預(yù)測。做出預(yù)測仍然很重要,但是大多數(shù)機器學(xué)習(xí)算法缺乏可解釋性使得難以證明數(shù)據(jù)內(nèi)的關(guān)系(這實際上是學(xué)術(shù)研究中的一個大問題,研究人員使用他們不理解和獲得的算法似是而非的推論)。

這兩種方法的目標(biāo)不同,盡管使用的方法類似。機器學(xué)習(xí)算法的評估使用測試集來驗證其準(zhǔn)確性。統(tǒng)計模型可以使用置信區(qū)間,顯著性檢驗和其他檢驗對回歸參數(shù)進(jìn)行分析,以評估模型的合法性。由于這些方法產(chǎn)生相同的結(jié)果,因此很容易理解為什么人們可能認(rèn)為它們是相同的。

統(tǒng)計與機器學(xué)習(xí)在線性回歸上的差異

有一個誤解存在了10年:僅基于它們都利用相同的基本概率概念這一事實,來混淆這兩個術(shù)語是不合理的。

有人一種說法是,根據(jù)這個事實做出機器學(xué)習(xí)只是美化統(tǒng)計的陳述,我們也可以做出以下陳述:

物理學(xué)只是美化數(shù)學(xué)

動物學(xué)只是美化郵票收藏

建筑只是美化沙子城堡建筑

這些陳述(尤其是第三個)非常荒謬,所有這些陳述都基于這種混淆基于類似想法的術(shù)語的想法(用于架構(gòu)示例的雙關(guān)語)。

實際上,物理學(xué)是建立在數(shù)學(xué)基礎(chǔ)之上的,它是數(shù)學(xué)應(yīng)用于理解現(xiàn)實中存在的物理現(xiàn)象。物理學(xué)還包括統(tǒng)計學(xué)的各個方面,現(xiàn)代統(tǒng)計學(xué)的形式通常是由一個由Zermelo-Frankel集理論與測量理論相結(jié)合的框架構(gòu)建,以產(chǎn)生概率空間。它們之間都有很多共同之處,因為都來自相似的起源,并應(yīng)用類似的想法,來達(dá)成合乎邏輯的結(jié)論。同樣,建筑和沙堡建筑也有很多共同點啊,但這兩個顯然不是一個概念。

還有兩個與機器學(xué)習(xí)和統(tǒng)計相關(guān)的常見誤解我們需要糾正一下,一個是混淆了數(shù)據(jù)科學(xué)和統(tǒng)計學(xué);另一個是混淆了機器學(xué)習(xí)和人工智能。這些是AI與機器學(xué)習(xí)不同,數(shù)據(jù)科學(xué)與統(tǒng)計學(xué)不同。這些是相當(dāng)無爭議的問題所以它會很快。

數(shù)據(jù)科學(xué) vs 統(tǒng)計學(xué)

數(shù)據(jù)科學(xué)本質(zhì)上是應(yīng)用于數(shù)據(jù)的計算和統(tǒng)計方法,這些方法可以是小型或大型數(shù)據(jù)集,也可以是探索性數(shù)據(jù)分析。數(shù)據(jù)被檢查和可視化,以幫助科學(xué)家更好地理解數(shù)據(jù),并從中做出推論。數(shù)據(jù)科學(xué)還包括數(shù)據(jù)爭用和預(yù)處理等內(nèi)容,因此還在某種程度上涉及到計算機科學(xué),例如編碼,在數(shù)據(jù)庫,Web服務(wù)器等之間建立連接和pipe等。不一定非得使用計算機來進(jìn)行統(tǒng)計,但如果沒有計算機,就沒法真正進(jìn)行數(shù)據(jù)科學(xué)。所以,數(shù)據(jù)科學(xué)使用統(tǒng)計數(shù)據(jù),但二者也顯然不一樣。

機器學(xué)習(xí) vs 人工智能

機器學(xué)習(xí)跟人工智能不同。事實上,機器學(xué)習(xí)是人工智能的一個子集,這是非常明顯的,因為我們正在“訓(xùn)練”一臺機器,根據(jù)以前的數(shù)據(jù)對某些類型的數(shù)據(jù)做出可推廣的推斷。

機器學(xué)習(xí)是基于統(tǒng)計學(xué)的

在我們討論統(tǒng)計和機器學(xué)習(xí)的不同之前,讓我們首先討論相似之處。我們已經(jīng)在前幾節(jié)中對此進(jìn)行了一些討論。

機器學(xué)習(xí)建立在統(tǒng)計框架之上。這應(yīng)該是顯而易見的,因為機器學(xué)習(xí)涉及數(shù)據(jù),并且必須使用統(tǒng)計框架來描述數(shù)據(jù)。然而,統(tǒng)計力學(xué)也擴展到大量粒子的熱力學(xué),也建立在統(tǒng)計框架之上。壓力的概念實際上是一個統(tǒng)計量,溫度也是一個統(tǒng)計量。如果你覺得這聽起來很荒謬可笑,但事實上確實如此。這就是為什么你無法描述分子的溫度或壓力,這是荒謬的。溫度是分子碰撞產(chǎn)生的平均能量的表現(xiàn)。對于足夠大量的分子,我們可以描述像房子或戶外的溫度。

你會承認(rèn)熱力學(xué)和統(tǒng)計學(xué)是一樣的嗎?不,熱力學(xué)使用統(tǒng)計數(shù)據(jù)來幫助我們以運輸現(xiàn)象的形式理解工作和熱量的相互作用。

實際上,熱力學(xué)是建立在除了統(tǒng)計之外的更多項目之上的。同樣,機器學(xué)習(xí)也利用了大量其他數(shù)學(xué)和計算機科學(xué)領(lǐng)域,例如:

ML理論來自數(shù)學(xué)和統(tǒng)計學(xué)等領(lǐng)域

ML算法來自優(yōu)化,矩陣代數(shù),微積分等領(lǐng)域

ML實現(xiàn)來自計算機科學(xué)與工程概念(例如內(nèi)核技巧,特征散列)

當(dāng)你開始使用Python進(jìn)行編碼,剔除sklearn庫并開始使用這些算法時,很多這些概念都被抽象出來,因此很難看出這些差異。

統(tǒng)計學(xué)習(xí)理論:機器學(xué)習(xí)的統(tǒng)計基礎(chǔ)

統(tǒng)計學(xué)與機器學(xué)習(xí)之間的主要區(qū)別在于統(tǒng)計學(xué)僅基于概率空間。從集合論中推導(dǎo)出整個統(tǒng)計數(shù)據(jù),它討論了我們?nèi)绾螌?shù)字組合成類別,稱為集合,然后對此集合強加一個度量,以確保所有這些的總和值為1,我們稱之為概率空間。

除了這些集合和度量的概念之外,統(tǒng)計數(shù)據(jù)不對宇宙做任何其他假設(shè)。這就是為什么當(dāng)我們用非常嚴(yán)格的數(shù)學(xué)術(shù)語指定概率空間時,我們指定了3個東西。

概率空間,我們這樣表示,(Ω,F(xiàn),P)由三部分組成:

樣本空間Ω,它是所有可能結(jié)果的集合

一組事件F,其中每個事件是包含零個或多個結(jié)果的集合

為事件分配概率P; 也就是說,從事件到概率的函數(shù)

機器學(xué)習(xí)基于統(tǒng)計學(xué)習(xí)理論。它仍然基于概率空間的這種公理概念。該理論是在20世紀(jì)60年代發(fā)展起來的,并擴展到傳統(tǒng)統(tǒng)計學(xué)。

機器學(xué)習(xí)有幾種類型,這里我們主要講監(jiān)督學(xué)習(xí),因為它是最容易解釋的。

根據(jù)監(jiān)督學(xué)習(xí)的統(tǒng)計學(xué)習(xí)理論,一組數(shù)據(jù),我們將其表示為S={(x?,y?)}。這是一個有n個數(shù)據(jù)點的數(shù)據(jù)集,每個數(shù)據(jù)點由我們稱之為功能的其他一些值描述,這些值由x提供,并且這些特征由某個函數(shù)映射以給出值y。

假如說我們已經(jīng)有了這些數(shù)據(jù),我們的目標(biāo)是找到將x值映射到y(tǒng)值的函數(shù)。可以描述此映射的所有可能函數(shù)的集合,稱為假設(shè)空間。

要找到這個函數(shù),我們必須讓算法“學(xué)會”一些方法來找出解決問題的最佳方法,這個過程由損失函數(shù)實現(xiàn)。因此,對于我們所擁有的每個假設(shè)(建議函數(shù)),需要通過查看其對所有數(shù)據(jù)的預(yù)期風(fēng)險值來評估該函數(shù)的執(zhí)行情況。

預(yù)期風(fēng)險基本上是損失函數(shù)乘以數(shù)據(jù)概率分布的總和。如果我們知道映射的聯(lián)合概率分布,就很容易找到最佳函數(shù)。然而,這通常是未知的,因此我們最好的選擇是猜測,然后憑經(jīng)驗確定損失函數(shù)是否更好。我們稱之為經(jīng)驗風(fēng)險。

然后,我們可以比較不同的函數(shù),并尋找給出最小預(yù)期風(fēng)險的假設(shè),即假設(shè)給出數(shù)據(jù)上所有假設(shè)的最小值(稱為下限)。

然而,該算法具有作弊的傾向,可以通過過度擬合數(shù)據(jù)來最小化其損失函數(shù)。這就是為什么在學(xué)習(xí)基于訓(xùn)練集數(shù)據(jù)的函數(shù)之后,該函數(shù)需要在測試數(shù)據(jù)集上進(jìn)行驗證,驗證用的數(shù)據(jù)數(shù)據(jù)不會出現(xiàn)在訓(xùn)練集中。

顯然,這不是統(tǒng)計學(xué)看重的點,因為統(tǒng)計學(xué)并不需要最小化經(jīng)驗風(fēng)險。選擇最小化經(jīng)驗風(fēng)險的函數(shù)的學(xué)習(xí)算法稱為經(jīng)驗風(fēng)險最小化。

舉例

以線性回歸的簡單情況為例。在傳統(tǒng)意義上,我們嘗試將某些數(shù)據(jù)之間的錯誤最小化,以便找到可用于描述數(shù)據(jù)的函數(shù)。在這種情況下,常使用均方誤差。我們將它調(diào)整為正負(fù)誤差不會相互抵消。然后我們可以以封閉形式的方式求解回歸系數(shù)。

如果將損失函數(shù)作為均方誤差來執(zhí)行統(tǒng)計學(xué)習(xí)理論所支持的經(jīng)驗風(fēng)險最小化,最終得到的是與傳統(tǒng)線性回歸分析相同的結(jié)果。

這是因為兩種情況是等價的,就像在同一數(shù)據(jù)上執(zhí)行最大似然估計也會得到相同的結(jié)果一樣。最大似然可以用不同的方式來實現(xiàn)同一目標(biāo),但沒有人會說最大似然與線性回歸相同,對吧。

另一個需要注意的是,在傳統(tǒng)的統(tǒng)計方法中,并沒有訓(xùn)練和測試集的概念。而是用度量來檢查模型的執(zhí)行方式。雖然評估程序不同,但兩種方法都能夠在統(tǒng)計上給出魯棒的結(jié)果。

更進(jìn)一步,傳統(tǒng)的統(tǒng)計方法提供了最優(yōu)解,因為解決方案具有封閉形式,它沒有測試任何其它假設(shè)并收斂到解決方案。而機器學(xué)習(xí)方法則是嘗試了一堆不同的模型,收斂到最終假設(shè)。

如果我們使用了不同的損失函數(shù),結(jié)果就不會收斂。例如,如果我們使用鉸鏈損耗(使用標(biāo)準(zhǔn)梯度下降不可微分,那么就需要其他技術(shù),如近端梯度下降來解決問題),那么結(jié)果將不會相同。

當(dāng)然,可以通過考慮模型的偏差來進(jìn)行最終比較,比如要求機器學(xué)習(xí)算法測試線性模型,以及多項式模型,指數(shù)模型等,以查看這些假設(shè)是否更適合我們的先驗損失函數(shù)。

這類似于增加相關(guān)的假設(shè)空間。在傳統(tǒng)的統(tǒng)計意義上,我們選擇一個模型就可以評估其準(zhǔn)確性,但不能自動選擇100個不同模型中的最佳模型。因為模型中總有一些偏差源于最初的算法選擇。這是必要的,因為找到對數(shù)據(jù)集最佳的任意函數(shù)是NP難問題。

結(jié)論

沒有統(tǒng)計學(xué)就不會存在機器學(xué)習(xí),但機器學(xué)習(xí)在當(dāng)代非常有用,因為自信息爆炸以來人類,已經(jīng)產(chǎn)生了大量數(shù)據(jù)。

在“到底應(yīng)該選擇機器學(xué)習(xí)還是統(tǒng)計模型”的問題上,很大程度上取決于目的是什么。如果只是想創(chuàng)建一種能夠高精度地預(yù)測住房價格的算法,或者使用數(shù)據(jù)來確定某人是否可能感染某些類型的疾病,那么機器學(xué)習(xí)可能是更好的方法;如果試圖證明變量之間的關(guān)系或從數(shù)據(jù)推斷,統(tǒng)計模型可能是更好的方法。

還有就是,即使沒有強大的統(tǒng)計學(xué)背景,也仍然可以掌握機器學(xué)習(xí)并應(yīng)用在實際問題中。但基本的統(tǒng)計思想還是要有的,以防止模型過度擬合和給出似是而非的推論。

這里推薦幾個不錯的課程,可以讓你對機器學(xué)習(xí)和統(tǒng)計學(xué)有更清晰的認(rèn)識:

9.520/6.860: Statistical Learning Theory and Applications

http://www.mit.edu/~9.520/fall18/

該課程是以統(tǒng)計學(xué)家的角度來闡述機器學(xué)習(xí)

ECE 543: Statistical Learning Theory

-

傳感器

+關(guān)注

關(guān)注

2564文章

52665瀏覽量

764209 -

機器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8493瀏覽量

134161 -

數(shù)據(jù)科學(xué)

+關(guān)注

關(guān)注

0文章

168瀏覽量

10416

原文標(biāo)題:機器學(xué)習(xí)不是統(tǒng)計學(xué)!這篇文章終于把真正區(qū)別講清楚了

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

如何使用統(tǒng)計學(xué)知識進(jìn)行和統(tǒng)計分析誤差分析?

人工智能其實就是華麗的統(tǒng)計學(xué)?

機器學(xué)習(xí)入門寶典《統(tǒng)計學(xué)習(xí)方法》的介紹

機器學(xué)習(xí)如何運作 下一步是什么

機器學(xué)習(xí)就是現(xiàn)代統(tǒng)計學(xué)

統(tǒng)計學(xué)對于機器學(xué)習(xí)有什么作用

“機器學(xué)習(xí)”術(shù)語的誕生并不是為了區(qū)分統(tǒng)計學(xué)

燈具的種類百科:你分得清哪些是可以調(diào)光的嗎

深度學(xué)習(xí)與經(jīng)典統(tǒng)計學(xué)的差異

激光加工納秒激光、皮秒激光、飛秒激光,你分得清嗎?

統(tǒng)計學(xué)和機器學(xué)習(xí)的真正差別。你分得清嗎?

統(tǒng)計學(xué)和機器學(xué)習(xí)的真正差別。你分得清嗎?

評論