電子發(fā)燒友網(wǎng)報道(文/吳子鵬)美東時間本周二(11月30日),亞馬遜旗下云計算部門 AWS 推出了兩款新的定制計算芯片,兩款芯片均在效能和成本方面進行了專門的優(yōu)化,以幫助AWS的客戶在一些需求上面

2021-12-03 10:18:41 3099

3099 — GTC — 太平洋時間2022 年 9 月 20 日 — NVIDIA 于今日發(fā)布兩項全新大型語言模型(LLM)云 AI 服務(wù)——NVIDIA NeMo 大型語言模型服務(wù)和 NVIDIA BioNeMo

2022-09-21 15:24:52 434

434

大模型在端側(cè)的部署也成了業(yè)界關(guān)注的焦點。 ? 如何把AI 模型在邊緣端部署 ? 首先得軟硬件適配,硬件方面,適配的AI芯片越多越好,這樣對于工程師來說,就降低了端側(cè)模型適配遷移的難度,即使換一個設(shè)備也可以輕松部署上去;軟件方面,主要

2023-07-04 00:11:00 1825

1825

算法和大數(shù)據(jù)時代的到來、以及AI芯片的出現(xiàn)。 第三波AI浪潮的發(fā)展主要由深度學(xué)習(xí)技術(shù)的突破引領(lǐng),而英偉達(Nvidia)憑借其通用的GPU單元,專門的TensorRT加速器,強勁的矩陣運算性能加上對其他

2018-06-11 08:20:23

、手指關(guān)鍵點、人車物檢測等功能,開發(fā)者僅需要幾條API調(diào)用即可在嵌入式產(chǎn)品中離線地使用這些功能,而無需關(guān)心AI模型的部署細節(jié),極大加速了產(chǎn)品的原型驗證和開發(fā)部署。Rock-X組件庫根據(jù)用戶的需求仍會不斷

2022-08-15 17:53:47

阿里云上的NGC容器, 開發(fā)者們可以快速的接入深度學(xué)習(xí)框架,大大縮減了產(chǎn)品開發(fā)以及業(yè)務(wù)部署的時間;,用戶通過阿里云和NGC即可以完成自己AI 的應(yīng)用的搭建。自2015年起,阿里云就陸續(xù)推出了彈性GPU

2018-04-04 14:39:24

雖然GPU解決方案對訓(xùn)練,AI部署需要更多。

預(yù)計到2020年代中期,人工智能行業(yè)將增長到200億美元,其中大部分增長是人工智能推理。英特爾Xeon可擴展處理器約占運行AI推理的處理器單元的70

2023-08-04 07:25:00

GPU編程--OpenCL四大模型

2019-04-29 07:40:44

ai芯片和gpu的區(qū)別▌車載芯片的發(fā)展趨勢(CPU-GPU-FPGA-ASIC)過去汽車電子芯片以與傳感器一一對應(yīng)的電子控制單元(ECU)為主,主要分布與發(fā)動機等核心部件上。...

2021-07-27 07:29:46

,筆者覺得就可以從VM部署這一點看出來,速度比阿里云快很多(同樣的條件下),微軟的云服務(wù)和AWS和阿里云筆者都或多或少的使用過,如果不是因為AWS入門門檻太高筆者還會繼續(xù)使用下去的,如果一個公司或者

2021-04-28 17:36:49

亞馬遜推出用于人工智能部署的AWS Inferentia芯片

2021-01-18 06:17:03

1、如何在生產(chǎn)中部署基于嵌入的機器學(xué)習(xí)模型 由于最近大量的研究,機器學(xué)習(xí)模型的性能在過去幾年里有了顯著的提高。雖然這些改進的模型開辟了新的可能性,但是它們只有在可以部署到生產(chǎn)應(yīng)用中時才開始提供真正

2022-11-02 15:09:52

,也正積極的為其開發(fā)專用的 AI 硬件,用于自己的云產(chǎn)品和邊緣計算產(chǎn)品環(huán)境中。

神經(jīng)形態(tài)芯片 方面也有著一些發(fā)展,這是一種專門為神經(jīng)網(wǎng)絡(luò)設(shè)計的計算機架構(gòu)。英特爾在神經(jīng)形態(tài)計算領(lǐng)域處于領(lǐng)先地位,已經(jīng)開發(fā)

2024-03-21 15:19:45

英特爾正在使其GPU多樣化,以與x86以外架構(gòu)的處理器兼容,這可能是使其從芯片制造商成為以代工為首要業(yè)務(wù)的公司的一步。英特爾即將推出的名為Ponte Vecchio的GPU,將會和SiPearl

2022-03-29 14:41:33

Mali GPU 支持tensorflow或者caffe等深度學(xué)習(xí)模型嗎? 好像caffe2go和tensorflow lit可以部署到ARM,但不知道是否支持在GPU運行?我希望把訓(xùn)練

2022-09-16 14:13:01

量化

七、Vitis AI 通過遷移學(xué)習(xí)訓(xùn)練自定義模型

八、Vitis AI 將自定義模型編譯并部署到KV260中

鋪墊

Vitis AI 是什么?

Vitis AI 是賽靈思公司推出的一款綜合 AI

2023-10-14 15:34:26

,本周將會推出針對異構(gòu)計算GPU實例GN5年付5折的優(yōu)惠活動,希望能夠打造良好的AI生態(tài)環(huán)境,幫助更多的人工智能企業(yè)以及項目順利上云。隨著深度學(xué)習(xí)對人工智能的巨大推動,深度學(xué)習(xí)所構(gòu)建的多層神經(jīng)網(wǎng)絡(luò)模型

2017-12-26 11:22:09

介紹在STM32cubeIDE上部署AI模型的系列教程,開發(fā)板型號STM32H747I-disco,值得一看。MCUAI原文鏈接:【嵌入式AI開發(fā)】篇四|部署篇:STM32cubeIDE上部署神經(jīng)網(wǎng)絡(luò)之模型部署

2021-12-14 09:05:03

IoT邊緣設(shè)備部署推論功能。

這些功能利用AWS Greengrass,以安全的方式,提供從云層到邊緣的視覺分析的無縫移動。

Figure 1: Architecture Diagram開始

2023-08-03 08:48:24

看到CUBE_AI已經(jīng)支持到STM32F0系列芯片,就想拿來入門嵌入式AI。

生成的模型很小,是可以部署到F0上的,但是一直無法創(chuàng)建成功。

查閱CUBE AI文檔說在調(diào)用create函數(shù)前,要啟用

2024-03-15 08:10:25

千芯科技推出了針對芯來RISC-V平臺的AI部署工具包(tinyAI SDK),使用戶可以基于該先進技術(shù)快速部署基于芯來RISC-V內(nèi)核的AIoT應(yīng)用。在芯來UX600上,實測的AI應(yīng)用實現(xiàn)

2020-11-21 10:08:17

如何用stm32cube.ai簡化人工神經(jīng)網(wǎng)絡(luò)映射?如何使用stm32cube.ai部署神經(jīng)網(wǎng)絡(luò)?

2021-10-11 08:05:42

如何利用周易AIPU來進行AI應(yīng)用的部署開發(fā)?

2021-12-29 07:43:54

在即將開展的“中國移動全球合作伙伴大會”上,華為將發(fā)布一款面向運營商電信領(lǐng)域的一站式AI開發(fā)平臺——SoftCOM AI平臺,幫助電信領(lǐng)域開發(fā)者解決AI開發(fā)在數(shù)據(jù)準(zhǔn)備、模型訓(xùn)練、模型發(fā)布以及部署驗證

2021-02-25 06:53:41

本期我們分享主題是如何將 AI 模型部署到嵌入式系統(tǒng)中,下一期將介紹如何在 RT-Thread 操作系統(tǒng)上運行 Mnist Demo(手寫數(shù)字識別)。 嵌入式關(guān)聯(lián) AIAI落地一直是一...

2021-12-14 07:55:43

我正在嘗試通過 cube-ai 擴展將機器學(xué)習(xí)模型部署到 STM32H743ZIT6。該模型采用 .tflite 格式。當(dāng)我嘗試分析模型時,結(jié)果如下:該工具指出 MCU 總共有 512KB 可用,模型超過了它,但在數(shù)據(jù)表上我發(fā)現(xiàn)有 1024KB。什么原因?

2022-12-30 08:57:53

保駕護航。下面讓我們來了解如何不借助手動工具或手動編程來選擇模型、隨時隨地訓(xùn)練模型并將其無縫部署到TI處理器上,從而實現(xiàn)硬件加速推理。圖1: 邊緣AI應(yīng)用的開發(fā)流程第1步:選擇模型邊緣AI系統(tǒng)開發(fā)

2022-11-03 06:53:28

還只是編譯階段,選擇的是ART-PI,還沒有燒錄,只是編譯階段就報錯在部署完成過后,在工程里面打開發(fā)現(xiàn)如下報錯,之前部署完官方的minist的時候也會在X-CUBE-AI這個包報錯,已經(jīng)嘗試重新安裝,望得解

2022-11-01 11:14:15

`` 為什么發(fā)起AI芯片設(shè)計眾籌 ?1、傳統(tǒng)指令驅(qū)動的處理器(CPU和GPU)已經(jīng)無法支持數(shù)據(jù)驅(qū)動的AI技術(shù),專用AI芯片已成為市場真實的強勁的需求,擁有AI芯片開發(fā)能力和經(jīng)驗的工程師將會受到產(chǎn)業(yè)

2019-07-19 11:54:01

驅(qū)動程序,用于與DBM10芯片進行通信。SoC還具有跨平臺工具鏈,該工具鏈支持所有常用的人工智能(AI)和機器學(xué)習(xí)(ML)框架,以簡化算法部署。工程師可以開發(fā),訓(xùn)練和測試算法;接下來,他們可以將其保存為標(biāo)準(zhǔn)

2021-03-03 10:46:14

基礎(chǔ)設(shè)施管理工具。使用 Terraform 有很多好處,但其中一個好處是它不會將您鎖定在任何特定的云提供商中。它可用于在 AWS、Azure 等上部署基礎(chǔ)設(shè)施。正如我們將看到的,它也很容易上手。我們的設(shè)置

2022-09-16 14:53:14

請問 新唐有沒有專門用于ad采集的芯片呢

2023-06-20 08:19:13

RT-AK 是 RT-Thread 團隊為 RT-Thread 實時操作系統(tǒng)所開發(fā)的 AI 套件,能夠一鍵將 AI 模型部署到 RT-Thread 項目中,讓用戶可以 在統(tǒng)一的 API 之上

2022-09-02 15:06:14

PyTorch 模型所需的大部分基礎(chǔ)設(shè)施工作,這是一個將模型作為 api 部署到 AWS 上的開源工具。這篇文章并不是一個完整的 Cortex 使用指南,只是一個高層次的 Cortex 使用方法,你

2022-11-01 15:25:02

在2016年11月底舉辦的AWS re:invent大會上,AWS正式推出了自己的AI產(chǎn)品線。以此為標(biāo)志,AWS正式加入全球人工智能大戰(zhàn)。

2016-12-01 14:00:53 1124

1124 中國上海,2017年7月26日——恩智浦半導(dǎo)體(納斯達克代碼:NXPI,以下簡稱“恩智浦”)今日宣布與亞馬遜AWS開展合作,在其設(shè)計研發(fā)的Layerscape智能網(wǎng)關(guān)平臺上成功完成對亞馬遜AWS

2017-07-26 15:08:04 845

845 DeepLens預(yù)先加載了AWS Greengrass進行本地計算,并且可以與SageMaker(這是一項用于簡化AI模型部署的新服務(wù))以及諸如Google的TensorFlow和Facebook的Caffe2這些流行的開源AI服務(wù)協(xié)同工作。

2017-11-30 15:17:46 573

573 近日,亞馬遜正式推出DeepLens攝像頭,它是一個面向AI開發(fā)者的定制攝像頭,開發(fā)者可以在AWS(Amazon Web Services)上開發(fā)AI系統(tǒng),讓系統(tǒng)在攝像頭上運行。

2018-01-05 09:26:43 4214

4214 Alexa和AWS是亞馬遜的關(guān)鍵業(yè)務(wù),其中最大的亮點就是人工智能技術(shù)的參與。據(jù)悉亞馬遜內(nèi)部部門不止Alexa和AWS,幾乎所有的部門都有深度學(xué)習(xí)技術(shù)的影子,本文將揭秘亞馬遜人工智能發(fā)展史。他談?wù)勊侨绾芜M行人工智能的賦能。

2018-02-05 09:15:52 1547

1547 入亞馬遜AWS是我一次在學(xué)術(shù)界之外的“產(chǎn)業(yè)界”任職。我選擇AWS有幾個原因。我認為人工智能的民主化具有巨大潛力,AWS是功能最全面、應(yīng)用范圍最廣的云平臺。兩年前,云AI仍然是一個未知的領(lǐng)域,讓這份工作成為一次令人興奮的冒險。將應(yīng)用AI研究引入AWS這件事也很吸引我。

2018-08-31 08:42:38 7289

7289 如果在業(yè)界談起AI人工智能和機器學(xué)習(xí)技術(shù)的發(fā)展歷程,有一家云計算服務(wù)商的名字是絕對繞不開的,那就是亞馬遜AWS。

2018-10-01 11:04:00 2226

2226 據(jù)報道,在拉斯維加斯舉行的AWS re:Invent上,亞馬遜宣布了一款名為Inferentia的新型專用機器學(xué)習(xí)芯片。

2018-11-29 14:19:46 1626

1626 本周,亞馬遜AWS re:Invent 2018大會在拉斯維加斯舉辦,AWS首席執(zhí)行官Andy Jassy在會上發(fā)布了一款名為Inferentia的首款云端AI芯片。

2018-11-29 16:08:39 1950

1950 亞馬遜發(fā)布一款機器學(xué)習(xí)芯片,進軍英特爾和英偉達所在的市場,希望借此提升未來幾年的盈利能力。 亞馬遜是英特爾和英偉達的最大買家,后兩家公司的芯片對亞馬遜的AWS云計算業(yè)務(wù)形成幫助。但亞馬遜現(xiàn)在開始

2019-05-04 18:23:00 1219

1219 亞馬遜(Amazon)AWS(Amazon Web Services)在官網(wǎng)上宣布推出全新EC2 A1虛擬服務(wù)器(Instances),并先行在美國東、西部和歐洲等地區(qū)上市。

2018-12-01 10:37:39 3209

3209 近日,在拉斯維加斯舉行的AWS re:Invent上,亞馬遜正式發(fā)布了其首款云端AI芯片——Inferentia。亞馬遜云CEO Andy Jassy。他表示Inferentia將是一款高性能

2018-12-05 09:32:07 832

832 一,亞馬遜推出首款自研Arm架構(gòu)云服務(wù)器CPU Graviton,目標(biāo)直指英特爾; 昨天,亞馬遜又推出了首款云端AI推理芯片AWS Inferentia,目

2018-12-06 17:47:01 269

269 本周,亞馬遜推出首款自研Arm架構(gòu)云服務(wù)器CPU Graviton和首款云端AI推理芯片AWS Inferentia,拳打TPU,腳踢英特爾,力圖走一條自己的云端芯一體化路線,未來云計算市場將迎巨變

2019-01-04 17:01:01 310

310 據(jù)亞馬遜官方介紹,AWS Inferentia提供數(shù)百 TOPS(每秒萬億次運算)推理吞吐量,以允許復(fù)雜模型能夠進行快速預(yù)測。對于更復(fù)雜的性能需求,可以組合使用多個 AWS Inferentia

2019-02-14 13:58:51 5527

5527 據(jù)路透社報道,兩位知情人士透露,亞馬遜云計算部門AWS已經(jīng)設(shè)計了第二代功能更加強大的數(shù)據(jù)中心處理器芯片,這是該公司為其增長最快的業(yè)務(wù)向定制芯片投入大量資金的最新跡象。

2019-11-29 09:12:18 2128

2128 亞馬遜AWS在此次大會上推出了Inf1實例,該實例由Inferentia芯片提供支持,是一個在云端為AI推理提供支持的實例,AWS CEO Andy Jassy稱之為云中可用的成本最低的推理產(chǎn)品。

2019-12-05 14:31:21 3574

3574 沃達豐表示,將在歐洲推出亞馬遜 AWS 的 Wavelength 服務(wù),使開發(fā)者、物聯(lián)網(wǎng)、設(shè)備和最終用戶能夠使用邊緣計算(edge-computing)能力。

2019-12-05 15:28:44 3262

3262 亞馬遜云服務(wù) AWS 已經(jīng)成長為非常大的一塊業(yè)務(wù),但是一直在亞馬遜體系里,所以對其的感知要差很多。根據(jù)亞馬遜公布的財報,AWS 在 2018 年的營收已經(jīng)達到 256 億美金了。

2020-03-22 17:15:00 2888

2888 近日,麻省理工學(xué)院(MIT)的生物工程師們創(chuàng)建了一種被稱為“芯片上的器官”的模型。這是一種多組織模型,讓他們能夠在一個專門的微流控平臺上研究不同器官和免疫系統(tǒng)之間的關(guān)系。利用這種模型,研究小組能夠探索循環(huán)免疫細胞在潰瘍性結(jié)腸炎和其他炎癥性疾病中的作用。

2020-03-23 14:59:42 2962

2962 針對GPU制造商最直接的產(chǎn)品是Nervana NNP-T1000神經(jīng)網(wǎng)絡(luò)處理器。它是針對硬件密集型任務(wù)進行優(yōu)化的集成電路,該任務(wù)使用示例數(shù)據(jù)訓(xùn)練AI模型。今天,此過程對于確保模型產(chǎn)生準(zhǔn)確的結(jié)果是必不可少的,如今已在絕大多數(shù)AI項目中使用Nvidia芯片進行了此過程。

2020-03-24 15:19:30 2337

2337 此后,在計算機視覺和自然語言處理領(lǐng)域,GPU 的高并行計算能力得到了充分的發(fā)揮,英偉達的 GPU 也隨著 AI 第三次浪潮的崛起而迎來井噴發(fā)展。與此同時,更多為機器學(xué)習(xí)而專門定制的專用芯片開始出現(xiàn)

2020-10-11 10:23:34 2306

2306 亞馬遜宣布將人工智能處理遷移到自家定制的 AWS Inferentia 芯片。這意味著亞馬遜最大的推理(inferencing)服務(wù)(例如語音助手 Alexa)將交由更快、更專業(yè)的芯片進行處理,而非

2020-11-16 16:40:48 1376

1376 亞馬遜正在使用Nvidia芯片進行此處理。現(xiàn)在,大部分計算工作將被重新路由到亞馬遜自己的定制芯片Inferentia。Inferentia于2018年首次發(fā)布,該芯片專門設(shè)計用于加速機器學(xué)習(xí)任務(wù),例如大量識別圖像或文本到語音的翻譯。

2020-11-21 10:48:01 1515

1515 在近日舉辦的re:Invent開發(fā)人員大會上,AWS宣布推出全新的AI訓(xùn)練芯片AWS Trainium,這是該公司用于訓(xùn)練機器學(xué)習(xí)模型的下一代定制芯片。該公司承諾,通過對TensorFlow,PyTorch和MXNet的支持,它可以提供比云中任何競爭對手更高的性能。

2020-12-02 15:21:30 1942

1942 AWS即將推出云計算實例系列預(yù)覽,使企業(yè)可以在AWS云上訓(xùn)練人工智能(AI)模型,其性價比與顯卡比高40%。

2020-12-08 10:18:57 1602

1602 12月10日消息,據(jù)國外媒體報道,亞馬遜云服務(wù)(AWS)利用Gaudi AI處理器,來降低深度學(xué)習(xí)模型成本。 ? 隨著機器學(xué)習(xí)使用的增加和復(fù)雜性的增加,培訓(xùn)模型的成本和時間對企業(yè)來說是一個挑戰(zhàn)

2020-12-10 11:56:50 2539

2539 據(jù)BuzzFeed,亞馬遜周六將受美國保守派人士歡迎的社交平臺Parler移出云計算服務(wù)平臺(AWS)。

2021-01-11 10:41:40 1935

1935 亞馬遜云服務(wù)(AWS)是如何成為全球云計算老大的,它做云有沒有一套可借鑒的方法論?

2021-01-13 11:32:21 4844

4844 NVIDIA NeMo Megatron 框架; 可定制的大規(guī)模語言模型Megatron 530B;多GPU、多節(jié)點 Triton推理服務(wù)器助力基于語言的AI開發(fā)和部署,推動行業(yè)和科學(xué)發(fā)展

2021-11-12 14:30:07 1327

1327 近日,亞馬遜AWS推出了一項新的基于云計算的數(shù)據(jù)服務(wù),推動其數(shù)字化轉(zhuǎn)型工作。據(jù)了解,亞馬遜將通過Alexa語音助手進軍汽車行業(yè),日前還宣布推出了Amazon EC2 M6a 實例將采用第三代 AMD EPYC 霄龍 7003 系列處理器。

2021-12-01 10:31:16 4042

4042 近日,根據(jù)國外的媒體報道消息稱,亞馬遜在一年一度的全球大會上正式發(fā)布了系列新服務(wù),隨后亞馬遜公司的云計算部門正式推出了兩款新的定制計算芯片,AWS 一直致力于開發(fā)自己的定制芯片,旨在幫助其客戶降低使用英特爾和英偉達芯片的成本。

2021-12-02 11:09:41 1620

1620 電子發(fā)燒友網(wǎng)報道(文/吳子鵬)美東時間本周二(11月30日),亞馬遜旗下云計算部門 AWS 推出了兩款新的定制計算芯片,兩款芯片均在效能和成本方面進行了專門的優(yōu)化,以幫助AWS的客戶在一些需求上面

2021-12-07 11:23:07 1355

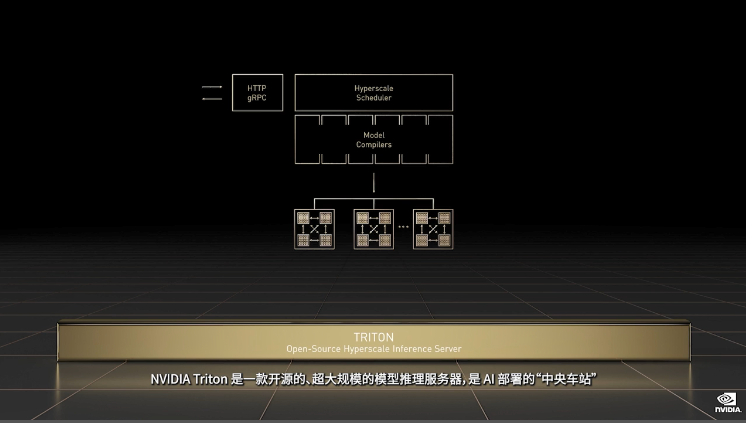

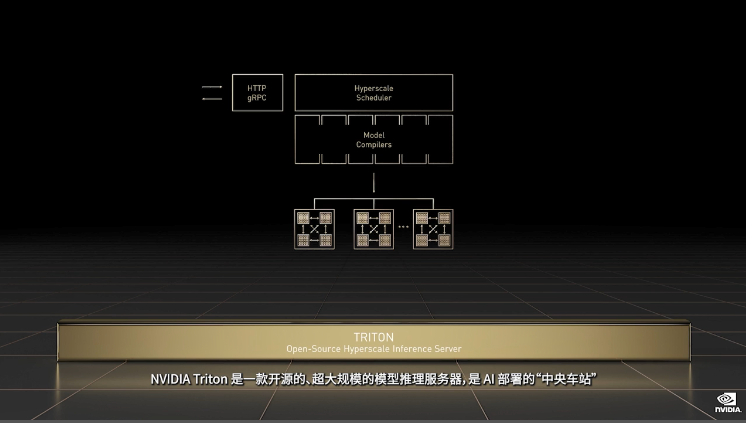

1355 GTC2022大會黃仁勛:NVIDIA Triton是AI部署的“中央車站”,支持在每一代NVIDIA GPU、x86和ARM CPU上部署模型。

2022-03-23 16:23:04 1259

1259

團隊可以將各類框架(TensorFlowPyTorch、TensorRT、ONNX Runtime、MXNet、XGBoost 等或自定義框架后端)訓(xùn)練的 AI 模型,在基于 GPU 或 CPU 的本地

2022-06-28 15:49:47 1293

1293 通過 NVIDIA GPU 加速平臺,Colossal-AI 實現(xiàn)了通過高效多維并行、異構(gòu)內(nèi)存管理、大規(guī)模優(yōu)化庫、自適應(yīng)任務(wù)調(diào)度等方式,更高效快速部署 AI 大模型訓(xùn)練與推理。

2022-10-19 09:39:39 1149

1149 為了解決AI部署落地難題,我們發(fā)起了FastDeploy項目。FastDeploy針對產(chǎn)業(yè)落地場景中的重要AI模型,將模型API標(biāo)準(zhǔn)化,提供下載即可運行的Demo示例。相比傳統(tǒng)推理引擎,做到端到端的推理性能優(yōu)化。FastDeploy還支持在線(服務(wù)化部署)和離線部署形態(tài),滿足不同開發(fā)者的部署需求。

2022-11-10 10:18:32 909

909 推理芯片,在Amazon EC2上以最低的延遲與成本,大規(guī)模地運行大型的深度學(xué)習(xí)模型 北京2022年11月30日 /美通社/ -- 亞馬遜云科技在2022 re:Invent全球大會上宣布,推出三款

2022-11-30 18:26:37 721

721 大型語言模型能識別、總結(jié)、翻譯、預(yù)測和生成文本及其他內(nèi)容。 AI 應(yīng)用在大型語言模型的幫助下,可用于解決總結(jié)文章、編寫故事和參與長對話等多種繁重工作。 大型語言模型(LLM)是一種深度學(xué)習(xí)算法,可以

2023-02-23 19:50:04 3887

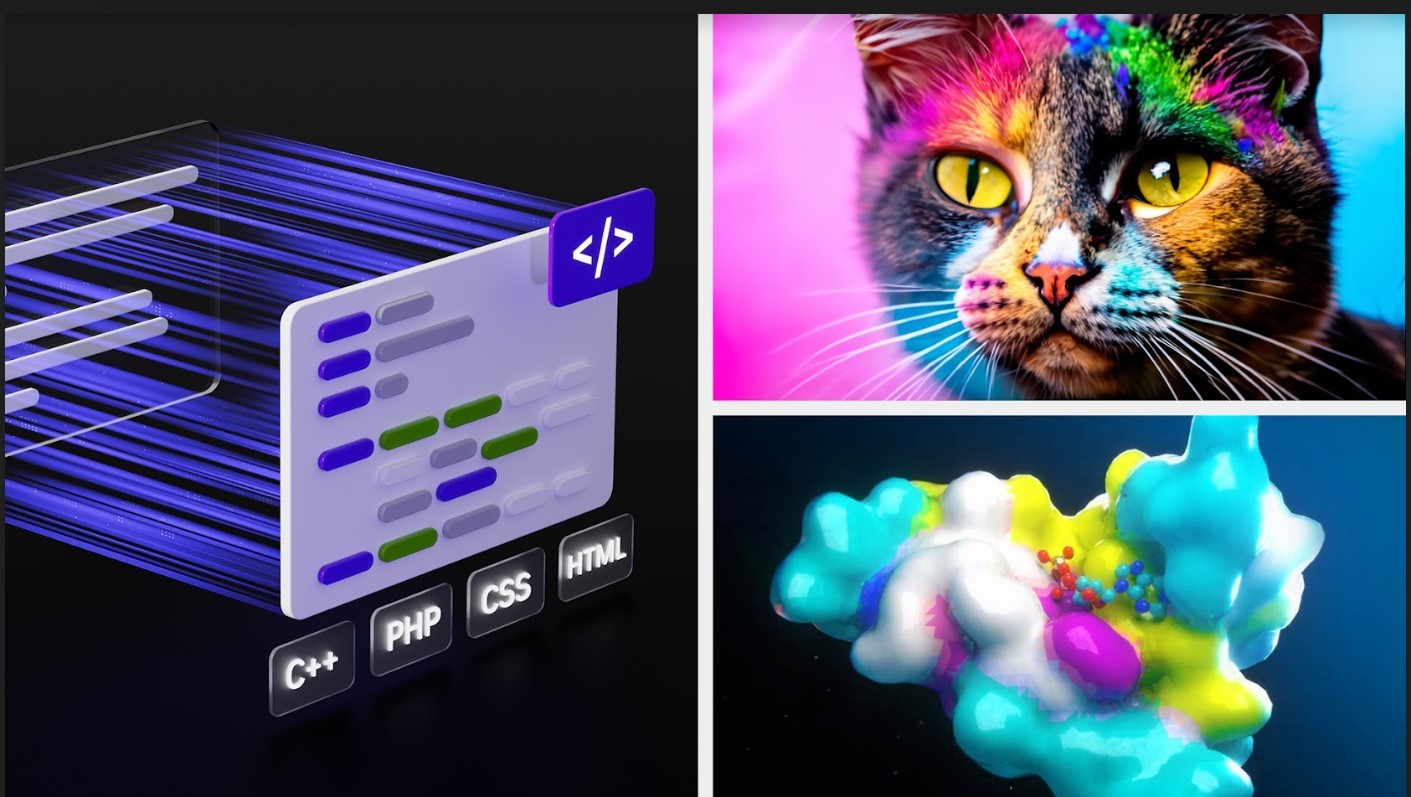

3887 為AI驅(qū)動的應(yīng)用構(gòu)建自定義模型 ? 加利福尼亞州圣克拉拉 – GTC – 太平洋時間 2023年3月21日 – 為了加速企業(yè)應(yīng)用生成式AI,NVIDIA今日宣布推出一套云服務(wù),使企業(yè)能夠構(gòu)建、完善

2023-03-22 13:45:40 261

261

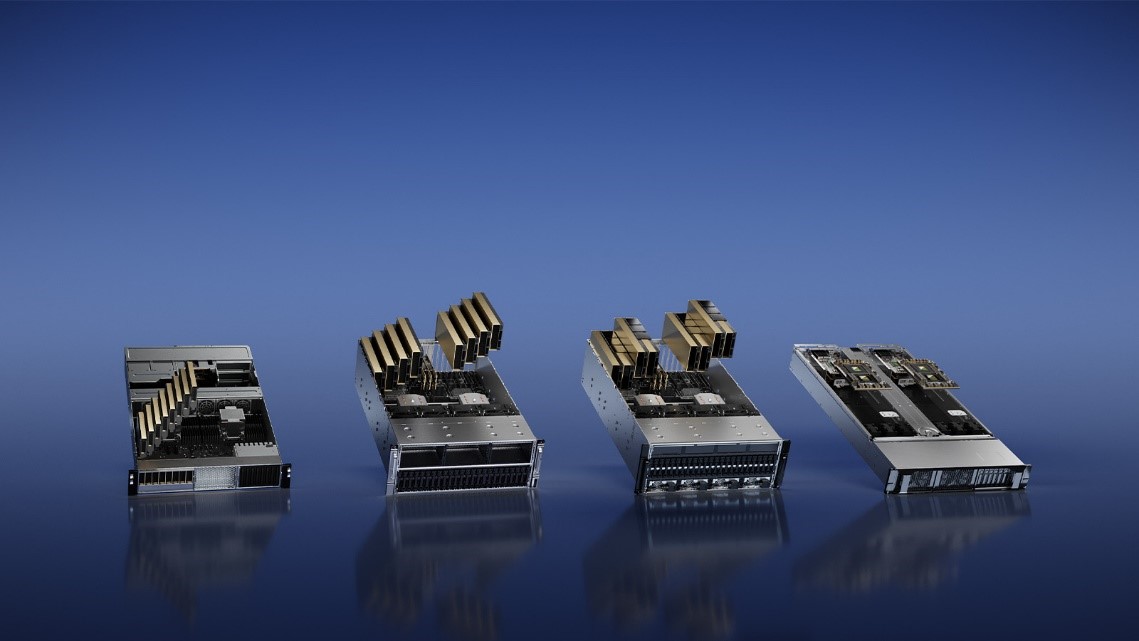

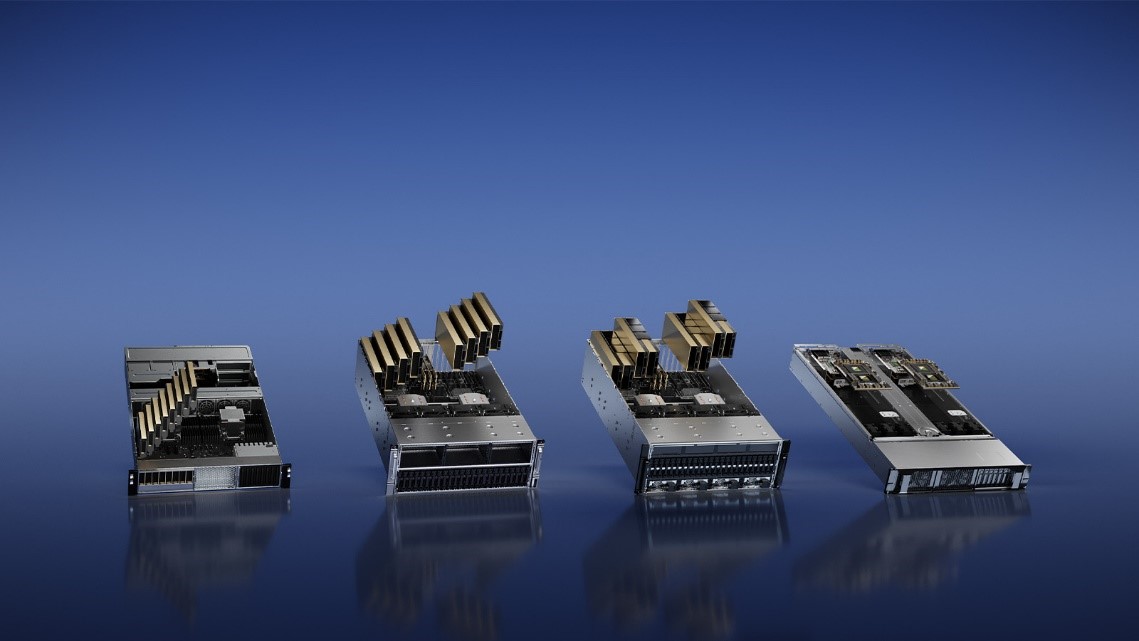

日 – NVIDIA于今日推出四款推理平臺。這些平臺針對各種快速興起的生成式AI應(yīng)用進行了優(yōu)化,能夠幫助開發(fā)人員快速構(gòu)建用于提供新服務(wù)和洞察的AI驅(qū)動的專業(yè)應(yīng)用。 ? 這些平臺將NVIDIA的全棧推理

2023-03-22 14:48:39 256

256

助力大型機器學(xué)習(xí)模型訓(xùn)練和生成式AI應(yīng)用程序構(gòu)建 部署在Amazon EC2 UltraCluster中的新型Amazon EC2 P5實例經(jīng)過充分優(yōu)化,可以利用英偉達?Hopper GPU加速生成

2023-03-22 18:05:52 499

499 Foundations 云服務(wù)為 AI 驅(qū)動的應(yīng)用構(gòu)建 自定義模型 加利福尼亞州圣克拉拉 – GTC – 太平洋時間 2023年3月21日 – 為了加速企業(yè)應(yīng)用生成式 AI,NVIDIA 宣布推出一套云服務(wù),使企業(yè)

2023-03-23 06:50:04 365

365 Foundations 云服務(wù)為 AI 驅(qū)動的應(yīng)用構(gòu)建 自定義模型 加利福尼亞州圣克拉拉 – GTC – 太平洋時間 2023年3月21日 – 為了加速企業(yè)應(yīng)用生成式 AI,NVIDIA 宣布推出一套云服務(wù),使企業(yè)

2023-03-25 15:20:04 285

285 電子發(fā)燒友網(wǎng)站提供《適用于AWS的M5Core2/Core2上的亞馬遜Alexa.zip》資料免費下載

2023-06-14 15:36:15 0

0 北京2023年7月27日?/美通社/ -- 亞馬遜云科技近日在紐約峰會上宣布,推出七項生成式AI創(chuàng)新,包括Amazon Bedrock新增基礎(chǔ)模型供應(yīng)商Cohere和全新基礎(chǔ)模型,以及全新代理

2023-07-27 16:19:12 508

508

AI芯片也被稱為AI加速器或計算卡,即專門用于處理人工智能應(yīng)用中的大量計算任務(wù)的模塊(其他非計算任務(wù)仍由CPU負責(zé))。當(dāng)前,AI芯片主要分為 GPU 、FPGA 、ASIC。

2023-08-03 17:19:11 1816

1816 ,AI芯片是專門為人工智能而設(shè)計的,它在處理神經(jīng)網(wǎng)絡(luò)和深度學(xué)習(xí)方面更加高效。而GPU芯片則是為了更好地處理圖像和視頻等方面而略微弱于AI芯片。 其次,AI芯片通常采用多核心硬件設(shè)計,這些核心之間可以并行工作,處理復(fù)雜的神經(jīng)網(wǎng)絡(luò),并且更加靈

2023-08-08 18:02:28 3616

3616 ?幫 助OEM廠商實現(xiàn)簡單、快速和安全的物聯(lián)網(wǎng)實 施與部署 2023年8月10日,中國北京——安富利(納斯達克股票代碼:AVT)推出第二款基于亞馬遜云科技(AWS)服務(wù)打造的IoTConnect平臺

2023-08-11 17:20:01 239

239 首臺GPU千億參數(shù)大模型訓(xùn)推一體機由數(shù)字寧夏倡議發(fā)起技術(shù)攻關(guān),基于沐曦最新發(fā)布的曦云C500旗艦GPU芯片提供的算力支持、智譜華章的AI大模型以及優(yōu)刻得靈活的算力部署方案,共同打造國內(nèi)模型能力、算力支持及解決方案領(lǐng)先的國有自主知識產(chǎn)權(quán)的AI大模型訓(xùn)練推理一體機

2023-08-21 14:41:20 2449

2449 眾所周知,谷歌、亞馬遜、微軟先后在內(nèi)部啟動自研AI芯片項目——谷歌的TPU系列,亞馬遜的Inferentia和Trainium系列,以及微軟今年被曝光的Athena芯片。三大云巨頭都有充分的資源與動力自研AI芯片,來削減英偉達的“GPU稅”。

2023-08-21 15:00:26 398

398

盤古ai大模型用的什么芯片? 盤古AI大模型是一種基于深度學(xué)習(xí)算法的人工智能技術(shù),它是由中國互聯(lián)網(wǎng)公司暴風(fēng)集團投入上億元研發(fā)的一項人工智能技術(shù)。盤古AI大模型采用了深度學(xué)習(xí)算法,能夠模擬人類的神經(jīng)元

2023-08-31 09:01:40 2008

2008 了 Nvidia 的 H100 GPU 和谷歌自主設(shè)計的 200 Gbps 基礎(chǔ)設(shè)施處理器(IPU)。主要用于訓(xùn)練和運行生成式 AI 模型以及大型語言模型。 谷歌云表示,A3 虛擬機將

2023-08-31 13:00:07 377

377

亞馬遜與 Anthropic 的聯(lián)手,和微軟與 OpenAI 的合作相類似,未來 Anthropic 將利用 AWS 的高性能、低成本機器學(xué)習(xí)加速器,在 AWS Trainium 和 Inferentia 芯片上訓(xùn)練和部署其未來基礎(chǔ)模型,而 AWS 用戶可以廣泛使用這些模型。

2023-09-26 15:58:10 375

375 Anthropic選擇亞馬遜云科技作為首選云服務(wù)供應(yīng)商,并將在Amazon Trainium和Amazon Inferentia芯片上進行其未來基礎(chǔ)模型的訓(xùn)練和部署,充分利用亞馬遜云科技高性能

2023-09-27 10:34:53 404

404 云科技的客戶使用。雙方深化合作的部分內(nèi)容包括: Anthropic將使用Amazon Trainium和Amazon Inferentia芯片來構(gòu)建、訓(xùn)練和部署其未來基礎(chǔ)模型,并充分利用亞馬遜云科技在價格

2023-09-28 11:55:24 420

420 。為了解決這個問題,英偉達將針對中國市場推出新的AI芯片,以應(yīng)對美國出口限制。本文將探討如何在多個GPU上訓(xùn)練大型模型,并分析英偉達禁令對中國AI計算行業(yè)的影響。

2023-11-16 11:39:31 898

898

。該套件即將在亞馬遜云科技(AWS)上的 NVIDIA DGX 云 上提供。 制藥和科技生物頭部企業(yè)的研究與開發(fā)人員現(xiàn)在可以通過亞馬遜云科技( Amazon Web Services,AWS)輕松部署

2023-11-29 21:10:01 329

329 本文將介紹亞馬遜如何使用 NVIDIA NeMo 框架、GPU 以及亞馬遜云科技的 EFA 來訓(xùn)練其 最大的新一代大語言模型(LLM)。 大語言模型的一切都很龐大——巨型模型是在數(shù)千顆 NVIDIA

2023-11-29 21:15:02 295

295

AWS最新推出的Trainium2 AI訓(xùn)練引擎在re:Invent 2023主機上首次亮相,引起廣泛關(guān)注,通過與AWS實驗室的Gadi Hutt的交流和對技術(shù)文檔的挖掘,可以試圖深入了解Trainium2與之前Inferentia系列的關(guān)系以及對Trainium2的期望。

2023-12-14 11:48:46 147

147

Groq推出了大模型推理芯片,以每秒500tokens的速度引起轟動,超越了傳統(tǒng)GPU和谷歌TPU。

2024-02-26 10:24:46 289

289

北京2024年3月5日?/美通社/ -- 亞馬遜云科技宣布,致力于AI安全和研究的公司Anthropic的領(lǐng)先模型Claude 3系列將基于Amazon Bedrock提供服務(wù)。Claude 3系列

2024-03-06 15:45:26 198

198

電子發(fā)燒友App

電子發(fā)燒友App

評論