01

—

研究動(dòng)機(jī)

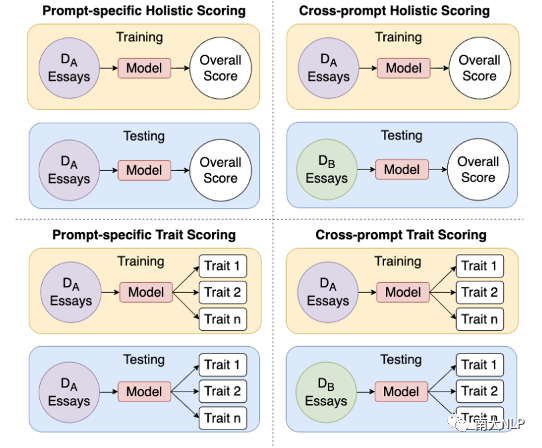

自動(dòng)作文評(píng)分(英文叫Automated Essay Scoring,簡(jiǎn)稱AES)旨在使用計(jì)算機(jī)來根據(jù)論文的整體質(zhì)量或與某些屬性(trait)相關(guān)的質(zhì)量來評(píng)分,例如,文章組織、切題程度、敘述性等。現(xiàn)有的大多數(shù)研究都是針對(duì)同一主題的已評(píng)分作文數(shù)據(jù)集上進(jìn)行模型的訓(xùn)練和預(yù)測(cè)(如圖1左上角和左下角),其中訓(xùn)練和測(cè)試數(shù)據(jù)都是從同一分布中(DA)提取的。

圖1: AES任務(wù)概覽

然而真實(shí)場(chǎng)景中的AES系統(tǒng)通常無法獲得足夠多的目標(biāo)主題文章,因此有必要研究如何預(yù)測(cè)訓(xùn)練數(shù)據(jù)中不存在的主題的文章分?jǐn)?shù)。因此,最近的一些研究探索了跨主題的AES,即從不同的主題中提取訓(xùn)練數(shù)據(jù)和測(cè)試數(shù)據(jù)(圖1的右上角)。跨主題的AES研究目前只關(guān)注根據(jù)論文的整體性來評(píng)分,而我們認(rèn)為一個(gè)有效的AES系統(tǒng)還應(yīng)該能夠提供屬性級(jí)別的反饋,因此,我們引入了一個(gè)新的AES任務(wù),即自動(dòng)跨主題作文屬性評(píng)分,該任務(wù)要求模型在僅有非目標(biāo)主題作文進(jìn)行訓(xùn)練的前提下,能夠準(zhǔn)確預(yù)測(cè)屬于目標(biāo)主題的文章的總分以及多個(gè)屬性的分?jǐn)?shù)(如圖1右下角),其中訓(xùn)練和測(cè)試數(shù)據(jù)來自不同的分布,輸出是不同屬性的分?jǐn)?shù)。

這項(xiàng)新的任務(wù)表現(xiàn)出兩個(gè)主要的挑戰(zhàn):

第一,模型需要有足夠的泛化能力,才能在新的主題中表現(xiàn)良好;

第二,模型需要能夠從不同的方面表示文章質(zhì)量,以便有效地對(duì)各種文章屬性進(jìn)行評(píng)分。

在探討自動(dòng)跨主題作文屬性評(píng)分的任務(wù)中,我們解決了兩個(gè)問題:

第一,屬于不同題目的文章有不同的trait集,因此許多trait有部分覆蓋率(論文中叫partial-trait coverage),這會(huì)導(dǎo)致某些trait的訓(xùn)練數(shù)據(jù)不足。例如,如果只有兩個(gè)題目的文章在敘述性trait上有分?jǐn)?shù)(所有其他題目的文章沒有),那一個(gè)被訓(xùn)練為這一trait打分的模型只能在這兩個(gè)題目的文章上進(jìn)行訓(xùn)練;

第二,不同trait之間存在高度的相關(guān)性。例如,一個(gè)在word choice的trait上分?jǐn)?shù)高的文章也可以預(yù)期在conventions上獲得很好的分?jǐn)?shù)。

為了解決partial-trait coverage的問題,我們引入了一種多任務(wù)的方法,即Cross-prompt Trait Scorer(CTS),該方法同時(shí)預(yù)測(cè)總體分?jǐn)?shù)和所有trait的分?jǐn)?shù)。這使得模型能夠?qū)τ?xùn)練集中的所有數(shù)據(jù)進(jìn)行訓(xùn)練,以學(xué)習(xí)更魯棒的表示。為了解決trait間關(guān)系的問題,我們?cè)O(shè)計(jì)了一個(gè)trait-attention機(jī)制,利用最相關(guān)的trait信息來預(yù)測(cè)每個(gè)trait的分?jǐn)?shù)。

02

—

貢獻(xiàn)

1.我們提出了一個(gè)新的任務(wù),即自動(dòng)主題作文屬性評(píng)分,它將AES解決方案中的兩個(gè)重要任務(wù)(跨主題作文評(píng)分和作文屬性評(píng)分)結(jié)合起來,從而更貼近真實(shí)場(chǎng)景。

2.我們?cè)O(shè)計(jì)了一個(gè)新的方法叫Cross-prompt Trait Scorer(CTS),通過使用多任務(wù)方法來解決由于partial-trait coverage而導(dǎo)致訓(xùn)練數(shù)據(jù)受限的問題。

3.我們?cè)O(shè)計(jì)了一個(gè)trait-attention機(jī)制來利用不同trait之間存在的關(guān)系。

03

—

解決方案

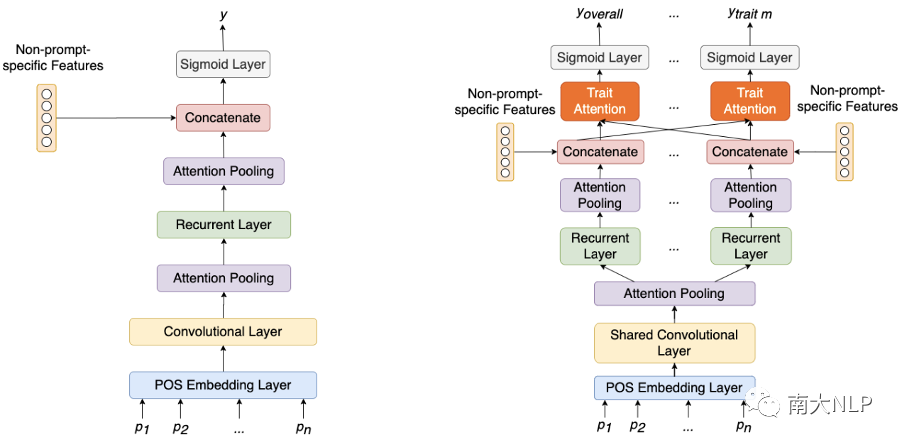

我們的方法建立在PAES(Ridley et al. 2020,如圖2左)之上,PAES是一個(gè)跨主題AES的SOTA方法。該方法利用詞性嵌入來學(xué)習(xí)廣義句法表示。首先,每個(gè)句子都有一個(gè)卷積層,通過attention pooling來實(shí)現(xiàn)句子級(jí)的表示。然后,這些表示被輸入一個(gè)recurrent層,該層使用LSTM,然后是第二個(gè)attention pooling層來學(xué)習(xí)完整的文章表示。然后將一組非主題特定的特征與文章表示鏈接起來,最后通過一個(gè)線性層和sigmoid激活來預(yù)測(cè)單個(gè)分?jǐn)?shù)。

這類方法通過獨(dú)立地對(duì)每個(gè)trait進(jìn)行訓(xùn)練,也可以直接應(yīng)用于本文提出的新任務(wù)中,然而這樣做有兩個(gè)問題:首先,如果訓(xùn)練數(shù)據(jù)中只有少量的文章?lián)碛心繕?biāo)trait的標(biāo)簽,那么就沒有足夠的數(shù)據(jù)來訓(xùn)練一個(gè)魯棒的模型。其次,這些trait并不是相互獨(dú)立的,而是相互關(guān)聯(lián)的。這種簡(jiǎn)單的方法不利用任何隱含的trait間的關(guān)系。

為了解決上述問題,我們?cè)O(shè)計(jì)了一個(gè)名為Cross prompt Trait Scorer(CTS)的模型,如圖2右所示。針對(duì)partial-trait coverage導(dǎo)致數(shù)據(jù)不足的問題,我們采用了基于多任務(wù)的體系結(jié)構(gòu),這使得模型能夠?qū)?shù)據(jù)集中的所有樣本進(jìn)行訓(xùn)練,以便學(xué)習(xí)更魯棒的編碼器表示。為了解決trait間的關(guān)系問題,我們?cè)谀P偷牡图?jí)別實(shí)現(xiàn)共享層,然后在高級(jí)別實(shí)現(xiàn)私有層。共享層旨在學(xué)習(xí)對(duì)所有任務(wù)都有用的通用表示。在多任務(wù)結(jié)構(gòu)中,高級(jí)別的層能夠表示更復(fù)雜的信息,因此私有層被用來學(xué)習(xí)更多的任務(wù)特定表示。此外,為了更明確地共享trait之間的信息,我們?cè)O(shè)計(jì)了一個(gè)trait-attention機(jī)制,允許每個(gè)trait集中于其他trait的相關(guān)信息。

圖2: PAES(左,Ridley et al. 2020)及本文給出的CTS模型(右)

04

—

實(shí)驗(yàn)

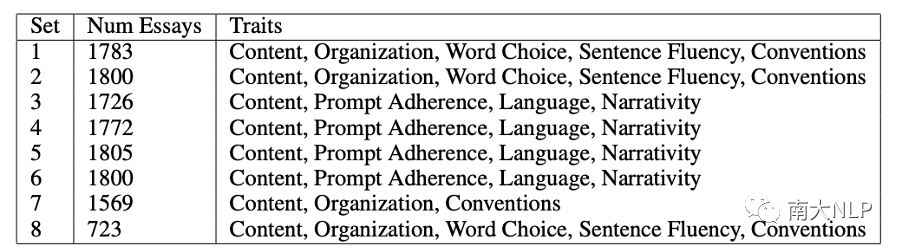

本文的實(shí)驗(yàn)是在Automated Student Assessment Prize(ASAP)數(shù)據(jù)集上進(jìn)行的。ASAP數(shù)據(jù)集包含八個(gè)不同的文章集,每個(gè)集中的文章都有不同的題目。每一篇文章都會(huì)根據(jù)文章的整體質(zhì)量獲得一個(gè)人性化的評(píng)分,而文章集7和8的文章則會(huì)根據(jù)評(píng)分標(biāo)準(zhǔn)對(duì)一些相關(guān)trait進(jìn)行額外評(píng)分。由于只有文章集7和8具有trait分?jǐn)?shù),因此我們還使用了ASAP++數(shù)據(jù)集,該數(shù)據(jù)集是在原始ASAP數(shù)據(jù)集的基礎(chǔ)上構(gòu)建的。ASAP++的作者為文章集1-6提供了各種相關(guān)trait的分?jǐn)?shù),以補(bǔ)充ASAP的原始總分。

表1: ASAP和ASAP++數(shù)據(jù)集中的屬性定義

每個(gè)文章集的trait如表1所示,文章集1-6的trait分?jǐn)?shù)來自補(bǔ)充的ASAP++數(shù)據(jù)集,文章集7和8的trait分?jǐn)?shù)來自ASAP數(shù)據(jù)集。所有的總分都來自原始的ASAP數(shù)據(jù)集。

在實(shí)驗(yàn)中,一個(gè)文章集的作文被用作測(cè)試數(shù)據(jù),其余幾組的文章被用作訓(xùn)練數(shù)據(jù)。對(duì)于每個(gè)文章集重復(fù)此操作。在每種情況下,開發(fā)集包含與訓(xùn)練集相同集的文章。

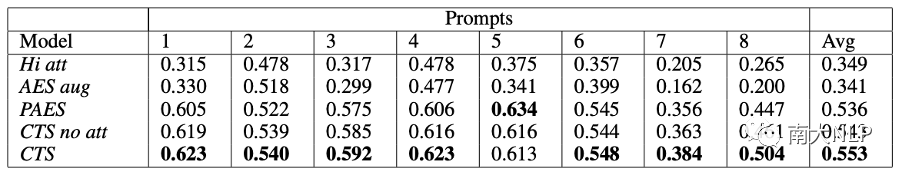

我們將CTS與四個(gè)baseline模型進(jìn)行了比較,Hi att和AES aug都是在Prompt-specific Holistic scoring和Prompt-specific Trait Scoring都取得了很好性能的模型,PAES是我們的base模型,是一個(gè)面向Cross-prompt Holistic Scoring的SOTA方法,最后,CTS no att是我們的CTS模型的一個(gè)消融版本,沒有添加trait-attention機(jī)制。

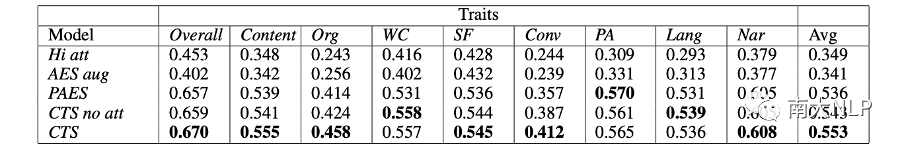

表2:各文章集的平均QWK值

表3:各屬性的平均QWK值

在表2中,我們顯示了每個(gè)文章集的所有trait的平均分?jǐn)?shù),在表3中,我們顯示了每個(gè)trait的所有文章集的平均分?jǐn)?shù)。從這兩個(gè)表來看,我們可以看出兩個(gè)面向Prompt-specific的方法(Hi att 和AES aug)都表現(xiàn)不好。這是因?yàn)檫@些模型不是為Cross-prompt的設(shè)置設(shè)計(jì)的,因此它們過擬合很嚴(yán)重。

當(dāng)我們比較三種面向Cross-prompt模型時(shí),我們可以看到,除了文章集5外,CTS在所有文章集上的性能都超過了PAES和CTS no att,而且在大多數(shù)文章集中,多任務(wù)方法CTS no att的性能都優(yōu)于單任務(wù)方法PAES。這是因?yàn)镻AES無法利用完整的訓(xùn)練數(shù)據(jù)集,它只能在目標(biāo)trait有標(biāo)簽的樣本上進(jìn)行訓(xùn)練。CTS no att和CTS的多任務(wù)結(jié)構(gòu)能夠利用訓(xùn)練集中的所有樣本進(jìn)行訓(xùn)練。

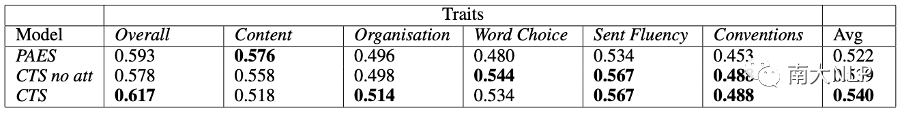

表4:文章集2中每個(gè)屬性的平均QWK值

我們還通過實(shí)驗(yàn)來驗(yàn)證可用的訓(xùn)練數(shù)據(jù)的數(shù)量對(duì)模型性能的影響。表4中顯示了PAES、CTS no att和CTS的文章集2的每個(gè)屬性的性能。在這個(gè)表格中,有Word Choice和Sentence Fluency只出現(xiàn)在另外兩個(gè)文章集中。因此,在對(duì)這兩個(gè)屬性進(jìn)行評(píng)分時(shí),基于單任務(wù)方法僅能對(duì)訓(xùn)練集9499篇論文中的2129篇進(jìn)行訓(xùn)練,與其他兩個(gè)模型相比,這兩個(gè)trait的表現(xiàn)顯著降低。

圖3:預(yù)測(cè)文章集3的總分時(shí)所有屬性的注意力權(quán)重

為了深入了解trait-attention機(jī)制的運(yùn)作方式,我們將注意力權(quán)重可視化。在圖3中,當(dāng)預(yù)測(cè)文章集3的總分時(shí),由于這是一個(gè)整體評(píng)分,應(yīng)該從多個(gè)不同方面考慮文章的質(zhì)量,因此我們可以看到注意力在所有屬性中的分布相對(duì)均勻,基本沒有權(quán)重明顯高于其他屬性的屬性。

圖4:預(yù)測(cè)文章集3的Language分?jǐn)?shù)時(shí)的屬性注意權(quán)重

圖4則顯示了在預(yù)測(cè)文章集3的Language分?jǐn)?shù)時(shí)的trait注意權(quán)重。這是一個(gè)比總分更具體、更集中的屬性,此時(shí)與語言密切相關(guān)的屬性Word Choice的權(quán)重要明顯高于其他屬性權(quán)重。

05

—

總結(jié)

為了滿足真實(shí)場(chǎng)景中AES系統(tǒng)的需求,我們引入了一個(gè)新的AES任務(wù),即Automated Cross-prompt Scoring of Essay Traits。此外,我們還提出了一個(gè)新的方法(Cross-prompt Trait Scorer),它利用共享和私有層的多任務(wù)結(jié)構(gòu)以及trait-attention機(jī)制來解決在跨主題設(shè)置中某些屬性數(shù)據(jù)有限以及屬性間關(guān)系利用的兩個(gè)問題。

責(zé)任編輯:xj

原文標(biāo)題:【AAAI2021】自動(dòng)跨主題作文屬性評(píng)分

文章出處:【微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

-

機(jī)器學(xué)習(xí)

+關(guān)注

關(guān)注

66文章

8500瀏覽量

134508 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5560瀏覽量

122750

原文標(biāo)題:【AAAI2021】自動(dòng)跨主題作文屬性評(píng)分

文章出處:【微信號(hào):zenRRan,微信公眾號(hào):深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

連續(xù)四年!Splashtop 再度榮膺 TrustRadius 最高評(píng)分獎(jiǎng)

ArkUI-X跨平臺(tái)應(yīng)用改造指南

ArkUI-X跨平臺(tái)框架接入指南

如何在設(shè)備上通過USBEZ-USB?將第二個(gè)SPI閃存用作文件系統(tǒng)的應(yīng)用說明或建議?

深入探索GCC的attribute屬性

Chart FX-使用API傳輸數(shù)據(jù) 使用Value屬性傳輸數(shù)據(jù)

晶科能源標(biāo)普ESG評(píng)分位居光伏組件企業(yè)之首

TSP研究:車內(nèi)網(wǎng)聯(lián)服務(wù)向跨域融合、全場(chǎng)景融合、艙駕融合方向拓展

SOLIDWORKS高級(jí)BOM及屬性批量導(dǎo)入工具

Linux用戶身份與進(jìn)程權(quán)限詳解

Zoom推出AI協(xié)作文件方案Zoom Docs

OPA847進(jìn)行跨阻放大震蕩的原因?

跨網(wǎng)段 IP 地址通信故障分析

自動(dòng)跨主題作文屬性評(píng)分研究

自動(dòng)跨主題作文屬性評(píng)分研究

評(píng)論